1. Introdução

A utilidade dos agentes de IA depende dos dados que eles podem acessar. A maioria dos dados do mundo real está em bancos de dados. Conectar agentes a eles geralmente significa escrever gerenciamento de conexões, lógica de consultas e incorporar pipelines no código do agente. Cada agente que precisa de acesso ao banco de dados repete esse trabalho, e cada mudança de consulta exige a nova implantação do agente.

Este codelab mostra uma abordagem diferente. Você declara as ferramentas de banco de dados em um arquivo YAML (consultas SQL padrão, pesquisa de similaridade vetorial e até mesmo geração automática de embeddings), e a MCP Toolbox para bancos de dados processa todas as operações de banco de dados como um servidor MCP. O código do seu agente permanece mínimo: carregue as ferramentas e deixe o Gemini decidir qual chamar.

O que você vai criar

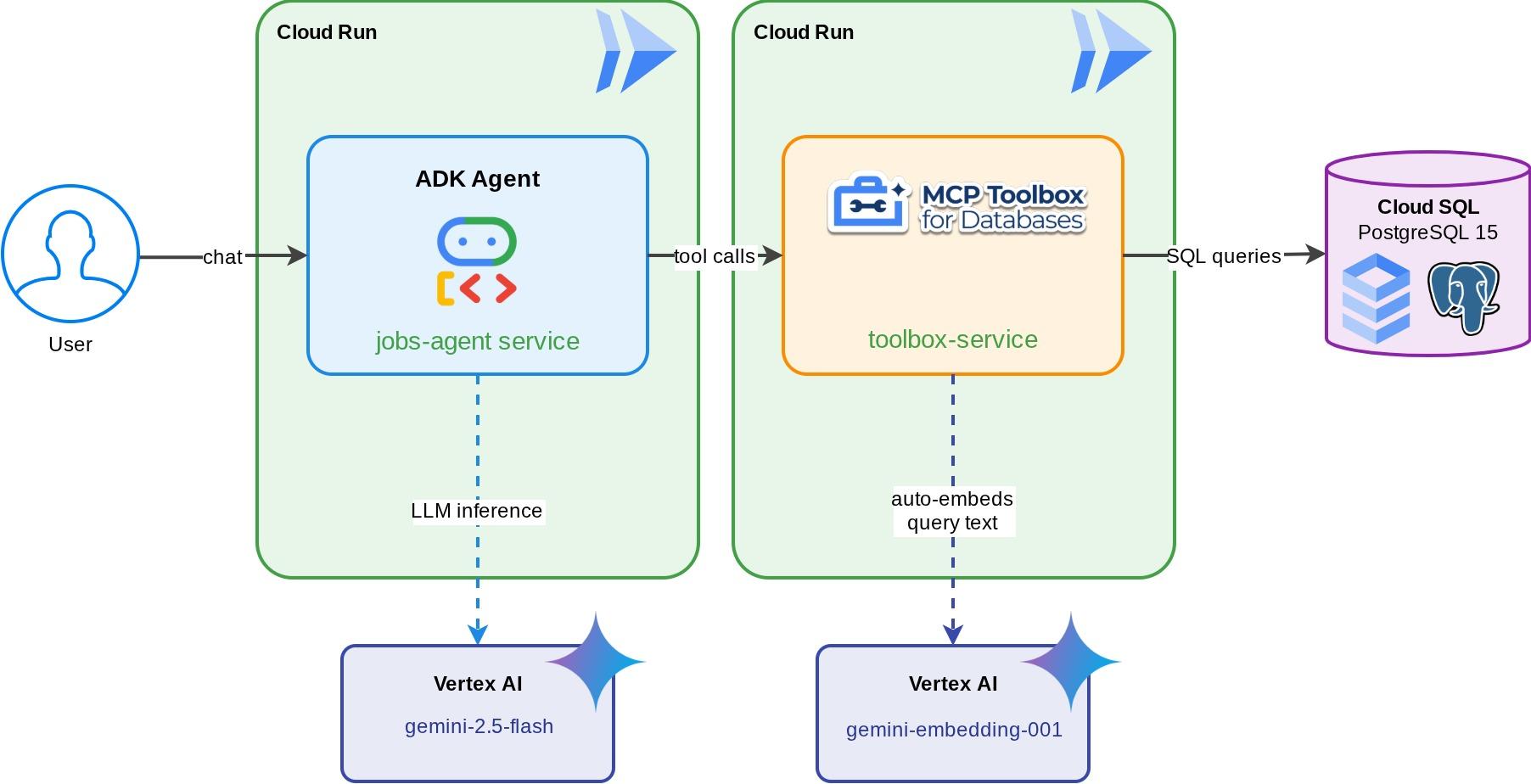

Um assistente de quadro de empregos inteligente para "TechJobs", um agente do ADK com tecnologia do Gemini que ajuda os desenvolvedores a navegar em listas de empregos de tecnologia usando filtros padrão (função, conjunto de tecnologias) e descobrir vagas com descrições em linguagem natural, como "Quero um emprego remoto trabalhando com chatbots de IA". O agente lê e grava em um banco de dados do Cloud SQL PostgreSQL totalmente pela MCP Toolbox for Databases, que processa todo o acesso ao banco de dados, incluindo a geração automática de embeddings para pesquisa vetorial. No final, a caixa de ferramentas e o agente serão executados no Cloud Run.

O que você vai aprender

- Como o MCP (Protocolo de Contexto de Modelo) padroniza o acesso a ferramentas para agentes de IA e como a MCP Toolbox para bancos de dados aplica isso às operações de banco de dados

- Configurar o MCP Toolbox for Databases como middleware entre um agente ADK e o Cloud SQL PostgreSQL

- Defina ferramentas de banco de dados de forma declarativa em

tools.yaml. Não é necessário código de banco de dados no seu agente. - Criar um agente do ADK que carrega ferramentas de um servidor da caixa de ferramentas em execução usando

ToolboxToolset - Gerar embeddings de vetores usando a função

embedding()integrada do Cloud SQL e ativar a pesquisa semântica compgvector - Usar o recurso

valueFromParampara ingestão automática de vetores em operações de gravação - Implantar o servidor da caixa de ferramentas e o agente do ADK no Cloud Run

Pré-requisitos

- Uma conta do Google Cloud com uma conta de faturamento de teste

- Conhecimento básico de Python e SQL

- Experiência prévia com o Cloud Database e o ADK é útil

2. Configuração de seu ambiente

Esta etapa prepara seu ambiente do Cloud Shell, configura seu projeto do Google Cloud e clona o repositório de referência.

Abra o Cloud Shell

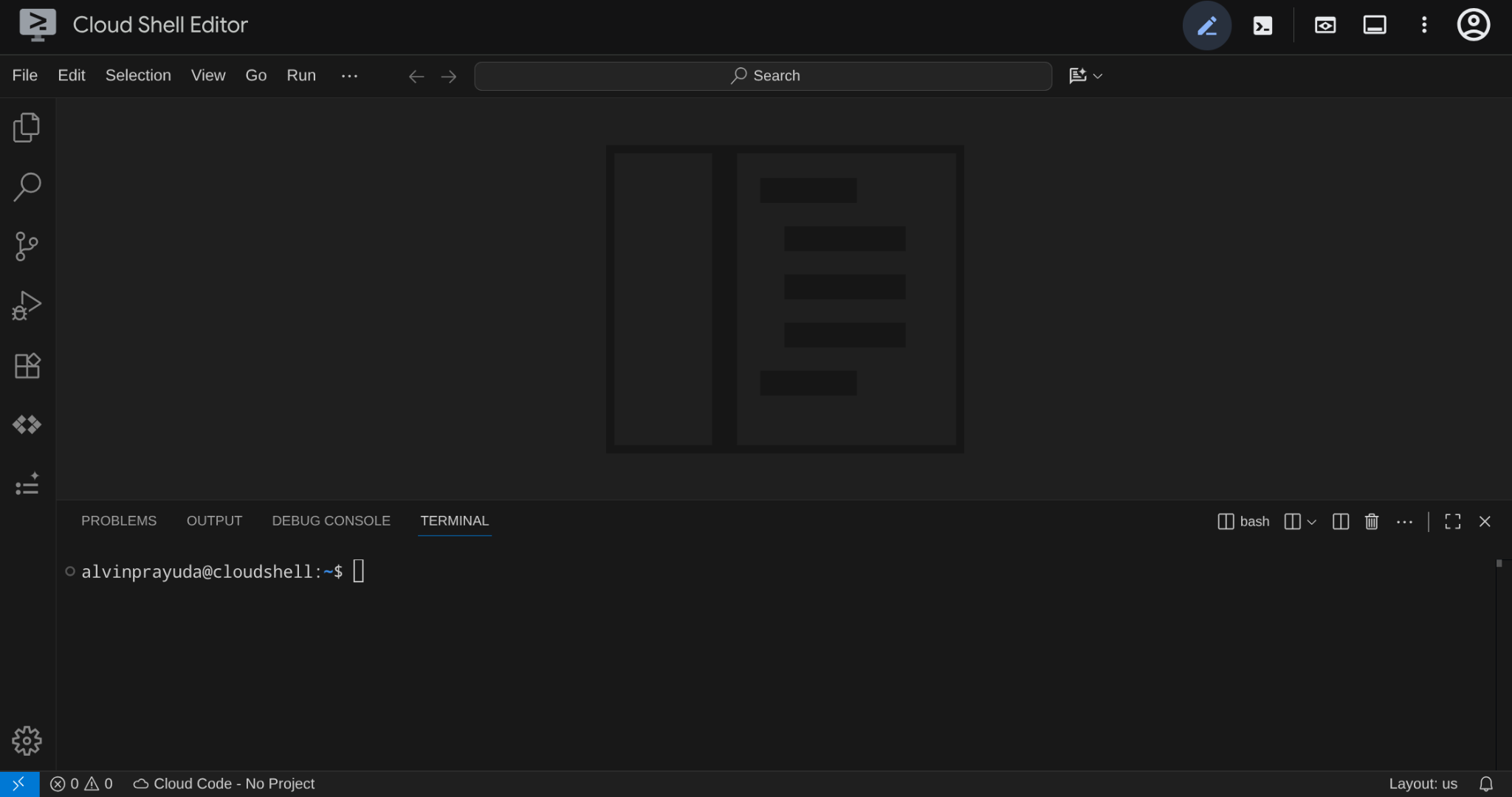

Abra o Cloud Shell no navegador. O Cloud Shell oferece um ambiente pré-configurado com todas as ferramentas necessárias para este codelab. Clique em Autorizar quando solicitado a

Em seguida, clique em Visualizar -> Terminal para abrir o terminal.Sua interface vai ficar parecida com esta:

Essa será nossa interface principal, com o IDE na parte de cima e o terminal na parte de baixo.

Configurar seu diretório de trabalho

Crie o diretório de trabalho. Todo o código que você escrever neste codelab vai ficar aqui:

mkdir -p ~/build-agent-adk-toolbox-cloudsql

cloudshell workspace ~/build-agent-adk-toolbox-cloudsql && cd ~/build-agent-adk-toolbox-cloudsql

Depois disso, vamos preparar vários diretórios para gerenciar itens como scripts de propagação e registros.

mkdir -p ~/build-agent-adk-toolbox-cloudsql/scripts

mkdir -p ~/build-agent-adk-toolbox-cloudsql/logs

Configuração no projeto do Google Cloud

Crie o arquivo .env com as variáveis de local:

# For Vertex AI / Gemini API calls

echo "GOOGLE_CLOUD_LOCATION=global" > .env

# For Cloud SQL, Cloud Run, Artifact Registry

echo "REGION=us-central1" >> .env

Para simplificar a configuração do projeto no terminal, baixe este script de configuração no diretório de trabalho:

curl -sL https://raw.githubusercontent.com/alphinside/cloud-trial-project-setup/main/setup_verify_trial_project.sh -o setup_verify_trial_project.sh

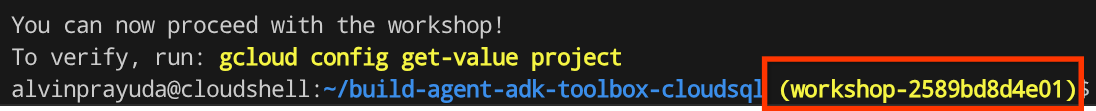

Execute o script. Ele verifica sua conta de faturamento de teste, cria um novo projeto (ou valida um existente), salva o ID do projeto em um arquivo .env no diretório atual e define o projeto ativo em gcloud.

bash setup_verify_trial_project.sh && source .env

O script faz o seguinte:

- Verifique se você tem uma conta de faturamento de teste ativa

- Verifique se há um projeto em

.env(se houver). - Crie um novo projeto ou reutilize o atual

- Vincular a conta de faturamento de teste ao projeto

- Salve o ID do projeto em

.env - Defina o projeto como o projeto

gcloudativo

Verifique se o projeto está definido corretamente conferindo o texto amarelo ao lado do diretório de trabalho no prompt do terminal do Cloud Shell. Ele vai mostrar o ID do projeto.

Ativar a API necessária

Em seguida, precisamos ativar várias APIs para o produto com que vamos interagir:

gcloud services enable \

aiplatform.googleapis.com \

sqladmin.googleapis.com \

compute.googleapis.com \

run.googleapis.com \

cloudbuild.googleapis.com \

artifactregistry.googleapis.com

- API Vertex AI (

aiplatform.googleapis.com): seu agente usa modelos do Gemini, e a caixa de ferramentas usa a API Embedding para pesquisa vetorial. - API Cloud SQL Admin (

sqladmin.googleapis.com): você provisiona e gerencia uma instância do PostgreSQL. - API Compute Engine (

compute.googleapis.com): necessária para criar instâncias do Cloud SQL. - Cloud Run, Cloud Build, Artifact Registry: usados na etapa de implantação mais adiante neste codelab.

3. Como preparar scripts para inicialização de banco de dados

Esta etapa inicia a criação da instância do Cloud SQL e executa um script de configuração automatizado que aguarda a instância ficar pronta, cria o banco de dados, o preenche com anúncios de emprego e gera incorporações, tudo em uma única operação.

Primeiro, adicione a senha do banco de dados ao arquivo .env e recarregue-o:

echo "DB_PASSWORD=techjobs-pwd" >> .env

echo "DB_INSTANCE=jobs-instance" >> .env

echo "DB_NAME=jobs_db" >> .env

source .env

Como criar um script Bash para criação de instâncias e bancos de dados

Em seguida, crie o script scripts/setup_database.sh com o seguinte comando:

mkdir -p ~/build-agent-adk-toolbox-cloudsql/scripts

cloudshell edit scripts/setup_database.sh

Em seguida, copie o código abaixo no arquivo scripts/setup_database.sh.

#!/bin/bash

set -e

source .env

echo "================================================"

echo "Database Setup"

echo "================================================"

echo ""

# Step 1: Create Cloud SQL instance

echo "[1/5] Creating Cloud SQL instance..."

# Check if instance already exists

if gcloud sql instances describe "$DB_INSTANCE" --quiet >/dev/null 2>&1; then

echo " Instance already exists"

else

echo " Creating instance (takes 5-10 minutes)..."

gcloud sql instances create "$DB_INSTANCE" \

--database-version=POSTGRES_17 \

--tier=db-custom-1-3840 \

--edition=ENTERPRISE \

--region="$REGION" \

--root-password="$DB_PASSWORD" \

--enable-google-ml-integration \

--database-flags cloudsql.enable_google_ml_integration=on \

--quiet

fi

echo " ✓ Instance ready"

echo ""

# Step 2: Verify instance is ready

echo "[2/5] Verifying instance state..."

STATE=$(gcloud sql instances describe "$DB_INSTANCE" --format='value(state)')

if [ "$STATE" != "RUNNABLE" ]; then

echo "ERROR: Instance not ready (state: $STATE)"

exit 1

fi

echo " ✓ Instance is RUNNABLE"

echo ""

# Step 3: Grant IAM permissions

echo "[3/5] Granting Vertex AI permissions..."

SERVICE_ACCOUNT=$(gcloud sql instances describe "$DB_INSTANCE" \

--format='value(serviceAccountEmailAddress)')

if [ -z "$SERVICE_ACCOUNT" ]; then

echo "ERROR: Could not retrieve service account"

exit 1

fi

gcloud projects add-iam-policy-binding "$GOOGLE_CLOUD_PROJECT" \

--member="serviceAccount:$SERVICE_ACCOUNT" \

--role="roles/aiplatform.user" \

--quiet

echo " ✓ Permissions granted"

echo ""

# Step 4: Create database

echo "[4/5] Creating database..."

# Check if database already exists

if gcloud sql databases describe "$DB_NAME" \

--instance="$DB_INSTANCE" --quiet >/dev/null 2>&1; then

echo " Database already exists"

else

gcloud sql databases create "$DB_NAME" \

--instance="$DB_INSTANCE" \

--quiet

fi

echo " ✓ Database '$DB_NAME' ready"

echo ""

# Step 5: Seed database and generate embeddings

echo "[5/5] Seeding database and generating embeddings..."

SCRIPT_DIR="$(cd "$(dirname "${BASH_SOURCE[0]}")" && pwd)"

SETUP_SCRIPT="${SCRIPT_DIR}/setup_jobs_db.py"

if [ ! -f "$SETUP_SCRIPT" ]; then

echo "ERROR: Setup script not found: $SETUP_SCRIPT"

exit 1

fi

uv run "$SETUP_SCRIPT"

echo ""

echo "================================================"

echo "Setup complete!"

echo "================================================"

echo ""

Como criar um script Python para propagação de dados

Depois disso, crie o arquivo Python do script de propagação scripts/setup_jobs_db.py usando o comando abaixo:

cloudshell edit scripts/setup_jobs_db.py

Em seguida, copie o código abaixo no arquivo scripts/setup_jobs_db.py.

import os

import sys

from pathlib import Path

from dotenv import load_dotenv

from google.cloud.sql.connector import Connector

import pg8000

import time

# Load environment variables from .env file

env_path = Path(__file__).parent.parent / '.env'

load_dotenv(env_path)

EMBEDDING_MODEL='gemini-embedding-001'

# Verify required environment variables

required_vars = ['GOOGLE_CLOUD_PROJECT', 'REGION', 'DB_PASSWORD']

missing_vars = [var for var in required_vars if not os.environ.get(var)]

if missing_vars:

print(f"ERROR: Missing required environment variables: {', '.join(missing_vars)}", file=sys.stderr)

print(f"", file=sys.stderr)

print(f"Expected .env file location: {env_path}", file=sys.stderr)

if not env_path.exists():

print(f"✗ File not found at that location", file=sys.stderr)

else:

print(f"✓ File exists but is missing the variables above", file=sys.stderr)

print(f"", file=sys.stderr)

print(f"Make sure your .env file contains:", file=sys.stderr)

for var in missing_vars:

print(f" {var}=<value>", file=sys.stderr)

sys.exit(1)

# Job listings data (fictional, for tutorial purposes only)

JOBS = [

("Senior Backend Engineer", "Stripe", "Backend", "Go, PostgreSQL, gRPC, Kubernetes", "$180-250K/year", "San Francisco, Hybrid", 3,

"Design and build high-throughput microservices powering payment infrastructure for millions of businesses. Optimize Go services for sub-100ms latency at scale, work with PostgreSQL and Redis for data persistence, and deploy on Kubernetes clusters handling billions of API calls."),

("Machine Learning Engineer", "Spotify", "Data/AI", "Python, TensorFlow, BigQuery, Vertex AI", "$170-230K/year", "Stockholm, Remote", 2,

"Build and deploy ML models for music recommendation and personalization systems serving hundreds of millions of listeners. Design feature pipelines in BigQuery, train models using distributed computing, and serve predictions through real-time APIs processing thousands of requests per second."),

("Frontend Engineer", "Vercel", "Frontend", "React, TypeScript, Next.js", "$140-190K/year", "Remote", 4,

"Build developer-facing dashboard interfaces and deployment tools used by millions of developers worldwide. Create responsive, accessible React components for project management, analytics, and real-time deployment monitoring with a focus on developer experience."),

("DevOps Engineer", "Datadog", "DevOps", "Terraform, GCP, Docker, Kubernetes, ArgoCD", "$160-220K/year", "New York, Hybrid", 2,

"Manage cloud infrastructure powering an observability platform used by thousands of engineering teams. Automate deployment pipelines with ArgoCD, manage multi-cloud Kubernetes clusters, and implement infrastructure-as-code with Terraform across production environments."),

("Mobile Engineer (Android)", "Grab", "Mobile", "Kotlin, Jetpack Compose, GraphQL", "$120-170K/year", "Singapore, Hybrid", 3,

"Develop features for a super-app serving millions of users across Southeast Asia. Build modern Android UIs with Jetpack Compose, integrate GraphQL APIs, and optimize app performance for diverse device capabilities and network conditions."),

("Data Engineer", "Airbnb", "Data", "Python, Apache Spark, Airflow, BigQuery", "$160-210K/year", "San Francisco, Hybrid", 2,

"Build data pipelines that process booking, search, and pricing data for a global travel marketplace. Design ETL workflows with Apache Spark and Airflow, maintain data warehouses in BigQuery, and ensure data quality for analytics and machine learning teams."),

("Full Stack Engineer", "Revolut", "Full Stack", "TypeScript, Node.js, React, PostgreSQL", "$130-180K/year", "London, Remote", 5,

"Build the next generation of financial products making banking accessible to millions of users across 35 countries. Develop real-time trading interfaces with React and WebSockets, build Node.js APIs handling market data streams, and design PostgreSQL schemas for financial transactions."),

("Site Reliability Engineer", "Cloudflare", "SRE", "Go, Prometheus, Grafana, GCP, Terraform", "$170-230K/year", "Austin, Hybrid", 2,

"Ensure 99.99% uptime for a global network handling millions of requests per second. Define SLOs, build monitoring dashboards with Prometheus and Grafana, manage incident response, and automate infrastructure scaling across 300+ data centers worldwide."),

("Cloud Architect", "Google Cloud", "Cloud", "GCP, Terraform, Kubernetes, Python", "$200-280K/year", "Seattle, Hybrid", 1,

"Help enterprises modernize their infrastructure on Google Cloud. Design multi-region architectures, lead migration projects from on-premises to GKE, and build reference implementations using Terraform and Cloud Foundation Toolkit."),

("Backend Engineer (Payments)", "Square", "Backend", "Java, Spring Boot, PostgreSQL, Kafka", "$160-220K/year", "San Francisco, Hybrid", 3,

"Build payment processing systems handling millions of transactions for businesses of all sizes. Design event-driven architectures using Kafka, implement idempotent payment flows with Spring Boot, and ensure PCI-DSS compliance across all services."),

("AI Engineer", "Hugging Face", "Data/AI", "Python, LangChain, Vertex AI, FastAPI, PostgreSQL", "$150-210K/year", "Paris, Remote", 2,

"Build AI-powered tools for the largest open-source ML community. Develop RAG pipelines that index and search model documentation, create conversational agents using LangChain, and deploy AI services with FastAPI on cloud infrastructure."),

("Platform Engineer", "Coinbase", "Platform", "Rust, Kubernetes, AWS, Terraform", "$180-250K/year", "Remote", 0,

"Build the infrastructure platform for a leading cryptocurrency exchange. Develop high-performance matching engines in Rust, manage Kubernetes clusters for microservices, and design CI/CD pipelines that enable rapid feature deployment with zero downtime."),

("QA Automation Engineer", "Shopify", "QA", "Python, Selenium, Cypress, Jenkins", "$110-160K/year", "Toronto, Hybrid", 3,

"Design and maintain automated test suites for a commerce platform powering millions of merchants. Build end-to-end test frameworks with Cypress and Selenium, integrate tests into Jenkins CI pipelines, and establish quality gates that prevent regressions in checkout and payment flows."),

("Security Engineer", "CrowdStrike", "Security", "Python, SIEM, Kubernetes, Penetration Testing", "$170-240K/year", "Austin, On-site", 1,

"Protect enterprise customers from cyber threats on a leading endpoint security platform. Conduct penetration testing, design security monitoring with SIEM tools, implement zero-trust networking in Kubernetes environments, and lead incident response for security events."),

("Product Engineer", "GitLab", "Full Stack", "Go, React, PostgreSQL, Redis, GCP", "$140-200K/year", "Remote", 4,

"Own features end-to-end for an all-in-one DevSecOps platform used by millions of developers. Build Go microservices for CI/CD pipelines, create React frontends for code review and project management, and collaborate with product managers to iterate on user-facing features using data-driven development."),

]

def get_connection():

"""Create a connection to Cloud SQL using the connector."""

project = os.environ['GOOGLE_CLOUD_PROJECT']

region = os.environ['REGION']

password = os.environ['DB_PASSWORD']

instance = os.environ['DB_INSTANCE']

database = os.environ['DB_NAME']

connector = Connector()

conn = connector.connect(

f"{project}:{region}:{instance}",

"pg8000",

user="postgres",

password=password,

db=database

)

return conn, connector

def create_schema(cursor):

"""Create extensions and jobs table."""

cursor.execute("CREATE EXTENSION IF NOT EXISTS google_ml_integration")

cursor.execute("CREATE EXTENSION IF NOT EXISTS vector")

cursor.execute("""

CREATE TABLE IF NOT EXISTS jobs (

id SERIAL PRIMARY KEY,

title VARCHAR NOT NULL,

company VARCHAR NOT NULL,

role VARCHAR NOT NULL,

tech_stack VARCHAR NOT NULL,

salary_range VARCHAR NOT NULL,

location VARCHAR NOT NULL,

openings INTEGER NOT NULL,

description TEXT NOT NULL,

description_embedding vector(3072)

)

""")

def seed_jobs(cursor, conn):

"""Insert job listings."""

cursor.execute("SELECT COUNT(*) FROM jobs")

existing_count = cursor.fetchone()[0]

if existing_count > 0:

print(f" {existing_count} jobs already exist, skipping seed")

return 0

cursor.executemany("""

INSERT INTO jobs (title, company, role, tech_stack, salary_range, location, openings, description)

VALUES (%s, %s, %s, %s, %s, %s, %s, %s)

""", JOBS)

conn.commit()

return len(JOBS)

def generate_embeddings(cursor, conn):

"""Generate embeddings using Cloud SQL's embedding() function."""

cursor.execute("SELECT COUNT(*) FROM jobs WHERE description_embedding IS NULL")

null_count = cursor.fetchone()[0]

if null_count == 0:

print(" All jobs already have embeddings")

return 0

cursor.execute(f"""

UPDATE jobs

SET description_embedding = embedding('{EMBEDDING_MODEL}', description)::vector

WHERE description_embedding IS NULL

""")

rows_updated = cursor.rowcount

conn.commit()

return rows_updated

def main():

conn, connector = get_connection()

cursor = conn.cursor()

try:

create_schema(cursor)

conn.commit()

seeded = seed_jobs(cursor, conn)

if seeded > 0:

print(f" ✓ Inserted {seeded} jobs")

# Waiting for vertex role propagation

time.sleep(60)

embedded = generate_embeddings(cursor, conn)

if embedded > 0:

print(f" ✓ Generated {embedded} embeddings")

except Exception as e:

print(f"ERROR: {e}", file=sys.stderr)

sys.exit(1)

finally:

cursor.close()

conn.close()

connector.close()

if __name__ == "__main__":

main()

Agora, vamos para a próxima etapa

4. Criar e inicializar o banco de dados

Agora nossos scripts estão prontos para serem executados. Vamos precisar do Python para executar o script preparado. Então, vamos preparar isso primeiro.

Configurar o projeto Python

uv é um gerenciador de projetos e pacotes Python rápido escrito em Rust ( documentações do uv). Este codelab o usa para agilidade e simplicidade na manutenção do projeto Python.

Inicialize um projeto Python e adicione as dependências necessárias:

uv init

uv add cloud-sql-python-connector --extra pg8000

uv add python-dotenv

Estamos usando o SDK do Python cloud-sql-python-connector para inicializar uma conexão segura com a instância do banco de dados, que é autenticada usando o Application Default Credentials.

Execute o script de configuração

Agora, podemos executar o script de configuração em segundo plano e inspecionar a saída do console, que será gravada no arquivo logs/atabase_setup.log usando o seguinte comando. Você pode continuar para a próxima seção enquanto espera a conclusão.

mkdir -p ~/build-agent-adk-toolbox-cloudsql/logs

bash scripts/setup_database.sh > logs/database_setup.log 2>&1 &

Baixe o binário da caixa de ferramentas

Vamos usar a caixa de ferramentas do MCP neste tutorial. Felizmente, ela vem com um binário pré-criado pronto para ser usado no ambiente Linux. Agora, vamos fazer o download em segundo plano, já que isso leva um tempo. Execute o comando a seguir para fazer o download do binário e inspecionar o registro de saída no logs/toolbox_dl.log . Você pode continuar para a próxima seção enquanto espera a conclusão.

cd ~/build-agent-adk-toolbox-cloudsql

curl -O https://storage.googleapis.com/mcp-toolbox-for-databases/v1.0.0/linux/amd64/toolbox > logs/toolbox_dl.log 2>&1 &

Como entender o script de configuração scripts/setup_database.sh

Agora vamos tentar entender o script de configuração que configuramos anteriormente. Ele faz o seguinte processo:

- O primeiro comando que executamos é o

gcloud sql instances createcom a seguinte flag:

db-custom-1-3840é o menor nível do Cloud SQL de núcleo dedicado (1 vCPU, 3,75 GB de RAM) na ediçãoENTERPRISE. Leia mais detalhes aqui. Um núcleo dedicado é necessário para a integração de ML da Vertex AI. Os níveis de núcleo compartilhado (db-f1-micro,db-g1-small) não oferecem suporte a ela.--root-passworddefine a senha do usuáriopostgrespadrão.- O

--enable-google-ml-integrationativa a integração integrada do Cloud SQL com a Vertex AI, permitindo que você chame modelos de embedding diretamente do SQL usando a funçãoembedding().

- Verifique se a instância já está no status

RUNNABLE. - Conceda à conta de serviço da instância do Cloud SQL permissão para chamar a Vertex AI usando o comando

gcloud projects add-iam-policy-binding. Isso é necessário para a funçãoembedding()integrada que usaremos ao propagar o banco de dados. - Criar o banco de dados

- Executar o script de inicialização

setup_jobs_db.py

Como entender o script de inicialização scripts/setup_jobs_db.py

Agora, passando para o script de propagação, ele faz o seguinte:

- Inicializar a conexão com a instância do banco de dados

- Instala duas extensões do PostgreSQL:

google_ml_integration: fornece a função SQLembedding(), que chama modelos de embedding da Vertex AI diretamente do SQL. É uma extensão no nível do banco de dados que disponibiliza funções de ML nojobs_db. A flag no nível da instância (--enable-google-ml-integration) definida durante a criação da instância permite que a VM do Cloud SQL alcance a Vertex AI. A extensão disponibiliza as funções SQL nesse banco de dados específico.vector(pgvector): adiciona o tipo de dadosvectore operadores de distância para armazenar e consultar incorporações.

- Crie a tabela. Observe que a coluna

description_embeddingévector(3072), uma colunapgvectorque armazena vetores de 3.072 dimensões. - Propagar os dados iniciais de jobs

- Gere os dados de embedding do campo

descriptione preencha odescription_embeddingusando a integração do Vertex integrada pela funçãoembedding().

embedding('gemini-embedding-001', description): chama o modelo de embedding do Gemini da Vertex AI diretamente do SQL, transmitindo o textodescriptionde cada vaga. Essa é a extensãogoogle_ml_integrationque você instalou no script de inicialização.::vector: converte a matriz de ponto flutuante retornada para o tipovectordo pgvector para que ela possa ser armazenada e consultada com operadores de distância.- O

UPDATEé executado em todas as 15 linhas, gerando uma incorporação de 3.072 dimensões por descrição de vaga.

Isso vai preparar os dados iniciais que serão acessados pelo nosso agente.

5. Configurar a MCP Toolbox para bancos de dados

Esta etapa apresenta a caixa de ferramentas do MCP para bancos de dados, configura a conexão com sua instância do Cloud SQL e define duas ferramentas padrão de consulta SQL.

O que é o MCP e por que usar a Toolbox?

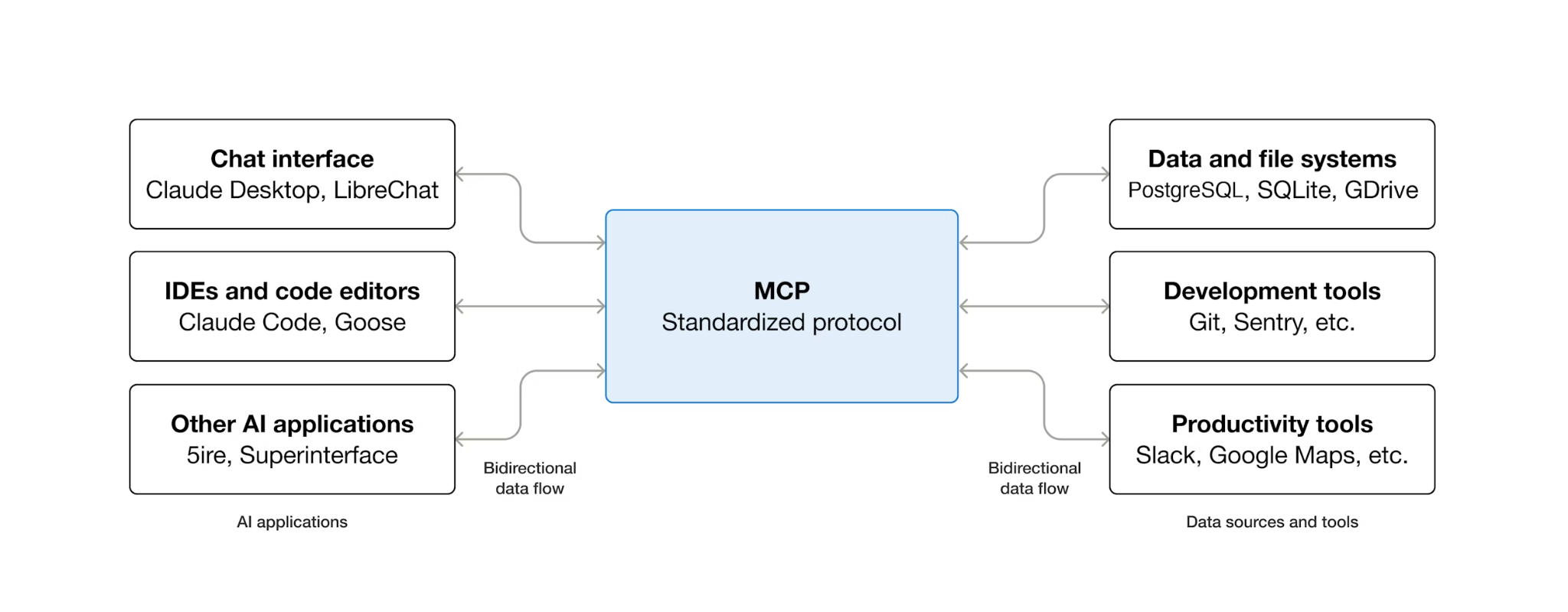

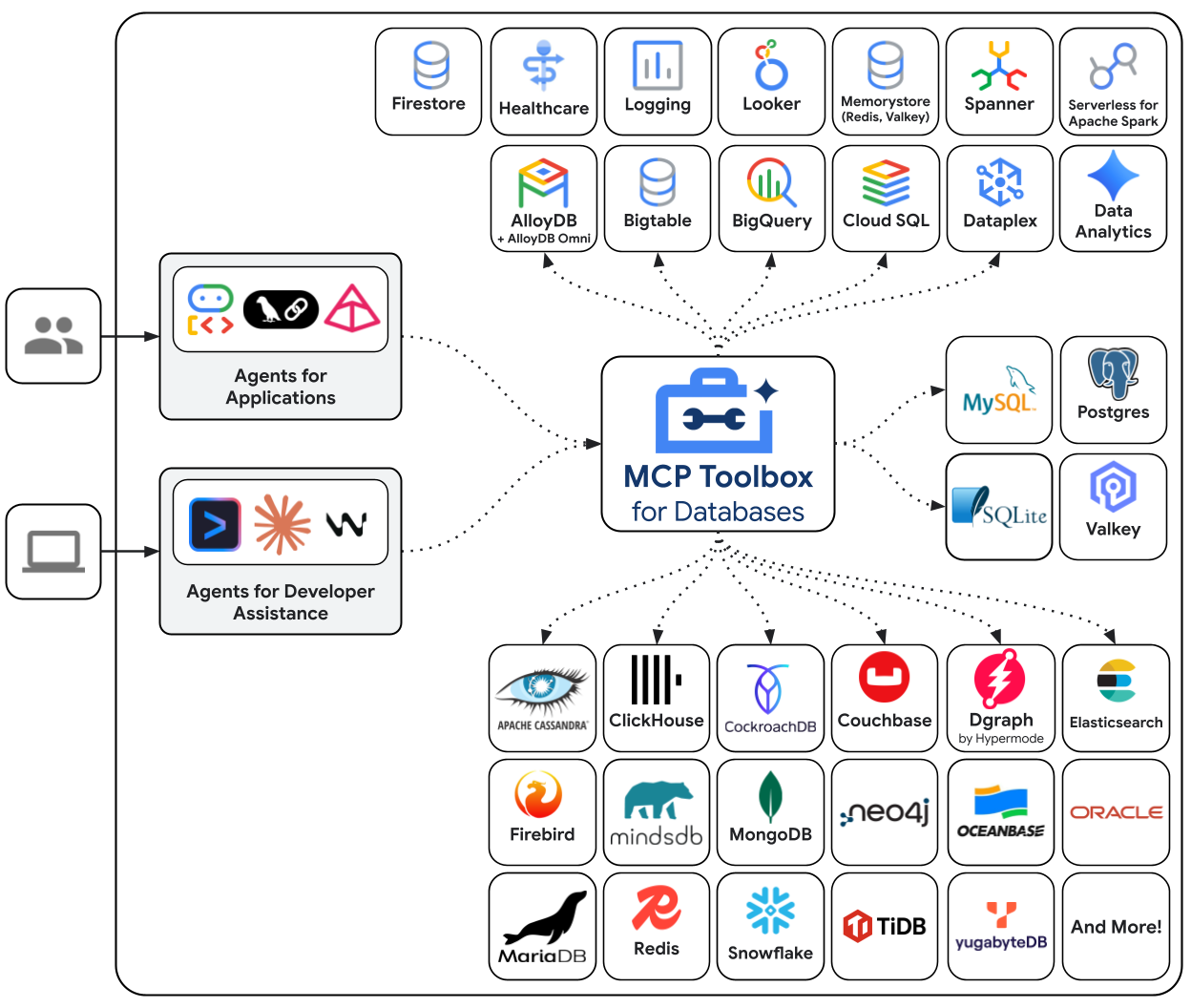

O MCP (Protocolo de Contexto de Modelo) é um protocolo aberto que padroniza como os agentes de IA descobrem e interagem com ferramentas externas. Ele define um modelo cliente-servidor: o agente hospeda um cliente MCP, e as ferramentas são expostas por servidores MCP. Qualquer cliente compatível com o MCP pode usar qualquer servidor compatível com o MCP. O agente não precisa de um código de integração personalizado para cada ferramenta.

O MCP Toolbox for Databases é um servidor MCP de código aberto criado especificamente para acesso a bancos de dados. Sem ele, você escreveria funções Python que abrem conexões de banco de dados, gerenciam pools de conexões, criam consultas parametrizadas para evitar injeção de SQL, processam erros e incorporam todo esse código no seu agente. Cada agente que precisa de acesso ao banco de dados repete esse trabalho. Mudar uma consulta significa reimplantação do agente.

Com a caixa de ferramentas, você escreve um arquivo YAML. Cada ferramenta é mapeada para uma instrução SQL parametrizada. A caixa de ferramentas processa o pooling de conexões, consultas parametrizadas, autenticação e capacidade de observação. As ferramentas são dissociadas do agente. Para atualizar uma consulta, edite tools.yaml e reinicie a caixa de ferramentas sem mexer no código do agente. As mesmas ferramentas funcionam no ADK, LangGraph, LlamaIndex ou qualquer framework compatível com o MCP.

Escreva a configuração das ferramentas

Agora, precisamos criar um arquivo chamado tools.yaml no editor do Cloud Shell para configurar a configuração das ferramentas.

cloudshell edit tools.yaml

O arquivo usa YAML de vários documentos. Cada bloco separado por --- é um recurso independente. Todo recurso tem um kind que declara o que ele é (sources para conexões de banco de dados, tools para ações chamáveis por agente) e um type que especifica o back-end (cloud-sql-postgres para a origem, postgres-sql para ferramentas baseadas em SQL). Uma ferramenta faz referência à fonte usando name, que é como a caixa de ferramentas sabe qual pool de conexões executar. As variáveis de ambiente usam a sintaxe ${VAR_NAME} e são resolvidas na inicialização.

Agora, vamos copiar os seguintes scripts primeiro no arquivo tools.yaml

# tools.yaml

# --- Data Source ---

kind: source

name: jobs-db

type: cloud-sql-postgres

project: ${GOOGLE_CLOUD_PROJECT}

region: ${REGION}

instance: ${DB_INSTANCE}

database: ${DB_NAME}

user: postgres

password: ${DB_PASSWORD}

---

Este script define o seguinte recurso:

- Origem (

jobs-db): informa à caixa de ferramentas como se conectar à sua instância do Cloud SQL PostgreSQL. O tipocloud-sql-postgresusa o conector do Cloud SQL internamente, processando a autenticação e as conexões seguras de forma automática. Os marcadores de posição${GOOGLE_CLOUD_PROJECT},${REGION}e${DB_PASSWORD}são resolvidos de variáveis de ambiente na inicialização.

Em seguida, adicione o script a seguir abaixo do símbolo --- em tools.yaml.

# --- Tool 1: Search jobs by role and/or tech stack ---

kind: tool

name: search-jobs

type: postgres-sql

source: jobs-db

description: >-

Search for job listings by role category and/or tech stack.

Use this tool when the developer wants to browse listings

by role (e.g., Backend, Frontend, Data) or find jobs

using a specific technology. Both parameters accept an

empty string to match all values.

statement: |

SELECT title, company, role, tech_stack, salary_range, location, openings

FROM jobs

WHERE ($1 = '' OR LOWER(role) = LOWER($1))

AND ($2 = '' OR LOWER(tech_stack) LIKE '%' || LOWER($2) || '%')

ORDER BY title

LIMIT 10

parameters:

- name: role

type: string

description: "The role category to filter by (e.g., 'Backend', 'Frontend', 'Data/AI', 'DevOps'). Use empty string for all roles."

- name: tech_stack

type: string

description: "A technology to search for in the tech stack (partial match, e.g., 'Python', 'Kubernetes'). Use empty string for all tech stacks."

---

# --- Tool 2: Get full details for a specific job ---

kind: tool

name: get-job-details

type: postgres-sql

source: jobs-db

description: >-

Get full details for a specific job listing including its description,

salary range, location, and number of openings. Use this tool when the

developer asks about a particular job by title or company.

statement: |

SELECT title, company, role, tech_stack, salary_range, location, openings, description

FROM jobs

WHERE LOWER(title) LIKE '%' || LOWER($1) || '%'

OR LOWER(company) LIKE '%' || LOWER($1) || '%'

parameters:

- name: search_term

type: string

description: "The job title or company name to look up (partial match supported)."

---

Este script define o seguinte recurso:

- Ferramentas 1 e 2 (

search-jobs,get-job-details): ferramentas de consulta SQL padrão. Cada um mapeia um nome de ferramenta (o que o agente vê) para uma instrução SQL parametrizada (o que o banco de dados executa). Os parâmetros usam marcadores de posição$1e$2. A caixa de ferramentas executa essas ações como instruções preparadas, o que evita a injeção de SQL.

Vamos continuar. Adicione o script a seguir abaixo do símbolo --- em tools.yaml.

# --- Embedding Model ---

kind: embeddingModel

name: gemini-embedding

type: gemini

model: gemini-embedding-001

project: ${GOOGLE_CLOUD_PROJECT}

location: ${GOOGLE_CLOUD_LOCATION}

dimension: 3072

---

Este script define o seguinte recurso:

- Modelo de embedding (

gemini-embedding): configura a caixa de ferramentas para chamar o modelogemini-embedding-001do Gemini e gerar embeddings de texto de 3.072 dimensões. A caixa de ferramentas usa o Application Default Credentials (ADC) para autenticar. Não é necessário ter uma chave de API no Cloud Shell ou no Cloud Run. Observa que odimensionconfigurado aqui precisa ser o mesmo que configuramos anteriormente para propagar o banco de dados.

Vamos continuar. Adicione o script a seguir abaixo do símbolo --- em tools.yaml.

# --- Tool 3: Semantic search by description ---

kind: tool

name: search-jobs-by-description

type: postgres-sql

source: jobs-db

description: >-

Find jobs that match a natural language description of what the developer

is looking for. Use this tool when the developer describes their ideal job

using interests, work style, career goals, or project type rather than a

specific role or tech stack. Examples: "I want to work on AI chatbots,"

"a remote job at a fintech startup," "something involving infrastructure

and reliability."

statement: |

SELECT title, company, role, tech_stack, salary_range, location, description

FROM jobs

WHERE description_embedding IS NOT NULL

ORDER BY description_embedding <=> $1

LIMIT 5

parameters:

- name: search_query

type: string

description: "A natural language description of the kind of job the developer is looking for."

embeddedBy: gemini-embedding

---

Este script define o seguinte recurso:

- Ferramenta 3 (

search-jobs-by-description): uma ferramenta de pesquisa vetorial. O parâmetrosearch_querytemembeddedBy: gemini-embedding, que instrui a caixa de ferramentas a interceptar o texto bruto, enviá-lo ao modelo de embedding e usar o vetor resultante na instrução SQL. O operador<=>é a distância de cosseno do pgvector. Valores menores significam descrições mais semelhantes.

Por fim, adicione a última ferramenta abaixo do símbolo --- em tools.yaml.

# --- Tool 4: Add a new job listing with automatic embedding ---

kind: tool

name: add-job

type: postgres-sql

source: jobs-db

description: >-

Add a new job listing to the platform. Use this tool when a user asks

to post a job that is not currently listed.

statement: |

INSERT INTO jobs (title, company, role, tech_stack, salary_range, location, openings, description, description_embedding)

VALUES ($1, $2, $3, $4, $5, $6, CAST($7 AS INTEGER), $8, $9)

RETURNING title, company

parameters:

- name: title

type: string

description: "The job title (e.g., 'Senior Backend Engineer')."

- name: company

type: string

description: "The company name (e.g., 'Stripe', 'Spotify')."

- name: role

type: string

description: "The role category (e.g., 'Backend', 'Frontend', 'Data/AI', 'DevOps')."

- name: tech_stack

type: string

description: "Comma-separated list of technologies (e.g., 'Python, FastAPI, GCP')."

- name: salary_range

type: string

description: "The salary range (e.g., '$150-200K/year')."

- name: location

type: string

description: "Work location and arrangement (e.g., 'Remote')."

- name: openings

type: string

description: "The number of open positions."

- name: description

type: string

description: "A short description of the job (2-3 sentences)."

- name: description_vector

type: string

description: "Auto-generated embedding vector for the job description."

valueFromParam: description

embeddedBy: gemini-embedding

Este script define o seguinte recurso:

- Ferramenta 4 (

add-job): demonstra a ingestão de vetores. O parâmetrodescription_vectortem dois campos especiais: valueFromParam: description: a caixa de ferramentas copia o valor do parâmetrodescriptionpara este. O LLM nunca vê esse parâmetro.embeddedBy: gemini-embedding: a caixa de ferramentas incorpora o texto copiado em um vetor antes de transmiti-lo ao SQL.

O resultado: uma chamada de função armazena o texto de descrição bruto e o embedding de vetor dele, sem que o agente saiba nada sobre embeddings.

O formato YAML de vários documentos separa cada recurso com ---. Cada documento tem campos kind, name e type que definem o que ele é. Em resumo, já configuramos tudo o que segue:

- Definir o banco de dados de origem

- Defina ferramentas ( ferramentas 1 e 2) para consultar o banco de dados com um filtro padrão.

- Definir o modelo de embedding

- Definir a ferramenta para fazer a pesquisa de vetor ( ferramenta 3) no banco de dados

- Definir a ferramenta para fazer a ingestão de dados de vetor ( ferramenta 4) no banco de dados

6. Executar o servidor da MCP Toolbox

Na etapa anterior, já definimos a configuração necessária para a MCP Toolbox. Agora podemos executar o servidor.

Verificar os dados de inicialização

Antes de iniciar a caixa de ferramentas, vamos confirmar se a configuração do banco de dados foi concluída. Crie um script Python scripts/verify_database.py usando o seguinte comando:

cloudshell edit scripts/verify_seed.py

Em seguida, copie o código abaixo no arquivo scripts/verify_seed.py.

#!/usr/bin/env python3

"""Verify the database has 15 jobs with embeddings."""

import os

import sys

from pathlib import Path

from dotenv import load_dotenv

from google.cloud.sql.connector import Connector

import pg8000

# Load environment variables

env_path = Path(__file__).parent.parent / '.env'

load_dotenv(env_path)

# Verify required environment variables

required_vars = ['GOOGLE_CLOUD_PROJECT', 'REGION', 'DB_PASSWORD', 'DB_INSTANCE', 'DB_NAME']

missing_vars = [var for var in required_vars if not os.environ.get(var)]

if missing_vars:

print(f"ERROR: Missing environment variables: {', '.join(missing_vars)}", file=sys.stderr)

sys.exit(1)

def verify_database():

"""Check that 15 jobs exist with embeddings."""

connector = Connector()

try:

project = os.environ['GOOGLE_CLOUD_PROJECT']

region = os.environ['REGION']

password = os.environ['DB_PASSWORD']

instance = os.environ['DB_INSTANCE']

database = os.environ['DB_NAME']

conn = connector.connect(

f"{project}:{region}:{instance}",

"pg8000",

user="postgres",

password=password,

db=database

)

cursor = conn.cursor()

# Count jobs and embeddings

cursor.execute("SELECT COUNT(*) FROM jobs")

job_count = cursor.fetchone()[0]

cursor.execute("SELECT COUNT(*) FROM jobs WHERE description_embedding IS NOT NULL")

embedding_count = cursor.fetchone()[0]

print(f"Jobs: {job_count}/15")

print(f"Embeddings: {embedding_count}/15")

cursor.close()

conn.close()

if job_count == 15 and embedding_count == 15:

print("\n✓ Database ready!")

return True

else:

print("\n✗ Database not ready")

return False

except Exception as e:

print(f"\nERROR: {e}", file=sys.stderr)

return False

finally:

connector.close()

if __name__ == "__main__":

success = verify_database()

sys.exit(0 if success else 1)

Esse script vai verificar o número de dados de postagens de vagas e a incorporação deles. Execute o script usando o seguinte comando:

uv run scripts/verify_seed.py

Se você vir a seguinte saída do terminal, isso significa que os dados estão prontos:

Jobs: 15/15 Embeddings: 15/15 ✓ Database ready!

Iniciar o servidor da caixa de ferramentas

Na etapa de configuração anterior, já fizemos o download do executável toolbox. Verifique se o arquivo binário existe e foi baixado corretamente. Se não, faça o download e aguarde a conclusão.

cd ~/build-agent-adk-toolbox-cloudsql

if [ ! -f toolbox ]; then

curl -O https://storage.googleapis.com/mcp-toolbox-for-databases/v1.0.0/linux/amd64/toolbox

fi

chmod +x toolbox

Precisamos expor nossas variáveis .env ao processo filho executado pela caixa de ferramentas do MCP. Execute o comando a seguir para iniciar o servidor da caixa de ferramentas e registrar a saída do console no arquivo logs/mcp_toolbox.log.

set -a; source .env; set +a

./toolbox --config tools.yaml --enable-api > logs/mcp_toolbox.log 2>&1 &

Você vai ver uma saída no arquivo logs/mcp_toolbox.log confirmando que o servidor está pronto, como mostrado abaixo:

... INFO "Initialized 1 sources: jobs-db" ... INFO "Initialized 0 authServices: " ... INFO "Using Vertex AI backend for Gemini embedding" ... INFO "Initialized 1 embeddingModels: gemini-embedding" ... INFO "Initialized 4 tools: add-job, search-jobs, get-job-details, search-jobs-by-description" ... ... INFO "Server ready to serve!"

Verificar as ferramentas

Consulte a API Toolbox para listar todas as ferramentas registradas:

curl -s http://localhost:5000/api/toolset | uv run -m json.tool

Você vai encontrar as ferramentas com as descrições e os parâmetros. Como mostrado abaixo

...

"search-jobs-by-description": {

"description": "Find jobs that match a natural language description of what the developer is looking for. Use this tool when the developer describes their ideal job using interests, work style, career goals, or project type rather than a specific role or tech stack. Examples: \"I want to work on AI chatbots,\" \"a remote job at a fintech startup,\" \"something involving infrastructure and reliability.\"",

"parameters": [

{

"name": "search_query",

"type": "string",

"required": true,

"description": "A natural language description of the kind of job the developer is looking for.",

"authSources": []

}

],

"authRequired": []

}

...

Teste a ferramenta search-jobs diretamente:

curl -s -X POST http://localhost:5000/api/tool/search-jobs/invoke \

-H "Content-Type: application/json" \

-d '{"role": "Backend", "tech_stack": ""}' | jq '.result | fromjson'

A resposta precisa conter os dois jobs de engenharia de back-end dos seus dados iniciais.

[

{

"title": "Backend Engineer (Payments)",

"company": "Square",

"role": "Backend",

"tech_stack": "Java, Spring Boot, PostgreSQL, Kafka",

"salary_range": "$160-220K/year",

"location": "San Francisco, Hybrid",

"openings": 3

},

{

"title": "Senior Backend Engineer",

"company": "Stripe",

"role": "Backend",

"tech_stack": "Go, PostgreSQL, gRPC, Kubernetes",

"salary_range": "$180-250K/year",

"location": "San Francisco, Hybrid",

"openings": 3

}

]

7. Criar o agente do ADK

Agora, vamos usar o ADK em Python para este projeto. Adicione as dependências necessárias:

uv add google-adk==1.29.0 toolbox-adk==1.0.0

google-adk: o Kit de Desenvolvimento de Agente do Google, incluindo o SDK do Geminitoolbox-adk: integração do ADK para a MCP Toolbox for Databases.

Criar a estrutura de diretórios do agente

O ADK espera um layout de pasta específico: um diretório com o nome do seu agente que contenha __init__.py, agent.py e .env. Para ajudar com isso, ele tem um comando integrado para estabelecer rapidamente a estrutura:

uv run adk create jobs_agent \

--model gemini-2.5-flash \

--project ${GOOGLE_CLOUD_PROJECT} \

--region ${GOOGLE_CLOUD_LOCATION}

Seu diretório vai ficar assim:

build-agent-adk-toolbox-cloudsql/ ├── jobs_agent/ │ ├── __init__.py │ ├── agent.py │ └── .env ├── logs ├── scripts └── ...

Em seguida, vamos integrar o agente do ADK ao servidor da caixa de ferramentas em execução e testar todas as quatro ferramentas: consultas padrão, pesquisa semântica e ingestão de vetores. O código do agente é mínimo: toda a lógica do banco de dados está em tools.yaml.

Configurar o ambiente do agente

O ADK lê GOOGLE_GENAI_USE_VERTEXAI, GOOGLE_CLOUD_PROJECT e GOOGLE_CLOUD_LOCATION do ambiente shell, que você já definiu na etapa anterior. A única variável específica do agente é TOOLBOX_URL. Anexe-a ao arquivo .env do agente:

echo -e "\nTOOLBOX_URL=http://127.0.0.1:5000" >> jobs_agent/.env

Atualizar o módulo do agente

Abra jobs_agent/agent.py no editor do Cloud Shell

cloudshell edit jobs_agent/agent.py

e substitua o conteúdo pelo seguinte código:

# jobs_agent/agent.py

import os

from google.adk.agents import LlmAgent

from toolbox_adk import ToolboxToolset

TOOLBOX_URL = os.environ.get("TOOLBOX_URL", "http://127.0.0.1:5000")

toolbox = ToolboxToolset(TOOLBOX_URL)

root_agent = LlmAgent(

name="jobs_agent",

model="gemini-2.5-flash",

instruction="""You are a helpful assistant at "TechJobs," a tech job listing platform.

Your job:

- Help developers browse job listings by role or tech stack.

- Provide full details about specific positions, including salary range and number of openings.

- Recommend jobs based on natural language descriptions of what the developer is looking for.

- Add new job listings to the platform when asked.

When a developer asks about a specific job by title or company, use the get-job-details tool.

When a developer asks for a specific role category or tech stack, use the search-jobs tool.

When a developer describes what kind of job they want — by interest area, work style,

career goals, or project type — use the search-jobs-by-description tool for semantic search.

When in doubt between search-jobs and search-jobs-by-description, prefer

search-jobs-by-description — it searches job descriptions and finds more relevant matches.

If a position has no openings (openings is 0), let the developer know

and suggest similar alternatives from the search results.

Be conversational, knowledgeable, and concise.""",

tools=[toolbox],

)

Não há código de banco de dados aqui. O ToolboxToolset se conecta ao servidor da caixa de ferramentas na inicialização e carrega todas as ferramentas disponíveis. O agente chama as ferramentas por nome, e a caixa de ferramentas traduz essas chamadas em consultas SQL no Cloud SQL.

A variável de ambiente TOOLBOX_URL tem como padrão http://127.0.0.1:5000 para desenvolvimento local. Ao implantar no Cloud Run mais tarde, você vai substituir isso pelo URL do Cloud Run do serviço Toolbox. Não é necessário mudar o código.

No momento, a instrução faz referência apenas às duas ferramentas padrão (search-jobs e get-job-details). Você vai expandir isso na próxima etapa ao adicionar ferramentas de pesquisa semântica e ingestão.

Testar o agente

Inicie a interface de desenvolvimento do ADK:

cd ~/build-agent-adk-toolbox-cloudsql

uv run adk web --allow_origins "regex:https://.*\.cloudshell\.dev"

Abra o URL mostrado no terminal (normalmente http://localhost:8000) usando o recurso Visualização na Web do Cloud Shell ou ctrl + clique no URL mostrado no terminal. Selecione jobs_agent no menu suspenso de agentes no canto superior esquerdo.

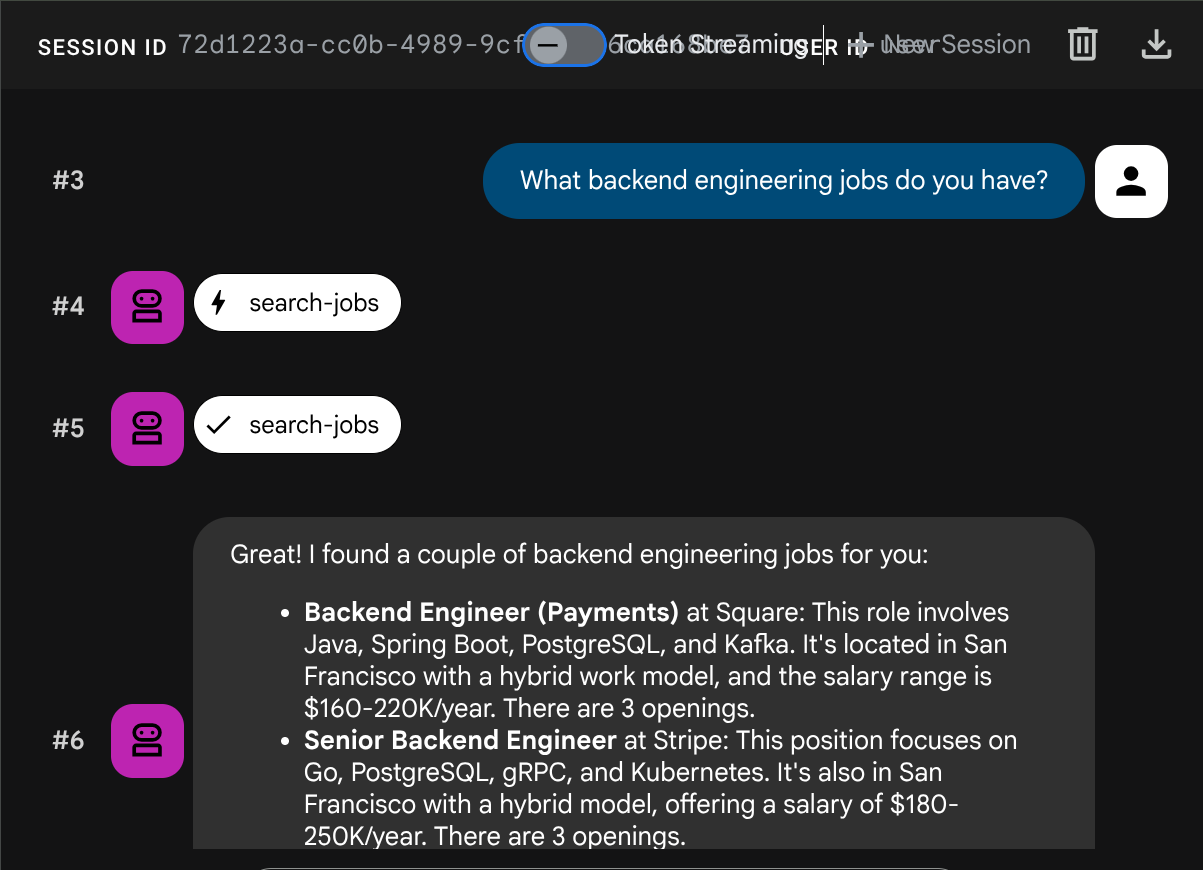

Testar consultas padrão

Teste estes comandos para verificar as ferramentas de SQL padrão:

What backend engineering jobs do you have?

Any jobs using Kubernetes?

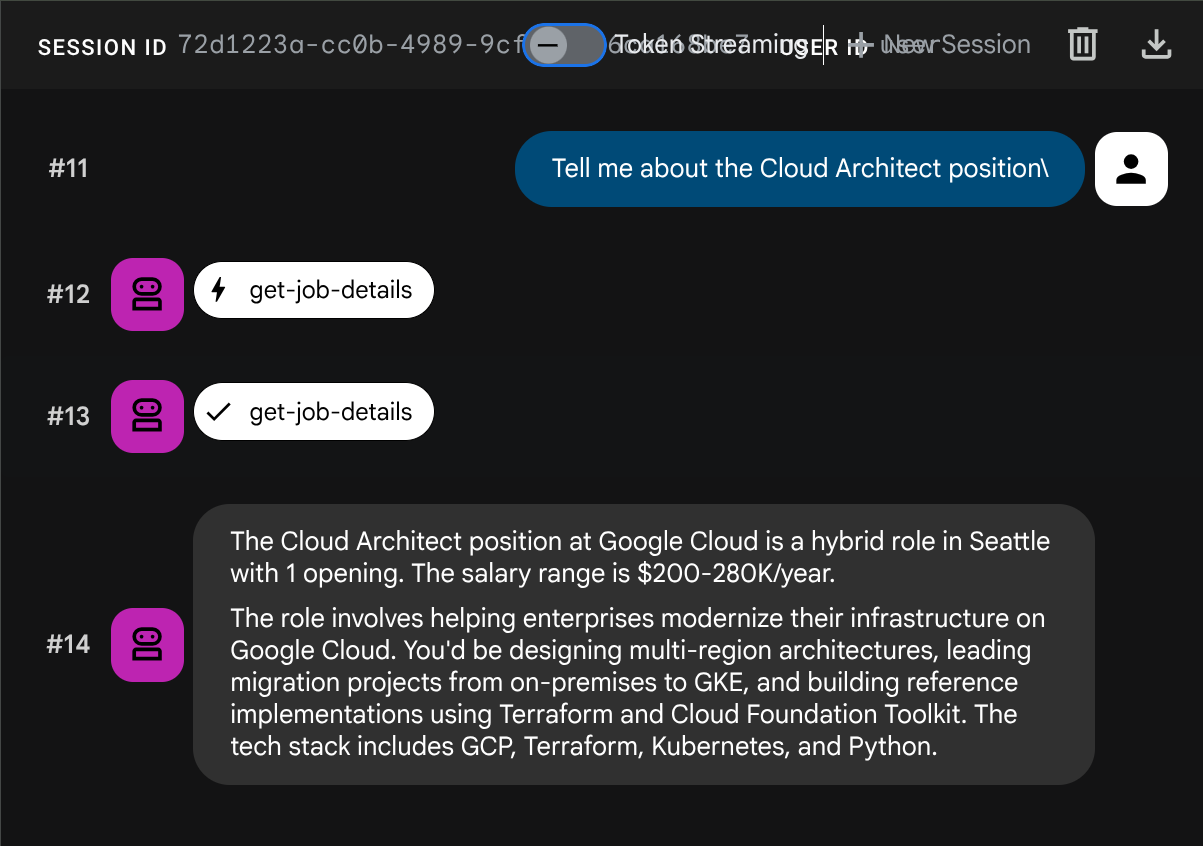

Tell me about the Cloud Architect position

Testar a pesquisa semântica

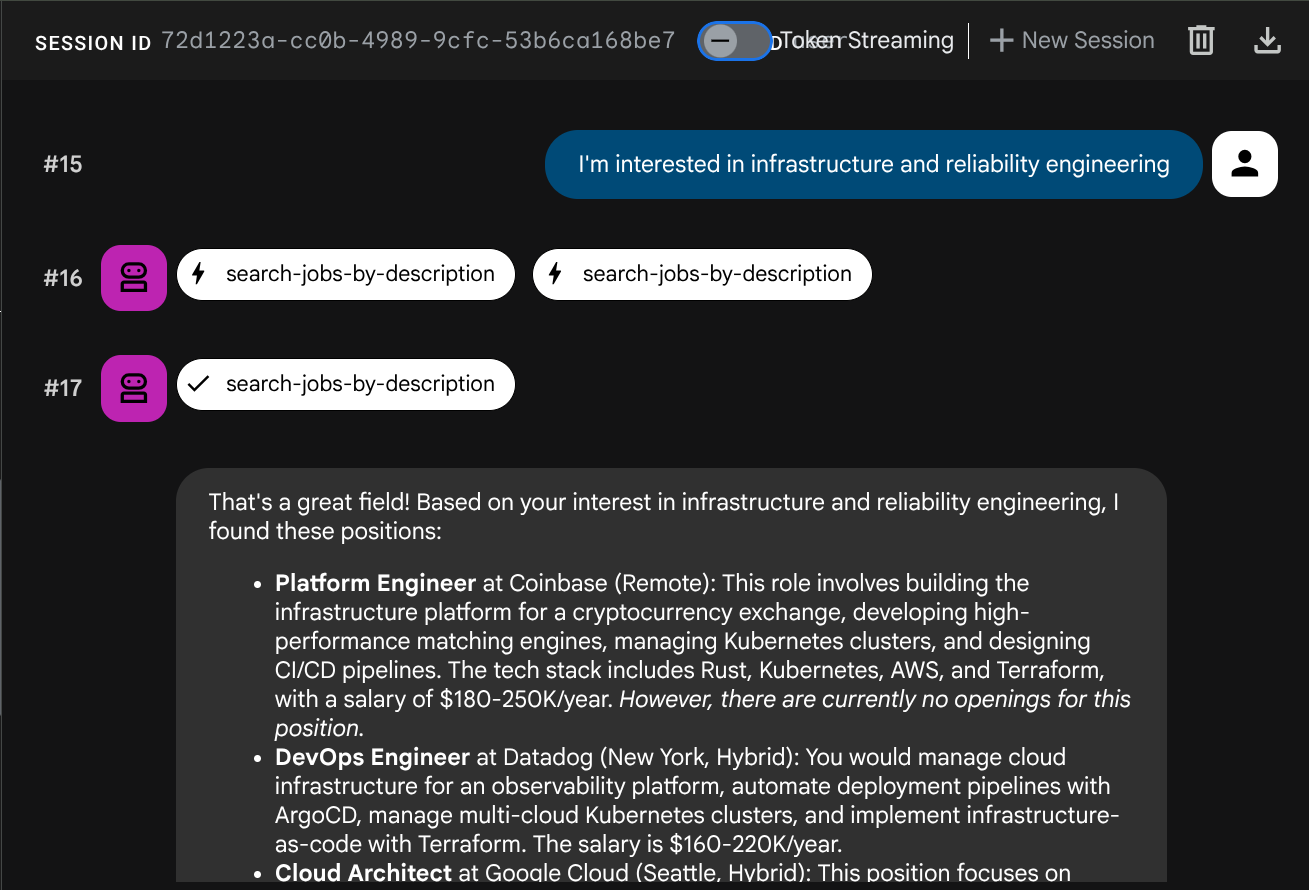

Tente descrições em linguagem natural que não correspondam a uma função ou pilha de tecnologia específica:

I want a remote job where I can work on AI and machine learning

Find me something in fintech with good work-life balance

I'm interested in infrastructure and reliability engineering

O agente tenta escolher a ferramenta certa com base no tipo de consulta: filtros estruturados passam por search-jobs, e descrições em linguagem natural passam por search-jobs-by-description.

Teste de ingestão de vetores

Peça para o agente adicionar um novo trabalho:

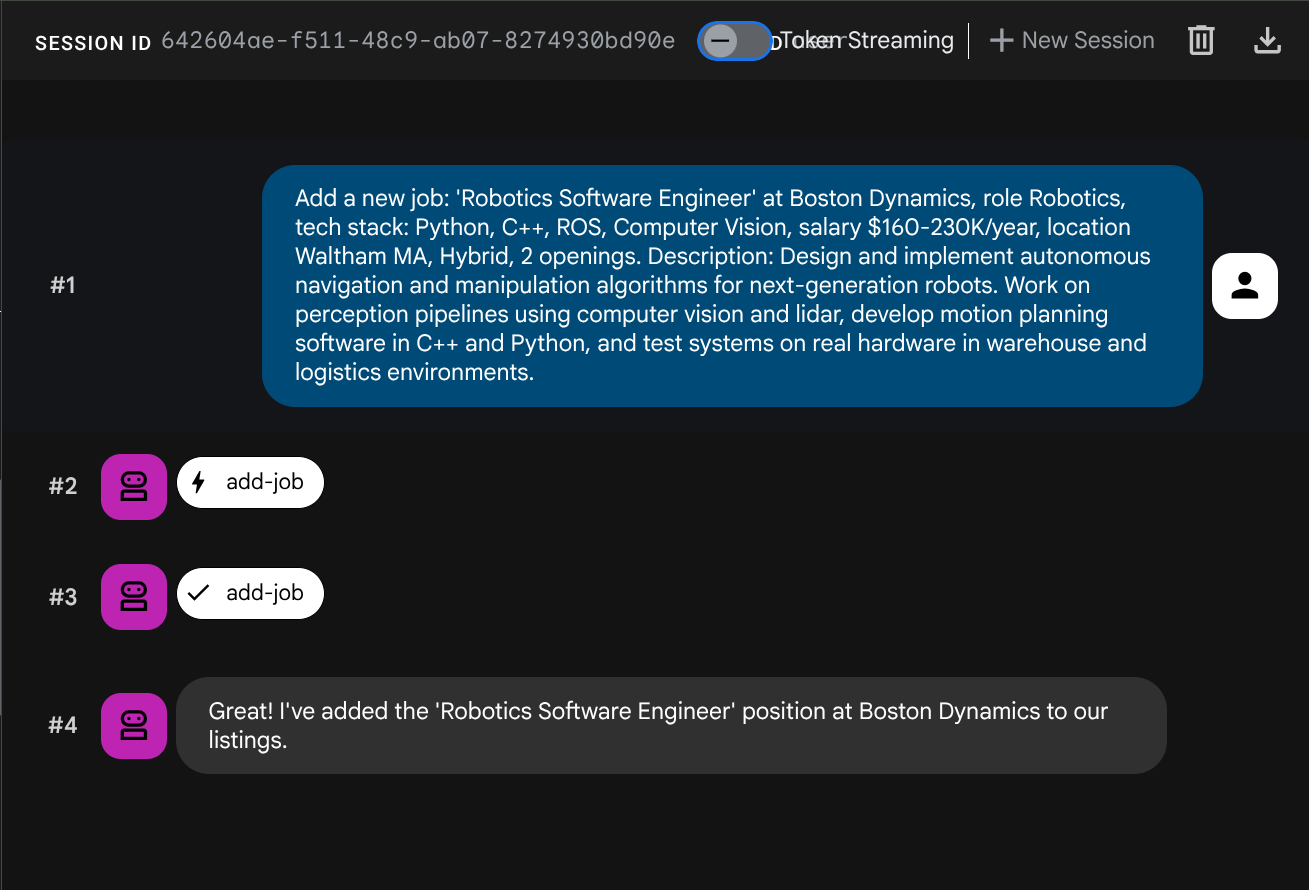

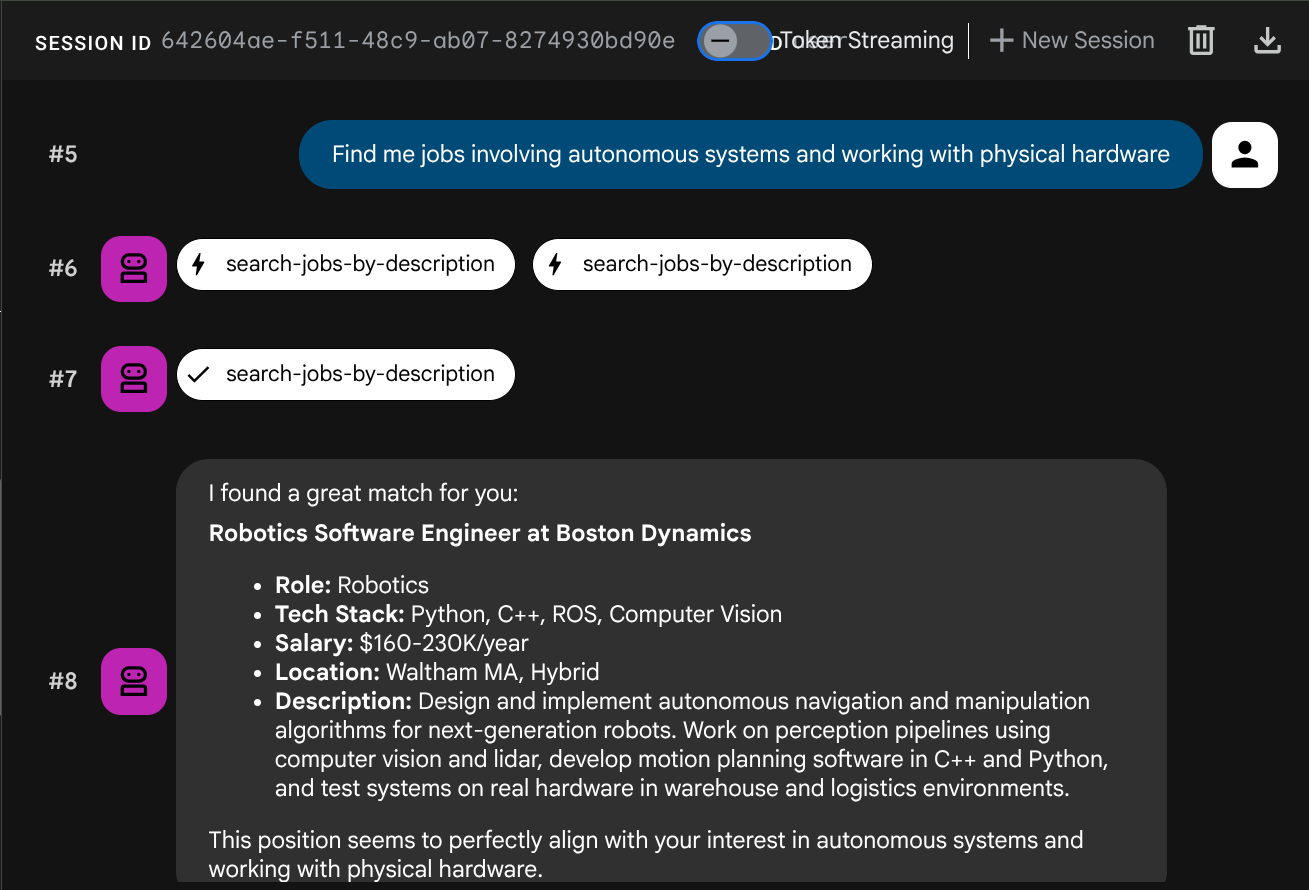

Add a new job: 'Robotics Software Engineer' at Boston Dynamics, role Robotics, tech stack: Python, C++, ROS, Computer Vision, salary $160-230K/year, location Waltham MA, Hybrid, 2 openings. Description: Design and implement autonomous navigation and manipulation algorithms for next-generation robots. Work on perception pipelines using computer vision and lidar, develop motion planning software in C++ and Python, and test systems on real hardware in warehouse and logistics environments.

Agora tente pesquisar:

Find me jobs involving autonomous systems and working with physical hardware

A incorporação foi gerada automaticamente durante o INSERT. Não é necessário fazer uma etapa separada.

Agora você já tem um aplicativo RAG agêntico totalmente funcional que usa ADK, MCP Toolbox e CloudSQL. Parabéns! Vamos dar mais um passo e implantar esses apps no Cloud Run.

Agora, vamos interromper a interface de desenvolvimento encerrando o processo. Para isso, pressione Ctrl+C duas vezes antes de continuar.

8. Implantar no Cloud Run

O agente e a caixa de ferramentas funcionam localmente. Esta etapa implanta os dois como serviços do Cloud Run para que possam ser acessados pela Internet. O serviço da caixa de ferramentas é executado como um servidor MCP no Cloud Run, e o serviço do agente se conecta a ele.

Preparar a caixa de ferramentas para implantação

Crie um diretório de implantação para o serviço da caixa de ferramentas:

cd ~/build-agent-adk-toolbox-cloudsql

mkdir -p deploy-toolbox

cp toolbox tools.yaml deploy-toolbox/

Crie o Dockerfile para a caixa de ferramentas. Abra deploy-toolbox/Dockerfile no editor do Cloud Shell:

cloudshell edit deploy-toolbox/Dockerfile

e copie o seguinte script nele:

# deploy-toolbox/Dockerfile

FROM debian:bookworm-slim

RUN apt-get update && apt-get install -y ca-certificates && rm -rf /var/lib/apt/lists/*

WORKDIR /app

COPY toolbox tools.yaml ./

RUN chmod +x toolbox

EXPOSE 8080

CMD ["./toolbox", "--config", "tools.yaml", "--enable-api", "--address", "0.0.0.0", "--port", "8080"]

O binário da caixa de ferramentas e o tools.yaml são empacotados em uma imagem mínima do Debian. O Cloud Run encaminha o tráfego para a porta 8080.

Implantar o serviço da caixa de ferramentas

cd ~/build-agent-adk-toolbox-cloudsql

gcloud run deploy toolbox-service \

--source deploy-toolbox/ \

--region $REGION \

--set-env-vars "DB_PASSWORD=$DB_PASSWORD,DB_INSTANCE=$DB_INSTANCE,DB_NAME=$DB_NAME,GOOGLE_CLOUD_PROJECT=$GOOGLE_CLOUD_PROJECT,REGION=$REGION,GOOGLE_CLOUD_LOCATION=$GOOGLE_CLOUD_LOCATION" \

--allow-unauthenticated \

--quiet > logs/deploy_toolbox.log 2>&1 &

Esse comando envia a origem para o Cloud Build, cria uma imagem de contêiner, envia para o Artifact Registry e implanta no Cloud Run. Isso vai levar alguns minutos. Podemos inspecionar o registro do processo de implantação no arquivo logs/deploy_toolbox.log.

Preparar o agente para implantação

Enquanto a caixa de ferramentas é criada, configure os arquivos de implantação do agente.

Crie um Dockerfile na raiz do projeto. Abra Dockerfile no editor do Cloud Shell:

cloudshell edit Dockerfile

Em seguida, copie o conteúdo a seguir:

# Dockerfile

FROM ghcr.io/astral-sh/uv:python3.12-trixie-slim

WORKDIR /app

COPY pyproject.toml ./

COPY uv.lock ./

RUN uv sync --no-dev

COPY jobs_agent/ jobs_agent/

EXPOSE 8080

CMD ["uv", "run", "adk", "web", "--host", "0.0.0.0", "--port", "8080"]

Esse Dockerfile usa ghcr.io/astral-sh/uv como a imagem de base, que inclui Python e uv pré-instalados. Não é necessário instalar o uv separadamente via pip.

Crie um arquivo .dockerignore para excluir arquivos desnecessários da imagem do contêiner:

cloudshell edit .dockerignore

Em seguida, copie o script a seguir nele:

# .dockerignore

.venv/

__pycache__/

*.pyc

.env

jobs_agent/.env

toolbox

tools.yaml

seed.sql

deploy-toolbox/

Implantar o serviço do agente

Aguarde a conclusão da implantação da caixa de ferramentas. Verifique o processo de implantação novamente em logs/deploy_toolbox.log. Em seguida, recupere o URL do Cloud Run usando o seguinte comando:

TOOLBOX_URL=$(gcloud run services describe toolbox-service \

--region=$REGION \

--format='value(status.url)')

echo "Toolbox URL: $TOOLBOX_URL"

Você vai ver uma saída semelhante a esta:

Toolbox URL: https://toolbox-service-xxxxxx-xx.a.run.app

Em seguida, vamos verificar se a caixa de ferramentas implantada está funcionando:

curl -s "$TOOLBOX_URL/api/toolset" | python3 -m json.tool | head -5

Se a saída for semelhante a este exemplo, a implantação já foi concluída.

{

"serverVersion": "1.0.0+binary.linux.amd64.c5524d3",

"tools": {

"add-job": {

"description": "Add a new job listing to the platform. Use this tool when a user asks to post a job that is not currently listed.",

Em seguida, vamos implantar o agente, transmitindo o URL da caixa de ferramentas como uma variável de ambiente:

cd ~/build-agent-adk-toolbox-cloudsql

gcloud run deploy jobs-agent \

--source . \

--region $REGION \

--set-env-vars "TOOLBOX_URL=$TOOLBOX_URL,GOOGLE_CLOUD_PROJECT=$GOOGLE_CLOUD_PROJECT,GOOGLE_CLOUD_LOCATION=$GOOGLE_CLOUD_LOCATION,GOOGLE_GENAI_USE_VERTEXAI=TRUE" \

--allow-unauthenticated \

--quiet

O código do agente lê TOOLBOX_URL do ambiente (você configurou isso antes). Localmente, ele aponta para http://127.0.0.1:5000. No Cloud Run, ele aponta para o URL do serviço da caixa de ferramentas. Não é necessário mudar o código.

Testar o agente implantado

Recupere o URL do Cloud Run do agente:

AGENT_URL=$(gcloud run services describe jobs-agent \

--region=$REGION \

--format='value(status.url)')

echo "Agent URL: $AGENT_URL"

Abra o URL no seu navegador. A interface de desenvolvimento do ADK é carregada. É a mesma interface que você estava usando localmente, agora executada no Cloud Run.

Selecione jobs_agent no menu suspenso e teste:

What backend engineering jobs do you have?

I want a remote job working on AI and machine learning

As duas consultas funcionam pelos serviços implantados: o agente no Cloud Run chama a caixa de ferramentas no Cloud Run, que consulta o Cloud SQL.

9. Parabéns / Limpeza

Você criou e implantou um assistente de quadro de vagas inteligente que usa o MCP Toolbox for Databases para conectar um agente ADK e o Cloud SQL PostgreSQL, com consultas SQL padrão e pesquisa semântica de vetores.

O que você aprendeu

- Como o MCP padroniza o acesso a ferramentas para agentes de IA e como o MCP Toolbox for Databases aplica isso especificamente a operações de banco de dados, substituindo o código personalizado do banco de dados por uma configuração YAML declarativa

- Como configurar o Cloud SQL PostgreSQL como uma fonte de dados da caixa de ferramentas usando o tipo de origem

cloud-sql-postgres - Como definir ferramentas de consulta SQL padrão com instruções parametrizadas que evitam a injeção de SQL

- Como ativar a pesquisa vetorial usando pgvector e

gemini-embedding-001, com o parâmetroembeddedBypara embedding de consulta automático - Como o

valueFromParampermite a ingestão automática de vetores: o LLM fornece uma descrição de texto, e a caixa de ferramentas copia, incorpora e armazena o vetor silenciosamente ao lado do texto. - Como o

ToolboxToolsetdo ADK carrega ferramentas de um servidor da caixa de ferramentas em execução, mantendo o código do agente mínimo e a lógica do banco de dados totalmente dissociada - Como implantar o servidor MCP da caixa de ferramentas e o agente do ADK no Cloud Run como serviços separados

Limpeza

Para evitar cobranças na sua conta do Google Cloud pelos recursos criados neste codelab, exclua os recursos individuais ou o projeto inteiro.

Opção 1: excluir o projeto (recomendado)

A maneira mais fácil de fazer a limpeza é excluir o projeto. Isso remove todos os recursos associados ao projeto.

gcloud projects delete $GOOGLE_CLOUD_PROJECT

Opção 2: excluir recursos individuais

Se você quiser manter o projeto, mas remover apenas os recursos criados neste codelab:

gcloud run services delete jobs-agent --region=$REGION --quiet

gcloud run services delete toolbox-service --region=$REGION --quiet

gcloud sql instances delete jobs-instance --quiet

gcloud artifacts repositories delete cloud-run-source-deploy --location=$REGION --quiet 2>/dev/null