1. Giriş

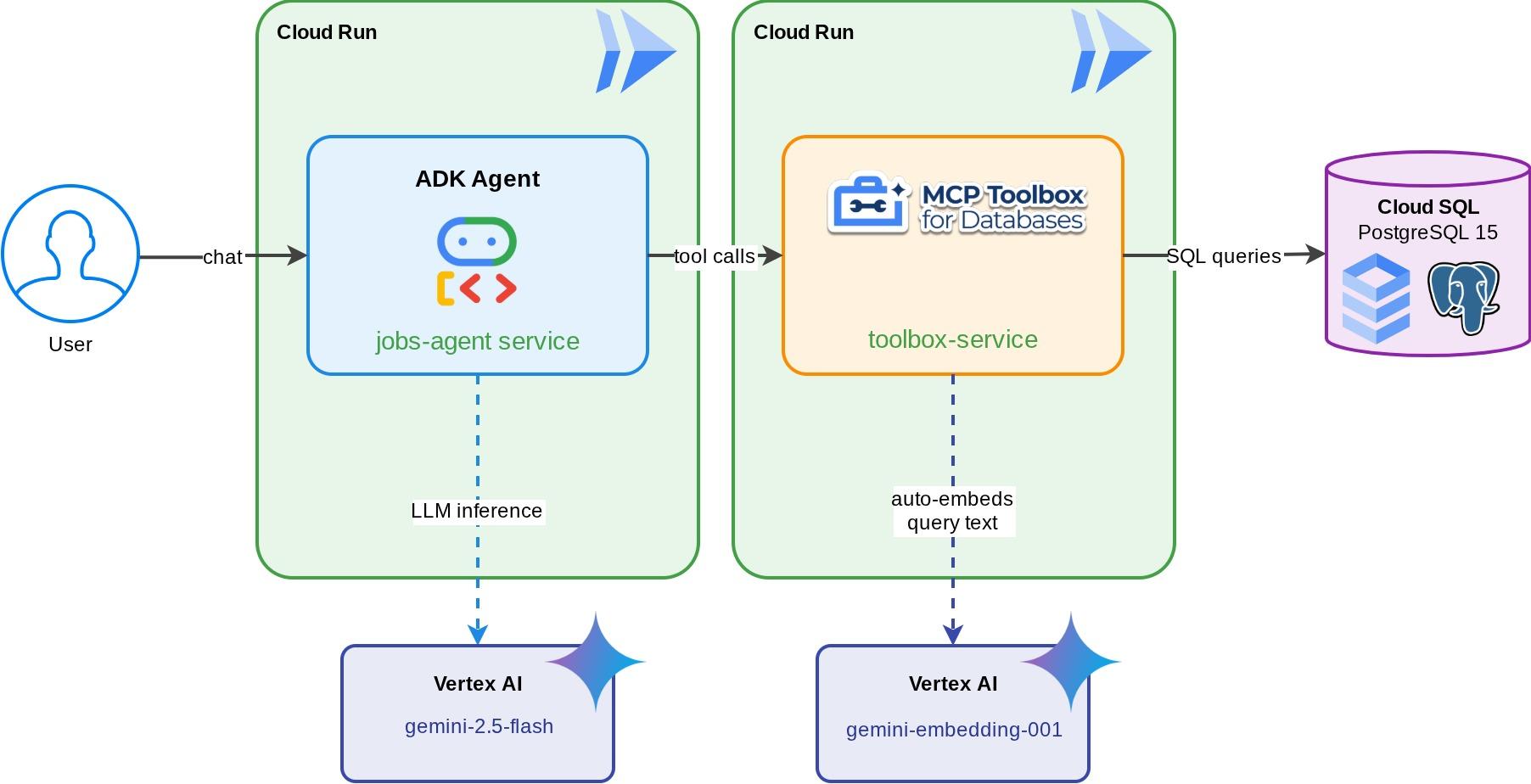

Yapay zeka ajanları yalnızca erişebildikleri veriler kadar faydalıdır. Gerçek dünyadaki verilerin çoğu veritabanlarında bulunur. Aracıları veritabanlarına bağlamak genellikle bağlantı yönetimi, sorgu mantığı ve yerleştirme işlem hatlarını aracı kodunuza yazmak anlamına gelir. Veritabanı erişimi gereken her aracı bu çalışmayı tekrarlar ve her sorgu değişikliği, aracının yeniden dağıtılmasını gerektirir.

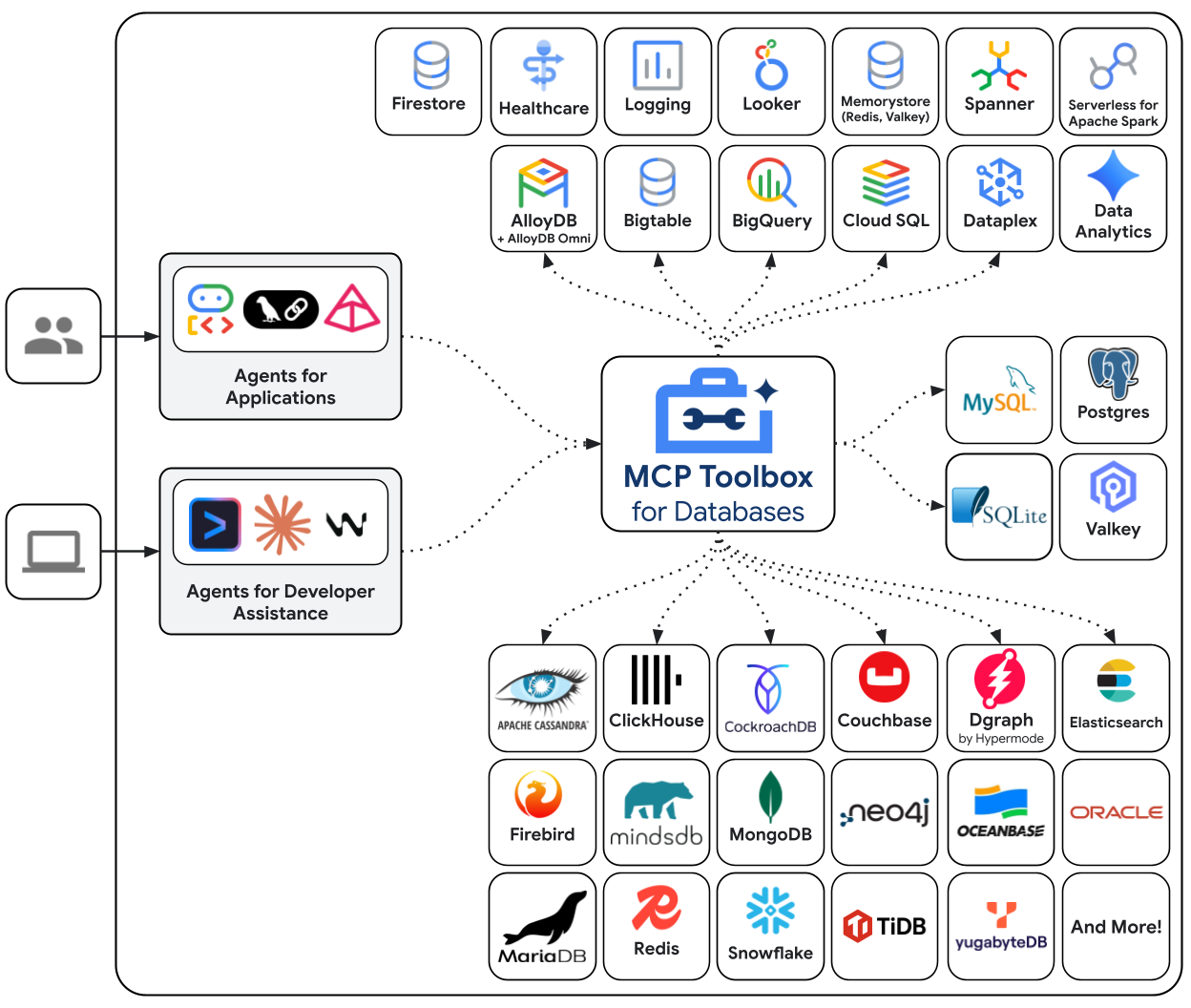

Bu codelab'de farklı bir yaklaşım gösterilmektedir. Veritabanı araçlarınızı bir YAML dosyasında (standart SQL sorguları, vektör benzerliği araması ve hatta otomatik yerleştirme oluşturma) tanımlarsınız. Veritabanları için MCP Araç Kutusu, tüm veritabanı işlemlerini bir MCP sunucusu olarak gerçekleştirir. Aracı kodunuz minimum düzeyde kalır: Araçları yükleyin, hangi aracın çağrılacağına Gemini karar versin.

Ne oluşturacaksınız?

"TechJobs" için Akıllı İş İlanı Panosu Asistanı: Geliştiricilerin standart filtreleri (rol, teknoloji yığını) kullanarak teknoloji iş ilanlarına göz atmasına ve "Yapay zeka chatbot'ları üzerinde çalışacağım uzaktan bir iş istiyorum" gibi doğal dil açıklamalarıyla işleri keşfetmesine yardımcı olan, Gemini destekli bir ADK aracısı. Aracı, Cloud SQL PostgreSQL veritabanında okuma ve yazma işlemlerini tamamen MCP Toolbox for Databases aracılığıyla gerçekleştirir. Bu araç, vektör araması için otomatik yerleştirme oluşturma da dahil olmak üzere tüm veritabanı erişimini yönetir. Sonunda hem Toolbox hem de aracı Cloud Run'da çalışır.

Neler öğreneceksiniz?

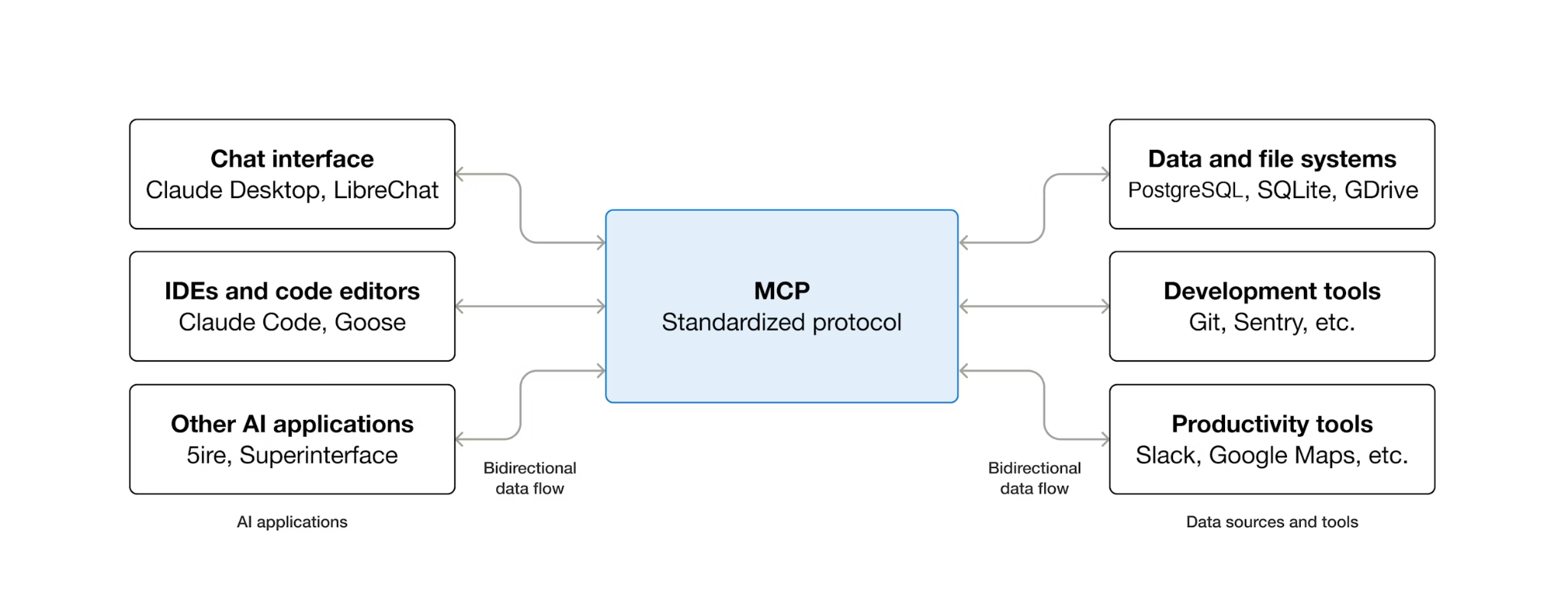

- MCP (Model Context Protocol) standardının, yapay zeka aracıları için araç erişimini nasıl standartlaştırdığı ve MCP Toolbox for Databases'in bunu veritabanı işlemlerine nasıl uyguladığı

- Veritabanları için MCP Toolbox'ı ADK aracısı ile Cloud SQL PostgreSQL arasında ara katman yazılımı olarak ayarlama

- Veritabanı araçlarını

tools.yamliçinde bildirimsel olarak tanımlayın. Temsilcinizde veritabanı kodu bulunmaz. ToolboxToolsetkullanarak çalışan bir Araç Kutusu sunucusundan araç yükleyen bir ADK aracısı oluşturma- Cloud SQL'in yerleşik

embedding()işlevini kullanarak vektör yerleştirmeleri oluşturma vepgvectorile semantik aramayı etkinleştirme - Yazma işlemlerinde otomatik vektör alımı için

valueFromParamözelliğini kullanma - Toolbox sunucusunu ve ADK aracısını Cloud Run'a dağıtma

Ön koşullar

- Deneme faturalandırma hesabına sahip bir Google Cloud hesabı

- Python ve SQL ile ilgili temel bilgiler

- Cloud Database ve ADK ile ilgili önceki deneyimler yardımcı olacaktır.

2. Ortamınızı Kurma

Bu adımda Cloud Shell ortamınız hazırlanır, Google Cloud projeniz yapılandırılır ve referans deposu klonlanır.

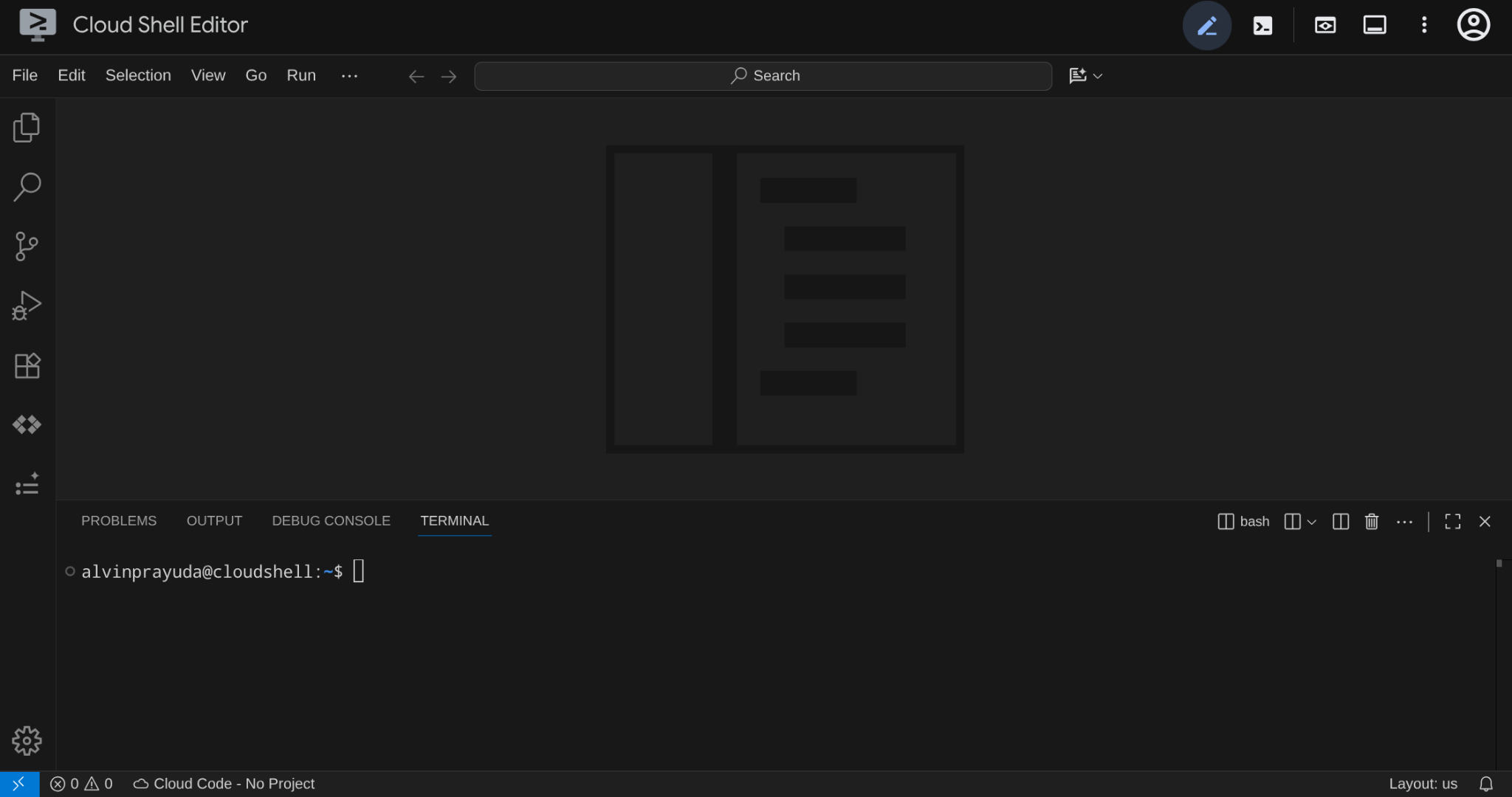

Cloud Shell'i açma

Tarayıcınızda Cloud Shell'i açın. Cloud Shell, bu codelab için ihtiyacınız olan tüm araçların bulunduğu önceden yapılandırılmış bir ortam sağlar. İstendiğinde Yetkilendir'i tıklayın.

Ardından, terminali açmak için "Görünüm" -> "Terminal"i tıklayın. Arayüzünüz aşağıdaki gibi görünmelidir.

Bu, ana arayüzümüz olacak. Üstte IDE, altta terminal yer alacak.

Çalışma dizininizi ayarlama

Çalışma dizininizi oluşturun. Bu codelab'de yazdığınız tüm kodlar burada bulunur:

mkdir -p ~/build-agent-adk-toolbox-cloudsql

cloudshell workspace ~/build-agent-adk-toolbox-cloudsql && cd ~/build-agent-adk-toolbox-cloudsql

Ardından, seeding komut dosyaları ve günlükler gibi öğeleri yönetmek için birkaç dizin hazırlayalım.

mkdir -p ~/build-agent-adk-toolbox-cloudsql/scripts

mkdir -p ~/build-agent-adk-toolbox-cloudsql/logs

Google Cloud projenizi oluşturun

Konum değişkenlerini içeren .env dosyasını oluşturun:

# For Vertex AI / Gemini API calls

echo "GOOGLE_CLOUD_LOCATION=global" > .env

# For Cloud SQL, Cloud Run, Artifact Registry

echo "REGION=us-central1" >> .env

Terminalinizde proje kurulumunu basitleştirmek için bu proje kurulum komut dosyasını çalışma dizininize indirin:

curl -sL https://raw.githubusercontent.com/alphinside/cloud-trial-project-setup/main/setup_verify_trial_project.sh -o setup_verify_trial_project.sh

Komut dosyasını çalıştırın. Deneme faturalandırma hesabınızı doğrular, yeni bir proje oluşturur (veya mevcut bir projeyi doğrular), proje kimliğinizi geçerli dizindeki bir .env dosyasına kaydeder ve gcloud'de etkin projeyi ayarlar.

bash setup_verify_trial_project.sh && source .env

Komut dosyası:

- Etkin bir deneme faturalandırma hesabınız olduğunu doğrulayın.

.env'da mevcut bir proje olup olmadığını kontrol edin (varsa)- Yeni bir proje oluşturun veya mevcut projeyi yeniden kullanın

- Deneme faturalandırma hesabını projenize bağlama

- Proje kimliğini

.envdosyasına kaydedin. - Projeyi etkin

gcloudprojesi olarak ayarlayın

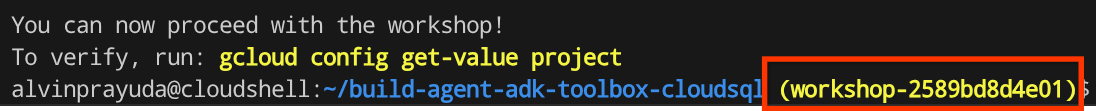

Cloud Shell terminal isteminde çalışma dizininizin yanındaki sarı metni kontrol ederek projenin doğru şekilde ayarlandığını doğrulayın. Proje kimliğiniz gösterilmelidir.

Gerekli API'yi Etkinleştirme

Ardından, etkileşimde bulunacağımız ürün için birkaç API'yi etkinleştirmemiz gerekir:

gcloud services enable \

aiplatform.googleapis.com \

sqladmin.googleapis.com \

compute.googleapis.com \

run.googleapis.com \

cloudbuild.googleapis.com \

artifactregistry.googleapis.com

- Vertex AI API (

aiplatform.googleapis.com): Aracınız Gemini modellerini, Araç Kutusu ise vektör araması için yerleştirme API'sini kullanır. - Cloud SQL Admin API (

sqladmin.googleapis.com): PostgreSQL örneği sağlarsınız ve yönetirsiniz. - Compute Engine API (

compute.googleapis.com): Cloud SQL örnekleri oluşturmak için gereklidir. - Cloud Run, Cloud Build, Artifact Registry: Bu codelab'in ilerleyen bölümlerinde dağıtım adımında kullanılır.

3. Veritabanı başlatma için komut dosyaları hazırlama

Bu adımda Cloud SQL örneği oluşturma işlemi başlatılır ve örneğin hazır olmasını bekleyen, ardından veritabanını oluşturan, iş ilanlarıyla dolduran ve yerleştirmeler oluşturan otomatik bir kurulum komut dosyası çalıştırılır. Tüm bu işlemler tek bir işlemde gerçekleştirilir.

Öncelikle, veritabanı şifresini .env dosyanıza ekleyip yeniden yükleyelim:

echo "DB_PASSWORD=techjobs-pwd" >> .env

echo "DB_INSTANCE=jobs-instance" >> .env

echo "DB_NAME=jobs_db" >> .env

source .env

Örnek ve veritabanı oluşturma için Bash komut dosyası oluşturma

Ardından, aşağıdaki komutla scripts/setup_database.sh komut dosyasını oluşturun.

mkdir -p ~/build-agent-adk-toolbox-cloudsql/scripts

cloudshell edit scripts/setup_database.sh

Ardından, aşağıdaki kodu scripts/setup_database.sh dosyasına kopyalayın.

#!/bin/bash

set -e

source .env

echo "================================================"

echo "Database Setup"

echo "================================================"

echo ""

# Step 1: Create Cloud SQL instance

echo "[1/5] Creating Cloud SQL instance..."

# Check if instance already exists

if gcloud sql instances describe "$DB_INSTANCE" --quiet >/dev/null 2>&1; then

echo " Instance already exists"

else

echo " Creating instance (takes 5-10 minutes)..."

gcloud sql instances create "$DB_INSTANCE" \

--database-version=POSTGRES_17 \

--tier=db-custom-1-3840 \

--edition=ENTERPRISE \

--region="$REGION" \

--root-password="$DB_PASSWORD" \

--enable-google-ml-integration \

--database-flags cloudsql.enable_google_ml_integration=on \

--quiet

fi

echo " ✓ Instance ready"

echo ""

# Step 2: Verify instance is ready

echo "[2/5] Verifying instance state..."

STATE=$(gcloud sql instances describe "$DB_INSTANCE" --format='value(state)')

if [ "$STATE" != "RUNNABLE" ]; then

echo "ERROR: Instance not ready (state: $STATE)"

exit 1

fi

echo " ✓ Instance is RUNNABLE"

echo ""

# Step 3: Grant IAM permissions

echo "[3/5] Granting Vertex AI permissions..."

SERVICE_ACCOUNT=$(gcloud sql instances describe "$DB_INSTANCE" \

--format='value(serviceAccountEmailAddress)')

if [ -z "$SERVICE_ACCOUNT" ]; then

echo "ERROR: Could not retrieve service account"

exit 1

fi

gcloud projects add-iam-policy-binding "$GOOGLE_CLOUD_PROJECT" \

--member="serviceAccount:$SERVICE_ACCOUNT" \

--role="roles/aiplatform.user" \

--quiet

echo " ✓ Permissions granted"

echo ""

# Step 4: Create database

echo "[4/5] Creating database..."

# Check if database already exists

if gcloud sql databases describe "$DB_NAME" \

--instance="$DB_INSTANCE" --quiet >/dev/null 2>&1; then

echo " Database already exists"

else

gcloud sql databases create "$DB_NAME" \

--instance="$DB_INSTANCE" \

--quiet

fi

echo " ✓ Database '$DB_NAME' ready"

echo ""

# Step 5: Seed database and generate embeddings

echo "[5/5] Seeding database and generating embeddings..."

SCRIPT_DIR="$(cd "$(dirname "${BASH_SOURCE[0]}")" && pwd)"

SETUP_SCRIPT="${SCRIPT_DIR}/setup_jobs_db.py"

if [ ! -f "$SETUP_SCRIPT" ]; then

echo "ERROR: Setup script not found: $SETUP_SCRIPT"

exit 1

fi

uv run "$SETUP_SCRIPT"

echo ""

echo "================================================"

echo "Setup complete!"

echo "================================================"

echo ""

Veri başlangıcı için Python komut dosyası oluşturma

Ardından, aşağıdaki komutu kullanarak seeding_script.py adlı Python dosyasını scripts/setup_jobs_db.py oluşturun.

cloudshell edit scripts/setup_jobs_db.py

Ardından, aşağıdaki kodu scripts/setup_jobs_db.py dosyasına kopyalayın.

import os

import sys

from pathlib import Path

from dotenv import load_dotenv

from google.cloud.sql.connector import Connector

import pg8000

import time

# Load environment variables from .env file

env_path = Path(__file__).parent.parent / '.env'

load_dotenv(env_path)

EMBEDDING_MODEL='gemini-embedding-001'

# Verify required environment variables

required_vars = ['GOOGLE_CLOUD_PROJECT', 'REGION', 'DB_PASSWORD']

missing_vars = [var for var in required_vars if not os.environ.get(var)]

if missing_vars:

print(f"ERROR: Missing required environment variables: {', '.join(missing_vars)}", file=sys.stderr)

print(f"", file=sys.stderr)

print(f"Expected .env file location: {env_path}", file=sys.stderr)

if not env_path.exists():

print(f"✗ File not found at that location", file=sys.stderr)

else:

print(f"✓ File exists but is missing the variables above", file=sys.stderr)

print(f"", file=sys.stderr)

print(f"Make sure your .env file contains:", file=sys.stderr)

for var in missing_vars:

print(f" {var}=<value>", file=sys.stderr)

sys.exit(1)

# Job listings data (fictional, for tutorial purposes only)

JOBS = [

("Senior Backend Engineer", "Stripe", "Backend", "Go, PostgreSQL, gRPC, Kubernetes", "$180-250K/year", "San Francisco, Hybrid", 3,

"Design and build high-throughput microservices powering payment infrastructure for millions of businesses. Optimize Go services for sub-100ms latency at scale, work with PostgreSQL and Redis for data persistence, and deploy on Kubernetes clusters handling billions of API calls."),

("Machine Learning Engineer", "Spotify", "Data/AI", "Python, TensorFlow, BigQuery, Vertex AI", "$170-230K/year", "Stockholm, Remote", 2,

"Build and deploy ML models for music recommendation and personalization systems serving hundreds of millions of listeners. Design feature pipelines in BigQuery, train models using distributed computing, and serve predictions through real-time APIs processing thousands of requests per second."),

("Frontend Engineer", "Vercel", "Frontend", "React, TypeScript, Next.js", "$140-190K/year", "Remote", 4,

"Build developer-facing dashboard interfaces and deployment tools used by millions of developers worldwide. Create responsive, accessible React components for project management, analytics, and real-time deployment monitoring with a focus on developer experience."),

("DevOps Engineer", "Datadog", "DevOps", "Terraform, GCP, Docker, Kubernetes, ArgoCD", "$160-220K/year", "New York, Hybrid", 2,

"Manage cloud infrastructure powering an observability platform used by thousands of engineering teams. Automate deployment pipelines with ArgoCD, manage multi-cloud Kubernetes clusters, and implement infrastructure-as-code with Terraform across production environments."),

("Mobile Engineer (Android)", "Grab", "Mobile", "Kotlin, Jetpack Compose, GraphQL", "$120-170K/year", "Singapore, Hybrid", 3,

"Develop features for a super-app serving millions of users across Southeast Asia. Build modern Android UIs with Jetpack Compose, integrate GraphQL APIs, and optimize app performance for diverse device capabilities and network conditions."),

("Data Engineer", "Airbnb", "Data", "Python, Apache Spark, Airflow, BigQuery", "$160-210K/year", "San Francisco, Hybrid", 2,

"Build data pipelines that process booking, search, and pricing data for a global travel marketplace. Design ETL workflows with Apache Spark and Airflow, maintain data warehouses in BigQuery, and ensure data quality for analytics and machine learning teams."),

("Full Stack Engineer", "Revolut", "Full Stack", "TypeScript, Node.js, React, PostgreSQL", "$130-180K/year", "London, Remote", 5,

"Build the next generation of financial products making banking accessible to millions of users across 35 countries. Develop real-time trading interfaces with React and WebSockets, build Node.js APIs handling market data streams, and design PostgreSQL schemas for financial transactions."),

("Site Reliability Engineer", "Cloudflare", "SRE", "Go, Prometheus, Grafana, GCP, Terraform", "$170-230K/year", "Austin, Hybrid", 2,

"Ensure 99.99% uptime for a global network handling millions of requests per second. Define SLOs, build monitoring dashboards with Prometheus and Grafana, manage incident response, and automate infrastructure scaling across 300+ data centers worldwide."),

("Cloud Architect", "Google Cloud", "Cloud", "GCP, Terraform, Kubernetes, Python", "$200-280K/year", "Seattle, Hybrid", 1,

"Help enterprises modernize their infrastructure on Google Cloud. Design multi-region architectures, lead migration projects from on-premises to GKE, and build reference implementations using Terraform and Cloud Foundation Toolkit."),

("Backend Engineer (Payments)", "Square", "Backend", "Java, Spring Boot, PostgreSQL, Kafka", "$160-220K/year", "San Francisco, Hybrid", 3,

"Build payment processing systems handling millions of transactions for businesses of all sizes. Design event-driven architectures using Kafka, implement idempotent payment flows with Spring Boot, and ensure PCI-DSS compliance across all services."),

("AI Engineer", "Hugging Face", "Data/AI", "Python, LangChain, Vertex AI, FastAPI, PostgreSQL", "$150-210K/year", "Paris, Remote", 2,

"Build AI-powered tools for the largest open-source ML community. Develop RAG pipelines that index and search model documentation, create conversational agents using LangChain, and deploy AI services with FastAPI on cloud infrastructure."),

("Platform Engineer", "Coinbase", "Platform", "Rust, Kubernetes, AWS, Terraform", "$180-250K/year", "Remote", 0,

"Build the infrastructure platform for a leading cryptocurrency exchange. Develop high-performance matching engines in Rust, manage Kubernetes clusters for microservices, and design CI/CD pipelines that enable rapid feature deployment with zero downtime."),

("QA Automation Engineer", "Shopify", "QA", "Python, Selenium, Cypress, Jenkins", "$110-160K/year", "Toronto, Hybrid", 3,

"Design and maintain automated test suites for a commerce platform powering millions of merchants. Build end-to-end test frameworks with Cypress and Selenium, integrate tests into Jenkins CI pipelines, and establish quality gates that prevent regressions in checkout and payment flows."),

("Security Engineer", "CrowdStrike", "Security", "Python, SIEM, Kubernetes, Penetration Testing", "$170-240K/year", "Austin, On-site", 1,

"Protect enterprise customers from cyber threats on a leading endpoint security platform. Conduct penetration testing, design security monitoring with SIEM tools, implement zero-trust networking in Kubernetes environments, and lead incident response for security events."),

("Product Engineer", "GitLab", "Full Stack", "Go, React, PostgreSQL, Redis, GCP", "$140-200K/year", "Remote", 4,

"Own features end-to-end for an all-in-one DevSecOps platform used by millions of developers. Build Go microservices for CI/CD pipelines, create React frontends for code review and project management, and collaborate with product managers to iterate on user-facing features using data-driven development."),

]

def get_connection():

"""Create a connection to Cloud SQL using the connector."""

project = os.environ['GOOGLE_CLOUD_PROJECT']

region = os.environ['REGION']

password = os.environ['DB_PASSWORD']

instance = os.environ['DB_INSTANCE']

database = os.environ['DB_NAME']

connector = Connector()

conn = connector.connect(

f"{project}:{region}:{instance}",

"pg8000",

user="postgres",

password=password,

db=database

)

return conn, connector

def create_schema(cursor):

"""Create extensions and jobs table."""

cursor.execute("CREATE EXTENSION IF NOT EXISTS google_ml_integration")

cursor.execute("CREATE EXTENSION IF NOT EXISTS vector")

cursor.execute("""

CREATE TABLE IF NOT EXISTS jobs (

id SERIAL PRIMARY KEY,

title VARCHAR NOT NULL,

company VARCHAR NOT NULL,

role VARCHAR NOT NULL,

tech_stack VARCHAR NOT NULL,

salary_range VARCHAR NOT NULL,

location VARCHAR NOT NULL,

openings INTEGER NOT NULL,

description TEXT NOT NULL,

description_embedding vector(3072)

)

""")

def seed_jobs(cursor, conn):

"""Insert job listings."""

cursor.execute("SELECT COUNT(*) FROM jobs")

existing_count = cursor.fetchone()[0]

if existing_count > 0:

print(f" {existing_count} jobs already exist, skipping seed")

return 0

cursor.executemany("""

INSERT INTO jobs (title, company, role, tech_stack, salary_range, location, openings, description)

VALUES (%s, %s, %s, %s, %s, %s, %s, %s)

""", JOBS)

conn.commit()

return len(JOBS)

def generate_embeddings(cursor, conn):

"""Generate embeddings using Cloud SQL's embedding() function."""

cursor.execute("SELECT COUNT(*) FROM jobs WHERE description_embedding IS NULL")

null_count = cursor.fetchone()[0]

if null_count == 0:

print(" All jobs already have embeddings")

return 0

cursor.execute(f"""

UPDATE jobs

SET description_embedding = embedding('{EMBEDDING_MODEL}', description)::vector

WHERE description_embedding IS NULL

""")

rows_updated = cursor.rowcount

conn.commit()

return rows_updated

def main():

conn, connector = get_connection()

cursor = conn.cursor()

try:

create_schema(cursor)

conn.commit()

seeded = seed_jobs(cursor, conn)

if seeded > 0:

print(f" ✓ Inserted {seeded} jobs")

# Waiting for vertex role propagation

time.sleep(60)

embedded = generate_embeddings(cursor, conn)

if embedded > 0:

print(f" ✓ Generated {embedded} embeddings")

except Exception as e:

print(f"ERROR: {e}", file=sys.stderr)

sys.exit(1)

finally:

cursor.close()

conn.close()

connector.close()

if __name__ == "__main__":

main()

Şimdi bir sonraki adıma geçelim.

4. Veritabanını Oluşturma ve Başlatma

Artık komut dosyalarımız yürütülmeye hazır. Hazırladığımız komut dosyasını yürütmek için Python'a ihtiyacımız olacak. Bu nedenle önce Python'ı hazırlayalım.

Python projesini oluşturma

uv, Rust ile yazılmış hızlı bir Python paketi ve proje yöneticisidir ( uv dokümanları ). Bu codelab'de, Python projesinin bakımını hızlı ve basit bir şekilde yapmak için kullanılır.

Bir Python projesi başlatın ve gerekli bağımlılıkları ekleyin:

uv init

uv add cloud-sql-python-connector --extra pg8000

uv add python-dotenv

Burada, Uygulama Varsayılan Kimlik Bilgileri kullanılarak kimliği doğrulanmış veritabanı örneğimizle güvenli bir bağlantı başlatmak için cloud-sql-python-connector Python SDK'sını kullandığımızı unutmayın.

Kurulum komut dosyasını yürütün

Artık kurulum komut dosyasını arka planda çalıştırabilir ve aşağıdaki komutu kullanarak logs/atabase_setup.log dosyasına yazılacak konsol çıkışını inceleyebiliriz. Bu işlemin tamamlanmasını beklerken sonraki bölüme geçebilirsiniz.

mkdir -p ~/build-agent-adk-toolbox-cloudsql/logs

bash scripts/setup_database.sh > logs/database_setup.log 2>&1 &

Toolbox ikilisini indirin

Bu eğitimde MCP Toolbox'ı kullanacağız. Neyse ki bu araç, Linux ortamında kullanıma hazır önceden oluşturulmuş bir ikili dosya ile birlikte gelir. Şimdi de arka planda indirelim. Bu işlem biraz zaman alabilir. İkili dosyayı indirmek ve çıkış günlüğünü logs/toolbox_dl.log üzerinde incelemek için aşağıdaki komutu çalıştırın . Bu işlemin tamamlanmasını beklerken sonraki bölüme geçebilirsiniz.

cd ~/build-agent-adk-toolbox-cloudsql

curl -O https://storage.googleapis.com/mcp-toolbox-for-databases/v1.0.0/linux/amd64/toolbox > logs/toolbox_dl.log 2>&1 &

Kurulum komut dosyasını anlama scripts/setup_database.sh

Şimdi de daha önce yapılandırdığımız kurulum komut dosyasını anlamaya çalışalım. Aşağıdaki işlemi yapar:

- Burada yürüttüğümüz ilk komut, aşağıdaki işaretle birlikte

gcloud sql instances createkomutudur.

db-custom-1-3840,ENTERPRISEsürümündeki en küçük ayrılmış çekirdekli Cloud SQL katmanıdır (1 vCPU, 3,75 GB RAM). Daha fazla bilgiyi burada bulabilirsiniz. Vertex AI ML entegrasyonu için özel bir çekirdek gerekir. Paylaşılan çekirdek katmanları (db-f1-micro,db-g1-small) bu entegrasyonu desteklemez.--root-password, varsayılanpostgreskullanıcısının şifresini ayarlar.--enable-google-ml-integration, Cloud SQL'in Vertex AI ile yerleşik entegrasyonunu etkinleştirir. Bu entegrasyon,embedding()işlevini kullanarak doğrudan SQL'den yerleştirme modellerini çağırmanızı sağlar.

- Örneğin

RUNNABLEdurumunda olup olmadığını doğrulayın. gcloud projects add-iam-policy-bindingkomutunu kullanarak Cloud SQL örneğinin hizmet hesabına Vertex AI'ı çağırma izni verin. Bu, veritabanını doldururken kullanacağımız yerleşikembedding()işlevi için gereklidir.- Veritabanını oluşturma

- İlk veri komut dosyası

setup_jobs_db.pykomut dosyası yürütülüyor

Başlangıç komut dosyasını anlama scripts/setup_jobs_db.py

Şimdi de başlangıç komut dosyasına geçelim. Bu komut dosyası aşağıdaki işlemleri yapar:

- Veritabanı örneğiyle bağlantıyı başlatma

- İki PostgreSQL uzantısı yükler:

google_ml_integration: Vertex AI yerleştirme modellerini doğrudan SQL'den çağıranembedding()SQL işlevini sağlar. Bu,jobs_dbiçinde makine öğrenimi işlevlerini kullanılabilir hale getiren bir veritabanı düzeyinde uzantıdır. Örnek oluşturma sırasında ayarladığınız örnek düzeyindeki işaret (--enable-google-ml-integration), Cloud SQL VM'nin Vertex AI'ye ulaşmasına olanak tanır. Bu uzantı, SQL işlevlerini söz konusu veritabanında kullanılabilir hâle getirir.vector(pgvector): Yerleştirmeleri depolamak ve sorgulamak içinvectorveri türünü ve mesafe operatörlerini ekler.

- Tabloyu oluşturun.

description_embeddingsütunununvector(3072)olduğunu unutmayın. Bu, 3072 boyutlu vektörleri depolayan birpgvectorsütunudur. - İlk iş verilerini doldurma

descriptionalanından yerleştirme verilerini oluşturun veembedding()işlevi aracılığıyla yerleşik Vertex entegrasyonunu kullanarakdescription_embeddingalanını doldurun.

embedding('gemini-embedding-001', description)— Her işindescriptionmetnini ileterek doğrudan SQL'den Vertex AI'ın Gemini yerleştirme modelini çağırır. Bu, başlangıç komut dosyasına yüklediğinizgoogle_ml_integrationuzantısıdır.::vector: Döndürülen kayan nokta dizisini, mesafe operatörleriyle depolanıp sorgulanabilmesi için pgvector'ınvectortürüne yayınlar.UPDATE, 15 satırın tamamında çalışarak iş tanımı başına 3072 boyutlu bir yerleştirme oluşturur.

Bu işlem, müşteri temsilcimiz tarafından erişilecek ilk verileri hazırlar.

5. Veritabanları için MCP Araç Kutusu'nu yapılandırma

Bu adımda, MCP Toolbox for Databases tanıtılır, Cloud SQL örneğinize bağlanmak için yapılandırılır ve iki standart SQL sorgu aracı tanımlanır.

MCP nedir ve neden Toolbox'ı kullanmalısınız?

MCP (Model Context Protocol), yapay zeka ajanlarının harici araçları keşfetme ve bunlarla etkileşime girme şeklini standartlaştıran açık bir protokoldür. Bu, bir istemci-sunucu modeli tanımlar: Ajan, bir MCP istemcisine ev sahipliği yapar ve araçlar MCP sunucuları tarafından kullanıma sunulur. MCP ile uyumlu herhangi bir istemci, MCP ile uyumlu herhangi bir sunucuyu kullanabilir. Aracının her araç için özel entegrasyon koduna ihtiyacı yoktur.

Veritabanları için MCP Araç Kutusu, özellikle veritabanı erişimi için oluşturulmuş açık kaynaklı bir MCP sunucusudur. Bu olmadan, veritabanı bağlantılarını açan, bağlantı havuzlarını yöneten, SQL eklemeyi önlemek için parametreli sorgular oluşturan, hataları işleyen ve tüm bu kodu aracınıza yerleştiren Python işlevleri yazmanız gerekirdi. Veritabanı erişimi gereken her temsilci bu çalışmayı tekrarlar. Bir sorguyu değiştirmek, temsilcinin yeniden dağıtılması anlamına gelir.

Araç kutusu ile bir YAML dosyası yazarsınız. Her araç, parametrelendirilmiş bir SQL ifadesiyle eşlenir. Toolbox, bağlantı havuzunu, parametreli sorguları, kimlik doğrulamayı ve gözlemlenebilirliği yönetir. Araçlar, aracıdan ayrılır. tools.yaml düzenleyerek ve Toolbox'ı yeniden başlatarak sorguyu güncelleyin. Aracı koduna dokunmayın. Aynı araçlar ADK, LangGraph, LlamaIndex veya MCP ile uyumlu herhangi bir çerçevede çalışır.

Araç yapılandırmasını yazma

Şimdi, araç yapılandırmamızı ayarlamak için Cloud Shell Düzenleyici'de tools.yaml adlı bir dosya oluşturmamız gerekiyor.

cloudshell edit tools.yaml

Dosyada çok dokümanlı YAML kullanılır. --- ile ayrılan her blok bağımsız bir kaynaktır. Her kaynağın, ne olduğunu bildiren bir kind (veritabanı bağlantıları için sources, aracı tarafından çağrılabilir işlemler için tools) ve arka ucu belirten bir type (kaynak için cloud-sql-postgres, SQL tabanlı araçlar için postgres-sql) vardır. Bir araç, kaynağına name ile referans verir. Toolbox, hangi bağlantı havuzunun yürütüleceğini bu şekilde bilir. Ortam değişkenleri ${VAR_NAME} söz dizimini kullanır ve başlatma sırasında çözümlenir.

Şimdi aşağıdaki komut dosyalarını önce tools.yaml dosyasına kopyalayalım.

# tools.yaml

# --- Data Source ---

kind: source

name: jobs-db

type: cloud-sql-postgres

project: ${GOOGLE_CLOUD_PROJECT}

region: ${REGION}

instance: ${DB_INSTANCE}

database: ${DB_NAME}

user: postgres

password: ${DB_PASSWORD}

---

Buradaki komut dosyası aşağıdaki kaynağı tanımlar:

- Kaynak (

jobs-db): Toolbox'ın Cloud SQL PostgreSQL örneğinize nasıl bağlanacağını belirtir.cloud-sql-postgrestürü, kimlik doğrulama ve güvenli bağlantıları otomatik olarak işleyerek dahili olarak Cloud SQL bağlayıcısını kullanır.${GOOGLE_CLOUD_PROJECT},${REGION}ve${DB_PASSWORD}yer tutucuları, başlangıçta ortam değişkenlerinden çözümlenir.

Ardından, tools.yaml dosyasındaki --- sembolünün altına aşağıdaki komut dosyasını ekleyin.

# --- Tool 1: Search jobs by role and/or tech stack ---

kind: tool

name: search-jobs

type: postgres-sql

source: jobs-db

description: >-

Search for job listings by role category and/or tech stack.

Use this tool when the developer wants to browse listings

by role (e.g., Backend, Frontend, Data) or find jobs

using a specific technology. Both parameters accept an

empty string to match all values.

statement: |

SELECT title, company, role, tech_stack, salary_range, location, openings

FROM jobs

WHERE ($1 = '' OR LOWER(role) = LOWER($1))

AND ($2 = '' OR LOWER(tech_stack) LIKE '%' || LOWER($2) || '%')

ORDER BY title

LIMIT 10

parameters:

- name: role

type: string

description: "The role category to filter by (e.g., 'Backend', 'Frontend', 'Data/AI', 'DevOps'). Use empty string for all roles."

- name: tech_stack

type: string

description: "A technology to search for in the tech stack (partial match, e.g., 'Python', 'Kubernetes'). Use empty string for all tech stacks."

---

# --- Tool 2: Get full details for a specific job ---

kind: tool

name: get-job-details

type: postgres-sql

source: jobs-db

description: >-

Get full details for a specific job listing including its description,

salary range, location, and number of openings. Use this tool when the

developer asks about a particular job by title or company.

statement: |

SELECT title, company, role, tech_stack, salary_range, location, openings, description

FROM jobs

WHERE LOWER(title) LIKE '%' || LOWER($1) || '%'

OR LOWER(company) LIKE '%' || LOWER($1) || '%'

parameters:

- name: search_term

type: string

description: "The job title or company name to look up (partial match supported)."

---

Buradaki komut dosyası aşağıdaki kaynağı tanımlar:

- 1. ve 2. araçlar (

search-jobs,get-job-details): Standart SQL sorgu araçları. Her biri bir araç adını (aracının gördüğü) parametrelendirilmiş bir SQL ifadesiyle (veritabanının yürüttüğü) eşler. Parametreler$1,$2konumsal yer tutucularını kullanır. Araç kutusu, bunları hazırlanmış ifadeler olarak yürütür. Bu sayede SQL yerleştirme önlenir.

Devam edelim ve tools.yaml dosyasında --- sembolünün altına aşağıdaki komut dosyasını ekleyin.

# --- Embedding Model ---

kind: embeddingModel

name: gemini-embedding

type: gemini

model: gemini-embedding-001

project: ${GOOGLE_CLOUD_PROJECT}

location: ${GOOGLE_CLOUD_LOCATION}

dimension: 3072

---

Buradaki komut dosyası aşağıdaki kaynağı tanımlar:

- Yerleştirme modeli (

gemini-embedding): Araç Kutusu'nu, 3.072 boyutlu metin yerleştirmeleri oluşturmak için Gemini'ıngemini-embedding-001modelini çağıracak şekilde yapılandırır. Araç kutusu, kimlik doğrulamak için Uygulama Varsayılan Kimlik Bilgileri'ni (ADC) kullanır. Cloud Shell veya Cloud Run'da API anahtarı gerekmez. Burada yapılandırılandimension, veritabanını başlatmak için daha önce yapılandırdığımızdimensionile aynı olmalıdır.

Devam edelim ve tools.yaml dosyasında --- sembolünün altına aşağıdaki komut dosyasını ekleyin.

# --- Tool 3: Semantic search by description ---

kind: tool

name: search-jobs-by-description

type: postgres-sql

source: jobs-db

description: >-

Find jobs that match a natural language description of what the developer

is looking for. Use this tool when the developer describes their ideal job

using interests, work style, career goals, or project type rather than a

specific role or tech stack. Examples: "I want to work on AI chatbots,"

"a remote job at a fintech startup," "something involving infrastructure

and reliability."

statement: |

SELECT title, company, role, tech_stack, salary_range, location, description

FROM jobs

WHERE description_embedding IS NOT NULL

ORDER BY description_embedding <=> $1

LIMIT 5

parameters:

- name: search_query

type: string

description: "A natural language description of the kind of job the developer is looking for."

embeddedBy: gemini-embedding

---

Buradaki komut dosyası aşağıdaki kaynağı tanımlar:

- 3. Araç (

search-jobs-by-description): Vektör arama aracı.search_queryparametresindeembeddedBy: gemini-embeddingbulunur. Bu parametre, Araç Kutusu'na ham metni yakalamasını, yerleştirme modeline göndermesini ve sonuçtaki vektörü SQL ifadesinde kullanmasını söyler.<=>operatörü, pgvector'ın kosinüs uzaklığıdır. Daha küçük değerler, daha benzer açıklamalar anlamına gelir.

Son olarak, tools.yaml dosyasında --- simgesinin altına son aracı ekleyin.

# --- Tool 4: Add a new job listing with automatic embedding ---

kind: tool

name: add-job

type: postgres-sql

source: jobs-db

description: >-

Add a new job listing to the platform. Use this tool when a user asks

to post a job that is not currently listed.

statement: |

INSERT INTO jobs (title, company, role, tech_stack, salary_range, location, openings, description, description_embedding)

VALUES ($1, $2, $3, $4, $5, $6, CAST($7 AS INTEGER), $8, $9)

RETURNING title, company

parameters:

- name: title

type: string

description: "The job title (e.g., 'Senior Backend Engineer')."

- name: company

type: string

description: "The company name (e.g., 'Stripe', 'Spotify')."

- name: role

type: string

description: "The role category (e.g., 'Backend', 'Frontend', 'Data/AI', 'DevOps')."

- name: tech_stack

type: string

description: "Comma-separated list of technologies (e.g., 'Python, FastAPI, GCP')."

- name: salary_range

type: string

description: "The salary range (e.g., '$150-200K/year')."

- name: location

type: string

description: "Work location and arrangement (e.g., 'Remote')."

- name: openings

type: string

description: "The number of open positions."

- name: description

type: string

description: "A short description of the job (2-3 sentences)."

- name: description_vector

type: string

description: "Auto-generated embedding vector for the job description."

valueFromParam: description

embeddedBy: gemini-embedding

Buradaki komut dosyası aşağıdaki kaynağı tanımlar:

- 4. Araç (

add-job): Vektör alımını gösterir.description_vectorparametresinin iki özel alanı vardır: valueFromParam: description: Araç kutusu,descriptionparametresindeki değeri bu parametreye kopyalar. LLM bu parametreyi hiçbir zaman görmez.embeddedBy: gemini-embedding: Araç kutusu, kopyalanan metni SQL'e iletmeden önce bir vektöre yerleştirir.

Sonuç: Bir araç çağrısı, hem ham açıklama metnini hem de vektör yerleştirmesini depolar. Böylece, aracı yerleştirmeler hakkında hiçbir şey bilmez.

Çok dokümanlı YAML biçimi, her kaynağı --- ile ayırır. Her belgenin ne olduğunu tanımlayan kind, name ve type alanları vardır. Özetle, aşağıdakilerin tümünü zaten yapılandırdık:

- Kaynak veritabanını tanımlama

- Veritabanına standart filtreyle sorgu uygulamak için araçlar ( 1. ve 2. araç ) tanımlayın.

- Yerleştirme modelini tanımlama

- Veritabanında vektör araması yapacak aracı tanımlayın ( tool 3 ).

- Vektör verilerini veritabanına veri kullanımı yapmak için aracı tanımlayın ( 4. araç ).

6. MCP Toolbox Sunucusunu Çalıştırma

Önceki adımda, MCP Toolbox'ımız için gerekli yapılandırmayı zaten ayarladık. Artık sunucuyu çalıştırmaya hazırız.

Başlangıç verilerini doğrulama

Araç kutusunu başlatmadan önce veritabanı kurulumunun tamamlandığını onaylayalım. Aşağıdaki komutu kullanarak bir Python komut dosyası scripts/verify_database.py oluşturun.

cloudshell edit scripts/verify_seed.py

Ardından, aşağıdaki kodu scripts/verify_seed.py dosyasına kopyalayın.

#!/usr/bin/env python3

"""Verify the database has 15 jobs with embeddings."""

import os

import sys

from pathlib import Path

from dotenv import load_dotenv

from google.cloud.sql.connector import Connector

import pg8000

# Load environment variables

env_path = Path(__file__).parent.parent / '.env'

load_dotenv(env_path)

# Verify required environment variables

required_vars = ['GOOGLE_CLOUD_PROJECT', 'REGION', 'DB_PASSWORD', 'DB_INSTANCE', 'DB_NAME']

missing_vars = [var for var in required_vars if not os.environ.get(var)]

if missing_vars:

print(f"ERROR: Missing environment variables: {', '.join(missing_vars)}", file=sys.stderr)

sys.exit(1)

def verify_database():

"""Check that 15 jobs exist with embeddings."""

connector = Connector()

try:

project = os.environ['GOOGLE_CLOUD_PROJECT']

region = os.environ['REGION']

password = os.environ['DB_PASSWORD']

instance = os.environ['DB_INSTANCE']

database = os.environ['DB_NAME']

conn = connector.connect(

f"{project}:{region}:{instance}",

"pg8000",

user="postgres",

password=password,

db=database

)

cursor = conn.cursor()

# Count jobs and embeddings

cursor.execute("SELECT COUNT(*) FROM jobs")

job_count = cursor.fetchone()[0]

cursor.execute("SELECT COUNT(*) FROM jobs WHERE description_embedding IS NOT NULL")

embedding_count = cursor.fetchone()[0]

print(f"Jobs: {job_count}/15")

print(f"Embeddings: {embedding_count}/15")

cursor.close()

conn.close()

if job_count == 15 and embedding_count == 15:

print("\n✓ Database ready!")

return True

else:

print("\n✗ Database not ready")

return False

except Exception as e:

print(f"\nERROR: {e}", file=sys.stderr)

return False

finally:

connector.close()

if __name__ == "__main__":

success = verify_database()

sys.exit(0 if success else 1)

Bu komut dosyası, iş ilanı verilerinin sayısını ve yerleştirilme durumunu kontrol eder. Aşağıdaki komutu kullanarak komut dosyasını çalıştırın.

uv run scripts/verify_seed.py

Aşağıdaki terminal çıkışını görüyorsanız veriler hazır demektir.

Jobs: 15/15 Embeddings: 15/15 ✓ Database ready!

Araç kutusu sunucusunu başlatma

Kurulumun önceki adımında toolbox yürütülebilir dosyasını indirmiştik. Bu ikili program dosyasının mevcut olduğundan ve başarıyla indirildiğinden emin olun. Aksi takdirde dosyayı indirip işlemin tamamlanmasını bekleyin.

cd ~/build-agent-adk-toolbox-cloudsql

if [ ! -f toolbox ]; then

curl -O https://storage.googleapis.com/mcp-toolbox-for-databases/v1.0.0/linux/amd64/toolbox

fi

chmod +x toolbox

.env değişkenlerimizi, MCP araç kutusu tarafından çalıştırılan alt işleme aktarmamız gerekir. Araç kutusu sunucusunu başlatmak ve konsol çıkışını logs/mcp_toolbox.log dosyasına kaydetmek için aşağıdaki komutu çalıştırın.

set -a; source .env; set +a

./toolbox --config tools.yaml --enable-api > logs/mcp_toolbox.log 2>&1 &

logs/mcp_toolbox.log dosyasında, sunucunun hazır olduğunu onaylayan aşağıdaki gibi bir çıkış görmeniz gerekir:

... INFO "Initialized 1 sources: jobs-db" ... INFO "Initialized 0 authServices: " ... INFO "Using Vertex AI backend for Gemini embedding" ... INFO "Initialized 1 embeddingModels: gemini-embedding" ... INFO "Initialized 4 tools: add-job, search-jobs, get-job-details, search-jobs-by-description" ... ... INFO "Server ready to serve!"

Araçları doğrulama

Kayıtlı tüm araçları listelemek için Araç Kutusu API'sini sorgulayın:

curl -s http://localhost:5000/api/toolset | uv run -m json.tool

Açıklamaları ve parametreleriyle birlikte araçları görürsünüz. Aşağıda gösterildiği gibi

...

"search-jobs-by-description": {

"description": "Find jobs that match a natural language description of what the developer is looking for. Use this tool when the developer describes their ideal job using interests, work style, career goals, or project type rather than a specific role or tech stack. Examples: \"I want to work on AI chatbots,\" \"a remote job at a fintech startup,\" \"something involving infrastructure and reliability.\"",

"parameters": [

{

"name": "search_query",

"type": "string",

"required": true,

"description": "A natural language description of the kind of job the developer is looking for.",

"authSources": []

}

],

"authRequired": []

}

...

search-jobs aracını doğrudan test edin:

curl -s -X POST http://localhost:5000/api/tool/search-jobs/invoke \

-H "Content-Type: application/json" \

-d '{"role": "Backend", "tech_stack": ""}' | jq '.result | fromjson'

Yanıt, başlangıç verilerinizdeki iki arka uç mühendisliği işini içermelidir.

[

{

"title": "Backend Engineer (Payments)",

"company": "Square",

"role": "Backend",

"tech_stack": "Java, Spring Boot, PostgreSQL, Kafka",

"salary_range": "$160-220K/year",

"location": "San Francisco, Hybrid",

"openings": 3

},

{

"title": "Senior Backend Engineer",

"company": "Stripe",

"role": "Backend",

"tech_stack": "Go, PostgreSQL, gRPC, Kubernetes",

"salary_range": "$180-250K/year",

"location": "San Francisco, Hybrid",

"openings": 3

}

]

7. ADK aracısını oluşturma

Şimdi bu proje için Python'da ADK'yı kullanacağız. Gerekli bağımlılıkları ekleyelim:

uv add google-adk==1.29.0 toolbox-adk==1.0.0

google-adk: Gemini SDK dahil olmak üzere Google'ın Agent Development Kit'itoolbox-adk— Veritabanları için MCP Araç Kutusu'na yönelik ADK entegrasyonu.

Temsilci dizin yapısını oluşturma

ADK, belirli bir klasör düzeni bekler: __init__.py, agent.py ve .env içeren, aracınızın adını taşıyan bir dizin. Bu konuda yardımcı olmak için yapıyı hızlıca oluşturmanızı sağlayan yerleşik bir komut vardır:

uv run adk create jobs_agent \

--model gemini-2.5-flash \

--project ${GOOGLE_CLOUD_PROJECT} \

--region ${GOOGLE_CLOUD_LOCATION}

Dizininiz artık şu şekilde görünmelidir:

build-agent-adk-toolbox-cloudsql/ ├── jobs_agent/ │ ├── __init__.py │ ├── agent.py │ └── .env ├── logs ├── scripts └── ...

Ardından, ADK aracısını çalışan Toolbox sunucusuna entegre etmemiz ve dört aracı da (standart sorgular, semantik arama ve vektör alımı) test etmemiz gerekir. Aracı kodu minimum düzeydedir: Tüm veritabanı mantığı tools.yaml içinde yer alır.

Temsilcinin ortamını yapılandırma

ADK, kabuk ortamından GOOGLE_GENAI_USE_VERTEXAI, GOOGLE_CLOUD_PROJECT ve GOOGLE_CLOUD_LOCATION değerlerini okur. Bu değerleri önceki adımda ayarlamıştınız. Ajanlara özgü tek değişken TOOLBOX_URL'dır. Bu değişkeni, ajanın .env dosyasına ekleyin:

echo -e "\nTOOLBOX_URL=http://127.0.0.1:5000" >> jobs_agent/.env

Aracı modülünü güncelleme

Cloud Shell Düzenleyici'de jobs_agent/agent.py dosyasını açın.

cloudshell edit jobs_agent/agent.py

ve içeriğin üzerine aşağıdaki kodu yazın:

# jobs_agent/agent.py

import os

from google.adk.agents import LlmAgent

from toolbox_adk import ToolboxToolset

TOOLBOX_URL = os.environ.get("TOOLBOX_URL", "http://127.0.0.1:5000")

toolbox = ToolboxToolset(TOOLBOX_URL)

root_agent = LlmAgent(

name="jobs_agent",

model="gemini-2.5-flash",

instruction="""You are a helpful assistant at "TechJobs," a tech job listing platform.

Your job:

- Help developers browse job listings by role or tech stack.

- Provide full details about specific positions, including salary range and number of openings.

- Recommend jobs based on natural language descriptions of what the developer is looking for.

- Add new job listings to the platform when asked.

When a developer asks about a specific job by title or company, use the get-job-details tool.

When a developer asks for a specific role category or tech stack, use the search-jobs tool.

When a developer describes what kind of job they want — by interest area, work style,

career goals, or project type — use the search-jobs-by-description tool for semantic search.

When in doubt between search-jobs and search-jobs-by-description, prefer

search-jobs-by-description — it searches job descriptions and finds more relevant matches.

If a position has no openings (openings is 0), let the developer know

and suggest similar alternatives from the search results.

Be conversational, knowledgeable, and concise.""",

tools=[toolbox],

)

Burada veritabanı kodu olmadığını unutmayın. ToolboxToolset, başlangıçta Toolbox sunucusuna bağlanır ve mevcut tüm araçları yükler. Aracı, araçları adıyla çağırır. Toolbox, bu çağrıları Cloud SQL'e karşı SQL sorgularına çevirir.

TOOLBOX_URL ortam değişkeni, yerel geliştirme için varsayılan olarak http://127.0.0.1:5000 değerini alır. Daha sonra Cloud Run'a dağıtım yaptığınızda bunu Toolbox hizmetinin Cloud Run URL'siyle geçersiz kılarsınız. Kod değişikliği yapmanız gerekmez.

Talimatta şu anda yalnızca iki standart araç (search-jobs ve get-job-details) referans olarak verilmektedir. Semantik arama ve alım araçlarını eklediğinizde talimatı genişleteceksiniz.

Temsilciyi test etme

ADK geliştirici kullanıcı arayüzünü başlatın:

cd ~/build-agent-adk-toolbox-cloudsql

uv run adk web --allow_origins "regex:https://.*\.cloudshell\.dev"

Cloud Shell'in Web Önizleme özelliğini kullanarak veya terminalde gösterilen URL'yi Ctrl + tıklayarak terminalde gösterilen URL'yi (genellikle http://localhost:8000) açın. Sol üst köşedeki aracı açılır listesinden jobs_agent'ı seçin.

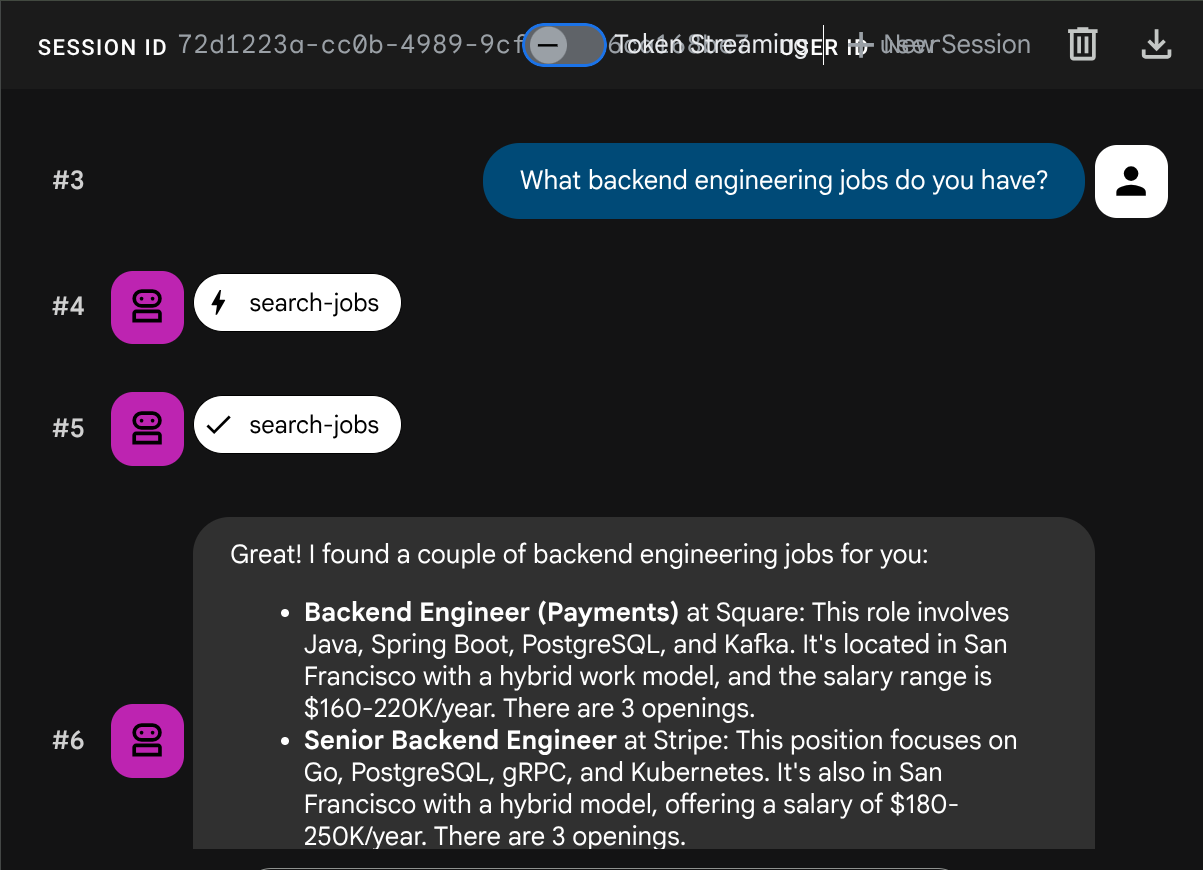

Standart sorguları test etme

Standart SQL araçlarını doğrulamak için aşağıdaki istemleri deneyin:

What backend engineering jobs do you have?

Any jobs using Kubernetes?

Tell me about the Cloud Architect position

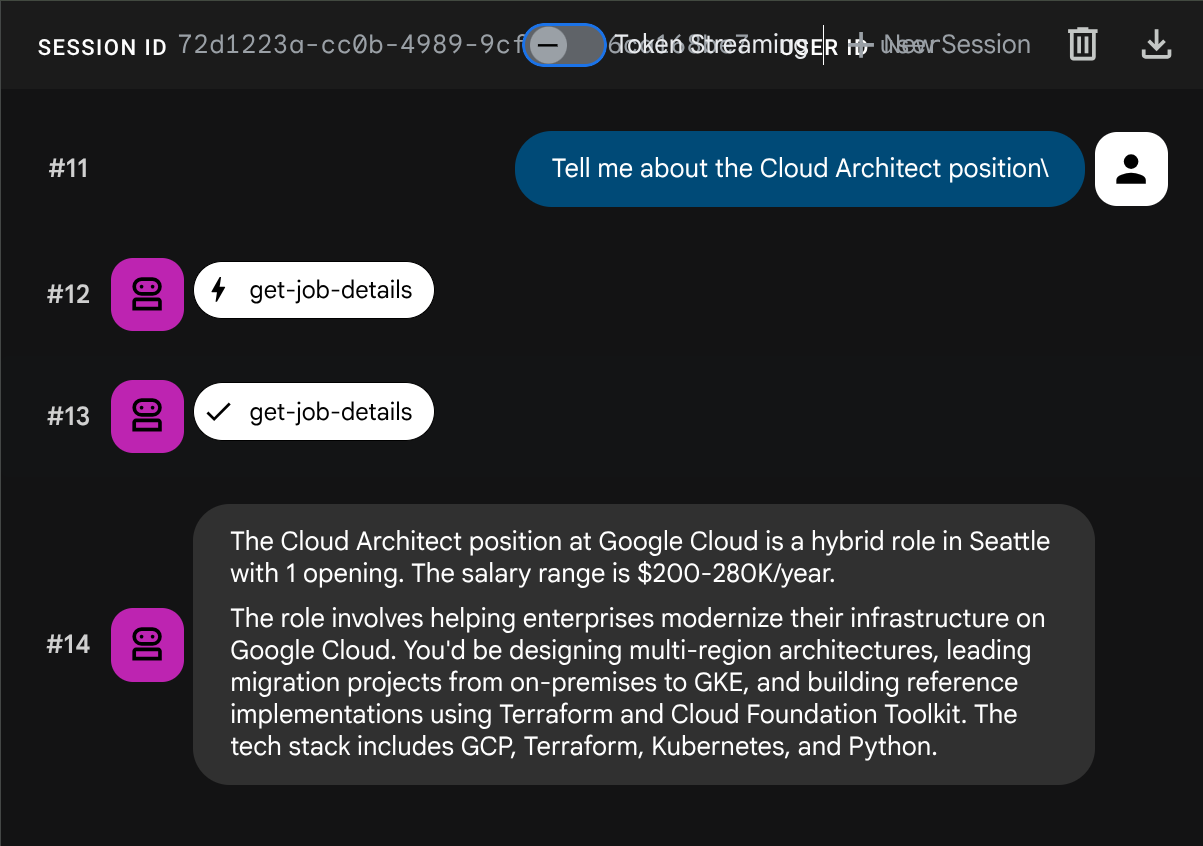

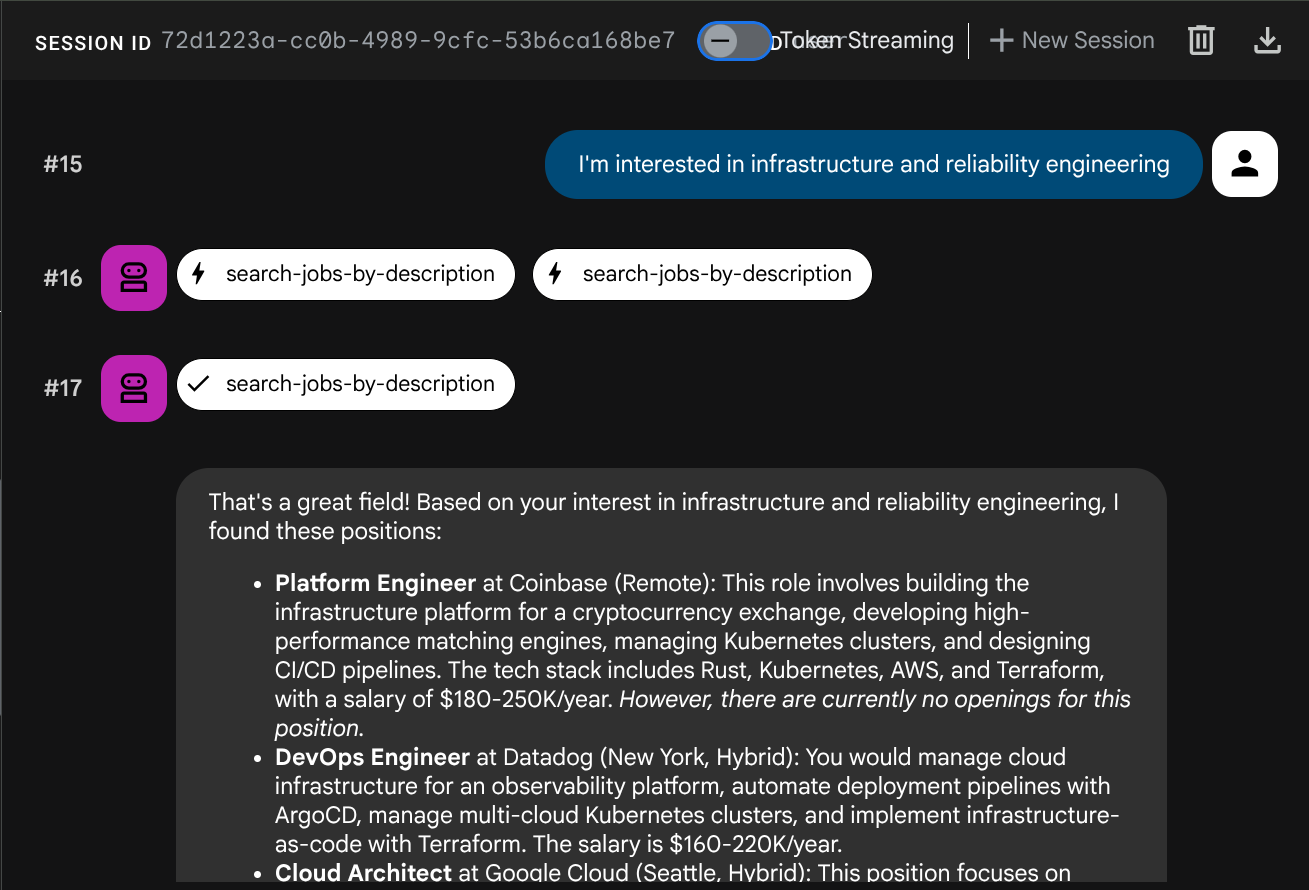

Semantik aramayı test etme

Belirli bir role veya teknoloji yığınına karşılık gelmeyen doğal dil açıklamalarını deneyin:

I want a remote job where I can work on AI and machine learning

Find me something in fintech with good work-life balance

I'm interested in infrastructure and reliability engineering

Temsilci, sorgu türüne göre doğru aracı seçmeye çalışır: Yapılandırılmış filtreler search-jobs, doğal dil açıklamaları ise search-jobs-by-description üzerinden geçer.

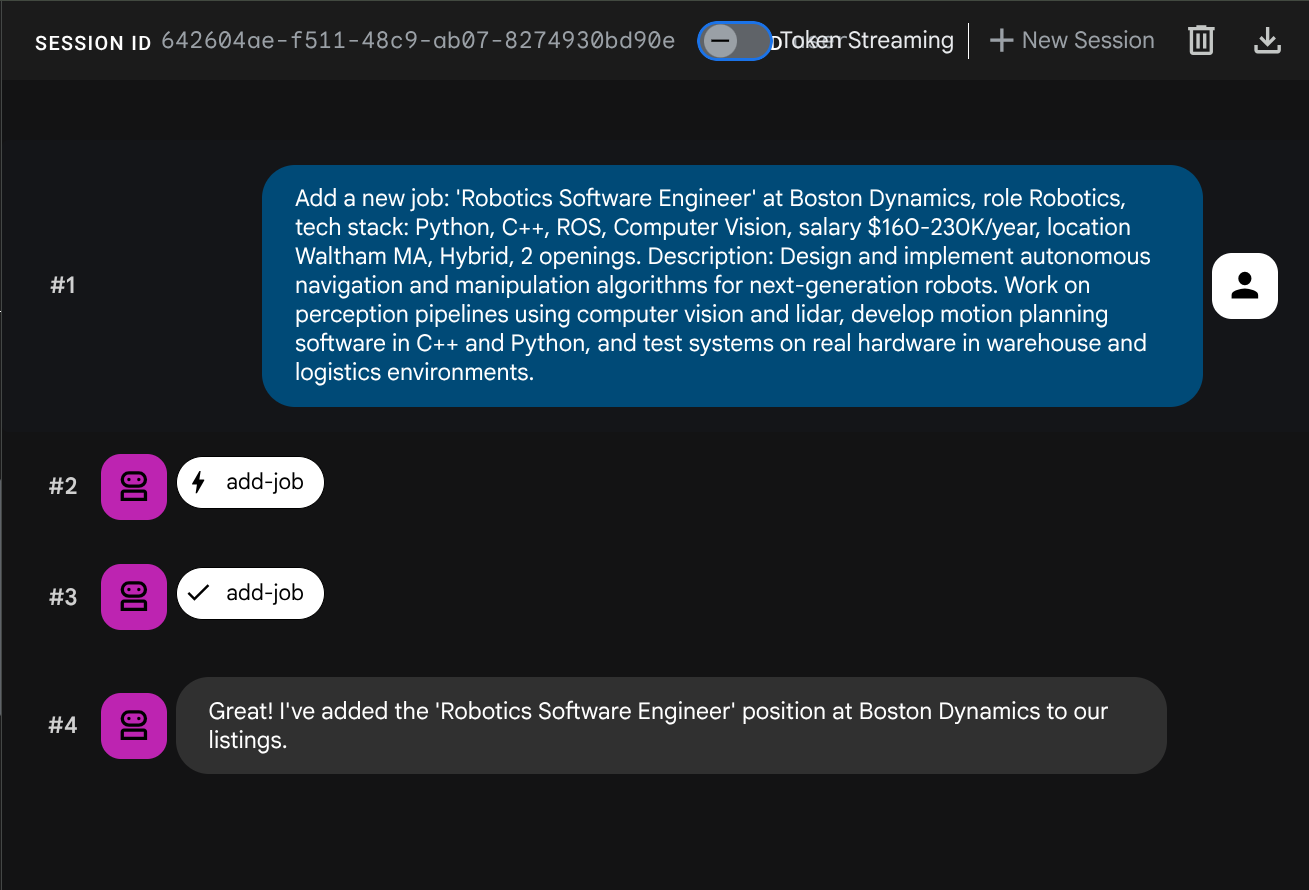

Vektör beslemeyi test etme

Temsilciden yeni bir iş eklemesini isteyin:

Add a new job: 'Robotics Software Engineer' at Boston Dynamics, role Robotics, tech stack: Python, C++, ROS, Computer Vision, salary $160-230K/year, location Waltham MA, Hybrid, 2 openings. Description: Design and implement autonomous navigation and manipulation algorithms for next-generation robots. Work on perception pipelines using computer vision and lidar, develop motion planning software in C++ and Python, and test systems on real hardware in warehouse and logistics environments.

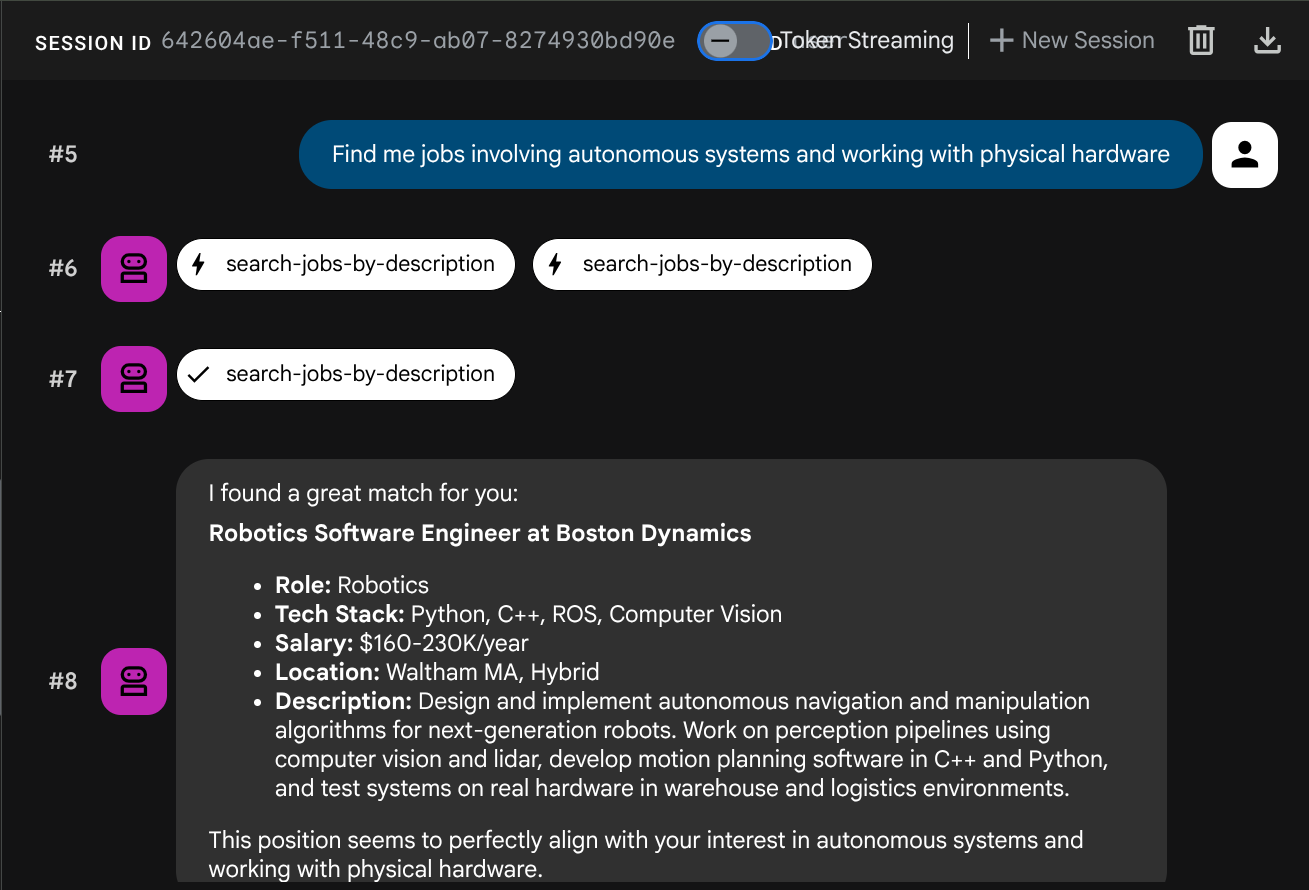

Şimdi aramayı deneyin:

Find me jobs involving autonomous systems and working with physical hardware

Yerleştirme, INSERT sırasında otomatik olarak oluşturuldu. Ayrı bir adım gerekmedi.

Artık ADK, MCP Toolbox ve CloudSQL'i kullanan, tam işlevsel bir ajan tabanlı RAG uygulamanız var. Tebrikler! Şimdi bu uygulamaları Cloud Run'a dağıtmak için bir adım daha atalım.

Şimdi devam etmeden önce Ctrl+C tuşlarına iki kez basarak işlemi sonlandırıp geliştirici kullanıcı arayüzünü durduralım.

8. Cloud Run'a dağıt

Aracı ve Araç Kutusu yerel olarak çalışır. Bu adımda her ikisi de Cloud Run hizmeti olarak dağıtılır. Böylece internet üzerinden erişilebilirler. Toolbox hizmeti, Cloud Run'da bir MCP sunucusu olarak çalışır ve aracı hizmeti buna bağlanır.

Araç kutusunu dağıtıma hazırlama

Araç kutusu hizmeti için bir dağıtım dizini oluşturun:

cd ~/build-agent-adk-toolbox-cloudsql

mkdir -p deploy-toolbox

cp toolbox tools.yaml deploy-toolbox/

Araç kutusu için Dockerfile'ı oluşturun. Cloud Shell Düzenleyici'de deploy-toolbox/Dockerfile dosyasını açın:

cloudshell edit deploy-toolbox/Dockerfile

Aşağıdaki komut dosyasını bu dosyaya kopyalayın.

# deploy-toolbox/Dockerfile

FROM debian:bookworm-slim

RUN apt-get update && apt-get install -y ca-certificates && rm -rf /var/lib/apt/lists/*

WORKDIR /app

COPY toolbox tools.yaml ./

RUN chmod +x toolbox

EXPOSE 8080

CMD ["./toolbox", "--config", "tools.yaml", "--enable-api", "--address", "0.0.0.0", "--port", "8080"]

Araç kutusu ikili programı ve tools.yaml, minimum Debian görüntüsüne paketlenir. Cloud Run, trafiği 8080 numaralı bağlantı noktasına yönlendirir.

Araç Kutusu hizmetini dağıtma

cd ~/build-agent-adk-toolbox-cloudsql

gcloud run deploy toolbox-service \

--source deploy-toolbox/ \

--region $REGION \

--set-env-vars "DB_PASSWORD=$DB_PASSWORD,DB_INSTANCE=$DB_INSTANCE,DB_NAME=$DB_NAME,GOOGLE_CLOUD_PROJECT=$GOOGLE_CLOUD_PROJECT,REGION=$REGION,GOOGLE_CLOUD_LOCATION=$GOOGLE_CLOUD_LOCATION" \

--allow-unauthenticated \

--quiet > logs/deploy_toolbox.log 2>&1 &

Bu komut, kaynağı Cloud Build'e gönderir, bir container görüntüsü oluşturur, bunu Artifact Registry'ye aktarır ve Cloud Run'a dağıtır. Bu işlem birkaç dakika sürer. Dağıtım süreci günlüğünü logs/deploy_toolbox.log dosyasında inceleyebiliriz.

Aracı dağıtıma hazırlama

Araç kutusu oluşturulurken aracının dağıtım dosyalarını ayarlayın.

Proje kökünde Dockerfile oluşturun. Cloud Shell Düzenleyici'de Dockerfile dosyasını açın:

cloudshell edit Dockerfile

Ardından, aşağıdaki içeriği kopyalayın.

# Dockerfile

FROM ghcr.io/astral-sh/uv:python3.12-trixie-slim

WORKDIR /app

COPY pyproject.toml ./

COPY uv.lock ./

RUN uv sync --no-dev

COPY jobs_agent/ jobs_agent/

EXPOSE 8080

CMD ["uv", "run", "adk", "web", "--host", "0.0.0.0", "--port", "8080"]

Bu Dockerfile, temel görüntü olarak ghcr.io/astral-sh/uv kullanır. Bu görüntüde hem Python hem de uv önceden yüklenmiştir. Bu nedenle, uv'ı pip aracılığıyla ayrı olarak yüklemeniz gerekmez.

Gereksiz dosyaları kapsayıcı görüntüsünden hariç tutmak için .dockerignore dosyası oluşturun:

cloudshell edit .dockerignore

Ardından, aşağıdaki komut dosyasını kopyalayıp yapıştırın.

# .dockerignore

.venv/

__pycache__/

*.pyc

.env

jobs_agent/.env

toolbox

tools.yaml

seed.sql

deploy-toolbox/

Temsilci hizmetini dağıtma

Araç kutusu dağıtımının tamamlanmasını bekleyin. İşlemi doğrulamak için logs/deploy_toolbox.log adresinde dağıtım sürecini tekrar kontrol edin. Ardından, aşağıdaki komutu kullanarak Cloud Run URL'sini alın.

TOOLBOX_URL=$(gcloud run services describe toolbox-service \

--region=$REGION \

--format='value(status.url)')

echo "Toolbox URL: $TOOLBOX_URL"

Aşağıdakine benzer bir çıkış görürsünüz:

Toolbox URL: https://toolbox-service-xxxxxx-xx.a.run.app

Ardından, dağıtılan araç kutusunun çalıştığını doğrulayalım:

curl -s "$TOOLBOX_URL/api/toolset" | python3 -m json.tool | head -5

Çıktı bu örnekteki gibi gösteriliyorsa dağıtım zaten başarılı olmuştur.

{

"serverVersion": "1.0.0+binary.linux.amd64.c5524d3",

"tools": {

"add-job": {

"description": "Add a new job listing to the platform. Use this tool when a user asks to post a job that is not currently listed.",

Ardından, Toolbox URL'sini ortam değişkeni olarak ileterek aracı dağıtalım:

cd ~/build-agent-adk-toolbox-cloudsql

gcloud run deploy jobs-agent \

--source . \

--region $REGION \

--set-env-vars "TOOLBOX_URL=$TOOLBOX_URL,GOOGLE_CLOUD_PROJECT=$GOOGLE_CLOUD_PROJECT,GOOGLE_CLOUD_LOCATION=$GOOGLE_CLOUD_LOCATION,GOOGLE_GENAI_USE_VERTEXAI=TRUE" \

--allow-unauthenticated \

--quiet

Aracı kodu, ortamdan TOOLBOX_URL değerini okur (bunu daha önce ayarlamış olmanız gerekir). Yerel olarak http://127.0.0.1:5000'ya, Cloud Run'da ise Toolbox hizmeti URL'sine yönlendirir. Kod değişikliği gerekmez.

Dağıtılan temsilciyi test etme

Temsilcinin Cloud Run URL'sini alın:

AGENT_URL=$(gcloud run services describe jobs-agent \

--region=$REGION \

--format='value(status.url)')

echo "Agent URL: $AGENT_URL"

URL'yi tarayıcınızda açın. ADK geliştirici kullanıcı arayüzü yüklenir. Bu arayüz, yerel olarak kullandığınız arayüzün Cloud Run'da çalışan sürümüdür.

Açılır menüden jobs_agent'ı seçin ve test edin:

What backend engineering jobs do you have?

I want a remote job working on AI and machine learning

Her iki sorgu da dağıtılan hizmetler üzerinden çalışır: Cloud Run'daki aracı, Cloud SQL'i sorgulayan Cloud Run'daki Toolbox'ı çağırır.

9. Tebrikler / Temizleme

Hem standart SQL sorgularını hem de semantik vektör aramayı kullanarak bir ADK aracısı ile Cloud SQL PostgreSQL arasında köprü kurmak için Veritabanları için MCP Araç Kutusu'nu kullanan akıllı bir iş ilanı panosu asistanı oluşturup dağıttınız.

Öğrendikleriniz

- MCP'nin yapay zeka aracıları için araç erişimini nasıl standartlaştırdığı ve MCP Toolbox for Databases'in bunu özellikle veritabanı işlemlerine nasıl uyguladığı (özel veritabanı kodunu bildirimsel YAML yapılandırmasıyla değiştirme)

cloud-sql-postgreskaynak türünü kullanarak Cloud SQL PostgreSQL'i Toolbox veri kaynağı olarak yapılandırma- SQL yerleştirilmesini önleyen parametreli ifadelerle standart SQL sorgu araçları tanımlama

- Otomatik sorgu yerleştirme için

embeddedByparametresiyle birlikte pgvector vegemini-embedding-001kullanarak vektör aramasını etkinleştirme valueFromParam, otomatik vektör alımını nasıl sağlar? LLM, metin açıklaması sağlar ve Araç Kutusu, vektörü metinle birlikte sessizce kopyalar, yerleştirir ve depolar.- ADK'nın

ToolboxToolset, çalışan bir Araç Kutusu sunucusundan araçları nasıl yüklediği, aracı kodunu minimumda tuttuğu ve veritabanı mantığını tamamen ayırdığı - Toolbox MCP sunucusunu ve ADK aracısını Cloud Run'a ayrı hizmetler olarak dağıtma

Temizleme

Bu codelab'de oluşturulan kaynaklar için Google Cloud hesabınızın ücretlendirilmesini istemiyorsanız kaynakları tek tek veya projenin tamamını silebilirsiniz.

1. seçenek: Projeyi silme (önerilir)

Temizlemenin en kolay yolu projeyi silmektir. Bu işlem, projeyle ilişkili tüm kaynakları kaldırır.

gcloud projects delete $GOOGLE_CLOUD_PROJECT

2. seçenek: Kaynakları tek tek silme

Projeyi korumak ancak yalnızca bu codelab'de oluşturulan kaynakları kaldırmak istiyorsanız:

gcloud run services delete jobs-agent --region=$REGION --quiet

gcloud run services delete toolbox-service --region=$REGION --quiet

gcloud sql instances delete jobs-instance --quiet

gcloud artifacts repositories delete cloud-run-source-deploy --location=$REGION --quiet 2>/dev/null