1. खास जानकारी

इस लैब में, BigQuery Studio में मौजूद Python नोटबुक से BigQuery DataFrames का इस्तेमाल किया जाएगा. इससे, आयोवा में शराब की बिक्री से जुड़े सार्वजनिक डेटासेट को साफ़ किया जा सकेगा और उसका विश्लेषण किया जा सकेगा. अहम जानकारी पाने के लिए, BigQuery ML और रिमोट फ़ंक्शन की सुविधाओं का इस्तेमाल करें.

आपको अलग-अलग भौगोलिक क्षेत्रों में हुई बिक्री की तुलना करने के लिए, एक Python नोटबुक बनानी होगी. इसे किसी भी स्ट्रक्चर्ड डेटा के साथ काम करने के लिए अडैप्ट किया जा सकता है.

मकसद

इस लैब में, आपको ये टास्क करने का तरीका बताया जाएगा:

- BigQuery Studio में Python नोटबुक चालू करना और उनका इस्तेमाल करना

- BigQuery DataFrames पैकेज का इस्तेमाल करके BigQuery से कनेक्ट करना

- BigQuery ML का इस्तेमाल करके लीनियर रिग्रेशन बनाना

- Pandas जैसे सिंटैक्स का इस्तेमाल करके, जटिल एग्रीगेशन और जॉइन किए जा सकते हैं

2. ज़रूरी शर्तें

शुरू करने से पहले

इस कोडलैब में दिए गए निर्देशों का पालन करने के लिए, आपके पास BigQuery Studio की सुविधा चालू किया गया Google Cloud प्रोजेक्ट और उससे जुड़ा बिलिंग खाता होना चाहिए.

- Google Cloud Console में, प्रोजेक्ट चुनने वाले पेज पर जाकर, Google Cloud प्रोजेक्ट चुनें या बनाएं

- पक्का करें कि आपके Google Cloud प्रोजेक्ट के लिए बिलिंग चालू हो. किसी प्रोजेक्ट के लिए बिलिंग चालू है या नहीं, यह देखने का तरीका जानें

- ऐसेट मैनेजमेंट के लिए BigQuery Studio चालू करने से जुड़े निर्देशों का पालन करें.

BigQuery Studio को तैयार करना

एक खाली नोटबुक बनाएं और उसे रनटाइम से कनेक्ट करें.

- Google Cloud Console में BigQuery Studio पर जाएं.

- + बटन के बगल में मौजूद ▼ पर क्लिक करें.

- Python नोटबुक चुनें.

- टेंप्लेट चुनने वाला टूल बंद करें.

- नई कोड सेल बनाने के लिए, + कोड को चुनें.

- कोड सेल से, BigQuery DataFrames पैकेज का नया वर्शन इंस्टॉल करें.यह कमांड टाइप करें.

%pip install --upgrade bigframes --quiet

3. किसी सार्वजनिक डेटासेट को पढ़ना

नई कोड सेल में यह कोड चलाकर, BigQuery DataFrames पैकेज शुरू करें:

import bigframes.pandas as bpd

bpd.options.bigquery.ordering_mode = "partial"

bpd.options.display.repr_mode = "deferred"

ध्यान दें: इस ट्यूटोरियल में, हम एक्सपेरिमेंट के तौर पर उपलब्ध "पार्शियल ऑर्डरिंग मोड" का इस्तेमाल करते हैं. इससे pandas जैसे फ़िल्टरिंग टूल के साथ इस्तेमाल करने पर, क्वेरी ज़्यादा असरदार तरीके से काम करती हैं. पांडा की कुछ ऐसी सुविधाएं काम नहीं कर सकती हैं जिनके लिए, क्रम या इंडेक्स का सही होना ज़रूरी है.

bigframes पैकेज का वर्शन देखने के लिए,

bpd.__version__

इस ट्यूटोरियल के लिए, 1.27.0 या इसके बाद का वर्शन ज़रूरी है.

आयोवा में शराब की खुदरा बिक्री

आयोवा में शराब की खुदरा बिक्री का डेटासेट, BigQuery पर उपलब्ध है. इसे Google Cloud के सार्वजनिक डेटासेट प्रोग्राम के ज़रिए उपलब्ध कराया गया है. इस डेटासेट में, 1 जनवरी, 2012 से लेकर अब तक, आयोवा राज्य में खुदरा दुकानदारों की ओर से शराब की गई हर थोक खरीदारी की जानकारी शामिल है. यह खरीदारी, लोगों को शराब बेचने के लिए की गई थी. डेटा को आयोवा डिपार्टमेंट ऑफ़ कॉमर्स के अल्कोहलिक बेवरेजेस डिविज़न ने इकट्ठा किया है.

आयोवा में शराब की खुदरा बिक्री का विश्लेषण करने के लिए, BigQuery में bigquery-public-data.iowa_liquor_sales.sales को क्वेरी करें. क्वेरी स्ट्रिंग या टेबल आईडी से DataFrame बनाने के लिए, bigframes.pandas.read_gbq() तरीके का इस्तेमाल करें.

"df" नाम का DataFrame बनाने के लिए, नई कोड सेल में यह कोड चलाएं:

df = bpd.read_gbq_table("bigquery-public-data.iowa_liquor_sales.sales")

किसी DataFrame के बारे में बुनियादी जानकारी पाना

डेटा का छोटा सैंपल डाउनलोड करने के लिए, DataFrame.peek() तरीके का इस्तेमाल करें.

इस सेल को चलाएं:

df.peek()

अनुमानित आउटपुट:

index invoice_and_item_number date store_number store_name ...

0 RINV-04620300080 2023-04-28 10197 SUNSHINE FOODS / HAWARDEN

1 RINV-04864800097 2023-09-25 2621 HY-VEE FOOD STORE #3 / SIOUX CITY

2 RINV-05057200028 2023-12-28 4255 FAREWAY STORES #058 / ORANGE CITY

3 ...

ध्यान दें: head() के लिए क्रम से लगाने की ज़रूरत होती है. अगर आपको डेटा का सैंपल देखना है, तो आम तौर पर peek(), head() से कम असरदार होता है.

pandas की तरह ही, DataFrame.dtypes प्रॉपर्टी का इस्तेमाल करके, सभी उपलब्ध कॉलम और उनके डेटा टाइप देखें. इन्हें pandas के साथ काम करने वाले तरीके से दिखाया जाता है.

इस सेल को चलाएं:

df.dtypes

अनुमानित आउटपुट:

invoice_and_item_number string[pyarrow]

date date32[day][pyarrow]

store_number string[pyarrow]

store_name string[pyarrow]

address string[pyarrow]

city string[pyarrow]

zip_code string[pyarrow]

store_location geometry

county_number string[pyarrow]

county string[pyarrow]

category string[pyarrow]

category_name string[pyarrow]

vendor_number string[pyarrow]

vendor_name string[pyarrow]

item_number string[pyarrow]

item_description string[pyarrow]

pack Int64

bottle_volume_ml Int64

state_bottle_cost Float64

state_bottle_retail Float64

bottles_sold Int64

sale_dollars Float64

volume_sold_liters Float64

volume_sold_gallons Float64

dtype: object

DataFrame.describe() तरीके से, DataFrame से कुछ बुनियादी आंकड़ों के बारे में क्वेरी की जाती है. इन खास जानकारी वाले आंकड़ों को pandas DataFrame के तौर पर डाउनलोड करने के लिए, DataFrame.to_pandas() चलाएं.

इस सेल को चलाएं:

df.describe("all").to_pandas()

अनुमानित आउटपुट:

invoice_and_item_number date store_number store_name ...

nunique 30305765 <NA> 3158 3353 ...

std <NA> <NA> <NA> <NA> ...

mean <NA> <NA> <NA> <NA> ...

75% <NA> <NA> <NA> <NA> ...

25% <NA> <NA> <NA> <NA> ...

count 30305765 <NA> 30305765 30305765 ...

min <NA> <NA> <NA> <NA> ...

50% <NA> <NA> <NA> <NA> ...

max <NA> <NA> <NA> <NA> ...

9 rows × 24 columns

4. डेटा को विज़ुअलाइज़ करना और उसे साफ़ करना

आयोवा में शराब की खुदरा बिक्री के डेटासेट में, भौगोलिक जानकारी के बारे में ज़्यादा जानकारी मिलती है. इसमें यह भी शामिल है कि खुदरा दुकानें कहां मौजूद हैं. इस डेटा का इस्तेमाल करके, अलग-अलग भौगोलिक क्षेत्रों में ट्रेंड और अंतर की पहचान करें.

हर पिन कोड के हिसाब से बिक्री को विज़ुअलाइज़ करना

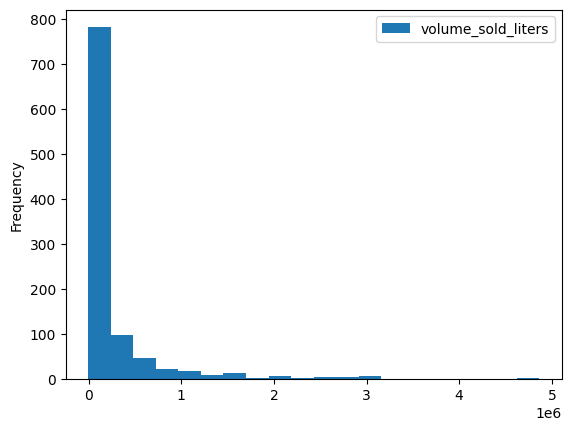

इसमें विज़ुअलाइज़ेशन के कई तरीके पहले से मौजूद होते हैं. जैसे, DataFrame.plot.hist(). इस तरीके का इस्तेमाल करके, पिन कोड के हिसाब से शराब की बिक्री की तुलना करें.

volume_by_zip = df.groupby("zip_code").agg({"volume_sold_liters": "sum"})

volume_by_zip.plot.hist(bins=20)

अनुमानित आउटपुट:

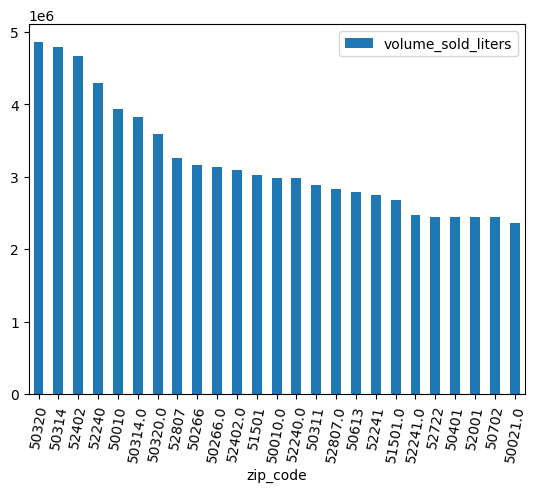

बार चार्ट का इस्तेमाल करके देखें कि किन ज़िप कोड में सबसे ज़्यादा शराब बेची गई.

(

volume_by_zip

.sort_values("volume_sold_liters", ascending=False)

.head(25)

.to_pandas()

.plot.bar(rot=80)

)

अनुमानित आउटपुट:

डेटा को साफ़ करना

कुछ पिन कोड के आखिर में .0 होता है. ऐसा हो सकता है कि डेटा कलेक्शन के दौरान, पिन कोड गलती से फ़्लोटिंग पॉइंट वैल्यू में बदल गए हों. पिन कोड को ठीक करने के लिए, रेगुलर एक्सप्रेशन का इस्तेमाल करें और विश्लेषण को दोहराएं.

df = (

bpd.read_gbq_table("bigquery-public-data.iowa_liquor_sales.sales")

.assign(

zip_code=lambda _: _["zip_code"].str.replace(".0", "")

)

)

volume_by_zip = df.groupby("zip_code").agg({"volume_sold_liters": "sum"})

(

volume_by_zip

.sort_values("volume_sold_liters", ascending=False)

.head(25)

.to_pandas()

.plot.bar(rot=80)

)

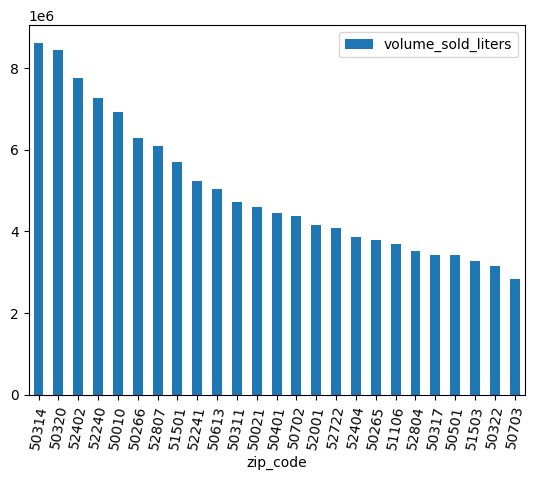

अनुमानित आउटपुट:

5. बिक्री में सहसंबंधों का पता लगाना

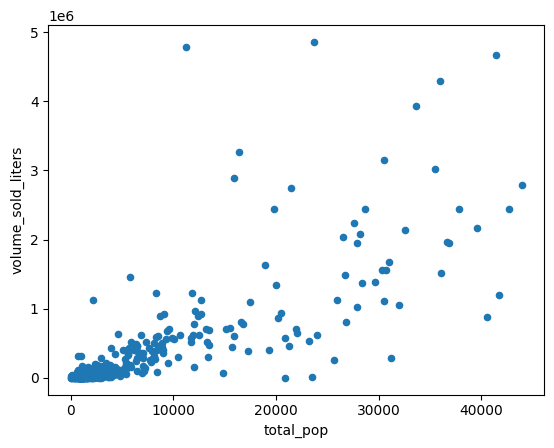

कुछ पिन कोड में, अन्य पिन कोड की तुलना में ज़्यादा बिक्री क्यों होती है? एक अनुमान यह है कि ऐसा जनसंख्या के अंतर की वजह से होता है. ज़्यादा आबादी वाले पिन कोड में शराब की बिक्री ज़्यादा होने की संभावना होती है.

जनसंख्या और शराब की बिक्री की मात्रा के बीच सहसंबंध का हिसाब लगाकर, इस हाइपोथेसिस की जांच करें.

अन्य डेटासेट के साथ जोड़ना

इसे जनसंख्या के डेटासेट के साथ जोड़ें. जैसे, अमेरिकी जनगणना ब्यूरो का अमेरिकन कम्यूनिटी सर्वे पिन कोड टैबुलेशन एरिया सर्वे.

census_acs = bpd.read_gbq_table("bigquery-public-data.census_bureau_acs.zcta_2020_5yr")

अमेरिकन कम्यूनिटी सर्वे, राज्यों की पहचान GEOID के हिसाब से करता है. पिन कोड टैबुलेशन एरिया के मामले में, GEOID, पिन कोड के बराबर होता है.

volume_by_pop = volume_by_zip.join(

census_acs.set_index("geo_id")

)

बेची गई शराब की मात्रा की तुलना, पिन कोड के हिसाब से जनसंख्या से करने के लिए स्कैटर प्लॉट बनाएं.

(

volume_by_pop[["volume_sold_liters", "total_pop"]]

.to_pandas()

.plot.scatter(x="total_pop", y="volume_sold_liters")

)

अनुमानित आउटपुट:

सहसंबंधों की गणना करना

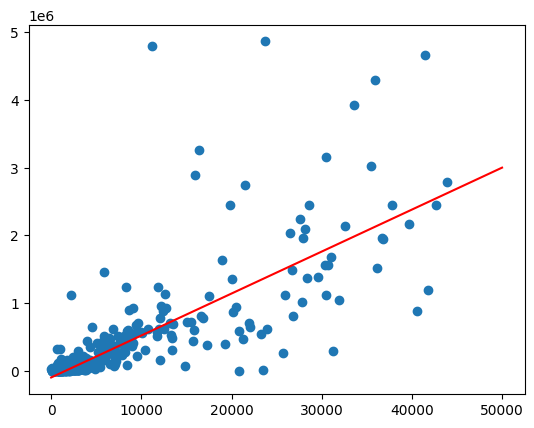

रुझान लगभग लीनियर दिखता है. इस पर लीनियर रिग्रेशन मॉडल लागू करें, ताकि यह पता चल सके कि जनसंख्या से शराब की बिक्री का कितना सटीक अनुमान लगाया जा सकता है.

from bigframes.ml.linear_model import LinearRegression

feature_columns = volume_by_pop[["total_pop"]]

label_columns = volume_by_pop[["volume_sold_liters"]]

# Create the linear model

model = LinearRegression()

model.fit(feature_columns, label_columns)

score का इस्तेमाल करके, यह देखें कि जूते कितने फ़िट हैं.

model.score(feature_columns, label_columns).to_pandas()

आउटपुट का उदाहरण:

mean_absolute_error mean_squared_error mean_squared_log_error median_absolute_error r2_score explained_variance

0 245065.664095 224398167097.364288 5.595021 178196.31289 0.380096 0.380096

जनसंख्या की वैल्यू की रेंज पर predict फ़ंक्शन को कॉल करके, सबसे सही लाइन बनाएं.

import matplotlib.pyplot as pyplot

import numpy as np

import pandas as pd

line = pd.Series(np.arange(0, 50_000), name="total_pop")

predictions = model.predict(line).to_pandas()

zips = volume_by_pop[["volume_sold_liters", "total_pop"]].to_pandas()

pyplot.scatter(zips["total_pop"], zips["volume_sold_liters"])

pyplot.plot(

line,

predictions.sort_values("total_pop")["predicted_volume_sold_liters"],

marker=None,

color="red",

)

अनुमानित आउटपुट:

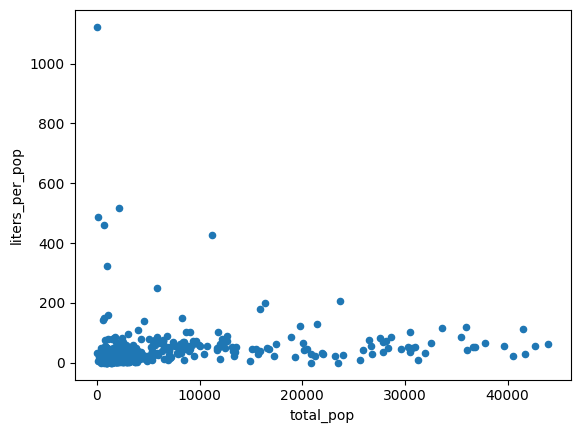

विषम विचरण की समस्या को हल करना

पिछले चार्ट में मौजूद डेटा, हेट्रोस्केडैस्टिक दिखता है. पूरी संख्या के हिसाब से, सबसे सही फ़िट लाइन के आस-पास का अंतर बढ़ता है.

ऐसा हो सकता है कि हर व्यक्ति के हिसाब से, अल्कोहल की खरीदारी की मात्रा में कोई खास बदलाव न हुआ हो.

volume_per_pop = (

volume_by_pop[volume_by_pop['total_pop'] > 0]

.assign(liters_per_pop=lambda df: df["volume_sold_liters"] / df["total_pop"])

)

(

volume_per_pop[["liters_per_pop", "total_pop"]]

.to_pandas()

.plot.scatter(x="total_pop", y="liters_per_pop")

)

अनुमानित आउटपुट:

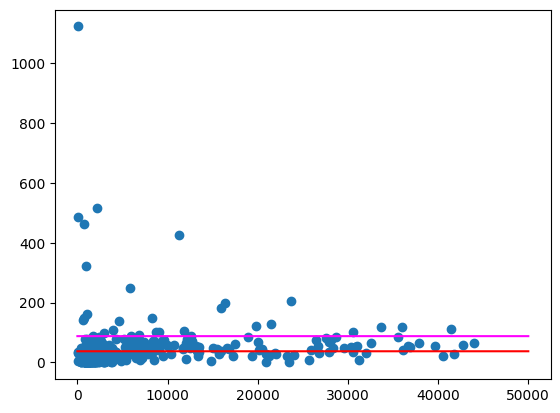

दो अलग-अलग तरीकों से, खरीदे गए ऐल्कॉहल की औसत मात्रा का हिसाब लगाएं:

- आयोवा में, हर व्यक्ति ने औसतन कितने रुपये की शराब खरीदी?

- हर व्यक्ति ने सभी ज़िप कोड में औसतन कितने रुपये की शराब खरीदी.

(1) में, यह दिखाया गया है कि पूरे राज्य में कितनी शराब खरीदी गई. (2) में, औसत पिन कोड दिखता है. यह ज़रूरी नहीं है कि यह (1) के बराबर हो, क्योंकि अलग-अलग पिन कोड में रहने वाले लोगों की संख्या अलग-अलग होती है.

df = (

bpd.read_gbq_table("bigquery-public-data.iowa_liquor_sales.sales")

.assign(

zip_code=lambda _: _["zip_code"].str.replace(".0", "")

)

)

census_state = bpd.read_gbq(

"bigquery-public-data.census_bureau_acs.state_2020_5yr",

index_col="geo_id",

)

volume_per_pop_statewide = (

df['volume_sold_liters'].sum()

/ census_state["total_pop"].loc['19']

)

volume_per_pop_statewide

अनुमानित आउटपुट: 87.997

average_per_zip = volume_per_pop["liters_per_pop"].mean()

average_per_zip

अनुमानित आउटपुट: 67.139

ऊपर दिए गए उदाहरण की तरह ही, इन औसत को प्लॉट करें.

import numpy as np

import pandas as pd

from matplotlib import pyplot

line = pd.Series(np.arange(0, 50_000), name="total_pop")

zips = volume_per_pop[["liters_per_pop", "total_pop"]].to_pandas()

pyplot.scatter(zips["total_pop"], zips["liters_per_pop"])

pyplot.plot(line, np.full(line.shape, volume_per_pop_statewide), marker=None, color="magenta")

pyplot.plot(line, np.full(line.shape, average_per_zip), marker=None, color="red")

अनुमानित आउटपुट:

अब भी कुछ पिन कोड ऐसे हैं जो काफ़ी बड़े आउटलायर हैं. खास तौर पर, कम आबादी वाले इलाकों में. इसकी वजह का पता लगाने के लिए, आपको कुछ काम करना होगा. उदाहरण के लिए, ऐसा हो सकता है कि कुछ पिन कोड में जनसंख्या कम हो, लेकिन खपत ज़्यादा हो. इसकी वजह यह हो सकती है कि उस इलाके में शराब की दुकान सिर्फ़ एक हो. अगर ऐसा है, तो आस-पास के ज़िप कोड की जनसंख्या के आधार पर गणना करने से, इन आउटलायर को भी शामिल किया जा सकता है.

6. बेची गई शराब के टाइप की तुलना करना

भौगोलिक डेटा के अलावा, आयोवा में शराब की खुदरा बिक्री के डेटाबेस में बेचे गए आइटम के बारे में भी पूरी जानकारी होती है. इनका विश्लेषण करके, हम अलग-अलग इलाकों में लोगों की पसंद के बारे में जान सकते हैं.

श्रेणियों के बारे में और जानें

डेटाबेस में आइटम को कैटगरी के हिसाब से रखा जाता है. कितनी कैटगरी हैं?

import bigframes.pandas as bpd

bpd.options.bigquery.ordering_mode = "partial"

bpd.options.display.repr_mode = "deferred"

df = bpd.read_gbq_table("bigquery-public-data.iowa_liquor_sales.sales")

df.category_name.nunique()

अनुमानित आउटपुट: 103

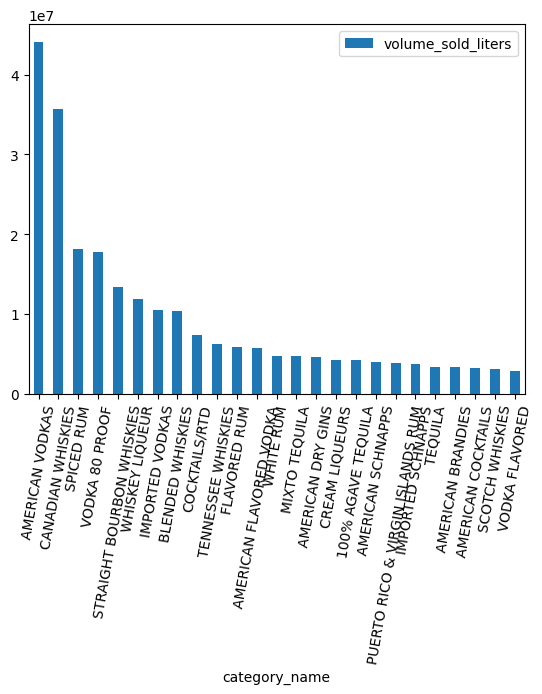

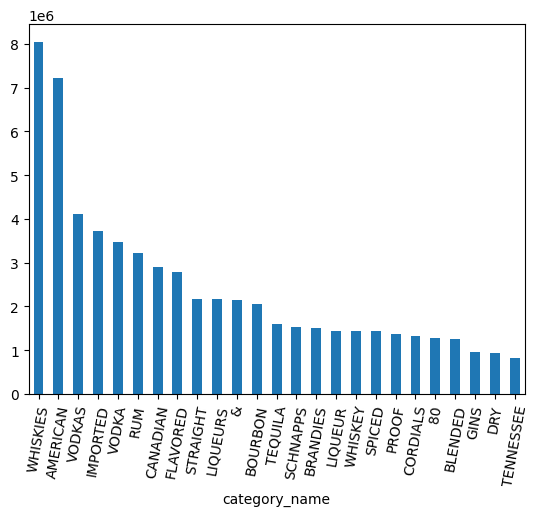

वॉल्यूम के हिसाब से सबसे लोकप्रिय कैटगरी कौनसी हैं?

counts = (

df.groupby("category_name")

.agg({"volume_sold_liters": "sum"})

.sort_values(["volume_sold_liters"], ascending=False)

.to_pandas()

)

counts.head(25).plot.bar(rot=80)

ARRAY डेटा टाइप का इस्तेमाल करना

व्हिस्की, रम, वोडका वगैरह की कई कैटगरी होती हैं. मुझे इन सभी को एक साथ ग्रुप करना है.

सबसे पहले, Series.str.split() तरीके का इस्तेमाल करके, कैटगरी के नामों को अलग-अलग शब्दों में बांटें. explode() तरीके का इस्तेमाल करके, इस ऐरे को अननेस्ट करें.

category_parts = df.category_name.str.split(" ").explode()

counts = (

category_parts

.groupby(category_parts)

.size()

.sort_values(ascending=False)

.to_pandas()

)

counts.head(25).plot.bar(rot=80)

category_parts.nunique()

अनुमानित आउटपुट: 113

ऊपर दिए गए चार्ट में, VODKA और VODKAS का डेटा अब भी अलग-अलग है. कैटेगरी को छोटे सेट में छोटा करने के लिए, ज़्यादा ग्रुपिंग की ज़रूरत होती है.

7. BigQuery DataFrames के साथ NLTK का इस्तेमाल करना

सिर्फ़ 100 कैटगरी होने पर, कुछ अनुमानित नियम लिखे जा सकते हैं. इसके अलावा, कैटगरी से लेकर शराब के ज़्यादा टाइप तक की मैपिंग को मैन्युअल तरीके से भी बनाया जा सकता है. इसके अलावा, Gemini जैसे लार्ज लैंग्वेज मॉडल का इस्तेमाल करके भी इस तरह की मैपिंग बनाई जा सकती है. Gemini के साथ BigQuery DataFrames का इस्तेमाल करने के लिए, BigQuery DataFrames का इस्तेमाल करके, बिना किसी स्ट्रक्चर वाले डेटा से अहम जानकारी पाना कोडलैब आज़माएं.

इसके बजाय, इस डेटा को प्रोसेस करने के लिए, नैचुरल लैंग्वेज प्रोसेसिंग के ज़्यादा पारंपरिक पैकेज, NLTK का इस्तेमाल करें. "स्टेमर" नाम की टेक्नोलॉजी, बहुवचन और एकवचन संज्ञाओं को एक ही वैल्यू में मर्ज कर सकती है. उदाहरण के लिए.

शब्दों को उनके मूल रूप में बदलने के लिए NLTK का इस्तेमाल करना

NLTK पैकेज, नैचुरल लैंग्वेज प्रोसेसिंग के ऐसे तरीके उपलब्ध कराता है जिन्हें Python से ऐक्सेस किया जा सकता है. इसे आज़माने के लिए, पैकेज इंस्टॉल करें.

%pip install nltk

इसके बाद, पैकेज इंपोर्ट करें. वर्शन की जांच करें. इसका इस्तेमाल ट्यूटोरियल में बाद में किया जाएगा.

import nltk

nltk.__version__

शब्दों को स्टैंडर्ड बनाने का एक तरीका, ताकि शब्द को "स्टेम" किया जा सके. इससे सभी प्रत्यय हट जाते हैं. जैसे, बहुवचन के लिए आखिर में "s" जोड़ा जाता है.

def stem(word: str) -> str:

# https://www.nltk.org/howto/stem.html

import nltk.stem.snowball

# Avoid failure if a NULL is passed in.

if not word:

return word

stemmer = nltk.stem.snowball.SnowballStemmer("english")

return stemmer.stem(word)

कुछ शब्दों के लिए इसे आज़माएं.

stem("WHISKEY")

अनुमानित आउटपुट: whiskey

stem("WHISKIES")

अनुमानित आउटपुट: whiski

माफ़ करें, इससे व्हिस्की को व्हिस्की के तौर पर मैप नहीं किया गया. स्टेमर्स, अनियमित बहुवचन के साथ ठीक से काम नहीं करते. लेमैटाइज़र का इस्तेमाल करके देखें. यह मूल शब्द की पहचान करने के लिए, ज़्यादा बेहतर तकनीकों का इस्तेमाल करता है. इसे "लेमा" कहा जाता है.

def lemmatize(word: str) -> str:

# https://stackoverflow.com/a/18400977/101923

# https://www.nltk.org/api/nltk.stem.wordnet.html#module-nltk.stem.wordnet

import nltk

import nltk.stem.wordnet

# Avoid failure if a NULL is passed in.

if not word:

return word

nltk.download('wordnet')

wnl = nltk.stem.wordnet.WordNetLemmatizer()

return wnl.lemmatize(word.lower())

कुछ शब्दों के लिए इसे आज़माएं.

lemmatize("WHISKIES")

अनुमानित आउटपुट: whisky

lemmatize("WHISKY")

अनुमानित आउटपुट: whisky

lemmatize("WHISKEY")

अनुमानित आउटपुट: whiskey

माफ़ करें, यह लेमेटाइज़र "whiskey" को "whiskies" के लेमा के तौर पर मैप नहीं करता है. यह शब्द, आयोवा में खुदरा शराब की बिक्री के डेटाबेस के लिए खास तौर पर अहम है. इसलिए, इसे डिक्शनरी का इस्तेमाल करके, मैन्युअल तरीके से अमेरिकन स्पेलिंग में मैप करें.

def lemmatize(word: str) -> str:

# https://stackoverflow.com/a/18400977/101923

# https://www.nltk.org/api/nltk.stem.wordnet.html#module-nltk.stem.wordnet

import nltk

import nltk.stem.wordnet

# Avoid failure if a NULL is passed in.

if not word:

return word

nltk.download('wordnet')

wnl = nltk.stem.wordnet.WordNetLemmatizer()

lemma = wnl.lemmatize(word.lower())

table = {

"whisky": "whiskey", # Use the American spelling.

}

return table.get(lemma, lemma)

कुछ शब्दों के लिए इसे आज़माएं.

lemmatize("WHISKIES")

अनुमानित आउटपुट: whiskey

lemmatize("WHISKEY")

अनुमानित आउटपुट: whiskey

बधाई हो! यह लेमेटाइज़र, कैटगरी को कम करने के लिए अच्छी तरह से काम करना चाहिए. BigQuery के साथ इसका इस्तेमाल करने के लिए, आपको इसे क्लाउड पर डिप्लॉय करना होगा.

फ़ंक्शन डिप्लॉय करने के लिए अपना प्रोजेक्ट सेट अप करना

इसे क्लाउड पर डिप्लॉय करने से पहले, आपको एक बार सेट अप करना होगा, ताकि BigQuery इस फ़ंक्शन को ऐक्सेस कर सके.

एक नई कोड सेल बनाएं और your-project-id की जगह, इस ट्यूटोरियल के लिए इस्तेमाल किया जा रहा Google Cloud प्रोजेक्ट आईडी डालें.

project_id = "your-project-id"

बिना किसी अनुमति के एक सेवा खाता बनाएं, क्योंकि इस फ़ंक्शन को किसी भी क्लाउड संसाधन का ऐक्सेस नहीं चाहिए.

from google.cloud import iam_admin_v1

from google.cloud.iam_admin_v1 import types

iam_admin_client = iam_admin_v1.IAMClient()

request = types.CreateServiceAccountRequest()

account_id = "bigframes-no-permissions"

request.account_id = account_id

request.name = f"projects/{project_id}"

display_name = "bigframes remote function (no permissions)"

service_account = types.ServiceAccount()

service_account.display_name = display_name

request.service_account = service_account

account = iam_admin_client.create_service_account(request=request)

print(account.email)

अनुमानित आउटपुट: bigframes-no-permissions@your-project-id.iam.gserviceaccount.com

फ़ंक्शन को सेव करने के लिए, एक BigQuery डेटासेट बनाएं.

from google.cloud import bigquery

bqclient = bigquery.Client(project=project_id)

dataset = bigquery.Dataset(f"{project_id}.functions")

bqclient.create_dataset(dataset, exists_ok=True)

रिमोट फ़ंक्शन डिप्लॉय करना

अगर Cloud Functions API पहले से चालू नहीं है, तो उसे चालू करें.

!gcloud services enable cloudfunctions.googleapis.com

अब, अपने फ़ंक्शन को उस डेटासेट में डिप्लॉय करें जिसे आपने अभी बनाया है. पिछले चरणों में बनाए गए फ़ंक्शन में @bpd.remote_function डेकोरेटर जोड़ें.

@bpd.remote_function(

dataset=f"{project_id}.functions",

name="lemmatize",

# TODO: Replace this with your version of nltk.

packages=["nltk==3.9.1"],

cloud_function_service_account=f"bigframes-no-permissions@{project_id}.iam.gserviceaccount.com",

cloud_function_ingress_settings="internal-only",

)

def lemmatize(word: str) -> str:

# https://stackoverflow.com/a/18400977/101923

# https://www.nltk.org/api/nltk.stem.wordnet.html#module-nltk.stem.wordnet

import nltk

import nltk.stem.wordnet

# Avoid failure if a NULL is passed in.

if not word:

return word

nltk.download('wordnet')

wnl = nltk.stem.wordnet.WordNetLemmatizer()

lemma = wnl.lemmatize(word.lower())

table = {

"whisky": "whiskey", # Use the American spelling.

}

return table.get(lemma, lemma)

इसे डिप्लॉय करने में करीब दो मिनट लगेंगे.

रिमोट फ़ंक्शन का इस्तेमाल करना

डप्लॉयमेंट पूरा होने के बाद, इस फ़ंक्शन को टेस्ट किया जा सकता है.

lemmatize = bpd.read_gbq_function(f"{project_id}.functions.lemmatize")

words = bpd.Series(["whiskies", "whisky", "whiskey", "vodkas", "vodka"])

words.apply(lemmatize).to_pandas()

अनुमानित आउटपुट:

0 whiskey

1 whiskey

2 whiskey

3 vodka

4 vodka

dtype: string

8. काउंटी के हिसाब से शराब पीने के डेटा की तुलना करना

lemmatize फ़ंक्शन उपलब्ध होने के बाद, इसका इस्तेमाल करके कैटगरी मर्ज करें.

कैटगरी के बारे में सबसे अच्छी जानकारी देने वाला शब्द ढूंढना

सबसे पहले, डेटाबेस में मौजूद सभी कैटगरी का DataFrame बनाएं.

df = bpd.read_gbq_table("bigquery-public-data.iowa_liquor_sales.sales")

categories = (

df['category_name']

.groupby(df['category_name'])

.size()

.to_frame()

.rename(columns={"category_name": "total_orders"})

.reset_index(drop=False)

)

categories.to_pandas()

अनुमानित आउटपुट:

category_name total_orders

0 100 PROOF VODKA 99124

1 100% AGAVE TEQUILA 724374

2 AGED DARK RUM 59433

3 AMARETTO - IMPORTED 102

4 AMERICAN ALCOHOL 24351

... ... ...

98 WATERMELON SCHNAPPS 17844

99 WHISKEY LIQUEUR 1442732

100 WHITE CREME DE CACAO 7213

101 WHITE CREME DE MENTHE 2459

102 WHITE RUM 436553

103 rows × 2 columns

इसके बाद, कैटगरी में मौजूद सभी शब्दों का एक डेटाफ़्रेम बनाएं. इसमें कुछ फ़िलर शब्द शामिल न करें. जैसे, विराम चिह्न और "आइटम".

words = (

categories.assign(

words=categories['category_name']

.str.lower()

.str.split(" ")

)

.assign(num_words=lambda _: _['words'].str.len())

.explode("words")

.rename(columns={"words": "word"})

)

words = words[

# Remove punctuation and "item", unless it's the only word

(words['word'].str.isalnum() & ~(words['word'].str.startswith('item')))

| (words['num_words'] == 1)

]

words.to_pandas()

अनुमानित आउटपुट:

category_name total_orders word num_words

0 100 PROOF VODKA 99124 100 3

1 100 PROOF VODKA 99124 proof 3

2 100 PROOF VODKA 99124 vodka 3

... ... ... ... ...

252 WHITE RUM 436553 white 2

253 WHITE RUM 436553 rum 2

254 rows × 4 columns

ध्यान दें कि ग्रुप बनाने के बाद लेमटाइज़ेशन करने से, Cloud फ़ंक्शन पर लोड कम हो जाता है. डेटाबेस में मौजूद लाखों पंक्तियों में से हर एक पर लेमैटाइज़ फ़ंक्शन लागू किया जा सकता है. हालांकि, ग्रुप करने के बाद इसे लागू करने पर कम खर्च आएगा. साथ ही, इसके लिए कोटे में बढ़ोतरी की ज़रूरत पड़ सकती है.

lemmas = words.assign(lemma=lambda _: _["word"].apply(lemmatize))

lemmas.to_pandas()

अनुमानित आउटपुट:

category_name total_orders word num_words lemma

0 100 PROOF VODKA 99124 100 3 100

1 100 PROOF VODKA 99124 proof 3 proof

2 100 PROOF VODKA 99124 vodka 3 vodka

... ... ... ... ... ...

252 WHITE RUM 436553 white 2 white

253 WHITE RUM 436553 rum 2 rum

254 rows × 5 columns

शब्दों को लेमैटाइज़ करने के बाद, आपको वह लेमा चुनना होगा जो कैटगरी के बारे में सबसे अच्छी जानकारी देता हो. इन कैटगरी में फ़ंक्शन वर्ड ज़्यादा नहीं हैं.इसलिए, इस अनुमान का इस्तेमाल करें कि अगर कोई शब्द कई अन्य कैटगरी में दिखता है, तो वह जवाब में शामिल करने के लिए बेहतर शब्द हो सकता है. जैसे, व्हिस्की.

lemma_counts = (

lemmas

.groupby("lemma", as_index=False)

.agg({"total_orders": "sum"})

.rename(columns={"total_orders": "total_orders_with_lemma"})

)

categories_with_lemma_counts = lemmas.merge(lemma_counts, on="lemma")

max_lemma_count = (

categories_with_lemma_counts

.groupby("category_name", as_index=False)

.agg({"total_orders_with_lemma": "max"})

.rename(columns={"total_orders_with_lemma": "max_lemma_count"})

)

categories_with_max = categories_with_lemma_counts.merge(

max_lemma_count,

on="category_name"

)

categories_mapping = categories_with_max[

categories_with_max['total_orders_with_lemma'] == categories_with_max['max_lemma_count']

].groupby("category_name", as_index=False).max()

categories_mapping.to_pandas()

अनुमानित आउटपुट:

category_name total_orders word num_words lemma total_orders_with_lemma max_lemma_count

0 100 PROOF VODKA 99124 vodka 3 vodka 7575769 7575769

1 100% AGAVE TEQUILA 724374 tequila 3 tequila 1601092 1601092

2 AGED DARK RUM 59433 rum 3 rum 3226633 3226633

... ... ... ... ... ... ... ...

100 WHITE CREME DE CACAO 7213 white 4 white 446225 446225

101 WHITE CREME DE MENTHE 2459 white 4 white 446225 446225

102 WHITE RUM 436553 rum 2 rum 3226633 3226633

103 rows × 7 columns

अब हर कैटगरी के लिए एक लेमा मौजूद है. इसे ओरिजनल डेटाफ़्रेम में मर्ज करें.

df_with_lemma = df.merge(

categories_mapping,

on="category_name",

how="left"

)

df_with_lemma[df_with_lemma['category_name'].notnull()].peek()

अनुमानित आउटपुट:

invoice_and_item_number ... lemma total_orders_with_lemma max_lemma_count

0 S30989000030 ... vodka 7575769 7575769

1 S30538800106 ... vodka 7575769 7575769

2 S30601200013 ... vodka 7575769 7575769

3 S30527200047 ... vodka 7575769 7575769

4 S30833600058 ... vodka 7575769 7575769

5 rows × 30 columns

काउंटी की तुलना करना

हर काउंटी में हुई बिक्री की तुलना करके देखें कि उनमें क्या अंतर है.

county_lemma = (

df_with_lemma

.groupby(["county", "lemma"])

.agg({"volume_sold_liters": "sum"})

# Cast to an integer for more deterministic equality comparisons.

.assign(volume_sold_int64=lambda _: _['volume_sold_liters'].astype("Int64"))

)

हर काउंटी में सबसे ज़्यादा बिकने वाला प्रॉडक्ट (लेमा) ढूंढें.

county_max = (

county_lemma

.reset_index(drop=False)

.groupby("county")

.agg({"volume_sold_int64": "max"})

)

county_max_lemma = county_lemma[

county_lemma["volume_sold_int64"] == county_max["volume_sold_int64"]

]

county_max_lemma.to_pandas()

अनुमानित आउटपुट:

volume_sold_liters volume_sold_int64

county lemma

SCOTT vodka 6044393.1 6044393

APPANOOSE whiskey 292490.44 292490

HAMILTON whiskey 329118.92 329118

... ... ... ...

WORTH whiskey 100542.85 100542

MITCHELL vodka 158791.94 158791

RINGGOLD whiskey 65107.8 65107

101 rows × 2 columns

ये काउंटी एक-दूसरे से कितनी अलग हैं?

county_max_lemma.groupby("lemma").size().to_pandas()

अनुमानित आउटपुट:

lemma

american 1

liqueur 1

vodka 15

whiskey 83

dtype: Int64

ज़्यादातर देशों में, व्हिस्की सबसे ज़्यादा बिकने वाला प्रॉडक्ट है. वहीं, वोडका 15 देशों में सबसे ज़्यादा बिकने वाला प्रॉडक्ट है. इसकी तुलना, राज्य में सबसे ज़्यादा लोकप्रिय शराब की किस्मों से करें.

total_liters = (

df_with_lemma

.groupby("lemma")

.agg({"volume_sold_liters": "sum"})

.sort_values("volume_sold_liters", ascending=False)

)

total_liters.to_pandas()

अनुमानित आउटपुट:

volume_sold_liters

lemma

vodka 85356422.950001

whiskey 85112339.980001

rum 33891011.72

american 19994259.64

imported 14985636.61

tequila 12357782.37

cocktails/rtd 7406769.87

...

विस्की और वोडका की बिक्री लगभग बराबर है. हालांकि, पूरे राज्य में वोडका की बिक्री, विस्की की बिक्री से थोड़ी ज़्यादा है.

अनुपातों की तुलना करना

हर काउंटी में बिक्री की क्या खास बात है? यह काउंटी, राज्य के बाकी हिस्सों से कैसे अलग है?

कोहेन के एच मेज़र का इस्तेमाल करके पता लगाएं कि शराब की बिक्री की मात्रा, राज्य भर में हुई बिक्री की मात्रा के अनुपात के हिसाब से सबसे ज़्यादा किस इलाके में अलग है.

import numpy as np

total_proportions = total_liters / total_liters.sum()

total_phi = 2 * np.arcsin(np.sqrt(total_proportions))

county_liters = df_with_lemma.groupby(["county", "lemma"]).agg({"volume_sold_liters": "sum"})

county_totals = df_with_lemma.groupby(["county"]).agg({"volume_sold_liters": "sum"})

county_proportions = county_liters / county_totals

county_phi = 2 * np.arcsin(np.sqrt(county_proportions))

cohens_h = (

(county_phi - total_phi)

.rename(columns={"volume_sold_liters": "cohens_h"})

.assign(cohens_h_int=lambda _: (_['cohens_h'] * 1_000_000).astype("Int64"))

)

अब जब हर लेम्मा के लिए कोहेन का एच मेज़र कर लिया गया है, तो हर काउंटी में राज्यव्यापी अनुपात से सबसे बड़ा अंतर ढूंढें.

# Note: one might want to use the absolute value here if interested in counties

# that drink _less_ of a particular liquor than expected.

largest_per_county = cohens_h.groupby("county").agg({"cohens_h_int": "max"})

counties = cohens_h[cohens_h['cohens_h_int'] == largest_per_county["cohens_h_int"]]

counties.sort_values('cohens_h', ascending=False).to_pandas()

अनुमानित आउटपुट:

cohens_h cohens_h_int

county lemma

EL PASO liqueur 1.289667 1289667

ADAMS whiskey 0.373591 373590

IDA whiskey 0.306481 306481

OSCEOLA whiskey 0.295524 295523

PALO ALTO whiskey 0.293697 293696

... ... ... ...

MUSCATINE rum 0.053757 53757

MARION rum 0.053427 53427

MITCHELL vodka 0.048212 48212

WEBSTER rum 0.044896 44895

CERRO GORDO cocktails/rtd 0.027496 27495

100 rows × 2 columns

कोहेन का h वैल्यू जितनी ज़्यादा होगी, इस बात की संभावना उतनी ही ज़्यादा होगी कि राज्य के औसत की तुलना में, उस तरह की शराब की खपत में आंकड़ों के हिसाब से अहम अंतर है. पॉज़िटिव वैल्यू कम होने पर, खपत में राज्य के औसत से अलग अंतर होता है. हालांकि, यह अंतर अनियमितता की वजह से हो सकता है.

एक और बात: ऐसा लगता है कि एल पासो काउंटी, आयोवा की काउंटी नहीं है. इससे पता चलता है कि इन नतीजों पर पूरी तरह से भरोसा करने से पहले, डेटा को साफ़ करने की ज़रूरत है.

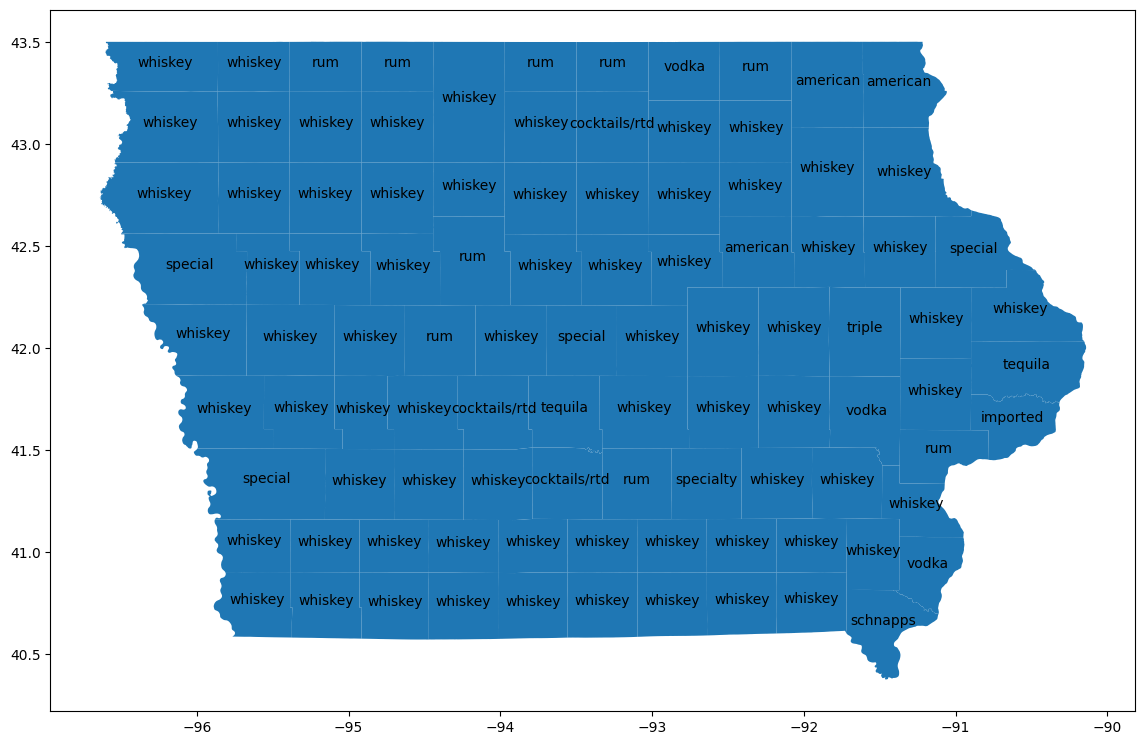

काउंटी को विज़ुअलाइज़ करना

हर काउंटी के लिए भौगोलिक क्षेत्र की जानकारी पाने के लिए, bigquery-public-data.geo_us_boundaries.counties टेबल के साथ जुड़ें. अमेरिका के सभी राज्यों में काउंटी के नाम अलग-अलग नहीं होते. इसलिए, सिर्फ़ आयोवा की काउंटी को शामिल करने के लिए फ़िल्टर करें. आयोवा का FIPS कोड ‘19' है.

counties_geo = (

bpd.read_gbq("bigquery-public-data.geo_us_boundaries.counties")

.assign(county=lambda _: _['county_name'].str.upper())

)

counties_plus = (

counties

.reset_index(drop=False)

.merge(counties_geo[counties_geo['state_fips_code'] == '19'], on="county", how="left")

.dropna(subset=["county_geom"])

.to_pandas()

)

counties_plus

अनुमानित आउटपुट:

county lemma cohens_h cohens_h_int geo_id state_fips_code ...

0 ALLAMAKEE american 0.087931 87930 19005 19 ...

1 BLACK HAWK american 0.106256 106256 19013 19 ...

2 WINNESHIEK american 0.093101 93101 19191 19 ...

... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ...

96 CLINTON tequila 0.075708 75707 19045 19 ...

97 POLK tequila 0.087438 87438 19153 19 ...

98 LEE schnapps 0.064663 64663 19111 19 ...

99 rows × 23 columns

इन अंतरों को मैप पर विज़ुअलाइज़ करने के लिए, GeoPandas का इस्तेमाल करें.

import geopandas

counties_plus = geopandas.GeoDataFrame(counties_plus, geometry="county_geom")

# https://stackoverflow.com/a/42214156/101923

ax = counties_plus.plot(figsize=(14, 14))

counties_plus.apply(

lambda row: ax.annotate(

text=row['lemma'],

xy=row['county_geom'].centroid.coords[0],

ha='center'

),

axis=1,

)

9. व्यवस्थित करें

अगर आपने इस ट्यूटोरियल के लिए नया Google Cloud प्रोजेक्ट बनाया है, तो बनाए गए टेबल या अन्य संसाधनों के लिए अतिरिक्त शुल्क से बचने के लिए, उसे मिटाएं.

इसके अलावा, इस ट्यूटोरियल के लिए बनाए गए Cloud Functions, सेवा खातों, और डेटासेट को मिटाएं.

10. बधाई हो!

आपने BigQuery DataFrames का इस्तेमाल करके, स्ट्रक्चर्ड डेटा को साफ़ किया है और उसका विश्लेषण किया है. इस दौरान, आपने Google Cloud के सार्वजनिक डेटासेट, BigQuery Studio में Python नोटबुक, BigQuery ML, BigQuery रिमोट फ़ंक्शन, और BigQuery DataFrames की सुविधाओं के बारे में जाना. बहुत बढ़िया!

अगले चरण

- अमेरिका के नामों के डेटाबेस जैसे अन्य डेटा पर भी यह तरीका लागू करें.

- अपनी नोटबुक में Python कोड जनरेट करने की कोशिश करें. BigQuery Studio में Python notebook, Colab Enterprise की मदद से काम करते हैं. अहम जानकारी: मुझे टेस्ट डेटा जनरेट करने के लिए मदद मांगने की सुविधा काफ़ी मददगार लगी.

- GitHub पर, BigQuery DataFrames के लिए सैंपल नोटबुक देखें.

- BigQuery Studio में नोटबुक चलाने के लिए शेड्यूल बनाएं.

- BigQuery के साथ तीसरे पक्ष के Python पैकेज इंटिग्रेट करने के लिए, BigQuery DataFrames के साथ रिमोट फ़ंक्शन डिप्लॉय करें.