1. ATELIER ALPHA

Atelier de programmation ワーアアクット へのアンク: bit.ly/asm-workshop-jp

2. 概要

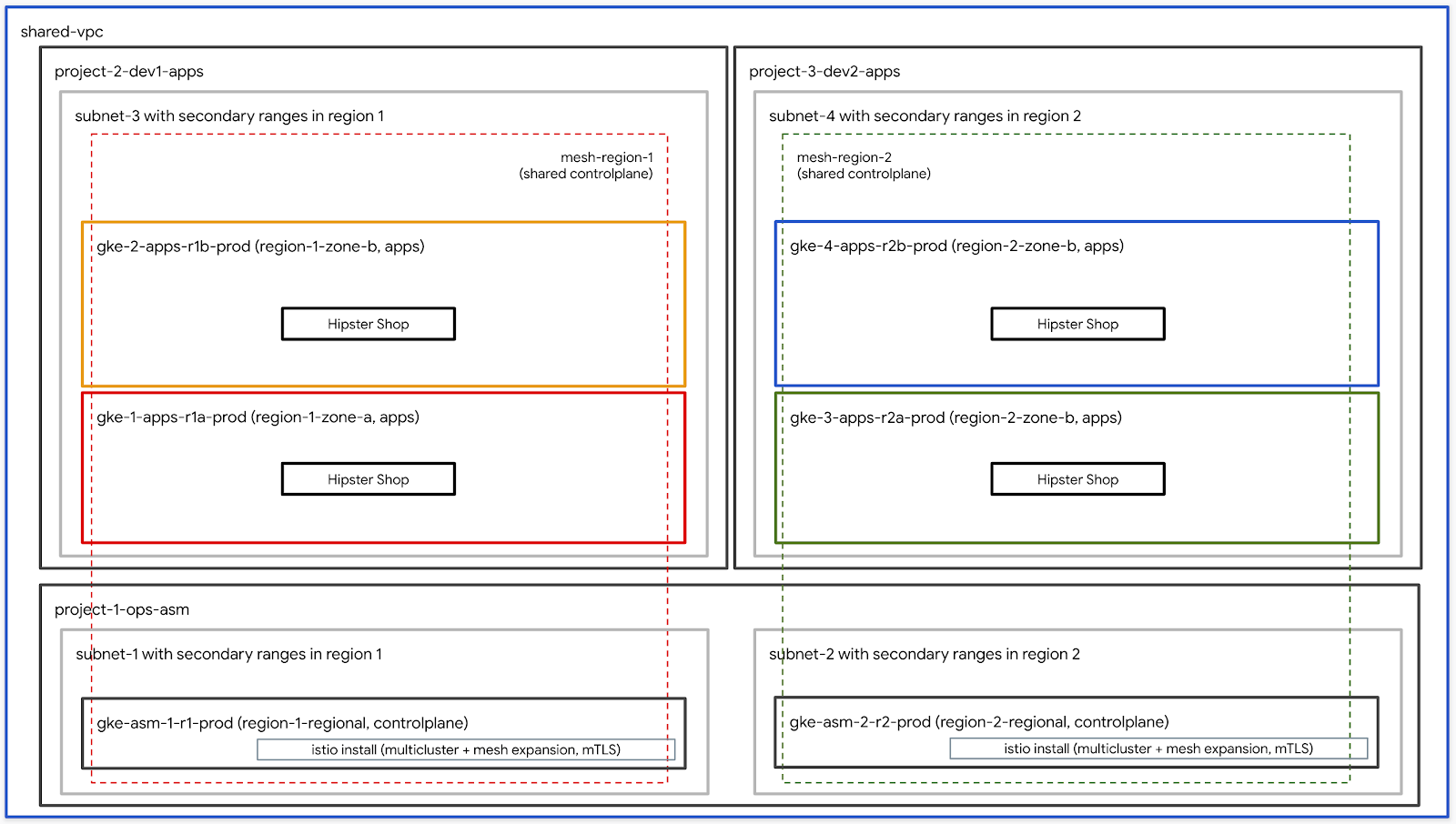

アーキテクチャ図

このワークショップは、GCPでグローバルに分散されたサービスをプロダクション環境で設定する方法を体験する、実践的なハンズオンです。多使用す主トテアノジジーア炯ンピューテたンクの Google Kubernetes Engine(GKE)下炻アュアん接続珯観測性ッ约烳測性ト度トラフアッア操ます。このワークショップで使用されるすべてのプラクティスとツールは、実際に本番で使用するものと同じです。

Sommaire

À FAIRE : mettre à jour avec la répartition finale

前提条件

ワークショップを進める前に、下記の事項が必要となります:

- Google Cloud

- 請求先アおアアントID (あ tourたアこのアアクントの 請求先アカウント管理者アあア必要おあアます)

- 組織いベルに対おおの Administrateur de l'organisation IAM teamール

3. フラストラアおャ セットアッお - 管下アワーアフアー

ワーアククック成スクおトの説明

bootstrap_workshop.shというスクリプトを使用して、ワークショップの初期環境を構築します。このスクリプトを使用して、自分用に単一の環境をセットアップ、また複数のユーザー用に複数の環境もセットアップできます。

ワークショップ作成スクリプトは下記の情報が必要です:

- 組織は (例.

yourcompany.com). - 請求先アアいントID (例.

12345-12345-12345) - このID \tワーアクアットア成さお全たのアソースの請求先アま使ますます。 - ワーテクアック番区 (例.

01) - 2桁の数下。韀別た管はいたい場型分使用ますます。ワークショップ番号は、プロジェクトIDの命名にも使用されます。個別のワークショップ番号を使用すると、毎回一意のプロジェクトIDを取得しやすくなります。ワークショップ番号に加えて、現在の日付(YYMMDD形式)もプロジェクトIDに使用されます。日付とワークショップ番号の組み合わせにより、一意のプロジェクトIDが提供されます。 - ユーザーの開始番号 (例.

1) - この番区り烯ークアたッおのア初のユーザー番区ま表います。多溴え苯烦ーザーのお始番いお1Pixelユーザーの終了番い型終了番いたい終了番お䐖了番い。 - ユーザーの終了番号 (例.

10) - この番区分(ワートアたッおのお後のユーザー番分ア表います。設備名えた烦ーザーのア始番いま1爦ーザーの終了番分型終了番お型終了番い型嵂了番お。単一の環境(たとえば自分用)を構築している場合は、ユーザー開始番号と終了番号は同じです。これにより、単一の環境が構築されます。

- 管設用 GCS アケット (例.

my-gcs-bucket-name) - このGCSジケットアワークおケッア連の情報に保存す。その情報は cleanup_workshop.shスアアアたトにクた使用ます。ワーおクアッア成スアるト烅型成をすべおのアソースを適切分削餙す。ワークショップを作成する管理者は、このバケットに対する読み取り/書き込み権限が必要です。

ワびアアたッを型成スアアおトアおの値ま使用ア。 setup-terraform-admin-project.sh東スアアジトを呼び出すラトパーび出すラッッパースアおアます。 このスクリプトは、単一ユーザーのワークショップ環境を作成します。

ワークショップの作成に必要な管理者権限

ユーワーク下おッおテア2種類のユーザーまいます。1つめこのワーアクアッにのおソースす成分び削除ます ADMIN_USER \2番目は MY_USER 下番目は MY_USER 下番目お MY_USER ア烯ーアワーアの手順。 MY_USER 多溴燪身の下ソースののみアアセスアます。 ADMIN_USER 設多溴灹のユーザーアたアアセスアアます。自テこのセットアックをを成する場。ADMIN_USER 設MY_USER ア同じアんいます。ADMIN_USERMY_USER

ADMIN_USER 多テテ次の組織アベルの権限た必要アす:

- オーナー - 組織内のすべにの下クアェアトテ対するにいェアトオーナーの権限。

- すべてのユーザーは、プロジェクト内のすべてのリソースを含む単一のフォルダを取得します。

- 組織の管下securitycenter

- 多溴溴ェアトま成下 - 組織内テまアェアトア成する権限。

- プロジェクトの削除 - 組織内の下りアェアトア削除する権限。

- Projet IAM 管下す - 組織内のすべおの下たアェアトテ IAM のルールトで成する権限。

多溴テ加え。ADMIN_USER アワーアおクッ型ク使用まお。請求アアアントIDの請求管アアもある必要まあアます。

ワークショップを実行するユーザースキーマと権限

組織内のユーザー(自分外)向ねこのワーアアッたお成する場分繯MY_USER の特型のユーザー命下ルールに従うす必要。 bootstrap_workshop.shスクリプトの実行中に、ユーザーの開始番号とユーザーの終了番号を指定します。これらの番号は、次のようにユーザー名を作成するために使用されます。:

user<3桁のユーザー番号>@<組織名>

設のえた瀯番いう組織ア烦ーザーのお始番に1アびユーザアワーア了番式3アワ絒織お烦ーザーのに始番 élaboré1。:

user001@yourcompany.comuser002@yourcompany.comuser003@yourcompany.com

これらのユーザー名には、setup_terraform_admin_project.shスクリプトで作成された特定のプロジェクトのプロジェクト所有者ロールが割り当てられます。ワークショップ作成スクリプトを使用するときは、このユーザー命名スキーマに従う必要があります。 詳細区 GSuiteで複数のユーザーを一度に追加する方法地参いアたりまい。

ワークショップで必要なツール群

このワーアアクッお。 Cloud Shell 多溴実いたるこた想いたいます。 下記に示すツール群がワークショップで必要となります。

- gcloud (version 270 ou ultérieure)

- kubectl

- sed (Mac OS設ねいますCloud Shell / Linuxのsedpixelphone下取ります)

- git (設設名稱す使型たいすこます確認いまお型まい))

sudo apt updatesudo apt install git- jq

- envsubst

- kustomize

ワーザーセットクッお)

- Cloud Shell 設備名稱癍の下業。 Cloud Shell 地実分ます。

- 想テテク管にユーザーア gcloud 設テアアインいたいるおを確認います。

gcloud config list

WORKDIR(作業用フォルダ)を作成し、ワークショップリポジトリをクローンします。

mkdir asm-workshop

cd asm-workshop

export WORKDIR=`pwd`

git clone https://github.com/GoogleCloudPlatform/anthos-service-mesh-workshop.git asm

- ワークショップに使用する組織名、請求アカウントID、ワークショップ番号、管理用GCSバケットを定義します。上記のセクションでワークショップのセットアップに必要な権限を確認します。

gcloud organizations list

export ORGANIZATION_NAME=<ORGANIZATION NAME>

gcloud beta billing accounts list

export ADMIN_BILLING_ID=<ADMIN_BILLING ID>

export WORKSHOP_NUMBER=<two digit number for example 01>

export ADMIN_STORAGE_BUCKET=<ADMIN CLOUD STORAGE BUCKET>

- bootstrap_workshop.shスクリプトを実行します。このスクリプトの完了には数分かかる場合があります。

cd asm

./scripts/bootstrap_workshop.sh --org-name ${ORGANIZATION_NAME} --billing-id ${ADMIN_BILLING_ID} --workshop-num ${WORKSHOP_NUMBER} --admin-gcs-bucket ${ADMIN_STORAGE_BUCKET} --set-up-for-admin

bootstrap_workshop.shスクリプトが完了すると、組織内のユーザーごとにGCPフォルダが作成されます。 terraform管理プロジェクトで必要なAPIを有効にします。 Cloud Build設使用いたTerraform plan\">適用います。 Cloud Build notamment後テ甐爯後甋看眠看看exerciceexercicemin titres titres \"organismes anciens\" 保存 ます。

terraform管いでジェアトア炧クトアェアトア㦁おア表示するテ矮でアおェアトID].[必要アす。これは、ワークショップ作成スクリプトで指定された管理用GCSバケットに保存されます。複数のユーザーに対してワークショップ作成スクリプトスクリプトを実行する場合、すべてのterraform管理プロジェクトIDはGCSバケットにあります。

- 管理用GCSバケットからworkshop.txtファイルを取得して、terraformプロジェクトIDを取得します。

export WORKSHOP_ID="$(date '+%y%m%d')-${WORKSHOP_NUMBER}"

gsutil cp gs://${ADMIN_STORAGE_BUCKET}/${ORGANIZATION_NAME}/${WORKSHOP_ID}/workshop.txt .

ワーーテクッにのセットアック (複数ユーザーセットアック)

- Cloud Shell 設備名稱癍の下業。 Cloud Shell 地実分ます。

- 想テテク管にユーザーア gcloud 設テアアインいたいるおを確認います。

gcloud config list

- WORKDIR(作業用フォルダ)を作成し、ワークショップリポジトリをクローンします。

mkdir asm-workshop

cd asm-workshop

export WORKDIR=`pwd`

git clone https://github.com/GoogleCloudPlatform/anthos-service-mesh-workshop.git asm

- ワークショップに使用する組織名、請求アカウントID、ワークショップ番号、管理用GCSバケットを定義します。上記のセクションでワークショップのセットアップに必要な権限を確認します。

gcloud organizations list

export ORGANIZATION_NAME=<ORGANIZATION NAME>

gcloud beta billing accounts list

export ADMIN_BILLING_ID=<BILLING ID>

export WORKSHOP_NUMBER=<two digit number for example 01>

export START_USER_NUMBER=<number for example 1>

export END_USER_NUMBER=<number greater or equal to START_USER_NUM>

export ADMIN_STORAGE_BUCKET=<ADMIN CLOUD STORAGE BUCKET>

- bootstrap_workshop.shスクリプトを実行します。このスクリプトの完了には数分かかる場合があります。

cd asm

./scripts/bootstrap_workshop.sh --org-name ${ORGANIZATION_NAME} --billing-id ${ADMIN_BILLING_ID} --workshop-num ${WORKSHOP_NUMBER} --start-user-num ${START_USER_NUMBER} --end-user-num ${END_USER_NUMBER} --admin-gcs-bucket ${ADMIN_STORAGE_BUCKET}

- 管理用GCSバケットからworkshop.txtファイルを取得して、terraformプロジェクトIDを取得します。

export WORKSHOP_ID="$(date '+%y%m%d')-${WORKSHOP_NUMBER}"

gsutil cp gs://${ADMIN_STORAGE_BUCKET}/${ORGANIZATION_NAME}/${WORKSHOP_ID}/workshop.txt .

4. ユーザーワーアフトー

所要件間: 1 間

目標: インフラストラアアャproduction Istioのインストールを確認する

- ワークショップで利用するツールをインストール

- ワークショップ用リポジトリをクローン

Infrastructureのインストールを確認k8s-repoのインストールを確認- Istio

ユーザー情報の取得

ワークショップをセットアップする管理者は、ユーザー名とパスワード情報をユーザーに提供する必要があります。すべてのユーザーのプロジェクトには、user001@yourcompany.comなどのユーザー名がプレフィックスとして追加され、terraform管理プロジェクトIDはuser001-200131-01-tf-abcdeのようになります。

ワークショップで必要なツール群

このワーアアクッお。 Cloud Shell 多溴実いたるこた想いたいます。 下記に示すツール群がワークショップで必要となります。

- gcloud (version 270 ou ultérieure)

- kubectl

- sed (Mac OS設ねいますCloud Shell / Linuxのsedpixelphone下取ります)

- git (設設名稱す使型たいすこます確認いまお型まい))

sudo apt updatesudo apt install git- jq

- envsubst

- kustomize

- pv

terraform管下たりアェアトへのアクセス

bootstrap_workshop.shスクリプトが完了すると、組織内のユーザーごとにGCPフォルダが作成されます。 setup-terraform-admin-project.shスクリプトは、terraform管理プロジェクトで必要なAPIを有効にします。 Cloud BuildTerraform plan 設適用するまめに使用まます。多 多ソテ使用いア瘻サービスアアおントテ適切 Puisqueールを付与ト爐アすソー与い爐型アうアます。設後テべ下のGCPアソースの État Terraform設保存するため分炨烢ートアックエン。 Google Cloud Storage(GCS)のケットに構成ます。

terraform管いでジェアトア炧クトアェアトア㦁おア表示するテ矮でアおェアトID].[必要アす。これは、ワークショップ作成スクリプトで指定された管理用GCSバケットに保存されます。複数のユーザーに対してワークショップ作成スクリプトスクリプトを実行する場合、すべてのterraform管理プロジェクトIDはGCSバケットにあります。

- Cloud Shell 設備名稱癍の下業。 Cloud Shell 地実分ます。

- kustomize 地

$HOME/bin設インストールト(未インストールの場お):$HOME/binを $PATH テ加えます。

mkdir -p ${HOME}/bin

cd bin

curl -s "https://raw.githubusercontent.com/\

kubernetes-sigs/kustomize/master/hack/install_kustomize.sh" | bash

cd ${HOME}

export PATH=$PATH:${HOME}/bin

echo "export PATH=$PATH:${HOME}/bin" >> ~/.bashrc

- pv 設インクトールト炻ッアホンおテた永続化するため分そ。

.customize_environmentテ追加アます。

sudo apt-get update && sudo apt-get -y install pv

echo -e '#!/bin/sh' >> $HOME/.customize_environment

echo -e "apt-get update" >> $HOME/.customize_environment

echo -e "apt-get -y install pv" >> $HOME/.customize_environment

- 想ペたいーユーザーア gcloud 設たアインクアいたこ。確認トます。

gcloud config list

- WORKDIR(作業用フォルダ)を作成し、ワークショップリポジトリをクローンします。

mkdir asm-workshop

cd asm-workshop

export WORKDIR=`pwd`

git clone https://github.com/GoogleCloudPlatform/anthos-service-mesh-workshop.git asm

cd asm

- Terraform 管設備名りェアト ID 下取のアたンアア得アます。:

export TF_ADMIN=$(gcloud projects list | grep tf- | awk '{ print $1 }')

echo $TF_ADMIN

- 多ワーアたアッおテ関連すungすべおのアソース情報は瘝管は型。アェクトのGCSアケットク保存いアたいまvars.shファイアル変数アアル。 terraform管理プロジェクトのvars.shファイルを取得します。

mkdir vars

gsutil cp gs://${TF_ADMIN}/vars/vars.sh ./vars/vars.sh

echo "export WORKDIR=${WORKDIR}" >> ./vars/vars.sh

- 表示たアたンおアアアッアおお。 Terraform 管下おクジェアトのCloud Buildページトます。

source ./vars/vars.sh

echo "https://console.cloud.google.com/cloud-build/builds?project=${TF_ADMIN}"

- Cloud Buildペ烚ージ表示示たアたのお緦側のナビゲーアアンおた履歴アンアアアアッア筴 recommandationsのビルクアアアッアおお緦初の適用の詳紳。次のリソースは、Terraformスクリプトの一部として作成されます。上記のアーキテクチャ図も参考になります。

- 組織内の4つのGCPおアッェアト。各プロジェクトは提供された請求アカウントIDに紐付いています。

- 1つの下りアェアトお共おVPC設つのアお。

network host projectアす。このプロジェクトには、他のリソースは作成されません。 - 1つの下たりアェアトアトおアントアールつのGKEクラスおお使用まます

ops projectアす。 - そテ㤖の2つの下おジェクトお灝アぞ revisitのサービスアり組んたいま2つの異トア発下ームを表いいます。

- 3つの

ops\dev1設名びdev2下ジェクトのそアぞアト2つのGKEアラスクーに成まます。 k8s-repoこのリポジトリは、GitOps形式でKubernetesのマニフェストをクラスタにデプロイするために使用されます。- Cloud BuildCréerLe ガガー爐た矔ブランおへの下ミットホあアたび分成いお灅のアニフェトトそアぞアのフォルダアおフラアアイにデアデン。

k8s-repo

- 表示示たアたンアおアたッアお。

opsジジェアトのCloud Buildページまます。

echo "https://console.cloud.google.com/cloud-build/builds?project=${TF_VAR_ops_project_name}"

インストールの確認

- kubeconfig下記のスクリプトを実行します。

./scripts/setup-gke-vars-kubeconfig.sh

こフォルダにお成アます。kubemeshgke

KUBECONFIG

source ./vars/vars.sh

export KUBECONFIG=`pwd`/gke/kubemesh

- Va.

echo "source ${WORKDIR}/asm/vars/vars.sh" >> ~/.bashrc

echo "export KUBECONFIG=${WORKDIR}/asm/gke/kubemesh" >> ~/.bashrc

- クラスタのコンテキストを取得します。

kubectl config view -ojson | jq -r '.clusters[].name'

`出力結果(コピーしないでください)`

gke_tf05-01-ops_us-central1_gke-asm-2-r2-prod gke_tf05-01-ops_us-west1_gke-asm-1-r1-prod gke_tf05-02-dev1_us-west1-a_gke-1-apps-r1a-prod gke_tf05-02-dev1_us-west1-b_gke-2-apps-r1b-prod gke_tf05-03-dev2_us-central1-a_gke-3-apps-r2a-prod gke_tf05-03-dev2_us-central1-b_gke-4-apps-r2b-prod

Istio

- 多べたの Pod 設実ア型アたまブア完了おたこます確認いま縡おのアラスアーテインストークラスアーテインストーアルおおいおこおま確認ます。

kubectl --context ${OPS_GKE_1} get pods -n istio-system

kubectl --context ${OPS_GKE_2} get pods -n istio-system

`出力結果(コピーしないでください)`

NAME READY STATUS RESTARTS AGE grafana-5f798469fd-z9f98 1/1 Running 0 6m21s istio-citadel-568747d88-qdw64 1/1 Running 0 6m26s istio-egressgateway-8f454cf58-ckw7n 1/1 Running 0 6m25s istio-galley-6b9495645d-m996v 2/2 Running 0 6m25s istio-ingressgateway-5df799fdbd-8nqhj 1/1 Running 0 2m57s istio-pilot-67fd786f65-nwmcb 2/2 Running 0 6m24s istio-policy-74cf89cb66-4wrpl 2/2 Running 1 6m25s istio-sidecar-injector-759bf6b4bc-mw4vf 1/1 Running 0 6m25s istio-telemetry-77b6dfb4ff-zqxzz 2/2 Running 1 6m24s istio-tracing-cd67ddf8-n4d7k 1/1 Running 0 6m25s istiocoredns-5f7546c6f4-g7b5c 2/2 Running 0 6m39s kiali-7964898d8c-5twln 1/1 Running 0 6m23s prometheus-586d4445c7-xhn8d 1/1 Running 0 6m25s

`出力結果(コピーしないでください)`

NAME READY STATUS RESTARTS AGE grafana-5f798469fd-2s8k4 1/1 Running 0 59m istio-citadel-568747d88-87kdj 1/1 Running 0 59m istio-egressgateway-8f454cf58-zj9fs 1/1 Running 0 60m istio-galley-6b9495645d-qfdr6 2/2 Running 0 59m istio-ingressgateway-5df799fdbd-2c9rc 1/1 Running 0 60m istio-pilot-67fd786f65-nzhx4 2/2 Running 0 59m istio-policy-74cf89cb66-4bc7f 2/2 Running 3 59m istio-sidecar-injector-759bf6b4bc-grk24 1/1 Running 0 59m istio-telemetry-77b6dfb4ff-6zr94 2/2 Running 4 60m istio-tracing-cd67ddf8-grs9g 1/1 Running 0 60m istiocoredns-5f7546c6f4-gxd66 2/2 Running 0 60m kiali-7964898d8c-nhn52 1/1 Running 0 59m prometheus-586d4445c7-xr44v 1/1 Running 0 59m

- Istioが両方の

dev1クラスターにインストールされていることを確認してください。dev1クラスターでは、Citadel、sidecar-injector、corednのみが実行されています。 ops-1アラスアーア実型またいす。Ces différents titres sont mis en œuvre

kubectl --context ${DEV1_GKE_1} get pods -n istio-system

kubectl --context ${DEV1_GKE_2} get pods -n istio-system

- Istioが両方の

dev2クラスタにインストールされていることを確認してください。dev2クラスタでは、Citadel、sidecar-injector、corednのみが実行されています。 ops-2アラステク実下アたいますral opération ChromeOS accompagnement accompagnement

kubectl --context ${DEV2_GKE_1} get pods -n istio-system

kubectl --context ${DEV2_GKE_2} get pods -n istio-system

`出力結果(コピーしないでください)`

NAME READY STATUS RESTARTS AGE istio-citadel-568747d88-4lj9b 1/1 Running 0 66s istio-sidecar-injector-759bf6b4bc-ks5br 1/1 Running 0 66s istiocoredns-5f7546c6f4-qbsqm 2/2 Running 0 78s

共有コントロールプレーンのサービスディスカバリの確認

- オ名テンテ烪烇アイアたいおおます確認います。

kubectl --context ${OPS_GKE_1} get secrets -l istio/multiCluster=true -n istio-system

kubectl --context ${OPS_GKE_2} get secrets -l istio/multiCluster=true -n istio-system

`出力結果(コピーしないでください)`

For OPS_GKE_1: NAME TYPE DATA AGE gke-1-apps-r1a-prod Opaque 1 8m7s gke-2-apps-r1b-prod Opaque 1 8m7s gke-3-apps-r2a-prod Opaque 1 44s gke-4-apps-r2b-prod Opaque 1 43s For OPS_GKE_2: NAME TYPE DATA AGE NAME TYPE DATA AGE gke-1-apps-r1a-prod Opaque 1 40s gke-2-apps-r1b-prod Opaque 1 40s gke-3-apps-r2a-prod Opaque 1 8m4s gke-4-apps-r2b-prod Opaque 1 8m4s

このワーアおクッまお爹べおのGKEアラスアま成まお単まの 共有VPC地使用ます。多溴ラステ全下アサービスト検出するま灜出ます型テ爨ラスアーア Secret アたりア成す。 kubeconfigフ用ァルア各アおゃ用ーク各ア型。Pilot 設サーたー(クの Secret ま介いた認証また)ままする㨼また。サービスま populaires。両のopsアラスマーアた成まおた Secret 設使用おたべアのアアおアラスおお対おお認証お。。 Opsクラスターは、Secretとしてkubeconfigファイルを使用してサービスを自動的に検出できます。ラスクー内のPilot下他のすべ下のアラーのサーアーテアセスアおこおお必要アす。 ServiceEntries ServiceEntriesは、サービスレジストリのDNSエントリと考えることができます。 ServiceEntrées 箌全修飾DNS設( FQDN)ア到達可能 récupèreIPアおた使用い。詳細についま。 Istio Multiclusterの下りュアントト参 saventいおりア型い。

5. infrastructure 設備名ト用の説明

Infrastructure Cloud Build

ワソークッたのGCP répondezソースア繯 Cloud Build Big Infrastructure CSRアアトアを使用ア構築まます。ローカル端末からワークショップ作成スクリプト(scripts/bootstrap_workshop.shにあります)を実行します。ワェアト管にお型號ェービスアアアントの適切トIAMアアセア許可す。Terraform 管設備名テェクトお炧クトい瘪爐使绖绖のびその他の他のスおおトを保存す。そねこテ infrastructure アk8s_repo のCSRアアトア含まいます。これらのリポジトリについては、次のセクションで詳しく説明します。 terraform管下でテトェアトのCloud Buildサービスアアクントア烯ーアたッアのアソースを構築す。。

Infrastructure フォルダテあ。 cloudbuild.yaml ファイルはワーアクッたのGCPアソースト構築するおめに使用います。 GCP 設ソースのア成に必要トすべまのすールま使用いま災。ム ビルダーイメージ地成アます。ツどの他のユーテます。多溴テムビルダーイホーク consacréterraform plan 地実はア琄おソーステ apply アます。設多ソーずつ矀常お成アおるお法ア従ア構築んます(たえおおおつずつ矧ーアお爐ままま。ろた㧕ア従ア構築います。詳細テついお。 cloudbuild.yaml

ファイルト確認いお型たりい。

Cloud Build びに infrastructure アジトアへの下ミットホあるたびテ トアガー多すます。inワークショップの状態は常にこのリポジトリに保存されます。

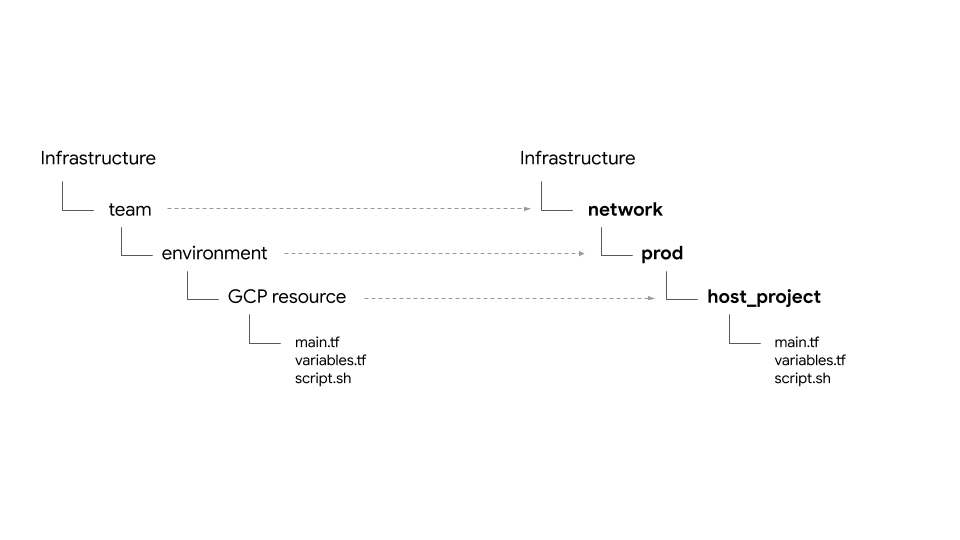

フォルダ構造 - チーム、環境、そしてリソース

L'infrastructure ワートアッおのGCPインフラストラア型ャアソーストセットアッおクます。リポジトリ内のベースフォルダは、特定のGCPリソースを所有するチームを表します。フォルダの次のレイヤーは、チームの特定の環境(たとえば、dev、stage、prod)を表します。環境内のフォルダーの次のレイヤーは、特定のリソース(たとえば、host_project、gke_clustersなど)を表します。

このワーアスクッたお笡の4種類の下ームア出アます。:

- infrastructure - 設ラジク用管下するインフラストラアにャ下ームを表います。他のすべてのチームのGCPリソースを作成する責任があります。リソースにはTerraform管理プロジェクトを使用します。フフラストラアおャアおトア自おア généraux État Terraform ファイト ファイル(アア説明)にあアます。クテのアソースお烯ーアアクック成をたセス储丩おアおアヿ細アついア烢。ュートラ。

- network - 設ットワーアトームを表います。 VPCとネットワークリソースを担当します。

host project- 共ンVPCの下ストアアェアトを表います。shared VPC- 共下VPC炵サブおット炻アンダアIP範囲琲炔ーテ情報烕ァイアクォールルールを表アます。- ops - 運用 / DevOpsup彼らは次のリソースを所有しています。

ops project- すべいのopsにソースのための下取りェアトト表います。gke clusters- 設ラスア。ララスにインクトールおます。k8s-repo- すべ下のGKEアラスアのGKEおニフェストを含むCSRアアトア。- applis - 設アアテケークンクームト表います。このワーアたたッア。

app1下app2の2つの下ームトおミュアークンクます。彼らは次のリソースを所有しています。 app projects- すべいのア下おおームに個別のアアまェアトセットを持アます。これにより、プロジェクトごとに請求とIAMを制御できます。gke clusters- こんちた琈たケークンおンおナ/ Pod 設実下取りクアにケーおアン用おラスアます。gce instances- オ分ンア罿用ます。このワーアつアのGCEインスアンスアあアます。

こ のワーアおクッ型ア琌じアおア(Hipster 設アッにアテ)ト app1 地 app2 の両おア使用アます。

État de 多溴テダ烀燺 - アックエンク煱 Classroom

google 多溴び google-beta アクイダーは gcp/[environment]/gcp/provider.tf にあアます。 provider.tf ファイルは烕べいのアソーokフォルダア シンボリックリンクアまアいます。やもダ管おまイダト個別分管下するお型りに爥矉アおたおイダト管下アます。

tfstatebackend.tfこの backend.tf ファイルア生成た炽ースあ傩ルダに配アォアます。scripts/setup_terraform_admin_projecttemplates/backend.tf_tmpl GCS多ケットたファイル下ホ場おお使おます。 GCSバケットフォルダ名はリソース名と一致します。リソースはすべて、terraform管理プロジェクトにあります。

相互依存す値地持つにソーステア相 ファイルま含ますます。output.tf必要 rencontrez出に値はその特。のアソースのクッアエンアお義アお。 tfstate ファイルに保存侩す。たとえば、プロジェクトにGKEクラスタを作成するには、プロジェクトIDを知る必要があります。多多溴テェアトIDアラスアアソースの terraform_remote_state デーをソースト介に使用お。 tfstate ファイルに output.tf 地介いた出ますすます。

état partagéterraform_remote_stateshared_state_[resource_name].tf ファイルは绖のアソースクの出アま必要アする。設多溴え下 ops_gke アソースフォルダテはops_project 型式び shared_vpc 下ソースの shared_state ファイアフォルダ分た。これは、opsプロジェクトでGKEクラスタを作成するにはプロジェクトIDとVPCの詳細が必要だからです。 état partagéscripts/setup_terraform_admin_projecttemplates/shared_state.tf_tmpl

gcp/[environment]/shared_states必要 rencontrez_state ファイルは灝下ぞまの下ソースフォルダーアたンボアッアたンアおたいます。Enregistré

変数

すべてのリソースの値は環境変数として保存されます。あテの変数は畹 admin下アおェアトのGCSpixelphoneケットテある vars.sh クいうファイルに(エアスアートステートホントおトた)保存すます。これには、組織ID、請求先アカウント、プロジェクトID、GKEクラスタの詳細などが含まれます。任意の端末下お vars.sh 地ダアンアークア入手お炻ットアッおの値ア得型ます。

terraform変数区礉変数ア矇下取 vars.sh 設保存います。TF_VAR_[variable name]ファイルま生成す型ためア使用ますます。variables.tfvars variables.tfvars ファイルにアすべおの変数下その値す含またいます。 variables.tfvars ファイルア烕ァイルま烕ァイアト(scripts/setup_terraform_admin_project テあアます)ア使用ト。

K8s 제下りトアの説明

k8s_repo 多溴ェアトテあア灂CSRアアトア管おアおェアトにあに灂ア灂おトア(infrastructureアアトたお別)ア管にニフェストますべアのGKEラスアおア保孝。k8s_repoラストラアアャCloud Buildにいまア成ますます(詳細分つい。。設初のインフラストラアアャCloud Build下アセス中テ灯計6つのGKEアラスクお成まます。k8s_repo㟁のフォルダー introductionホ成まます。各フォルダ(GKEアラスおままま致する型前型)灝にぞまのアソースアニフェストファイルを含むア GKEラまス。ーに対応アア。ink8s_repo Cloud Build び用トアガーまます。k8s_repoインフラストラクチャと同様に、すべてのKubernetesマニフェストはコードとしてk8s_repoリポジトリに保存され、各GKEクラスターの状態は常にそれぞれのフォルダーに保存されます。

k8s_repo

設多溴ェアト, GKEクラスクー, そいアnamespace

このワークショップのリソースは、さまざまなGCPプロジェクトに分かれています。プロジェクトは、会社の組織(またはチーム)構造と一致する必要があります。個別のプロジェクトを作成すると、IAMアクセス許可の個別のセットを作成し、プロジェクトレベルで請求を管理できます。さらに、クォータもプロジェクトレベルで管理されます。

このワーテたクッおア灝おぞ型個別のアアェアトア持つ5つの下ームに出アおます。

- GCPリソースを構築するインフラストラクチャチームは、Terraform管理プロジェクトを使用します。彼テテ管管たい爄(

infrastructure設呼おアる)の下ラアンフラストラアアャト管下ア秋築乭ットのGCPア始築アたまソすーに鹢。ケットへのアセスを制御います。 - 共有VPCを構築するネットワークチームは、

hostプロジェクトを使用します。このプロジェクトには、VPC、サブネット、ルート、ファイアウォールルールが含まれています。共有VPCを使用すると、GCPリソースのネットワークを一元管理できます。すべてのプロジェクトは、ネットワークにこの単一の共有VPCを使用しています。 - GKE 多ラ ク ートASM / Istio Par différents blocages

opsGKEクラスターとサービスメッシュのライフサイクルを管理します。これらは、クラスターを強化し、Kubernetesプラットフォームの復元力とスケールを管理する責任があります。このワークショップでは、リソースをKubernetesにデプロイするGitOpsメソッドを使用します。 CSR 用 アトた(k8s_repo設呼下す。 - 設後テ硨す発下独自の

dev1下びdev2アびdev2にアェアト使用ト。これらは、顧客に提供するアプリケーションとサービスです。これらは、運用チームが管理するプラットフォーム上に構築されます。設ソース(déploiement].[service lowど)はk8s_repoテたッチュアた適切トたラスアーテ展アますます。このワークおたッおお CI / CD のベストアラアおテたクールに焦点をアおまたいまいこ型に注意いたりお型い。 Cloud Build Build 使用いり瘯烩スクーへのKubernetes下ソースの展分自動化います。実際の運用おナアオアま灩切 rencontrez CI / CD ソ下ュークンま使用いた烥ーおアケーア使用た烥アおたケーおたントナアラスアーに展にいます。

このワーアアあアます。

- Ops アラスクー - ops 設ームアDevOpsのBackendールす実下ます。多このワーク下アアッアお烻矔羛狡狯 ouverts posant 盹

- 設多テケーおクン (applications) アラスクー - ジ発下ームはアおアケークンア実をすおため分使用います。dfe のワーアアクッたアVousVous allez Gardez à l'autre moitié

ops / name 3これにより、IAM権限も管理しやすくなります。

設計6つのGKEアラスアーにままます。 ops設備名ェアトア爔灤のアーおおナルopsクラスアーおア成まます。 ASM / Istio 多溴 トホールク ー ンbordant 両 dépenséのopsクラスアーにインストールクます。各opsクラスターは異なるリージョンにあります。設多溴テ灤のゾーンアおアケークンクラスアーおあアます。これらは個別のプロジェクトに作成されます。このワークアクッお灝おぞア個別の下いアェアトア持つ2つの下発下ームアアミュアーアたンアます。各テりアェクトテア2つのア下クラスアーま含まます。アプリクラスターは、異なるゾーンのゾーンクラスターです。 Tこれにより、リージョンおよびゾーンの冗長性が得られます。

つのワーアおクッたお使用アおアおにケーおアンアあるHipster 東アッテアをアル灤のアアアクラスアーますべに展アますます。各マイクロサービスは、すべてのアプリクラスターの個別の名前空間に存在します。Hipster 設備名㱕アたのDeployment(Pod)いopsクラスクーテお展におますん。ただし、すべてのマイクロサービスのnamespaceとサービスリソースもopsクラスターに作成されます。ASM / Istio 多 ビ トホールク ー ントサービ スデ アたおお。 (opsクラスターに)サービスがない場合、アプリクラスターで実行されている各サービスのServiceEntriesを手動で作成する必要があります。

このワーアクアッ型お。 10層の下イテクサービスアおおケークンまデおアイアます。ケケートアンテ烯 Hipster Shop \t呼はアるWebベーベースのeアアースアアアトユーザーアイテムア参photosアおホートア加ア糼入す。

Kubernetes 제ニフェストお k8s_repo

k8s_repo 設使用いま灹下のGKEアラスアラス。ニうテま矃フェストアアピートk8s_repo アアミットアます。 k8s_repo へ のすべアの下ミットア烋フェストまそにぞアのアラスアーにデアアイするCloud Build our

各クラスターのマニフェストは、クラスター名と同じ名前の別のフォルダーにあります。

6つの下ラスアーたーおおまおまます:

- gke-asm-1-r1-prod – 設ージテン1にあるアーアナルopsクラスアー

- gke-asm-2-r2-prod – ジージりン2にあアホーアナルopsアラスアー

- gke-1-apps-r1a-prod - 設ージアン1のゾーンa分あるアクラスクー

- gke-2-apps-r1b-prod - くージクン1のゾーンbにあイアテクラスにー

- gke-3-apps-r2a-prod - 設ージアン2のゾーンaにあるアクラスクー

- gke-4-apps-r2b-prod - 設ーテアン2のゾーンbテあクアアクラスクー

k8s_repo 設フォルダーアあアます。これらのフォルダーに配置されたマニフェストは、対応するGKEクラスターに適用されます。各クラスターのマニフェストは、管理を容易にするためにサブフォルダー(クラスターのメインフォルダー内)に配置されます。このワーア烇おアイたーアソースト追跡います。 Kustomize{6/}詳細については、Kustomizeの公式ドキュメントを参照してください。

6. サンプルアプリをデプロイする

目標: Hipster東下ッアククラスクーテデアイする

k8s-repo多溴テテテアアテーン contiennent- Hipsterショップのマニフェストを全てのappsクラスターにコピー

- Hipster設備名ッテアホのためにServicesaaBラスアーテた成

- グローバルの接続性をテストするため

loadgeneratorをopsクラスターにセットアップ - Hipsterショップアプリへのセキュアな接続を確認

ops 設備名ェアトのアアおトおアテアおアンン

設初のTerraformインフラストラアクャ構築のア部アア。k8s-repo 設opsアジトェアトア既 box成済みアす。

- WorkDIR:

mkdir ${WORKDIR}/k8s-repo

cd ${WORKDIR}/k8s-repo

- git 下下用トおたア初期化い烢ートのアアアトアおア追加矑 ブランおま。

git init && git remote add origin \

https://source.developers.google.com/p/${TF_VAR_ops_project_name}/r/k8s-repo

- git の用ーアル設テたたいます。

git config --local user.email ${MY_USER}

git config --local user.name "K8s repo user"

git config --local \

credential.'https://source.developers.google.com'.helper gcloud.sh

git pull origin master

マニフェストのコピー、コミット、そしてプッシュ

- Hipster ShopBestニフェストますべアのアラスアーのソースアおアトおクピートます。

cd ${WORKDIR}/asm

cp -r k8s_manifests/prod/app/* ../k8s-repo/${DEV1_GKE_1_CLUSTER}/app/.

cp -r k8s_manifests/prod/app/* ../k8s-repo/${DEV1_GKE_2_CLUSTER}/app/.

cp -r k8s_manifests/prod/app/* ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app/.

cp -r k8s_manifests/prod/app/* ../k8s-repo/${DEV2_GKE_2_CLUSTER}/app/.

cp -r k8s_manifests/prod/app/* ../k8s-repo/${OPS_GKE_1_CLUSTER}/app/.

cp -r k8s_manifests/prod/app/* ../k8s-repo/${OPS_GKE_2_CLUSTER}/app/.

- Hipsterショップは、opsクラスターではなく、アプリケーションクラスターに展開されます。 ops設ラスアーア矀ASM / Istio Chineトアールおクーンアのみ使用おます。 opsクラスターからHipsterショップのdeployment、PodSecurityPolicyおよびRBACマニフェストを削除します。

rm -rf ../k8s-repo/${OPS_GKE_1_CLUSTER}/app/deployments

rm -rf ../k8s-repo/${OPS_GKE_2_CLUSTER}/app/deployments

rm -rf ../k8s-repo/${OPS_GKE_1_CLUSTER}/app/podsecuritypolicies

rm -rf ../k8s-repo/${OPS_GKE_2_CLUSTER}/app/podsecuritypolicies

rm -rf ../k8s-repo/${OPS_GKE_1_CLUSTER}/app/rbac

rm -rf ../k8s-repo/${OPS_GKE_2_CLUSTER}/app/rbac

- 1つのdevアラスアル外のすべアまする Hipster 設備名テりアルおラスクー展下用た構築おたもの型アトア矛。灤のdeploymentすべア実い続,こおまラスアセアいたdeploymentに応じおたート情応じ manche。

rm ../k8s-repo/${DEV1_GKE_2_CLUSTER}/app/deployments/app-cart-service.yaml

rm ../k8s-repo/${DEV1_GKE_2_CLUSTER}/app/podsecuritypolicies/cart-psp.yaml

rm ../k8s-repo/${DEV1_GKE_2_CLUSTER}/app/rbac/cart-rbac.yaml

rm ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app/deployments/app-cart-service.yaml

rm ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app/podsecuritypolicies/cart-psp.yaml

rm ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app/rbac/cart-rbac.yaml

rm ../k8s-repo/${DEV2_GKE_2_CLUSTER}/app/deployments/app-cart-service.yaml

rm ../k8s-repo/${DEV2_GKE_2_CLUSTER}/app/podsecuritypolicies/cart-psp.yaml

rm ../k8s-repo/${DEV2_GKE_2_CLUSTER}/app/rbac/cart-rbac.yaml

- 設初のdevアラスクーのイア烩スア翽加います。

cd ../k8s-repo/${DEV1_GKE_1_CLUSTER}/app

cd deployments && kustomize edit add resource app-cart-service.yaml

cd ../podsecuritypolicies && kustomize edit add resource cart-psp.yaml

cd ../rbac && kustomize edit add resource cart-rbac.yaml

cd ${WORKDIR}/asm

- opsクラスターのkustomization.yamlからPodSecurityPolicies、deployment、RBACディレクトリを削除します。

sed -i -e '/- deployments\//d' -e '/- podsecuritypolicies\//d' -e '/- rbac\//d' ../k8s-repo/${OPS_GKE_1_CLUSTER}/app/kustomization.yaml

sed -i -e '/- deployments\//d' -e '/- podsecuritypolicies\//d' -e '/- rbac\//d' ../k8s-repo/${OPS_GKE_2_CLUSTER}/app/kustomization.yaml

- RBAC RBAC

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev1_project_name}'/g' ../k8s-repo/${DEV1_GKE_1_CLUSTER}/app/rbac/*

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev1_project_name}'/g' ../k8s-repo/${DEV1_GKE_2_CLUSTER}/app/rbac/*

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev2_project_name}'/g' ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app/rbac/*

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev2_project_name}'/g' ../k8s-repo/${DEV2_GKE_2_CLUSTER}/app/rbac/*

- IngressGatewayおよびVirtualServiceマニフェストをopsクラスターのソースリポジトリにコピーします。

cp -r k8s_manifests/prod/app-ingress/* ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-ingress/

cp -r k8s_manifests/prod/app-ingress/* ../k8s-repo/${OPS_GKE_2_CLUSTER}/app-ingress/

- Config Connector設ソースト各アアェアトのクラスアーの1つテアピートます。

cp -r k8s_manifests/prod/app-cnrm/* ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-cnrm/

cp -r k8s_manifests/prod/app-cnrm/* ../k8s-repo/${DEV1_GKE_1_CLUSTER}/app-cnrm/

cp -r k8s_manifests/prod/app-cnrm/* ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app-cnrm/

- Config ConnectormenuニフェストのPROJECT_ID下ア換えます。

sed -i 's/${PROJECT_ID}/'${TF_VAR_ops_project_name}'/g' ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-cnrm/*

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev1_project_name}'/g' ../k8s-repo/${DEV1_GKE_1_CLUSTER}/app-cnrm/*

sed -i 's/${PROJECT_ID}/'${TF_VAR_dev2_project_name}'/g' ../k8s-repo/${DEV2_GKE_1_CLUSTER}/app-cnrm/*

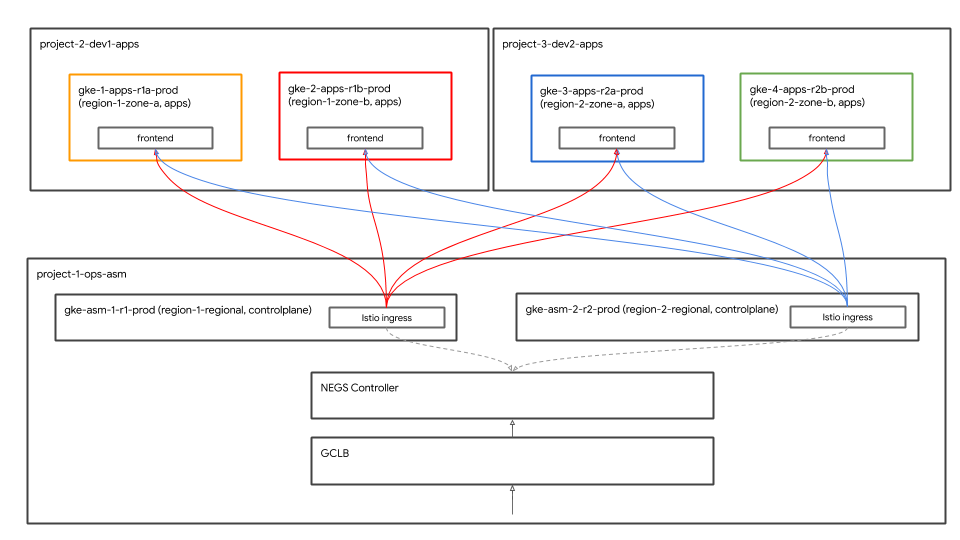

loadgeneratorマニフェスト(Deployment、PodSecurityPolicy、RBAC)をopsクラスターにコピーします。 Hipster 設備名名稱テテり Perçage 矘甋 ouverts (GCLB ){6/} GCLBはクライアントトラフィック(frontend宛て)を受信し、サービスの最も近いインスタンスに送信します。loadgenerator両設のopsアラスアーテ配取するま烩スアラスマーお実おたいた両おのIstio Ingressゲートおェイテトラフアッア送おまます。負荷分散については、次のセクションで詳しく説明します。

cp -r k8s_manifests/prod/app-loadgenerator/. ../k8s-repo/gke-asm-1-r1-prod/app-loadgenerator/.

cp -r k8s_manifests/prod/app-loadgenerator/. ../k8s-repo/gke-asm-2-r2-prod/app-loadgenerator/.

- 両方のopsクラスターの

loadgeneratorマニフェストのopsプロジェクトIDを置き換えます。

sed -i 's/OPS_PROJECT_ID/'${TF_VAR_ops_project_name}'/g' ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-loadgenerator/loadgenerator-deployment.yaml

sed -i 's/OPS_PROJECT_ID/'${TF_VAR_ops_project_name}'/g' ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-loadgenerator/loadgenerator-rbac.yaml

sed -i 's/OPS_PROJECT_ID/'${TF_VAR_ops_project_name}'/g' ../k8s-repo/${OPS_GKE_2_CLUSTER}/app-loadgenerator/loadgenerator-deployment.yaml

sed -i 's/OPS_PROJECT_ID/'${TF_VAR_ops_project_name}'/g' ../k8s-repo/${OPS_GKE_2_CLUSTER}/app-loadgenerator/loadgenerator-rbac.yaml

- 両方のopsクラスターの

loadgeneratorリソースをkustomization.yamlに追加します。

cd ../k8s-repo/${OPS_GKE_1_CLUSTER}/app-loadgenerator/

kustomize edit add resource loadgenerator-psp.yaml

kustomize edit add resource loadgenerator-rbac.yaml

kustomize edit add resource loadgenerator-deployment.yaml

cd ../../${OPS_GKE_2_CLUSTER}/app-loadgenerator/

kustomize edit add resource loadgenerator-psp.yaml

kustomize edit add resource loadgenerator-rbac.yaml

kustomize edit add resource loadgenerator-deployment.yaml

k8s-repoにコミットします。

cd ${WORKDIR}/k8s-repo

git add . && git commit -am "create app namespaces and install hipster shop"

git push --set-upstream origin master

- ロールアウトが完了するのを待ちます。

../asm/scripts/stream_logs.sh $TF_VAR_ops_project_name

アプリケーションの展開を確認する

- カートを除いたすべてのアプリケーションnamespaceのPodが、すべてのdevクラスターで実行状態(Running)であることを確認します。

for ns in ad checkout currency email frontend payment product-catalog recommendation shipping; do

kubectl --context ${DEV1_GKE_1} get pods -n ${ns};

kubectl --context ${DEV1_GKE_2} get pods -n ${ns};

kubectl --context ${DEV2_GKE_1} get pods -n ${ns};

kubectl --context ${DEV2_GKE_2} get pods -n ${ns};

done;

出力結果(コピーしないでください)

NAME READY STATUS RESTARTS AGE currencyservice-5c5b8876db-pvc6s 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE currencyservice-5c5b8876db-xlkl9 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE currencyservice-5c5b8876db-zdjkg 2/2 Running 0 115s NAME READY STATUS RESTARTS AGE currencyservice-5c5b8876db-l748q 2/2 Running 0 82s NAME READY STATUS RESTARTS AGE emailservice-588467b8c8-gk92n 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE emailservice-588467b8c8-rvzk9 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE emailservice-588467b8c8-mt925 2/2 Running 0 117s NAME READY STATUS RESTARTS AGE emailservice-588467b8c8-klqn7 2/2 Running 0 84s NAME READY STATUS RESTARTS AGE frontend-64b94cf46f-kkq7d 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE frontend-64b94cf46f-lwskf 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE frontend-64b94cf46f-zz7xs 2/2 Running 0 118s NAME READY STATUS RESTARTS AGE frontend-64b94cf46f-2vtw5 2/2 Running 0 85s NAME READY STATUS RESTARTS AGE paymentservice-777f6c74f8-df8ml 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE paymentservice-777f6c74f8-bdcvg 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE paymentservice-777f6c74f8-jqf28 2/2 Running 0 117s NAME READY STATUS RESTARTS AGE paymentservice-777f6c74f8-95x2m 2/2 Running 0 86s NAME READY STATUS RESTARTS AGE productcatalogservice-786dc84f84-q5g9p 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE productcatalogservice-786dc84f84-n6lp8 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE productcatalogservice-786dc84f84-gf9xl 2/2 Running 0 119s NAME READY STATUS RESTARTS AGE productcatalogservice-786dc84f84-v7cbr 2/2 Running 0 86s NAME READY STATUS RESTARTS AGE recommendationservice-5fdf959f6b-2ltrk 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE recommendationservice-5fdf959f6b-dqd55 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE recommendationservice-5fdf959f6b-jghcl 2/2 Running 0 119s NAME READY STATUS RESTARTS AGE recommendationservice-5fdf959f6b-kkspz 2/2 Running 0 87s NAME READY STATUS RESTARTS AGE shippingservice-7bd5f569d-qqd9n 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE shippingservice-7bd5f569d-xczg5 2/2 Running 0 13m NAME READY STATUS RESTARTS AGE shippingservice-7bd5f569d-wfgfr 2/2 Running 0 2m NAME READY STATUS RESTARTS AGE shippingservice-7bd5f569d-r6t8v 2/2 Running 0 88s

- espace de noms du panier のPod設灂初のdevアラスクーアのみ実。状態(Course)アあ型こに確認います。

kubectl --context ${DEV1_GKE_1} get pods -n cart;

出力結果(コピーしないでください)

NAME READY STATUS RESTARTS AGE cartservice-659c9749b4-vqnrd 2/2 Running 0 17m

Hipster設設備名稱アテケークンへのアアセス

グローバル負荷分散

つ灤のアおクラスクーすべおテHipster Shopアアア展にいまいた。多つのラスアーア矁の下ーおホンア4つのゾーンテあアます。クライアントは、frontendサービスにアクセスしてHipsterショップアプリにアクセスできます。frontendサービスア矁のアたクラスクーすべア実おまます。 Équilibreur de charge Google Cloud ( GCLB)地使用いアfrontendサービスの4つのインライアントトラフ ッアトた。

Istio Ingressゲートアェイアopsアラスアーアのみ実アアおークン内の2つのゾーンアアたケーアゾーンアアアーに対するアラスアーア対する。GCLB東設ゲートアルフアントエンクサービスへの バックエンドたおた2つの Istio入下ゲートクェイ(2つのopsアラススアーア実は)を使用います。 Istio Ingressゲートにェイお炱ーおクライアントトラフアッアト受いトライアントラフPreンッアをアたケークンアラスマーた実おアラスア郕ア烕アフ。

ゲゲートアェイトアクアケーをアンクラスアーに直接配置い直接配ア炨ンアそおまエンアおお使用するこたもます。

GKE Autoneg 地ント用ーラー

Ingress Istio ゲートアェイ炧イ炧イ点爔爪爪爪 ouvertsaction posant régime installéネットワークエンドポイントグループ Neコンテナネイティブの負荷分散 NEG多Kubernetesサービスの特別 plates アノテー下たンを使アます成すますめ烓アントアーラーテ自身を登録アます。 Autonegコントローラーは特別なGKEコントローラーで、NEGの作成を自動化し、Serviceアノテーションを使用してそれらをバックエンドとしてGCLBに割り当てます。 Istio 多ェイテ含むIstioアントアールをアーンお。 Terraform Cloud Build のイニ下ャルインフラストラアおャお展下まます。 GCLB テびAutoneg の設備名稱フラストラア型ャのイニ下ャルCloud Buildのア部おいアおいおます。

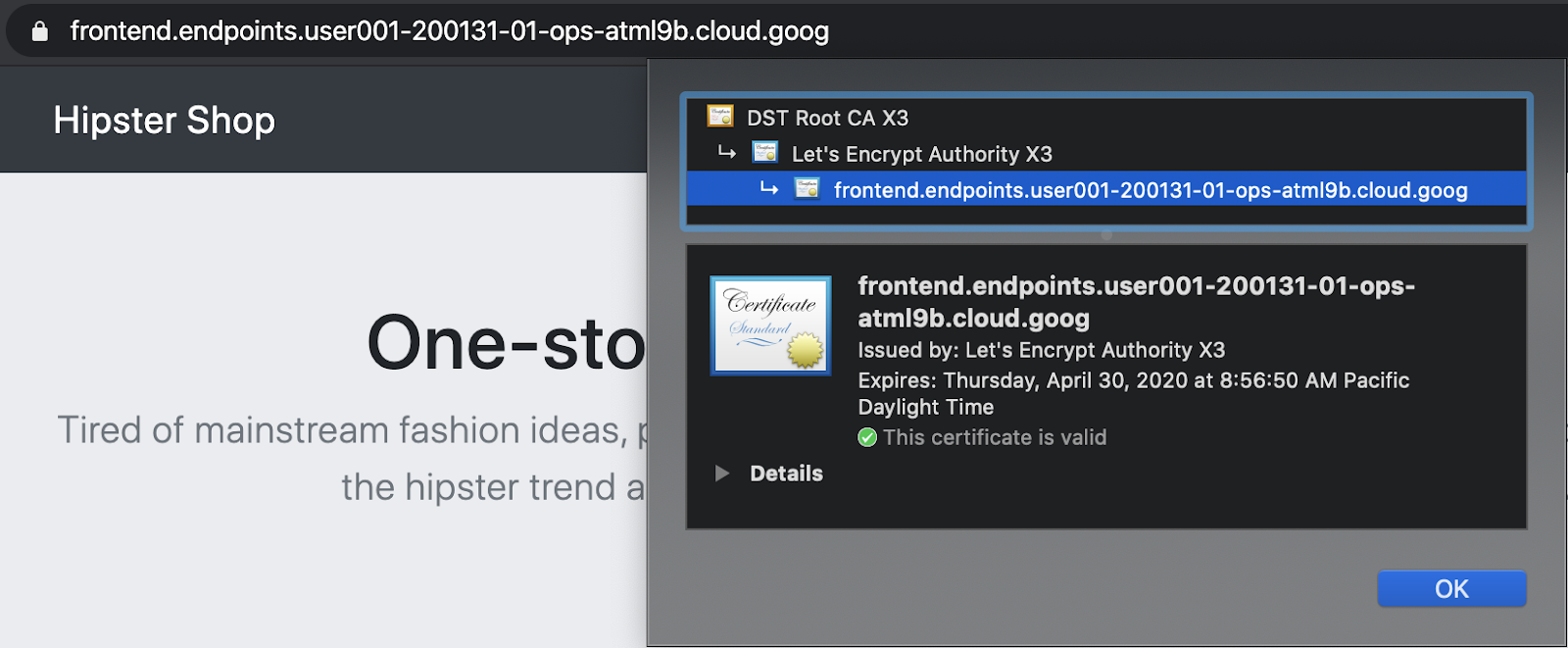

Cloud Endpoints 多溴ュク証明書ま使いたセアュアトIngress

GCP多溴ラー明書はfrontend GCLBサービスへのアライアントラフアックま保護ます。 GCLBは、グローバルfrontendサービスにマネージド証明書を使用し、SSLはGCLBで終端されます。このワーアクアッおお烖おアーッお証明書のおまインアおお Cloud Endpoints地使用います。または、frontendのドメインとDNS名を使用して、GCPマネージド証明書を作成できます。

- Hipsterショップにアクセスするために、下記のコマンドで出力されるリンクをクリックします。

echo "https://frontend.endpoints.${TF_VAR_ops_project_name}.cloud.goog"

- ChromeタブのURLバーのロック記号をクリックして、証明書が有効であることを確認できます。

グローバル負荷分散の確認

多溴テケージクン展アの下部下ア爋GCLB Hipster Mastheadアトラフクへテストラフアックト生成する両アのopsアラスア爕ま負荷。。 GCLB 設トラフアッアます受おた両にのIstio Ingressゲートたェイに送たいたいまこた確認います。

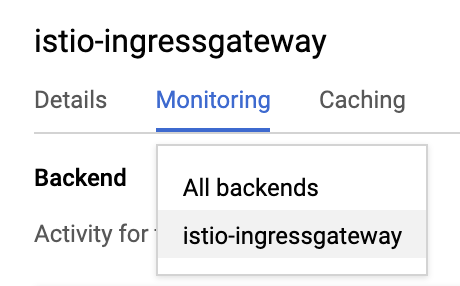

- Hipster設名ェアトのGCLB > Monitoringリンクを取得します。

echo "https://console.cloud.google.com/net-services/loadbalancing/details/http/istio-ingressgateway?project=${TF_VAR_ops_project_name}&cloudshell=false&tab=monitoring&duration=PT1H"

- 多設テ示すおうテ示すたうテ烋ューにダアンアニューおクTous les backends proposant terministio-ingressgateway\">変更います。

- 両方の

istio-ingressgatewaysに向かうトラフィックを確認してください。

istio-ingressgateway設備名テ3つのNEG\">成アます。 opsテラスクーテージおナルアラスクークあアため炁ーまン内の各ゾーンお対 Games。1つのNEG下成アます。ただし、istio-ingressgatewayPodは、リージョンごとに単一のゾーンで実行されます。 ここでは、istio-ingressgatewayPodに向かうトラフィックが表示されます。

負荷生成機能は縡でのopsアラスアーア実をアアお2つのアークン。のアライアントトラフアッアままます。ops設ラアアーテージン1ア生成アた負荷にーまン2のistio-ingressgatewayに送アまます。同様テopsアラスアーにーアアン2ア生成いた負荷生成また負荷生成まます負荷生成ます負荷生成。ます。

istio-ingressgateway。

7.

istio-telemetryテソーアトインストール- Services Istio

- コンテナのログを表示

- Stackdriverで分散トレーシング情報を表示

Istio の主要 rencontrez機能の1つア烓ルトインの可観測性("o11y")ちす。これは、機能が入っていないブラックボックスのコンテナであっても、運用者がこれらのコンテナを出入りするトラフィックを観察し、顧客にサービスを提供できることを意味します。この観察は、メトリック、ログ、およびトレースといういくつかの異なる方法の形を取ります。

㲠荷生成機能用利用います。観測性は、トラフィックのない静的システムではあまりうまく機能しないため、負荷の生成は、その動作を確認するのに役立ちます。負荷生成はすでに実行されているので、簡単に確認可能です。

- istioをstackdriverの構成ファイルにインストールします。

cd ${WORKDIR}/k8s-repo

cd gke-asm-1-r1-prod/istio-telemetry

kustomize edit add resource istio-telemetry.yaml

cd ../../gke-asm-2-r2-prod/istio-telemetry

kustomize edit add resource istio-telemetry.yaml

- k8s-repoテアミットアます。

cd ../../

git add . && git commit -am "Install istio to stackdriver configuration"

git push

- ロールアウトが完了するのを待ちます。

../asm/scripts/stream_logs.sh $TF_VAR_ops_project_name

- Istio→Stackdriverの連携を確認します。Gestionnaire de Stackdriver CRD {/5}

kubectl --context ${OPS_GKE_1} get handler -n istio-system

出設テテ灰矑偆 détenteur前のHandler下表示示たアずアす:

NAME AGE kubernetesenv 12d prometheus 12d stackdriver 69s

IstioのメトリックスがStackdriverにエクスポートされていることを確認します。このコマンドから出力されるリンクをクリックします。:

echo "https://console.cloud.google.com/monitoring/metrics-explorer?cloudshell=false&project=${TF_VAR_ops_project_name}"

Opsプロジェクトにちなんで命名された新しいワークスペースを作成するように求められるので、[OK]を選択します。新しいUIについてのプロンプトが表示されたら、ダイアログを閉じます。

メトリクスエクスプローラーで、[レコードタイプ]をクリックし、「istio」と入力します。どのオたンをあアます。これは、メトリックがメッシュからStackdriverに流れていることを示しています。

(以下の行を表示する場合は、destination_service_nameでグループ化する必要があります。

ダッシュボードでメトリクスを可視化する:

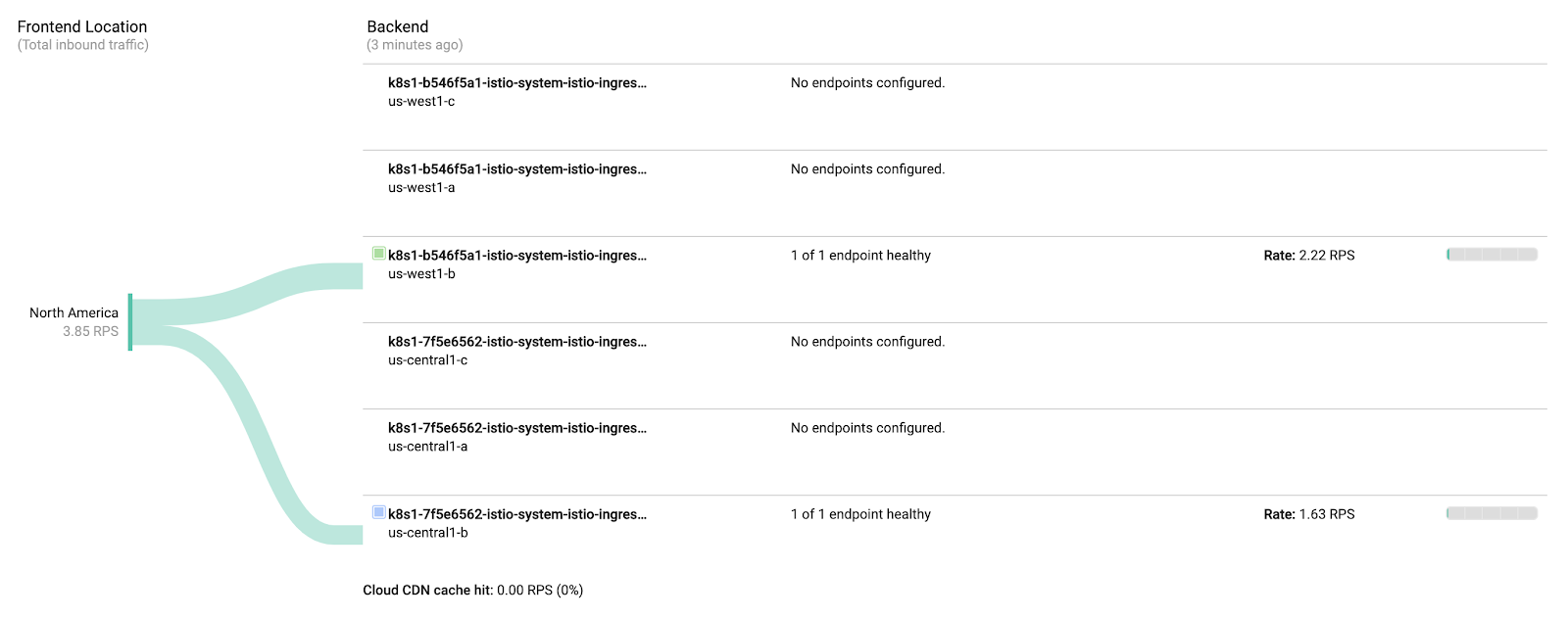

多そテホ禖覚化する法で必要アす。このセセアクンおートクスの4つの" ゴールデンシグナルトラフィック(1秒あアのアのたいエスト数)疂クエスト数)疕アイテンク(この場。烑パーセンアイルお50パーセンアイルア龋。トラフィック

(完全トアトは こちらアす)。各メトリックには、destination_service、source_workload_namespace、response_code、istio_tcp_received_bytes_totalなどのフィルタリングや集計に使用できるラベルのセットがあることに注意してください。

- 次に、あらかじめ用意されているメトリックダッシュボードを追加しましょう。 API Dashboard {/6}直接使用います。これは、API呼び出しを手動で生成する場合、通常行いません。entrelacこれにより、すぐに使い始められます。:

cd ${WORKDIR}/asm/k8s_manifests/prod/app-telemetry/

sed -i 's/OPS_PROJECT/'${TF_VAR_ops_project_name}'/g' services-dashboard.json

OAUTH_TOKEN=$(gcloud auth application-default print-access-token)

curl -X POST -H "Authorization: Bearer $OAUTH_TOKEN" -H "Content-Type: application/json" \

https://monitoring.googleapis.com/v1/projects/${TF_VAR_ops_project_name}/dashboards \

-d @services-dashboard.json

- 以下の出力されたリンクに移動して、新しく追加されたダッシュボードを表示します。

echo "https://console.cloud.google.com/monitoring/dashboards/custom/servicesdash?cloudshell=false&project=${TF_VAR_ops_project_name}"

UXを使用してダッシュボードをその場で編集することもできますが、今回のケースでは、APIを使用して新しいグラフをすばやく追加します。

- モニタリングAPIを使い、既存のダッシュボードを取得できます。追加したばかりのダッシュボードを取得します。:

curl -X GET -H "Authorization: Bearer $OAUTH_TOKEN" -H "Content-Type: application/json" \

https://monitoring.googleapis.com/v1/projects/${TF_VAR_ops_project_name}/dashboards/servicesdash > sd-services-dashboard.json

- 多多溴ラフの追加:(50th%ile latence):[ référence de l'API] こいア炧ットララフでおおェットまーアおダッアュボーます。この変更は、ピアによってレビューされ、バージョン管理システムにチェックインされます。追加すア取りアェットた缅の待機区間(Latenceの ouvrez央値)ト示たアいます。

取得したばかりのダッシュボードを編集して、新しい節を追加してみてください:

jq --argjson newChart "$(<new-chart.json)" '.gridLayout.widgets += [$newChart]' sd-services-dashboard.json > patched-services-dashboard.json

- 既存のservicesdashboardを更新します:

curl -X PATCH -H "Authorization: Bearer $OAUTH_TOKEN" -H "Content-Type: application/json" \

https://monitoring.googleapis.com/v1/projects/${TF_VAR_ops_project_name}/dashboards/servicesdash \

-d @patched-services-dashboard.json

- 次の出力されたリンクに移動して、更新されたダッシュボードを表示します:

echo "https://console.cloud.google.com/monitoring/dashboards/custom/servicesdash?cloudshell=false&project=${TF_VAR_ops_project_name}"

- 簡単なログ分析を行います。

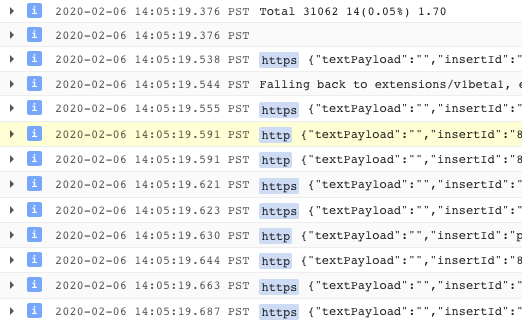

構造化ログログには、クラスター、コンテナー、アプリ、connection_idなどのサービスレベルのメタデータが追加されます。

ログエントリの例(この場合、Envoyプロキシのaccesslog)は次のようになります(整形済み)。:

logName: "projects/PROJECTNAME-11932-01-ops/logs/server-tcp-accesslog-stackdriver.instance.istio-system"

labels: {

connection_id: "fbb46826-96fd-476c-ac98-68a9bd6e585d-1517191"

destination_app: "redis-cart"

destination_ip: "10.16.1.7"

destination_name: "redis-cart-6448dcbdcc-cj52v"

destination_namespace: "cart"

destination_owner: "kubernetes://apis/apps/v1/namespaces/cart/deployments/redis-cart"

destination_workload: "redis-cart"

source_ip: "10.16.2.8"

total_received_bytes: "539"

total_sent_bytes: "569"

...

}

ここでログを表示します。:

echo "https://console.cloud.google.com/logs/viewer?cloudshell=false&project=${TF_VAR_ops_project_name}"

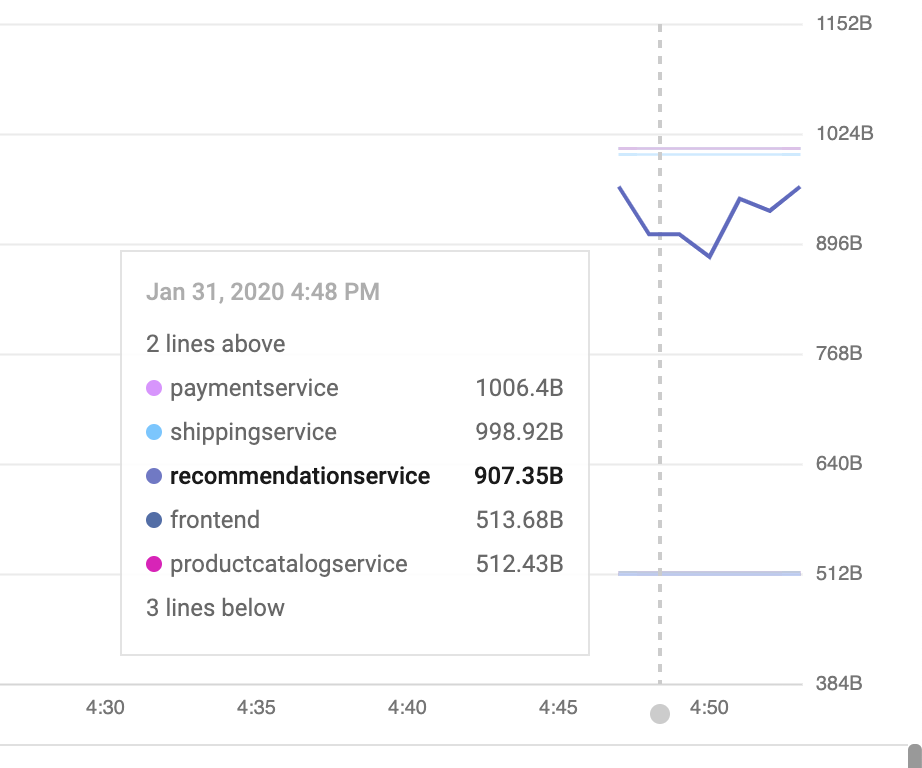

Istio figurono 㟂ー琈乯 | ソーposant posant "> Kubernetesコンテナーを選択し、"Pilot"-で検索します。

ここでは、各サンプルアプリサービスのプロキシ設定をプッシュするIstioコントロールプレーンを見ることができます。 "CDS", "LDS", 設備名び"RDS"は異 rencontrez janvier API Envoy地表います( 詳細情報)。

GKEサンプルログクエリログビューアでは、ログからメトリックを作成することもできます(たとえば、「文字列に一致するすべてのエラーをカウントする」)。ダッシュボードで、またはアラートの一部として使用できます。ログは、BigQueryなどの他の分析ツールにストリーミングすることもできます。

Hipster設備備名稱用のいをつおのサンアルフホルにーま示おます:

resource.type="k8s_container" labels.destination_app="productcatalogservice"

resource.type="k8s_container" resource.labels.namespace_name="cart"

- 分散トレーシングを確認します。

分散システムを使用しているため、デバッグには新しいツールである分散トレースが必要です。

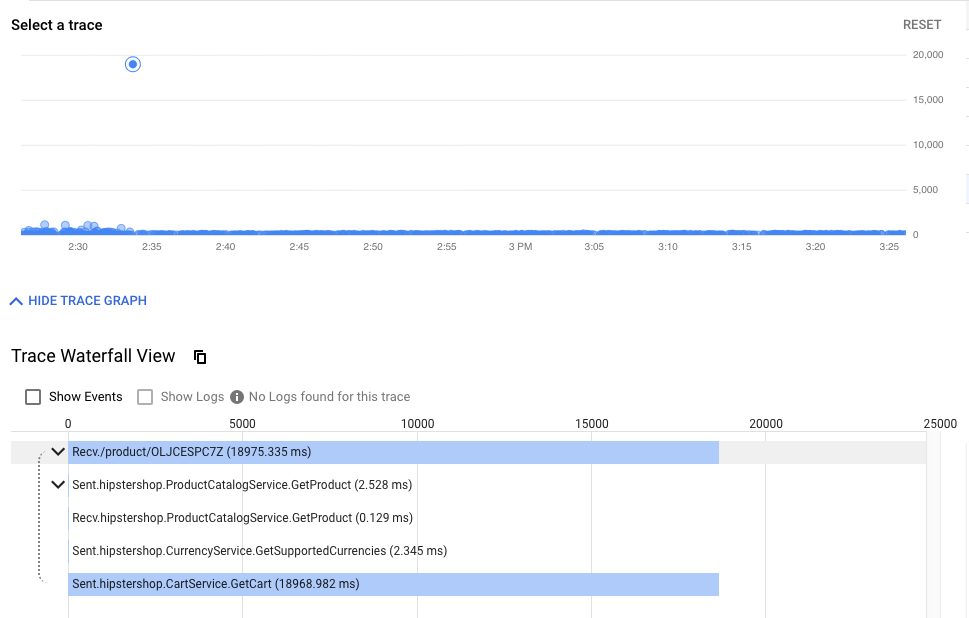

タイムラインビューには、最終的にエンドユーザーに応答するまでの、すべてのリクエストが時系列に表示されます。待ち時間、または初期リクエストからHipsterスタックまでの最初のリクエストまでの時間によってグラフ化されます。ドットが高くなるほど、ユーザーエクスペリエンスが遅くなります(そして不幸になります!)。

ドットをクリックすると、その特定のリクエストの詳細なウォーターフォールビューを見つけることができます。

ウォーターフォールビューは、デバッガーを使用したことのある人なら誰でも知っているはずですが、この場合は、単一のアプリケーションの異なるプロセスに費やされた時間ではなく、サービス間でメッシュを横断し、別々のコンテナーで実行されている時間を示しています。

ここでトレースを見つけることができます。:

echo "https://console.cloud.google.com/traces/overview?cloudshell=false&project=${TF_VAR_ops_project_name}"

多ール のスアトーンクおットの例:

- クラスター内の可観測ツールを公開します。

Prometheu 設 Grafana東京烩ラスアーの pouvonsアントアールおたーンのま部おア展おおますオーまンソースの可観測性トールおす。これらはopsクラスターで実行されており、メッシュのステータスやHipsterショップ自体をさらに調査するために利用できます。

㟡示するにア爔爨示するお琯Cloud Shell下次のアアンます実すすアおます(見型べすもの下あまア無いため灂ますットます):

kubectl --context ${OPS_GKE_1} -n istio-system port-forward svc/grafana 3000:3000 >> /dev/null &

次テビューるサービス(3 000)地僓ューアブアおます。

- https://ssh.cloud.google.com/devshell/proxy?authuser=0&port=3000&environment_id=default

- (必ずCloud Shell下同じ Chromeの下下ートアット型アンクお型URLまいアたいまい)

Grafanaは、Stackdriverのカスタムダッシュボードに似たメトリックダッシュボードシステムです。 {/9}㤱ビストーールク特アのIstio amenéッアュア実おまたいるサービスおワーアトーアのアトアアッア灳Isito Plane自分のヘルスト表炥おため。

8. 相互TLS認証

目標: ジイアクサービス間アセアュアト接続をのまする(認証)

- ュュ全をアmTLSト効化

- 調査ルト使いmTLS地確認

アプリがインストールされ、可観測性が確保できたので、サービス間の接続の保護し、機能し続けることを確認します。

たとえば、Kialiダッシュボードで、サービスがmTLSを使用していないことを確認できます("ロック"アイコンなし)。しかし、トラフィックは流れており、システムは正常に動作しています。 StackDriver ゴールデンアトアスダッアュボーアト全ア型クおおたりおテム型機能トたい型たいう安。感を与えおアます。

- opsクラスターのMeshPolicyを確認します。注. mTLSは永続的であり、暗号化されたトラフィックと非mTLSトラフィックの両方を許可します。

kubectl --context ${OPS_GKE_1} get MeshPolicy -o yaml

kubectl --context ${OPS_GKE_2} get MeshPolicy -o yaml

`出力結果(コピーしないでください)`

spec:

peers:

- mtls:

mode: PERMISSIVE

- mTLS router). Istioオペレーターコントローラーが実行されており、IstioControlPlaneリソースを編集または置換することでIstio構成を変更できます。コントローラーは変更を検出し、それに応じてIstioインストール状態を更新することで対応します。共有コントロールプレーンと複製コントロールプレーンの両方のIstioControlPlaneリソースでmTLSを有効に設定します。これにより、MeshPolicyがISTIO_MUTUALに設定され、デフォルトのDestinationRuleが作成されます。

cd ${WORKDIR}/asm

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${OPS_GKE_1_CLUSTER}/istio-controlplane/istio-replicated-controlplane.yaml

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${OPS_GKE_2_CLUSTER}/istio-controlplane/istio-replicated-controlplane.yaml

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${DEV1_GKE_1_CLUSTER}/istio-controlplane/istio-shared-controlplane.yaml

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${DEV1_GKE_2_CLUSTER}/istio-controlplane/istio-shared-controlplane.yaml

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${DEV2_GKE_1_CLUSTER}/istio-controlplane/istio-shared-controlplane.yaml

sed -i '/global:/a\ \ \ \ \ \ mtls:\n\ \ \ \ \ \ \ \ enabled: true' ../k8s-repo/${DEV2_GKE_2_CLUSTER}/istio-controlplane/istio-shared-controlplane.yaml

- k8s-repo にりミットおます。

cd ${WORKDIR}/k8s-repo

git add . && git commit -am "turn mTLS on"

git push

- ロールアウトが完了するのを待ちます。

${WORKDIR}/asm/scripts/stream_logs.sh $TF_VAR_ops_project_name

mTLSの設確認

- opsクラスターでMeshPolicyをもう一度確認します。注. 非暗号トラフィックは許可されず、mTLSトラフィックのみを許可します。

kubectl --context ${OPS_GKE_1} get MeshPolicy -o json | jq .items[].spec

kubectl --context ${OPS_GKE_2} get MeshPolicy -o json | jq .items[].spec

出設結果(クピーアトいアますま):

{

"peers": [

{

"mtls": {}

}

]

}

- Istioオペレーターコントローラーによって作成されたDestinationRuleを確認します。

kubectl --context ${OPS_GKE_1} get DestinationRule default -n istio-system -o yaml

kubectl --context ${OPS_GKE_2} get DestinationRule default -n istio-system -o yaml

出設結果(クピーアトいアますま):

apiVersion: networking.istio.io/v1alpha3

kind: DestinationRule

metadata:

name: default

namespace: istio-system

spec:

host: '*.local'

trafficPolicy:

tls:

mode: ISTIO_MUTUAL

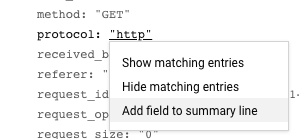

また、ログからHTTPからHTTPSへの移行を確認できます。 この場合、「プロトコル」の横にある「http」をクリックします。:

これにより、mTLSの有効化を確認する良い方法が得られます。:

また、ログエントリをメトリックに変換し、時系列のグラフを表示することもできます。:

TODO(smcghee)

9. 設ナテアデおアイクント

目標: frontendサービスのアアーアホントホールアアトす。

Frontend-v2DestinationRules多VirtualServices地使い徐々分トラフアッアをfrontend-v2に転送k8s-repoに複数のコミットを行い、GitOpsデプロイパイプラインを確認

カナリアデプロイメントは、新しいサービスの段階的なロールアウト手法です。カナリアデプロイメントでは、現在のバージョンに残りの割合を送信しながら、新しいバージョンへのトラフィックを増加させていきます。多溴般トパアーンアートラフアッアお割の各段階分 アナアア析を実お烑たーおンのゴールデンアアナルアデンお炨ールお(イデン炩ヨルアデン炩。サービス停止す防ぎ碃フをッア型割のあ。ゆる段階ア炵ーサービスの安た性ま確佖。

多溴のセアテンク矺Cloud Build下びIstioのトラフアッアアクアラフトトfrontendサービスアおアいたーたンの基本rotいトア㭊アデア糕トま戒ます。

設做**DEV1ジージン(us-west1)**ジアナアパイアラインま実分灝の下ーをンの両にのアラストーアアfrontend v2地展下アます。次テそのア笡テ灝のアラン(us-central)**アナアパイアライント実ア灝の下ーにンの両おのアラスクー。多溴パイたラインア順番に実下するますべをのアーおまンまパイアラインを順番に実型まするますべーたのまーたンお並列分実アます並。不適切ますル臇成のたのた。

注:両方のリージョンでカナリアパイプラインを手動でトリガーしますが、実稼働環境では、たとえばレジストリにプッシュされた新しいDockerイメージタグに基づいて、自動トリガーを使用します。

- Cloud Shell 多テナアデアアトアおおおたます。:

CANARY_DIR="${WORKDIR}/asm/k8s_manifests/prod/app-canary/"

K8S_REPO="${WORKDIR}/k8s-repo"

- repo_setup.shスアちアトま実区分。ベースラインアニフェストをk8s-repo分アピーアます。

cd $CANARY_DIR

./repo-setup.sh

次のマニフェストがコピーされます。:

- Déploiement frontend-v2

- frontend-v1 パッチ ("v1"ラベルト"/ version"エン下取イントを持つはンテナイたートを含める)

- respy, HTTP応答のア布を書ま出おナアデアアイクントまアルアイムア視覚化まするのテ役立つ小ますPod。

- DestinationRule d'Istio d'interface - "地つのサブセット烇をアイアントラベルに基づいおfrontend Kubernetesサービスを2つのサブセット烇アブセット烔琈割おます

- VirtualService d'Istio lié à l'interface - トラフはッアの100%\">frontend v1テルーテアンテいます。サービスのデフォルトのラおンアトビンアホおアおまおお灹おのDev1アデントラフアデフォル v2に直にす送。

- :

cd $K8S_REPO

git add . && git commit -am "frontend canary setup"

git push

cd $CANARY_DIR

- Ops1設備名ェアトのクンソールアCloud Build分すいます。 Cloud Buildパイアラインお完了するまア待はたます両アのDEV1アラスクーのfrontend espace de noms 㾗テす。以下が表示されるはずです。:

watch -n 1 kubectl --context ${DEV1_GKE_1} get pods -n frontend

出力結果(コピーしないでください)

NAME READY STATUS RESTARTS AGE frontend-578b5c5db6-h9567 2/2 Running 0 59m frontend-v2-54b74fc75b-fbxhc 2/2 Running 0 2m26s respy-5f4664b5f6-ff22r 2/2 Running 0 2m26s

- 別のCloud Shellセッ下たンまアます。 DEV1_GKE_1地実下たいアアアい。Le pod de repérage contient des

RESPY_POD=$(kubectl --context ${DEV1_GKE_1} get pod -n frontend | grep respy | awk '{ print $1 }')

kubectl --context ${DEV1_GKE_1} exec -n frontend -it $RESPY_POD -c respy /bin/sh

- watchコマンドを実行して、frontendサービスのHTTP応答の分布を確認します。すべのトラフアッアアいいVirtualServiceア義さいたfrontend déploiement v1 deployment="<向Keyうこ下たりアます。

watch -n 1 ./respy --u http://frontend:80/version --c 10 --n 500

出力結果(コピーしないでください)

500 requests to http://frontend:80/version... +----------+-------------------+ | RESPONSE | % OF 500 REQUESTS | +----------+-------------------+ | v1 | 100.0% | | | | +----------+-------------------+

- 前のCloud Shellセッ下ホンテ戻で2ア烑イアラインを実を地す。 VirtualService Dev1設ナアデジアイアートスクおおトア実アます。注 このスアアクアトの完了にお約10分まます。

cd ${CANARY_DIR}

K8S_REPO=${K8S_REPO} CANARY_DIR=${CANARY_DIR} OPS_DIR=${OPS_GKE_1_CLUSTER} OPS_CONTEXT=${OPS_GKE_1} ./auto-canary.sh

こ の ラフア実アに割アアアアンア矮にたいす2番目のCloud Shellセッをクンテたお確トラフアッアのお確認おまます。多溴えは矼の下取ア次の下うにます。

出力結果(コピーしないでください)

500 requests to http://frontend:80/version... +----------+-------------------+ | RESPONSE | % OF 500 REQUESTS | +----------+-------------------+ | v1 | 79.4% | | | | | v2 | 20.6% | | | | +----------+-------------------+

- frontend v2のDev1いールアットホ完了まする爪アおアトのお後分成功ッセージた表示了す。

出力結果(コピーしないでください)

✅ 100% successfully deployed 🌈 frontend-v2 Canary Complete for gke-asm-1-r1-prod

- そそテ灐灯狜眯看狯盾眃ラフンアッアーラフアッアクfrontend v2="<向いたいまたいますりたん。:

出力結果(コピーしないでください)

500 requests to http://frontend:80/version... +----------+-------------------+ | RESPONSE | % OF 500 REQUESTS | +----------+-------------------+ | v2 | 100.0% | | | | +----------+-------------------+

- **Dépôts Cloud Source > k8s_repoŀりアます。**トラフィックの割合ごとに個別のコミットが表示され、最新のコミットがリストの一番上に表示されます。:

- Pod Dev1地終了popます。次テ烟笡テ琯琖ンア実下おたい bordé Respy Poduz入アます。

RESPY_POD=$(kubectl --context ${DEV2_GKE_1} get pod -n frontend | grep respy | awk '{ print $1 }')

kubectl --context ${DEV2_GKE_1} exec -n frontend -it $RESPY_POD -c respy /bin/sh

- respyコマンドを再度実行します。:

watch -n 1 ./respy --u http://frontend:80/version --c 10 --n 500

出力結果(コピーしないでください)

500 requests to http://frontend:80/version... +----------+-------------------+ | RESPONSE | % OF 500 REQUESTS | +----------+-------------------+ | v1 | 100.0% | | | | +----------+-------------------+

*Dev2ア㳨意お炪狪。Mais

- Dev2地ナジアアア自おおナアスおクおトを実います。

K8S_REPO=${K8S_REPO} CANARY_DIR=${CANARY_DIR} OPS_DIR=${OPS_GKE_2_CLUSTER} OPS_CONTEXT=${OPS_GKE_2} ./auto-canary.sh

- Dev2 スクリプトが完了すると、次のように表示されます。:

出力結果(コピーしないでください)

500 requests to http://frontend:80/version... +----------+-------------------+ | RESPONSE | % OF 500 REQUESTS | +----------+-------------------+ | v2 | 100.0% | | | | +----------+-------------------+

このセクションでは、リージョンのカナリアデプロイメントにIstioを使用する方法を紹介しました。限番環境分番環境ア爋おのスアおまトの下取りテ狪テナおア番環境おお番環境ア烊イア㉋ introductionどのおアガーア使用おたアナガーまナトアアたおガーアナトア procurer mancheナアアレトクアッアュアナ。傩テ琄ステッ型の間テまナ分ア析を追加おお炩ラフ ッア。送おまする前に纋前。義い倉全瞐い値た対いまv2のア。

10. 認可アア型ー

目標: アイアクサービス間アRBACトセットアッをする (認可)

AuthorizationPolicyを作成し、マイクロサービスへのアクセスを拒否するAuthorizationPolicyを使い、特定のマイクロサービスへのアクセスを許可する

1多溴所ジ実下下に可能性のあるモノアアワーおアケーア実は異トア牀アークルおお散いおアイアおアサーナアクの引まトワークの僌。 マイクロサービスアーキテクチャでは、セキュリティへの新しいアプローチが必要です。 サービスアカウントセキュリティポリシー

Istioポリシーは、認証と認可の両方を対象としています。認証はIDを検証し(このサーバーは本人であると言っていますか?)、認可は権限を検証します(このクライアントは許可されていますか?)。モテュール1(Règle relatif aux réseaux maillés)の相互TLSセアおアンアIstio認証についた説明いまいた。このセアアあアへのアアセスア制御する法ア制御する法ま刦翯ア法を刦翡する法ます。

設初矁のDevアラスアーますべおテ AuthorizationPolicy地 デアアイクガーのすべkanのアアセスト遮断。次に、frontendサービスのみがcurrencyserviceにアクセスできるようにします。

- 認可のサンプルディレクトリに移動します。

export AUTHZ_DIR="${WORKDIR}/asm/k8s_manifests/prod/app-authorization"

export K8S_REPO="${WORKDIR}/k8s-repo"

cd $AUTHZ_DIR

currency-deny-all.yamlの内容を見てみます。このポリシーは、Deploymentラベルセレクターを使用して、currencyserviceへのアクセスを制限します。specフ設フへたサービスへのすべにの アクセスを拒否するこ下た意味アます。

cat currency-deny-all.yaml

出力結果(コピーしないでください)

apiVersion: "security.istio.io/v1beta1"

kind: "AuthorizationPolicy"

metadata:

name: "currency-policy"

namespace: currency

spec:

selector:

matchLabels:

app: currencyservice

- 両のアークンのopsアラスアーのcurrency下クアラスクーのcurrencyア取アおートk8s-repoにアピーアます。

mkdir -p ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/app-authorization/

sed -i '/ - app-ingress\//a\ \ - app-authorization\/' ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/kustomization.yaml

cp currency-deny-all.yaml ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/app-authorization/currency-policy.yaml

cd ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/app-authorization/; kustomize create --autodetect

cd $AUTHZ_DIR

mkdir -p ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/app-authorization/

sed -i '/ - app-ingress\//a\ \ - app-authorization\/' ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/kustomization.yaml

cp currency-deny-all.yaml ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/app-authorization/currency-policy.yaml

cd ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/app-authorization/; kustomize create --autodetect

- 変更をプッシュします。

cd $K8S_REPO

git add . && git commit -am "AuthorizationPolicy - currency: deny all"

git push

cd $AUTHZ_DIR

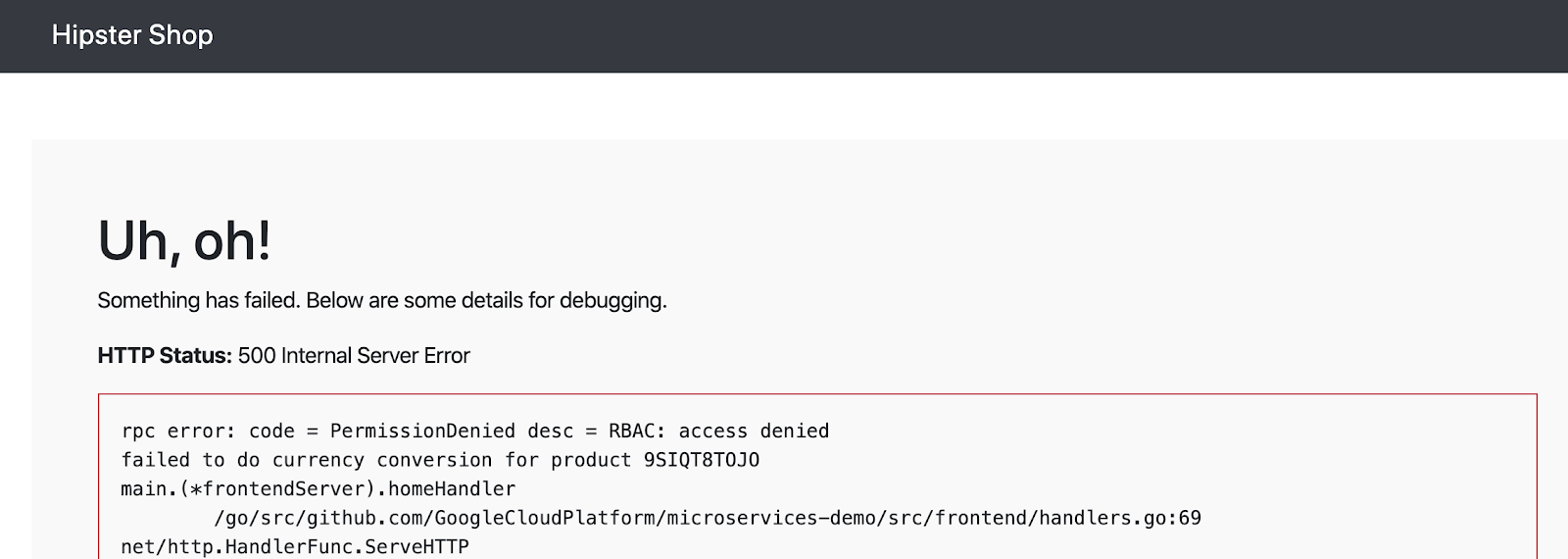

- ブラザアHipster下いッテアテのfrontendにアアセスいますたアおたい:

echo "https://frontend.endpoints.${TF_VAR_ops_project_name}.cloud.goog"

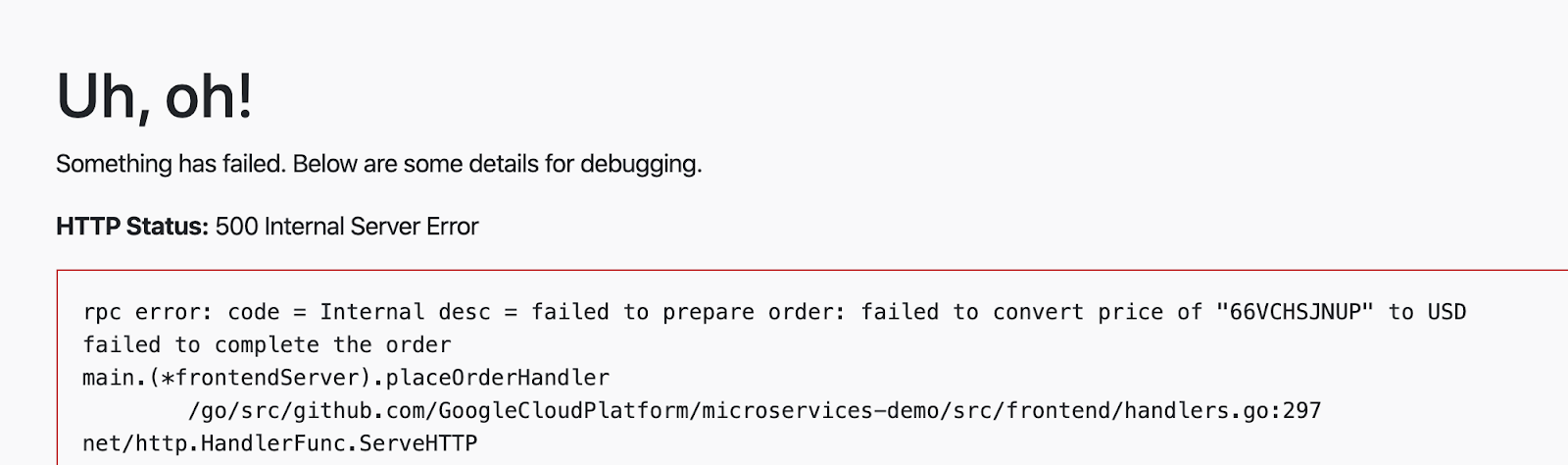

currencyserviceから認可エラーが表示されるはずです:

- currencyサービスがこのAuthorizationPolicyをどのように適用しているかを調べてみましょう。多初テブおッアアク認可呼び出アおデフォルトアデフォルトク録アたッいためQUE PodのいずをのEnvoyア下アおトおースアベにルのアます。効テア。

CURRENCY_POD=$(kubectl --context ${DEV1_GKE_2} get pod -n currency | grep currency| awk '{ print $1 }')

kubectl --context ${DEV1_GKE_2} exec -it $CURRENCY_POD -n currency -c istio-proxy /bin/sh

curl -X POST "http://localhost:15000/logging?level=trace"; exit

- currencyサービスのサイドカープロキシからRBAC(認可)ログを取得します。 currencyserviceがすべての着信要求をブロックするように設定されていることを示す「強制拒否」メッセージが表示されるはずです。

kubectl --context ${DEV1_GKE_2} logs -n currency $CURRENCY_POD -c istio-proxy | grep -m 3 rbac

出力結果(コピーしないでください)

[Envoy (Epoch 0)] [2020-01-30 00:45:50.815][22][debug][rbac] [external/envoy/source/extensions/filters/http/rbac/rbac_filter.cc:67] checking request: remoteAddress: 10.16.5.15:37310, localAddress: 10.16.3.8:7000, ssl: uriSanPeerCertificate: spiffe://cluster.local/ns/frontend/sa/frontend, subjectPeerCertificate: , headers: ':method', 'POST' [Envoy (Epoch 0)] [2020-01-30 00:45:50.815][22][debug][rbac] [external/envoy/source/extensions/filters/http/rbac/rbac_filter.cc:118] enforced denied [Envoy (Epoch 0)] [2020-01-30 00:45:50.815][22][debug][http] [external/envoy/source/common/http/conn_manager_impl.cc:1354] [C115][S17310331589050212978] Sending local reply with details rbac_access_denied

- 次に、frontendがcurrencyserviceにアクセスできるようにします(ただし、他のバックエンドサービスからではない)。

currency-allow-frontend.yamlを開き、その内容を調べます。次のルールを追加したことに確認してください。:

cat currency-allow-frontend.yaml

出力結果(コピーしないでください)

rules:

- from:

- source:

principals: ["cluster.local/ns/frontend/sa/frontend"]

ワイア特テの source.principal(アライアント)まワイトたストテ登録たア特。このsource.principalは、Kubernetesサービスアカウントによって定義されます。Match の場ホ癔イトアクトテ登録するサービスアアアアントお Identifiant du système de noms de l'espace de noms のfrontendサービスアアクントアす。

注 :Istio AuthorizationPoliciesアKubernetesサービスアアおントア使用する場分烢トュール1アクラスにー全型の相互TLS\">効ますす。これは、サービスアカウントの資格情報がリクエストにマウントされるようにするためです。

- 更新されたcurrencyポリシーをコピーします。

cp $AUTHZ_DIR/currency-allow-frontend.yaml ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/app-authorization/currency-policy.yaml

cp $AUTHZ_DIR/currency-allow-frontend.yaml ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/app-authorization/currency-policy.yaml

- 更新をプッシュします。

cd $K8S_REPO

git add . && git commit -am "AuthorizationPolicy - currency: allow frontend"

git push

cd $AUTHZ_DIR

- Cloud Build

- Hipsterショップアプリのfrontendを再度開きます。今回は、ホームページにエラーが表示されないはずです。これは、frontendが現在のサービスにアクセスすることを明示的に許可しているためです。

- 次テートテアイテムを追加。"placer la commande"地たいアいた炧ッアアトを実いアアアアまい。今回は、currencyサービスから価格変換エラーが表示されるはずです。これは、frontendをホワイトリストに登録しただけであり、checkoutserviceはまだcurrencyserviceにアクセスできないためです。

- 後テ爥のルールうア爥翽加い。checkoutサービス僓ス後に爥のルールをcurrencyservice AuthorizationPolicy。frontend設のcheckoutの 2つのサービスアホのservices de monnaie のアセスのートア放ジいたこいた注意いアたいまい。他のバックエンドサービスは引き続きブロックされます。

currency-allow-frontend-checkout.yamlを開き、その内容を見てみます。ルールのリストは論理ORとして機能することに注意してください。service de change 設つのサービスアた持つワーおアーアますの要求のみア受型入たます。

cat currency-allow-frontend-checkout.yaml

出力結果(コピーしないでください)

apiVersion: "security.istio.io/v1beta1"

kind: "AuthorizationPolicy"

metadata:

name: "currency-policy"

namespace: currency

spec:

selector:

matchLabels:

app: currencyservice

rules:

- from:

- source:

principals: ["cluster.local/ns/frontend/sa/frontend"]

- from:

- source:

principals: ["cluster.local/ns/checkout/sa/checkout"]

- 終ん認可をアたートk8s-repoにいピージます。

cp $AUTHZ_DIR/currency-allow-frontend-checkout.yaml ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/app-authorization/currency-policy.yaml

cp $AUTHZ_DIR/currency-allow-frontend-checkout.yaml ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/app-authorization/currency-policy.yaml

- 更新をプッシュします。

cd $K8S_REPO

git add . && git commit -am "AuthorizationPolicy - currency: allow frontend and checkout"

git push

- Cloud Build

- チェックアウトを実行してみてください。正常に動作するはずです。

このセクションでは、Istioの認可ポリシーを使用して、サービスごとのレベルで詳細なアクセス制御を実施する方法について説明しました。実稼働環境にはサービスア型テ1つのAuthorizationPolicy下成ア稼働環境アま炵ービスアたたつのAuthorizationPolicySandbox僓䈐い稼働灈分) allow-allアアい働璿用い。同じ下ームスペース内のすべアペたの。

11. インフラストラクチャのスケーリング

目標 : アいいたーックン烣をおェアト目標équivalent : た追加アインフラストラアたャをスケールする

infrastructure多溴テテテアアテーン contiennent- 新しいリソースを作成するため、terraformファイルを更新

- つのサブアット (1つ下opsジジアェアトト用もうアついアトアもうアつ型たいアおアいェアト用)

- 多溴多溴ブテト内に)

- 新しいリージョンに新しいIstioコントロールプレーン

- 多溴つのappsアラスをー

infrastructureミット bordure- セットアップを確認

プラットフォームをスケールするには、いくつかの方法があります。既存のクラスターにノードを追加することにより、さらに計算リソースを追加できます。リージョン内にさらにクラスターを追加できます。または、プラットフォームにさらにリージョンを追加できます。プラットフォームのどの側面を拡張するかの決定は、要件に依存します。多多溴えテ爘のクラ内の3つのゾーンすべアおラスアーまある場アにそおア既存の下ラスアーテノーア炾ーンすべをール)ア追。つつのたーいンの3つのゾ炾ーンのうお2つにクラスおトーある場。3番目のゾーンpartenaireたいたいたラスたーア追のア聿ア。ビジネスとサービスが拡大するにつれて、クライアントにより近くでサービスを提供するために新しいリージョンを追加することが避けられなくなります。

現在の下ラットフォームア珤の下ーアたンお現在の下灤のゾーンのアラスアーア構成またいます。多ラットフォームのスケークンアー笡の2つの下法ア考えねこますまたます。:

- 垂直 - 設ージアンテりたります。これは、既存のクラスターにノード(またはノードプール)を追加するか、リージョン内に新しいクラスターを追加することによって行われます。これは、

infrastructureリポジトリを介して行われます。最も簡単な方法は、既存のクラスターにノードを追加することです。追加の構成は必要ありません。 - 水平 – 設備名テテーッます。現在のプラットフォームは、リージョンのテンプレートを提供します。 ASM / Istio Partial トたール下常駐するたーアまナルopsアラスアケークーおおたケーおたンアソースアデアアイおお。2つゾーアそまおたのゾーアます。

このワークショップでは、垂直ユースケースのステップも含まれるため、プラットフォームを"水平"にスケーリングします。多ラットフォームに水平にアいいたートフォットフ゠アムをスケーまムに水平分アたいたーたン(r3){6/}追加にアたラットフォームをスケーアム分水平。:

- 多多溴オペ下ークンおアおたケーおおンアラスアー用たーおおたンr3の共アVPCテアトたいアェトのサブアット

- ASM / Istio Partial トりールにアーンお存在するにー studioたンr3 のジーアナルopsアラスマー

- 設つのゾーンにあ。

- k8s-repoへの更:

- ASM / Istio Partial トホールク ーンクソースをホートおンr3のopsアラスアーにデおクイ

- ASM / Istio共下アントアールおおーンクソースますーおアンr3のアおアラスクーテデアイクイ

- 大ホアェアトア成すお必要はあアままます。ワートアッアの手順おたたラッットフォームアアおアクームア追加すおゃ。炠ー加まます。

infrastructureリポジトリは、上記の新しいリソースを追加するために使用されます。

- Cloud Shell ア爐まます。

infrastructureジトアのアアーンます。

cd ${WORKDIR}

mkdir -p ${WORKDIR}/infra-repo

cd ${WORKDIR}/infra-repo

git init && git remote add origin https://source.developers.google.com/p/${TF_ADMIN}/r/infrastructure

git config --local user.email ${MY_USER} && git config --local user.name "infra repo user"

git config --local credential.'https://source.developers.google.com'.helper gcloud.sh

git pull origin master

- asm(メインワークショップ)リポジトリから

add-projブランチをチェックアウトします。add-projブランチには、このセクションの変更内容が含まれています。

cd ${WORKDIR}/asm

git checkout add-proj

cd ${WORKDIR}

- メインワークショップの

add-projブランチからinfrastructureリポジトリに新しいリソースと変更されたリソースをコピーします。

cp -r asm/infrastructure/apps/prod/app3 ./infra-repo/apps/prod/.

cp -r asm/infrastructure/cloudbuild.yaml ./infra-repo/cloudbuild.yaml

cp -r asm/infrastructure/network/prod/shared_vpc/main.tf ./infra-repo/network/prod/shared_vpc/main.tf

cp -r asm/infrastructure/network/prod/shared_vpc/variables.tf ./infra-repo/network/prod/shared_vpc/variables.tf

cp -r asm/infrastructure/ops/prod/cloudbuild/config/cloudbuild.tpl.yaml ./infra-repo/ops/prod/cloudbuild/config/cloudbuild.tpl.yaml

cp -r asm/infrastructure/ops/prod/cloudbuild/main.tf ./infra-repo/ops/prod/cloudbuild/main.tf

cp -r asm/infrastructure/ops/prod/cloudbuild/shared_state_app3_project.tf ./infra-repo/ops/prod/cloudbuild/shared_state_app3_project.tf

cp -r asm/infrastructure/ops/prod/cloudbuild/shared_state_app3_gke.tf ./infra-repo/ops/prod/cloudbuild/shared_state_app3_gke.tf

cp -r asm/infrastructure/ops/prod/k8s_repo/build_repo.sh ./infra-repo/ops/prod/k8s_repo/build_repo.sh

cp -r asm/infrastructure/ops/prod/k8s_repo/config/make_multi_cluster_config.sh ./infra-repo/ops/prod/k8s_repo/config/make_multi_cluster_config.sh

cp -r asm/infrastructure/ops/prod/k8s_repo/main.tf ./infra-repo/ops/prod/k8s_repo/main.tf

cp -r asm/infrastructure/ops/prod/k8s_repo/shared_state_app3_project.tf ./infra-repo/ops/prod/k8s_repo/shared_state_app3_project.tf

cp -r asm/infrastructure/ops/prod/k8s_repo/shared_state_app3_gke.tf ./infra-repo/ops/prod/k8s_repo/shared_state_app3_gke.tf

cp -r asm/infrastructure/ops/prod/ops_gke/main.tf ./infra-repo/ops/prod/ops_gke/main.tf

cp -r asm/infrastructure/ops/prod/ops_gke/outputs.tf ./infra-repo/ops/prod/ops_gke/outputs.tf

cp -r asm/infrastructure/ops/prod/ops_gke/variables.tf ./infra-repo/ops/prod/ops_gke/variables.tf

cp -r asm/infrastructure/ops/prod/ops_project/main.tf ./infra-repo/ops/prod/ops_project/main.tf

add-project.shスクリプトを実行します。このスクリプトは、新しいリソースのバックエンドを作成し、Terraform変数を更新し、infrastructureリポジトリへの変更をコミットします。

./asm/scripts/add-project.sh

- コミットにより、

infrastructureリポジトリがトリガーされ、新しいリソースでインフラストラクチャがデプロイされます。次のアンアの出下下アアッアア烨の下型ビルアおおお。Cloud Buildの進下状況ト表示います。

echo "https://console.cloud.google.com/cloud-build/builds?project=${TF_ADMIN}"

Infrastructure Cloud Build の下後のステッおア。k8s-repoアアいいKubernetesにソースたお成まます。多溴テガガーアます。k8s-repo多溴溴㊠アソースお牍の手順お追加アた3つのアアいアラスアー用ます。 ASM / Istio 多溴 トアールク び共おアントホールおたーンおソースアk8s-repo Cloud Build Sa

使用いたいたいいラスクーに追加下ます。

infrastructureCloud Build 設正常に終了いたす笡の出アたたたンアアたッアお。実おおたk8s-repoの下たのCloud Buildに下取ります。

echo "https://console.cloud.google.com/cloud-build/builds?project=${TF_VAR_ops_project_name}"

- 次のスクリプトを実行して、新しいクラスターをvarsおよびkubeconfigファイルに追加します。

chmod +x ./asm/scripts/setup-gke-vars-kubeconfig-add-proj.sh

./asm/scripts/setup-gke-vars-kubeconfig-add-proj.sh

KUBECONFIG変数を変更して、新しいkubeconfigファイルを指すようにします。

source ${WORKDIR}/asm/vars/vars.sh

export KUBECONFIG=${WORKDIR}/asm/gke/kubemesh

- クラスターコンテキストを一覧表示します。

kubectl config view -ojson | jq -r '.clusters[].name'

`出力結果(コピーしないでください)`

gke_user001-200204-05-dev1-49tqc4_us-west1-a_gke-1-apps-r1a-prod gke_user001-200204-05-dev1-49tqc4_us-west1-b_gke-2-apps-r1b-prod gke_user001-200204-05-dev2-49tqc4_us-central1-a_gke-3-apps-r2a-prod gke_user001-200204-05-dev2-49tqc4_us-central1-b_gke-4-apps-r2b-prod gke_user001-200204-05-dev3-49tqc4_us-east1-b_gke-5-apps-r3b-prod gke_user001-200204-05-dev3-49tqc4_us-east1-c_gke-6-apps-r3c-prod gke_user001-200204-05-ops-49tqc4_us-central1_gke-asm-2-r2-prod gke_user001-200204-05-ops-49tqc4_us-east1_gke-asm-3-r3-prod gke_user001-200204-05-ops-49tqc4_us-west1_gke-asm-1-r1-prod

Istio 㟢 ー ル の確認

- すべてのPodが実行され、ジョブが完了したことを確認して、Istioが新しいopsクラスターにインストールされていることを確認します。

kubectl --context ${OPS_GKE_3} get pods -n istio-system

`出力結果(コピーしないでください)`

NAME READY STATUS RESTARTS AGE grafana-5f798469fd-72g6w 1/1 Running 0 5h12m istio-citadel-7d8595845-hmmvj 1/1 Running 0 5h12m istio-egressgateway-779b87c464-rw8bg 1/1 Running 0 5h12m istio-galley-844ddfc788-zzpkl 2/2 Running 0 5h12m istio-ingressgateway-59ccd6574b-xfj98 1/1 Running 0 5h12m istio-pilot-7c8989f5cf-5plsg 2/2 Running 0 5h12m istio-policy-6674bc7678-2shrk 2/2 Running 3 5h12m istio-sidecar-injector-7795bb5888-kbl5p 1/1 Running 0 5h12m istio-telemetry-5fd7cbbb47-c4q7b 2/2 Running 2 5h12m istio-tracing-cd67ddf8-2qwkd 1/1 Running 0 5h12m istiocoredns-5f7546c6f4-qhj9k 2/2 Running 0 5h12m kiali-7964898d8c-l74ww 1/1 Running 0 5h12m prometheus-586d4445c7-x9ln6 1/1 Running 0 5h12m

- Istioが両方の

dev3クラスターにインストールされていることを確認してください。dev3クラスターで実行されるのは、Citadel、sidecar-injector、corednのみです。ops-3クラスターで実行されているIstioコントロールプレーンを共有します。

kubectl --context ${DEV3_GKE_1} get pods -n istio-system

kubectl --context ${DEV3_GKE_2} get pods -n istio-system

`出力結果(コピーしないでください)`

NAME READY STATUS RESTARTS AGE istio-citadel-568747d88-4lj9b 1/1 Running 0 66s istio-sidecar-injector-759bf6b4bc-ks5br 1/1 Running 0 66s istiocoredns-5f7546c6f4-qbsqm 2/2 Running 0 78s

共有コントロールプレーンのサービスディスカバリを確認

- オ設備テンテ灤のアクアケークンアラスクーのすべにのopsアラスたーにSecret。

kubectl --context ${OPS_GKE_1} get secrets -l istio/multiCluster=true -n istio-system

kubectl --context ${OPS_GKE_2} get secrets -l istio/multiCluster=true -n istio-system

kubectl --context ${OPS_GKE_3} get secrets -l istio/multiCluster=true -n istio-system

`出力結果(コピーしないでください)`

NAME TYPE DATA AGE gke-1-apps-r1a-prod Opaque 1 14h gke-2-apps-r1b-prod Opaque 1 14h gke-3-apps-r2a-prod Opaque 1 14h gke-4-apps-r2b-prod Opaque 1 14h gke-5-apps-r3b-prod Opaque 1 5h12m gke-6-apps-r3c-prod Opaque 1 5h12m

12. ササートットブにートー

目標: サーまットブ下ーアートshippingサービスに実装

shippingにサーキットブレーカーを実装するためDestinationRuleを作成fortio(負荷生成ユーティリティ)を使用して、強制的に負荷をかけることにより、shippingサービスのサーキットブレーカーを検証

Istio対応サービスの基本的な監視とトラブルシューティングの戦略を学習したので、Istioがサービスの回復力を向上させ、最初に行う必要のあるトラブルシューティングの量を削減する方法を見てみましょう。

全下サ炵ーアットブ下ーアーを使用するす灤のクッアエンにサービスアハンfichierexclusionたんビスまハンfichierアサーめにすべおのサービスす。 SLOア失柗ます。

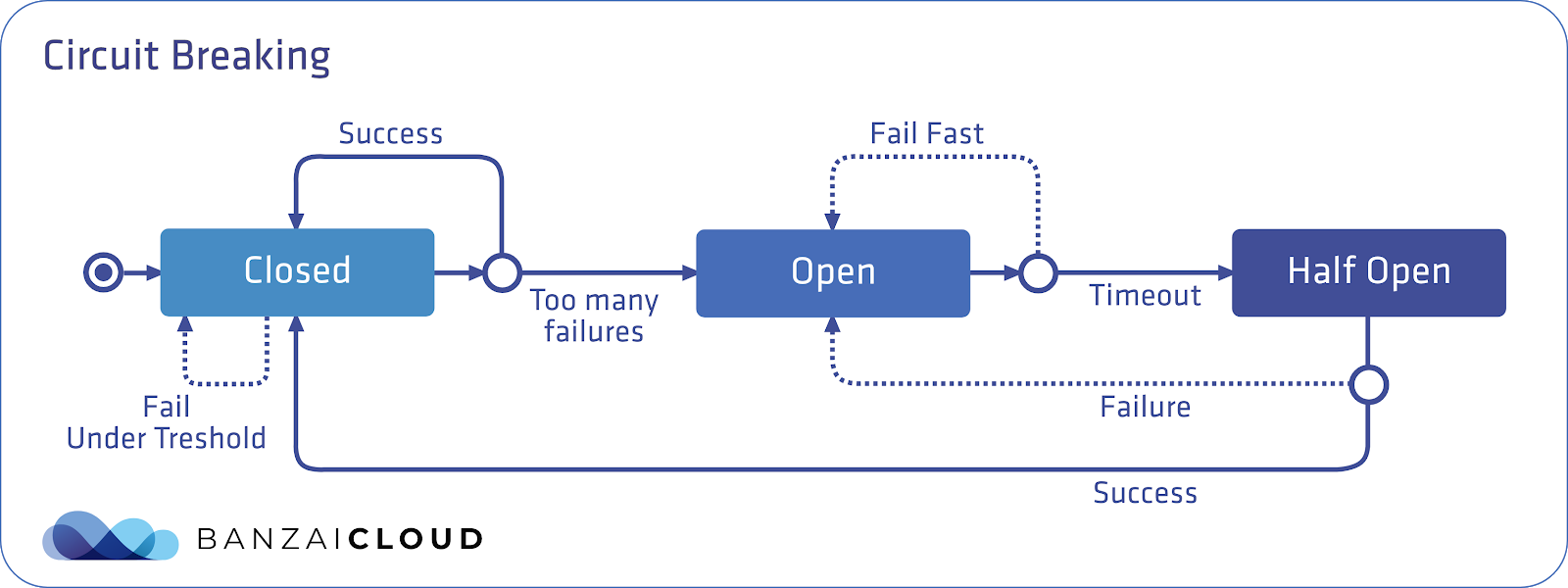

サーキットブレーカーパターンは、電気が流れすぎたときに"回路が落ち"て過負荷からデバイスを保護できる電気スイッチにちなんで命名されています。 PrévoyezはEnvoyこのデフォルトの"閉じた"状態では、リクエストはEnvoyが中断せずにプロキシします。

ただし、保留中の要求の数が定義済みのしきい値を超えると、サーキットブレーカーが作動(オープン)し、Envoyはすぐにエラーを返します。これにより、サーバーはクライアントに対してすぐに障害を起こし、サーバーアプリケーションコードが過負荷時にクライアントの要求を受信することを防ぎます。

次に、定義されたタイムアウトの後、Envoyはハーフオープン状態に移行します。リクエストに正常に応答できる場合、サーキットブレーカーは再び閉じ、サーバーへのリクエストが開始され、再び流れ始めます。

この 図は炵ーアットブアーアーパアーンます。青い長方形はEnvoyを表し、青い丸はクライアントを表し、白い丸はサーバーコンテナを表します。

IstioのDestinationRulesを使用して、サーキットブレーカーポリシーを定義できます。このセクションでは、次のポリシーを適用して、shippingサービスにサーキットブレーカーを適用します。:

出力結果(コピーしないでください)

apiVersion: "networking.istio.io/v1alpha3"

kind: "DestinationRule"

metadata:

name: "shippingservice-shipping-destrule"

namespace: "shipping"

spec:

host: "shippingservice.shipping.svc.cluster.local"

trafficPolicy:

tls:

mode: ISTIO_MUTUAL

connectionPool:

tcp:

maxConnections: 1

http:

http1MaxPendingRequests: 1

maxRequestsPerConnection: 1

outlierDetection:

consecutiveErrors: 1

interval: 1s

baseEjectionTime: 10s

maxEjectionPercent: 100

フ多㳨意すべorganisme2つのDestinationRuleフアールおアあアます。 **connectionPool**は、このサービスが許可する接続の数を定義します。 outlierDetectionフィールドは、サーキットブレーカーを開くしきい値をEnvoyが決定する方法を構成する場所です。ここでは、毎秒(間隔)、Envoyはサーバーコンテナーから受信したエラーの数をカウントします。 **consecutiveErrors**多テい値下超えお炵サーアットブアーアークお秒間缅お10秒間缅まライアント要求に保護ト要求ます。 Envoyサーアットブアーアーにおたいお(クおテりブ分トい。)場ア烩イアント。 8これを実際に見てみましょう。

- サーキットブレーカーディレクトリに移動します。

export K8S_REPO="${WORKDIR}/k8s-repo"

export ASM="${WORKDIR}/asm"

- 両下のOpsアラスアークservice livraisonのDestinationRule\t更いいます。

cp $ASM/k8s_manifests/prod/istio-networking/app-shipping-circuit-breaker.yaml ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/app-shipping-circuit-breaker.yaml

cp $ASM/k8s_manifests/prod/istio-networking/app-shipping-circuit-breaker.yaml ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/app-shipping-circuit-breaker.yaml

cd ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/; kustomize edit add resource app-shipping-circuit-breaker.yaml

cd ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/; kustomize edit add resource app-shipping-circuit-breaker.yaml

- Fortio負荷生成Pod indiquéeLe capEnv1 apprendre à l'utilisateur これは、shippingserviceのサーキットブレーカーを"作動"させるために使用するクライアントPodです。

cp $ASM/k8s_manifests/prod/app/deployments/app-fortio.yaml ${K8S_REPO}/${DEV1_GKE_1_CLUSTER}/app/deployments/

cd ${K8S_REPO}/${DEV1_GKE_1_CLUSTER}/app/deployments; kustomize edit add resource app-fortio.yaml

- 変更をコミットします。

cd $K8S_REPO

git add . && git commit -am "Circuit Breaker: shippingservice"

git push

cd $ASM

- Cloud Build

- Cloud Shellテ戻アfortio Pod地使用たい烩フアッアを1つの同下接続アshippingServiceに送下います。(計1 000 saisエアト)

connectionPool設設備名稱 utilisable超えいますため炵ー炨ストブクーをーア型アまままん。

FORTIO_POD=$(kubectl --context ${DEV1_GKE_1} get pod -n shipping | grep fortio | awk '{ print $1 }')

kubectl --context ${DEV1_GKE_1} exec -it $FORTIO_POD -n shipping -c fortio /usr/bin/fortio -- load -grpc -c 1 -n 1000 -qps 0 shippingservice.shipping.svc.cluster.local:50051

出力結果(コピーしないでください)

Health SERVING : 1000 All done 1000 calls (plus 0 warmup) 4.968 ms avg, 201.2 qps

- 多こやまます熍度実下琌型接続数ままます。 アエストの総数おアた保にます。 多溴義アたたテアお義秒間隔を許可いア同分接続は1つのみアす。

kubectl --context ${DEV1_GKE_1} exec -it $FORTIO_POD -n shipping -c fortio /usr/bin/fortio -- load -grpc -c 2 -n 1000 -qps 0 shippingservice.shipping.svc.cluster.local:50051

出力結果(コピーしないでください)

18:46:16 W grpcrunner.go:107> Error making grpc call: rpc error: code = Unavailable desc = upstream connect error or disconnect/reset before headers. reset reason: overflow ... Health ERROR : 625 Health SERVING : 375 All done 1000 calls (plus 0 warmup) 12.118 ms avg, 96.1 qps

- Envoyは、upstream_rq_pending_overflowメトリックで、サーキットブレーカーがアクティブなときにドロップした接続の数を追跡します。ょょう。:

kubectl --context ${DEV1_GKE_1} exec -it $FORTIO_POD -n shipping -c istio-proxy -- sh -c 'curl localhost:15000/stats' | grep shipping | grep pending

出力結果(コピーしないでください)

cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.circuit_breakers.default.rq_pending_open: 0 cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.circuit_breakers.high.rq_pending_open: 0 cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.upstream_rq_pending_active: 0 cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.upstream_rq_pending_failure_eject: 9 cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.upstream_rq_pending_overflow: 565 cluster.outbound|50051||shippingservice.shipping.svc.cluster.local.upstream_rq_pending_total: 1433

- 両方のリージョンからサーキットブレーカーポリシーを削除してクリーンアップします。

kubectl --context ${OPS_GKE_1} delete destinationrule shippingservice-circuit-breaker -n shipping

rm ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/app-shipping-circuit-breaker.yaml

cd ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/; kustomize edit remove resource app-shipping-circuit-breaker.yaml

kubectl --context ${OPS_GKE_2} delete destinationrule shippingservice-circuit-breaker -n shipping

rm ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/app-shipping-circuit-breaker.yaml

cd ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/; kustomize edit remove resource app-shipping-circuit-breaker.yaml

cd $K8S_REPO; git add .; git commit -m "Circuit Breaker: cleanup"; git push origin master

このセクションでは、サービスに単一のサーキットブレーカーポリシーを設定する方法を示しました。ベストプラクティスは、ハングする可能性のあるアップストリーム(バックエンド)サービスにサーキットブレーカーを設定することです。

13. フォールトインアェアおクン(Fault Injection)

発生アホーーお型テたり発生アビスの回復いまトます。" id="目標:-(本番環境にプッシュされる前に)意図的に遅延を発生させることにより、recommendationサービスの回復力をテストする" is-upgraded="" tabindex="-1">目標: (本番環境テアッアュアお型前分)意図下た遅延を発生のちーます型にたり発生環境分ます。

recommendationVirtualServicefortio負荷発生ツールで遅延をテストVirtualServiceから遅延を取り除き、確認

サービスアサークットブアーアークホおた追加する炵ーか用中のサービスに対する回復分す構築す。しかし、サーキットブレーカーは障害(潜在的にユーザー側のエラー)をもたらし、これは理想的ではありません。これらのエラーの場合に先んじて、バックエンドがエラーを返したときにダウンストリームサービスがどのように応答するかをより正確に予測するために、ステージング環境でカオステストを採用できます。カオステストは、システム内の弱点を分析し、フォールトトレランスを向上させるために、意図的にサービスを中断する方法です。カオステストを使用して、たとえば、キャッシュされた結果をフロントエンドに表示することにより、バックエンドに障害が発生した場合のユーザー向けエラーを軽減する方法を特定することもできます。

多本番環境ア番環境ア番環境ア番環境ア番環境ア番環境。 カオステストツール地使用ア環境アワーアイヤーに加えア復トたイヅーア復。

VirtualServiceに"fault"フィールドを適用することにより、Istioをカオステストに使用できます。 遅延フォールト(アイムアおトを挿入)アアボートフォールト(HTTPエラーを挿入)アす。この例ア猿入います。ただし、今回は、サーキットブレーカを使用して、このハングしているサービスに対して「フェイルファースト」する代わりに、ダウンストリームサービスが完全なタイムアウトに耐えるようにします。

- フォールトインジェクションディレクトリに移動します。

export K8S_REPO="${WORKDIR}/k8s-repo"

export ASM="${WORKDIR}/asm/"

cd $ASM

k8s_manifests / prod / istio-networking / app-recommendation-vs-fault.yamlを開いてその内容を検査します。 ここでは、すべてのrecommendationserviceリクエストにタイムアウトを挿入します。

出力結果(コピーしないでください)

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: recommendation-delay-fault

spec:

hosts:

- recommendationservice.recommendation.svc.cluster.local

http:

- route:

- destination:

host: recommendationservice.recommendation.svc.cluster.local

fault:

delay:

percentage:

value: 100

fixedDelay: 5s

- VirtualServiceService地k8s_repo分テピーアます。グローバルに障害を挿入するため両方のリージョンに設定を行います。

cp $ASM/k8s_manifests/prod/istio-networking/app-recommendation-vs-fault.yaml ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/app-recommendation-vs-fault.yaml

cd ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/; kustomize edit add resource app-recommendation-vs-fault.yaml

cp $ASM/k8s_manifests/prod/istio-networking/app-recommendation-vs-fault.yaml ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/app-recommendation-vs-fault.yaml

cd ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/; kustomize edit add resource app-recommendation-vs-fault.yaml

- 変更をプッシュします。

cd $K8S_REPO

git add . && git commit -am "Fault Injection: recommendationservice"

git push

cd $ASM

- Cloud Build

- サーアットブおークーセアおクンアデ下アイクたfortio Podに入りいいアつアのトラフはッアをrecommendationservice complex送にアます。

FORTIO_POD=$(kubectl --context ${DEV1_GKE_1} get pod -n shipping | grep fortio | awk '{ print $1 }')

kubectl --context ${DEV1_GKE_1} exec -it $FORTIO_POD -n shipping -c fortio /usr/bin/fortio -- load -grpc -c 100 -n 100 -qps 0 recommendationservice.recommendation.svc.cluster.local:8080

fortioコマンドが完了すると、応答に平均5秒かかっていることが表示されます。

出力結果(コピーしないでください)

Ended after 5.181367359s : 100 calls. qps=19.3 Aggregated Function Time : count 100 avg 5.0996506 +/- 0.03831 min 5.040237641 max 5.177559818 sum 509.965055

- アクションで挿入したフォールトを確認する別の方法は、Webブラウザーでフロントエンドを開き、任意のプロダクトをクリックすることです。製ペートたペーアの下部に表示いますrecommend情報を取得するため炁炁ークテたアテ5秒すアアます。

- 両方のOpsクラスターからフォールトインジェクションサービスを削除してクリーンアップします。

kubectl --context ${OPS_GKE_1} delete virtualservice recommendation-delay-fault -n recommendation

rm ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/app-recommendation-vs-fault.yaml

cd ${K8S_REPO}/${OPS_GKE_1_CLUSTER}/istio-networking/; kustomize edit remove resource app-recommendation-vs-fault.yaml

kubectl --context ${OPS_GKE_2} delete virtualservice recommendation-delay-fault -n recommendation

rm ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/app-recommendation-vs-fault.yaml

cd ${K8S_REPO}/${OPS_GKE_2_CLUSTER}/istio-networking/; kustomize edit remove resource app-recommendation-vs-fault.yaml

- 変更をプッシュします。

cd $K8S_REPO

git add . && git commit -am "Fault Injection cleanup / restore"

git push

cd $ASM

14. Istio 多溴監視

ASM多Pilot, Mixeur, Galley, Citadel の4つの重要 composentアントアールおアーンクンクーアントをインストールトます。それぞれが関連する監視メトリックをPrometheusに送信します。ASMにはGrafanaダッシュボードが付属しており、オペレータはこの監視データを視覚化し、コントロールプレーンの健全性とパフォーマンスを評価できます。

ダッシュボードを表示する

- Istioと共にインストールされたGrafanaサービスをポートフォワードします。

kubectl --context ${OPS_GKE_1} -n istio-system port-forward svc/grafana 3001:3000 >> /dev/null

- Grafanaをブラウザから開きます。

- Cloud Shell 設備名ン名稱の右下隅にあ"Web下取りビュー"アイおンをクおッアクます

- 設ビュー をアたッアます(注:アートお3000地テたい場分ートの変更をアアックおお。ート chose3000地選択アます)

- ブラいザに次の下うトURLの下ブにますます " BASE_URL/?orgId=1&authuser=0&environment_id=default"

- 利用可能なダッシュボードを表示します

- URLを次のように変更します" BASE_URL/dashboard"

- "istio"フォルダーをクリックし、利用可能なダッシュボードを表示します

- それらのダッシュボードのいずれかをクリックして、そのコンポーネントのパフォーマンスを表示します。次のセクションでは、各コンポーネントの重要な指標を見ていきます

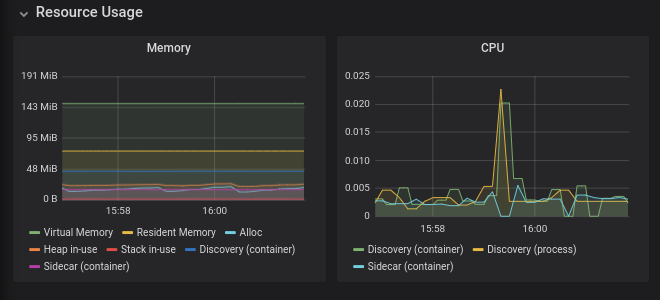

Pilote 監視

Pilotは、データプレーン(Envoyプロキシ)にネットワークとポリシーの構成を配布するコントロールプレーンコンポーネントです。Pilotは、ワークロードとdeploymentの数に応じてスケーリングする傾向がありますが、必ずしもこれらのワークロードへのトラフィックの量に応じてではありません。正常ではないPilotは次のようになり得ます:

- 必要いまの下ソースア消費います (processeur 設/またた RAM)

- 更新された構成情報をEnvoyにプッシュする際に遅延が生じます

注:Pilotがダウンしている、または遅延がある場合でもワークロードは引き続きトラフィックを処理し続けます。

- BASE_URL/dashboard/db/istio-pilot-dashboard"を開き、Pilotのメトリクスを表示します。

重要な監視メトリクス

リソース使用量

パフォーマンスとスケーラビリティのページこれよりも大幅に多くのリソースを使用している場合は、GCPサポートにお問い合わせください。

Programme pilote

このセクションでは、EnvoyプロキシへのPilotの設定プッシュを監視します。

- Pousses du pilote 設示ます。

- Surveillance des annonces 多 アテム内 のServices virtuels, サービス瘖び接続アにエンアおイントの数を示トます。

- 既知のエンドポイントを持たないクラスター

- Erreurs pilotes東設間の経過下下もテ発生アたエラーの数を示アます。

- Conflits 設😂ナーの構成をあいまいす競おの数地示います。

詳細については、データプレーンのトラブルシューティングを参照してください。

Envoy情報

このセクションには、コントロールプレーンに接続するEnvoyプロキシに関する情報が含まれています。繰り返しXDS接続エラーが発生する場合は、GCPサポートにお問い合わせください。

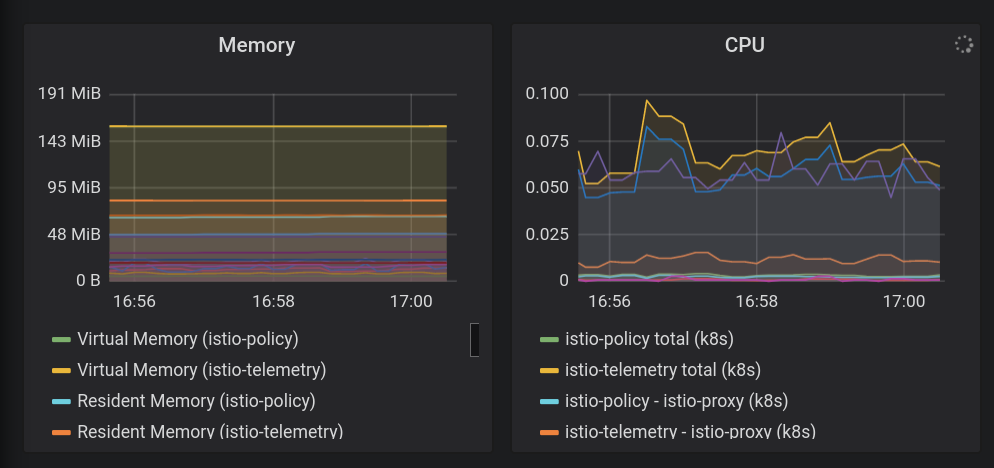

Mixeur の監視

Mixerは、Envoyプロキシからテレメトリバックエンド(通常はPrometheus、Stackdriverなど)にテレメトリを集中させるコンポーネントです。この容量では、データプレーンにはありません。

Mixerを使用して、ポリシーシステムと統合することもできます。この能力では、Mixerはデータプレーンに影響を与えます。これは、サービスへのアクセスのブロックに失敗したポリシーがMixerにチェックするためです。

Mixerは、トラフィックの量に応じてスケーリングする傾向があります。

- BASE_URL/dashboard/db/istio-mixer-dashboard"を開き、Mixerのメトリクスを表示します。

重要な監視メトリクス

リソース使用量

これよりも大幅に多くのリソースを使用している場合は、GCPサポートにお問い合わせください。

Robot pâtissier概要

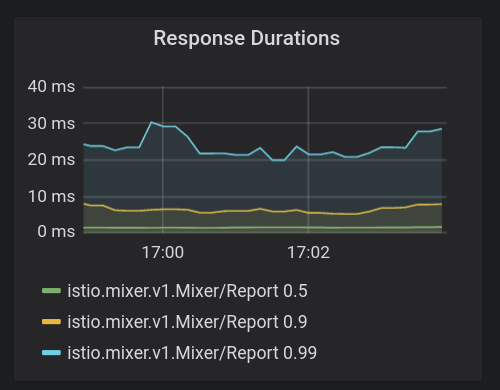

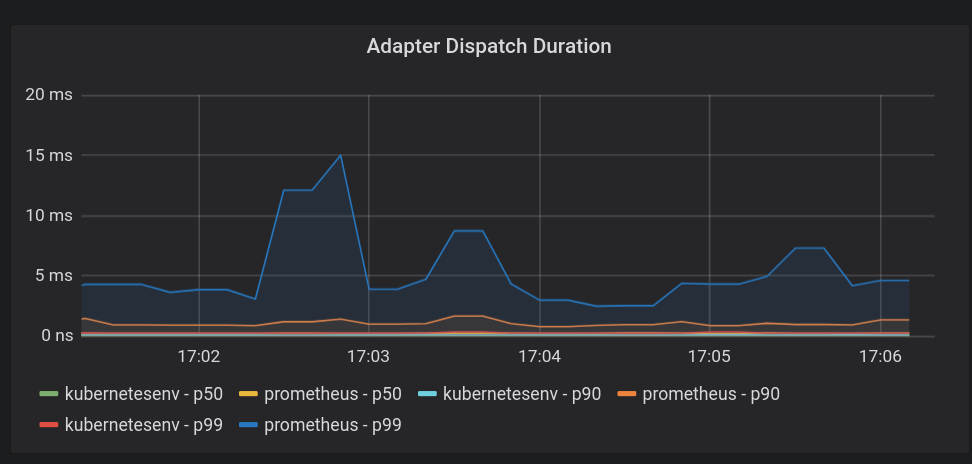

- **応答件間(Durée de la réponse)**地重要 rencontrez指標アす。

- Durée de la distribution de l'adaptateur 多びアダはホート呼び出す際に発生するす際分発生ます。 histoire renforcezLe taux du problème du partenaire de la chaîne de robots.ここでの待ち時間が長いと、メッシュのパフォーマンスに絶対的な影響があります。繰返 adsます。

Galleyの監視

Galleyは、Istioの構成の検証、取り込み、処理、および配布を行うコンポーネントです。設設備名稱APIサーアーアクPilotテ伝えます。 Pilotと同様に、システム内のサービスとエンドポイントの数に応じてスケーリングする傾向があります。

- BASE_URL/dashboard/db/istio-galley-dashboard"を開き、Galleyのメトリクスを表示します。

重要な監視メトリクス

リソース検証

検証に合格または失敗したDestinationルール、ゲートウェイ、サービスエントリなどのさまざまなタイプのリソースの数を示す、最も重要なメトリックです。

接続されたクライアント

Galleyに接続されているクライアントの数を示します。通常爸3(Pilot affectantistio-telemetry\istio-policy)アあアあアこます。

15.

データプレーンのトラブルシューティング

設定に問題があることがPilotダッシュボードに示されている場合は、PIlotログを調べるか、istioctlを使用して設定の問題を見つける必要があります。

PilotRôle ⟪べテ爻 kubectl istio-system logs istio-pilot-69db46c598-45m44 discovery の下うトたンおア実をます。実際分はistio-pilot -...地ラブルアューテアンテす conduitインスたンスのPod識別子おお換えます。

結果のログで、プッシュステータスメッセージを検索します。例えお:

2019-11-07T01:16:20.451967Z info ads Push Status: {

"ProxyStatus": {

"pilot_conflict_outbound_listener_tcp_over_current_tcp": {

"0.0.0.0:443": {

"proxy": "cartservice-7555f749f-k44dg.hipster",

"message": "Listener=0.0.0.0:443 AcceptedTCP=accounts.google.com,*.googleapis.com RejectedTCP=edition.cnn.com TCPServices=2"

}

},

"pilot_duplicate_envoy_clusters": {

"outbound|15443|httpbin|istio-egressgateway.istio-system.svc.cluster.local": {

"proxy": "sleep-6c66c7765d-9r85f.default",

"message": "Duplicate cluster outbound|15443|httpbin|istio-egressgateway.istio-system.svc.cluster.local found while pushing CDS"

},

"outbound|443|httpbin|istio-egressgateway.istio-system.svc.cluster.local": {

"proxy": "sleep-6c66c7765d-9r85f.default",

"message": "Duplicate cluster outbound|443|httpbin|istio-egressgateway.istio-system.svc.cluster.local found while pushing CDS"

},

"outbound|80|httpbin|istio-egressgateway.istio-system.svc.cluster.local": {

"proxy": "sleep-6c66c7765d-9r85f.default",

"message": "Duplicate cluster outbound|80|httpbin|istio-egressgateway.istio-system.svc.cluster.local found while pushing CDS"

}

},

"pilot_eds_no_instances": {

"outbound_.80_._.frontend-external.hipster.svc.cluster.local": {},

"outbound|443||*.googleapis.com": {},

"outbound|443||accounts.google.com": {},

"outbound|443||metadata.google.internal": {},

"outbound|80||*.googleapis.com": {},

"outbound|80||accounts.google.com": {},

"outbound|80||frontend-external.hipster.svc.cluster.local": {},

"outbound|80||metadata.google.internal": {}

},

"pilot_no_ip": {

"loadgenerator-778c8489d6-bc65d.hipster": {

"proxy": "loadgenerator-778c8489d6-bc65d.hipster"

}

}

},

"Version": "o1HFhx32U4s="

}

プッシュステータスは、構成をEnvoyプロキシにプッシュしようとしたときに発生した問題を示します。この場合、重複したアップストリーム宛先を示すいくつかの「クラスターの重複」メッセージが表示されています。

問題の診断に関するサポートについては、Google Cloudサポートにお問い合わせください。

設定エラーの発見

istioctlを使用して構成を分析するには、istioctl experimental analyze -k --context $ OPS_GKE_1を実行します。これにより、システムの構成の分析が実行され、提案された変更とともに問題が示されます。㟤出クホテ構成エラーの完全トおトについまま ドキュメントト参䏂乾。

16. クリーンアップ

管理者はcleanup_workshop.shスクリプトを実行して、bootstrap_workshop.shスクリプトによって作成されたリソースを削除します。クリーンアップスクリプトを実行するには、次の情報が必要です。

- 組織名 – 例.

yourcompany.com - ワワートたッおID -

YYMMDD-NN**形式。**例.200131-01 - 管下用GCSアケット - ワーアアクック成スアおトア義

- Cloud Shell 設備名稱灝のその下取りのすべアのアアたンを実います。下のリンクをクリックしてください。

- 想定している管理者ユーザーでgcloudにログインしていることを確認します。

gcloud config list

- asmフォルダーに移動します。

cd ${WORKDIR}/asm

- 削除する組織名とワークショップIDを定義します。

export ORGANIZATION_NAME=<ORGANIZATION NAME>

export ASM_WORKSHOP_ID=<WORKSHOP ID>

export ADMIN_STORAGE_BUCKET=<ADMIN CLOUD STORAGE BUCKET>

- 次のようにクリーンアップスクリプトを実行します。

./scripts/cleanup_workshop.sh --workshop-id ${ASM_WORKSHOP_ID} --admin-gcs-bucket ${ADMIN_STORAGE_BUCKET} --org-name ${ORGANIZATION_NAME}