1. 개요

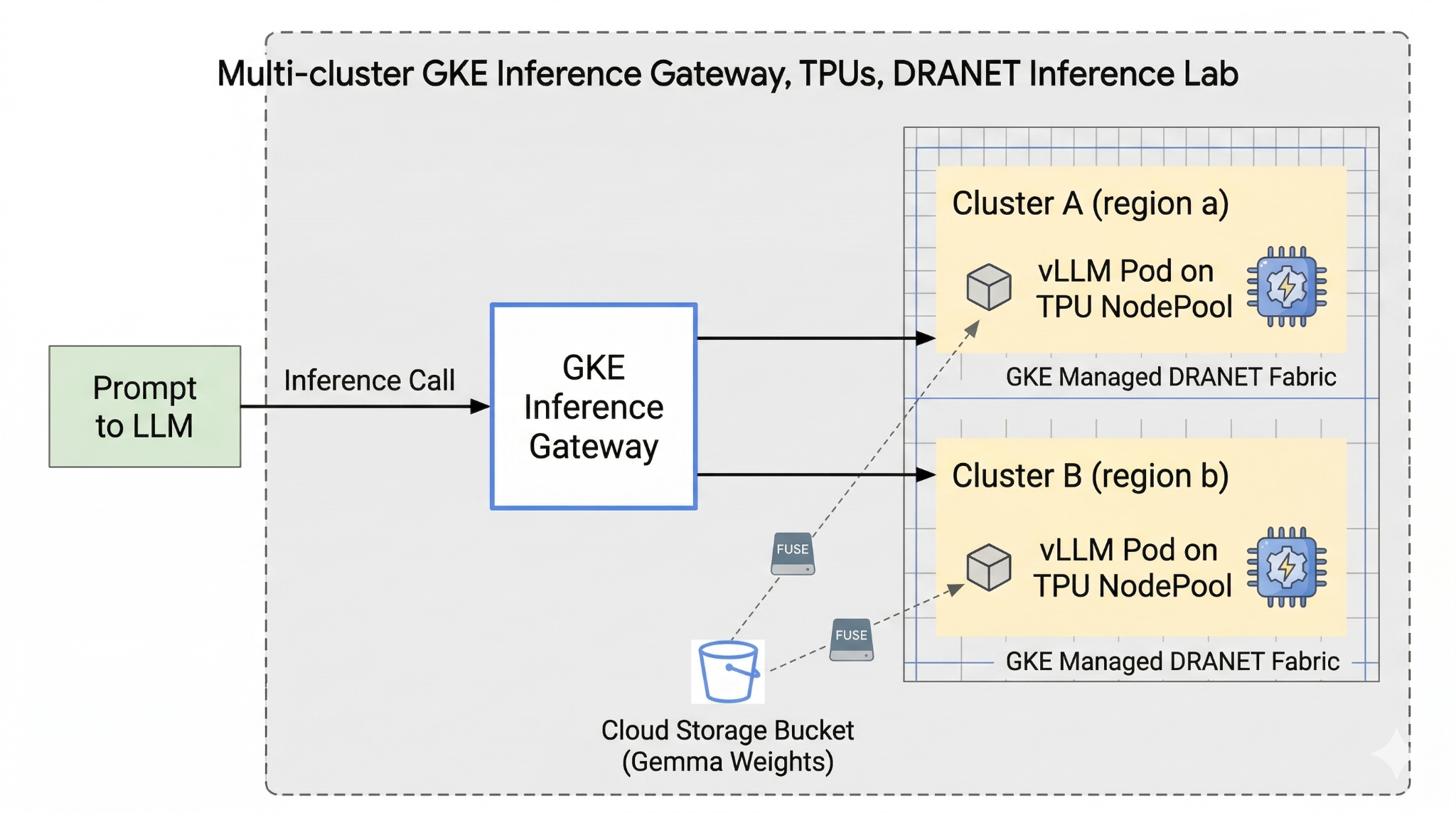

이 실습에서는 AI 워크로드를 실행하는 데 사용할 수 있는 AI 인프라를 소개합니다. 다음과 같은 항목을 사용하게 됩니다.

Google Kubernetes Engine (GKE) - 기본 컨테이너 오케스트레이션 플랫폼입니다.

GKE 관리 DRANET - 고속 상호 연결 패브릭을 TPU 포드에 직접 할당하는 동적 리소스 할당 네트워킹입니다.

GKE Inference Gateway - 추론에 맞게 조정된 Google Cloud의 관리형 게이트웨이 객체입니다. 이 경우 멀티 클러스터 기능을 사용합니다.

Tensor Processing Unit (TPU) - Google의 맞춤형 가속기 칩입니다.

Cloud Storage FUSE: 포드가 Cloud Storage 버킷을 직접 마운트하여 대규모 모델 가중치를 즉시 로드할 수 있도록 지원하는 스토리지 인터페이스입니다.

구성하려면 서로 다른 리전에 커스텀 VPC, Cloud Storage 버킷, 두 개의 클러스터를 배포해야 합니다. 각 클러스터에는 네트워킹을 위해 관리형 DRANET을 사용하는 TPU 노드 풀이 있습니다. Fleet에 클러스터를 추가한 후 버킷에 Gemma 모델 가중치를 캐시하고 Cloud Storage FUSE를 통해 이러한 가중치를 즉시 마운트하는 vLLM 워크로드를 배포합니다. 마지막으로 GKE Inference Gateway가 트래픽을 라우팅하도록 구성되므로 실시간 교차 리전 장애 조치 테스트를 실행할 수 있습니다.

구성에서는 Terraform, gcloud, kubectl를 조합하여 사용합니다.

이 실습에서는 다음 작업을 수행하는 방법을 알아봅니다.

- VPC, 네트워크, 스토리지 설정

- Standard 모드로 GKE 클러스터 설정

- TPU 노드 풀을 만들고 관리형 DRANET 사용

- Fleet에 클러스터 추가

- 모델 가중치 캐시

- 멀티 클러스터 GKE Inference Gateway 설정 및 장애 조치 테스트

이 실습에서는 다음 패턴을 만듭니다.

그림 1.

2. Google Cloud 서비스 설정

자습형 환경 설정

- Google Cloud Console에 로그인하여 새 프로젝트를 만들거나 기존 프로젝트를 재사용합니다. 아직 Gmail이나 Google Workspace 계정이 없는 경우 계정을 만들어야 합니다.

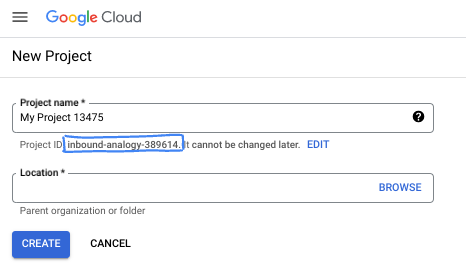

- 프로젝트 이름은 이 프로젝트 참가자의 표시 이름입니다. 이는 Google API에서 사용하지 않는 문자열이며 언제든지 업데이트할 수 있습니다.

- 프로젝트 ID는 모든 Google Cloud 프로젝트에서 고유하며, 변경할 수 없습니다(설정된 후에는 변경할 수 없음). Cloud 콘솔은 고유한 문자열을 자동으로 생성합니다. 일반적으로는 신경 쓰지 않아도 됩니다. 대부분의 Codelab에서는 프로젝트 ID (일반적으로

PROJECT_ID로 식별됨)를 참조해야 합니다. 생성된 ID가 마음에 들지 않으면 다른 임의 ID를 생성할 수 있습니다. 또는 직접 시도해 보고 사용 가능한지 확인할 수도 있습니다. 이 단계 이후에는 변경할 수 없으며 프로젝트 기간 동안 유지됩니다. - 참고로 세 번째 값은 일부 API에서 사용하는 프로젝트 번호입니다. 이 세 가지 값에 대한 자세한 내용은 문서를 참고하세요.

- 다음으로 Cloud 리소스/API를 사용하려면 Cloud 콘솔에서 결제를 사용 설정해야 합니다. 이 Codelab 실행에는 많은 비용이 들지 않습니다. 이 튜토리얼이 끝난 후에 요금이 청구되지 않도록 리소스를 종료하려면 만든 리소스 또는 프로젝트를 삭제하면 됩니다. Google Cloud 신규 사용자는 300달러(USD) 상당의 무료 체험판 프로그램에 참여할 수 있습니다.

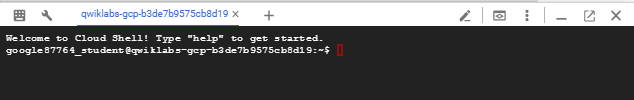

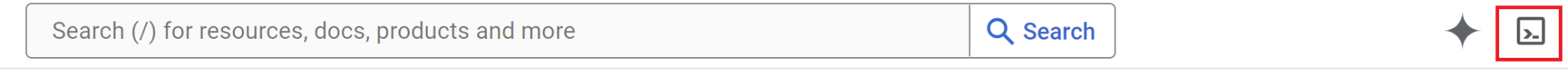

Cloud Shell 시작

Google Cloud를 노트북에서 원격으로 실행할 수 있지만, 이 Codelab에서는 Cloud에서 실행되는 명령줄 환경인 Google Cloud Shell을 사용합니다.

Google Cloud Console의 오른쪽 상단 툴바에 있는 Cloud Shell 아이콘을 클릭합니다.

환경을 프로비저닝하고 연결하는 데 몇 분 정도 소요됩니다. 완료되면 다음과 같이 표시됩니다.

가상 머신에는 필요한 개발 도구가 모두 들어있습니다. 영구적인 5GB 홈 디렉터리를 제공하고 Google Cloud에서 실행되므로 네트워크 성능과 인증이 크게 개선됩니다. 이 Codelab의 모든 작업은 브라우저 내에서 수행할 수 있습니다. 아무것도 설치할 필요가 없습니다.

3. Terraform으로 환경 설정

이 실습을 수행하려면 TPU에 액세스할 수 있어야 합니다. 사용된 정확한 버전은 TPU v6e입니다.

- 액세스 권한을 얻으려면 TPU 계획 문서를 따르고 TPU 할당량을 사용 설정해야 합니다.

- 4개의 TPU v6e 칩이 필요한 소규모 배포를 사용하고 있습니다 (

ct6e-standard-4t)). 이는 서로 다른 두 리전의 2x2 슬라이스입니다. - Hugging Face 토큰: Gemma 모델 가중치를 다운로드하려면 액세스 토큰이 필요합니다.

방화벽 규칙, 스토리지, 서브넷이 있는 커스텀 VPC를 만듭니다. Cloud 콘솔을 열고 사용할 프로젝트를 선택합니다.

- 콘솔 오른쪽 상단에 있는 Cloud Shell을 열고 Cloud Shell에 올바른 프로젝트 ID가 표시되는지 확인하고 액세스를 허용하라는 메시지가 표시되면 확인합니다.

gke-tf라는 폴더를 만들고 해당 폴더로 이동합니다.

mkdir -p gke-tf && cd gke-tf

PROJECT_ID=$(gcloud config get-value project)

- 이제 구성 파일을 추가합니다. 그러면 network.tf , variable.tf, providers.tf, fuse.tf 파일이 생성됩니다.

cat <<EOF > terraform.tfvars

project_id = "${PROJECT_ID}"

EOF

cat <<EOF > variables.tf

variable "project_id" { type = string }

variable "network_prefix" { default = "tpu-gke-dranet" }

variable "regions" { default = ["europe-west4", "us-east5"] }

variable "region_to_tpu_zone" {

default = {

"europe-west4" = "europe-west4-a"

"us-east5" = "us-east5-b"

}

}

EOF

cat <<EOF > providers.tf

terraform {

required_version = ">= 1.5.7"

required_providers {

google-beta = { source = "hashicorp/google-beta", version = "~> 7.0" }

time = { source = "hashicorp/time", version = "~> 0.11.0" }

}

}

provider "google-beta" { project = var.project_id }

resource "google_project_service" "base_apis" {

for_each = toset([

"compute.googleapis.com",

"container.googleapis.com",

"cloudresourcemanager.googleapis.com",

"storage.googleapis.com"

])

project = var.project_id

service = each.value

disable_on_destroy = false

}

EOF

cat <<EOF > network.tf

resource "google_compute_network" "vpc" {

name = "\${var.network_prefix}-vpc"

auto_create_subnetworks = false

mtu = 8896

depends_on = [google_project_service.base_apis]

}

resource "google_compute_subnetwork" "subnets" {

for_each = toset(var.regions)

name = "\${var.network_prefix}-node-subnet"

region = each.value

network = google_compute_network.vpc.id

ip_cidr_range = each.value == "europe-west4" ? "10.0.1.0/24" : "10.0.2.0/24"

}

resource "google_compute_subnetwork" "proxy_subnets" {

for_each = toset(var.regions)

name = "\${var.network_prefix}-proxy-subnet-\${each.value}"

region = each.value

network = google_compute_network.vpc.id

ip_cidr_range = each.value == "europe-west4" ? "10.1.1.0/24" : "10.1.2.0/24"

purpose = "GLOBAL_MANAGED_PROXY"

role = "ACTIVE"

}

resource "google_compute_address" "gateway_ips" {

for_each = toset(var.regions)

name = "gemma-gateway-ip-\${each.value}"

region = each.value

subnetwork = google_compute_subnetwork.subnets[each.value].id

address_type = "INTERNAL"

}

resource "google_compute_firewall" "allow_internal" {

name = "\${var.network_prefix}-allow-internal"

network = google_compute_network.vpc.name

allow { protocol = "all" }

source_ranges = ["10.0.0.0/8", "10.1.0.0/16"]

}

resource "google_compute_firewall" "allow_health_checks" {

name = "\${var.network_prefix}-allow-hc"

network = google_compute_network.vpc.name

allow {

protocol = "tcp"

ports = ["8000"]

}

source_ranges = ["130.211.0.0/22", "35.191.0.0/16"]

}

EOF

cat <<EOF > fuse.tf

resource "google_storage_bucket" "model_bucket" {

name = "\${var.project_id}-gemma-weights"

location = "US"

force_destroy = true

uniform_bucket_level_access = true

depends_on = [google_project_service.base_apis]

}

resource "google_service_account" "gcs_fuse_sa" {

account_id = "gcs-fuse-sa"

display_name = "Service Account for GCS FUSE"

}

resource "google_storage_bucket_iam_member" "gcs_fuse_sa_admin" {

bucket = google_storage_bucket.model_bucket.name

role = "roles/storage.objectAdmin"

member = "serviceAccount:\${google_service_account.gcs_fuse_sa.email}"

}

resource "google_project_iam_binding" "workload_identity_binding" {

project = var.project_id

role = "roles/iam.workloadIdentityUser"

members = ["serviceAccount:\${var.project_id}.svc.id.goog[default/gemma-ksa]"]

}

EOF

variable.tf 파일은 프로젝트 이름, 리전, 영역 정보를 추가합니다. 참고로 TPU 할당량이 있는 리전으로 변수 'regions' default = ["europe-west4", "us-east5"]를 업데이트하세요. 자세한 내용은 'GKE에서 TPU 가용성 확인' 문서를 참고하세요.

network.tf는 서로 다른 두 영역의 서브넷, 프록시 전용 서브넷, 방화벽 규칙이 있는 새 VPC를 프로젝트에 추가합니다.

provider.tf은 Terraform을 지원하기 위해 관련 제공자를 추가합니다.

fuse.tf는 모델 가중치를 캐시하기 위해 Cloud Storage 버킷을 추가하고 objectAdmin 권한으로 IAM 서비스 계정을 프로비저닝합니다. 이 계정을 GKE 워크로드 아이덴티티에 바인딩합니다.

- gke-tf 디렉터리에 있는지 확인하고 다음 명령어를 실행합니다.

terraform init -작업 디렉터리를 초기화합니다. 이 단계에서는 지정된 구성에 필요한 제공자를 다운로드합니다.terraform plan -인프라를 배포하기 위해 Terraform에서 취할 조치를 보여주는 실행 계획을 생성합니다.terraform apply –auto-approve가 업데이트를 실행하고 자동으로 승인합니다.

terraform init

terraform plan

- 이제 배포를 실행합니다. (3~5분 정도 걸릴 수 있음)

terraform apply -auto-approve

- 동일한

gke-tf폴더에 다음 gke.tf 파일을 만듭니다.

cat <<EOF > gke.tf

resource "google_container_cluster" "clusters" {

provider = google-beta

for_each = toset(var.regions)

name = "gke-\${each.value}"

location = var.region_to_tpu_zone[each.value]

deletion_protection = false

network = google_compute_network.vpc.id

subnetwork = google_compute_subnetwork.subnets[each.value].id

release_channel { channel = "RAPID" }

datapath_provider = "ADVANCED_DATAPATH"

networking_mode = "VPC_NATIVE"

gateway_api_config { channel = "CHANNEL_STANDARD" }

ip_allocation_policy {

cluster_ipv4_cidr_block = ""

services_ipv4_cidr_block = ""

}

workload_identity_config { workload_pool = "\${var.project_id}.svc.id.goog" }

addons_config {

gcs_fuse_csi_driver_config { enabled = true }

}

initial_node_count = 1

node_config {

machine_type = "e2-standard-16"

oauth_scopes = ["https://www.googleapis.com/auth/cloud-platform"]

workload_metadata_config { mode = "GKE_METADATA" }

}

}

resource "google_container_node_pool" "tpu_pools" {

provider = google-beta

for_each = toset(var.regions)

name = "tpu-v6e-pool"

location = var.region_to_tpu_zone[each.value]

cluster = google_container_cluster.clusters[each.value].name

node_count = 1

network_config { accelerator_network_profile = "auto" }

node_config {

machine_type = "ct6e-standard-4t"

oauth_scopes = ["https://www.googleapis.com/auth/cloud-platform"]

labels = { "cloud.google.com/gke-networking-dra-driver" = "true" }

workload_metadata_config { mode = "GKE_METADATA" }

}

lifecycle { ignore_changes = [node_config[0].labels] }

}

EOF

gke.tf는 서로 다른 리전에 클러스터 두 개를 추가하고, 칩 4개로 TPU v6e를 실행하는 TPU 노드 풀 두 개를 만들어 관리형 DRANET을 노드 풀에 할당합니다.

- 이제 배포를 실행합니다. (10~15분 정도 걸릴 수 있음)

terraform apply -auto-approve

- 확인

echo -e "\n=== Verifying GKE Clusters ==="

gcloud container clusters list --filter="name:gke-europe-west4 OR name:gke-us-east5" --project=$PROJECT_ID

echo -e "\n=== Verifying VPC Network ==="

gcloud compute networks list --filter="name:tpu-gke-dranet-vpc" --project=$PROJECT_ID

echo -e "\n=== Verifying Reserved Static IPs for Gateway ==="

gcloud compute addresses list --filter="name~gemma-gateway-ip" --project=$PROJECT_ID

echo -e "\n=== Verifying GCS Bucket ==="

gcloud storage ls | grep "${PROJECT_ID}-gemma-weights"

echo -e "\n=== Verifying GCS FUSE Service Account ==="

gcloud iam service-accounts list --filter="email:gcs-fuse-sa@${PROJECT_ID}.iam.gserviceaccount.com" --project=$PROJECT_ID

4. Fleet 등록

클러스터를 Fleet에 등록해야 합니다.

gke-tf디렉터리에 있는지 확인하고 다음 명령어를 실행합니다.

cat <<EOF > fleet.tf

data "google_project" "project" {

project_id = var.project_id

}

resource "google_project_service" "fleet_apis" {

for_each = toset([

"gkehub.googleapis.com",

"multiclusterservicediscovery.googleapis.com",

"multiclusteringress.googleapis.com",

"trafficdirector.googleapis.com"

])

project = var.project_id

service = each.value

disable_on_destroy = false

}

resource "google_project_service_identity" "mci_sa" {

provider = google-beta

project = var.project_id

service = "multiclusteringress.googleapis.com"

depends_on = [google_project_service.fleet_apis]

}

resource "time_sleep" "wait_for_apis" {

create_duration = "60s"

depends_on = [google_project_service.fleet_apis]

}

resource "google_project_iam_member" "mci_sa_admin" {

project = var.project_id

role = "roles/container.admin"

member = "serviceAccount:\${google_project_service_identity.mci_sa.email}"

depends_on = [google_project_service_identity.mci_sa, time_sleep.wait_for_apis]

}

resource "google_gke_hub_membership" "memberships" {

provider = google-beta

for_each = toset(var.regions)

project = var.project_id

membership_id = "gke-\${each.value}"

endpoint {

gke_cluster { resource_link = "//container.googleapis.com/\${google_container_cluster.clusters[each.value].id}" }

}

depends_on = [time_sleep.wait_for_apis, google_container_cluster.clusters]

}

resource "google_gke_hub_feature" "mcs" {

provider = google-beta

name = "multiclusterservicediscovery"

location = "global"

project = var.project_id

depends_on = [time_sleep.wait_for_apis]

}

resource "google_gke_hub_feature" "ingress" {

provider = google-beta

name = "multiclusteringress"

location = "global"

project = var.project_id

depends_on = [google_gke_hub_membership.memberships, google_project_iam_member.mci_sa_admin]

spec {

multiclusteringress { config_membership = "projects/\${var.project_id}/locations/global/memberships/gke-us-east5" }

}

}

EOF

fleet.tf 파일은 두 클러스터를 전역 GKE Fleet에 등록하고 멀티 클러스터 서비스 검색 및 인그레스를 사용 설정합니다. 미국 클러스터를 중앙 구성 클러스터로 지정하여 게이트웨이 API가 트래픽을 모니터링하고 라우팅할 수 있도록 합니다.

gke-tf폴더에서 (3~5분 정도 걸림)을 실행합니다.

terraform plan

terraform apply -auto-approve

- Fleet 등록 유효성 검사

gcloud container fleet memberships list --project=$PROJECT_ID

5. 모델 가중치를 FUSE에 캐시

미국 클러스터에서 임시 Kubernetes 작업을 실행하여 Python 스크립트를 통해 Gemma 모델을 FUSE 마운트된 Cloud Storage 버킷에 직접 안전하게 다운로드합니다.

- 다음 변수를 만듭니다.

export CTX_EU="gke_${PROJECT_ID}_europe-west4-a_gke-europe-west4"

export CTX_US="gke_${PROJECT_ID}_us-east5-b_gke-us-east5"

- google/gemma-3-27b-it 모델을 사용하므로 HF 토큰을 생성해야 합니다. 아래의

YOUR_ACTUAL_HUGGING_FACE_TOKEN을 실제 토큰으로 바꿉니다.

export HF_TOKEN="YOUR_ACTUAL_HUGGING_FACE_TOKEN"

gke-tf디렉터리에 있는지 확인하고 다음 명령어를 실행합니다.

gcloud container clusters get-credentials gke-us-east5 --zone us-east5-b --project=$PROJECT_ID

cat <<EOF > ksa.yaml

apiVersion: v1

kind: ServiceAccount

metadata:

name: gemma-ksa

namespace: default

annotations:

iam.gke.io/gcp-service-account: "gcs-fuse-sa@${PROJECT_ID}.iam.gserviceaccount.com"

EOF

kubectl apply -f ksa.yaml --context=$CTX_US

kubectl delete secret hf-secret --context=$CTX_US --ignore-not-found

kubectl create secret generic hf-secret --from-literal=hf_token=${HF_TOKEN} --context=$CTX_US

cat <<EOF > download-job.yaml

apiVersion: batch/v1

kind: Job

metadata:

name: model-downloader

namespace: default

spec:

backoffLimit: 1

template:

metadata:

annotations:

gke-gcsfuse/volumes: "true"

spec:

serviceAccountName: gemma-ksa

restartPolicy: Never

containers:

- name: downloader

image: python:3.11-slim

env:

- name: HF_TOKEN

valueFrom:

secretKeyRef:

name: hf-secret

key: hf_token

command:

- bash

- -c

- |

pip install -U huggingface_hub

echo "Downloading Gemma 3 directly to GCS bucket..."

python3 -c "from huggingface_hub import snapshot_download; import os; snapshot_download(repo_id='google/gemma-3-27b-it', local_dir='/data/gemma-weights', token=os.environ['HF_TOKEN'])"

echo "Download complete! Safe to proceed."

volumeMounts:

- name: gcs-fuse-volume

mountPath: /data/gemma-weights

volumes:

- name: gcs-fuse-volume

csi:

driver: gcsfuse.csi.storage.gke.io

volumeAttributes:

bucketName: "${PROJECT_ID}-gemma-weights"

EOF

kubectl apply -f download-job.yaml --context=$CTX_US

- 다운로드가 완료될 때까지 기다린 후 계속 진행합니다(모델 크기에 따라 5~10분 소요).

kubectl logs -f job/model-downloader --context=$CTX_US

('다운로드 완료'라는 메시지가 표시되면 Ctrl+C를 눌러 로그를 종료합니다.)

6. 워크로드 vLLM 및 Gemma 배포

gke-tf디렉터리에 있는지 확인하고 다음 명령어를 실행합니다.

cat <<EOF > workload.yaml

apiVersion: v1

kind: ServiceAccount

metadata:

name: gemma-ksa

namespace: default

annotations:

iam.gke.io/gcp-service-account: "gcs-fuse-sa@${PROJECT_ID}.iam.gserviceaccount.com"

---

apiVersion: resource.k8s.io/v1

kind: ResourceClaimTemplate

metadata:

name: all-netdev

namespace: default

spec:

spec:

devices:

requests:

- name: req-netdev

exactly:

deviceClassName: netdev.google.com

allocationMode: All

---

apiVersion: apps/v1

kind: Deployment

metadata:

name: vllm-gemma

namespace: default

labels:

app: gemma-server

spec:

replicas: 1

selector:

matchLabels:

app: gemma-server

template:

metadata:

labels:

app: gemma-server

annotations:

gke-gcsfuse/volumes: "true"

spec:

serviceAccountName: gemma-ksa

nodeSelector:

cloud.google.com/gke-tpu-accelerator: tpu-v6e-slice

cloud.google.com/gke-tpu-topology: 2x2

resourceClaims:

- name: netdev

resourceClaimTemplateName: all-netdev

containers:

- name: vllm-tpu

image: vllm/vllm-tpu:latest

command:

- bash

- -c

- |

export PYTHONUNBUFFERED=1

echo "Booting vLLM instantly from local GCS FUSE mount..."

python3 -m vllm.entrypoints.openai.api_server \

--model /data/gemma-weights \

--tensor-parallel-size 4 \

--port 8000

ports:

- containerPort: 8000

resources:

requests:

google.com/tpu: 4

limits:

google.com/tpu: 4

claims:

- name: netdev

volumeMounts:

- name: dshm

mountPath: /dev/shm

- name: gcs-fuse-volume

mountPath: /data/gemma-weights

readOnly: true

volumes:

- name: dshm

emptyDir:

medium: Memory

- name: gcs-fuse-volume

csi:

driver: gcsfuse.csi.storage.gke.io

readOnly: true

volumeAttributes:

bucketName: "${PROJECT_ID}-gemma-weights"

mountOptions: "implicit-dirs"

fileCacheCapacity: "100Gi"

fileCacheForRangeRead: "true"

---

apiVersion: v1

kind: Service

metadata:

name: vllm-gemma-service

namespace: default

spec:

selector:

app: gemma-server

ports:

- protocol: TCP

port: 8000

targetPort: 8000

type: ClusterIP

---

apiVersion: monitoring.googleapis.com/v1

kind: PodMonitoring

metadata:

name: vllm-gemma-monitoring

namespace: default

spec:

selector:

matchLabels:

app: gemma-server

endpoints:

- port: 8000

interval: 15s

path: /metrics

EOF

- 이제 다음 스크립트를 실행합니다. 두 리전에 배포되므로 완료하는 데 5~10분이 걸립니다.

for CTX in $CTX_EU $CTX_US; do

ZONE=$(echo $CTX | cut -d_ -f3)

CLUSTER=$(echo $CTX | cut -d_ -f4)

gcloud container clusters get-credentials $CLUSTER --zone $ZONE --project=$PROJECT_ID

kubectl delete secret hf-secret --ignore-not-found --context=$CTX

kubectl create secret generic hf-secret --from-literal=hf_token=${HF_TOKEN} --context=$CTX

kubectl apply -f workload.yaml --context=$CTX

done

- 배포 확인

for CTX in $CTX_EU $CTX_US; do kubectl rollout status deployment/vllm-gemma --timeout=15m --context=$CTX; done

- 완료되면 다음을 실행하여 관리 DRANET 네트워킹이 포드에 할당되었는지 확인할 수 있습니다.

for CTX in $CTX_EU $CTX_US; do

echo "Checking DRA network interfaces on $CTX..."

kubectl --context=$CTX exec deployment/vllm-gemma -c vllm-tpu -- ls /sys/class/net

echo "----------------------------------------"

done

전용 TPU 패브릭을 나타내는 보조 인터페이스 eth1, eth2 등과 함께 표준 포드 네트워킹을 위한 추가 네트워크 인터페이스 eth0이 표시됩니다.

7. 추론 API 및 게이트웨이 구성

이제 InferenceObjective (gemma-objective), AutoscalingMetric (tpu-cache) 및 Inference Pool(gemma-pool)를 만듭니다. 추론 풀은 Helm 차트를 사용하여 생성됩니다. 생성된 항목을 설치하고 검증합니다.

gke-tf디렉터리에 있는지 확인하고 다음 명령어를 실행합니다. 이렇게 하면 객체가 배포되고 유효성 검사가 실행됩니다.

cat <<EOF > inference-objective.yaml

apiVersion: inference.networking.x-k8s.io/v1alpha2

kind: InferenceObjective

metadata:

name: gemma-objective

namespace: default

spec:

priority: 10

poolRef:

name: gemma-pool

group: "inference.networking.k8s.io"

EOF

cat <<EOF > metrics.yaml

apiVersion: autoscaling.gke.io/v1beta1

kind: AutoscalingMetric

metadata:

name: tpu-cache

namespace: default

spec:

selector:

matchLabels:

app: gemma-server

endpoints:

- port: 8000

path: /metrics

metrics:

- name: vllm:kv_cache_usage_perc

exportName: tpu-cache

EOF

for CTX in $CTX_EU $CTX_US; do

kubectl apply -f https://raw.githubusercontent.com/kubernetes-sigs/gateway-api-inference-extension/v1.1.0/config/crd/bases/inference.networking.x-k8s.io_inferenceobjectives.yaml --context=$CTX

kubectl apply -f inference-objective.yaml --context=$CTX

kubectl apply -f metrics.yaml --context=$CTX

done

helm install gemma-pool --kube-context $CTX_EU \

--set inferencePool.modelServers.matchLabels.app=gemma-server \

--set provider.name=gke \

--version v1.1.0 \

oci://registry.k8s.io/gateway-api-inference-extension/charts/inferencepool

helm install gemma-pool --kube-context $CTX_US \

--set inferencePool.modelServers.matchLabels.app=gemma-server \

--set provider.name=gke \

--set inferenceExtension.monitoring.gke.enabled=true \

--version v1.1.0 \

oci://registry.k8s.io/gateway-api-inference-extension/charts/inferencepool

for CTX in $CTX_EU $CTX_US; do

kubectl annotate inferencepool gemma-pool networking.gke.io/export="True" --context=$CTX

done

for CTX in $CTX_EU $CTX_US; do

echo "Verifying Inference API resources on $CTX..."

kubectl get inferencepools --context=$CTX

kubectl get autoscalingmetrics tpu-cache --context=$CTX

done

8. 게이트웨이 구성

이제 교차 리전 게이트웨이 구성을 만듭니다. Gateway(cross-region-gateway), HTTPRoute (gemma-route), HealthCheckPolicy(gemma-health-check)and GCPBackendPolicy(gemma-backend-policy. 추론 풀은 Helm 차트를 사용하여 생성됩니다. 생성된 항목을 설치하고 검증합니다. (게이트웨이가 활성화되는 데 8~10분 정도 걸립니다.)

cat <<EOF > config-cluster.yaml

apiVersion: gateway.networking.k8s.io/v1

kind: Gateway

metadata:

name: cross-region-gateway

namespace: default

spec:

gatewayClassName: gke-l7-cross-regional-internal-managed-mc

addresses:

- type: networking.gke.io/named-address-with-region

value: "regions/europe-west4/addresses/gemma-gateway-ip-europe-west4"

- type: networking.gke.io/named-address-with-region

value: "regions/us-east5/addresses/gemma-gateway-ip-us-east5"

listeners:

- name: http

protocol: HTTP

port: 80

---

apiVersion: gateway.networking.k8s.io/v1

kind: HTTPRoute

metadata:

name: gemma-route

namespace: default

spec:

parentRefs:

- name: cross-region-gateway

kind: Gateway

rules:

- backendRefs:

- group: networking.gke.io

kind: GCPInferencePoolImport

name: gemma-pool

port: 8000

---

apiVersion: networking.gke.io/v1

kind: HealthCheckPolicy

metadata:

name: gemma-health-check

namespace: default

spec:

targetRef:

group: networking.gke.io

kind: GCPInferencePoolImport

name: gemma-pool

default:

config:

type: HTTP

httpHealthCheck:

requestPath: /health

port: 8000

---

apiVersion: networking.gke.io/v1

kind: GCPBackendPolicy

metadata:

name: gemma-backend-policy

namespace: default

spec:

targetRef:

group: networking.gke.io

kind: GCPInferencePoolImport

name: gemma-pool

default:

timeoutSec: 100

balancingMode: CUSTOM_METRICS

trafficDuration: LONG

customMetrics:

- name: gke.named_metrics.tpu-cache

dryRun: false

maxUtilizationPercent: 60

EOF

echo -e "\n=== Creating Cross-Regional Gateway Resources ==="

kubectl apply -f config-cluster.yaml --context=$CTX_US

echo -e "\n=== Provisioning Global Load Balancer (This takes 5-10 minutes) ==="

echo "Working on the Gateway... waiting for Google Cloud to assign IPs and program routes..."

# The script will hold here until the gateway is officially ready

kubectl wait --for=condition=programmed gateway/cross-region-gateway --timeout=10m --context=$CTX_US

echo -e "\n=== SUCCESS: Gateway is fully provisioned and ready! ==="

추론 풀 (Helm): 두 리전의 모델 서버를 단일 논리적 백엔드로 그룹화합니다.

게이트웨이 및 HTTPRoute: 실제 전역 내부 부하 분산기를 만들고 수신되는 AI 프롬프트를 모델로 라우팅하는 규칙을 정의합니다.

상태 점검 및 백엔드 정책: 요청이 정상 포드로만 전송되도록 하고 스마트한 측정항목 기반 트래픽 분산을 지원하여 과부하된 TPU를 방지합니다.

유효성 검사: 스크립트는 Google Cloud에서 내부 IP 주소를 완전히 프로비저닝할 때까지 일시중지됩니다.

9. 장애 조치 테스트

이제 실습의 가장 중요한 부분인 아키텍처의 고가용성을 테스트합니다.

이 자동 테스트가 수행하는 작업은 다음과 같습니다.

- 기준 테스트: 시뮬레이션된 사용자가 추론 프롬프트 ('프랑스의 수도는 어디야?')를 전송합니다. 사용자가 기본 리전에 있으므로 게이트웨이는 가능한 가장 낮은 지연 시간을 위해 요청을 해당 로컬 TPU로 라우팅합니다.

- 재해: 기본 리전 (

replicas=0)의 모든 TPU 포드를 종료하여 심각한 데이터 센터 서비스 중단을 시뮬레이션합니다. - 감지: 45초 동안 기다립니다. 이 기간 동안 게이트웨이의 상태 점검이 실패하고 기본 백엔드가 완전히 오프라인 상태임을 인식하며 전역 라우팅 테이블을 동적으로 업데이트합니다.

- 장애 조치: 사용자가 두 번째 프롬프트 ('독일의 수도는 어디야?')를 전송합니다. 사용자는 서비스 중단이 발생했음을 알지 못합니다. 게이트웨이는 요청을 가로채 전 세계의 정상적인 보조 TPU로 즉시 리라우팅합니다.

- 복구: 기본 TPU를 복원하여 전역 아키텍처를 완전히 정상 상태로 되돌립니다.

- Cloud Shell을 열고 다음을 실행합니다.

cat << 'EOF' > failover-test.sh

#!/bin/bash

# Multi-Cluster Inference Failover Test

export PROJECT_ID=$(gcloud config get-value project)

export CTX_EU="gke_${PROJECT_ID}_europe-west4-a_gke-europe-west4"

export CTX_US="gke_${PROJECT_ID}_us-east5-b_gke-us-east5"

echo -e "\n=== PHASE 1: VERIFYING CURRENT STATE (BOTH CLUSTERS UP) ==="

echo "Checking US Cluster (Primary):"

kubectl get pods -l app=gemma-server --context=$CTX_US

echo "Checking EU Cluster (Secondary):"

kubectl get pods -l app=gemma-server --context=$CTX_EU

echo -e "\nDeploying Test Client in US..."

export GATEWAY_IP_US=$(gcloud compute addresses describe gemma-gateway-ip-us-east5 --region=us-east5 --project=$PROJECT_ID --format="value(address)")

kubectl run curl-test --image=curlimages/curl --restart=Never --context=$CTX_US -- sleep 3600

kubectl wait --for=condition=ready pod/curl-test --context=$CTX_US --timeout=60s

echo -e "\n=== PHASE 2: BASELINE TEST (US Client -> US TPUs) ==="

echo "Prompting the AI: 'What is the capital of France?'"

echo "Expect to see the full JSON response including token usage..."

kubectl exec curl-test --context=$CTX_US -- curl -s -X POST http://$GATEWAY_IP_US/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "/data/gemma-weights",

"messages": [{"role": "user", "content": "What is the capital of France?"}],

"max_tokens": 100

}' | jq .

echo -e "\n=== PHASE 3: SIMULATING REGIONAL OUTAGE (Scaling US to 0) ==="

kubectl scale deployment vllm-gemma --replicas=0 --context=$CTX_US

echo "Waiting 20 seconds for pods to begin terminating..."

sleep 20

echo -e "\n=== PHASE 4: CONFIRMING STATE (PODS TERMINATING) ==="

echo "Checking US Cluster (Should be terminating):"

kubectl get pods -l app=gemma-server --context=$CTX_US

echo "Checking EU Cluster (Should still be running):"

kubectl get pods -l app=gemma-server --context=$CTX_EU

echo -e "\nWaiting 45 seconds for Gateway health checks to update global routing tables..."

sleep 45

echo -e "\n=== PHASE 5: CONFIRMING COMPLETE DOWN AND EURO UP ==="

echo "Checking US Cluster (Should be completely empty now):"

kubectl get pods -l app=gemma-server --context=$CTX_US

echo "Checking EU Cluster (Should still be running):"

kubectl get pods -l app=gemma-server --context=$CTX_EU

echo -e "\n=== PHASE 6: FAILOVER TEST (US Client -> EU TPUs) ==="

echo "Prompting the AI: 'What is the capital of Germany?'"

echo "Request is actively being rerouted to Europe. Expecting full JSON response..."

kubectl exec curl-test --context=$CTX_US -- curl -s -X POST http://$GATEWAY_IP_US/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "/data/gemma-weights",

"messages": [{"role": "user", "content": "What is the capital of Germany?"}],

"max_tokens": 100

}' | jq .

echo -e "\n=== PHASE 7: RESTORING INFRASTRUCTURE (Scaling US to 1) ==="

kubectl scale deployment vllm-gemma --replicas=1 --context=$CTX_US

echo "Waiting for US pods to boot and mount FUSE..."

kubectl rollout status deployment/vllm-gemma --timeout=15m --context=$CTX_US

echo -e "\n=== PHASE 8: CONFIRMING BOTH SYSTEMS ARE BACK UP ==="

echo "Checking US Cluster (Restored):"

kubectl get pods -l app=gemma-server --context=$CTX_US

echo "Checking EU Cluster (Still Healthy):"

kubectl get pods -l app=gemma-server --context=$CTX_EU

echo -e "\n=== PHASE 9: CLEANUP ==="

kubectl delete pod curl-test --context=$CTX_US

echo "Failover lab complete."

EOF

chmod +x failover-test.sh

./failover-test.sh

- 테스트가 완료되면 정리할 수 있습니다.

10. 삭제

- 워크로드 정리

#!/bin/bash

echo "=== PART 1: Kubernetes & Workload Cleanup ==="

export PROJECT_ID=$(gcloud config get-value project)

export CTX_EU="gke_${PROJECT_ID}_europe-west4-a_gke-europe-west4"

export CTX_US="gke_${PROJECT_ID}_us-east5-b_gke-us-east5"

echo "Deleting Gateway resources..."

for CTX in $CTX_EU $CTX_US; do

kubectl delete gateways,httproutes,healthcheckpolicies,gcpbackendpolicies --all --context=$CTX --ignore-not-found

done

echo "Waiting 60 seconds for the external Load Balancer to detach..."

sleep 60

echo "Cleaning up workloads and custom resources..."

for CTX in $CTX_EU $CTX_US; do

helm uninstall gemma-pool --kube-context=$CTX || true

kubectl delete job model-downloader --context=$CTX --ignore-not-found

kubectl delete all -l app=gemma-server --context=$CTX --ignore-not-found

kubectl delete inferenceobjectives,autoscalingmetrics --all --context=$CTX --ignore-not-found

kubectl delete serviceaccount gemma-ksa --context=$CTX --ignore-not-found

kubectl delete -f https://raw.githubusercontent.com/kubernetes-sigs/gateway-api-inference-extension/v1.1.0/config/crd/bases/inference.networking.x-k8s.io_inferenceobjectives.yaml --context=$CTX --ignore-not-found

done

echo -e "\n=== Part 1 Complete! Safe to proceed to Terraform Teardown. ==="

- 인프라를 정리합니다. 현재 위치가

gke-tf폴더인지 확인합니다.

cat << 'EOF' > cleanup-tf.sh

#!/bin/bash

echo "=== PART 2: Infrastructure & Terraform Teardown ==="

export PROJECT_ID=$(gcloud config get-value project)

export LAB_NETWORK="tpu-gke-dranet-vpc"

echo "Destroying GKE Fleet Features to prevent firewall resurrection..."

terraform destroy -target=google_gke_hub_feature.mcs -target=google_gke_hub_feature.ingress -auto-approve

echo "Waiting 30 seconds for the self-healing controllers to spin down..."

sleep 30

echo "Hunting down orphaned auto-generated firewall rules strictly on the lab network..."

GHOST_RULES=$(gcloud compute firewall-rules list --filter="network~${LAB_NETWORK} AND (name~mcsd OR name~k8s-fw-l7)" --format="value(name)" --project=$PROJECT_ID)

if [ ! -z "$GHOST_RULES" ]; then

for rule in $GHOST_RULES; do

echo "Deleting ghost rule: $rule"

gcloud compute firewall-rules delete $rule --project=$PROJECT_ID --quiet

done

else

echo "No ghost rules found on ${LAB_NETWORK}."

fi

echo "=== Controllers and Firewalls dead. Destroying remaining Base Infrastructure. ==="

MAX_RETRIES=3

RETRY_COUNT=0

SUCCESS=false

while [ $RETRY_COUNT -lt $MAX_RETRIES ]; do

# Run the destroy command. If it succeeds (exit code 0), break the loop.

if terraform destroy -auto-approve; then

SUCCESS=true

break

else

RETRY_COUNT=$((RETRY_COUNT+1))

echo -e "\n[WARNING] Terraform destroy encountered an error (likely a GCP resource lock)."

if [ $RETRY_COUNT -lt $MAX_RETRIES ]; then

echo "Waiting 30 seconds before retry $RETRY_COUNT of $MAX_RETRIES..."

sleep 30

fi

fi

done

if [ "$SUCCESS" = true ]; then

echo -e "\n=== Lab Cleanup Successfully Completed! ==="

else

echo -e "\n[ERROR] Lab Cleanup failed after $MAX_RETRIES attempts."

echo "Some resources may still be locked. Run 'terraform destroy -auto-approve' manually later to finish."

exit 1

fi

EOF

chmod +x cleanup-tf.sh

./cleanup-tf.sh

특정 리소스를 삭제하는 데 문제가 발생하면 terraform destroy 명령어 스크립트 ./cleanup-tf.sh을 다시 실행해야 합니다.

11. 마무리

축하합니다. GKE, 관리형 DRANET, TPU v6e 액셀러레이터를 사용하여 가용성이 높은 멀티 클러스터 GKE 추론 게이트웨이, 교차 리전 AI 추론 아키텍처를 성공적으로 배포했습니다.

인스턴트 모델 로드를 위한 Cloud Storage FUSE와 지연 시간 인식 다중 클러스터 라우팅을 위한 추론 게이트웨이 API를 결합하여 내부 사용자 트래픽을 중단하지 않고 완전한 리전 데이터 센터 중단에서 살아남을 수 있는 복원력 있는 백엔드를 구축했습니다.

다음 단계/더 학습하기

GKE 네트워킹에 대해 자세히 알아볼 수 있습니다.

다음 실습 참여하기

Google Cloud로 퀘스트를 계속 진행하고 다음 Google Cloud 실습을 확인하세요.