1. Wprowadzenie

GCP od dawna obsługuje wiele interfejsów na poziomie instancji maszyny wirtualnej. Dzięki wielu interfejsom maszyna wirtualna może połączyć maksymalnie 7 nowych interfejsów (domyślny + 7 interfejsów) z różnymi sieciami VPC. Sieć GKE rozszerza to działanie na pody działające na węzłach. Wcześniej klastry GKE umożliwiały, aby wszystkie pule węzłów miały tylko 1 interfejs, a tym samym były mapowane na 1 sieć VPC. Dzięki funkcji obsługi wielu sieci w podach użytkownik może włączyć więcej niż jeden interfejs w węzłach i podach w klastrze GKE.

Co utworzysz

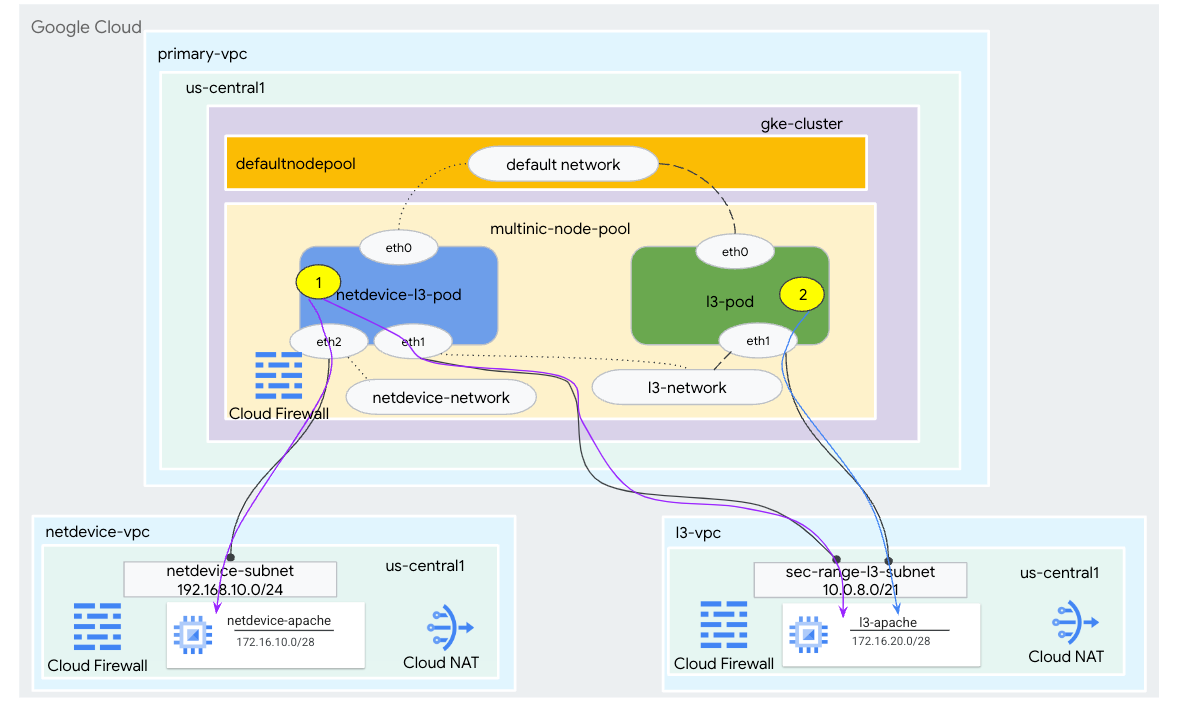

W tym samouczku utworzysz kompleksowe środowisko GKE z wieloma interfejsami sieciowymi, które ilustruje przypadki użycia przedstawione na rysunku 1.

- Utwórz urządzenie sieciowe netdevice-l3-pod, które wykorzystuje busybox do:

- Wykonaj polecenia PING i wget -S na instancji netdevice-apache w sieci netdevice-vpc przez interfejs eth2.

- Wykonaj polecenia PING i wget -S na instancji l3-apache w sieci l3-vpc przez interfejs eth1.

- Utwórz zasobnik l3, który wykorzystuje busybox do wykonania poleceń PING i wget -S na instancji l3-apache przez interfejs eth1.

W obu przypadkach interfejs eth0 poda jest połączony z siecią domyślną.

Rysunek 1.

Czego się nauczysz

- Jak utworzyć podsieć typu L3

- Tworzenie podsieci typu NetDevice

- Jak utworzyć pulę węzłów GKE z wieloma interfejsami sieciowymi

- Jak utworzyć poda z możliwościami netdevice i L3

- Jak utworzyć grupę z możliwościami warstwy 3

- Jak utworzyć i zweryfikować sieć obiektów GKE

- Jak sprawdzić łączność ze zdalnymi serwerami Apache za pomocą poleceń PING i wget oraz logów zapory sieciowej

Czego potrzebujesz

- Projekt Google Cloud

2. Terminologia i koncepcje

Podstawowa sieć VPC: podstawowa sieć VPC to wstępnie skonfigurowana sieć VPC z zestawem domyślnych ustawień i zasobów. Klaster GKE zostanie utworzony w tej sieci VPC.

Podsieć: w Google Cloud podsieć to sposób tworzenia międzydomenowego routingu bez klasy (CIDR) z maskami sieci w sieci VPC. Podsieć ma jeden podstawowy zakres adresów IP, który jest przypisany do węzłów, i może mieć wiele zakresów dodatkowych, które mogą należeć do podów i usług.

Sieć węzłów: sieć węzłów to dedykowana kombinacja sieci VPC i pary podsieci. W tej sieci węzłów węzłom należącym do puli węzłów są przydzielane adresy IP z podstawowego zakresu adresów IP.

Zakres dodatkowy: dodatkowy zakres Google Cloud to CIDR i maska sieci należące do regionu w sieci VPC. GKE używa go jako sieci podów w warstwie 3. Sieć VPC może mieć wiele zakresów dodatkowych, a pod może łączyć się z wieloma sieciami podów.

Sieć (warstwa 3 lub urządzenie): obiekt sieci, który służy jako punkt połączenia dla podów. W samouczku sieci to l3-network i netdevice-network, a urządzenie może być typu netdevice lub dpdk. Sieć domyślna jest obowiązkowa i tworzona podczas tworzenia klastra na podstawie podsieci domyślnej puli węzłów.

Sieci warstwy 3 odpowiadają drugiemu zakresowi w podsieci i są reprezentowane w ten sposób:

VPC -> Nazwa podsieci -> Nazwa zakresu dodatkowego

Sieć urządzenia odpowiada podsieci w sieci VPC i jest reprezentowana w ten sposób:

VPC -> Nazwa podsieci

Domyślna sieć podów: Google Cloud tworzy domyślną sieć podów podczas tworzenia klastra. Domyślna sieć Pod używa podstawowej sieci VPC jako sieci węzła. Domyślna sieć poda jest domyślnie dostępna na wszystkich węzłach klastra i podach.

Pody z wieloma interfejsami: pody z wieloma interfejsami w GKE nie mogą łączyć się z tą samą siecią podów, ponieważ każdy interfejs poda musi być połączony z unikalną siecią.

Aktualizowanie projektu, aby obsługiwał ćwiczenia z programowania

W tym laboratorium wykorzystywane są zmienne $variables, które ułatwiają wdrażanie konfiguracji gcloud w Cloud Shell.

W Cloud Shell wykonaj te czynności:

gcloud config list project

gcloud config set project [YOUR-PROJECT-NAME]

projectid=YOUR-PROJECT-NAME

echo $projectid

3. Konfiguracja podstawowej sieci VPC

Utwórz podstawową sieć VPC

W Cloud Shell wykonaj te czynności:

gcloud compute networks create primary-vpc --project=$projectid --subnet-mode=custom

Utwórz węzeł i podsieci dodatkowe

W Cloud Shell wykonaj te czynności:

gcloud compute networks subnets create primary-node-subnet --project=$projectid --range=192.168.0.0/24 --network=primary-vpc --region=us-central1 --enable-private-ip-google-access --secondary-range=sec-range-primay-vpc=10.0.0.0/21

4. Tworzenie klastra GKE

Utwórz prywatny klaster GKE, określając podsieci primary-vpc, aby utworzyć domyślną pulę węzłów z wymaganymi flagami –enable-multi-networking i –enable-dataplane-v2, które obsługują pule węzłów z wieloma interfejsami sieciowymi.

W Cloud Shell utwórz klaster GKE:

gcloud container clusters create multinic-gke \

--zone "us-central1-a" \

--enable-dataplane-v2 \

--enable-ip-alias \

--enable-multi-networking \

--network "primary-vpc" --subnetwork "primary-node-subnet" \

--num-nodes=2 \

--max-pods-per-node=32 \

--cluster-secondary-range-name=sec-range-primay-vpc \

--no-enable-master-authorized-networks \

--release-channel "regular" \

--enable-private-nodes --master-ipv4-cidr "100.100.10.0/28" \

--enable-ip-alias

Sprawdzanie klastra multinic-gke

W Cloud Shell uwierzytelnij się w klastrze:

gcloud container clusters get-credentials multinic-gke --zone us-central1-a --project $projectid

W Cloud Shell sprawdź, czy w puli domyślnej zostały wygenerowane 2 węzły:

kubectl get nodes

Przykład:

user@$ kubectl get nodes

NAME STATUS ROLES AGE VERSION

gke-multinic-gke-default-pool-3d419e48-1k2p Ready <none> 2m4s v1.27.3-gke.100

gke-multinic-gke-default-pool-3d419e48-xckb Ready <none> 2m4s v1.27.3-gke.100

5. Konfiguracja netdevice-vpc

Utwórz sieć netdevice-vpc

W Cloud Shell wykonaj te czynności:

gcloud compute networks create netdevice-vpc --project=$projectid --subnet-mode=custom

Utwórz podsieci netdevice-vpc

W Cloud Shell utwórz podsieć używaną w przypadku sieci urządzenia sieciowego z wieloma interfejsami:

gcloud compute networks subnets create netdevice-subnet --project=$projectid --range=192.168.10.0/24 --network=netdevice-vpc --region=us-central1 --enable-private-ip-google-access

W Cloud Shell utwórz podsieć dla instancji netdevice-apache:

gcloud compute networks subnets create netdevice-apache --project=$projectid --range=172.16.10.0/28 --network=netdevice-vpc --region=us-central1 --enable-private-ip-google-access

Konfiguracja routera Cloud Router i NAT

W samouczku do instalacji pakietu oprogramowania używamy Cloud NAT, ponieważ instancja maszyny wirtualnej nie ma zewnętrznego adresu IP.

W Cloud Shell utwórz router Cloud Router.

gcloud compute routers create netdevice-cr --network netdevice-vpc --region us-central1

W Cloud Shell utwórz bramę NAT.

gcloud compute routers nats create cloud-nat-netdevice --router=netdevice-cr --auto-allocate-nat-external-ips --nat-all-subnet-ip-ranges --region us-central1

Tworzenie instancji netdevice-apache

W następnej sekcji utworzysz instancję netdevice-apache.

W Cloud Shell utwórz instancję:

gcloud compute instances create netdevice-apache \

--project=$projectid \

--machine-type=e2-micro \

--image-family debian-11 \

--no-address \

--image-project debian-cloud \

--zone us-central1-a \

--subnet=netdevice-apache \

--metadata startup-script="#! /bin/bash

sudo apt-get update

sudo apt-get install apache2 -y

sudo service apache2 restart

echo 'Welcome to the netdevice-apache instance !!' | tee /var/www/html/index.html

EOF"

6. l3-vpc setup

Utwórz sieć l3-vpc

W Cloud Shell wykonaj te czynności:

gcloud compute networks create l3-vpc --project=$projectid --subnet-mode=custom

Utwórz podsieci l3-vpc

W Cloud Shell utwórz podsieć z podstawowym i dodatkowym zakresem adresów. Zakres dodatkowy(sec-range-l3-subnet) jest używany w sieci warstwy 3 z wieloma interfejsami sieciowymi:

gcloud compute networks subnets create l3-subnet --project=$projectid --range=192.168.20.0/24 --network=l3-vpc --region=us-central1 --enable-private-ip-google-access --secondary-range=sec-range-l3-subnet=10.0.8.0/21

W Cloud Shell utwórz podsieć dla instancji l3-apache:

gcloud compute networks subnets create l3-apache --project=$projectid --range=172.16.20.0/28 --network=l3-vpc --region=us-central1 --enable-private-ip-google-access

Konfiguracja routera Cloud Router i NAT

W samouczku do instalacji pakietu oprogramowania używamy Cloud NAT, ponieważ instancja maszyny wirtualnej nie ma zewnętrznego adresu IP.

W Cloud Shell utwórz router Cloud Router.

gcloud compute routers create l3-cr --network l3-vpc --region us-central1

W Cloud Shell utwórz bramę NAT.

gcloud compute routers nats create cloud-nat-l3 --router=l3-cr --auto-allocate-nat-external-ips --nat-all-subnet-ip-ranges --region us-central1

Tworzenie instancji l3-apache

W następnej sekcji utworzysz instancję l3-apache.

W Cloud Shell utwórz instancję:

gcloud compute instances create l3-apache \

--project=$projectid \

--machine-type=e2-micro \

--image-family debian-11 \

--no-address \

--image-project debian-cloud \

--zone us-central1-a \

--subnet=l3-apache \

--metadata startup-script="#! /bin/bash

sudo apt-get update

sudo apt-get install apache2 -y

sudo service apache2 restart

echo 'Welcome to the l3-apache instance !!' | tee /var/www/html/index.html

EOF"

7. Tworzenie puli węzłów z wieloma interfejsami

W sekcji poniżej utworzysz pulę węzłów z wieloma interfejsami sieciowymi, która będzie zawierać te flagi:

–additional-node-network (wymagany w przypadku interfejsów typu urządzenia)

Przykład:

--additional-node-network network=netdevice-vpc,subnetwork=netdevice-subnet

–additional-node-network i –additional-pod-network ( wymagane w przypadku interfejsów typu L3)

Przykład:

--additional-node-network network=l3-vpc,subnetwork=l3-subnet --additional-pod-network subnetwork=l3-subnet,pod-ipv4-range=sec-range-l3-subnet,max-pods-per-node=8

Typ maszyny: podczas wdrażania puli węzłów weź pod uwagę zależność typu maszyny. Na przykład typ maszyny „e2-standard-4” z 4 procesorami wirtualnymi może obsługiwać łącznie do 4 sieci VPC. Na przykład netdevice-l3-pod będzie mieć łącznie 3 interfejsy (domyślny, netdevice i l3), dlatego w samouczku używany jest typ maszyny e2-standard-4.

W Cloud Shell utwórz pulę węzłów składającą się z urządzenia typu Device i L3:

gcloud container --project "$projectid" node-pools create "multinic-node-pool" --cluster "multinic-gke" --zone "us-central1-a" --additional-node-network network=netdevice-vpc,subnetwork=netdevice-subnet --additional-node-network network=l3-vpc,subnetwork=l3-subnet --additional-pod-network subnetwork=l3-subnet,pod-ipv4-range=sec-range-l3-subnet,max-pods-per-node=8 --machine-type "e2-standard-4"

8. Sprawdź pulę węzłów z wieloma interfejsami sieciowymi

W Cloud Shell sprawdź, czy w puli węzłów multinic-node-pool zostały wygenerowane 3 węzły:

kubectl get nodes

Przykład:

user@$ kubectl get nodes

NAME STATUS ROLES AGE VERSION

gke-multinic-gke-default-pool-3d419e48-1k2p Ready <none> 15m v1.27.3-gke.100

gke-multinic-gke-default-pool-3d419e48-xckb Ready <none> 15m v1.27.3-gke.100

gke-multinic-gke-multinic-node-pool-135699a1-0tfx Ready <none> 3m51s v1.27.3-gke.100

gke-multinic-gke-multinic-node-pool-135699a1-86gz Ready <none> 3m51s v1.27.3-gke.100

gke-multinic-gke-multinic-node-pool-135699a1-t66p Ready <none> 3m51s v1.27.3-gke.100

9. Tworzenie sieci netdevice-network

W kolejnych krokach wygenerujesz obiekt kubernetes Network i GKENetworkParamSet, aby utworzyć sieć netdevice-network, która będzie używana do łączenia podów w późniejszych krokach.

Tworzenie obiektu sieci netdevice-network

W Cloud Shell utwórz obiekt sieciowy YAML netdevice-network.yaml za pomocą edytora VI lub nano. Zwróć uwagę, że „routes to” to podsieć 172.16.10.0/28 (netdevice-apache) w sieci netdevice-vpc.

apiVersion: networking.gke.io/v1

kind: Network

metadata:

name: netdevice-network

spec:

type: "Device"

parametersRef:

group: networking.gke.io

kind: GKENetworkParamSet

name: "netdevice"

routes:

- to: "172.16.10.0/28"

W Cloud Shell zastosuj plik netdevice-network.yaml:

kubectl apply -f netdevice-network.yaml

W Cloud Shell sprawdź, czy typ stanu netdevice-network to Ready.

kubectl describe networks netdevice-network

Przykład:

user@$ kubectl describe networks netdevice-network

Name: netdevice-network

Namespace:

Labels: <none>

Annotations: networking.gke.io/in-use: false

API Version: networking.gke.io/v1

Kind: Network

Metadata:

Creation Timestamp: 2023-07-30T22:37:38Z

Generation: 1

Resource Version: 1578594

UID: 46d75374-9fcc-42be-baeb-48e074747052

Spec:

Parameters Ref:

Group: networking.gke.io

Kind: GKENetworkParamSet

Name: netdevice

Routes:

To: 172.16.10.0/28

Type: Device

Status:

Conditions:

Last Transition Time: 2023-07-30T22:37:38Z

Message: GKENetworkParamSet resource was deleted: netdevice

Reason: GNPDeleted

Status: False

Type: ParamsReady

Last Transition Time: 2023-07-30T22:37:38Z

Message: Resource referenced by params is not ready

Reason: ParamsNotReady

Status: False

Type: Ready

Events: <none>

Tworzenie GKENetworkParamSet

W Cloud Shell utwórz obiekt sieciowy YAML netdevice-network-parm.yaml za pomocą edytora VI lub nano. Specyfikacja jest mapowana na wdrożenie podsieci netdevice-vpc.

apiVersion: networking.gke.io/v1

kind: GKENetworkParamSet

metadata:

name: "netdevice"

spec:

vpc: "netdevice-vpc"

vpcSubnet: "netdevice-subnet"

deviceMode: "NetDevice"

W Cloud Shell zastosuj plik netdevice-network-parm.yaml.

kubectl apply -f netdevice-network-parm.yaml

W Cloud Shell sprawdź, czy w przypadku urządzenia sieciowego przyczyna stanu to GNPParmsReady i NetworkReady:

kubectl describe networks netdevice-network

Przykład:

user@$ kubectl describe networks netdevice-network

Name: netdevice-network

Namespace:

Labels: <none>

Annotations: networking.gke.io/in-use: false

API Version: networking.gke.io/v1

Kind: Network

Metadata:

Creation Timestamp: 2023-07-30T22:37:38Z

Generation: 1

Resource Version: 1579791

UID: 46d75374-9fcc-42be-baeb-48e074747052

Spec:

Parameters Ref:

Group: networking.gke.io

Kind: GKENetworkParamSet

Name: netdevice

Routes:

To: 172.16.10.0/28

Type: Device

Status:

Conditions:

Last Transition Time: 2023-07-30T22:39:44Z

Message:

Reason: GNPParamsReady

Status: True

Type: ParamsReady

Last Transition Time: 2023-07-30T22:39:44Z

Message:

Reason: NetworkReady

Status: True

Type: Ready

Events: <none>

W Cloud Shell sprawdź blok CIDR gkenetworkparamset 192.168.10.0/24 używany w interfejsie poda w późniejszym kroku.

kubectl describe gkenetworkparamsets.networking.gke.io netdevice

Przykład:

user@$ kubectl describe gkenetworkparamsets.networking.gke.io netdevice

Name: netdevice

Namespace:

Labels: <none>

Annotations: <none>

API Version: networking.gke.io/v1

Kind: GKENetworkParamSet

Metadata:

Creation Timestamp: 2023-07-30T22:39:43Z

Finalizers:

networking.gke.io/gnp-controller

networking.gke.io/high-perf-finalizer

Generation: 1

Resource Version: 1579919

UID: 6fe36b0c-0091-4b6a-9d28-67596cbce845

Spec:

Device Mode: NetDevice

Vpc: netdevice-vpc

Vpc Subnet: netdevice-subnet

Status:

Conditions:

Last Transition Time: 2023-07-30T22:39:43Z

Message:

Reason: GNPReady

Status: True

Type: Ready

Network Name: netdevice-network

Pod CID Rs:

Cidr Blocks:

192.168.10.0/24

Events: <none>

10. Tworzenie sieci L3

W kolejnych krokach wygenerujesz obiekt Kubernetes Network i GKENetworkParamSet, aby utworzyć sieć warstwy 3, która będzie używana do łączenia zasobników w późniejszych krokach.

Tworzenie obiektu sieci L3

W Cloud Shell utwórz obiekt sieciowy YAML l3-network.yaml za pomocą edytora VI lub nano. Zwróć uwagę, że „routes to” to podsieć 172.16.20.0/28 (l3-apache) w sieci l3-vpc.

apiVersion: networking.gke.io/v1

kind: Network

metadata:

name: l3-network

spec:

type: "L3"

parametersRef:

group: networking.gke.io

kind: GKENetworkParamSet

name: "l3-network"

routes:

- to: "172.16.20.0/28"

W Cloud Shell zastosuj plik l3-network.yaml:

kubectl apply -f l3-network.yaml

W Cloud Shell sprawdź, czy typ stanu sieci L3 to Ready (Gotowy).

kubectl describe networks l3-network

Przykład:

user@$ kubectl describe networks l3-network

Name: l3-network

Namespace:

Labels: <none>

Annotations: networking.gke.io/in-use: false

API Version: networking.gke.io/v1

Kind: Network

Metadata:

Creation Timestamp: 2023-07-30T22:43:54Z

Generation: 1

Resource Version: 1582307

UID: 426804be-35c9-4cc5-bd26-00b94be2ef9a

Spec:

Parameters Ref:

Group: networking.gke.io

Kind: GKENetworkParamSet

Name: l3-network

Routes:

to: 172.16.20.0/28

Type: L3

Status:

Conditions:

Last Transition Time: 2023-07-30T22:43:54Z

Message: GKENetworkParamSet resource was deleted: l3-network

Reason: GNPDeleted

Status: False

Type: ParamsReady

Last Transition Time: 2023-07-30T22:43:54Z

Message: Resource referenced by params is not ready

Reason: ParamsNotReady

Status: False

Type: Ready

Events: <none>

Tworzenie elementu GKENetworkParamSet

W Cloud Shell utwórz obiekt sieciowy YAML l3-network-parm.yaml za pomocą edytora VI lub nano. Zwróć uwagę, że specyfikacja jest mapowana na wdrożenie podsieci l3-vpc.

apiVersion: networking.gke.io/v1

kind: GKENetworkParamSet

metadata:

name: "l3-network"

spec:

vpc: "l3-vpc"

vpcSubnet: "l3-subnet"

podIPv4Ranges:

rangeNames:

- "sec-range-l3-subnet"

W Cloud Shell zastosuj plik l3-network-parm.yaml.

kubectl apply -f l3-network-parm.yaml

W Cloud Shell sprawdź, czy w polu Status Reason sieci l3-network widnieją wartości GNPParmsReady i NetworkReady:

kubectl describe networks l3-network

Przykład:

user@$ kubectl describe networks l3-network

Name: l3-network

Namespace:

Labels: <none>

Annotations: networking.gke.io/in-use: false

API Version: networking.gke.io/v1

Kind: Network

Metadata:

Creation Timestamp: 2023-07-30T22:43:54Z

Generation: 1

Resource Version: 1583647

UID: 426804be-35c9-4cc5-bd26-00b94be2ef9a

Spec:

Parameters Ref:

Group: networking.gke.io

Kind: GKENetworkParamSet

Name: l3-network

Routes:

To: 172.16.20.0/28

Type: L3

Status:

Conditions:

Last Transition Time: 2023-07-30T22:46:14Z

Message:

Reason: GNPParamsReady

Status: True

Type: ParamsReady

Last Transition Time: 2023-07-30T22:46:14Z

Message:

Reason: NetworkReady

Status: True

Type: Ready

Events: <none>

W Cloud Shell sprawdź parametr gkenetworkparamset l3-network CIDR 10.0.8.0/21 użyty do utworzenia interfejsu poda.

kubectl describe gkenetworkparamsets.networking.gke.io l3-network

Przykład:

user@$ kubectl describe gkenetworkparamsets.networking.gke.io l3-network

Name: l3-network

Namespace:

Labels: <none>

Annotations: <none>

API Version: networking.gke.io/v1

Kind: GKENetworkParamSet

Metadata:

Creation Timestamp: 2023-07-30T22:46:14Z

Finalizers:

networking.gke.io/gnp-controller

Generation: 1

Resource Version: 1583656

UID: 4c1f521b-0088-4005-b000-626ca5205326

Spec:

podIPv4Ranges:

Range Names:

sec-range-l3-subnet

Vpc: l3-vpc

Vpc Subnet: l3-subnet

Status:

Conditions:

Last Transition Time: 2023-07-30T22:46:14Z

Message:

Reason: GNPReady

Status: True

Type: Ready

Network Name: l3-network

Pod CID Rs:

Cidr Blocks:

10.0.8.0/21

Events: <none>

11. Tworzenie podu netdevice-l3

W następnej sekcji utworzysz poda netdevice-l3-pod z busyboxem, czyli „szwajcarskim scyzorykiem” obsługującym ponad 300 popularnych poleceń. Pod jest skonfigurowany do komunikacji z siecią l3-vpc za pomocą interfejsu eth1 i z siecią netdevice-vpc za pomocą interfejsu eth2.

W Cloud Shell utwórz kontener busybox o nazwie netdevice-l3-pod.yaml za pomocą edytora VI lub nano.

apiVersion: v1

kind: Pod

metadata:

name: netdevice-l3-pod

annotations:

networking.gke.io/default-interface: 'eth0'

networking.gke.io/interfaces: |

[

{"interfaceName":"eth0","network":"default"},

{"interfaceName":"eth1","network":"l3-network"},

{"interfaceName":"eth2","network":"netdevice-network"}

]

spec:

containers:

- name: netdevice-l3-pod

image: busybox

command: ["sleep", "10m"]

ports:

- containerPort: 80

restartPolicy: Always

W Cloud Shell zastosuj plik netdevice-l3-pod.yaml.

kubectl apply -f netdevice-l3-pod.yaml

Weryfikacja tworzenia puli netdevice-l3

W Cloud Shell sprawdź, czy netdevice-l3-pod działa:

kubectl get pods netdevice-l3-pod

Przykład:

user@$ kubectl get pods netdevice-l3-pod

NAME READY STATUS RESTARTS AGE

netdevice-l3-pod 1/1 Running 0 74s

W Cloud Shell sprawdź adresy IP przypisane do interfejsów poda.

kubectl get pods netdevice-l3-pod -o yaml

W podanym przykładzie pole networking.gke.io/pod-ips zawiera adresy IP powiązane z interfejsami poda z sieci l3-network i netdevice-network. Domyślny adres IP sieci 10.0.1.22 jest podany w sekcji podIPs:

user@$ kubectl get pods netdevice-l3-pod -o yaml

apiVersion: v1

kind: Pod

metadata:

annotations:

kubectl.kubernetes.io/last-applied-configuration: |

{"apiVersion":"v1","kind":"Pod","metadata":{"annotations":{"networking.gke.io/default-interface":"eth0","networking.gke.io/interfaces":"[\n{\"interfaceName\":\"eth0\",\"network\":\"default\"},\n{\"interfaceName\":\"eth1\",\"network\":\"l3-network\"},\n{\"interfaceName\":\"eth2\",\"network\":\"netdevice-network\"}\n]\n"},"name":"netdevice-l3-pod","namespace":"default"},"spec":{"containers":[{"command":["sleep","10m"],"image":"busybox","name":"netdevice-l3-pod","ports":[{"containerPort":80}]}],"restartPolicy":"Always"}}

networking.gke.io/default-interface: eth0

networking.gke.io/interfaces: |

[

{"interfaceName":"eth0","network":"default"},

{"interfaceName":"eth1","network":"l3-network"},

{"interfaceName":"eth2","network":"netdevice-network"}

]

networking.gke.io/pod-ips: '[{"networkName":"l3-network","ip":"10.0.8.4"},{"networkName":"netdevice-network","ip":"192.168.10.2"}]'

creationTimestamp: "2023-07-30T22:49:27Z"

name: netdevice-l3-pod

namespace: default

resourceVersion: "1585567"

uid: d9e43c75-e0d1-4f31-91b0-129bc53bbf64

spec:

containers:

- command:

- sleep

- 10m

image: busybox

imagePullPolicy: Always

name: netdevice-l3-pod

ports:

- containerPort: 80

protocol: TCP

resources:

limits:

networking.gke.io.networks/l3-network.IP: "1"

networking.gke.io.networks/netdevice-network: "1"

networking.gke.io.networks/netdevice-network.IP: "1"

requests:

networking.gke.io.networks/l3-network.IP: "1"

networking.gke.io.networks/netdevice-network: "1"

networking.gke.io.networks/netdevice-network.IP: "1"

terminationMessagePath: /dev/termination-log

terminationMessagePolicy: File

volumeMounts:

- mountPath: /var/run/secrets/kubernetes.io/serviceaccount

name: kube-api-access-f2wpb

readOnly: true

dnsPolicy: ClusterFirst

enableServiceLinks: true

nodeName: gke-multinic-gke-multinic-node-pool-135699a1-86gz

preemptionPolicy: PreemptLowerPriority

priority: 0

restartPolicy: Always

schedulerName: default-scheduler

securityContext: {}

serviceAccount: default

serviceAccountName: default

terminationGracePeriodSeconds: 30

tolerations:

- effect: NoExecute

key: node.kubernetes.io/not-ready

operator: Exists

tolerationSeconds: 300

- effect: NoExecute

key: node.kubernetes.io/unreachable

operator: Exists

tolerationSeconds: 300

- effect: NoSchedule

key: networking.gke.io.networks/l3-network.IP

operator: Exists

- effect: NoSchedule

key: networking.gke.io.networks/netdevice-network

operator: Exists

- effect: NoSchedule

key: networking.gke.io.networks/netdevice-network.IP

operator: Exists

volumes:

- name: kube-api-access-f2wpb

projected:

defaultMode: 420

sources:

- serviceAccountToken:

expirationSeconds: 3607

path: token

- configMap:

items:

- key: ca.crt

path: ca.crt

name: kube-root-ca.crt

- downwardAPI:

items:

- fieldRef:

apiVersion: v1

fieldPath: metadata.namespace

path: namespace

status:

conditions:

- lastProbeTime: null

lastTransitionTime: "2023-07-30T22:49:28Z"

status: "True"

type: Initialized

- lastProbeTime: null

lastTransitionTime: "2023-07-30T22:49:33Z"

status: "True"

type: Ready

- lastProbeTime: null

lastTransitionTime: "2023-07-30T22:49:33Z"

status: "True"

type: ContainersReady

- lastProbeTime: null

lastTransitionTime: "2023-07-30T22:49:28Z"

status: "True"

type: PodScheduled

containerStatuses:

- containerID: containerd://dcd9ead2f69824ccc37c109a47b1f3f5eb7b3e60ce3865e317dd729685b66a5c

image: docker.io/library/busybox:latest

imageID: docker.io/library/busybox@sha256:3fbc632167424a6d997e74f52b878d7cc478225cffac6bc977eedfe51c7f4e79

lastState: {}

name: netdevice-l3-pod

ready: true

restartCount: 0

started: true

state:

running:

startedAt: "2023-07-30T22:49:32Z"

hostIP: 192.168.0.4

phase: Running

podIP: 10.0.1.22

podIPs:

- ip: 10.0.1.22

qosClass: BestEffort

startTime: "2023-07-30T22:49:28Z"

Sprawdzanie tras netdevice-l3-pod

W Cloud Shell sprawdź trasy do sieci netdevice-vpc i l3-vpc z sieci netdevice-l3-pod:

kubectl exec --stdin --tty netdevice-l3-pod -- /bin/sh

Utwórz instancję i sprawdź interfejsy poda:

ifconfig

W tym przykładzie interfejs eth0 jest połączony z siecią domyślną, eth1 z siecią l3-network, a eth2 z siecią netdevice-network.

/ # ifconfig

eth0 Link encap:Ethernet HWaddr 26:E3:1B:14:6E:0C

inet addr:10.0.1.22 Bcast:10.0.1.255 Mask:255.255.255.0

UP BROADCAST RUNNING MULTICAST MTU:1460 Metric:1

RX packets:5 errors:0 dropped:0 overruns:0 frame:0

TX packets:7 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:446 (446.0 B) TX bytes:558 (558.0 B)

eth1 Link encap:Ethernet HWaddr 92:78:4E:CB:F2:D4

inet addr:10.0.8.4 Bcast:0.0.0.0 Mask:255.255.255.255

UP BROADCAST RUNNING MULTICAST MTU:1460 Metric:1

RX packets:5 errors:0 dropped:0 overruns:0 frame:0

TX packets:6 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:446 (446.0 B) TX bytes:516 (516.0 B)

eth2 Link encap:Ethernet HWaddr 42:01:C0:A8:0A:02

inet addr:192.168.10.2 Bcast:0.0.0.0 Mask:255.255.255.255

UP BROADCAST RUNNING MULTICAST MTU:1460 Metric:1

RX packets:73 errors:0 dropped:0 overruns:0 frame:0

TX packets:50581 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:26169 (25.5 KiB) TX bytes:2148170 (2.0 MiB)

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

UP LOOPBACK RUNNING MTU:65536 Metric:1

RX packets:0 errors:0 dropped:0 overruns:0 frame:0

TX packets:0 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:0 (0.0 B) TX bytes:0 (0.0 B)

Na urządzeniu sieciowym netdevice-l3-pod sprawdź trasy do sieci netdevice-vpc (172.16.10.0/28) i l3-vpc (172.16.20.0/28).

Utwórz instancję i sprawdź trasy poda:

ip route

Przykład:

/ # ip route

default via 10.0.1.1 dev eth0 #primary-vpc

10.0.1.0/24 via 10.0.1.1 dev eth0 src 10.0.1.22

10.0.1.1 dev eth0 scope link src 10.0.1.22

10.0.8.0/21 via 10.0.8.1 dev eth1 #l3-vpc (sec-range-l3-subnet)

10.0.8.1 dev eth1 scope link

172.16.10.0/28 via 192.168.10.1 dev eth2 #netdevice-vpc (netdevice-apache subnet)

172.16.20.0/28 via 10.0.8.1 dev eth1 #l3-vpc (l3-apache subnet)

192.168.10.0/24 via 192.168.10.1 dev eth2 #pod interface subnet

192.168.10.1 dev eth2 scope link

Aby wrócić do Cloud Shell, zamknij poda z instancji.

exit

12. Utwórz pod L3

W następnej sekcji utworzysz poda l3 z busyboxem, czyli „szwajcarskim scyzorykiem” obsługującym ponad 300 popularnych poleceń. Pod jest skonfigurowany tak, aby komunikować się z siecią VPC warstwy 3 tylko za pomocą interfejsu eth1.

W Cloud Shell utwórz kontener busybox o nazwie l3-pod.yaml za pomocą edytora VI lub nano.

apiVersion: v1

kind: Pod

metadata:

name: l3-pod

annotations:

networking.gke.io/default-interface: 'eth0'

networking.gke.io/interfaces: |

[

{"interfaceName":"eth0","network":"default"},

{"interfaceName":"eth1","network":"l3-network"}

]

spec:

containers:

- name: l3-pod

image: busybox

command: ["sleep", "10m"]

ports:

- containerPort: 80

restartPolicy: Always

W Cloud Shell zastosuj plik l3-pod.yaml.

kubectl apply -f l3-pod.yaml

Sprawdzanie utworzenia l3-pod

W Cloud Shell sprawdź, czy netdevice-l3-pod działa:

kubectl get pods l3-pod

Przykład:

user@$ kubectl get pods l3-pod

NAME READY STATUS RESTARTS AGE

l3-pod 1/1 Running 0 52s

W Cloud Shell sprawdź adresy IP przypisane do interfejsów poda.

kubectl get pods l3-pod -o yaml

W podanym przykładzie pole networking.gke.io/pod-ips zawiera adresy IP powiązane z interfejsami poda z sieci l3-network. Domyślny adres IP sieci 10.0.2.12 jest podany w sekcji podIPs:

user@$ kubectl get pods l3-pod -o yaml

apiVersion: v1

kind: Pod

metadata:

annotations:

kubectl.kubernetes.io/last-applied-configuration: |

{"apiVersion":"v1","kind":"Pod","metadata":{"annotations":{"networking.gke.io/default-interface":"eth0","networking.gke.io/interfaces":"[\n{\"interfaceName\":\"eth0\",\"network\":\"default\"},\n{\"interfaceName\":\"eth1\",\"network\":\"l3-network\"}\n]\n"},"name":"l3-pod","namespace":"default"},"spec":{"containers":[{"command":["sleep","10m"],"image":"busybox","name":"l3-pod","ports":[{"containerPort":80}]}],"restartPolicy":"Always"}}

networking.gke.io/default-interface: eth0

networking.gke.io/interfaces: |

[

{"interfaceName":"eth0","network":"default"},

{"interfaceName":"eth1","network":"l3-network"}

]

networking.gke.io/pod-ips: '[{"networkName":"l3-network","ip":"10.0.8.22"}]'

creationTimestamp: "2023-07-30T23:22:29Z"

name: l3-pod

namespace: default

resourceVersion: "1604447"

uid: 79a86afd-2a50-433d-9d48-367acb82c1d0

spec:

containers:

- command:

- sleep

- 10m

image: busybox

imagePullPolicy: Always

name: l3-pod

ports:

- containerPort: 80

protocol: TCP

resources:

limits:

networking.gke.io.networks/l3-network.IP: "1"

requests:

networking.gke.io.networks/l3-network.IP: "1"

terminationMessagePath: /dev/termination-log

terminationMessagePolicy: File

volumeMounts:

- mountPath: /var/run/secrets/kubernetes.io/serviceaccount

name: kube-api-access-w9d24

readOnly: true

dnsPolicy: ClusterFirst

enableServiceLinks: true

nodeName: gke-multinic-gke-multinic-node-pool-135699a1-t66p

preemptionPolicy: PreemptLowerPriority

priority: 0

restartPolicy: Always

schedulerName: default-scheduler

securityContext: {}

serviceAccount: default

serviceAccountName: default

terminationGracePeriodSeconds: 30

tolerations:

- effect: NoExecute

key: node.kubernetes.io/not-ready

operator: Exists

tolerationSeconds: 300

- effect: NoExecute

key: node.kubernetes.io/unreachable

operator: Exists

tolerationSeconds: 300

- effect: NoSchedule

key: networking.gke.io.networks/l3-network.IP

operator: Exists

volumes:

- name: kube-api-access-w9d24

projected:

defaultMode: 420

sources:

- serviceAccountToken:

expirationSeconds: 3607

path: token

- configMap:

items:

- key: ca.crt

path: ca.crt

name: kube-root-ca.crt

- downwardAPI:

items:

- fieldRef:

apiVersion: v1

fieldPath: metadata.namespace

path: namespace

status:

conditions:

- lastProbeTime: null

lastTransitionTime: "2023-07-30T23:22:29Z"

status: "True"

type: Initialized

- lastProbeTime: null

lastTransitionTime: "2023-07-30T23:22:35Z"

status: "True"

type: Ready

- lastProbeTime: null

lastTransitionTime: "2023-07-30T23:22:35Z"

status: "True"

type: ContainersReady

- lastProbeTime: null

lastTransitionTime: "2023-07-30T23:22:29Z"

status: "True"

type: PodScheduled

containerStatuses:

- containerID: containerd://1d5fe2854bba0a0d955c157a58bcfd4e34cecf8837edfd7df2760134f869e966

image: docker.io/library/busybox:latest

imageID: docker.io/library/busybox@sha256:3fbc632167424a6d997e74f52b878d7cc478225cffac6bc977eedfe51c7f4e79

lastState: {}

name: l3-pod

ready: true

restartCount: 0

started: true

state:

running:

startedAt: "2023-07-30T23:22:35Z"

hostIP: 192.168.0.5

phase: Running

podIP: 10.0.2.12

podIPs:

- ip: 10.0.2.12

qosClass: BestEffort

startTime: "2023-07-30T23:22:29Z"

Sprawdzanie poprawności tras l3-pod

W Cloud Shell sprawdź trasy do sieci l3-vpc z urządzenia netdevice-l3-pod:

kubectl exec --stdin --tty l3-pod -- /bin/sh

Utwórz instancję i sprawdź interfejsy poda:

ifconfig

W tym przykładzie eth0 jest połączony z siecią domyślną, a eth1 z siecią l3-network.

/ # ifconfig

eth0 Link encap:Ethernet HWaddr 22:29:30:09:6B:58

inet addr:10.0.2.12 Bcast:10.0.2.255 Mask:255.255.255.0

UP BROADCAST RUNNING MULTICAST MTU:1460 Metric:1

RX packets:5 errors:0 dropped:0 overruns:0 frame:0

TX packets:7 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:446 (446.0 B) TX bytes:558 (558.0 B)

eth1 Link encap:Ethernet HWaddr 6E:6D:FC:C3:FF:AF

inet addr:10.0.8.22 Bcast:0.0.0.0 Mask:255.255.255.255

UP BROADCAST RUNNING MULTICAST MTU:1460 Metric:1

RX packets:5 errors:0 dropped:0 overruns:0 frame:0

TX packets:6 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:446 (446.0 B) TX bytes:516 (516.0 B)

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

UP LOOPBACK RUNNING MTU:65536 Metric:1

RX packets:0 errors:0 dropped:0 overruns:0 frame:0

TX packets:0 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:0 (0.0 B) TX bytes:0 (0.0 B)

W przypadku l3-pod sprawdź trasy do l3-vpc (172.16.20.0/28).

Utwórz instancję i sprawdź trasy poda:

ip route

Przykład:

/ # ip route

default via 10.0.2.1 dev eth0 #primary-vpc

10.0.2.0/24 via 10.0.2.1 dev eth0 src 10.0.2.12

10.0.2.1 dev eth0 scope link src 10.0.2.12

10.0.8.0/21 via 10.0.8.17 dev eth1 #l3-vpc (sec-range-l3-subnet)

10.0.8.17 dev eth1 scope link #pod interface subnet

172.16.20.0/28 via 10.0.8.17 dev eth1 #l3-vpc (l3-apache subnet)

Aby wrócić do Cloud Shell, zamknij poda z instancji.

exit

13. Aktualizacje zapory sieciowej

Aby umożliwić połączenia z puli GKE multicnic do sieci netdevice-vpc i l3-vpc, wymagane są reguły zapory sieciowej ruchu przychodzącego. Utworzysz reguły zapory sieciowej, w których jako zakres źródłowy podasz podsieć sieci poda, np. netdevice-subnet, sec-range-l3-subnet.

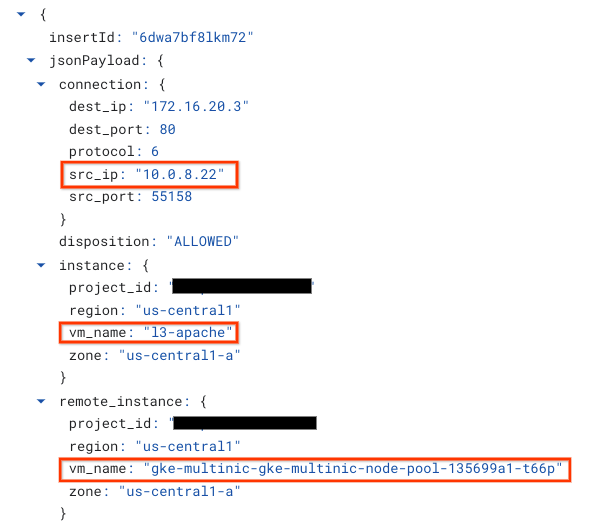

Na przykład niedawno utworzony kontener l3-pod, interfejs eth2 10.0.8.22 (przydzielony z sec-range-l3-subnet) jest źródłowym adresem IP podczas łączenia się z instancją l3-apache w l3-vpc.

netdevice-vpc: Allow from netdevice-subnet to netdevice-apache

W Cloud Shell utwórz regułę zapory sieciowej w sieci netdevice-vpc, która zezwala podsieci netdevice-subnet na dostęp do instancji netdevice-apache.

gcloud compute --project=$projectid firewall-rules create allow-ingress-from-netdevice-network-to-all-vpc-instances --direction=INGRESS --priority=1000 --network=netdevice-vpc --action=ALLOW --rules=all --source-ranges=192.168.10.0/24 --enable-logging

l3-vpc: Allow from sec-range-l3-subnet to l3-apache

W Cloud Shell utwórz w sieci l3-vpc regułę zapory sieciowej zezwalającą na dostęp z podsieci sec-range-l3-subnet do instancji l3-apache.

gcloud compute --project=$projectid firewall-rules create allow-ingress-from-l3-network-to-all-vpc-instances --direction=INGRESS --priority=1000 --network=l3-vpc --action=ALLOW --rules=all --source-ranges=10.0.8.0/21 --enable-logging

14. Sprawdzanie połączenia z podem

W następnej sekcji sprawdzisz łączność z instancjami Apache z poziomu zasobników netdevice-l3-pod i l3-pod. W tym celu zalogujesz się w zasobnikach i uruchomisz polecenie wget -S, które sprawdzi pobieranie strony głównej serwerów Apache. Ponieważ pod netdevice-l3-pod jest skonfigurowany z interfejsami z sieci netdevice-network i l3-network, możliwe jest połączenie z serwerami Apache w sieciach netdevice-vpc i l3-vpc.

Natomiast w przypadku wykonania polecenia wget -S z l3-pod nie można nawiązać połączenia z serwerem Apache w sieci netdevice-vpc, ponieważ l3-pod jest skonfigurowany tylko z interfejsem z sieci l3-network.

Uzyskiwanie adresu IP serwera Apache

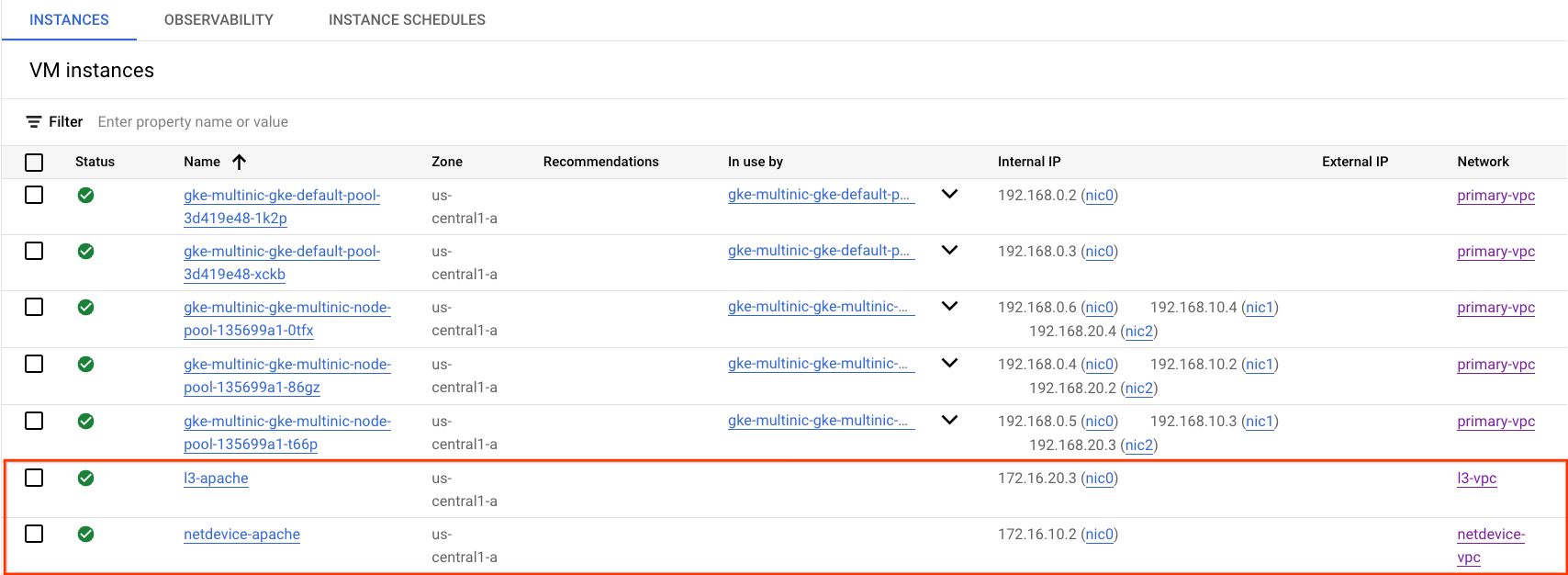

W Cloud Console uzyskaj adres IP serwerów Apache, przechodząc do Compute Engine → Instancje maszyn wirtualnych.

Test połączenia z urządzenia sieciowego warstwy 3 do urządzenia sieciowego z Apache

W Cloud Shell zaloguj się w netdevice-l3-pod:

kubectl exec --stdin --tty netdevice-l3-pod -- /bin/sh

Z poziomu kontenera wyślij ping do instancji netdevice-apache na podstawie adresu IP uzyskanego w poprzednim kroku.

ping <insert-your-ip> -c 4

Przykład:

/ # ping 172.16.10.2 -c 4

PING 172.16.10.2 (172.16.10.2): 56 data bytes

64 bytes from 172.16.10.2: seq=0 ttl=64 time=1.952 ms

64 bytes from 172.16.10.2: seq=1 ttl=64 time=0.471 ms

64 bytes from 172.16.10.2: seq=2 ttl=64 time=0.446 ms

64 bytes from 172.16.10.2: seq=3 ttl=64 time=0.505 ms

--- 172.16.10.2 ping statistics ---

4 packets transmitted, 4 packets received, 0% packet loss

round-trip min/avg/max = 0.446/0.843/1.952 ms

/ #

W Cloud Shell wykonaj polecenie wget -S na instancji netdevice-apache na podstawie adresu IP uzyskanego w poprzednim kroku. Kod 200 OK oznacza, że strona została pobrana.

wget -S <insert-your-ip>

Przykład:

/ # wget -S 172.16.10.2

Connecting to 172.16.10.2 (172.16.10.2:80)

HTTP/1.1 200 OK

Date: Mon, 31 Jul 2023 03:12:58 GMT

Server: Apache/2.4.56 (Debian)

Last-Modified: Sat, 29 Jul 2023 00:32:44 GMT

ETag: "2c-6019555f54266"

Accept-Ranges: bytes

Content-Length: 44

Connection: close

Content-Type: text/html

saving to 'index.html'

index.html 100% |********************************| 44 0:00:00 ETA

'index.html' saved

/ #

Test połączenia z urządzenia sieciowego warstwy 3 z Apache w warstwie 3

W Cloud Shell wykonaj pingowanie instancji l3-apache na podstawie adresu IP uzyskanego w poprzednim kroku.

ping <insert-your-ip> -c 4

Przykład:

/ # ping 172.16.20.3 -c 4

PING 172.16.20.3 (172.16.20.3): 56 data bytes

64 bytes from 172.16.20.3: seq=0 ttl=63 time=2.059 ms

64 bytes from 172.16.20.3: seq=1 ttl=63 time=0.533 ms

64 bytes from 172.16.20.3: seq=2 ttl=63 time=0.485 ms

64 bytes from 172.16.20.3: seq=3 ttl=63 time=0.462 ms

--- 172.16.20.3 ping statistics ---

4 packets transmitted, 4 packets received, 0% packet loss

round-trip min/avg/max = 0.462/0.884/2.059 ms

/ #

W Cloud Shell usuń poprzedni plik index.html i wykonaj polecenie wget -S na instancji l3-apache na podstawie adresu IP uzyskanego w poprzednim kroku. Kod 200 OK oznacza, że strona została pobrana.

rm index.html

wget -S <insert-your-ip>

Przykład:

/ # rm index.html

/ # wget -S 172.16.20.3

Connecting to 172.16.20.3 (172.16.20.3:80)

HTTP/1.1 200 OK

Date: Mon, 31 Jul 2023 03:41:32 GMT

Server: Apache/2.4.56 (Debian)

Last-Modified: Mon, 31 Jul 2023 03:24:21 GMT

ETag: "25-601bff76f04b7"

Accept-Ranges: bytes

Content-Length: 37

Connection: close

Content-Type: text/html

saving to 'index.html'

index.html 100% |*******************************************************************************************************| 37 0:00:00 ETA

'index.html' saved

Aby wrócić do Cloud Shell, zamknij poda z instancji.

exit

Test połączenia z sieci l3-pod z urządzeniem sieciowym-apache

W Cloud Shell zaloguj się w l3-pod:

kubectl exec --stdin --tty l3-pod -- /bin/sh

Z poziomu kontenera wyślij ping do instancji netdevice-apache na podstawie adresu IP uzyskanego w poprzednim kroku. Ponieważ l3-pod nie ma interfejsu powiązanego z netdevice-network, pingowanie zakończy się niepowodzeniem.

ping <insert-your-ip> -c 4

Przykład:

/ # ping 172.16.10.2 -c 4

PING 172.16.10.2 (172.16.10.2): 56 data bytes

--- 172.16.10.2 ping statistics ---

4 packets transmitted, 0 packets received, 100% packet loss

Opcjonalnie: w Cloud Shell wykonaj polecenie wget -S na instancji netdevice-apache na podstawie adresu IP uzyskanego w poprzednim kroku, które spowoduje przekroczenie limitu czasu.

wget -S <insert-your-ip>

Przykład:

/ # wget -S 172.16.10.2

Connecting to 172.16.10.2 (172.16.10.2:80)

wget: can't connect to remote host (172.16.10.2): Connection timed out

Test połączenia z l3-pod do l3-apache

W Cloud Shell wykonaj pingowanie instancji l3-apache na podstawie adresu IP uzyskanego w poprzednim kroku.

ping <insert-your-ip> -c 4

Przykład:

/ # ping 172.16.20.3 -c 4

PING 172.16.20.3 (172.16.20.3): 56 data bytes

64 bytes from 172.16.20.3: seq=0 ttl=63 time=1.824 ms

64 bytes from 172.16.20.3: seq=1 ttl=63 time=0.513 ms

64 bytes from 172.16.20.3: seq=2 ttl=63 time=0.482 ms

64 bytes from 172.16.20.3: seq=3 ttl=63 time=0.532 ms

--- 172.16.20.3 ping statistics ---

4 packets transmitted, 4 packets received, 0% packet loss

round-trip min/avg/max = 0.482/0.837/1.824 ms

/ #

W Cloud Shell wykonaj polecenie wget -S na instancji l3-apache na podstawie adresu IP uzyskanego w poprzednim kroku. Kod 200 OK oznacza, że strona została pobrana.

wget -S <insert-your-ip>

Przykład:

/ # wget -S 172.16.20.3

Connecting to 172.16.20.3 (172.16.20.3:80)

HTTP/1.1 200 OK

Date: Mon, 31 Jul 2023 03:52:08 GMT

Server: Apache/2.4.56 (Debian)

Last-Modified: Mon, 31 Jul 2023 03:24:21 GMT

ETag: "25-601bff76f04b7"

Accept-Ranges: bytes

Content-Length: 37

Connection: close

Content-Type: text/html

saving to 'index.html'

index.html 100% |*******************************************************************************************************| 37 0:00:00 ETA

'index.html' saved

/ #

15. Logi zapory sieciowej

Usługa logowania reguł zapory sieciowej umożliwia kontrolę, weryfikację i analizę wpływu reguł zapory sieciowej. Możesz na przykład sprawdzić, czy reguła zapory sieciowej zaprojektowana w celu odrzucania ruchu działa zgodnie z oczekiwaniami. Logowanie reguł zapory sieciowej jest też przydatne przy określaniu liczby połączeń, na które wpływa dana reguła zapory sieciowej.

W samouczku włączono logowanie zapory sieciowej podczas tworzenia reguł zapory sieciowej dotyczących ruchu przychodzącego. Przyjrzyjmy się informacjom uzyskanym z logów.

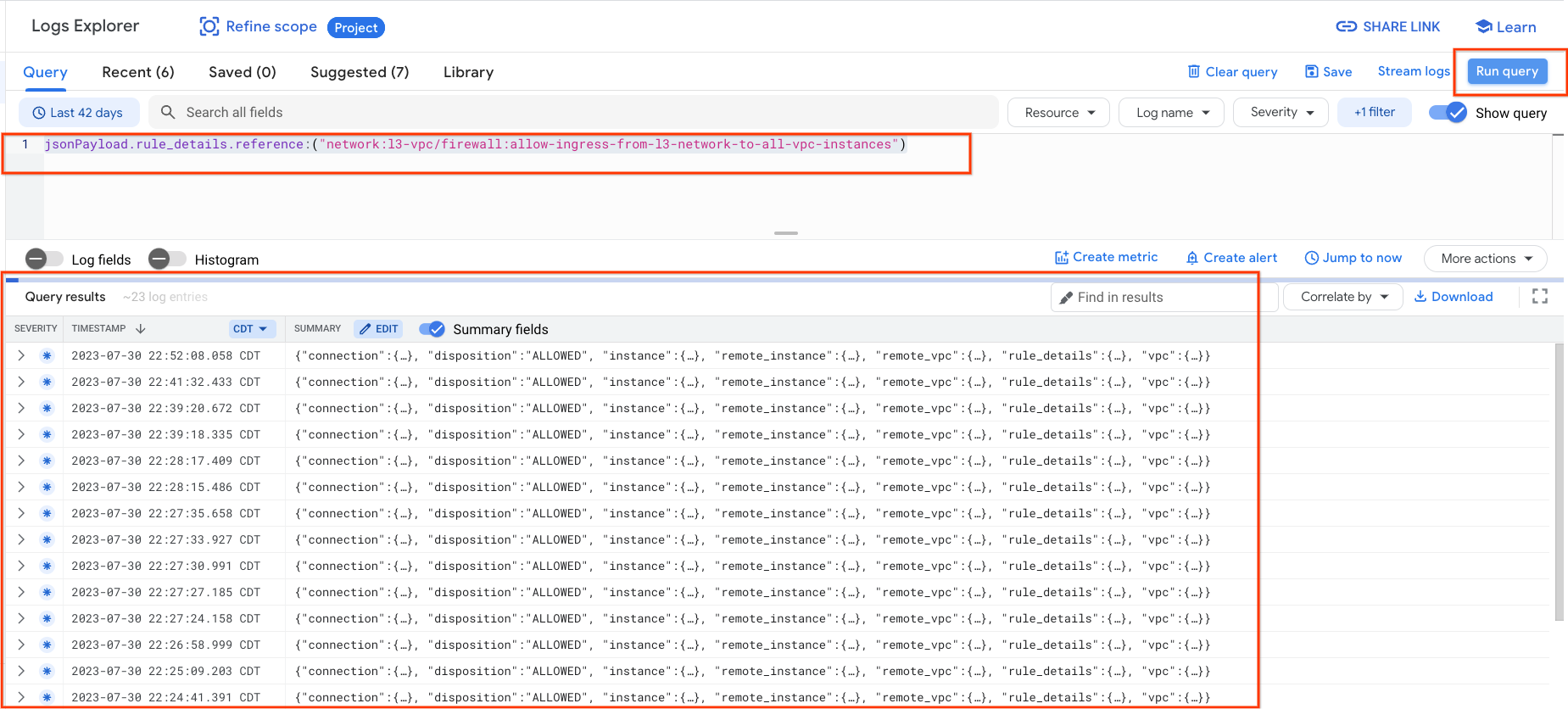

W Cloud Console otwórz Logowanie → Eksplorator logów.

Wstaw poniższe zapytanie zgodnie ze zrzutem ekranu i kliknij Uruchom zapytanie jsonPayload.rule_details.reference:("network:l3-vpc/firewall:allow-ingress-from-l3-network-to-all-vpc-instances")

Szczegółowe informacje o przechwyconych danych są przydatne dla administratorów zabezpieczeń. Obejmują one adres IP źródła i miejsca docelowego, port, protokół i nazwę puli węzłów.

Aby dokładniej zbadać logi zapory sieciowej, otwórz Sieć VPC → Zapora sieciowa → allow-ingress-from-netdevice-network-to-all-vpc-instances, a następnie kliknij Wyświetl w Eksploratorze logów.

16. Czyszczenie danych

W Cloud Shell usuń komponenty samouczka.

gcloud compute instances delete l3-apache netdevice-apache --zone=us-central1-a --quiet

gcloud compute routers delete l3-cr netdevice-cr --region=us-central1 --quiet

gcloud container clusters delete multinic-gke --zone=us-central1-a --quiet

gcloud compute firewall-rules delete allow-ingress-from-l3-network-to-all-vpc-instances allow-ingress-from-netdevice-network-to-all-vpc-instances --quiet

gcloud compute networks subnets delete l3-apache l3-subnet netdevice-apache netdevice-subnet primary-node-subnet --region=us-central1 --quiet

gcloud compute networks delete l3-vpc netdevice-vpc primary-vpc --quiet

17. Gratulacje

Gratulacje. Udało Ci się skonfigurować i zweryfikować tworzenie puli węzłów z wieloma interfejsami sieciowymi oraz tworzenie podów z busyboxem w celu sprawdzenia łączności typu L3 i łączności z serwerami Apache za pomocą poleceń PING i wget.

Dowiedzieliśmy się też, jak wykorzystywać logi zapory sieciowej do sprawdzania pakietów źródłowych i docelowych między kontenerami poda a serwerami Apache.

Cosmopup uważa, że samouczki są świetne!!