1. Présentation

Introduction

Gemini 2.5 Pro est le modèle de Google le plus performant pour le codage et la connaissance du monde.

Avec la série 2.5, les modèles Gemini sont désormais des modèles de raisonnement hybrides. Gemini 2.5 Pro peut appliquer une réflexion approfondie aux tâches et utiliser des outils afin de vous proposer les réponses les plus exactes possible.

Gemini 2.5 Pro :

- est une amélioration significative par rapport aux modèles précédents en termes de fonctionnalités, y compris le codage, le raisonnement et la multimodalité ;

- est un leader du secteur en matière de raisonnement, avec des performances de pointe dans les benchmarks mathématiques et STEM ;

- est un modèle incroyable pour le code, particulièrement robuste sur le développement Web ;

- est particulièrement adapté aux requêtes complexes, tout en restant équilibré, y compris en étant classé n° 1 sur LMSys.

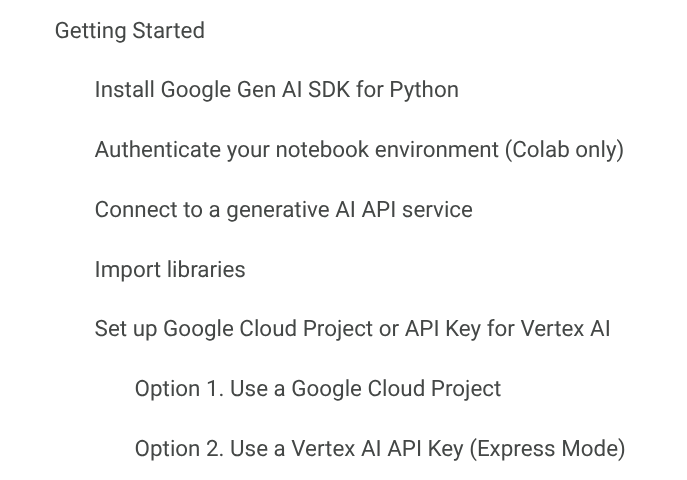

Points abordés

Dans cet atelier, vous allez apprendre à utiliser l'API Gemini et le SDK Google Gen AI pour Python avec le modèle Gemini 2.5 Pro.

Vous allez effectuer les tâches suivantes :

- Générer du texte à partir de prompts textuels

- Générer du texte en flux continu

- Commencer des chats multitours

- Utiliser des méthodes asynchrones

- Configurer les paramètres du modèle

- Définir des instructions système

- Utiliser des filtres de sécurité

- Utiliser la génération contrôlée

- Compter les jetons

- Traiter des données multimodales (audio, code, documents, images et vidéo)

- Utiliser l'appel de fonction automatique et manuel

- Exécution du code

- Exemples de mode de réflexion

2. Avant de commencer

Prérequis

Avant de commencer, vous devez disposer d'un projet Google Cloud avec un compte de facturation valide. Veuillez sélectionner le projet Google Cloud que vous souhaitez utiliser.

Pour exécuter l'atelier de programmation, nous allons utiliser Colab Enterprise, qui est un environnement de notebook géré et collaboratif avec les fonctionnalités de sécurité et de conformité de Google Cloud.

Activer les API requises

Cliquez sur le bouton ci-dessous pour activer les API nécessaires à cet atelier de programmation dans votre projet Google Cloud : Vertex AI, Dataform et Compute Engine.

Copier le notebook Colab dans Google Cloud

Cliquez sur le bouton ci-dessous pour ouvrir le notebook de l'atelier dans Colab Enterprise. Cela créera une copie du notebook Colab dans votre projet Google Cloud actuel, ce qui vous permettra ensuite d'exécuter le notebook.

Commençons !

3. Initialiser l'environnement

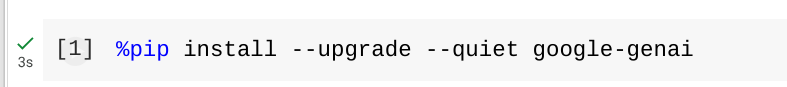

Maintenant que nous avons créé le notebook Colab, nous pouvons exécuter le code fourni dans le notebook. Les premières étapes consistent à installer les dépendances et à importer les bibliothèques nécessaires.

Suivre les étapes de la section Premiers pas

Commencez par exécuter les cellules de la section Premiers pas les unes après les autres.

Remarque : Vous pouvez exécuter une cellule en plaçant le pointeur de la souris sur la cellule de code que vous souhaitez exécuter, puis en cliquant sur l'icône ![]() Exécuter la cellule.

Exécuter la cellule.

À la fin de cette section, vous aurez effectué les opérations suivantes :

- Installer le SDK Google Gen AI pour Python

- Importer les bibliothèques nécessaires pour l'atelier

- Configurer un projet Google Cloud pour utiliser Vertex AI

Utilisons maintenant Gemini 2.5 Pro pour générer du texte

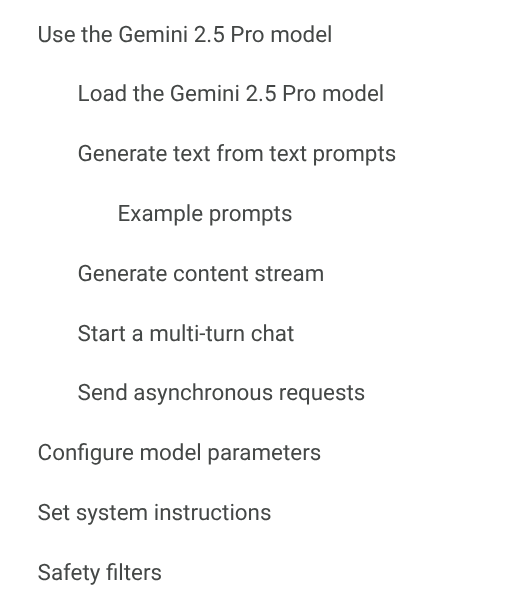

4. Générer du texte avec Gemini

Dans cette section du notebook, vous allez utiliser Gemini 2.5 Pro pour générer des complétions de texte.

Exécutez l'ensemble de cellules suivant dans le notebook, en prenant le temps de lire le code et de comprendre comment utiliser le SDK Google GenAI.

À la fin de cette section, vous aurez appris les points suivants :

- Comment spécifier le modèle à utiliser

- Génération de sortie en flux continu ou non

- Utilisation de la fonctionnalité de chat multitours du SDK

- Appel asynchrone du SDK

- Configuration des paramètres du modèle

- Définition d'instructions système pour personnaliser le comportement du modèle

- Configuration des filtres de sécurité du contenu

Nous allons maintenant voir comment envoyer des requêtes multimodales à Gemini

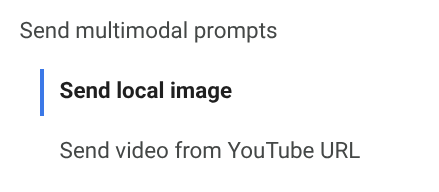

5. Requêtes multimodales

Dans cette section du notebook, vous allez utiliser Gemini 2.5 Pro pour traiter des images et des vidéos.

Exécutez les cellules suivantes dans le notebook.

À la fin de cette section, vous aurez appris les points suivants :

- Envoyer une requête composée d'une image et de texte

- Traiter une vidéo à partir d'une URL

Nous allons maintenant générer des sorties bien définies et structurées

6. Sorties structurées

Lorsque vous utilisez la réponse des modèles dans le code, il est important d'obtenir des sorties cohérentes et fiables du modèle. La génération contrôlée vous permet de définir un schéma de réponse pour spécifier la structure de la sortie d'un modèle, les noms des champs et le type de données attendu pour chaque champ.

Exécutez les cellules suivantes dans le notebook.

Nous allons maintenant voir comment ancrer les sorties des modèles

7. Surface de référence

Si vous souhaitez utiliser des bases de connaissances existantes ou fournir des informations en temps réel au modèle, vous devez examiner l'ancrage des sorties du modèle.

Avec Gemini et Vertex AI, vous pouvez ancrer la sortie dans la recherche Google, dans la sortie des réponses de fonction et enfin dans le code lui-même. L'exécution de code permet au modèle de générer du code et de l'exécuter, ce qui lui permet d'apprendre des résultats et d'itérer pour obtenir la sortie finale.

Exécutez les cellules suivantes dans le notebook.

Nous allons maintenant voir les capacités de réflexion de Gemini 2.5 Pro

8. Raisonnement

Le mode de réflexion est particulièrement utile pour les tâches complexes qui nécessitent plusieurs cycles de raisonnement et de résolution itérative. Les modèles Gemini 2.5 sont des modèles de réflexion, capable de raisonner avant de répondre, offrant ainsi de meilleures performances et plus de précision.

Exécutez les cellules suivantes dans le notebook. Lorsque vous le faites, notez la sortie de réflexion avant que le modèle ne présente sa sortie réelle.

9. Conclusion

Félicitations ! Vous avez appris à exploiter la puissance de Gemini 2.5 Pro à l'aide du SDK Google Gen AI pour Python, en couvrant la génération de texte, la multimodalité, l'ancrage, les sorties structurées et ses capacités de réflexion avancées. Vous disposez désormais des connaissances de base nécessaires pour commencer à créer vos propres applications innovantes à l'aide du SDK. Gemini 2.5 Pro, avec son mode de réflexion et de raisonnement puissant, ouvre de nouvelles possibilités et se prête à l'innovation dans divers cas d'utilisation.

Références supplémentaires

- Consultez la documentation de référence du SDK Google Gen AI.

- Découvrez d'autres notebooks dans le dépôt GitHub Google Cloud pour l'IA générative.

- Découvrez des modèles d'IA dans Model Garden.