1. Übersicht

Willkommen beim Google Codelab zum Ausführen eines parallelen Lustre-Dateisystemclusters auf der Google Cloud Platform.

Daten sind das Herzstück des Hochleistungs-Computings (HPC). Der Zugriff auf große Datenmengen mit extrem hohen Geschwindigkeiten und niedrigen Latenzen war schon immer eine große Herausforderung beim Ausführen von HPC-Arbeitslasten. Diese Anforderung an leistungsstarken Speicher hat sich in der Cloud nicht geändert. Tatsächlich ist die Möglichkeit, schnell und einfach große Mengen an Speicherplatz zu nutzen, von größter Bedeutung.

HPC-Center haben diesen Bedarf schon lange vor Ort mit Technologien wie dem parallelen Dateisystem Lustre gedeckt. Lustre ist heute eine der beliebtesten Open-Source-Hochleistungsspeicherlösungen und wird seit Juni 2005 von mindestens der Hälfte der zehn und mehr als 60 der 100 schnellsten Supercomputer der Welt verwendet. Lustre kann auf Hunderte von PB an Kapazität skaliert werden und bietet die maximale Leistung für HPC-Jobs. Systeme liefern TB/s an Durchsatz in einem einzelnen Namespace.

Um den Bedarf an Speicherplatz zu decken, hat Google Cloud zwei Ansätze gewählt. Zuerst hat GCP mit DDN zusammengearbeitet, um die unterstützte DDN EXAScaler Lustre-Software der Unternehmensklasse im GCP Marketplace anzubieten. Zweitens haben unsere Ingenieure bei Google Cloud eine Reihe von Scripts entwickelt und als Open Source veröffentlicht, mit denen sich ein Lustre-Speichercluster in Google Compute Engine mithilfe von Google Cloud Deployment Manager einfach konfigurieren und bereitstellen lässt.

Lustre auf Google Cloud Platform kann die maximale Leistung der Infrastruktur, auf der es ausgeführt wird, ebenso gut liefern. Die Leistung auf GCP ist so gut, dass es 2019 mit unserem Partner DDN auf Platz 8 des IO-500-Benchmarks für Speichersysteme landete und damit das bestplatzierte cloudbasierte Dateisystem im IO-500 war. Heute zeigen wir Ihnen, wie Sie die Open-Source-Deployment Manager-Skripts für Lustre bereitstellen. Wenn Sie an einer gehärteten Lustre-Lösung für Unternehmen mit Lustre-Expertensupport für Ihren Lustre-Cluster sowie Funktionen wie einer GUI für Verwaltung und Monitoring oder Lustre-Optimierungen interessiert sind, empfehlen wir Ihnen, sich das DDN EXAScaler-Marketplace-Angebot anzusehen.

Lerninhalte

- GCP Deployment Manager-Dienst verwenden

- Informationen zum Konfigurieren und Bereitstellen eines Lustre-Dateisystems in der GCP.

- So konfigurieren Sie Striping und testen einfache E/A-Vorgänge für das Lustre-Dateisystem.

Vorbereitung

- Google Cloud Platform-Konto und ein Projekt mit Abrechnung

- Grundlegende Linux-Kenntnisse

2. Einrichtung

Umgebung zum selbstbestimmten Lernen einrichten

Projekt erstellen

Wenn Sie noch kein Google-Konto (Gmail oder G Suite) haben, müssen Sie eines erstellen. Melden Sie sich in der Google Cloud Console ( console.cloud.google.com) an und öffnen Sie die Seite „Ressourcen verwalten“:

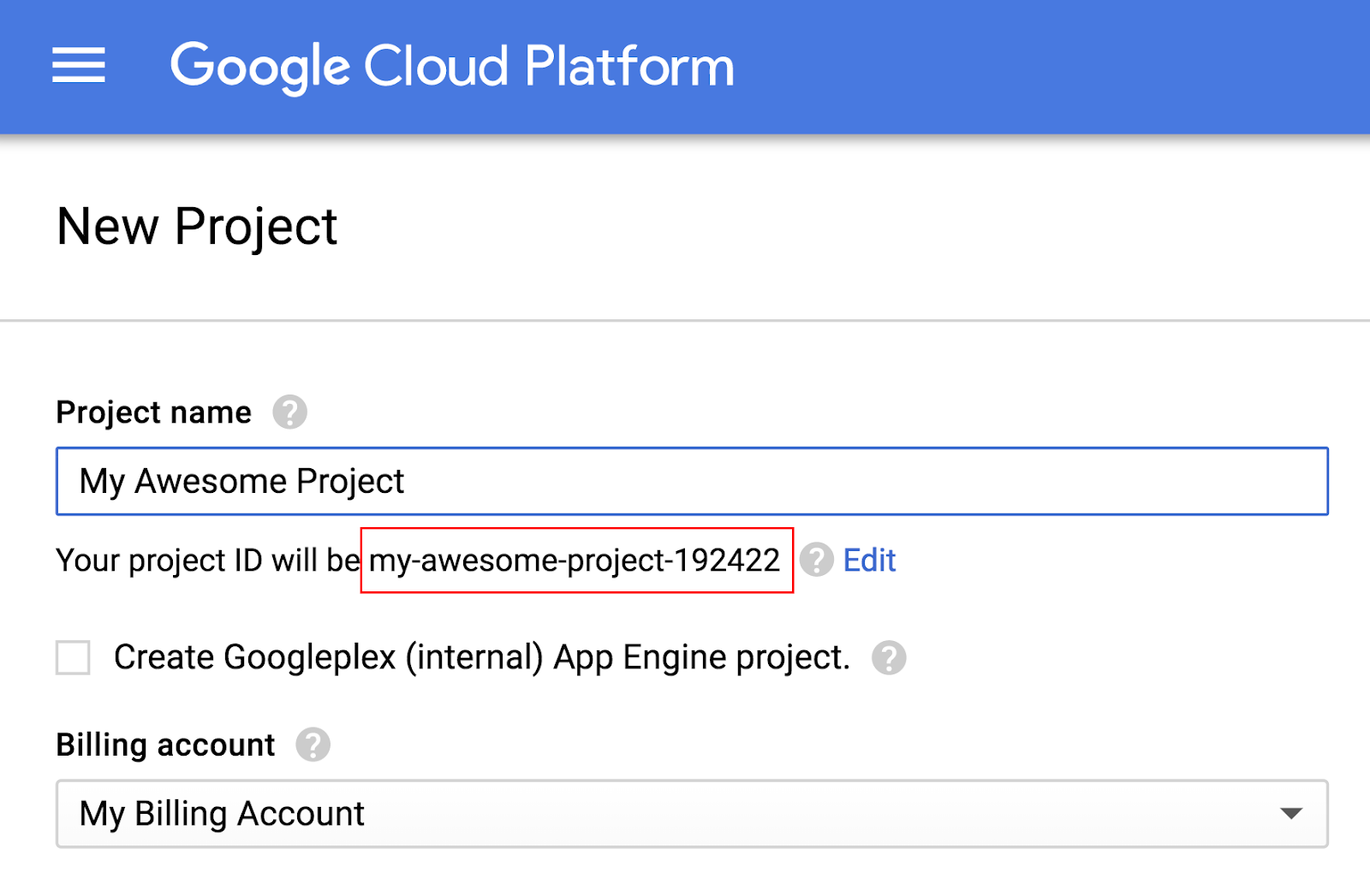

Klicken Sie auf Projekt erstellen.

Geben Sie einen Projektnamen ein. Merken Sie sich die Projekt-ID (im Screenshot oben rot hervorgehoben). Die Projekt-ID muss für alle Google Cloud-Projekte ein eindeutiger Name sein. Wenn Ihr Projektname nicht eindeutig ist, wird in Google Cloud eine zufällige Projekt-ID auf Grundlage des Projektnamens generiert.

Als Nächstes müssen Sie in der Developers Console die Abrechnung aktivieren, um Google Cloud-Ressourcen nutzen zu können.

Dieses Codelab sollte Sie nicht mehr als ein paar Dollar kosten, aber es könnte mehr sein, wenn Sie sich für mehr Ressourcen entscheiden oder wenn Sie sie laufen lassen (siehe Abschnitt „Zusammenfassung“ am Ende dieses Dokuments). Den Google Cloud Platform-Preisrechner finden Sie hier.

Neuen Nutzern der Google Cloud Platform steht eine kostenlose Testversion mit einem Guthaben von 300$ zur Verfügung.

Google Cloud Shell

Während Sie Google Cloud von Ihrem Laptop aus per Fernzugriff nutzen können, wird in diesem Codelab Google Cloud Shell verwendet, eine Befehlszeilenumgebung, die in der Cloud ausgeführt wird.

Google Cloud Shell starten

Klicken Sie in der GCP Console oben rechts in der Symbolleiste auf das Cloud Shell-Symbol:

Klicken Sie dann auf Cloud Shell starten:

Die Bereitstellung und Verbindung mit der Umgebung dauert nur einen Moment:

Diese virtuelle Maschine verfügt über sämtliche Entwicklertools, die Sie benötigen. Sie bietet ein Basisverzeichnis mit 5 GB nichtflüchtigem Speicher und läuft auf Google Cloud, was die Netzwerkleistung erheblich verbessert und die Authentifizierung vereinfacht. Die meisten, wenn nicht sogar alle Aufgaben in diesem Lab können mit einem Webbrowser oder einem Google Chromebook erledigt werden.

Sobald die Verbindung mit der Cloud Shell hergestellt ist, sehen Sie, dass Sie bereits authentifiziert sind und für das Projekt schon Ihre PROJECT_ID eingestellt ist:

$ gcloud auth list

Befehlsausgabe:

Credentialed accounts:

- <myaccount>@<mydomain>.com (active)

$ gcloud config list project

Befehlsausgabe:

[core]

project = <PROJECT_ID>

Wenn die Projekt-ID nicht richtig festgelegt ist, können Sie sie mit diesem Befehl festlegen:

$ gcloud config set project <PROJECT_ID>

Befehlsausgabe:

Updated property [core/project].

3. Lustre-Bereitstellungskonfiguration vorbereiten und überprüfen

Deployment Manager-Skripts für Lustre herunterladen

Führen Sie in der Cloud Shell-Sitzung den folgenden Befehl aus, um das Git-Repository zu klonen (herunterzuladen), das die Deployment Manager-Dateien für Lustre für Google Cloud enthält:

git clone https://github.com/GoogleCloudPlatform/deploymentmanager-samples.git

Wechseln Sie mit dem folgenden Befehl in das Verzeichnis für die Lustre-Bereitstellungskonfiguration:

cd deploymentmanager-samples/community/lustre/

YAML-Datei für die Lustre-Bereitstellung konfigurieren

Deployment Manager verwendet eine YAML-Datei, um die Bereitstellungskonfiguration bereitzustellen. Diese YAML-Datei enthält Details zur Konfiguration des Deployments, z. B. die bereitzustellende Lustre-Version und die bereitzustellenden Maschineninstanztypen. Die Datei ist standardmäßig so konfiguriert, dass sie in einem neuen Projekt ohne Kontingenterhöhungen bereitgestellt wird. Sie können den Maschinentyp oder die Kapazität für dieses Codelab jedoch nach Bedarf ändern. In diesem Codelab werden diese Standardeinstellungen verwendet. Wenn Sie Änderungen vornehmen, müssen Sie diese im gesamten Codelab berücksichtigen, um Fehler zu vermeiden. In der Produktion empfehlen wir für den MDS-Knoten mindestens eine Instanz mit 32 vCPUs und für die OSS-Knoten je nach Speicherkapazität und ‑typ mindestens eine Instanz mit 8 oder 16 vCPUs.

Wenn Sie die YAML-Datei in der Cloud Shell-Sitzung prüfen oder bearbeiten möchten, öffnen Sie die YAML-Datei für die Deployment-Konfiguration Lustre-cluster.yaml. Sie können entweder Ihren bevorzugten Befehlszeileneditor (vi, nano, emacs usw.) oder den Code-Editor der Cloud Console verwenden, um den Dateiinhalt aufzurufen:

Der Inhalt der Datei sieht so aus:

# [START cluster_yaml]

imports:

- path: lustre.jinja

resources:

- name: lustre

type: lustre.jinja

properties:

## Cluster Configuration

cluster_name : lustre

zone : us-central1-f

cidr : 10.20.0.0/16

external_ips : True

### Use these fields to deploy Lustre in an existing VPC, Subnet, and/or Shared VPC

#vpc_net : < VPC Network Name >

#vpc_subnet : < VPC Subnet Name >

#shared_vpc_host_proj : < Shared VPC Host Project name >

## Filesystem Configuration

fs_name : lustre

### Review https://downloads.whamcloud.com/public/ to determine version naming

lustre_version : latest-release

e2fs_version : latest

## Lustre MDS/MGS Node Configuration

#mds_node_count : 1

mds_ip_address : 10.20.0.2

mds_machine_type : n1-standard-8

### MDS/MGS Boot disk

mds_boot_disk_type : pd-standard

mds_boot_disk_size_gb : 10

### Lustre MetaData Target disk

mdt_disk_type : pd-ssd

mdt_disk_size_gb : 1000

## Lustre OSS Configuration

oss_node_count : 4

oss_ip_range_start : 10.20.0.5

oss_machine_type : n1-standard-4

### OSS Boot disk

oss_boot_disk_type : pd-standard

oss_boot_disk_size_gb : 10

### Lustre Object Storage Target disk

ost_disk_type : pd-standard

ost_disk_size_gb : 5000

# [END cluster_yaml]

Diese YAML-Datei enthält mehrere Felder. Die unten mit einem Sternchen (*) gekennzeichneten Felder sind Pflichtfelder. Zu diesen Feldern gehören:

Clusterkonfiguration

- cluster_name* – Name des Lustre-Clusters, der allen bereitgestellten Ressourcen vorangestellt wird

- zone* – Zone, in der der Cluster bereitgestellt werden soll

- cidr* – IP-Bereich im CIDR-Format

- external_ips* – True/False, Lustre-Knoten haben externe IP-Adressen. Wenn „false“, wird Cloud NAT als NAT-Gateway eingerichtet.

- vpc_net: Definieren Sie dieses Feld und das Feld „vpc_subnet“, um den Lustre-Cluster in einer vorhandenen VPC bereitzustellen.

- vpc_subnet: Vorhandenes VPC-Subnetz, in dem der Lustre-Cluster bereitgestellt werden soll

- shared_vpc_host_proj: Definieren Sie dieses Feld sowie die Felder vpc_net und vpc_subnet, um den Cluster in einer freigegebenen VPC bereitzustellen.

Dateisystemkonfiguration

- fs_name – Name des Lustre-Dateisystems

- lustre_version: Die zu bereitstellende Lustre-Version. Verwenden Sie „latest-release“, um den neuesten Branch von https://downloads.whamcloud.com/public/lustre/ bereitzustellen, oder „lustre-X.X.X“, um eine andere Version bereitzustellen.

- e2fs_version: E2fsprogs-Version, die bereitgestellt werden soll. Verwenden Sie „latest“, um den neuesten Branch von https://downloads.whamcloud.com/public/e2fsprogs/ bereitzustellen, oder X.XX.X.wcX, um andere Versionen bereitzustellen.

MDS-/MGS-Konfiguration

- mds_ip_address – Interne IP-Adresse, die für den MDS-/MGS-Knoten angegeben werden soll

- mds_machine_type: Der Maschinentyp, der für den MDS-/MGS-Knoten verwendet werden soll (siehe https://cloud.google.com/compute/docs/machine-types).

- mds_boot_disk_type – Der Laufwerkstyp, der für das MDS-/MGS-Bootlaufwerk verwendet werden soll (pd-standard, pd-ssd)

- mds_boot_disk_size_gb – Größe des MDS-Bootlaufwerks in GB

- mdt_disk_type* – Der Festplattentyp, der für die MDT-Festplatte (Metadata Target) verwendet werden soll (pd-standard, pd-ssd, local-ssd)

- mdt_disk_size_gb* – Größe des MDT-Laufwerks in GB

OSS-Konfiguration

- oss_node_count* – Anzahl der zu erstellenden Objektspeicherserverknoten (OSS)

- oss_ip_range_start – Start des IP-Bereichs für die OSS-Knoten. Wenn nicht angegeben, automatische IP-Zuweisung verwenden

- oss_machine_type – Maschinentyp für OSS-Knoten

- oss_boot_disk_type – Der für das OSS-Bootlaufwerk zu verwendende Laufwerkstyp (pd-standard, pd-ssd)

- oss_boot_disk_size_gb – Größe des MDS-Bootlaufwerks in GB

- ost_disk_type* – Der Laufwerkstyp, der für das OST-Laufwerk (Object Storage Target) verwendet werden soll (pd-standard, pd-ssd, local-ssd)

- ost_disk_size_gb* – Größe des OST-Laufwerks in GB

4. Konfiguration bereitstellen und prüfen

Konfiguration bereitstellen

Führen Sie in der Cloud Shell-Sitzung den folgenden Befehl im Ordner Lustre-gcp aus:

gcloud deployment-manager deployments create lustre --config lustre.yaml

Mit diesem Befehl wird ein Deployment mit dem Namen Lustre erstellt. Der Vorgang kann bis zu 10–20 Minuten dauern. Bitte haben Sie Geduld.

Nach Abschluss der Bereitstellung sehen Sie eine Ausgabe ähnlich der folgenden:

Create operation operation-1572410719018-5961966591cad-e25384f6-d4c905f8 completed successfully.

NAME TYPE STATE ERRORS INTENT

lustre-all-internal-firewall-rule compute.v1.firewall COMPLETED []

lustre-lustre-network compute.v1.network COMPLETED []

lustre-lustre-subnet compute.v1.subnetwork COMPLETED []

lustre-mds1 compute.v1.instance COMPLETED []

lustre-oss1 compute.v1.instance COMPLETED []

lustre-oss2 compute.v1.instance COMPLETED []

lustre-oss3 compute.v1.instance COMPLETED []

lustre-oss4 compute.v1.instance COMPLETED []

lustre-ssh-firewall-rule compute.v1.firewall COMPLETED []

Deployment prüfen

So rufen Sie die Bereitstellung in der Google Cloud Console auf:

- Öffnen Sie in der Cloud Console oben links das Menü Produkte & Dienste (drei horizontale Linien).

- Klicken Sie auf Deployment Manager.

- Klicken Sie auf Lustre, um die Details der Bereitstellung aufzurufen.

- Klicken Sie auf Übersicht – Lustre. Im Bereich Bereitstellungseigenschaften wird die allgemeine Bereitstellungskonfiguration angezeigt.

- Klicken Sie in der Property Config auf View (Anzeigen). Im Bereich Config (Konfiguration) wird der Inhalt der zuvor geänderten YAML-Datei für die Bereitstellungskonfiguration angezeigt. Prüfen Sie, ob die Inhalte korrekt sind, bevor Sie fortfahren. Wenn Sie eine Deployment-Konfiguration ändern müssen, löschen Sie das Deployment einfach gemäß den Schritten unter „Deployment bereinigen“ und starten Sie das Deployment gemäß den Schritten unter „Lustre-Deployment-YAML konfigurieren“ neu.

- Optional: Klicken Sie im Abschnitt Lustre-Cluster auf jede der von der Vorlage „Lustre.jinja“ erstellten Ressourcen und prüfen Sie die Details.

Nachdem die Konfiguration des Deployments überprüft wurde, prüfen wir, ob die Instanzen des Clusters gestartet wurden. Klicken Sie in der Cloud Platform Console im Menü Produkte & Dienste auf Compute Engine > VM-Instanzen.

Sehen Sie sich auf der Seite VM-Instanzen die fünf VM-Instanzen an, die vom Deployment Manager erstellt wurden. Dazu gehören lustre-mds1, lustre-oss1, lustre-oss2, lustre-oss3 und lustre-oss4.

5. Auf den Lustre-Cluster zugreifen

Installation überwachen

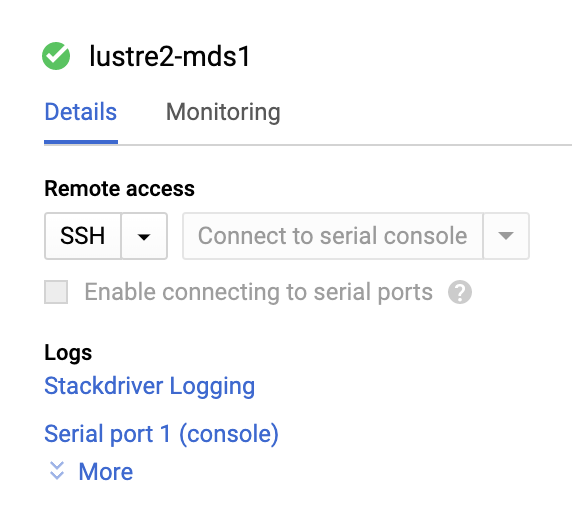

Klicken Sie auf der Seite „VM-Instanzen“ auf lustre-mds1, um die Seite „Instanzdetails“ zu öffnen.

Klicken Sie auf Serieller Port 1 (Konsole), um die Ausgabeseite der seriellen Konsole zu öffnen. Wir verwenden diese serielle Ausgabe, um den Installationsvorgang der MDS-Instanz zu überwachen und zu warten, bis das Start-up-Script abgeschlossen ist. Klicken Sie oben auf der Seite auf die Schaltfläche „Aktualisieren“, um die serielle Ausgabe zu aktualisieren. Der Knoten wird einmal neu gestartet, um den Lustre-Kernel zu starten, und zeigt Meldungen wie die folgenden an:

Startup finished in 838ms (kernel) + 6.964s (initrd) + 49.302s (userspace) = 57.105s.

Lustre: lustre-MDT0000: Connection restored to 374e2d80-0b31-0cd7-b2bf-de35b8119534 (at 0@lo)

Das bedeutet, dass Lustre auf dem Lustre-Cluster installiert ist und das Dateisystem verwendet werden kann.

Auf den Lustre-Cluster zugreifen

Klicken Sie in der Cloud Shell-Sitzung in der Google Cloud Console neben der Instanz lustre-mds1 auf die Schaltfläche SSH. Alternativ können Sie den folgenden Befehl in Cloud Shell ausführen und <ZONE> durch die Zone des lustre-mds1-Knotens ersetzen:

gcloud compute ssh lustre-mds1 --zone=<ZONE>

Mit diesem Befehl wird die Anmeldung bei der virtuellen Maschine „lustre-mds1“ durchgeführt. Dies ist die Lustre-Metadatenserver-Instanz (MDS), die auch als Lustre-Verwaltungsserver-Instanz (MGS) fungiert. Diese Instanz verarbeitet alle Authentifizierungs- und Metadatenanfragen für das Dateisystem.

Wir stellen das Dateisystem auf unserer lustre-mds1-Instanz bereit, damit wir es später testen können. Führen Sie die folgenden Befehle aus:

sudo mkdir /mnt/lustre sudo mount -t lustre lustre-mds1:/lustre /mnt/lustre cd /mnt/lustre

Mit diesen drei Befehlen werden drei Dinge erledigt. Mit dem ersten Befehl wird ein lokales Verzeichnis erstellt, das wir als Bereitstellungspunkt unter „/mnt/lustre“ verwenden. Mit dem zweiten Befehl wird das Dateisystem vom Typ „lustre“ gemountet, das sich auf dem Server „lustre-mds1“ befindet und dessen Dateisystemname „lustre“ ist, was als „/lustre“ angezeigt wird. Mit dem Befehl „mount“ wird das Lustre-Dateisystem in Ihrem lokalen Verzeichnis „/mnt/lustre“ bereitgestellt. Mit dem dritten Befehl wird schließlich das Verzeichnis in /mnt/lustre geändert, in dem Lustre bereitgestellt wird.

Sie haben das Lustre-Dateisystem jetzt unter „/mnt/lustre“ bereitgestellt. Sehen wir uns an, was wir mit diesem Dateisystem tun können.

6. Übersicht über die Lustre-Befehlszeilentools

Wenn Sie mit Lustre und seinen Tools nicht vertraut sind, werden wir hier einige wichtige Befehle durchgehen.

Das Low-Level-Clusterverwaltungstool von Lustre ist „lctl“. Mit lctl können wir den Lustre-Cluster konfigurieren und verwalten sowie die Dienste des Lustre-Clusters aufrufen. Führen Sie Folgendes aus, um die Dienste und Instanzen in unserem neuen Lustre-Cluster aufzurufen:

sudo lctl dl

Je nachdem, welche Änderungen Sie an der YAML-Konfigurationsdatei für Lustre vorgenommen haben, wird eine ähnliche Ausgabe wie unten angezeigt:

0 UP osd-ldiskfs lustre-MDT0000-osd lustre-MDT0000-osd_UUID 11

1 UP mgs MGS MGS 12

2 UP mgc MGC10.128.15.2@tcp 374e2d80-0b31-0cd7-b2bf-de35b8119534 4

3 UP mds MDS MDS_uuid 2

4 UP lod lustre-MDT0000-mdtlov lustre-MDT0000-mdtlov_UUID 3

5 UP mdt lustre-MDT0000 lustre-MDT0000_UUID 12

6 UP mdd lustre-MDD0000 lustre-MDD0000_UUID 3

7 UP qmt lustre-QMT0000 lustre-QMT0000_UUID 3

8 UP lwp lustre-MDT0000-lwp-MDT0000 lustre-MDT0000-lwp-MDT0000_UUID 4

9 UP osp lustre-OST0000-osc-MDT0000 lustre-MDT0000-mdtlov_UUID 4

10 UP osp lustre-OST0002-osc-MDT0000 lustre-MDT0000-mdtlov_UUID 4

11 UP osp lustre-OST0001-osc-MDT0000 lustre-MDT0000-mdtlov_UUID 4

12 UP osp lustre-OST0003-osc-MDT0000 lustre-MDT0000-mdtlov_UUID 4

Unser Lustre-Verwaltungsserver (MGS) ist Element 1, unser Lustre-Metadatenserver (MDS) ist Element 3, unser Lustre-Metadatenziel (MDT) ist Element 5 und unsere vier Lustre-Objektspeicherserver (OSS) sind die Elemente 8 bis 12. Informationen zu den anderen Diensten finden Sie im Lustre-Handbuch.

Das Dateisystemkonfigurationstool von Lustre ist „lfs“. Mit lfs können wir das Striping von Dateien auf unsere Lustre-Objektspeicherserver (OSS) und die entsprechenden Objektspeicherziele (OST) verwalten sowie allgemeine Dateisystemvorgänge wie „find“, „df“ und die Kontingentverwaltung ausführen.

Mit Striping können wir konfigurieren, wie eine Datei auf unserem Lustre-Cluster verteilt wird, um die bestmögliche Leistung zu erzielen. Wenn Sie eine große Datei auf so viele OSSs wie möglich verteilen, wird die E/A parallelisiert und die beste Leistung erzielt. Wenn Sie jedoch eine kleine Datei verteilen, kann die Leistung schlechter sein, als wenn die Datei nur in eine einzelne Instanz geschrieben würde.

Um dies zu testen, richten wir zwei Verzeichnisse ein: eines mit der Streifenzahl 1 und eines mit der Streifenzahl –1. Letzteres gibt an, dass die in diesem Verzeichnis geschriebenen Dateien über so viele OSSs wie möglich verteilt werden sollen. Verzeichnisse können Striping-Konfigurationen enthalten, die von darin erstellten Dateien übernommen werden. Unterverzeichnisse und einzelne Dateien in diesem Verzeichnis können jedoch bei Bedarf anders konfiguriert werden. Um diese beiden Verzeichnisse zu erstellen, führen Sie die folgenden Befehle aus, während Sie sich im Verzeichnis „/mnt/lustre“ befinden:

sudo mkdir stripe_one sudo mkdir stripe_all sudo lfs setstripe -c 1 stripe_one/ sudo lfs setstripe -c -1 stripe_all/

Mit lfs getstripe können Sie die Stripe-Einstellungen einer Datei oder eines Verzeichnisses aufrufen:

sudo lfs getstripe stripe_all/

Die Ausgabe zeigt, dass die Anzahl der Streifen auf „-1“ gesetzt ist:

stripe_all/

stripe_count: -1 stripe_size: 1048576 pattern: raid0 stripe_offset: -1

Jetzt können wir die Leistungssteigerungen testen, die durch das Schreiben einer großen Datei erzielt werden können, die über mehrere OSSs verteilt ist.

7. Lustre-E/A testen

Wir führen zwei einfache Tests der Lustre-E/A durch, um die möglichen Leistungsvorteile und Skalierungsfunktionen des Lustre-Dateisystems zu demonstrieren. Zuerst führen wir einen einfachen Test mit dem Dienstprogramm „dd“ aus, um eine 5 GB große Datei in das Verzeichnis „stripe_one“ zu schreiben. Führen Sie folgenden Befehl aus:

sudo dd if=/dev/zero of=stripe_one/test bs=1M count=5000

Das Schreiben von 5 GB Daten in das Dateisystem dauert durchschnittlich etwa 27 Sekunden, wenn auf eine einzelne Persistent Disk (PD) auf einem einzelnen Object Storage Server (OSS) geschrieben wird.

Um das Striping über mehrere OSSs und damit mehrere PDs hinweg zu testen, müssen wir lediglich das Ausgabeverzeichnis ändern, in das wir schreiben. Führen Sie folgenden Befehl aus:

sudo dd if=/dev/zero of=stripe_all/test bs=1M count=5000

Beachten Sie, dass wir „of=stripe_one/test“ in „of=stripe_all/test“ geändert haben. Dadurch können die Schreibvorgänge auf alle unsere Object Storage-Server verteilt werden und der Schreibvorgang wird im Durchschnitt in 5, 5 Sekunden abgeschlossen, also etwa viermal so schnell wie mit vier OSSs.

Diese Leistung steigt weiter, wenn Sie Objektspeicherserver hinzufügen. Sie können OSSs dem Dateisystem online hinzufügen und Daten darauf verteilen, um Kapazität und Leistung online zu erhöhen. Die Möglichkeiten mit Lustre auf der Google Cloud Platform sind endlos. Wir sind gespannt, was Sie damit entwickeln und welche Probleme Sie damit lösen können.

8. Fazit

Sie haben einen Lustre-Cluster auf der Google Cloud Platform erstellt. Sie können diese Skripts als Ausgangspunkt für die Erstellung Ihres eigenen Lustre-Clusters und für die Integration in Ihren cloudbasierten Computing-Cluster verwenden.

Deployment bereinigen

Melden Sie sich vom Lustre-Knoten ab:

exit

Sie können die Bereitstellung nach Abschluss der Arbeiten ganz einfach bereinigen, indem Sie den folgenden Befehl in Ihrer Google Cloud Shell ausführen, nachdem Sie sich vom Lustre-Cluster abgemeldet haben:

gcloud deployment-manager deployments delete lustre

Geben Sie bei entsprechender Aufforderung Y ein, um fortzufahren. Dieser Vorgang kann einige Zeit dauern. Bitte haben Sie etwas Geduld.

Projekt löschen

Zum Bereinigen löschen wir einfach unser Projekt.

- Wählen Sie im Navigationsmenü „IAM & Verwaltung“ aus.

- Klicken Sie dann im Untermenü auf „Einstellungen“.

- Klicken Sie auf das Papierkorbsymbol mit dem Text „Projekt löschen“.

- Anleitung in den Prompts befolgen

Behandelte Themen

- Verwendung des GCP Deployment Manager-Dienstes

- Informationen zum Konfigurieren und Bereitstellen eines Lustre-Dateisystems in der GCP.

- So konfigurieren Sie Striping und testen einfache E/A-Vorgänge für das Lustre-Dateisystem.

Support kontaktieren

Haben Sie etwas Cooles mit den Deployment Manager-Scripts für Lustre erstellt? Hast du Fragen? Chatten Sie mit uns in der Google Cloud Lustre-Diskussionsgruppe. Wenn Sie Funktionen anfordern, Feedback geben oder Fehler melden möchten, verwenden Sie dieses Formular. Sie können den Code auch ändern und eine Pull-Anfrage senden. Möchten Sie mit einem Google Cloud-Experten sprechen? Wenden Sie sich noch heute über die Website für Hochleistungs-Computing von Google Cloud an das Google Cloud-Team.

Weitere Informationen

Feedback

Über diesen Link können Sie Feedback zu diesem Codelab geben. Das Feedback dauert weniger als 5 Minuten. Vielen Dank!