1. מבוא

סקירה כללית

בשיעור ה-Lab הזה תכירו כמה מהתכונות של Network Connectivity Center.

Network Connectivity Center (NCC) הוא מודל של מישור בקרה מסוג Hub-and-Spoke לניהול קישוריות לרשת ב-Google Cloud. משאב ה-hub מספק מודל ריכוזי לניהול קישוריות כדי לקשר בין רשתות spoke. בשלב הזה, NCC תומך במשאבי הרשת הבאים כרכזות:

- צירופים ל-VLAN

- נתבים וירטואליים

- HA VPN

ב-Codelabs נדרש שימוש ב-SaaS של flexiWAN, שהוא פתרון SD-WAN שמפשט את הפריסה והניהול של WAN. flexWAN הוא פתרון SD-WAN ו-SASE בקוד פתוח.

מה תפַתחו

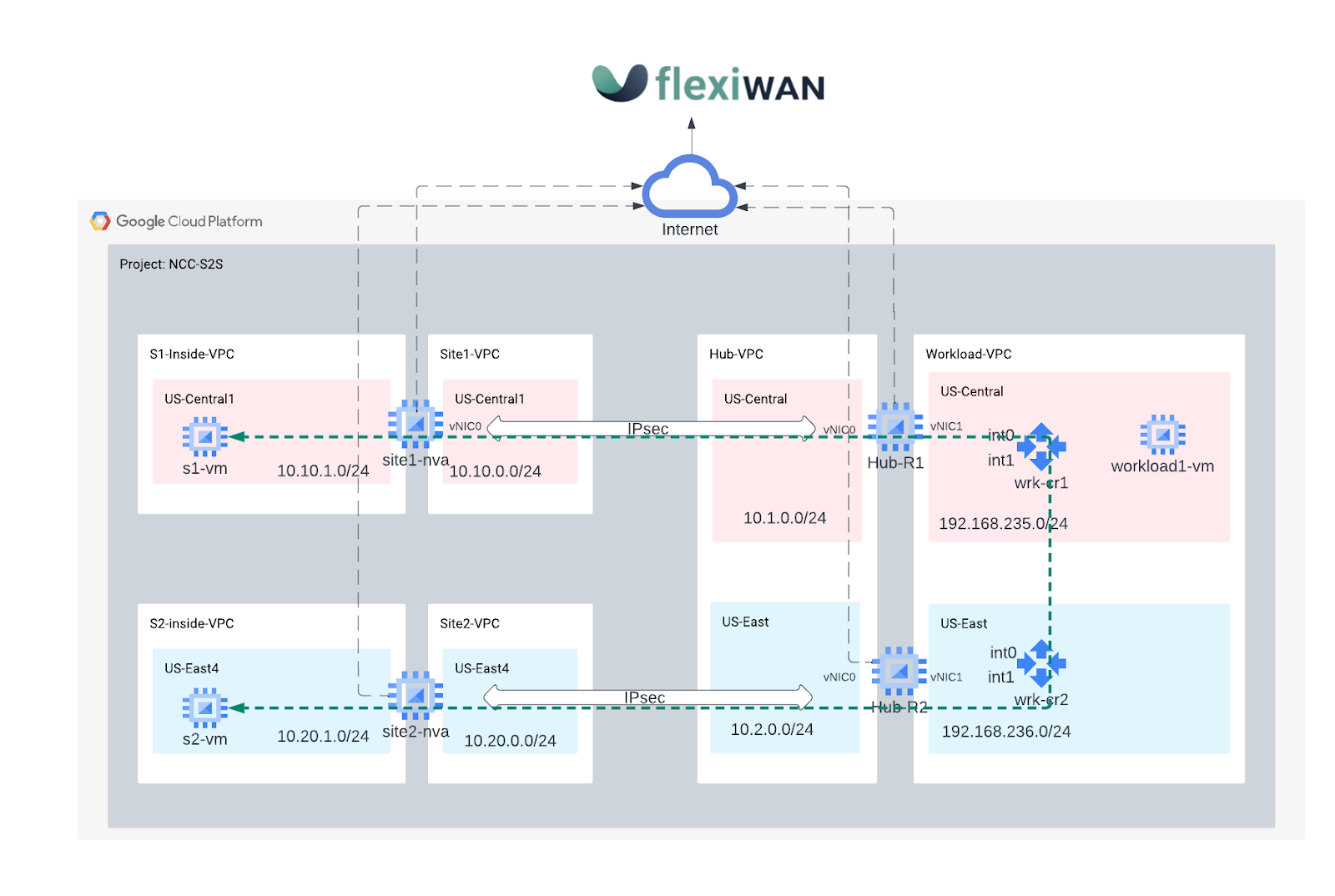

ב-codelab הזה, תיצרו טופולוגיית SD-WAN של רכזת וחישורים כדי לדמות אתרים של סניפים מרוחקים שיעברו ברשת בשדרה מרכזית של Google לצורך תקשורת בין אתר לענן ובין אתר לאתר.

- תפרסו זוג מכונות וירטואליות של GCE שהוגדרו לסוכן SD-WAN של flexiWAN ב-VPC של הרכזת, שמייצג את נקודות הקצה של תעבורת הנתונים הנכנסת והיוצאת אל GCP.

- פריסת שני נתבי flexiWAN SD-WAN מרוחקים כדי לייצג שני אתרי סניפים שונים של VPC

- לצורך בדיקת נתיב הנתונים, תגדירו שלוש מכונות וירטואליות של GCE כדי לדמות לקוחות מקומיים ושרת שמתארח ב-GCP.

מה תלמדו

- שימוש ב-NCC כדי ליצור קישוריות בין סניפים מרוחקים באמצעות פתרון WAN מוגדר באמצעות תוכנה בקוד פתוח

- ניסיון מעשי בפתרון WAN מוגדר-תוכנה בקוד פתוח

מה תצטרכו

- ידע ברשת VPC של GCP

- ידע ב-Cloud Router ובניתוב BGP

- ה-Codelab דורש 6 רשתות VPC. בודקים את המיכסה:רשתות ומבקשים להוסיף רשתות נוספות אם צריך. צילום מסך בהמשך:

2. מטרות

- הגדרת סביבת GCP

- פריסת מופעי flexiWAN Edge ב-GCP

- הגדרה של NCC Hub ו-flexiWAN Edge NVA כ-spoke

- הגדרה וניהול של מופעי flexiWAN באמצעות flexiManage

- הגדרת החלפת מסלולים של BGP בין vpc-app-svcs לבין flexiWAN NVA

- יצירת אתר מרוחק שמדמה סניף מרוחק של לקוח או מרכז נתונים

- יצירת מנהרת IPSEC בין האתר המרוחק לבין NVA

- אימות הפריסה של מכשירי ה-appliance

- אימות העברת נתונים מאתר לענן

- אימות העברת נתונים מאתר לאתר

- פינוי המשאבים שבהם השתמשתם

כדי לאמת, להוסיף ולנהל מופעים של flexiEdge, צריך ליצור חשבון flexiManage בחינם.

לפני שמתחילים

שימוש במסוף Google Cloud וב-Cloud Shell

במהלך שיעור ה-Lab הזה נשתמש גם במסוף Google Cloud וגם ב-Cloud Shell כדי ליצור אינטראקציה עם GCP.

Google Cloud Console

אפשר להיכנס ל-Cloud Console בכתובת https://console.cloud.google.com.

כדי להקל על הגדרת Network Connectivity Center, צריך להגדיר את הפריטים הבאים ב-Google Cloud:

במסוף Google Cloud, בדף לבחירת הפרויקט בענן, בוחרים פרויקט בענן או יוצרים פרויקט בענן חדש.

מפעילים את Cloud Shell. ב-Codelab הזה נעשה שימוש במשתנים ( $variables) כדי להקל על הטמעת ההגדרה של gcloud ב-Cloud Shell.

gcloud config list project

gcloud config set project [YOUR-PROJECT-NAME]

projectname=[YOUR-PROJECT-NAME]

echo $projectname

תפקידי IAM

כדי לגשת לממשקי API ספציפיים, צריך להקצות תפקידים ב-IAM ל-NCC. חשוב להקפיד להגדיר את המשתמש עם תפקידי ה-IAM של NCC לפי הצורך.

שם התפקיד | תיאור | הרשאות |

networkconnectivity.networkAdmin | מאפשרת לאדמינים של רשתות לנהל רכזות וחיבורים. | networkconnectivity.hubs.networkconnectivity.spokes. |

networkconnectivity.networkSpokeManager | מאפשרת להוסיף ולנהל רשתות מסוג Spoke ב-Hub. לשימוש ב-VPC משותף שבו הפרויקט המארח הוא הבעלים של ה-Hub, אבל אדמינים אחרים בפרויקטים אחרים יכולים להוסיף רשתות מסוג Spoke לחיבורים שלהם ל-Hub. | networkconnectivity.spokes.** |

networkconnectivity.networkUsernetworkconnectivity.networkViewer | מאפשר למשתמשים ברשת לראות מאפיינים שונים של רכזות ושל רשתות היקפיות. | networkconnectivity.hubs.getnetworkconnectivity.hubs.listnetworkconnectivity.spokes.getnetworkconnectivity.spokes.listnetworkconnectivity.spokes.aggregatedList |

3. הגדרת סביבת Lab לרשת

סקירה כללית

בקטע הזה נסביר איך פורסים את רשתות ה-VPC ואת כללי חומת האש.

הדמיה של רשתות אתרים של סניפים מקומיים

רשת ה-VPC הזו מכילה רשתות משנה למכונות וירטואליות מקומיות.

יוצרים את הרשתות והרשתות המשנה של האתר המקומי:

gcloud compute networks create site1-vpc \

--subnet-mode custom

gcloud compute networks create site2-vpc \

--subnet-mode custom

gcloud compute networks create s1-inside-vpc \

--subnet-mode custom

gcloud compute networks create s2-inside-vpc \

--subnet-mode custom

gcloud compute networks subnets create site1-subnet \

--network site1-vpc \

--range 10.10.0.0/24 \

--region us-central1

gcloud compute networks subnets create site2-subnet \

--network site2-vpc \

--range 10.20.0.0/24 \

--region us-east4

gcloud compute networks subnets create s1-inside-subnet \

--network s1-inside-vpc \

--range 10.10.1.0/24 \

--region us-central1

gcloud compute networks subnets create s2-inside-subnet \

--network s2-inside-vpc \

--range 10.20.1.0/24 \

--region us-east4

יוצרים כללים לחומת האש של site1-vpc כדי לאפשר:

- SSH, internal, IAP

- ESP, UDP/500, UDP/4500

- טווח 10.0.0.0/8

- טווח 192.168.0.0/16

gcloud compute firewall-rules create site1-ssh \--network site1-vpc \

--allow tcp:22

gcloud compute firewall-rules create site1-internal \

--network site1-vpc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create site1-cloud \

--network site1-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute firewall-rules create site1-vpn \

--network site1-vpc \

--allow esp,udp:500,udp:4500 \

--target-tags router

gcloud compute firewall-rules create site1-iap \

--network site1-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

יוצרים כללים לחומת האש של site2-vpc כדי לאפשר:

- SSH, internal, IAP

- טווח 10.0.0.0/8

- טווח 192.168.0.0/16

gcloud compute firewall-rules create site2-ssh \

--network site2-vpc \

--allow tcp:22

gcloud compute firewall-rules create site2-internal \

--network site2-vpc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create site2-cloud \

--network site1-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute firewall-rules create site2-vpn \

--network site1-vpc \

--allow esp,udp:500,udp:4500 \

--target-tags router

gcloud compute firewall-rules create site2-iap \

--network site2-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

יוצרים כללים לחומת האש s1-inside-vpc כדי לאפשר:

- SSH, internal, IAP

- טווח 10.0.0.0/8

- טווח 192.168.0.0/16

gcloud compute firewall-rules create s1-inside-ssh \

--network s1-inside-vpc \

--allow tcp:22

gcloud compute firewall-rules create s1-inside-internal \

--network s1-inside-vpc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create s1-inside-cloud \

--network s1-inside-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute firewall-rules create s1-inside-iap \

--network site2-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

יוצרים כללים לחומת האש s2-inside-vpc כדי לאפשר:

- SSH, internal, IAP

- טווח 10.0.0.0/8

- טווח 192.168.0.0/16

gcloud compute firewall-rules create s2-inside-ssh \

--network s2-inside-vpc \

--allow tcp:22

gcloud compute firewall-rules create s2-inside-internal \

--network s2-inside-vpc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create s2-inside-cloud \

--network s2-inside-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute firewall-rules create s2-inside-iap \

--network site2-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

למטרות בדיקה, יוצרים את המכונות s1-inside-vm ו-s2-inside-vm

gcloud compute instances create s1-vm \

--zone=us-central1-a \

--machine-type=e2-micro \

--network-interface subnet=s1-inside-subnet,private-network-ip=10.10.1.3,no-address

gcloud compute instances create s2-vm \

--zone=us-east4-b \

--machine-type=e2-micro \

--network-interface subnet=s2-inside-subnet,private-network-ip=10.20.1.3,no-address

הדמיה של סביבת רשת בענן של GCP

כדי להפעיל תעבורת נתונים בין אזורים באתרים דרך רשת hub-vpc וה-spokes, צריך להפעיל ניתוב גלובלי ברשת hub-vpc. מידע נוסף זמין במאמר בנושא החלפת נתיבים ב-NCC.

- יצירת רשת

hub-vpcותת-רשתות:

gcloud compute networks create hub-vpc \

--subnet-mode custom \

--bgp-routing-mode=global

gcloud compute networks subnets create hub-subnet1 \

--network hub-vpc \

--range 10.1.0.0/24 \

--region us-central1

gcloud compute networks subnets create hub-subnet2 \

--network hub-vpc \

--range 10.2.0.0/24 \

--region us-east4

- יצירת רשת

workload-vpcותת-רשתות:

gcloud compute networks create workload-vpc \

--subnet-mode custom \

--bgp-routing-mode=global

gcloud compute networks subnets create workload-subnet1 \

--network workload-vpc \

--range 192.168.235.0/24 \

--region us-central1

gcloud compute networks subnets create workload-subnet2 \

--network workload-vpc \

--range 192.168.236.0/24 \

--region us-east4

- יוצרים כללים של חומת אש ב-Hub-VPC כדי לאפשר:

- SSH

- ESP, UDP/500, UDP/4500

- טווח פנימי 10.0.0.0/8 (שכולל את יציאת TCP 179 שנדרשת לסשן BGP מ-Cloud Router למכשיר הנתב)

gcloud compute firewall-rules create hub-ssh \

--network hub-vpc \

--allow tcp:22

gcloud compute firewall-rules create hub-vpn \

--network hub-vpc \

--allow esp,udp:500,udp:4500 \

--target-tags router

gcloud compute firewall-rules create hub-internal \

--network hub-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute firewall-rules create hub-iap \

--network hub-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

- יוצרים כללים לחומת האש של Workload-VPC כדי לאפשר:

- SSH

- טווח פנימי 192.168.0.0/16 (שכולל את יציאת TCP 179 שנדרשת לסשן BGP מנתב בענן למכשיר הנתב)

gcloud compute firewall-rules create workload-ssh \

--network workload-vpc \

--allow tcp:22

gcloud compute firewall-rules create workload-internal \

--network workload-vpc \

--allow all \

--source-ranges 192.168.0.0/16

gcloud compute --project=$projectname firewall-rules create allow-from-site-1-2 --direction=INGRESS --priority=1000 --network=workload-vpc --action=ALLOW --rules=all --source-ranges=10.10.1.0/24,10.20.1.0/24

gcloud compute firewall-rules create workload-onprem \

--network hub-vpc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create workload-iap \

--network workload-vpc --allow tcp:22 --source-ranges=35.235.240.0/20

- הפעלת Cloud NAT ב-workload-VPC כדי לאפשר למכונה workload1-vm להוריד חבילות על ידי יצירת Cloud Router ו-NAT Gateway

gcloud compute routers create cloud-router-usc-central-1-nat \

--network workload-vpc \

--region us-central1

gcloud compute routers nats create cloudnat-us-central1 \

--router=cloud-router-usc-central-1-nat \

--auto-allocate-nat-external-ips \

--nat-all-subnet-ip-ranges \

--region us-central1

- יוצרים את

workload1-vmin "us-central1-a" inworkload-VPC. תשתמשו במארח הזה כדי לאמת את הקישוריות בין האתר לבין הענן.

gcloud compute instances create workload1-vm \

--project=$projectname \

--machine-type=e2-micro \

--image-family debian-10 \

--image-project debian-cloud \

--zone us-central1-a \

--private-network-ip 192.168.235.3 \

--no-address \

--subnet=workload-subnet1 \

--metadata startup-script="#! /bin/bash

sudo apt-get update

sudo apt-get install apache2 -y

sudo service apache2 restart

echo 'Welcome to Workload VM1 !!' | tee /var/www/html/index.html

EOF"

4. הגדרת מכשירי On Prem ל-SD-WAN

יצירת מכונה וירטואלית מקומית ל-SDWAN (מכשירי רשת)

בקטע הבא ניצור מכשירי נתב site1-nva ו-site2-nva שיפעלו כנתבים מקומיים.

יצירת מכונות

יוצרים את מכשיר site1-router בשם site1-nva

gcloud compute instances create site1-nva \

--zone=us-central1-a \

--machine-type=e2-medium \

--network-interface subnet=site1-subnet \

--network-interface subnet=s1-inside-subnet,no-address \

--create-disk=auto-delete=yes,boot=yes,device-name=flex-gcp-nva-1,image=projects/ubuntu-os-cloud/global/images/ubuntu-1804-bionic-v20220901,mode=rw,size=20,type=projects/$projectname/zones/us-central1-a/diskTypes/pd-balanced \

--no-shielded-secure-boot \

--shielded-vtpm \

--shielded-integrity-monitoring \

--reservation-affinity=any \

--can-ip-forward

יוצרים את הנתב הווירטואלי site2-router בשם site2-nva

gcloud compute instances create site2-nva \

--zone=us-east4-b \

--machine-type=e2-medium \

--network-interface subnet=site2-subnet \

--network-interface subnet=s2-inside-subnet,no-address \

--create-disk=auto-delete=yes,boot=yes,device-name=flex-gcp-nva-1,image=projects/ubuntu-os-cloud/global/images/ubuntu-1804-bionic-v20220901,mode=rw,size=20,type=projects/$projectname/zones/us-east4-a/diskTypes/pd-balanced \

--no-shielded-secure-boot \

--shielded-vtpm \

--shielded-integrity-monitoring \

--reservation-affinity=any \

--can-ip-forward

5. התקנה של flexiWAN באתר site1-nva

פותחים חיבור SSH אל site1-nva, ואם חלף הזמן הקצוב לתפוגה, מנסים שוב

gcloud compute ssh site1-nva --zone=us-central1-a

התקנה של flexiWAN ב-site1-nva

sudo su

sudo curl -sL https://deb.flexiwan.com/setup | sudo bash -

apt install flexiwan-router -y

הכנת המכונה הווירטואלית (VM) לרישום במישור הבקרה של flexiWAN.

אחרי שמתקינים את flexiWAN, מריצים את הפקודה fwsystem_checker כדי לבדוק את הגדרות המערכת. הפקודה הזו בודקת את דרישות המערכת ועוזרת לתקן שגיאות בהגדרות המערכת.

- בוחרים באפשרות

2להגדרה מהירה ושקטה - ואז יוצאים עם 0.

- לא לסגור את חלון Cloud Shell.

root@site-1-nva-1:/home/user# fwsystem_checker

<output snipped>

[0] - quit and use fixed parameters

1 - check system configuration

2 - configure system silently

3 - configure system interactively

4 - restore system checker settings to default

------------------------------------------------

Choose: 2

<output snipped>

[0] - quit and use fixed parameters

1 - check system configuration

2 - configure system silently

3 - configure system interactively

4 - restore system checker settings to default

------------------------------------------------

Choose: 0

Please wait..

Done.

=== system checker ended ====

משאירים את הסשן פתוח כדי לבצע את השלבים הבאים

6. רישום של site1-nva בבקר SD-WAN

השלבים האלה נדרשים כדי להשלים את הקצאת ה-NVA של flexiWAN שמנוהל ממסוף flexiManage. חשוב לוודא שהארגון ב-flexiWAN מוגדר לפני שממשיכים.

כדי לאמת את ה-NVA החדש של flexiWAN עם flexiManage באמצעות טוקן אבטחה, צריך להיכנס לחשבון flexiManage. אפשר לעשות שימוש חוזר באותו טוקן בכל מכשירי הנתב.

בוחרים באפשרות מלאי שטחי פרסום → טוקנים,יוצרים טוקן ובוחרים באפשרות 'העתקה'.

חוזרים אל Cloud Shell (site1-nva) ומדביקים את האסימון בספרייה /etc/flexiwan/agent/token.txt באמצעות הפעולות הבאות:

nano /etc/flexiwan/agent/token.txt

#Paste the generated token obtain from flexiManage

#Exit session with CTRL+X and Select Y to save then enter

הפעלת נתבי האתרים במסוף flexiManage

מתחברים למסוף flexiManage כדי להפעיל את site1-nva בבקר.

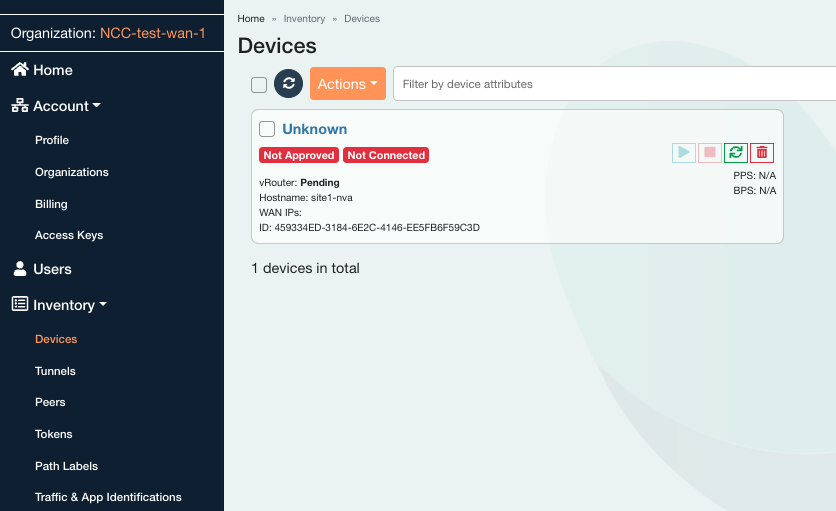

בחלונית שמימין, בוחרים באפשרות 'מלאי' ← 'מכשירים' ולוחצים על המכשיר 'לא ידוע'.

מזינים את שם המארח של site1-nva ומאשרים את המכשיר על ידי הזזת החוגה שמאלה.

בוחרים בכרטיסייה ממשקים.

מחפשים את העמודה Assigned (הוקצה) ולוחצים על No (לא) כדי לשנות את ההגדרה ל-Yes (כן).

בוחרים בכרטיסייה Firewall (חומת אש) ולוחצים על הסימן + כדי להוסיף כלל inbound firewall (חומת אש לתעבורה נכנסת).

בוחרים את ממשק ה-WAN כדי להחיל את כלל ה-SSH כמו שמתואר בהמשך

לוחצים על עדכון המכשיר.

מפעילים את site1-nva מבקר flexiWAN. חוזרים אל Inventory → Devices → site1-nva (מלאי > מכשירים > site1-nva) ובוחרים באפשרות Start Device (הפעלת המכשיר).

סטטוס – סנכרון

סטטוס – הושלם סנכרון

אינדיקטור האזהרה מוצג בקטע פתרון בעיות → התראות. אחרי שצופים בהודעות, בוחרים את כולן ומסמנים אותן כהודעות שנקראו

7. התקנה של flexiWAN ב-site2-nva

פותחים כרטיסייה חדשה ויוצרים סשן Cloud Shell, מעדכנים את המשתנים $כדי לעזור בהטמעה של הגדרת gcloud

gcloud config list project

gcloud config set project [YOUR-PROJECT-NAME]

projectname=[YOUR-PROJECT-NAME]

echo $projectname

פותחים חיבור SSH אל site2-nva, ואם חלף הזמן הקצוב לתפוגה מנסים שוב

gcloud compute ssh site2-nva --zone=us-east4-b

התקנה של flexiWAN ב-site2-nva

sudo su

sudo curl -sL https://deb.flexiwan.com/setup | sudo bash -

apt install flexiwan-router -y

הכנת המכונה הווירטואלית (VM) לרישום במישור הבקרה של flexiWAN.

אחרי שמתקינים את flexiWAN, מריצים את הפקודה fwsystem_checker כדי לבדוק את הגדרות המערכת. הפקודה הזו בודקת את דרישות המערכת ועוזרת לתקן שגיאות בהגדרות המערכת.

- בוחרים באפשרות

2להגדרה מהירה ושקטה - ואז יוצאים עם 0.

- לא לסגור את חלון Cloud Shell.

root@site2-nva:/home/user# fwsystem_checker

<output snipped>

[0] - quit and use fixed parameters

1 - check system configuration

2 - configure system silently

3 - configure system interactively

4 - restore system checker settings to default

------------------------------------------------

Choose: 2

<output snipped>

[0] - quit and use fixed parameters

1 - check system configuration

2 - configure system silently

3 - configure system interactively

4 - restore system checker settings to default

------------------------------------------------

Choose: 0

Please wait..

Done.

=== system checker ended ====

8. רישום של site2-nva ב-SD-WAN Controller

השלבים האלה נדרשים כדי להשלים את הקצאת ה-NVA של flexiWAN שמנוהל ממסוף flexiManage. חשוב לוודא שהארגון ב-flexiWAN מוגדר לפני שממשיכים.

כדי לאמת את ה-NVA החדש של flexiWAN עם flexiManage באמצעות טוקן אבטחה, צריך להיכנס לחשבון flexiManage. אפשר לעשות שימוש חוזר באותו טוקן בכל מכשירי הנתב.

בוחרים באפשרות 'מלאי שטחי פרסום' ← 'טוקנים', יוצרים טוקן ובוחרים באפשרות 'העתקה'

חוזרים אל Cloud Shell (site2-nva) ומדביקים את האסימון בספרייה /etc/flexiwan/agent/token.txt באמצעות הפעולות הבאות:

nano /etc/flexiwan/agent/token.txt

#Paste the generated token obtain from flexiManage

#Exit session with CTRL+X and Select Y to save then enter

הפעלת נתבי האתרים מ-flexiManage Console

מתחברים למסוף flexiManage כדי להפעיל את site2-nva בבקר.

בחלונית שמימין, בוחרים באפשרות 'מלאי' ← 'מכשירים' ולוחצים על המכשיר 'לא ידוע'.

מזינים את שם המארח של site2-nva ומאשרים את המכשיר על ידי הזזת החוגה שמאלה.

בוחרים בכרטיסייה ממשקים.

מחפשים את העמודה Assigned (הוקצה) ולוחצים על No (לא) כדי לשנות את ההגדרה ל-Yes (כן).

בוחרים באפשרות Firewall Tab (כרטיסיית חומת האש) ולוחצים על הסימן + כדי להוסיף כלל inbound firewall (חומת אש לתעבורה נכנסת). בוחרים את ממשק ה-WAN כדי להחיל את כלל ה-SSH כמו שמתואר בהמשך

לוחצים על עדכון המכשיר.

מפעילים את site2-nva מבקר flexiWAN. חוזרים אל Inventory → Devices → site2-nva ובוחרים באפשרות Start Device.

סטטוס – סנכרון

סטטוס – הושלם סנכרון

אינדיקטור האזהרה מוצג בקטע פתרון בעיות → התראות. אחרי שצופים בהודעות, בוחרים את כולן ומסמנים אותן כהודעות שנקראו

9. הגדרת מכשירי SDWAN של רכזת

בקטע הבא תיצרו ותירשמו את נתבי ה-Hub (hub-r1 ו-hub-r2) ב-flexiWAN Controller, כמו שביצעתם קודם עם נתיבי האתר.

פותחים כרטיסייה חדשה ויוצרים סשן Cloud Shell, מעדכנים את המשתנים $כדי לעזור בהטמעה של הגדרת gcloud

gcloud config list project

gcloud config set project [YOUR-PROJECT-NAME]

projectname=[YOUR-PROJECT-NAME]

echo $projectname

יצירת מופעים של NVA במרכז

יוצרים את מכשיר hub-r1:

gcloud compute instances create hub-r1 \

--zone=us-central1-a \

--machine-type=e2-medium \

--network-interface subnet=hub-subnet1 \

--network-interface subnet=workload-subnet1,no-address \

--can-ip-forward \

--create-disk=auto-delete=yes,boot=yes,device-name=flex-gcp-nva-1,image=projects/ubuntu-os-cloud/global/images/ubuntu-1804-bionic-v20220901,mode=rw,size=20,type=projects/$projectname/zones/us-central1-a/diskTypes/pd-balanced \

--no-shielded-secure-boot \

--shielded-vtpm \

--shielded-integrity-monitoring \

--reservation-affinity=any

יוצרים את מכשיר hub-r2:

gcloud compute instances create hub-r2 \

--zone=us-east4-b \

--machine-type=e2-medium \

--network-interface subnet=hub-subnet2 \

--network-interface subnet=workload-subnet2,no-address \

--can-ip-forward \

--create-disk=auto-delete=yes,boot=yes,device-name=flex-gcp-nva-1,image=projects/ubuntu-os-cloud/global/images/ubuntu-1804-bionic-v20220901,mode=rw,size=20,type=projects/$projectname/zones/us-east4-a/diskTypes/pd-balanced \

--no-shielded-secure-boot \

--shielded-vtpm \

--shielded-integrity-monitoring \

--reservation-affinity=any

10. התקנה של flexiWAN במופעי Hub עבור hub-r1

פותחים חיבור SSH ל-hub-r1

gcloud compute ssh hub-r1 --zone=us-central1-a

התקנת סוכן flexiWAN בשני הרכזות hub-r1

sudo su

sudo curl -sL https://deb.flexiwan.com/setup | sudo bash -

apt install flexiwan-router -y

הכנת מכונות וירטואליות מסוג hub-r1 לרישום ב-flexiWAN.

אחרי שמתקינים את flexiWAN, מריצים את הפקודה fwsystem_checker כדי לבדוק את הגדרות המערכת. הפקודה הזו בודקת את דרישות המערכת ועוזרת לתקן שגיאות בהגדרות המערכת.

root@hub-r1:/home/user# fwsystem_checker

- בוחרים באפשרות

2להגדרה מהירה ושקטה - ואז יוצאים עם 0.

- לא לסגור את חלון Cloud Shell.

11. רישום מכונות וירטואליות מסוג hub-r1 בבקר flexiManage

כדי לאמת את ה-NVA החדש של flexiWAN עם flexiManage באמצעות טוקן אבטחה, צריך להיכנס לחשבון flexiManage.

- בוחרים באפשרות מלאי שטחי פרסום → טוקנים ומעתיקים את הטוקן.

חוזרים אל Cloud Shell (hub-r1) ומדביקים את האסימון בספרייה /etc/flexiwan/agent/token.txt באמצעות הפעולות הבאות:

nano /etc/flexiwan/agent/token.txt

#Paste the generated token obtain from flexiManage

#Exit session with CTRL+X and Select Y to save then enter

12. התקנה של flexiWAN במופעי Hub עבור hub-r2

פותחים חיבור SSH ל-hub-r2

gcloud compute ssh hub-r2 --zone=us-east4-b

התקנת סוכן flexiWAN בשני הרכזות hub-r2

sudo su

sudo curl -sL https://deb.flexiwan.com/setup | sudo bash -

apt install flexiwan-router -y

הכנת מכונות וירטואליות מסוג hub-r2 לרישום ב-flexiWAN.

אחרי שמתקינים את flexiWAN, מריצים את הפקודה fwsystem_checker כדי לבדוק את הגדרות המערכת. הפקודה הזו בודקת את דרישות המערכת ועוזרת לתקן שגיאות בהגדרות המערכת.

root@hub-r2:/home/user# fwsystem_checker

- בוחרים באפשרות

2להגדרה מהירה ושקטה - ואז יוצאים עם 0.

- לא לסגור את חלון Cloud Shell.

13. רישום של מכונות וירטואליות מסוג hub-r2 בבקר flexiManage

כדי לאמת את ה-NVA החדש של flexiWAN עם flexiManage באמצעות טוקן אבטחה, צריך להיכנס לחשבון flexiManage.

- בוחרים באפשרות מלאי שטחי פרסום → טוקנים ומעתיקים את הטוקן.

חוזרים אל Cloud Shell (hub-r2) ומדביקים את האסימון בספרייה /etc/flexiwan/agent/token.txt באופן הבא:

nano /etc/flexiwan/agent/token.txt

#Paste the generated token obtain from flexiManage

#Exit session with CTRL+X and Select Y to save then enter

הפעלה של נתבי רכזת hub-r1 ב-flexiManage Console

כניסה ל-flexiManage Console

- עוברים אל Inventory → Devices (מלאי שטחי פרסום → מכשירים).

- מחפשים את שם המארח של hub-r1 ושל hub-r2 ורושמים אותו. אם השם של שניהם הוא unknown,

בוחרים במכשיר הלא ידוע עם שם המארח hub-r1.

- מזינים את שם המארח של hub-r1

- מאשרים את המכשיר. מזיזים את החוגה שמאלה.

בוחרים בכרטיסייה ממשקים.

- חיפוש העמודה Assigned (הוקצה)

- לצד שורת הממשק, לוחצים על 'לא' כדי לשנות את ההגדרה ל'כן'.

בוחרים בכרטיסייה Firewall (חומת אש).

- לוחצים על + כדי להוסיף כלל חומת אש לתעבורה נכנסת.

- בחירת ממשק ה-WAN להעברת הכלל

- אישור יציאת SSH 22 עם פרוטוקול TCP

- לוחצים על עדכון המכשיר.

הפעלת מכשיר hub-r1 ל-SD-WAN מהבקר של flexiWAN

- חוזרים אל Inventory → Devices → hub-r1

בוחרים באפשרות הפעלת המכשיר.

- ממתינים לסיום הסנכרון ורושמים את הסטטוס running.

הפעלת נתבי הרכזת hub-r2 ב-flexiManage Console

בוחרים במכשיר הלא ידוע עם שם המארח hub-r2

- מזינים את שם המארח של hub-r2

- מאשרים את המכשיר. מחליקים את החוגה שמאלה.

בוחרים בכרטיסייה Interfaces (ממשקים).

- חיפוש העמודה Assigned (הוקצה)

- לצד השורה של הממשק, לוחצים על No כדי לשנות את ההגדרה ל-Yes.

בוחרים באפשרות Firewall Tab (כרטיסיית חומת האש).

- לוחצים על + כדי להוסיף כלל חומת אש לתעבורה נכנסת.

- בחירת ממשק ה-WAN להעברת הכלל

- אישור יציאת SSH 22 עם פרוטוקול TCP

- לוחצים על הוספת כלל.

- לוחצים על עדכון המכשיר.

הפעלת מכשיר hub-r2 ל-SD-WAN מהבקר של flexiWAN

- חוזרים אל Inventory → Devices → hub-r2 (מלאי > מכשירים > hub-r2), בוחרים באפשרות Start Device (הפעלת המכשיר).

- ממתינים לסיום הסנכרון ורושמים את הסטטוס running.

14. Network Connectivity Center ב-GCP Hub

הפעלת שירותי API

אם ה-API של קישוריות הרשת עדיין לא מופעל, צריך להפעיל אותו:

gcloud services enable networkconnectivity.googleapis.com

יצירת מרכז NCC

gcloud network-connectivity hubs create ncc-hub

Create request issued for: [ncc-hub]

Waiting for operation [projects/user-3p-dev/locations/global/operations/operation-1668793629598-5edc24b7ee3ce-dd4c765b-5ca79556] to complete...done.

Created hub [ncc-hub]

הגדרת שני נתבים וירטואליים כרכזת NCC

מחפשים את ה-URI ואת כתובת ה-IP של hub-r1 ו-hub-r2 ורושמים את הפלט. תצטרכו את המידע הזה בשלב הבא.

חשוב לשים לב לכתובת ה-IP (192.168.x.x) של המופע hub-r1 ושל המופע hub-r2.

gcloud compute instances describe hub-r1 \

--zone=us-central1-a \

--format="value(selfLink.scope(projects))"

gcloud compute instances describe hub-r1 --zone=us-central1-a | grep "networkIP"

gcloud compute instances describe hub-r2 \

--zone=us-east4-b \

--format="value(selfLink.scope(projects))"

gcloud compute instances describe hub-r2 --zone=us-east4-b | grep "networkIP"

מוסיפים את ה-vNIC של hub-r1 networkIP (192.168.x.x) כרשת spoke ומפעילים העברת נתונים מאתר לאתר

gcloud network-connectivity spokes linked-router-appliances create s2s-wrk-cr1 \

--hub=ncc-hub \

--router-appliance=instance="https://www.googleapis.com/compute/projects/$projectname/zones/us-central1-a/instances/hub-r1",ip=192.168.235.4 \

--region=us-central1 \

--site-to-site-data-transfer

מוסיפים את ה-vnic של hub-r2 networkIP (192.168.x.x) כ-spoke ומפעילים העברת נתונים מאתר לאתר

gcloud network-connectivity spokes linked-router-appliances create s2s-wrk-cr2 \

--hub=ncc-hub \

--router-appliance=instance=/projects/$projectname/zones/us-east4-b/instances/hub-r2,ip=192.168.236.101 \

--region=us-east4 \

--site-to-site-data-transfer

הגדרת Cloud Router ליצירת BGP עם Hub-R1

בשלב הבא, יוצרים את Cloud Router ומכריזים על רשת המשנה של עומס העבודה ב-VPC 192.168.235.0/24

יוצרים Cloud Router באזור us-central1 שיתקשר עם BGP עם hub-r1

gcloud compute routers create wrk-cr1 \

--region=us-central1 \

--network=workload-vpc \

--asn=65002 \

--set-advertisement-groups=all_subnets \

--advertisement-mode=custom

הגדרת נתבי ה-Appliance כ-NCC Spoke מאפשרת לנתב הענן לנהל משא ומתן על BGP בממשקים וירטואליים.

יוצרים שני ממשקים ב-Cloud Router שיחליפו הודעות BGP עם hub-r1.

כתובות ה-IP נבחרות מתוך תת-הרשת של עומס העבודה, ואפשר לשנות אותן אם צריך.

gcloud compute routers add-interface wrk-cr1 \

--region=us-central1 \

--subnetwork=workload-subnet1 \

--interface-name=int0 \

--ip-address=192.168.235.101

gcloud compute routers add-interface wrk-cr1 \

--region=us-central1 \

--subnetwork=workload-subnet1 \

--interface-name=int1 \

--ip-address=192.168.235.102 \

--redundant-interface=int0

מגדירים את הממשק של Cloud Router כדי ליצור BGP עם vNIC-1 של hub-r1, מעדכנים את peer-ip-address עם כתובת ה-IP של hub-r1 networkIP . שימו לב שכתובת ה-IP זהה עבור int0 ו-int1.

gcloud compute routers add-bgp-peer wrk-cr1 \

--peer-name=hub-cr1-bgp-peer-0 \

--interface=int0 \

--peer-ip-address=192.168.235.4 \

--peer-asn=64111 \

--instance=hub-r1 \

--instance-zone=us-central1-a \

--region=us-central1

gcloud compute routers add-bgp-peer wrk-cr1 \

--peer-name=hub-cr1-bgp-peer-1 \

--interface=int1 \

--peer-ip-address=192.168.235.4 \

--peer-asn=64111 \

--instance=hub-r1 \

--instance-zone=us-central1-a \

--region=us-central1

בודקים את מצב ה-BGP. בשלב הזה של הסדנה, ה-BGP הוא במצב 'חיבור' כי לא הוגדר BGP בנתב הרשת.

gcloud compute routers get-status wrk-cr1 --region=us-central1

הגדרת Workload-cr2 כדי ליצור BGP עם Hub-R2

בשלב הבא, יוצרים את Cloud Router ומכריזים על רשת המשנה של עומס העבודה ב-VPC 192.168.236.0/24

יוצרים את Cloud Router באזור us-east4 שיצור תקשורת עם BGP עם רכזת hub-r2

gcloud compute routers create wrk-cr2 \

--region=us-east4 \

--network=workload-vpc \

--asn=65002 \

--set-advertisement-groups=all_subnets \

--advertisement-mode=custom

יוצרים זוג ממשקים ב-Cloud Router שיחליפו הודעות BGP עם hub-r2. כתובות ה-IP נבחרות מרשת המשנה של עומס העבודה, ואפשר לשנות אותן אם צריך.

gcloud compute routers add-interface wrk-cr2 \

--region=us-east4 \

--subnetwork=workload-subnet2 \

--interface-name=int0 \

--ip-address=192.168.236.5

gcloud compute routers add-interface wrk-cr2 \

--region=us-east4 \

--subnetwork=workload-subnet2 \

--interface-name=int1 \

--ip-address=192.168.236.6 \

--redundant-interface=int0

מגדירים את הממשק של Cloud Router כדי ליצור BGP עם vNIC-1 של hub-r2, מעדכנים את peer-ip-address עם כתובת ה-IP של hub-r1 networkIP . שימו לב שכתובת ה-IP זהה עבור int0 ו-int1.

gcloud compute routers add-bgp-peer wrk-cr2 \

--peer-name=hub-cr2-bgp-peer-0 \

--interface=int0 \

--peer-ip-address=192.168.236.101 \

--peer-asn=64112 \

--instance=hub-r2 \

--instance-zone=us-east4-b \

--region=us-east4

gcloud compute routers add-bgp-peer wrk-cr2 \

--peer-name=hub-cr2-bgp-peer-1 \

--interface=int1 \

--peer-ip-address=192.168.236.101 \

--peer-asn=64112 \

--instance=hub-r2 \

--instance-zone=us-east4-b \

--region=us-east4

בודקים את מצב ה-BGP. בשלב הזה של הסדנה, ה-BGP הוא במצב 'חיבור' כי לא הוגדר BGP בנתב הרשת.

gcloud compute routers get-status wrk-cr2 --region=us-east4

15. הגדרת מכשירי נתב Hub ל-BGP

הגדרת BGP ב-hub-r1

חשוב להיכנס למסוף flexiManage

עוברים אל Inventory (מלאי) ← Devices (מכשירים) ← hub-r1 ובוחרים את המכשיר עם HostName:hub-r1 (שם המארח: hub-r1).

- לוחצים על הכרטיסייה ניתוב.

- לוחצים על BGP Configuration (הגדרת BGP).

- השבתה של Redistribute OSPF Routes (הפצה מחדש של נתיבי OSPF)

- מגדירים את hub-r1 ל-BGP עם הפרמטרים האלה ולוחצים על Save (שמירה).

בוחרים בכרטיסייה ממשקים, מאתרים את ממשק ה-LAN, מוצאים את העמודה ניתוב

- לוחצים על none כדי לפתוח את התפריט ולבחור ב-BGP כפרוטוקול הניתוב.

- בחלק העליון של הדף, לוחצים על 'עדכון המכשיר'.

הגדרת hub-r2 ל-BGP

חשוב להיכנס למסוף flexiManage

עוברים אל Inventory → Devices (מלאי > מכשירים) → hub-r2, בוחרים את המכשיר עם HostName:hub-r2 (שם המארח: hub-r2)

- לוחצים על הכרטיסייה ניתוב.

- לוחצים על BGP Configuration (הגדרת BGP).

- השבתה של Redistribute OSPF Routes (הפצה מחדש של נתיבי OSPF)

- מגדירים את hub-r2 ל-BGP עם הפרמטרים האלה ולוחצים על שמירה.

בוחרים בכרטיסייה ממשקים, מאתרים את ממשק ה-LAN ומחפשים את העמודה 'ניתוב'.

- לוחצים על none כדי לפתוח תפריט נפתח ולבחור ב-BGP כפרוטוקול הניתוב.

- בחלק העליון של הדף, לוחצים על עדכון המכשיר.

בוחרים בכרטיסייה ניתוב.

- מוודאים ש-hub-r2 למד נתיב BGP מ-wrk-cr2

16. החלפת מסלולי BGP בין נתבים וירטואליים

הגדרת מספר מערכת אוטונומית (ASN) מקומי לאתרים מרוחקים

מגדירים מספר מערכת אוטונומית (ASN) של BGP מקומי עבור site1-nva ו-site2-nva. אחרי ההגדרה, יוצרים מנהרת IPsec בין האתרים המרוחקים לבין נתבי ה-Hub.

בוחרים את המכשיר עם HostName:site1-nva

- לוחצים על הכרטיסייה ניתוב.

- לוחצים על BGP Configuration (הגדרת BGP).

- השבתה של Redistribute OSPF Routes (הפצה מחדש של נתיבי OSPF)

- הפעלת BGP

- מספר ASN מקומי 7269 → שמירה

- עדכון המכשיר

- הכרטיסייה Interfaces (ממשקים) ← LAN (רשת מקומית) ← Routing (ניתוב) ← BGP

- עדכון המכשיר

בוחרים את המכשיר עם HostName:site2-nva

- לוחצים על הכרטיסייה ניתוב.

- לוחצים על BGP Configuration (הגדרת BGP).

- השבתה של Redistribute OSPF Routes (הפצה מחדש של נתיבי OSPF)

- הפעלת BGP

- מספר ASN מקומי 7270 → שמירה

- עדכון המכשיר

- הכרטיסייה Interfaces (ממשקים) ← LAN (רשת מקומית) ← Routing (ניתוב) ← BGP

- עדכון המכשיר

הגדרת מנהרות VPN בין מכשירי אתר ורכזת

חשוב להיכנס למסוף flexiManage

- עוברים אל Inventory → Devices (מלאי שטחי פרסום → מכשירים).

- מסמנים את התיבה לצד שם המארח של site1-nva ושל hub-r1 כדי ליצור מנהרת VPN בין צמד ה-NVA הזה.

- לוחצים על Actions→ Create Tunnels (פעולות → יצירת מנהרות) ומגדירים את האפשרויות הבאות:

- בוחרים באפשרות יצירת מנהרות.

- מסירים את סימני הווי מהאפשרויות site1-nva ו-ub-r1

חוזרים על השלבים כדי ליצור מנהרה בין site2-nva לבין hub-r2 על ידי בחירת הפרמטרים המתאימים

מוודאים שנוצר זוג מנהרות בין כל זוג של מכשירי NVA.

- בחלונית הצדדית שמימין, בוחרים באפשרות מלאי, לוחצים על מנהרות ומאתרים את עמודת הסטטוס.

מוודאים שהנתיבים לרשתות המשנה 192.168.235.0/24 ו-192.168.236.0/24 נלמדו על ידי site1-nva

- בוחרים באפשרות Inventory → Devices → site1-nva (מלאי → מכשירים → site1-nva) ולוחצים על הכרטיסייה ניתוב.

בדוגמה של הפלט שבהמשך, flexiWAN יצר את המנהרה באופן אוטומטי באמצעות כתובת ה-IP של המארח 10.100.0.6

17. אימות הקישוריות של נתיב הנתונים

אימות הקישוריות בין אתר לבין Cloud מתוך מיקום מקומי

בהתאם לתרשים, מוודאים שנתיב הנתונים בין s1-vm לבין workload1-vm

הגדרת מסלולים סטטיים של VPC לחיבור מאתר לענן

רשת Site1-VPC ו-Site2-VPC המקומית מדמה רשת של מרכז נתונים מקומי.

שני נתבי האפליקציות Site-1-nva ו-site-2-nva משתמשים בקישוריות VPN כדי להגיע לרשת המרכזית.

בתרחיש לדוגמה של חיבור אתר לענן**,** יוצרים נתיבים סטטיים ליעד 192.168.0.0/16 באמצעות מכשיר הנתב כנקודת הקפיצה הבאה כדי להגיע לרשתות ברשת הענן של GCP.

ב-s1-inside-vpc, יוצרים נתיב סטטי ליעד בענן (192.168.0.0/16):

gcloud compute routes create site1-subnet-route \

--network=s1-inside-vpc \

--destination-range=192.168.0.0/16 \

--next-hop-instance=site1-nva \

--next-hop-instance-zone=us-central1-a

ב-s2-inside-vpc, יוצרים נתיב סטטי ליעד בענן (192.168.0.0/16):

gcloud compute routes create site2-subnet-route \

--network=s2-inside-vpc \

--destination-range=192.168.0.0/16 \

--next-hop-instance=site2-nva \

--next-hop-instance-zone=us-east4-b

ב-Cloud Shell, מחפשים את כתובת ה-IP של workload1-vm. תצטרכו את זה כדי לבדוק את הקישוריות מ-s1-vm.

gcloud compute instances describe workload1-vm --zone=us-central1-a | grep "networkIP"

פותחים חיבור SSH ל-s1-vm, אם חלף הזמן הקצוב לתפוגה מנסים שוב

gcloud compute ssh s1-vm --zone=us-central1-a

מבצעים SSH אל s1-vm ומשתמשים בפקודה curl כדי ליצור סשן TCP לכתובת ה-IP של workload1-VM.

s1-vm:~$ curl 192.168.235.3 -vv * Trying 192.168.235.3:80... * Connected to 192.168.235.3 (192.168.235.3) port 80 (#0) > GET / HTTP/1.1 > Host: 192.168.235.3 > User-Agent: curl/7.74.0 > Accept: */* > * Mark bundle as not supporting multiuse < HTTP/1.1 200 OK < Date: Wed, 07 Dec 2022 15:12:08 GMT < Server: Apache/2.4.54 (Debian) < Last-Modified: Tue, 06 Dec 2022 00:57:46 GMT < ETag: "1f-5ef1e4acfa1d9" < Accept-Ranges: bytes < Content-Length: 31 < Content-Type: text/html < Page served from: workload1-vm * Connection #0 to host 192.168.235.3 left intact

אימות קישוריות בין אתרים

כדאי לעיין בתרשים ולוודא שנתיב הנתונים בין s1-vm ל-s2-vm

הגדרת מסלולים סטטיים של VPC לחיבור Site to Site

כדי לנתב תעבורת נתונים בין אתר 1 לאתר 2 באמצעות הרשת הגלובלית של GCP, צריך ליצור מסלולים סטטיים ליעדי רשת משנה באתר מרוחק באמצעות נתב וירטואלי מקומי כמעבר הבא.

בשלב מאוחר יותר, רשת ה-VPC של עומס העבודה תוגדר עם NCC כדי לתמוך בהעברת נתונים מאתר לאתר.

ב-s1-inside-vpc, יוצרים נתיב סטטי כדי להגיע לתת-הרשת site2 (10.20.1.0/24):

gcloud compute routes create site1-sn1-route \

--network=s1-inside-vpc \

--destination-range=10.20.1.0/24 \

--next-hop-instance=site1-nva \

--next-hop-instance-zone=us-central1-a

ב-s2-inside-vpc, יוצרים נתיב סטטי כדי להגיע ל-site1-subnet (10.10.1.0/24):

gcloud compute routes create site2-sn1-route \

--network=s2-inside-vpc \

--destination-range=10.10.1.0/24 \

--next-hop-instance=site2-nva \

--next-hop-instance-zone=us-east4-b

ב-Cloud Shell, מחפשים את כתובת ה-IP של s2-vm. תצטרכו את זה כדי לבדוק את הקישוריות מ-S1-vm.

gcloud compute instances describe s2-vm --zone=us-east4-b | grep networkIP

פותחים חיבור SSH ל-s1-vm, אם חלף הזמן הקצוב לתפוגה מנסים שוב

gcloud compute ssh s1-vm --zone=us-central1-a

מבצעים SSH אל s1-vm ומבצעים ping לכתובת ה-IP של s2-vm.

s1-vm:~$ ping 10.20.1.3

PING 10.20.1.3 (10.20.1.3) 56(84) bytes of data.

64 bytes from 10.20.1.3: icmp_seq=1 ttl=60 time=99.1 ms

64 bytes from 10.20.1.3: icmp_seq=2 ttl=60 time=94.3 ms

64 bytes from 10.20.1.3: icmp_seq=3 ttl=60 time=92.4 ms

64 bytes from 10.20.1.3: icmp_seq=4 ttl=60 time=90.9 ms

64 bytes from 10.20.1.3: icmp_seq=5 ttl=60 time=89.7 ms

18. הסרת המשאבים

מתחברים אל Cloud Shell ומוחקים את מכונות ה-VM ברשתות של אתר ה-Hub והאתר המסועף.

#on prem instances

gcloud compute instances delete s1-vm --zone=us-central1-a --quiet

gcloud compute instances delete s2-vm --zone=us-east4-b --quiet

#delete on prem firewall rules

gcloud compute firewall-rules delete site1-ssh --quiet

gcloud compute firewall-rules delete site1-internal --quiet

gcloud compute firewall-rules delete site1-cloud --quiet

gcloud compute firewall-rules delete site1-vpn --quiet

gcloud compute firewall-rules delete site1-iap --quiet

gcloud compute firewall-rules delete site2-ssh --quiet

gcloud compute firewall-rules delete site2-internal --quiet

gcloud compute firewall-rules delete site2-cloud --quiet

gcloud compute firewall-rules delete site2-vpn --quiet

gcloud compute firewall-rules delete site2-iap --quiet

gcloud compute firewall-rules delete allow-from-site-1-2 --quiet

gcloud compute firewall-rules delete s2-inside-cloud s2-inside-internal s2-inside-ssh --quiet

gcloud compute firewall-rules delete s1-inside-cloud s1-inside-iap s1-inside-internal s1-inside-ssh s2-inside-cloud s2-inside-iap s2-inside-internal s2-inside-ssh --quiet

#delete ncc spokes

gcloud network-connectivity spokes delete s2s-wrk-cr1 --region us-central1 --quiet

gcloud network-connectivity spokes delete s2s-wrk-cr2 --region us-east4 --quiet

#delete ncc hub

gcloud network-connectivity hubs delete ncc-hub --quiet

#delete the cloud router

gcloud compute routers delete wrk-cr1 --region=us-central1 --quiet

gcloud compute routers delete wrk-cr2 --region=us-east4 --quiet

#delete the instances

gcloud compute instances delete hub-r1 --zone=us-central1-a --quiet

gcloud compute instances delete hub-r2 --zone=us-east4-b --quiet

gcloud compute instances delete workload1-vm --zone=us-central1-a --quiet

gcloud compute instances delete site1-nva --zone=us-central1-a --quiet

gcloud compute instances delete site2-nva --zone=us-east4-b --quiet

#delete on prem subnets

gcloud compute networks subnets delete hub-subnet1 s1-inside-subnet site1-subnet workload-subnet1 --region=us-central1 --quiet

gcloud compute networks subnets delete hub-subnet2 s2-inside-subnet site2-subnet workload-subnet2 --region=us-east4 --quiet

#delete hub firewall rule

gcloud compute firewall-rules delete hub-ssh --quiet

gcloud compute firewall-rules delete hub-vpn --quiet

gcloud compute firewall-rules delete hub-internal --quiet

gcloud compute firewall-rules delete hub-iap --quiet

gcloud compute firewall-rules delete workload-ssh --quiet

gcloud compute firewall-rules delete workload-internal --quiet

gcloud compute firewall-rules delete workload-onprem --quiet

gcloud compute firewall-rules delete workload-iap --quiet

#delete on vpcs

gcloud compute networks delete hub-vpc s1-inside-vpc s2-inside-vpc site2-vpc workload-vpc --quiet

19. מעולה!

סיימתם את שיעור ה-Lab בנושא Network Connectivity Center.

מה כיסיתם

- הגדרת שילוב של רשת WAN מוגדרת באמצעות תוכנה (SD-WAN) לאתר NCC בענן

- הגדרת שילוב של רשת WAN מוגדרת באמצעות תוכנה (SD-WAN) לחיבור בין אתרים ב-NCC

השלבים הבאים

- סקירה כללית על Network Connectivity Center

- מסמכי תיעוד של Network Connectivity Center

- מקורות מידע על flexiWAN

- מאגר flexiWAN GitLab

©Google, LLC או השותפים העצמאיים שלה. כל הזכויות שמורות. אין להפיץ.