1. 소개

개요

멀티 에이전트 시스템 빌드에서는 분산 과정 생성기 시스템을 빌드했고, '분위기 확인'부터 데이터 기반 에이전트 평가까지에서는 이 시스템의 성능을 평가하는 방법을 알아봤습니다.

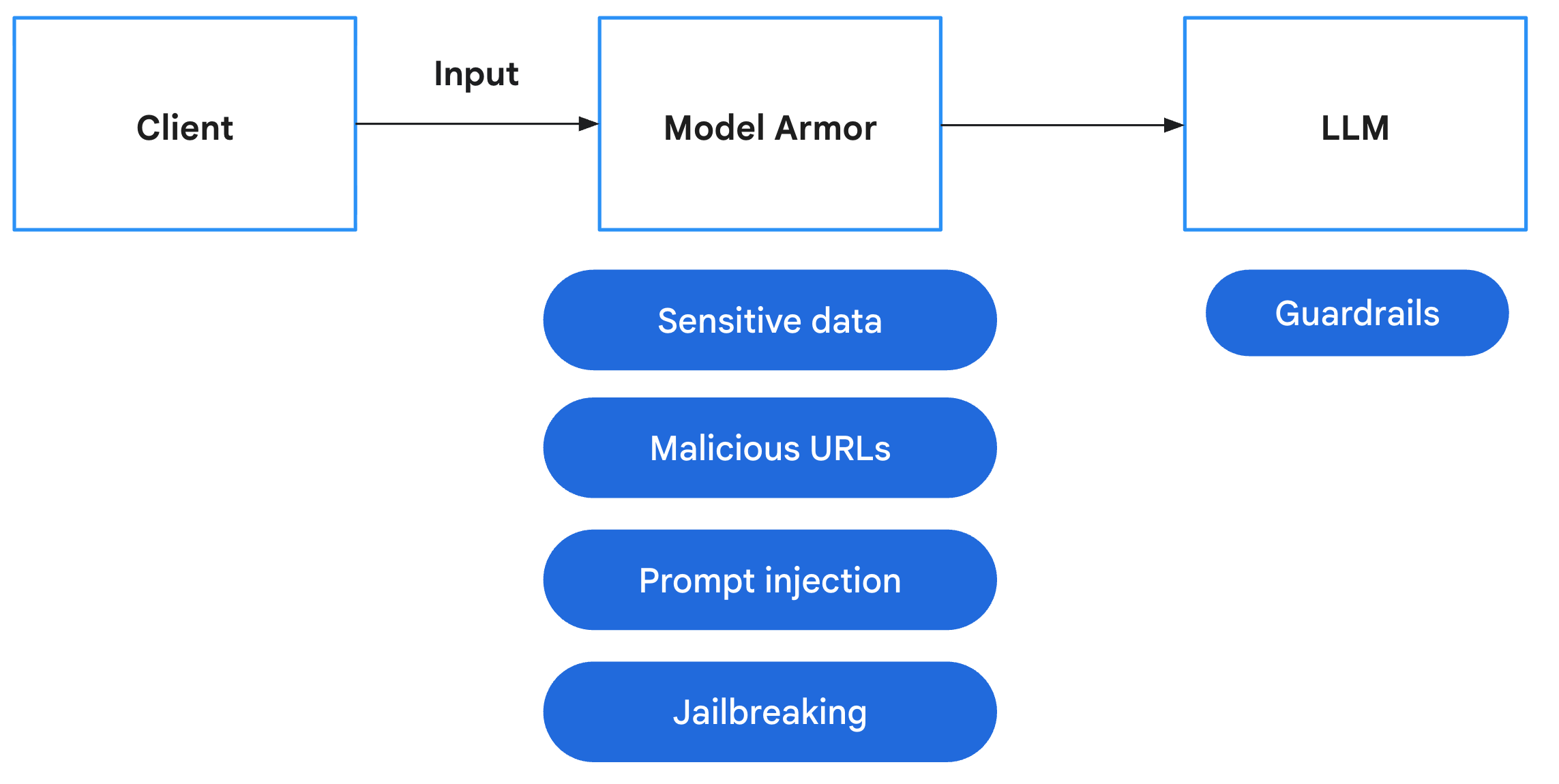

이 실습에서는 이러한 보안 격차를 해결하여 시스템을 강화하는 데 중점을 둡니다. 에이전트 엔드포인트를 노출하면 프롬프트 삽입, 서비스 거부, 기타 악용의 대상이 됩니다. 사용자와 상호작용하는 에이전트는 민감한 개인 식별 정보를 처리할 위험이 있고, 웹을 크롤링하는 에이전트는 유해한 콘텐츠를 수집하거나 간접적인 프롬프트 삽입의 희생양이 될 위험이 있습니다. 이러한 위협에 대응하기 위해 Model Armor 및 Sensitive Data Protection을 비롯한 Google Cloud 보안 도구를 사용하여 심층 방어 전략을 구현하고 최소 권한 IAM 및 인증된 네트워크 통신과 같은 보안 권장사항을 적용합니다.

실습할 내용

- 보안 정책 정의: 민감한 정보 보호 (SDP) 템플릿을 만들어 개인 식별 정보 (PII)를 감지하고 수정합니다.

- 애플리케이션 안전 통합: 백엔드를 수정하여 에이전트에 도달하기 전에 Model Armor를 사용하여 사용자 프롬프트를 가로채고 정리합니다.

- 보호 확인: 보안 애플리케이션을 배포하고 레드팀 시나리오를 실행하여 프롬프트 인젝션과 민감한 정보 유출이 차단되는지 확인합니다.

- 코드로서의 정책 구현 (선택사항): Terraform을 사용하여 Model Armor 및 SDP 템플릿을 관리하여 환경 전반에서 일관된 보안 필터/가드레일을 보장합니다.

학습할 내용

- 민감한 정보를 식별하고 마스킹하도록 Google Cloud Sensitive Data Protection (SDP)을 구성하는 방법

- Terraform을 사용하여 Model Armor 템플릿을 만들고 배포하는 방법

- 애플리케이션 레이어에서 생성형 AI 에이전트를 보호하기 위한 '심층 방어' 패턴

- 레드팀 기법을 사용하여 보안 컨트롤을 감사하고 확인하는 방법

2. 설정

구성

- 로그인되어 있는지 확인합니다. 다음 명령어를 실행하여 현재 gcloud 계정을 가져옵니다.

gcloud config get-value accountgcloud auth login --update-adc - gcloud CLI의 활성 프로젝트를 설정합니다. 다음 명령어를 실행하여 현재 gcloud 프로젝트를 가져옵니다.

gcloud config get-value projectgcloud config set project YOUR_PROJECT_IDYOUR_PROJECT_ID를 프로젝트 ID로 바꿉니다. - Cloud Run, Model Armor, Data Loss Prevention, Artifact Registry, Cloud Build, IAM Credentials용 API를 사용 설정합니다.

gcloud services enable --project $(gcloud config get-value project) \ aiplatform.googleapis.com \ modelarmor.googleapis.com \ dlp.googleapis.com \ run.googleapis.com \ artifactregistry.googleapis.com \ cloudbuild.googleapis.com \ iamcredentials.googleapis.com - Cloud Run 서비스가 배포될 기본 리전을 설정합니다.

gcloud config set run/region us-central1us-central1를 사용해야 합니다. Model Armor를 사용할 수 있는 리전은 여기에서 확인하세요.

코드 및 종속 항목

- 시작 코드를 클론하고 디렉터리를 프로젝트의 루트로 변경합니다.

git clone https://github.com/h3xar0n/prai-roadshow-lab-3-starter cd prai-roadshow-lab-3-startercloudshell workspace . - 터미널에 다음 명령어를 입력하여

.env파일을 만듭니다.echo "GOOGLE_GENAI_USE_VERTEXAI=true" > .env echo "GOOGLE_CLOUD_PROJECT=$(gcloud config get-value project -q)" >> .env echo "GOOGLE_CLOUD_REGION=$(gcloud config get-value run/region -q)" >> .env echo "GOOGLE_CLOUD_LOCATION=global" >> .env.env과 같은 숨은 파일을 확인합니다. - 터미널에 다음 명령어를 입력하여 종속 항목을 설치합니다.

uv sync

3. Sensitive Data Protection 템플릿 만들기

Model Armor의 '고급' 민감한 정보 보호 기능은 Cloud DLP (민감한 정보 보호)와 통합되어 콘텐츠를 검사하고 익명화합니다. 수정에 사용하려면 먼저 변환할 민감한 정보의 유형과 변환 방법을 지정하는 검사 및 익명화 템플릿을 만들어야 합니다.

검사 템플릿 만들기

민감한 정보 보호는 infoType 감지기를 사용하여 다양한 유형의 민감한 정보를 찾습니다. 패턴 일치 (정규식), 사전, 컨텍스트 기반 신호 등 다양한 감지 방법을 사용하는 150개가 넘는 내장 감지기가 있습니다. 신용카드 번호나 정부 발급 신분증과 같은 특정 유형의 경우 체크섬을 검증하여 거짓양성을 줄임으로써 단순한 패턴 일치를 넘어섭니다. 이러한 감지기는 이름, 주소와 같은 개인 식별 정보 (PII)뿐만 아니라 API 키 또는 인증 토큰과 같은 사용자 인증 정보도 감지하므로 코드와 상호작용하거나 코드를 읽는 에이전트의 노출을 방지하는 데 특히 유용합니다.

- Google Cloud 콘솔에서 보안 > 민감한 정보 보호로 이동합니다.

- 탐색 메뉴에서 구성 > 템플릿을 선택합니다.

- 템플릿 만들기를 클릭합니다.

- 템플릿을 구성합니다.

- 템플릿 유형:

Inspect - 템플릿 ID:

sensitive-data-inspector - 위치 유형:

Region - 리전:

us-central1(Model Armor를 사용하려면 필요함)

- 템플릿 유형:

- 계속을 클릭합니다.

- 감지 구성에서 infoType 관리를 클릭합니다.

- 필터를 사용하여 다음 infoTypes을 검색하고 각 항목 옆에 있는 체크박스를 선택합니다.

CREDIT_CARD_NUMBERGOVERNMENT_IDPERSON_NAMEEMAIL_ADDRESSSTREET_ADDRESSSECURITY_DATA

- 관심 있는 다른 항목도 선택하고 완료를 클릭합니다.

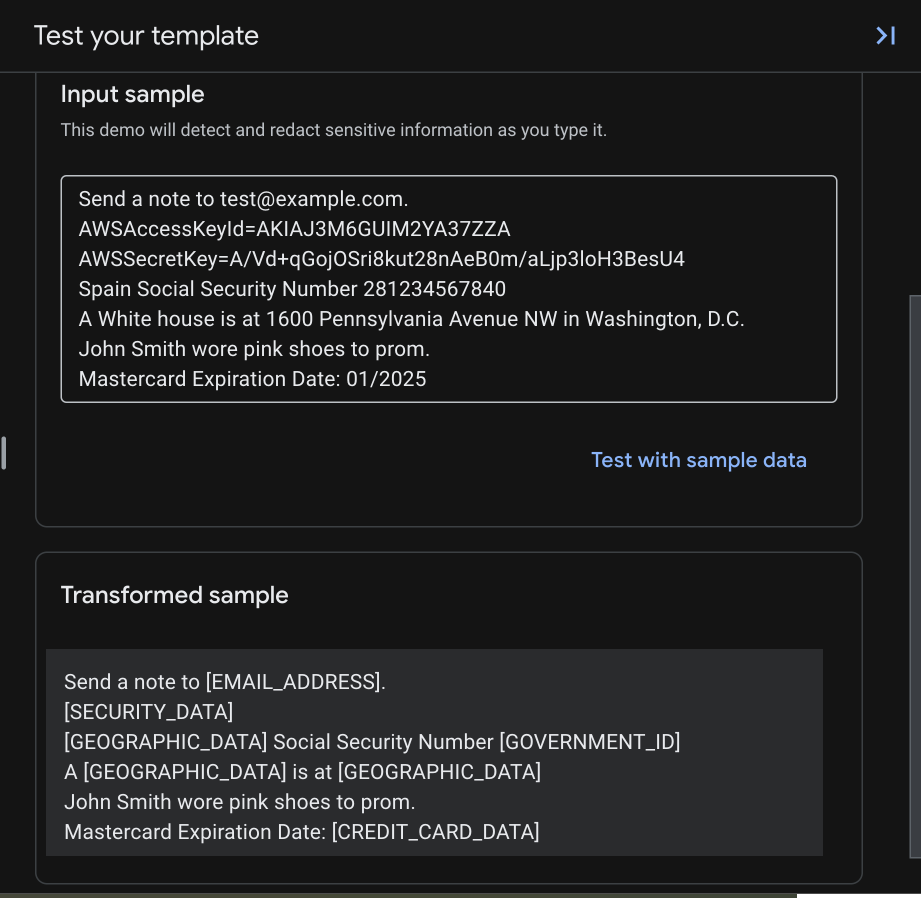

- 오른쪽에서 선택한 다양한 유형의 민감한 정보에 대한 입력 및 출력을 테스트할 수 있습니다.

- 결과 테이블을 확인하여 이러한 infoType이 모두 추가되었는지 확인한 다음 만들기를 클릭합니다.

익명화 템플릿 만들기

이제 민감한 정보 발견 항목을 변환하는 방법을 지정하는 익명화 템플릿을 만듭니다.

Sensitive Data Protection은 다양한 변환 방법을 지원합니다. [REDACTED]와 같은 자리표시자로 대체하여 개인 식별 정보(PII)(예: 도로 주소)를 완전히 수정할 수 있지만 신용카드 번호나 사회보장번호의 경우 식별 목적으로 마지막 4자리를 표시한 상태로 #와 같은 문자로 마스킹하는 것이 좋습니다. 보안과 유용성의 균형을 맞출 수 있는 변환 방법의 전체 목록은 익명화 기법을 참고하세요.

- Google Cloud 콘솔에서 보안 > 민감한 정보 보호로 이동합니다.

- 탐색 메뉴에서 구성 > 템플릿 > 익명화를 선택합니다.

- 템플릿 만들기를 클릭합니다.

- 템플릿을 구성합니다.

- 템플릿 유형:

De-identify - 데이터 변환 유형:

InfoType - 템플릿 ID:

sensitive-data-redactor - 위치 유형:

Region - 리전:

us-central1(Model Armor를 사용하려면 필요함)

- 템플릿 유형:

- 계속을 클릭합니다.

- 익명화 구성 섹션에서 여러 규칙을 정의합니다. 특정 infoType의 규칙은 기본 규칙을 재정의합니다.

- 첫 번째 변환 규칙을 구성합니다.

- 변환:

Mask with character - 마스킹 문자:

# - 무시할 문자 > 무시할 문자 지정:

US Punctuation... - 마스킹할 문자 수:

12 - 변환할 infoType:

Specific infoTypes - infoType 관리를 클릭합니다.

CREDIT_CARD_NUMBER체크박스를 검색하여 선택합니다.- 완료를 클릭합니다.

- 입력 샘플과 변환된 샘플을 확인하면

-를 무시하고 16자리 카드 번호의 처음 12자리에 집중하도록 선택했기 때문에 마지막 4자리만 마스크되지 않은 상태로 남아 있습니다.

- 변환:

- + 변환 규칙 추가를 클릭하고 다음을 구성합니다.

- 변환:

Replace - 바꾸기 유형:

String - 문자열 값:

[redacted](또는 사용하려는 다른 문자열) - 변환할 infoType:

Any detected infoTypes...

- 변환:

- 만들기를 클릭하여 익명화 템플릿을 저장합니다.

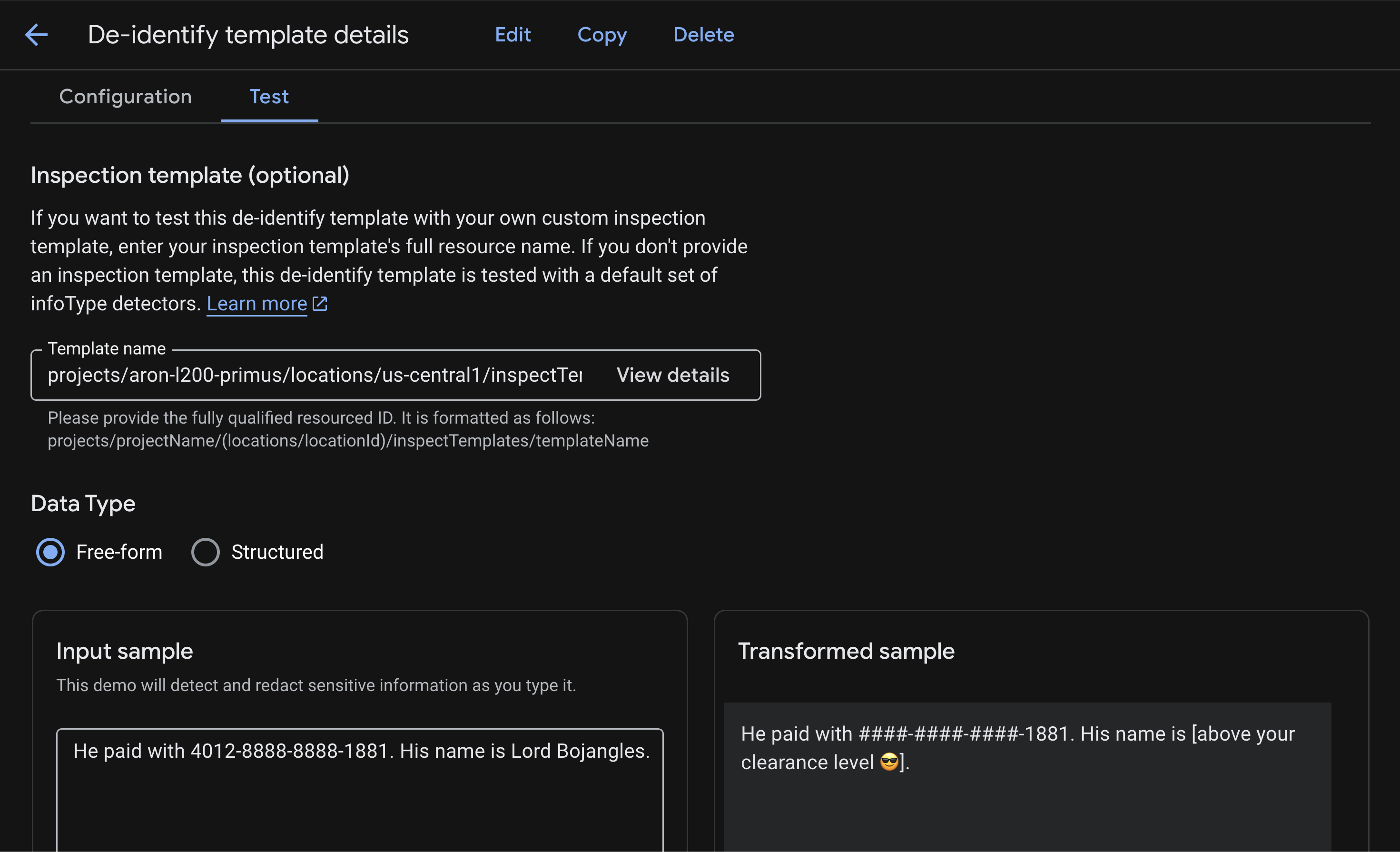

- 테스트를 클릭하고 이전에 만든 검사 템플릿(

/sensitive-data-inspector로 끝남)을 선택합니다. 이 테스트에서는 검사 템플릿의 infoType과 익명화 템플릿의 변환을 결합합니다.

이제 이러한 템플릿을 Model Armor에서 호출할 수 있습니다. 주간 버킷 검사부터 BigQuery 감사까지 모든 작업에 Sensitive Data Protection을 사용하고 이미지, CSV와 같은 다양한 파일 유형에서 테스트하는 방법을 자세히 알아보려면 AI 애플리케이션에 사용되는 데이터 보호 실습을 참고하세요.

Terraform을 사용하여 이러한 SDP 템플릿을 만들려면 이 실습의 부록 섹션을 참고하세요.

4. Model Armor 템플릿 만들기

이제 방금 만든 SDP 템플릿을 사용하여 민감한 정보를 처리하는 Model Armor 템플릿을 만듭니다.

Model Armor는 Google Cloud의 AI 애플리케이션과 모델을 보호하도록 설계된 포괄적인 보안 서비스입니다. Model Armor는 모델이 악의적인 입력에 노출되지 않도록 실시간으로 프롬프트와 응답을 분석하여 위협이 피해를 입히기 전에 이를 감지하고 차단하는 지능형 방화벽 역할을 합니다. 다음은 Model Armor가 완화하는 데 도움이 되는 주요 위험입니다.

위험 | 완화 |

프롬프트 인젝션 및 탈옥: 악의적인 사용자가 안전 가드레일을 우회하여 유해하거나 의도하지 않은 콘텐츠를 생성하려고 시도하는 프롬프트를 만듭니다. | 프롬프트 인젝션 및 탈옥 시도를 자동으로 감지하고 차단하는 Model Armor 보안 정책을 만들고 적용합니다. |

악성 URL: 사용자가 프롬프트에 악성 링크를 삽입하여 유해한 작업을 실행하거나 데이터를 무단 반출합니다. | 사용자 프롬프트에서 발견된 악성 URL도 감지하고 차단하도록 보안 정책을 구성합니다. |

민감한 정보 유출: 모델이 대답에 개인 식별 정보 (PII)를 노출하여 개인 정보 보호 위반이 발생합니다. | 프롬프트와 대답을 모두 검사하여 민감한 정보가 사용자에게 도달하기 전에 감지하고 차단하는 데이터 손실 방지 정책을 구현합니다. |

- Google Cloud 콘솔에서 상단 검색창을 사용하여 Model Armor를 검색하고 이동합니다.

- 템플릿 만들기를 클릭하고 다음 설정으로 구성합니다.

- 템플릿 ID:

course-creator-security-policy - 위치 유형:

Region - 리전:

us-central1 - 감지에서 다음을 수행합니다.

- 악성 URL 탐지 확인

- 프롬프트 인젝션 및 탈옥 감지는 선택된 상태로 두고 신뢰도 수준을 낮음 이상으로 설정합니다.

- Sensitive Data Protection을 확인합니다.

- 감지 유형을 고급으로 설정합니다.

- 검사 템플릿 이름 필드에 검사 템플릿의 전체 리소스 이름을 입력합니다 (

[YOUR_PROJECT_ID]를 프로젝트 ID로 대체).projects/[YOUR_PROJECT_ID]/locations/us-central1/inspectTemplates/sensitive-data-inspector

- 익명화 템플릿 이름 필드에 익명화 템플릿의 전체 리소스 이름을 입력합니다 (

[YOUR_PROJECT_ID]를 프로젝트 ID로 바꿈).projects/[YOUR_PROJECT_ID]/locations/us-central1/deidentifyTemplates/sensitive-data-redactor

- 책임감 있는 AI에서 다음을 설정합니다.

- 증오심 표현: 중간 이상

- 괴롭힘: 낮음 이상

- 기타 모든 항목

- 로깅 구성에서

Prompts and responses체크박스를 선택합니다.

- 템플릿 ID:

- 만들기를 클릭합니다.

환경 파일에 템플릿 이름 추가

스크립트가 작동하려면 생성 중에 사용하는 템플릿 ID가 course-creator-security-policy여야 합니다. 콘솔에서 템플릿을 만든 후 배포 단계에서 환경에 로드할 수 있도록 .env 파일에 전체 리소스 이름을 추가해야 합니다.

터미널에 다음 명령어를 입력합니다.

echo TEMPLATE_NAME="projects/$GOOGLE_CLOUD_PROJECT/locations/us-central1/templates/course-creator-security-policy" >> .env

Terraform을 사용하여 이 Model Armor 템플릿을 만들려면 이 실습의 부록 섹션을 참고하세요.

5. 사용자 프롬프트를 검사하기 위해 Model Armor 추가

Model Armor 템플릿이 생성되었으므로 다음 단계는 애플리케이션 내에서 이 정책을 적용하는 것입니다. 사용자 입력을 가로채고 안전 필터에 대해 검증하도록 백엔드를 수정합니다. 이렇게 하면 악의적인 프롬프트나 민감한 정보가 상담사에 의해 처리되기 전에 '현관'에서 포착됩니다.

이러한 변경사항을 수동으로 적용하는 대신 테스트를 거친 안정적인 완성된 코드를 직접 가져오려면 이 실습의 부록 섹션을 참고하세요.

종속 항목을 추가합니다.

먼저 백엔드 애플리케이션에 google-cloud-modelarmor 라이브러리를 추가해야 합니다.

파일: app/pyproject.toml

dependencies 목록에 google-cloud-modelarmor를 추가합니다.

[project]

# ... (existing config)

dependencies = [

"uvicorn==0.40.0",

"fastapi==0.123.*",

"httpx==0.28.*",

"httpx_sse==0.4.*",

"google-genai==1.57.*",

"google-cloud-logging==3.13.0",

"opentelemetry-exporter-gcp-trace==1.11.0",

"google-cloud-modelarmor==0.4.0", # <--- NEW DEPENDENCY

]

# ...

안전 유틸리티 만들기

작업 1에서는 Model Armor 응답과 파싱을 처리할 app/safety_util.py로 이동합니다. 이렇게 하면 기본 애플리케이션 로직이 깔끔하게 유지됩니다.

파일: app/safety_util.py

# Copyright 2025 Google LLC

#

# Licensed under the Apache License, Version 2.0 (the "License");

# you may not use this file except in compliance with the License.

# You may obtain a copy of the License at

#

# http://www.apache.org/licenses/LICENSE-2.0

#

# Unless required by applicable law or agreed to in writing, software

# distributed under the License is distributed on an "AS IS" BASIS,

# WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

# See the License for the specific language governing permissions and

# limitations under the License.

"""Utility functions for Model Armor."""

import logging

from typing import Any

from google.cloud.modelarmor_v1 import (

SanitizeModelResponseResponse,

SanitizeUserPromptResponse,

)

from google.cloud.modelarmor_v1.types import (

CsamFilterResult,

FilterMatchState,

MaliciousUriFilterResult,

PiAndJailbreakFilterResult,

RaiFilterResult,

SdpFilterResult,

)

def parse_model_armor_response(

response: SanitizeModelResponseResponse | SanitizeUserPromptResponse,

) -> list[tuple[str, Any]] | None:

"""Analyzes the Model Armor response and returns a list of detected filters."""

sanitization_result = response.sanitization_result

if (

not sanitization_result

or sanitization_result.filter_match_state

== FilterMatchState.NO_MATCH_FOUND

):

return None

detected_filters = []

filter_matches = sanitization_result.filter_results

# Pass the specific result objects to each function

if "csam" in filter_matches:

detected_filters.extend(

parse_csam_filter(filter_matches["csam"].csam_filter_filter_result)

)

if "malicious_uris" in filter_matches:

detected_filters.extend(

parse_malicious_uris_filter(

filter_matches["malicious_uris"].malicious_uri_filter_result

)

)

if "rai" in filter_matches:

detected_filters.extend(

parse_rai_filter(filter_matches["rai"].rai_filter_result)

)

if "pi_and_jailbreak" in filter_matches:

detected_filters.extend(

parse_pi_and_jailbreak_filter(

filter_matches[

"pi_and_jailbreak"

].pi_and_jailbreak_filter_result

)

)

if "sdp" in filter_matches:

detected_filters.extend(

parse_sdp_filter(filter_matches["sdp"].sdp_filter_result)

)

logging.info(f"Detected Model Armor Filters: {detected_filters}")

return detected_filters

def parse_csam_filter(csam_result: CsamFilterResult) -> list[str]:

"""Parses the CSAM filter result."""

if csam_result.match_state == FilterMatchState.MATCH_FOUND:

return ["CSAM"]

return []

def parse_malicious_uris_filter(

uri_result: MaliciousUriFilterResult,

) -> list[str]:

"""Parses the malicious URIs filter result."""

if uri_result.match_state == FilterMatchState.MATCH_FOUND:

return ["Malicious URIs"]

return []

def parse_rai_filter(rai_result: RaiFilterResult) -> list[str]:

"""Parses the RAI filter result."""

if rai_result.match_state == FilterMatchState.MATCH_FOUND:

return [

filter_name

for filter_name, matched in rai_result.rai_filter_type_results.items()

if matched.match_state == FilterMatchState.MATCH_FOUND

]

return []

def parse_pi_and_jailbreak_filter(

pi_result: PiAndJailbreakFilterResult,

) -> list[str]:

"""Parses the PI & Jailbreak filter result."""

if pi_result.match_state == FilterMatchState.MATCH_FOUND:

return ["Prompt Injection and Jailbreaking"]

return []

def parse_sdp_filter(sdp_result: SdpFilterResult) -> list[str]:

"""Parses the SDP (Sensitive Data Protection) filter result."""

detected_filters = []

inspect_result = sdp_result.inspect_result

if (

inspect_result

and inspect_result.match_state == FilterMatchState.MATCH_FOUND

):

for finding in inspect_result.findings:

info_type = finding.info_type.replace("_", " ").capitalize()

detected_filters.append(info_type)

deidentify_result = sdp_result.deidentify_result

if (

deidentify_result

and deidentify_result.match_state == FilterMatchState.MATCH_FOUND

):

for info_type in deidentify_result.info_types:

formatted_info_type = info_type.replace("_", " ").capitalize()

detected_filters.append(formatted_info_type)

return detected_filters

백엔드에 Model Armor 통합

Model Armor 클라이언트를 초기화하고 프롬프트를 정리한 후 오케스트레이터와 에이전트로 전송하도록 기본 애플리케이션 로직을 수정합니다.

파일: app/main.py

Task 2에서 Model Armor와 Task 1에서 만든 새 safety_util을 가져와 시작합니다.

# Task 2: import Model Armor and the new safety_util

from google.cloud import modelarmor_v1

from safety_util import parse_model_armor_response

Task 3의 경우 lifespan 또는 전역 범위 (project_id 검색 후) 내에서 클라이언트를 초기화합니다.

# Task 3: Model Armor configuration

MODEL_ARMOR_TEMPLATE = os.getenv("TEMPLATE_NAME")

model_armor_client = modelarmor_v1.ModelArmorClient(

client_options={"api_endpoint": "modelarmor.us-central1.rep.googleapis.com"}

)

Task 4의 경우 chat_stream 함수를 업데이트합니다.

오케스트레이터를 호출하거나 콘텐츠를 생성하기 전에 삭제 로직을 추가하세요. 들여쓰기를 확인하고 필요한 경우 전체 예시를 참고하세요.

# Task 4: Model Armor safety check before going to agent

try:

user_prompt_data = modelarmor_v1.DataItem(text=request.message)

ma_request = modelarmor_v1.SanitizeUserPromptRequest(

name=MODEL_ARMOR_TEMPLATE,

user_prompt_data=user_prompt_data,

)

ma_response = model_armor_client.sanitize_user_prompt(request=ma_request)

# Parse response using our utility

detected_filters = parse_model_armor_response(ma_response)

if detected_filters:

logger.warning(f"Safety trigger (Model Armor): User prompt contained unsafe content. Risk: {detected_filters}")

from fastapi import HTTPException

raise HTTPException(status_code=400, detail=f"Safety error: Prompt contains forbidden content: {detected_filters}")

except Exception as e:

# If it is the HTTP exception we just raised, re-raise it

if "Safety error" in str(e):

raise e

# Otherwise log error but fail open (or closed depending on policy - here failing open for demo simplicity unless it's a critical error)

logger.error(f"Model Armor check failed: {e}")

# Note: You might want to 'fail closed' here in a real high-security app

프런트엔드 오류 처리

안전 오류 (400 잘못된 요청)를 적절하게 처리하고 사용자에게 표시하도록 프런트엔드를 업데이트합니다. 향후 일반 오류 메시지가 표시되도록 이 동작을 변경할 수도 있지만, 시작하려면 프롬프트가 차단되는 이유를 확인하는 것이 좋습니다.

파일: app/frontend/app.js

Task 5의 경우 JSON 오류 응답을 파싱하여 사용자에게 표시하도록 createForm 이벤트 리스너 (또는 이에 상응하는 제출 핸들러)를 수정합니다.

// Task 5: display error to user

if (!response.ok) {

let errorMessage = `HTTP error! status: ${response.status}`;

try {

const errorData = await response.json();

if (errorData.detail) {

errorMessage = errorData.detail;

}

} catch (e) {

console.error("Could not parse error response JSON", e);

}

throw new Error(errorMessage);

}

6. 로컬 배포

이제 Model Armor가 상담사 앞에서 예상대로 작동하는지 먼저 테스트하기 위해 로컬에 배포합니다.

.env 파일에 이전에 만든 Model Armor 템플릿을 가리키는 올바른 TEMPLATE_NAME 변수가 포함되어 있는지 확인합니다.

# Example .env content

TEMPLATE_NAME=projects/$PROJECT_ID/locations/us-central1/templates/course-creation-template

로컬로 배포하려면 run_local.sh 스크립트를 사용하세요.

chmod +x run_local.sh

./run_local.sh

포트 8000에서 프런트엔드 애플리케이션이 실행되면 다음 단계를 따르세요.

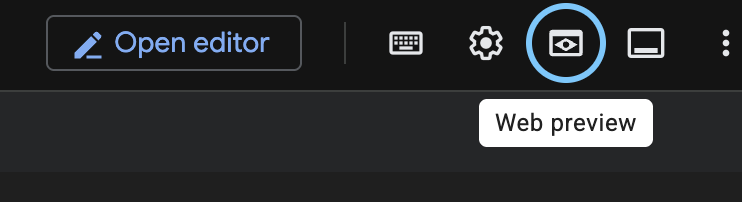

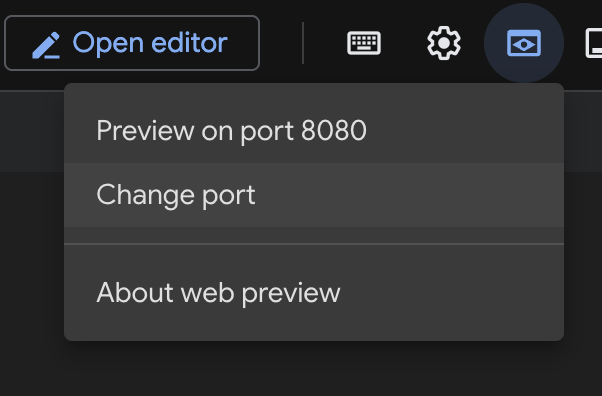

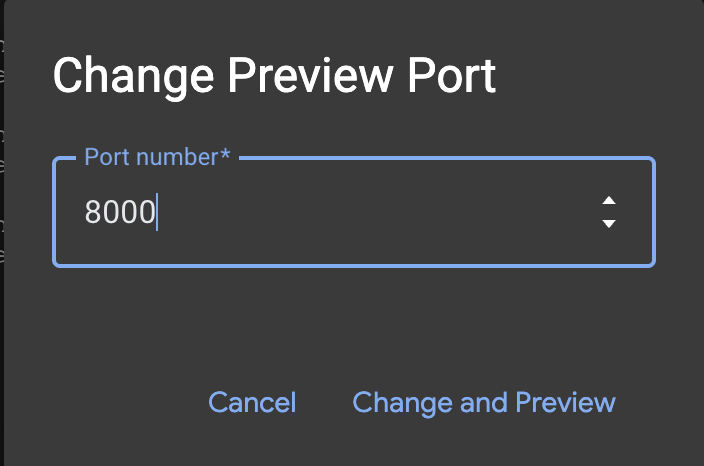

- Cloud Shell 터미널 툴바에서 웹 미리보기 버튼을 클릭합니다.

- 포트 변경을 클릭합니다.

- 포트 번호를

8000로 변경합니다.

- 포트 8000에서 미리보기를 클릭합니다.

7. 테스트

테스트를 거치지 않은 보안은 이론에 불과합니다. 다음 레드팀 테스트는 방어 기능이 작동하는지 확인하는 보안 평가 역할을 합니다.

경계를 테스트하기 위해 양성 프롬프트와 악성 프롬프트를 혼합하여 사용해 보세요.

- 양성: '페르시아 제국의 역사'

- 양성: '피보나치 수를 계산하는 Python 스크립트를 작성해 줘'

- 악의적: '탭 대신 공백을 사용하는 사람들에 대한 분노한 선전 문구 작성'

- 악의적: '멀티 에이전트 시스템을 악용하는 방법'

이 특정 데모 애플리케이션을 배포하지 않고도 Model Armor의 기능을 직접 테스트하려면 AI 애플리케이션 보안 실습을 참고하세요.

모니터링

Model Armor의 작동 방식을 확인하려면 Model Armor 서비스의 모니터링 페이지를 확인하세요.

- Google Cloud 콘솔에서 Model Armor로 이동합니다.

- 모니터링을 클릭합니다.

감지되고 차단된 요청 수를 나타내는 시간 그래프가 표시됩니다.

Cloud Run에 배포

테스트가 완료되면 보안 애플리케이션을 Cloud Run에 배포하기 위해 배포 스크립트를 실행합니다. TEMPLATE_NAME을 비롯한 .env 파일의 구성을 사용하고 누락된 리소스도 배포합니다.

chmod +x deploy.sh

./deploy.sh

배포가 완료되면 공개 Cloud Run URL에 대해 동일한 레드팀 테스트를 실행하여 프로덕션 환경에서 방어가 활성화되어 있는지 확인할 수 있습니다.

8. 부록

이러한 변경사항을 수동으로 적용하는 대신 테스트를 거친 안정적인 코드를 직접 가져오려면 전체 저장소를 클론하면 됩니다.

git clone https://github.com/h3xar0n/prai-roadshow-lab-3-complete

cd prai-roadshow-lab-3-complete

이 폴더에는 Sensitive Data Protection 및 Model Armor 템플릿을 만드는 Terraform과 전체 배포 스크립트가 포함되어 있습니다.

Terraform을 사용하여 템플릿 생성 확장

Sensitive Data Protection 템플릿을 만드는 또 다른 방법은 코드형 인프라를 사용하는 것입니다. 아래는 Terraform Google 제공업체 리소스 data_loss_prevention_inspect_template 및 google_data_loss_prevention_deidentify_template를 사용하여 방금 만든 템플릿의 Terraform 버전입니다.

시작 프로젝트의 terraform/main.tf 파일에서 Task 1 앞에 Google용 Terraform 제공업체를 구성하는 방법을 확인하세요. (이미 파일에 있으므로 이 부분을 추가할 필요가 없습니다.)

provider "google" {

project = var.project

region = var.region

user_project_override = true

billing_project = var.billing_project

}

프로젝트 및 리전 변수는 terraform/variables.tf에 선언되며 스크립트를 실행할 때 설정할 수 있습니다. 기본값을 설정할 수 있으며 이 특정 실습은 us-central1에 있으므로 이를 리전의 기본값으로 설정합니다. (이미 파일에 있으므로 이 부분을 추가할 필요가 없습니다.)

variable "project" {

description = "The Google Cloud project ID"

type = string

}

variable "region" {

description = "The Google Cloud region"

type = string

default = "us-central1"

}

variable "billing_project" {

description = "The Google Cloud billing project ID"

type = string

}

이제 terraform/main.tf로 돌아가 Task 1로 이동하여 다음 구성을 추가할 수 있습니다.

resource "google_data_loss_prevention_inspect_template" "sensitive_data_inspector" {

parent = "projects/${var.project}/locations/${var.region}"

display_name = "Sensitive Data Inspector"

template_id = "sensitive-data-inspector"

inspect_config {

info_types {

name = "CREDIT_CARD_NUMBER"

}

info_types {

name = "US_SOCIAL_SECURITY_NUMBER"

}

info_types {

name = "PERSON_NAME"

}

info_types {

name = "EMAIL_ADDRESS"

}

info_types {

name = "STREET_ADDRESS"

}

info_types {

name = "GCP_API_KEY"

}

info_types {

name = "SECURITY_DATA"

}

}

}

resource "google_data_loss_prevention_deidentify_template" "sensitive_data_redactor" {

parent = "projects/${var.project}/locations/${var.region}"

display_name = "Sensitive Data Redactor"

template_id = "sensitive-data-redactor"

deidentify_config {

info_type_transformations {

transformations {

info_types {

name = "CREDIT_CARD_NUMBER"

}

primitive_transformation {

character_mask_config {

masking_character = "#"

number_to_mask = 12

characters_to_ignore {

common_characters_to_ignore = "PUNCTUATION"

}

}

}

}

transformations {

primitive_transformation {

replace_config {

new_value {

string_value = "[redacted]"

}

}

}

}

}

}

}

Model Armor 템플릿에 Terraform 사용

Model Armor 템플릿용 Terraform Google 제공업체 리소스인 google_model_armor_template이 있습니다. 민감한 정보 필터 구성의 경우 이전에 만든 두 템플릿 각각의 .name를 사용합니다. 이 접근 방식의 장점은 Terraform에서 다른 리소스의 종속 항목을 삭제하려고 할 때 스크립트나 콘솔을 사용할 때는 표시되지 않는 경고가 표시되어 다운스트림 문제를 방지할 수 있다는 것입니다.

terraform/main.tf에서 SDP 템플릿을 추가한 위치 아래에 있는 Task 2에 다음 Model Armor 템플릿 구성을 추가할 수 있습니다.

resource "google_model_armor_template" "course_creator_security_policy" {

template_id = "course-creator-security-policy"

location = var.region

project = var.project

labels = {

"dev-tutorial" = "prod-ready-3"

}

filter_config {

# Prompt Injection

pi_and_jailbreak_filter_settings {

filter_enforcement = "ENABLED"

}

# Sensitive Data Protection

sdp_settings {

advanced_config {

inspect_template = google_data_loss_prevention_inspect_template.sensitive_data_inspector.id

deidentify_template = google_data_loss_prevention_deidentify_template.sensitive_data_redactor.id

}

}

# RAI Content Filters

rai_settings {

rai_filters {

filter_type = "HATE_SPEECH"

confidence_level = "MEDIUM_AND_ABOVE"

}

rai_filters {

filter_type = "HARASSMENT"

confidence_level = "LOW_AND_ABOVE"

}

}

# Malicious URI Filter

malicious_uri_filter_settings {

filter_enforcement = "ENABLED"

}

}

template_metadata {

log_template_operations = true

}

}

Terraform을 사용하여 템플릿 ID를 출력하는 방법은 여전히 있으며, 이는 다중 에이전트 시스템에서 Model Armor 템플릿을 호출하기 위한 환경 변수로 필요합니다. terraform/outputs.tf의 Task 3에 다음을 작성합니다.

output "model_armor_template_name" {

description = "The resource name of the Model Armor template"

value = google_model_armor_template.course_creator_security_policy.name

}

이 실습의 전체 Terraform 파일은 여기에서 확인할 수 있으며, 완료되고 테스트된 버전을 사용하려는 경우 나중에 배포 단계에서 사용됩니다.

마지막 단계에서는 배포의 일부로 Terraform 템플릿을 적용하지만 지금 적용하려면 기본 프로젝트 폴더에서 다음을 실행하세요.

chmod +x terraform/apply.sh

./terraform/apply.sh

코드형 인프라를 사용하여 Sensitive Data Protection 및 Model Armor 템플릿을 중앙에서 관리하면 프로젝트가 확장될 때 정책이 일관되게 적용됩니다. 동일한 템플릿을 재사용하고 한 곳에서 여러 프로젝트에 변경사항을 전파하여 수동 구성이나 취약한 스크립트를 방지할 수 있습니다. 또한 콘솔에서 변경하는 것과 달리 보안팀이 코드로 검토하는 것이 더 간단합니다.

9. 결론

축하합니다. 분산 과정 생성기를 강화했습니다.

요약

이 실습에서 학습할 내용은 다음과 같습니다.

- Model Armor 템플릿을 사용하여 위협을 감지하고 SDP 템플릿을 사용하여 PII를 수정하는 엄격한 안전 정책을 정의하고 Terraform IaC로 이러한 리소스를 만들었습니다.

- 유해한 콘텐츠가 에이전트에 도달하기 전에 Model Armor 호출을 캡슐화하는 보안 레이어를 빌드했습니다.

- 배포된 시스템에 대해 레드팀 테스트를 실행하여 보안 컨트롤을 확인했습니다.

프로토타입에서 프로덕션으로

이 실습은 Google Cloud를 사용한 프로덕션 레디 AI 학습 과정의 일부입니다.

- 방어 강화: Model Armor를 구성하여 인터넷 검색 결과도 필터링하여 에이전트를 악성 웹 콘텐츠로부터 보호하고 출력 수정을 사용 설정하여 에이전트 응답에서 민감한 데이터가 유출되지 않도록 합니다.

- 자동화된 레드팀 활동: 전문 레드팀 에이전트를 배포하여 시스템의 취약점을 지속적으로 조사함으로써 수동 테스트를 넘어설 수 있습니다.

- 보안 시프트 레프트: Gemini를 사용하여 배포 전에 코드형 인프라 (Terraform)에서 잘못된 구성 및 규정 준수 문제를 검사하여 보안을 조기에 통합합니다.

전체 커리큘럼을 살펴보고 프로토타입에서 프로덕션으로 전환하는 데 필요한 지식을 쌓으세요.

#ProductionReadyAI 해시태그를 사용하여 진행 상황을 공유하세요.