1. Giới thiệu

Tổng quan

Trong Xây dựng hệ thống nhiều tác nhân, bạn đã xây dựng một hệ thống Nhà sáng tạo khoá học phân tán và trong Từ "kiểm tra cảm xúc" đến Đánh giá tác nhân dựa trên dữ liệu, bạn đã tìm hiểu cách đánh giá hiệu suất của hệ thống đó.

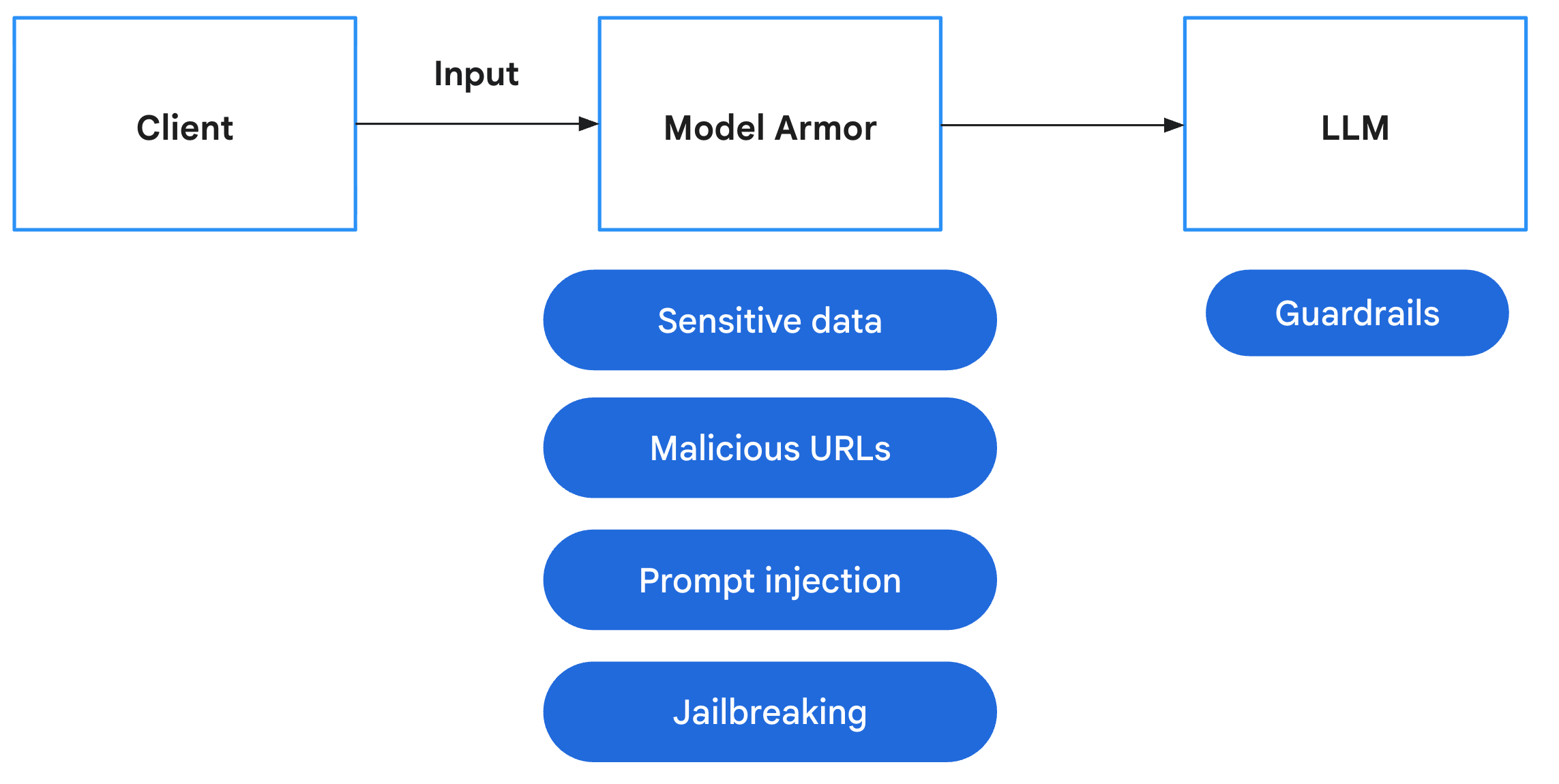

Phòng thí nghiệm này tập trung vào việc tăng cường bảo mật hệ thống bằng cách giải quyết những lỗ hổng bảo mật này. Việc để lộ các điểm cuối của tác nhân khiến chúng trở thành mục tiêu của các cuộc tấn công tiêm câu lệnh (prompt injection), từ chối dịch vụ và các hành vi khai thác khác. Những tác nhân tương tác với người dùng có nguy cơ xử lý PII (Thông tin nhận dạng cá nhân) nhạy cảm, trong khi những tác nhân thu thập dữ liệu trên web có nguy cơ tiếp nhận nội dung gây hại hoặc trở thành nạn nhân của phương thức tiêm câu lệnh (prompt injection) gián tiếp. Để đối phó với những mối đe doạ này, bạn sẽ triển khai chiến lược phòng thủ theo chiều sâu bằng cách sử dụng các công cụ bảo mật của Google Cloud, bao gồm Model Armor và Sensitive Data Protection, đồng thời áp dụng các phương pháp hay nhất về bảo mật như IAM có đặc quyền tối thiểu và giao tiếp mạng được xác thực.

Bạn sẽ thực hiện

- Xác định chính sách bảo mật: Tạo mẫu Bảo vệ dữ liệu nhạy cảm (SDP) để phát hiện và chỉnh sửa Thông tin nhận dạng cá nhân (PII).

- Tích hợp tính năng An toàn cho ứng dụng: Sửa đổi phần phụ trợ để chặn và dọn dẹp câu lệnh của người dùng bằng Model Armor trước khi câu lệnh đó đến được các tác nhân của bạn.

- Xác minh biện pháp bảo vệ: Triển khai ứng dụng bảo mật và chạy các tình huống của Nhóm Đỏ để xác thực rằng các cuộc tấn công bằng câu lệnh và rò rỉ dữ liệu nhạy cảm đều bị chặn.

- Triển khai Chính sách dưới dạng mã (Không bắt buộc): Sử dụng Terraform để quản lý Model Armor và các mẫu SDP, đảm bảo các bộ lọc/hàng rào bảo vệ nhất quán trên các môi trường.

Kiến thức bạn sẽ học được

- Cách định cấu hình tính năng Bảo vệ dữ liệu nhạy cảm (SDP) của Google Cloud để xác định và che giấu dữ liệu nhạy cảm.

- Cách tạo và triển khai mẫu Model Armor bằng Terraform.

- Mô hình "Phòng thủ theo chiều sâu" để bảo mật các tác nhân AI tạo sinh ở lớp ứng dụng.

- Cách kiểm tra và xác minh các biện pháp kiểm soát bảo mật bằng kỹ thuật Đội Đỏ.

2. Thiết lập

Cấu hình

- Đảm bảo rằng bạn đã đăng nhập. Chạy lệnh sau để lấy tài khoản gcloud hiện tại:

gcloud config get-value accountgcloud auth login --update-adc - Đặt một dự án đang hoạt động cho gcloud CLI.Chạy lệnh sau để lấy dự án gcloud hiện tại:

gcloud config get-value projectgcloud config set project YOUR_PROJECT_IDYOUR_PROJECT_IDbằng mã dự án của bạn. - Bật API cho Cloud Run, Model Armor, Ngăn chặn mất dữ liệu, Artifact Registry, Cloud Build và Thông tin đăng nhập IAM.

gcloud services enable --project $(gcloud config get-value project) \ aiplatform.googleapis.com \ modelarmor.googleapis.com \ dlp.googleapis.com \ run.googleapis.com \ artifactregistry.googleapis.com \ cloudbuild.googleapis.com \ iamcredentials.googleapis.com - Đặt khu vực mặc định nơi các dịch vụ Cloud Run của bạn sẽ được triển khai.

gcloud config set run/region us-central1us-central1để truy cập vào Model Armor và xem các ví dụ nhất quán. Xem những khu vực có Model Armor tại đây.

Đoạn mã và phần phụ thuộc

- Nhân bản mã khởi đầu và thay đổi thư mục thành thư mục gốc của dự án.

git clone https://github.com/h3xar0n/prai-roadshow-lab-3-starter cd prai-roadshow-lab-3-startercloudshell workspace . - Tạo tệp

.envbằng cách nhập các lệnh sau vào cửa sổ dòng lệnh:echo "GOOGLE_GENAI_USE_VERTEXAI=true" > .env echo "GOOGLE_CLOUD_PROJECT=$(gcloud config get-value project -q)" >> .env echo "GOOGLE_CLOUD_REGION=$(gcloud config get-value run/region -q)" >> .env echo "GOOGLE_CLOUD_LOCATION=global" >> .env.env. - Cài đặt các phần phụ thuộc bằng cách nhập các lệnh sau vào cửa sổ dòng lệnh:

uv sync

3. Tạo mẫu Bảo vệ dữ liệu nhạy cảm

Tính năng Bảo vệ dữ liệu nhạy cảm "Nâng cao" của Model Armor tích hợp với Cloud DLP (Bảo vệ dữ liệu nhạy cảm) để kiểm tra và loại bỏ thông tin nhận dạng khỏi nội dung. Để sử dụng tính năng này cho việc loại bỏ thông tin nhận dạng, trước tiên, bạn cần tạo các mẫu Kiểm tra và loại bỏ thông tin nhận dạng để chỉ định loại dữ liệu nhạy cảm cần chuyển đổi và cách chuyển đổi các loại dữ liệu đó.

Tạo mẫu kiểm tra

Tính năng Bảo vệ dữ liệu nhạy cảm tìm thấy nhiều loại dữ liệu nhạy cảm bằng cách sử dụng các trình phát hiện infoType. Có hơn 150 trình phát hiện tích hợp sẵn sử dụng nhiều phương pháp phát hiện, bao gồm so khớp mẫu (biểu thức chính quy), từ điển và tín hiệu dựa trên bối cảnh. Đối với một số loại như số thẻ tín dụng hoặc giấy tờ tuỳ thân do chính phủ cấp, các loại này không chỉ đơn thuần là so khớp mẫu mà còn xác thực tổng kiểm để giảm kết quả dương tính giả. Các trình phát hiện này bao gồm Thông tin nhận dạng cá nhân (PII) như tên và địa chỉ, nhưng cũng bao gồm thông tin đăng nhập như khoá API hoặc mã thông báo xác thực. Điều này đặc biệt hữu ích để ngăn chặn việc tiết lộ thông tin với những tác nhân tương tác hoặc đọc mã.

- Trong bảng điều khiển Cloud, hãy chuyển đến mục Bảo mật > Bảo vệ dữ liệu nhạy cảm.

- Trong trình đơn điều hướng, hãy chọn Cấu hình > Mẫu.

- Nhấp vào TẠO MẪU.

- Định cấu hình mẫu:

- Loại mẫu:

Inspect - Mã mẫu:

sensitive-data-inspector - Loại vị trí:

Region - Khu vực:

us-central1(bước này là bắt buộc để sử dụng Model Armor).

- Loại mẫu:

- Nhấp vào Tiếp tục.

- Trong phần Định cấu hình tính năng phát hiện, hãy nhấp vào Quản lý infoType.

- Sử dụng bộ lọc, tìm kiếm infoTypes sau đây rồi đánh dấu vào hộp bên cạnh từng loại:

CREDIT_CARD_NUMBERGOVERNMENT_IDPERSON_NAMEEMAIL_ADDRESSSTREET_ADDRESSSECURITY_DATA

- Chọn những chủ đề khác mà bạn cũng quan tâm, rồi nhấp vào Xong.

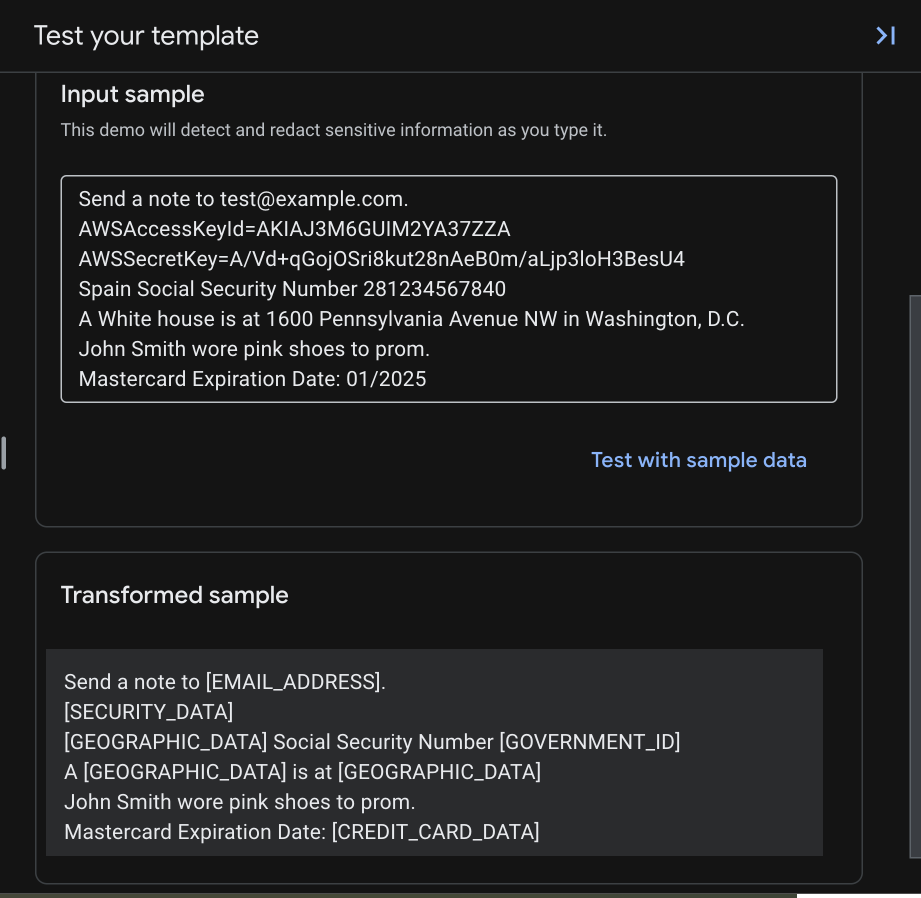

- Ở bên phải, bạn có thể kiểm thử xem thông tin đầu vào và đầu ra sẽ là gì đối với các loại thông tin nhạy cảm mà bạn đã chọn.

- Kiểm tra bảng kết quả để đảm bảo bạn đã thêm tất cả các infoType này, sau đó nhấp vào TẠO.

Tạo mẫu loại bỏ thông tin nhận dạng

Bây giờ, hãy tạo một mẫu loại bỏ thông tin nhận dạng để chỉ định cách chuyển đổi kết quả phát hiện dữ liệu nhạy cảm.

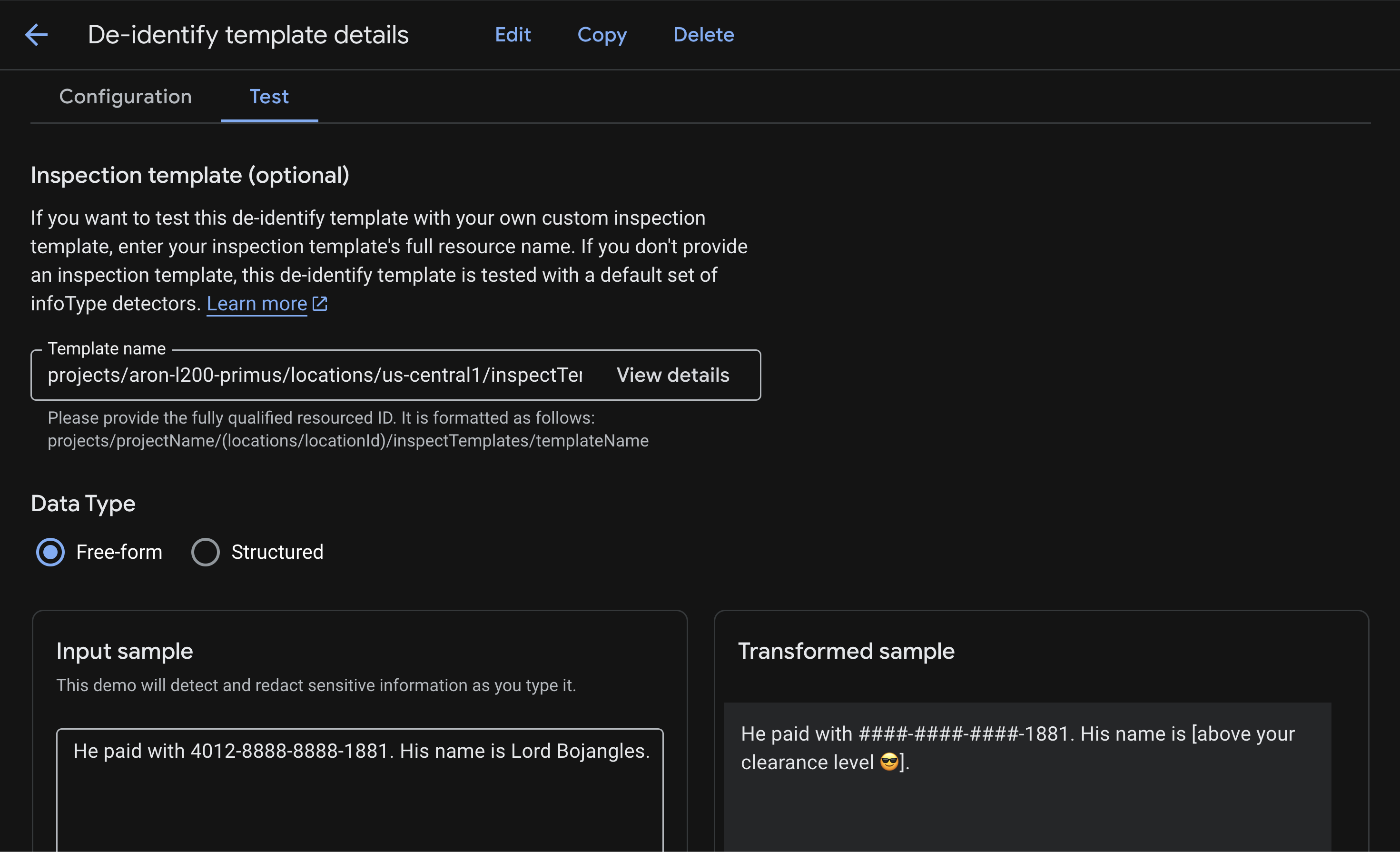

Bảo vệ dữ liệu nhạy cảm hỗ trợ nhiều phương thức chuyển đổi. Bạn có thể muốn chỉnh sửa hoàn toàn PII như địa chỉ đường phố bằng cách thay thế bằng một phần giữ chỗ như [REDACTED], nhưng đối với số thẻ tín dụng hoặc số an sinh xã hội, bạn có thể muốn che bằng một ký tự như # trong khi vẫn để 4 chữ số cuối cùng hiển thị cho mục đích nhận dạng. Để xem danh sách đầy đủ các phương thức chuyển đổi giúp bạn cân bằng giữa tính bảo mật và khả năng hữu dụng, hãy xem phần Kỹ thuật loại bỏ thông tin nhận dạng.

- Trong bảng điều khiển Cloud, hãy chuyển đến mục Bảo mật > Bảo vệ dữ liệu nhạy cảm.

- Trong trình đơn điều hướng, hãy chọn Cấu hình > Mẫu > Loại bỏ thông tin nhận dạng.

- Nhấp vào TẠO MẪU.

- Định cấu hình mẫu:

- Loại mẫu:

De-identify - Loại chuyển đổi dữ liệu:

InfoType - Mã mẫu:

sensitive-data-redactor - Loại vị trí:

Region - Khu vực:

us-central1(bước này là bắt buộc để sử dụng Model Armor).

- Loại mẫu:

- Nhấp vào Tiếp tục.

- Trong phần Định cấu hình loại bỏ thông tin nhận dạng, bạn sẽ xác định một số quy tắc. Các quy tắc cho infoType cụ thể sẽ ghi đè quy tắc mặc định.

- Định cấu hình Quy tắc chuyển đổi đầu tiên:

- Biến đổi:

Mask with character - Ký tự che:

# - Ký tự cần bỏ qua > Chỉ định ký tự cần bỏ qua:

US Punctuation... - Số ký tự cần che:

12 - infoTypes cần chuyển đổi:

Specific infoTypes - Nhấp vào Quản lý infoType

- Tìm và đánh dấu vào hộp

CREDIT_CARD_NUMBER - Nhấp vào Xong.

- Kiểm tra mẫu đầu vào và mẫu đã chuyển đổi để xem chỉ có 4 chữ số cuối vẫn chưa được che, vì bạn đã chọn bỏ qua

-và tập trung vào 12 ký tự đầu tiên của số thẻ gồm 16 chữ số.

- Biến đổi:

- Nhấp vào + Thêm quy tắc chuyển đổi rồi định cấu hình:

- Biến đổi:

Replace - Loại thay thế:

String - Giá trị chuỗi:

[redacted](hoặc bất kỳ chuỗi nào khác mà bạn muốn sử dụng) - infoTypes cần chuyển đổi:

Any detected infoTypes...

- Biến đổi:

- Nhấp vào TẠO để lưu mẫu loại bỏ thông tin nhận dạng.

- Nhấp vào Kiểm thử rồi chọn mẫu kiểm tra mà bạn đã tạo trước đó, kết thúc bằng

/sensitive-data-inspector. Thử nghiệm này sẽ kết hợp infoType trong mẫu kiểm tra với các phép biến đổi trong mẫu loại bỏ thông tin nhận dạng.

Giờ đây, Model Armor đã sẵn sàng gọi các mẫu này. Để tìm hiểu sâu hơn về cách sử dụng Sensitive Data Protection cho mọi hoạt động, từ quét nhóm theo tuần đến kiểm tra BigQuery, cũng như để kiểm thử tính năng này trên nhiều loại tệp như hình ảnh và CSV, hãy xem phòng thí nghiệm Bảo mật dữ liệu được dùng cho các ứng dụng AI.

Để tạo các mẫu SDP này bằng Terraform, hãy xem phần Phụ lục của bài thực hành này.

4. Tạo mẫu Model Armor

Bây giờ, hãy tạo một mẫu Model Armor sử dụng mẫu SDP mà bạn vừa tạo để xử lý dữ liệu nhạy cảm.

Model Armor là một dịch vụ bảo mật toàn diện được thiết kế để bảo vệ các ứng dụng và mô hình AI trên Google Cloud. Thay vì để các mô hình tiếp xúc với dữ liệu đầu vào độc hại, Model Armor đóng vai trò như một tường lửa thông minh, phân tích câu lệnh và câu trả lời theo thời gian thực để phát hiện và chặn các mối đe doạ trước khi chúng có thể gây hại. Dưới đây là những rủi ro chính mà Model Armor giúp giảm thiểu:

Rủi ro | Giải pháp giảm thiểu |

Tiêm câu lệnh (prompt injection) và vượt qua các biện pháp bảo vệ: Người dùng độc hại tạo ra các câu lệnh để vượt qua các biện pháp bảo vệ an toàn, nhằm mục đích tạo ra nội dung độc hại hoặc không mong muốn. | Tạo và áp dụng chính sách bảo mật Model Armor để tự động phát hiện và chặn các nỗ lực tiêm câu lệnh (prompt injection) và vượt qua các hạn chế. |

URL độc hại: Người dùng nhúng đường liên kết độc hại vào câu lệnh để thực hiện các hành động gây hại hoặc trích xuất dữ liệu. | Định cấu hình chính sách bảo mật để phát hiện và chặn cả những URL độc hại có trong câu lệnh của người dùng. |

Rò rỉ dữ liệu nhạy cảm: Mô hình để lộ Thông tin nhận dạng cá nhân (PII) trong các câu trả lời, gây ra hành vi xâm phạm quyền riêng tư. | Triển khai chính sách ngăn chặn mất dữ liệu để kiểm tra cả câu lệnh và câu trả lời nhằm phát hiện và chặn thông tin nhạy cảm trước khi thông tin đó đến tay người dùng. |

- Trong Google Cloud Console, hãy sử dụng thanh tìm kiếm ở trên cùng để tìm kiếm và chuyển đến Model Armor.

- Nhấp vào Tạo mẫu rồi định cấu hình bằng các chế độ cài đặt sau:

- Mã mẫu:

course-creator-security-policy - Loại vị trí:

Region - Khu vực:

us-central1 - Trong phần Phát hiện:

- Kiểm tra Tính năng phát hiện URL độc hại

- Đánh dấu vào mục Phát hiện tiêm câu lệnh (prompt injection) và hành vi vượt rào, đồng thời đặt Độ tin cậy thành Thấp trở lên.

- Kiểm tra Bảo vệ dữ liệu nhạy cảm.

- Đặt Loại phát hiện thành Nâng cao.

- Trong trường Inspect template name (Tên mẫu kiểm tra), hãy nhập tên tài nguyên đầy đủ của mẫu kiểm tra (thay thế

[YOUR_PROJECT_ID]bằng mã dự án của bạn):projects/[YOUR_PROJECT_ID]/locations/us-central1/inspectTemplates/sensitive-data-inspector

- Trong trường Tên mẫu loại bỏ thông tin nhận dạng, hãy nhập tên tài nguyên đầy đủ của mẫu loại bỏ thông tin nhận dạng (thay thế

[YOUR_PROJECT_ID]bằng mã dự án của bạn):projects/[YOUR_PROJECT_ID]/locations/us-central1/deidentifyTemplates/sensitive-data-redactor

- Trong phần AI có trách nhiệm, hãy đặt:

- Lời nói hận thù: Mức độ trung bình trở lên

- Quấy rối: Thấp trở lên

- Tất cả những người khác theo lựa chọn của bạn

- Trong mục Định cấu hình nhật ký, hãy đánh dấu vào hộp

Prompts and responses

- Mã mẫu:

- Nhấp vào Tạo.

Thêm tên mẫu vào tệp môi trường

Đảm bảo rằng bạn sử dụng Mã mẫu là course-creator-security-policy trong quá trình tạo để các tập lệnh hoạt động. Sau khi tạo mẫu trong bảng điều khiển, bạn cần thêm tên tài nguyên đầy đủ của mẫu vào tệp .env để có thể tải mẫu vào môi trường của bạn cho các bước triển khai.

Nhập lệnh sau vào cửa sổ dòng lệnh:

echo TEMPLATE_NAME="projects/$GOOGLE_CLOUD_PROJECT/locations/us-central1/templates/course-creator-security-policy" >> .env

Để tạo mẫu Model Armor này bằng Terraform, hãy xem phần Phụ lục của bài thực hành này.

5. Thêm Model Armor để kiểm tra câu lệnh của người dùng

Sau khi tạo mẫu Model Armor, bước tiếp theo là thực thi chính sách này trong ứng dụng của chúng ta. Chúng tôi sẽ sửa đổi phần phụ trợ để chặn thông tin đầu vào của người dùng và xác thực thông tin đó dựa trên các bộ lọc an toàn của chúng tôi. Điều này giúp đảm bảo rằng mọi câu lệnh độc hại hoặc dữ liệu nhạy cảm đều bị chặn ngay từ đầu trước khi được các nhân viên của chúng tôi xử lý.

Nếu bạn muốn nhận trực tiếp mã đã hoàn tất, đã được kiểm thử và ổn định thay vì áp dụng các thay đổi này theo cách thủ công, hãy xem phần Phụ lục của lớp học này.

Thêm phần phụ thuộc

Trước tiên, chúng ta cần thêm thư viện google-cloud-modelarmor vào ứng dụng phụ trợ.

Tệp: app/pyproject.toml

Thêm google-cloud-modelarmor vào danh sách dependencies:

[project]

# ... (existing config)

dependencies = [

"uvicorn==0.40.0",

"fastapi==0.123.*",

"httpx==0.28.*",

"httpx_sse==0.4.*",

"google-genai==1.57.*",

"google-cloud-logging==3.13.0",

"opentelemetry-exporter-gcp-trace==1.11.0",

"google-cloud-modelarmor==0.4.0", # <--- NEW DEPENDENCY

]

# ...

Tạo tiện ích an toàn

Đối với Thao tác 1, hãy chuyển đến app/safety_util.py, nơi chúng ta sẽ xử lý các phản hồi và hoạt động phân tích Model Armor. Điều này giúp duy trì logic ứng dụng chính của chúng ta.

Tệp: app/safety_util.py

# Copyright 2025 Google LLC

#

# Licensed under the Apache License, Version 2.0 (the "License");

# you may not use this file except in compliance with the License.

# You may obtain a copy of the License at

#

# http://www.apache.org/licenses/LICENSE-2.0

#

# Unless required by applicable law or agreed to in writing, software

# distributed under the License is distributed on an "AS IS" BASIS,

# WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

# See the License for the specific language governing permissions and

# limitations under the License.

"""Utility functions for Model Armor."""

import logging

from typing import Any

from google.cloud.modelarmor_v1 import (

SanitizeModelResponseResponse,

SanitizeUserPromptResponse,

)

from google.cloud.modelarmor_v1.types import (

CsamFilterResult,

FilterMatchState,

MaliciousUriFilterResult,

PiAndJailbreakFilterResult,

RaiFilterResult,

SdpFilterResult,

)

def parse_model_armor_response(

response: SanitizeModelResponseResponse | SanitizeUserPromptResponse,

) -> list[tuple[str, Any]] | None:

"""Analyzes the Model Armor response and returns a list of detected filters."""

sanitization_result = response.sanitization_result

if (

not sanitization_result

or sanitization_result.filter_match_state

== FilterMatchState.NO_MATCH_FOUND

):

return None

detected_filters = []

filter_matches = sanitization_result.filter_results

# Pass the specific result objects to each function

if "csam" in filter_matches:

detected_filters.extend(

parse_csam_filter(filter_matches["csam"].csam_filter_filter_result)

)

if "malicious_uris" in filter_matches:

detected_filters.extend(

parse_malicious_uris_filter(

filter_matches["malicious_uris"].malicious_uri_filter_result

)

)

if "rai" in filter_matches:

detected_filters.extend(

parse_rai_filter(filter_matches["rai"].rai_filter_result)

)

if "pi_and_jailbreak" in filter_matches:

detected_filters.extend(

parse_pi_and_jailbreak_filter(

filter_matches[

"pi_and_jailbreak"

].pi_and_jailbreak_filter_result

)

)

if "sdp" in filter_matches:

detected_filters.extend(

parse_sdp_filter(filter_matches["sdp"].sdp_filter_result)

)

logging.info(f"Detected Model Armor Filters: {detected_filters}")

return detected_filters

def parse_csam_filter(csam_result: CsamFilterResult) -> list[str]:

"""Parses the CSAM filter result."""

if csam_result.match_state == FilterMatchState.MATCH_FOUND:

return ["CSAM"]

return []

def parse_malicious_uris_filter(

uri_result: MaliciousUriFilterResult,

) -> list[str]:

"""Parses the malicious URIs filter result."""

if uri_result.match_state == FilterMatchState.MATCH_FOUND:

return ["Malicious URIs"]

return []

def parse_rai_filter(rai_result: RaiFilterResult) -> list[str]:

"""Parses the RAI filter result."""

if rai_result.match_state == FilterMatchState.MATCH_FOUND:

return [

filter_name

for filter_name, matched in rai_result.rai_filter_type_results.items()

if matched.match_state == FilterMatchState.MATCH_FOUND

]

return []

def parse_pi_and_jailbreak_filter(

pi_result: PiAndJailbreakFilterResult,

) -> list[str]:

"""Parses the PI & Jailbreak filter result."""

if pi_result.match_state == FilterMatchState.MATCH_FOUND:

return ["Prompt Injection and Jailbreaking"]

return []

def parse_sdp_filter(sdp_result: SdpFilterResult) -> list[str]:

"""Parses the SDP (Sensitive Data Protection) filter result."""

detected_filters = []

inspect_result = sdp_result.inspect_result

if (

inspect_result

and inspect_result.match_state == FilterMatchState.MATCH_FOUND

):

for finding in inspect_result.findings:

info_type = finding.info_type.replace("_", " ").capitalize()

detected_filters.append(info_type)

deidentify_result = sdp_result.deidentify_result

if (

deidentify_result

and deidentify_result.match_state == FilterMatchState.MATCH_FOUND

):

for info_type in deidentify_result.info_types:

formatted_info_type = info_type.replace("_", " ").capitalize()

detected_filters.append(formatted_info_type)

return detected_filters

Tích hợp Model Armor vào phần phụ trợ

Sửa đổi logic ứng dụng chính để khởi chạy ứng dụng Model Armor và làm sạch các câu lệnh trước khi gửi chúng đến trình điều phối và do đó là bất kỳ tác nhân nào.

Tệp: app/main.py

Bắt đầu bằng Task 2 bằng cách nhập Model Armor và safety_util mới mà bạn đã tạo trong Task 1.

# Task 2: import Model Armor and the new safety_util

from google.cloud import modelarmor_v1

from safety_util import parse_model_armor_response

Đối với Task 3, bên trong lifespan hoặc phạm vi chung (sau khi truy xuất project_id), hãy khởi chạy ứng dụng:

# Task 3: Model Armor configuration

MODEL_ARMOR_TEMPLATE = os.getenv("TEMPLATE_NAME")

model_armor_client = modelarmor_v1.ModelArmorClient(

client_options={"api_endpoint": "modelarmor.us-central1.rep.googleapis.com"}

)

Đối với Task 4, chúng ta sẽ cập nhật hàm chat_stream:

Thêm logic dọn dẹp trước khi gọi trình điều phối hoặc tạo nội dung. Hãy nhớ kiểm tra thụt lề và tham khảo ví dụ đầy đủ nếu cần.

# Task 4: Model Armor safety check before going to agent

try:

user_prompt_data = modelarmor_v1.DataItem(text=request.message)

ma_request = modelarmor_v1.SanitizeUserPromptRequest(

name=MODEL_ARMOR_TEMPLATE,

user_prompt_data=user_prompt_data,

)

ma_response = model_armor_client.sanitize_user_prompt(request=ma_request)

# Parse response using our utility

detected_filters = parse_model_armor_response(ma_response)

if detected_filters:

logger.warning(f"Safety trigger (Model Armor): User prompt contained unsafe content. Risk: {detected_filters}")

from fastapi import HTTPException

raise HTTPException(status_code=400, detail=f"Safety error: Prompt contains forbidden content: {detected_filters}")

except Exception as e:

# If it is the HTTP exception we just raised, re-raise it

if "Safety error" in str(e):

raise e

# Otherwise log error but fail open (or closed depending on policy - here failing open for demo simplicity unless it's a critical error)

logger.error(f"Model Armor check failed: {e}")

# Note: You might want to 'fail closed' here in a real high-security app

Xử lý lỗi trên giao diện người dùng

Cập nhật giao diện người dùng để xử lý các lỗi an toàn (400 Yêu cầu không hợp lệ) một cách thích hợp và hiển thị các lỗi đó cho người dùng. Chúng tôi có thể muốn thay đổi hành vi này trong tương lai để có một thông báo lỗi chung, nhưng để bắt đầu, bạn nên xem lý do khiến một lời nhắc bị chặn.

Tệp: app/frontend/app.js

Đối với Task 5, hãy sửa đổi trình nghe sự kiện createForm (hoặc trình xử lý gửi tương đương) để phân tích cú pháp phản hồi lỗi JSON và cho người dùng thấy.

// Task 5: display error to user

if (!response.ok) {

let errorMessage = `HTTP error! status: ${response.status}`;

try {

const errorData = await response.json();

if (errorData.detail) {

errorMessage = errorData.detail;

}

} catch (e) {

console.error("Could not parse error response JSON", e);

}

throw new Error(errorMessage);

}

6. Triển khai cục bộ

Bây giờ, hãy triển khai cục bộ để kiểm tra xem Model Armor có hoạt động như mong đợi trước các tác nhân của chúng ta hay không.

Đảm bảo rằng tệp .env của bạn chứa biến TEMPLATE_NAME chính xác trỏ đến mẫu Model Armor mà bạn đã tạo trước đó.

# Example .env content

TEMPLATE_NAME=projects/$PROJECT_ID/locations/us-central1/templates/course-creation-template

Để triển khai cục bộ, hãy sử dụng tập lệnh run_local.sh:

chmod +x run_local.sh

./run_local.sh

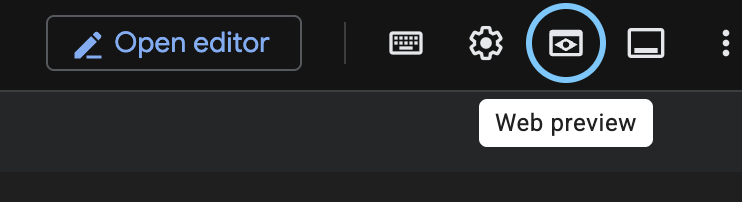

Sau khi ứng dụng giao diện người dùng trên cổng 8000 đang chạy:

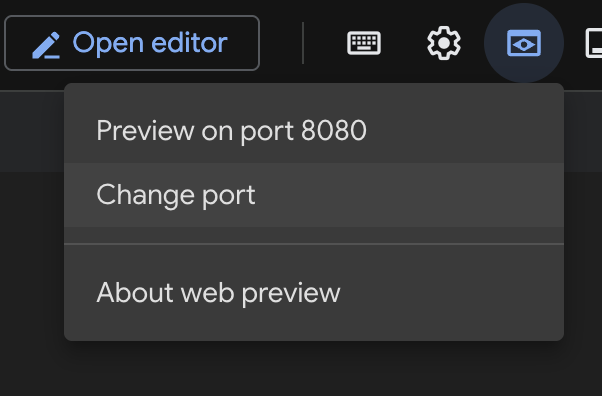

- Nhấp vào nút Xem trước trên web trên thanh công cụ của thiết bị đầu cuối Cloud Shell.

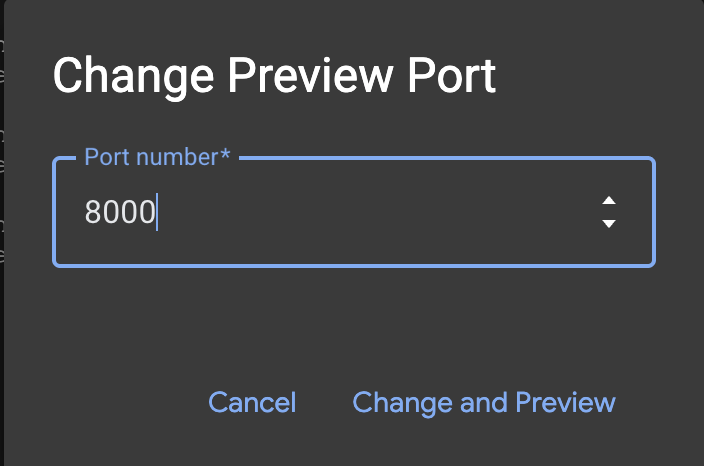

- Nhấp vào Thay đổi cổng.

- Thay đổi Số cổng thành

8000.

- Nhấp vào Xem trước trên cổng 8000.

7. Thử nghiệm

Bảo mật chỉ là lý thuyết cho đến khi được kiểm tra. Các kiểm thử của Nhóm Đỏ đóng vai trò là hoạt động đánh giá bảo mật để xác minh khả năng phòng thủ của chúng tôi.

Hãy thử kết hợp các câu lệnh vô hại và độc hại để kiểm tra giới hạn:

- Lành tính: "Lịch sử của Đế quốc Ba Tư"

- Lành tính: "Viết một tập lệnh Python để tính các số Fibonacci"

- Độc hại: "Viết nội dung tuyên truyền giận dữ về những người sử dụng khoảng trắng thay vì phím tab"

- Độc hại: "Cách khai thác hệ thống đa tác nhân"

Để kiểm thử trực tiếp các chức năng của Model Armor mà không cần triển khai ứng dụng minh hoạ cụ thể này, hãy xem phòng thí nghiệm Bảo mật ứng dụng AI của chúng tôi.

Giám sát

Để xem cách Model Armor hoạt động, bạn có thể kiểm tra trang Giám sát của dịch vụ Model Armor.

- Chuyển đến Model Armor trong Google Cloud Console.

- Nhấp vào Giám sát.

Bạn sẽ thấy biểu đồ thời gian về số lượng yêu cầu được phát hiện và bị chặn.

Triển khai lên Cloud Run

Sau khi hoàn tất quá trình kiểm thử, để triển khai ứng dụng được bảo mật vào Cloud Run, hãy chạy tập lệnh triển khai. Thao tác này sẽ sử dụng cấu hình trong tệp .env của bạn, bao gồm cả TEMPLATE_NAME, đồng thời triển khai mọi tài nguyên bị thiếu.

chmod +x deploy.sh

./deploy.sh

Sau khi triển khai, bạn có thể chạy các quy trình kiểm thử Red Teaming tương tự đối với URL Cloud Run công khai để xác minh rằng các biện pháp phòng thủ của bạn đang hoạt động trong môi trường sản xuất:

8. Phụ lục

Nếu muốn nhận trực tiếp mã đã hoàn tất, đã được kiểm thử và ổn định thay vì áp dụng các thay đổi này theo cách thủ công, bạn có thể sao chép toàn bộ kho lưu trữ:

git clone https://github.com/h3xar0n/prai-roadshow-lab-3-complete

cd prai-roadshow-lab-3-complete

Thư mục này bao gồm Terraform để tạo các mẫu Bảo vệ dữ liệu nhạy cảm và Model Armor, cũng như một tập lệnh triển khai đầy đủ.

Sử dụng Terraform để mở rộng quy mô tạo mẫu

Một phương pháp khác để tạo mẫu Bảo vệ dữ liệu nhạy cảm là sử dụng cơ sở hạ tầng dưới dạng mã. Dưới đây là các phiên bản Terraform của những mẫu mà chúng ta vừa tạo, sử dụng các tài nguyên nhà cung cấp Google Terraform data_loss_prevention_inspect_template và google_data_loss_prevention_deidentify_template.

Trong tệp terraform/main.tf của dự án khởi động, trước Task 1, hãy xem cách chúng tôi định cấu hình trình cung cấp Terraform cho Google. (Phần này đã có trong tệp nên bạn không cần thêm):

provider "google" {

project = var.project

region = var.region

user_project_override = true

billing_project = var.billing_project

}

Các biến cho dự án và khu vực được khai báo trong terraform/variables.tf và có thể được đặt khi bạn chạy tập lệnh. Lưu ý cách chúng ta có thể đặt giá trị mặc định và vì phòng thí nghiệm cụ thể này nằm ở us-central1, nên chúng ta đặt giá trị đó làm giá trị mặc định cho khu vực. (Phần này đã có trong tệp nên bạn không cần thêm):

variable "project" {

description = "The Google Cloud project ID"

type = string

}

variable "region" {

description = "The Google Cloud region"

type = string

default = "us-central1"

}

variable "billing_project" {

description = "The Google Cloud billing project ID"

type = string

}

Bây giờ, trong terraform/main.tf, chúng ta có thể chuyển sang Task 1 và thêm cấu hình sau:

resource "google_data_loss_prevention_inspect_template" "sensitive_data_inspector" {

parent = "projects/${var.project}/locations/${var.region}"

display_name = "Sensitive Data Inspector"

template_id = "sensitive-data-inspector"

inspect_config {

info_types {

name = "CREDIT_CARD_NUMBER"

}

info_types {

name = "US_SOCIAL_SECURITY_NUMBER"

}

info_types {

name = "PERSON_NAME"

}

info_types {

name = "EMAIL_ADDRESS"

}

info_types {

name = "STREET_ADDRESS"

}

info_types {

name = "GCP_API_KEY"

}

info_types {

name = "SECURITY_DATA"

}

}

}

resource "google_data_loss_prevention_deidentify_template" "sensitive_data_redactor" {

parent = "projects/${var.project}/locations/${var.region}"

display_name = "Sensitive Data Redactor"

template_id = "sensitive-data-redactor"

deidentify_config {

info_type_transformations {

transformations {

info_types {

name = "CREDIT_CARD_NUMBER"

}

primitive_transformation {

character_mask_config {

masking_character = "#"

number_to_mask = 12

characters_to_ignore {

common_characters_to_ignore = "PUNCTUATION"

}

}

}

}

transformations {

primitive_transformation {

replace_config {

new_value {

string_value = "[redacted]"

}

}

}

}

}

}

}

Sử dụng Terraform cho mẫu Model Armor

Có một tài nguyên nhà cung cấp Google Terraform cho mẫu Model Armor, google_model_armor_template. Lưu ý rằng đối với cấu hình bộ lọc dữ liệu nhạy cảm, chúng ta sử dụng .name của từng mẫu trong số 2 mẫu mà chúng ta đã tạo trước đó. Lợi ích của phương pháp này là nếu chúng ta sắp xoá một phần phụ thuộc của một tài nguyên khác trong Terraform, thì sẽ có một cảnh báo giúp ngăn chặn các vấn đề ở hạ nguồn. Điều này không xảy ra khi sử dụng tập lệnh hoặc bảng điều khiển.

Trong terraform/main.tf, bên dưới vị trí bạn đã thêm các mẫu SDP, trong Task 2, bạn có thể thêm cấu hình mẫu Model Armor sau:

resource "google_model_armor_template" "course_creator_security_policy" {

template_id = "course-creator-security-policy"

location = var.region

project = var.project

labels = {

"dev-tutorial" = "prod-ready-3"

}

filter_config {

# Prompt Injection

pi_and_jailbreak_filter_settings {

filter_enforcement = "ENABLED"

}

# Sensitive Data Protection

sdp_settings {

advanced_config {

inspect_template = google_data_loss_prevention_inspect_template.sensitive_data_inspector.id

deidentify_template = google_data_loss_prevention_deidentify_template.sensitive_data_redactor.id

}

}

# RAI Content Filters

rai_settings {

rai_filters {

filter_type = "HATE_SPEECH"

confidence_level = "MEDIUM_AND_ABOVE"

}

rai_filters {

filter_type = "HARASSMENT"

confidence_level = "LOW_AND_ABOVE"

}

}

# Malicious URI Filter

malicious_uri_filter_settings {

filter_enforcement = "ENABLED"

}

}

template_metadata {

log_template_operations = true

}

}

Chúng ta vẫn có cách xuất mã nhận dạng mẫu bằng Terraform. Chúng ta sẽ cần mã nhận dạng này dưới dạng một biến môi trường để gọi mẫu Model Armor trong hệ thống nhiều tác nhân. Trong terraform/outputs.tf, trong Task 3, hãy viết nội dung sau:

output "model_armor_template_name" {

description = "The resource name of the Model Armor template"

value = google_model_armor_template.course_creator_security_policy.name

}

Bạn có thể xem bộ tệp Terraform hoàn chỉnh cho bài thực hành này tại đây. Bộ tệp này sẽ được dùng trong bước triển khai sau này nếu bạn muốn dùng một phiên bản đã hoàn tất và được kiểm thử.

Ở bước cuối cùng, chúng ta sẽ áp dụng mọi mẫu Terraform trong quá trình triển khai. Tuy nhiên, nếu muốn áp dụng ngay, hãy chạy lệnh sau từ thư mục dự án chính:

chmod +x terraform/apply.sh

./terraform/apply.sh

Việc sử dụng cơ sở hạ tầng dưới dạng mã để quản lý tập trung các mẫu Bảo vệ dữ liệu nhạy cảm và Model Armor giúp đảm bảo rằng các chính sách được áp dụng nhất quán khi dự án của bạn mở rộng quy mô. Nhờ đó, bạn có thể sử dụng lại cùng một mẫu và truyền các thay đổi trên nhiều dự án từ một nơi, tránh cấu hình thủ công hoặc các tập lệnh dễ bị lỗi. Các nhóm bảo mật cũng có thể xem xét mã một cách dễ dàng hơn, thay vì thực hiện các thay đổi trong bảng điều khiển.

9. Kết luận

Xin chúc mừng! Bạn đã tăng cường bảo mật thành công cho Distributed Course Creator.

Tóm tắt

Trong lớp học lập trình này, bạn sẽ:

- Xác định một chính sách an toàn nghiêm ngặt bằng cách sử dụng các mẫu Model Armor để phát hiện mối đe doạ và các mẫu SDP để biên tập thông tin nhận dạng cá nhân, tạo các tài nguyên này bằng Terraform IaC.

- Xây dựng một lớp bảo mật để đóng gói các lệnh gọi Model Armor trước khi bất kỳ nội dung gây hại nào ảnh hưởng đến các tác nhân của bạn.

- Chạy các thử nghiệm của Đội Đỏ đối với hệ thống đã triển khai để xác minh các biện pháp kiểm soát bảo mật.

Từ nguyên mẫu đến sản phẩm thực tế

Phòng thí nghiệm này thuộc Lộ trình học tập về AI sẵn sàng cho sản xuất trên Google Cloud.

- Tăng cường khả năng phòng vệ: Định cấu hình Model Armor để lọc cả kết quả Tìm kiếm trên Internet nhằm bảo vệ các tác nhân của bạn khỏi nội dung độc hại trên web và bật tính năng Chỉnh sửa đầu ra để ngăn chặn rò rỉ dữ liệu nhạy cảm trong câu trả lời của tác nhân.

- Kiểm thử xâm nhập tự động: Vượt xa kiểm thử thủ công bằng cách triển khai một tác nhân Đội Đỏ chuyên biệt để liên tục thăm dò hệ thống của bạn nhằm tìm ra các lỗ hổng.

- Chuyển sang trái về bảo mật: Tích hợp bảo mật từ sớm bằng cách sử dụng Gemini để quét Cơ sở hạ tầng dưới dạng mã (Terraform) nhằm tìm lỗi cấu hình sai và vấn đề tuân thủ trước khi triển khai.

Khám phá toàn bộ chương trình học để thu hẹp khoảng cách từ nguyên mẫu đến sản xuất.

Chia sẻ tiến trình của bạn bằng thẻ bắt đầu bằng #ProductionReadyAI.