1. Introduzione

Nota: questo codelab richiede un dispositivo fisico per il test

TensorFlow è un framework di machine learning multiuso. TensorFlow può essere utilizzato ovunque, dall'addestramento di modelli enormi in cluster nel cloud all'esecuzione di modelli in locale su un sistema incorporato come lo smartphone.

Questo codelab utilizza TensorFlow Lite per eseguire un modello di riconoscimento di immagini su un dispositivo Android.

Installa Android Studio 4.1 o versioni successive

Se non è già installato, scarica e installa Android Studio 4.1 o versioni successive mentre addestri il modello TensorFlow Lite.

Obiettivi didattici

- Come addestrare il tuo classificatore di immagini personalizzato utilizzando TensorFlow Lite Model Maker.

- Come utilizzare Android Studio per importare il modello TensorFlow Lite per integrare il modello personalizzato in un'app per Android utilizzando CameraX.

- Come utilizzare la GPU sullo smartphone per accelerare il modello.

Cosa creerai

Una semplice app fotocamera che esegue un programma di riconoscimento delle immagini TensorFlow per identificare i fiori.

Licenza: Utilizzo senza costi

2. Addestra un sistema di riconoscimento dei fiori utilizzando Colab

Prima di avviare l'addestramento del modello, inizia a scaricare e installare Android Studio 4.1 o versioni successive.

Apri Colab, che mostra come addestrare un classificatore con Keras per riconoscere i fiori utilizzando il trasferimento di apprendimento di TensorFlow Lite.

3. Configurare la directory di lavoro

Clona il repository Git

Il seguente comando clonerà il repository Git contenente i file necessari per questo codelab:

git clone https://github.com/hoitab/TFLClassify.git

Poi vai alla directory in cui hai appena clonato il repository. Qui lavorerai per il resto di questo codelab:

cd TFLClassify

4. Configurare l'app scheletro Android

Installa Android Studio 4.1 o versioni successive

Se non l'hai ancora installato, vai a installare Android Studio 4.1 o versioni successive.

Apri il progetto con Android Studio

Apri un progetto con Android Studio seguendo questi passaggi:

- Apri Android Studio

. Una volta caricato, seleziona "Apri un progetto esistente" da questo popup:

. Una volta caricato, seleziona "Apri un progetto esistente" da questo popup:

- Nel selettore di file, scegli

TFLClassify/build.gradledalla directory di lavoro.

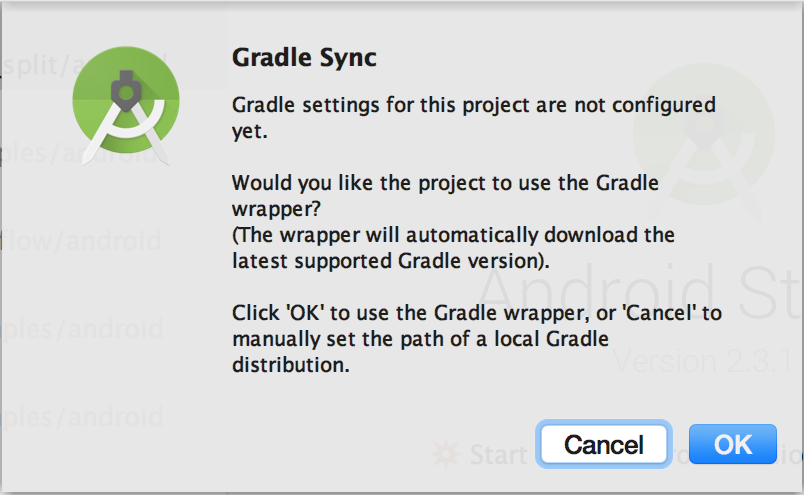

- La prima volta che apri il progetto, viene visualizzato un popup "Gradle Sync" che ti chiede se vuoi utilizzare Gradle Wrapper. Fai clic su "OK".

- Attiva la modalità sviluppatore e il debug USB sullo smartphone, se non l'hai ancora fatto. Si tratta di una configurazione una tantum. Segui queste istruzioni.

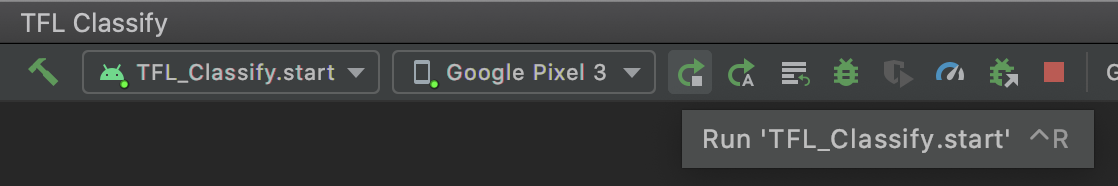

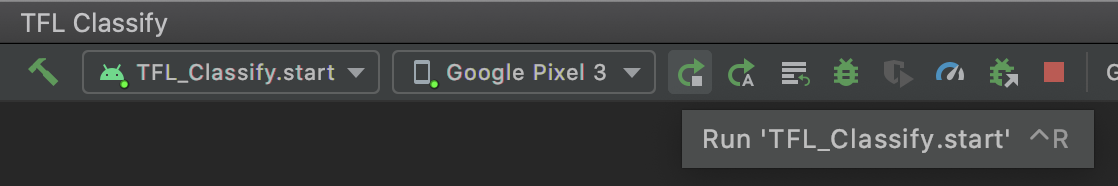

- Una volta che il progetto e lo smartphone sono pronti, puoi eseguirlo su un dispositivo reale selezionando

TFL_Classify.starte premendo il pulsante di esecuzione sulla barra degli strumenti:

sulla barra degli strumenti:

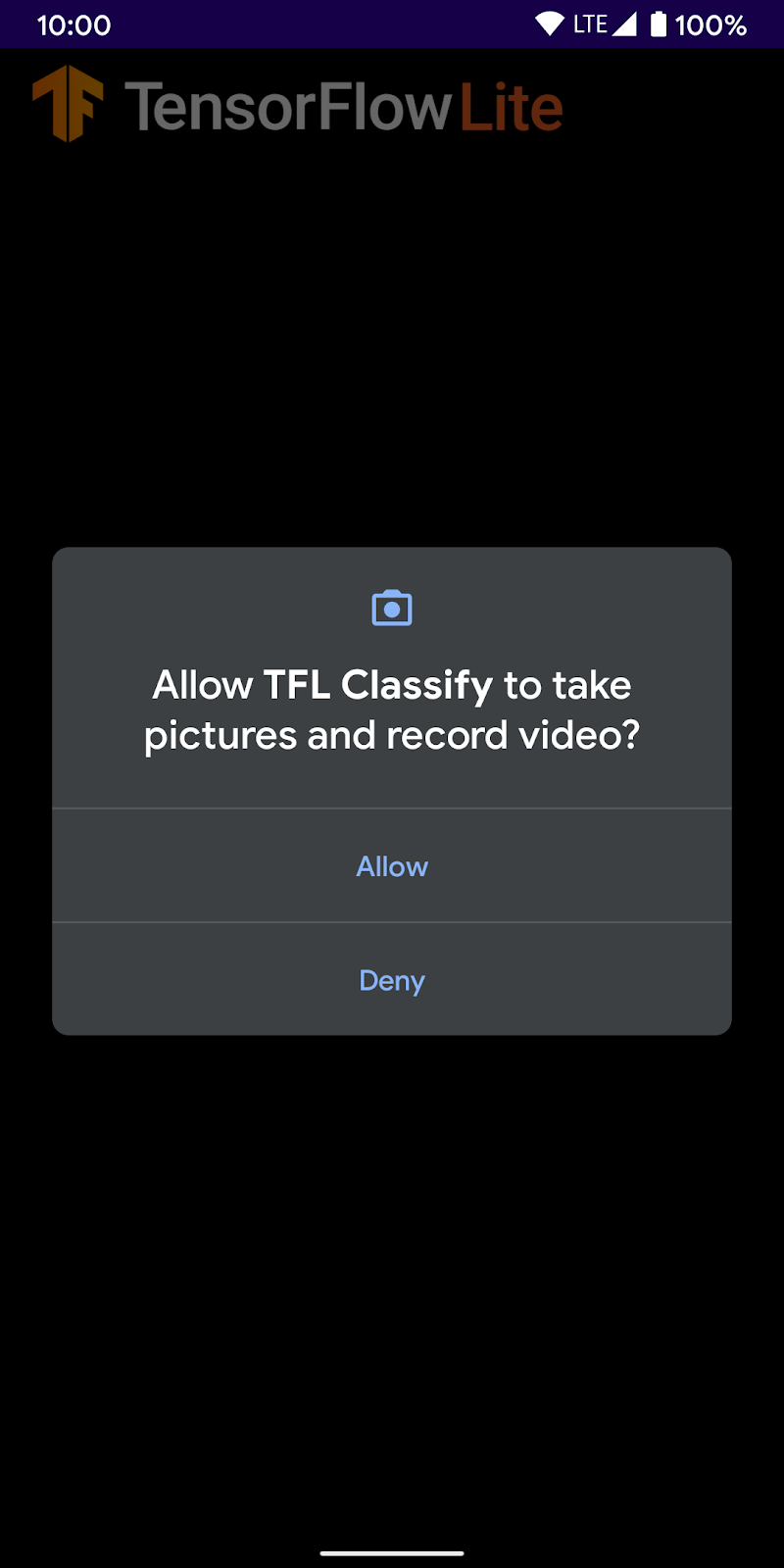

- Ora consenti alla demo di TensorFlow di accedere alla tua videocamera:

- Sul tuo smartphone vedrai la seguente schermata con numeri casuali al posto dei risultati reali.

5. Aggiungere TensorFlow Lite all'app per Android

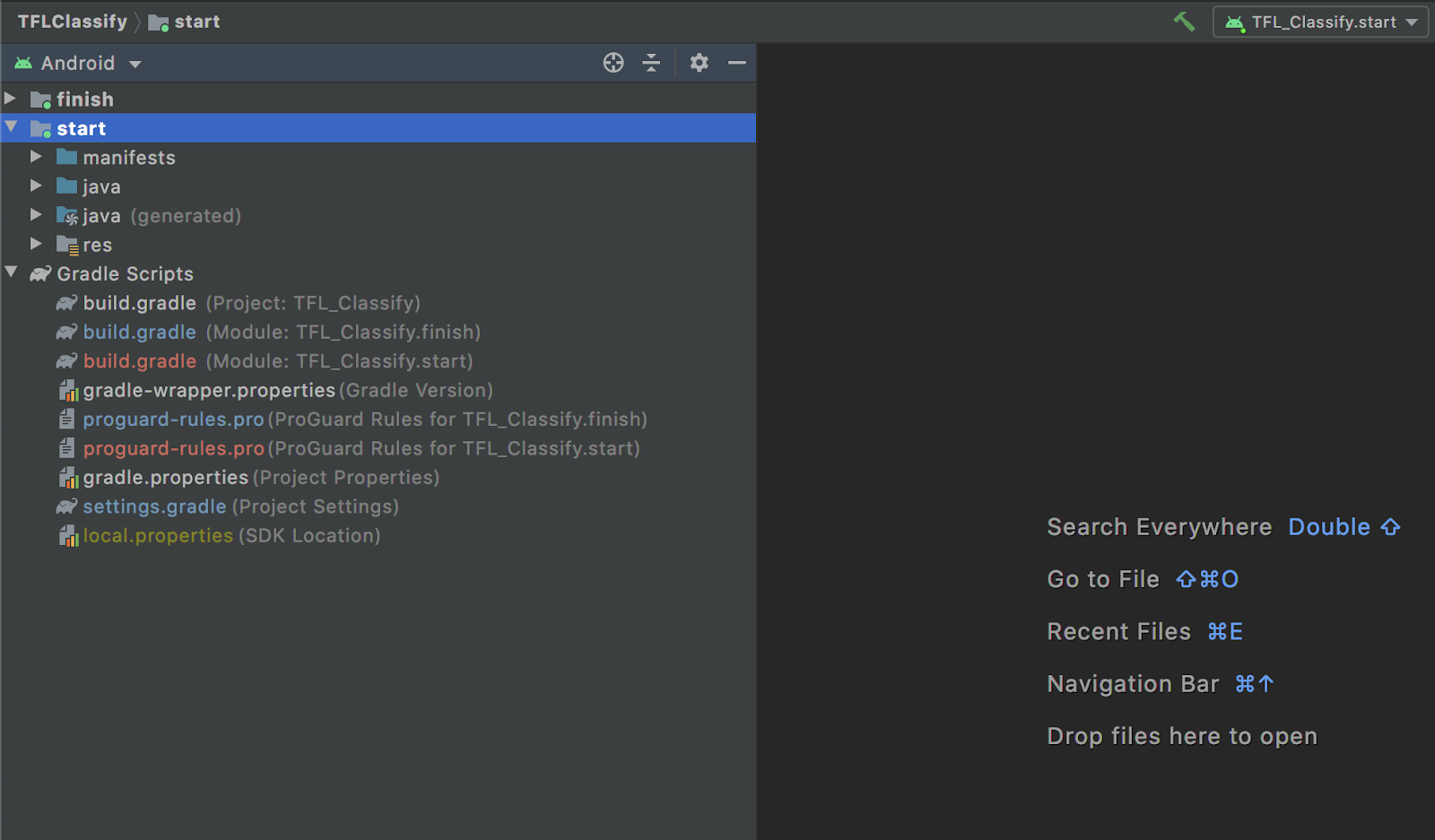

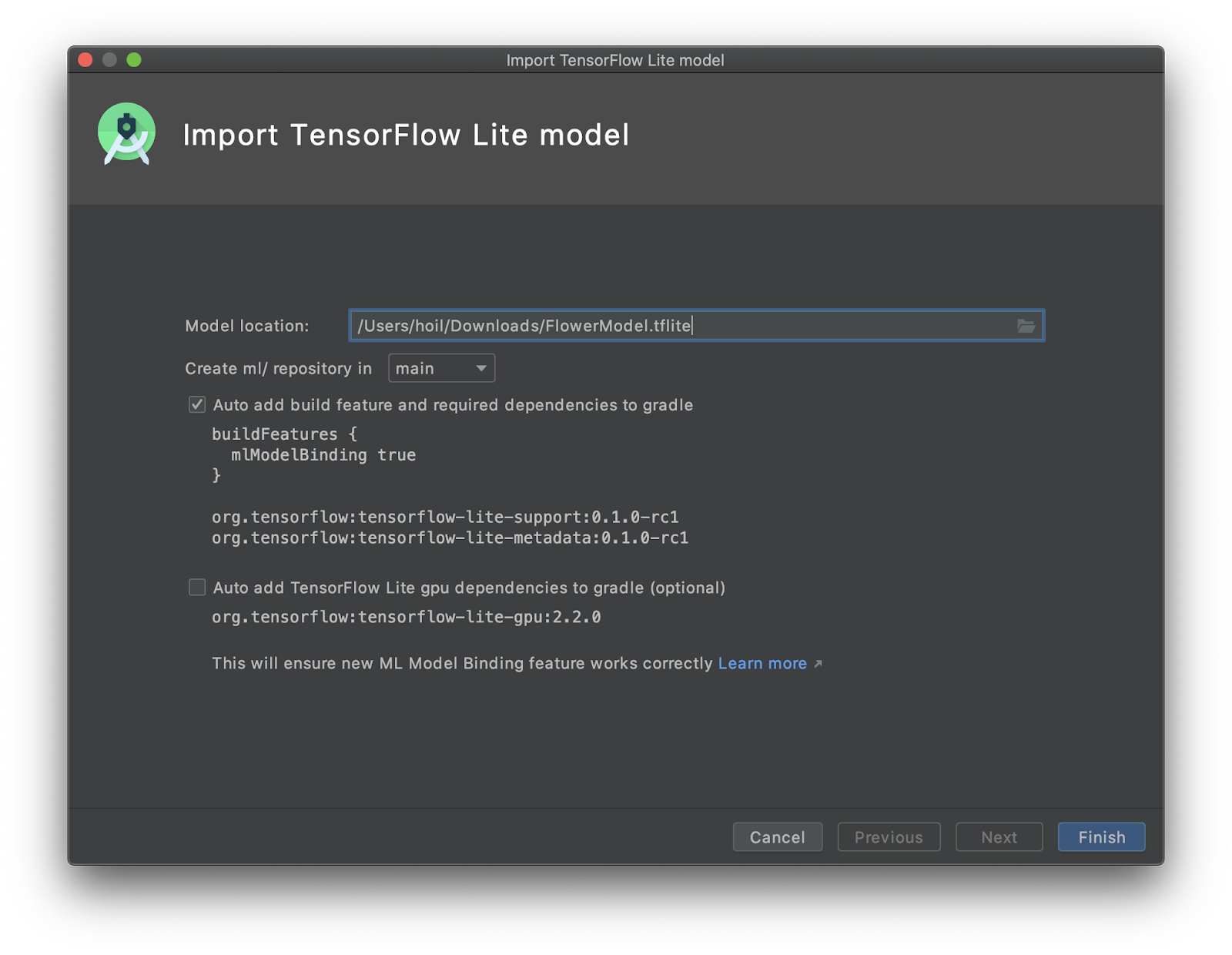

- Seleziona il modulo

startin Esplora progetti a sinistra:

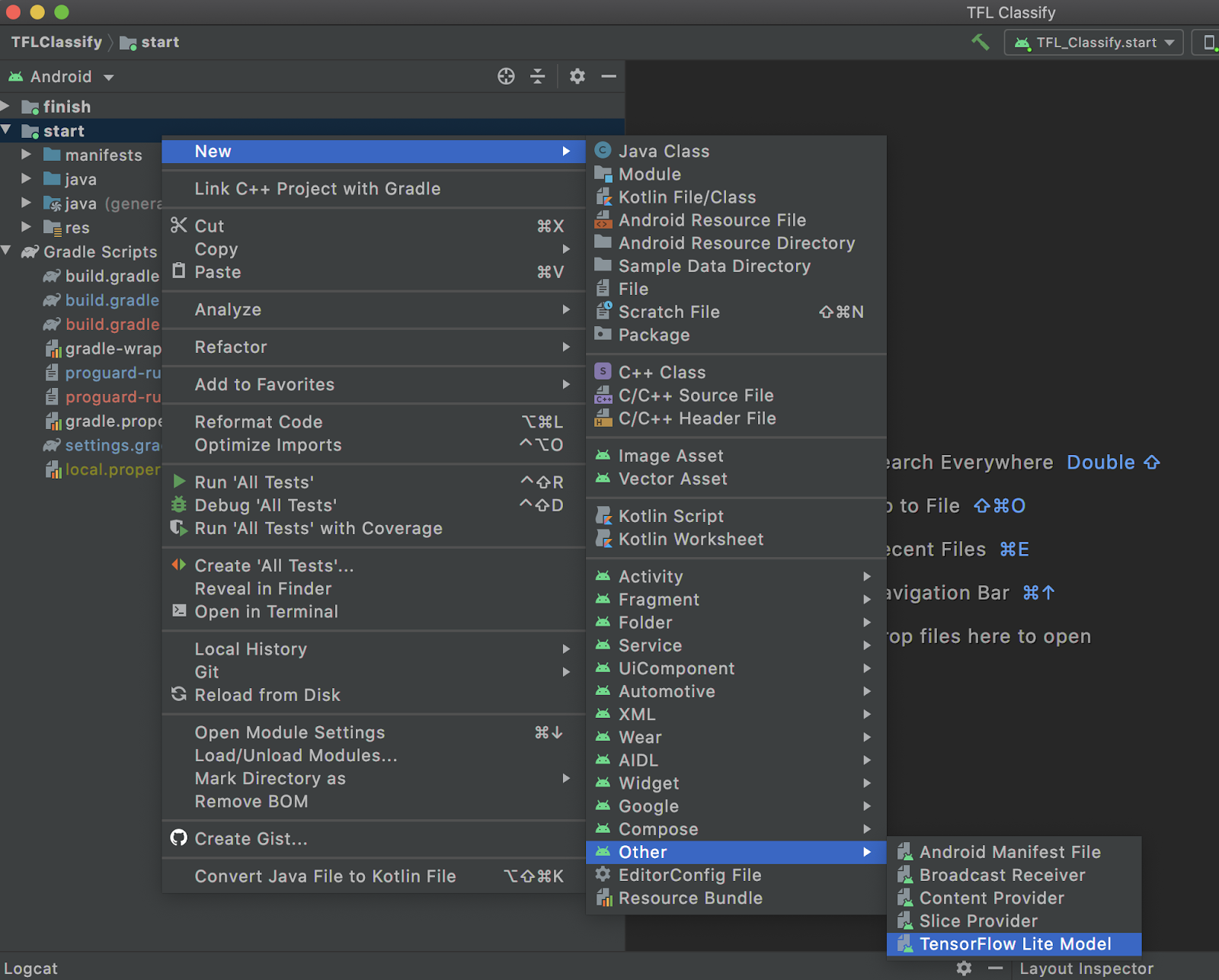

- Fai clic con il tasto destro del mouse sul modulo

starto fai clic suFile, quindiNew>Other>TensorFlow Lite Model.

- Seleziona la posizione del modello in cui hai scaricato

FlowerModel.tflitecon addestramento personalizzato in precedenza.

- Fai clic su

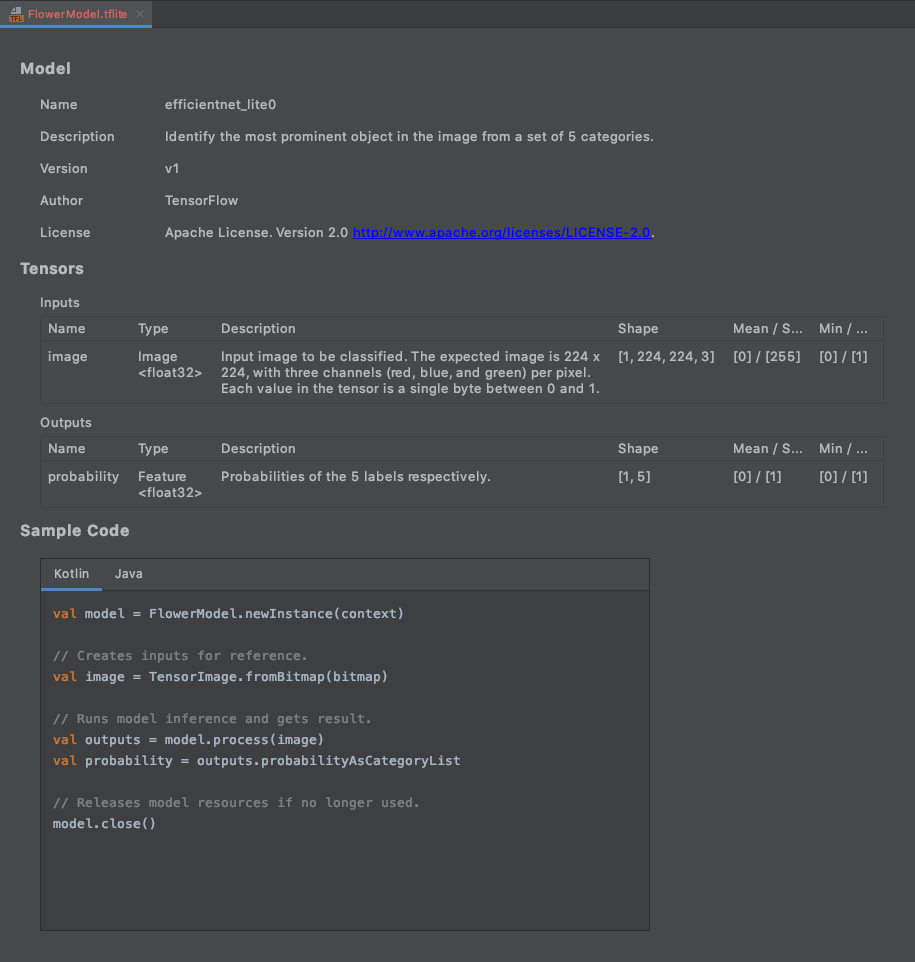

Finish. - Alla fine vedrai quanto segue. FlowerModel.tflite viene importato correttamente e mostra le informazioni di alto livello sul modello, inclusi input / output e alcuni codici campione per iniziare.

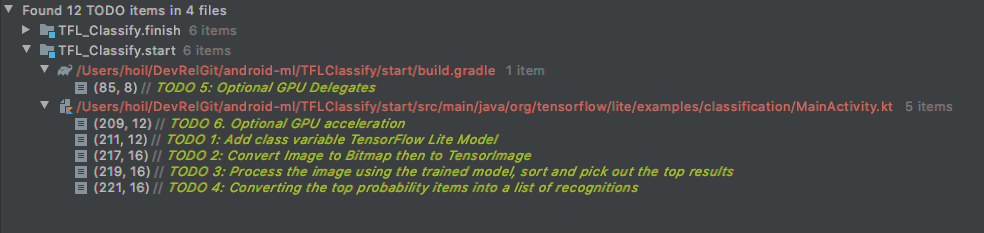

6. (Facoltativo) Controllare l'elenco di tutte le cose da fare

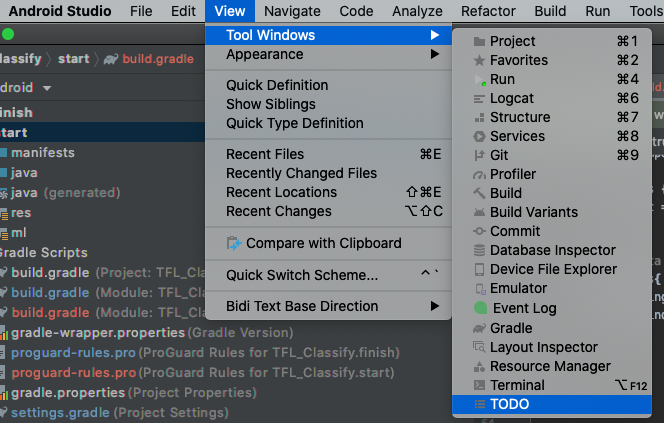

L'elenco delle cose da fare semplifica la navigazione fino alla posizione esatta in cui devi aggiornare il codelab. Puoi anche utilizzarlo nel tuo progetto Android per ricordarti il lavoro futuro. Puoi aggiungere elementi dell'elenco delle cose da fare utilizzando i commenti del codice e digitando la parola chiave TODO. Per accedere all'elenco delle cose da fare, puoi:

- Un ottimo modo per vedere cosa faremo è consultare l'elenco delle cose da fare. Per farlo, seleziona dalla barra dei menu in alto

View>Tool Windows>TODO.

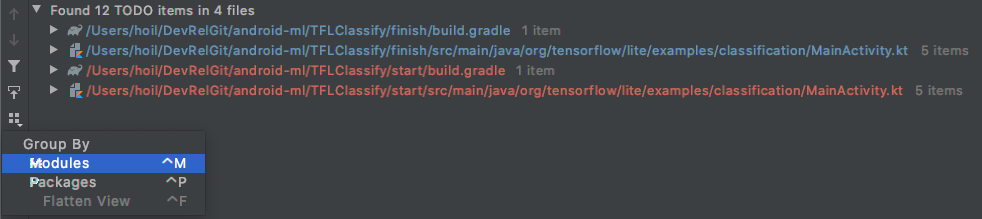

- Per impostazione predefinita, elenca tutti i TODO in tutti i moduli, il che lo rende un po' confuso. Possiamo ordinare solo i TO DO iniziali facendo clic sul pulsante Raggruppa per sul lato del riquadro TO DO e scegliendo

Modules

- Espandi tutti gli elementi nei moduli iniziali:

7. Esegui il modello personalizzato con TensorFlow Lite

- Fai clic su TODO 1 nell'elenco TODO o apri il file MainActivity.kt e individua TODO 1, inizializza il modello aggiungendo questa riga:

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

...

// TODO 1: Add class variable TensorFlow Lite Model

private val flowerModel = FlowerModel.newInstance(ctx)

...

}

- All'interno del metodo di analisi per CameraX Analyzer, dobbiamo convertire l'input della videocamera

ImageProxyin unBitmape creare un oggettoTensorImageper il processo di inferenza.

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 2: Convert Image to Bitmap then to TensorImage

val tfImage = TensorImage.fromBitmap(toBitmap(imageProxy))

...

}

- Elabora l'immagine ed esegui le seguenti operazioni sul risultato:

- Ordina i risultati in ordine decrescente in base alla probabilità nell'attributo

score, partendo dalla probabilità più alta. - Prendi i primi k risultati definiti dalla costante

MAX_RESULT_DISPLAY. Se vuoi, puoi variare il valore di questa variabile per ottenere più o meno risultati.

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 3: Process the image using the trained model, sort and pick out the top results

val outputs = flowerModel.process(tfImage)

.probabilityAsCategoryList.apply {

sortByDescending { it.score } // Sort with highest confidence first

}.take(MAX_RESULT_DISPLAY) // take the top results

...

}

- Converti i risultati ordinati e filtrati in oggetti dati

Recognitionpronti per essere utilizzati daRecyclerViewtramite il data binding:

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 4: Converting the top probability items into a list of recognitions

for (output in outputs) {

items.add(Recognition(output.label, output.score))

}

...

}

- Commenta o elimina le seguenti righe che aiutano a generare i risultati falsi che abbiamo visto in precedenza:

// START - Placeholder code at the start of the codelab. Comment this block of code out.

for (i in 0..MAX_RESULT_DISPLAY-1){

items.add(Recognition("Fake label $i", Random.nextFloat()))

}

// END - Placeholder code at the start of the codelab. Comment this block of code out.

- Esegui l'app su un dispositivo reale selezionando

TFL_Classify.starte premi il pulsante di esecuzione sulla barra degli strumenti:

sulla barra degli strumenti:

- Sul tuo smartphone vedrai la seguente schermata con numeri casuali al posto dei risultati reali:

8. (Facoltativo) Accelera l'inferenza con il delegato GPU

TensorFlow Lite supporta diversi acceleratori hardware per velocizzare l'inferenza sul tuo dispositivo mobile. La GPU è uno degli acceleratori che TensorFlow Lite può sfruttare tramite un meccanismo di delega ed è abbastanza facile da usare.

- Apri build.gradle nel modulo

startoppure fai clic su TODO 5 nell'elenco TODO e aggiungi la seguente dipendenza:

// TODO 5: Optional GPU Delegates

implementation 'org.tensorflow:tensorflow-lite-gpu:2.3.0'

- Torna al file MainActivity.kt o fai clic su TODO 6 nell'elenco TODO. Sostituisci l'inizializzazione semplice di flowerModel con quanto segue: recupera un'istanza dell'elenco di compatibilità delle GPU e inizializza la GPU a seconda che sia una delle GPU compatibili elencate. In caso contrario, avvia 4 thread della CPU per eseguire il modello:

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

...

// TODO 1: Add class variable TensorFlow Lite Model

// Initializing the flowerModel by lazy so that it runs in the same thread when the process

// method is called.

private val flowerModel: FlowerModel by lazy{

// TODO 6. Optional GPU acceleration

val compatList = CompatibilityList()

val options = if(compatList.isDelegateSupportedOnThisDevice){

Log.d(TAG, "This device is GPU Compatible ")

Model.Options.Builder().setDevice(Model.Device.GPU).build()

} else {

Log.d(TAG, "This device is GPU Incompatible ")

Model.Options.Builder().setNumThreads(4).build()

}

...

}

- Modifica l'inizializzatore del modello per utilizzarlo aggiungendo

optionsall'input del metodo:

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

private val flowerModel: FlowerModel by lazy{

...

// Initialize the Flower Model

FlowerModel.newInstance(ctx, options)

}

}

- Esegui l'app su un dispositivo reale selezionando

TFL_Classify.starte premi il pulsante di esecuzione sulla barra degli strumenti:

sulla barra degli strumenti:

9. Passaggi successivi

Ecco alcuni link per saperne di più:

- Prova altri modelli TFLite compatibili con il binding del modello ML da tfhub.dev.

- Scopri di più su TFLite nella documentazione su tensorflow.org e nel repository di codice.

- Prova altri modelli preaddestrati TFLite, tra cui un rilevatore di hotword vocali e una versione di Risposta rapida sul dispositivo.

- Scopri di più su TensorFlow in generale con la nostra documentazione sulla guida introduttiva.