1. はじめに

注: この Codelab では、テストに実機が必要です。

TensorFlow は多目的の機械学習フレームワークです。TensorFlow は、クラウド内のクラスタをまたがる巨大モデルのトレーニングから、スマートフォンなどの組み込みシステムにおけるモデルのローカルな実行まで、あらゆることに使用できます。

この Codelab では、 TensorFlow Lite を使用して Android デバイスで画像認識モデルを実行します。

Android Studio 4.1 以降をインストールする

まだインストールしていない場合は、TensorFlow Lite モデルのトレーニング中に Android Studio 4.1 以降をダウンロードしてインストールしてください。

学習内容

- TensorFlow Lite Model Maker を使用して独自のカスタム画像分類子をトレーニングする方法。

- Android Studio を使用して TensorFlow Lite モデルをインポートし、CameraX を使用してカスタムモデルを Android アプリに統合する方法。

- スマートフォンの GPU を使用してモデルを高速化する方法。

作業内容

TensorFlow 画像認識プログラムを実行して花を識別するシンプルなカメラアプリを作成します。

ライセンス: 自由に使用できます

2. Colab を使用して花認識ツールをトレーニングする

モデルのトレーニングを開始する前に、Android Studio 4.1 以降をダウンロードしてインストールします。

Colab を開きます。この Colab では、TensorFlow Lite 転移学習を使用して花を認識する分類子を Keras でトレーニングする方法について説明します。

3. 作業ディレクトリを設定する

Git リポジトリのクローンを作成する

次のコマンドを実行すると、この Codelab に必要なファイルを含む Git リポジトリのクローンが作成されます。

git clone https://github.com/hoitab/TFLClassify.git

次に、リポジトリのクローンを作成したディレクトリに移動します。この Codelab の残りの作業はここで行います。

cd TFLClassify

4. Android スケルトン アプリを設定する

Android Studio 4.1 以降をインストールする

まだインストールしていない場合は、Android Studio 4.1 以降をインストールしてください。

Android Studio でプロジェクトを開く

Android Studio でプロジェクトを開くには、次の操作を行います。

- Android Studio

を開きます。読み込まれたら、このポップアップから [Open an Existing project] を選択します。

を開きます。読み込まれたら、このポップアップから [Open an Existing project] を選択します。

- ファイル選択ツールで、作業ディレクトリから

TFLClassify/build.gradleを選択します。

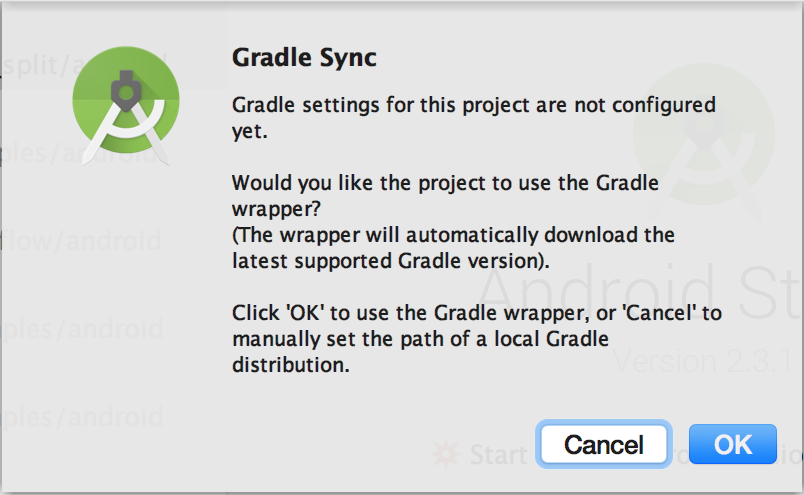

- 初めてプロジェクトを開く場合、Gradle ラッパーの使用について尋ねる [Gradle Sync] ポップアップが表示されます。[OK] をクリックします。

- まだ有効にしていない場合は、スマートフォンでデベロッパー モデルと USB デバッグを有効にします。これは 1 回限りの設定です。こちらの手順に沿って操作してください。

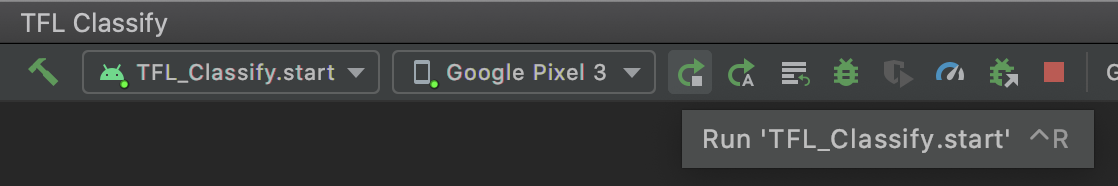

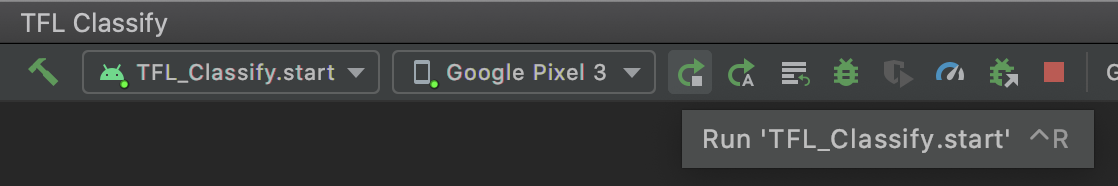

- プロジェクトとスマートフォンの両方の準備ができたら、ツールバーで

TFL_Classify.startを選択して実行ボタン を押すと、実機で実行できます。

を押すと、実機で実行できます。

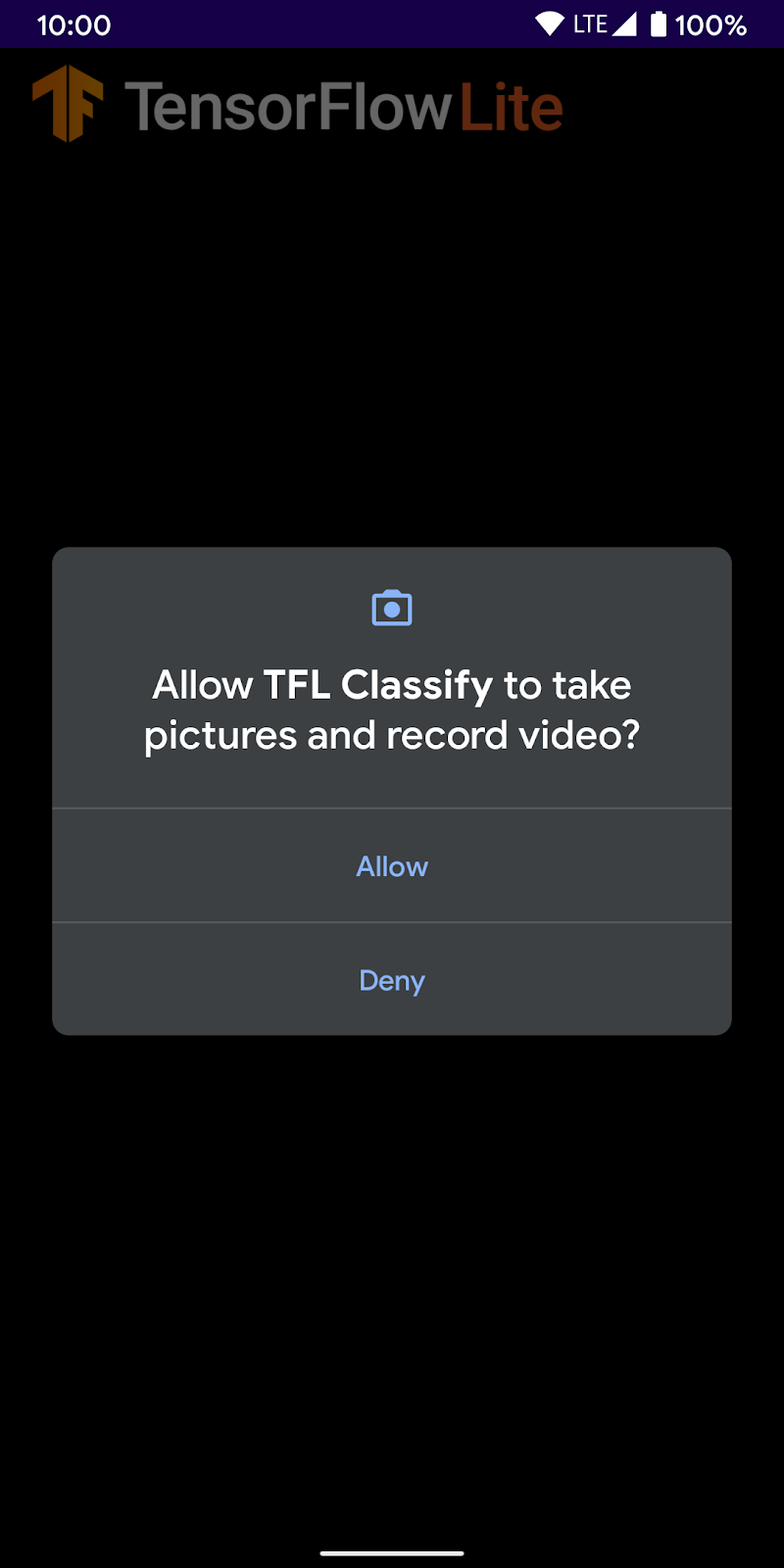

- TensorFlow デモにカメラへのアクセスを許可します。

- スマートフォンに次の画面が表示されます。実際の結果が表示される場所に乱数が表示されます。

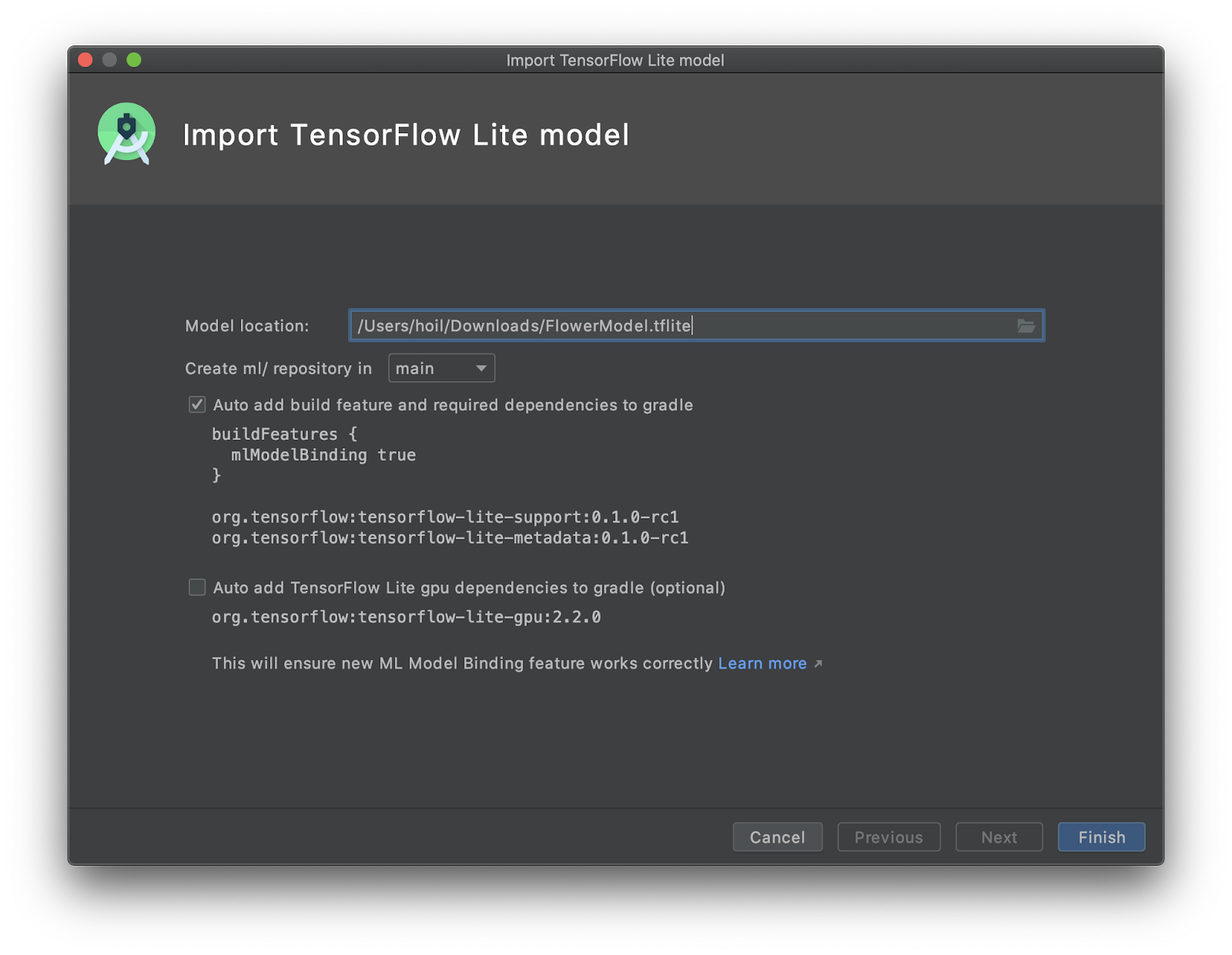

5. TensorFlow Lite を Android アプリに追加する

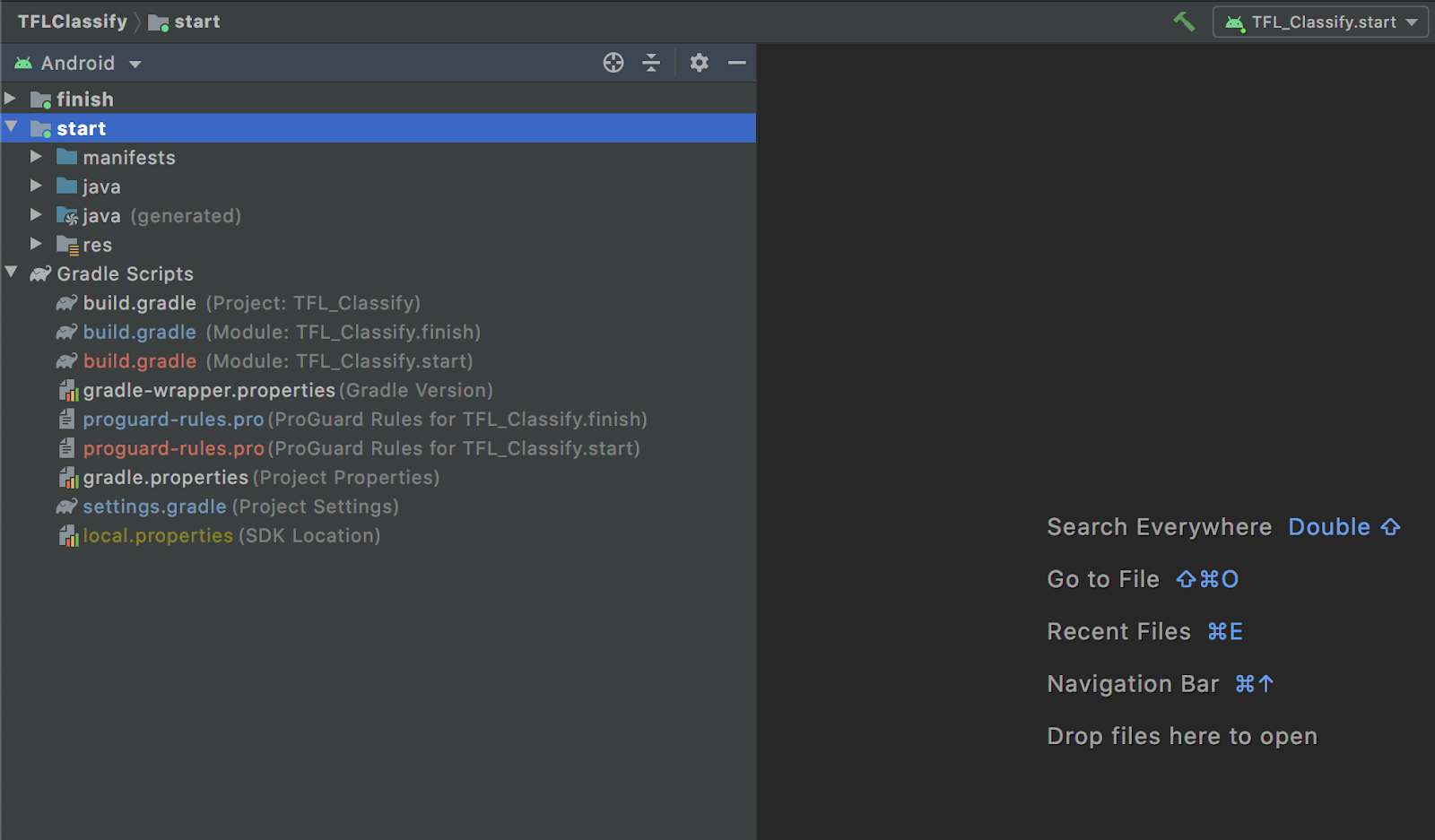

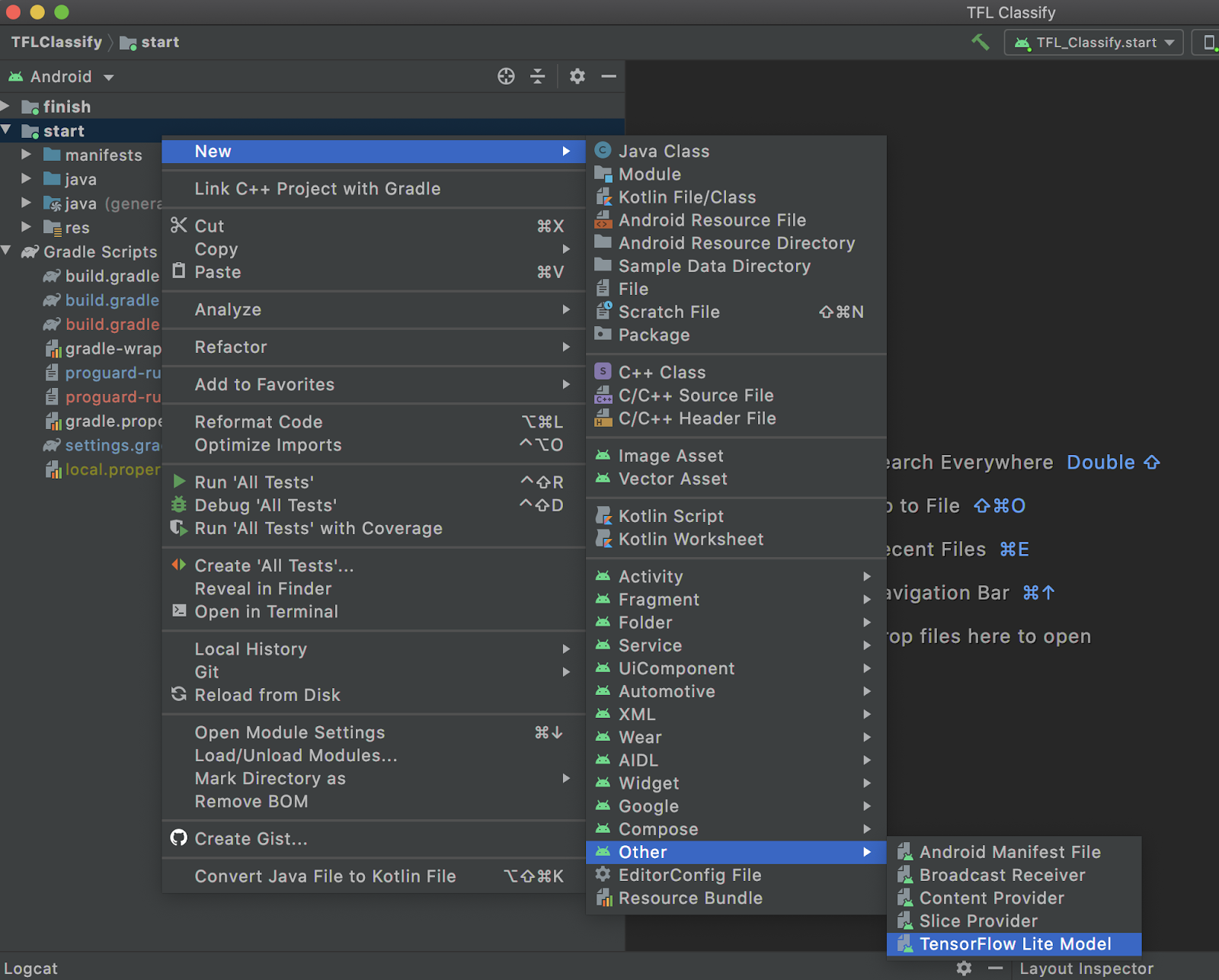

- 左側のプロジェクト エクスプローラで

startモジュールを選択します。

startモジュールを右クリックするか、File、New、Other、TensorFlow Lite Modelをクリックします。

- カスタム トレーニング済みの

FlowerModel.tfliteをダウンロードしたモデルの場所を選択します。

- [

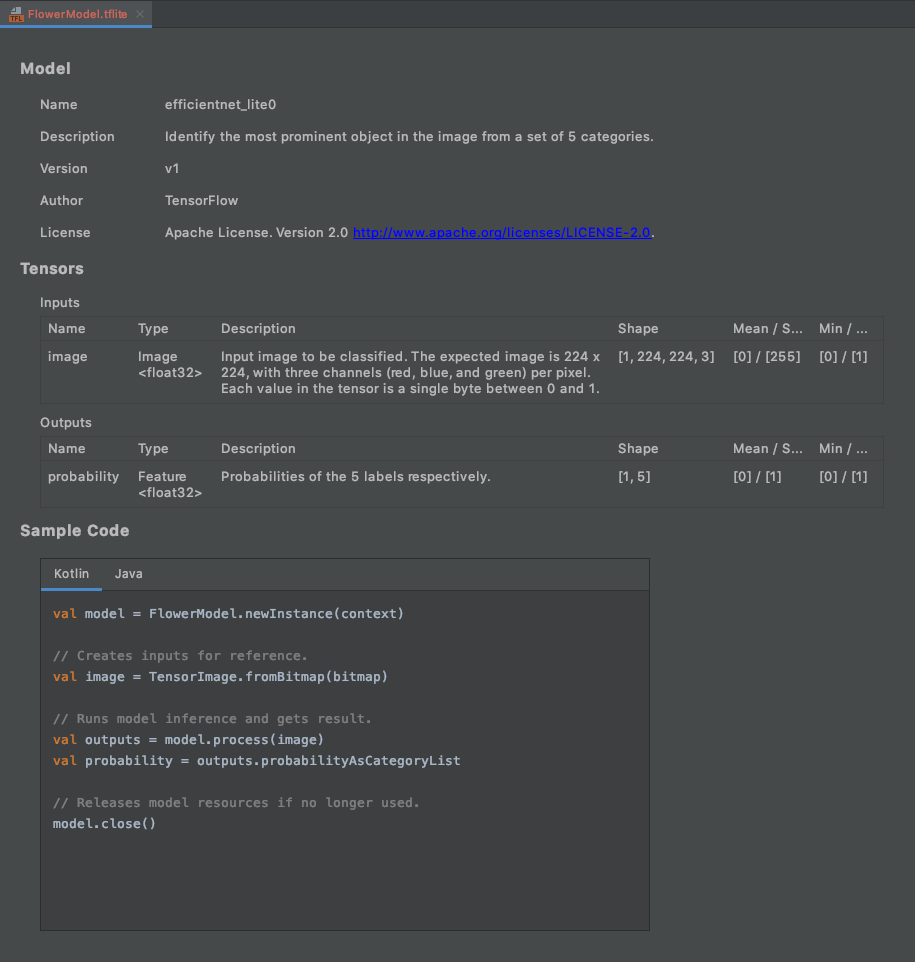

Finish] をクリックします。 - 最後に次のものが表示されます。FlowerModel.tflite が正常にインポートされ、モデルに関する概要情報(入出力など)と、作業を開始するためのサンプルコードが表示されます。

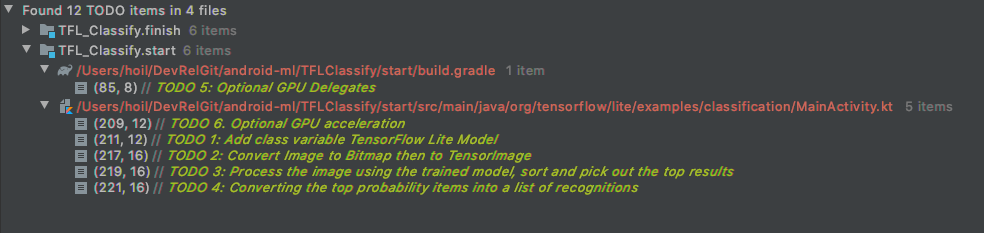

6. 省略可: TODO リストを確認する

TODO リストを使用すると、Codelab を更新する必要がある場所に簡単に移動できます。Android プロジェクトで使用して、今後の作業をリマインドすることもできます。TODO アイテムを追加するには、コードのコメントを使用してキーワード TODO を入力します。TODO のリストにアクセスするには、次の操作を行います。

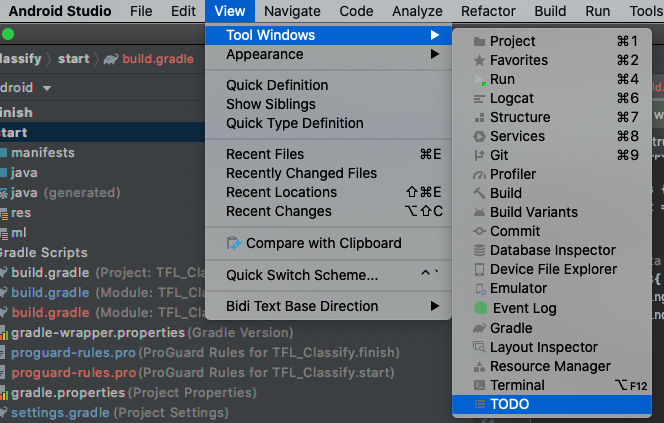

- TODO リストを確認すると、これから行う作業を確認できます。これを行うには、上部のメニューバーから

View>Tool Windows>TODOを選択します。

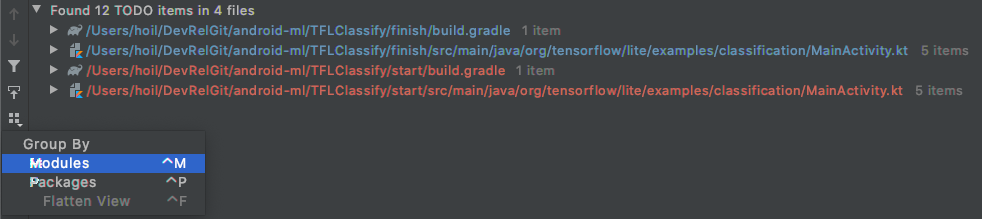

- デフォルトでは、すべてのモジュールのすべての TODO が一覧表示されるため、少しわかりにくい場合があります。TODO パネルの横にある [グループ化] ボタンをクリックして

Modulesを選択すると、開始 TODO のみを並べ替えることができます。

- 開始モジュールのすべての項目を展開します。

7. TensorFlow Lite でカスタムモデルを実行する

- TODO リストで [TODO 1] をクリックするか、MainActivity.kt ファイルを開いて TODO 1 を見つけ、次の行を追加してモデルを初期化します。

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

...

// TODO 1: Add class variable TensorFlow Lite Model

private val flowerModel = FlowerModel.newInstance(ctx)

...

}

- CameraX Analyzer の分析メソッドでは、カメラ入力

ImageProxyをBitmapに変換し、推論プロセス用のTensorImageオブジェクトを作成する必要があります。

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 2: Convert Image to Bitmap then to TensorImage

val tfImage = TensorImage.fromBitmap(toBitmap(imageProxy))

...

}

- 画像を処理し、結果に対して次の操作を行います。

- 属性

scoreの確率で結果を降順に並べ替えます。確率が最も高いものが最初になります。 - 定数

MAX_RESULT_DISPLAYで定義されている上位 k 個の結果を取得します。必要に応じて、この変数の値を変更して結果の数を増減できます。

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 3: Process the image using the trained model, sort and pick out the top results

val outputs = flowerModel.process(tfImage)

.probabilityAsCategoryList.apply {

sortByDescending { it.score } // Sort with highest confidence first

}.take(MAX_RESULT_DISPLAY) // take the top results

...

}

- 並べ替えとフィルタリングを行った結果を、

Recognitionデータ バインディングを介してRecyclerViewData Binding で使用できるデータ オブジェクトに変換します。

override fun analyze(imageProxy: ImageProxy) {

...

// TODO 4: Converting the top probability items into a list of recognitions

for (output in outputs) {

items.add(Recognition(output.label, output.score))

}

...

}

- 以前に表示された偽の結果を生成する次の行をコメントアウトまたは削除します。

// START - Placeholder code at the start of the codelab. Comment this block of code out.

for (i in 0..MAX_RESULT_DISPLAY-1){

items.add(Recognition("Fake label $i", Random.nextFloat()))

}

// END - Placeholder code at the start of the codelab. Comment this block of code out.

- ツールバーで

TFL_Classify.startを選択して実行ボタン を押すと、実機でアプリを実行できます。

を押すと、実機でアプリを実行できます。

- スマートフォンに次の画面が表示されます。実際の結果が表示される場所に乱数が表示されます。

8. 省略可: GPU デリゲートを使用して推論を高速化する

TensorFlow Lite は、モバイル デバイスでの推論を高速化するために、いくつかのハードウェア アクセラレータをサポートしています。 GPU は、TensorFlow Lite がデリゲート メカニズムを介して活用できるアクセラレータの 1 つであり、非常に簡単に使用できます。

startモジュールの下にある build.gradle を開くか、TODO リストの [TODO 5] をクリックして、次の依存関係を追加します。

// TODO 5: Optional GPU Delegates

implementation 'org.tensorflow:tensorflow-lite-gpu:2.3.0'

- MainActivity.kt ファイルに戻るか、TODO リストの [TODO 6] をクリックします。flowerModel の簡単な初期化を次のように置き換えます。GPU 互換性リストのインスタンスを取得し、リストされている互換性のある GPU のいずれであるかに応じて GPU を初期化します。それ以外の場合は、代わりに 4 つの CPU スレッドを開始してモデルを実行します。

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

...

// TODO 1: Add class variable TensorFlow Lite Model

// Initializing the flowerModel by lazy so that it runs in the same thread when the process

// method is called.

private val flowerModel: FlowerModel by lazy{

// TODO 6. Optional GPU acceleration

val compatList = CompatibilityList()

val options = if(compatList.isDelegateSupportedOnThisDevice){

Log.d(TAG, "This device is GPU Compatible ")

Model.Options.Builder().setDevice(Model.Device.GPU).build()

} else {

Log.d(TAG, "This device is GPU Incompatible ")

Model.Options.Builder().setNumThreads(4).build()

}

...

}

- メソッド入力に

optionsを追加して、これを使用するようにモデル初期化子を変更します。

private class ImageAnalyzer(ctx: Context, private val listener: RecognitionListener) :

ImageAnalysis.Analyzer {

private val flowerModel: FlowerModel by lazy{

...

// Initialize the Flower Model

FlowerModel.newInstance(ctx, options)

}

}

- ツールバーで

TFL_Classify.startを選択して実行ボタン を押すと、実機でアプリを実行できます。

を押すと、実機でアプリを実行できます。

9. 次のステップ

詳細については、次のリンクをご覧ください。

- tfhub.dev の ML Model Binding と互換性のある他の TFLite モデルを試す。

- tensorflow.org のドキュメントと コード リポジトリで TFLite の詳細を確認する。

- 音声起動ワード検出ツールやスマート リプライのデバイス上バージョンなど、他の TFLite 事前トレーニング済みモデルを試す。

- スタートガイド ドキュメントで TensorFlow の概要を学習する。