1. शुरुआती जानकारी 👋

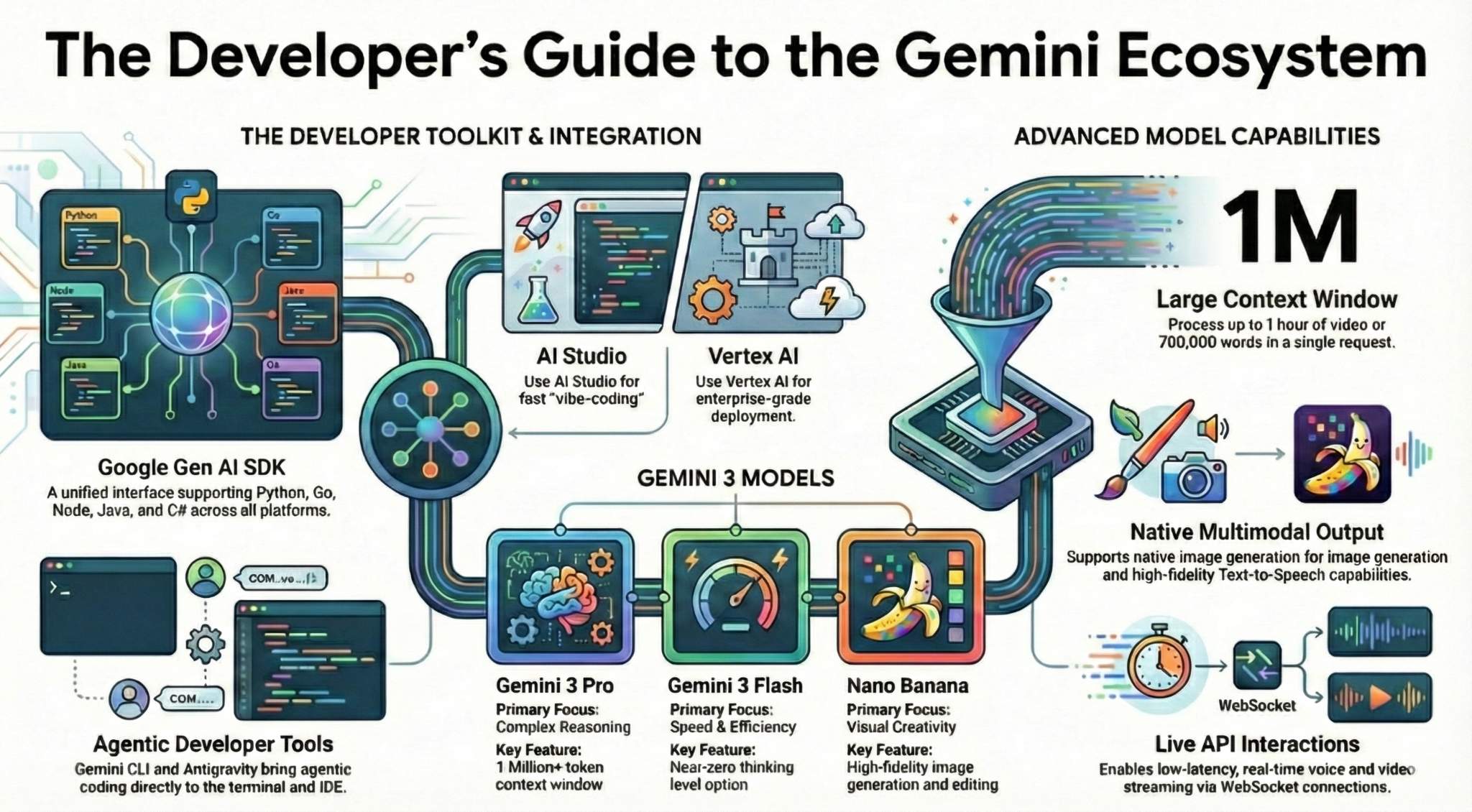

इस कोडलैब में, आपको डेवलपर के तौर पर Gemini के नेटवर्क के बारे में सभी ज़रूरी जानकारी मिलेगी. खास तौर पर, आपको Gemini के अलग-अलग मॉडल, Gemini की मदद से काम करने वाले अलग-अलग टूल, और Gemini के साथ इंटिग्रेट करने के लिए Google Gen AI SDK के बारे में जानने को मिलेगा. आपको Gemini की अलग-अलग सुविधाओं के बारे में भी जानने को मिलेगा. जैसे, लंबे कॉन्टेक्स्ट, सूझ-बूझ मोड, स्पेशल समझ, Live API, इमेज और ऑडियो आउटपुट वगैरह.

इस कोडलैब के आखिर में, आपको Gemini के इकोसिस्टम के बारे में पूरी जानकारी मिल जाएगी.

💡आपको क्या सीखने को मिलेगा

- Gemini के अलग-अलग मॉडल.

- Gemini के मॉडल की मदद से काम करने वाले टूल.

- Google Gen AI SDK का इस्तेमाल करके, Gemini के साथ इंटिग्रेट करने का तरीका.

- Gemini की लंबी कॉन्टेक्स्ट विंडो.

- Gemini का थिंकिंग मोड.

- Google Search, Google Maps जैसे अलग-अलग बिल्ट-इन टूल.

- Interactions API की मदद से, रिसर्च एजेंट के साथ इंटरैक्ट करने का तरीका.

- इमेज और टेक्स्ट को बोली में बदलने की सुविधा.

- Gemini की जगह के हिसाब से जानकारी समझने की क्षमता.

- रीयल-टाइम में वॉइस और वीडियो इंटरैक्शन के लिए Live API.

⚠️ आपको इन चीज़ों की ज़रूरत होगी

- Google AI Studio के सैंपल के लिए एपीआई पासकोड.

- ऐसा Google Cloud प्रोजेक्ट जिसमें Vertex AI के सैंपल के लिए बिलिंग की सुविधा चालू हो.

- Google Cloud में आपका लोकल डेवलपमेंट एनवायरमेंट या Cloud Shell Editor.

2. Gemini फ़ैमिली 🫂

Gemini, Google का एआई मॉडल है. यह किसी भी आइडिया को हकीकत में बदल सकता है. यह मल्टीमॉडल कॉन्टेंट को समझने, एजेंटिक, और वाइब कोडिंग के लिए एक बेहतरीन मॉडल है. इन सभी को, बेहतरीन तर्क के आधार पर बनाया गया है. Gemini मॉडल के बारे में खास जानकारी पाने के लिए, यह वीडियो देखें:

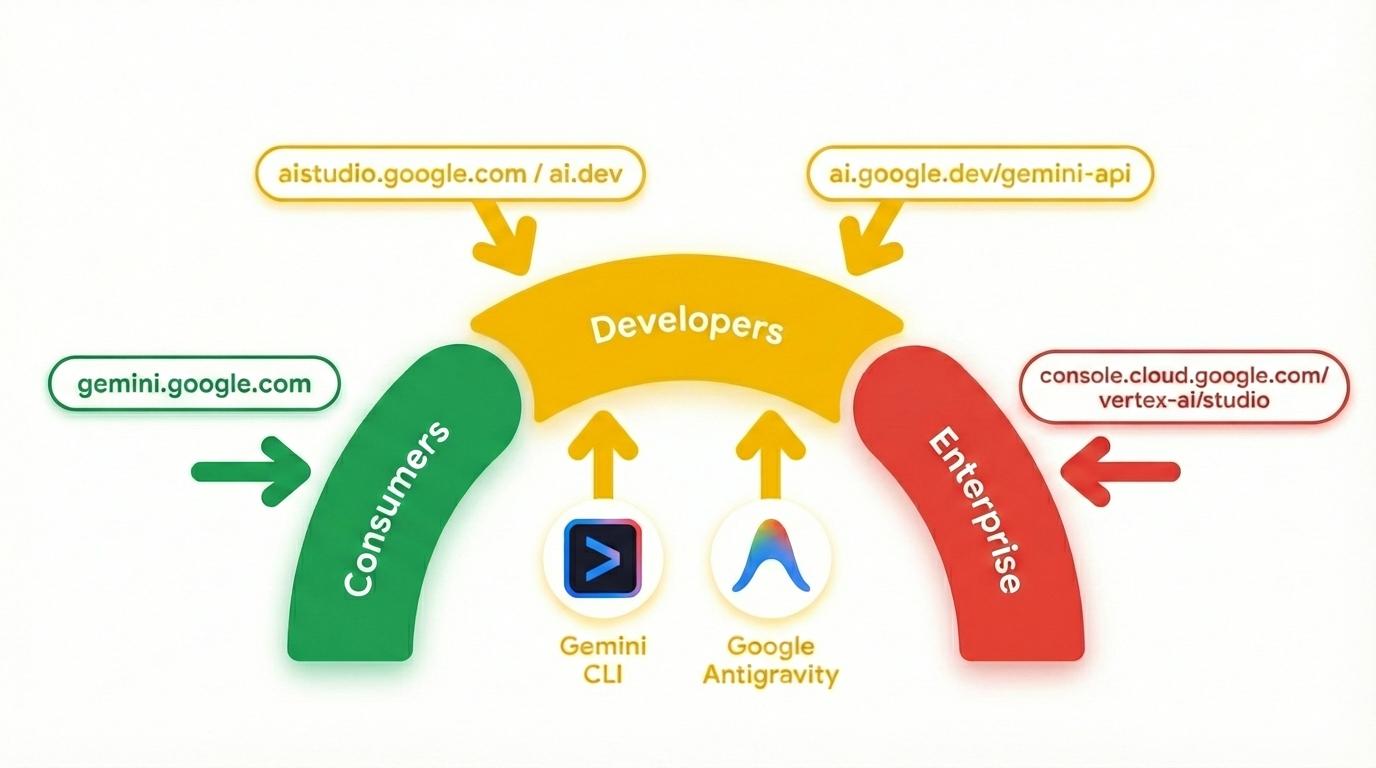

Gemini सिर्फ़ एक मॉडल नहीं है. यह Google के प्रॉडक्ट में इस्तेमाल किया जाने वाला एक अंब्रेला ब्रैंड भी है

जो Gemini मॉडल का इस्तेमाल करते हैं. Google Cloud के Gemini प्रॉडक्ट की एक पूरी रेंज है. इसमें उपभोक्ताओं के लिए Gemini ऐप्लिकेशन और NotebookLM, डेवलपर के लिए AI Studio, और एंटरप्राइज़ के लिए Vertex AI शामिल हैं. Gemini की मदद से काम करने वाले डेवलपर टूल भी उपलब्ध हैं. जैसे, Gemini CLI और Google Antigravity.

3. Gemini की मदद से काम करने वाले टूल 🧰

आइए, Gemini की मदद से काम करने वाले टूल के बारे में कुछ जानकारी लेते हैं.

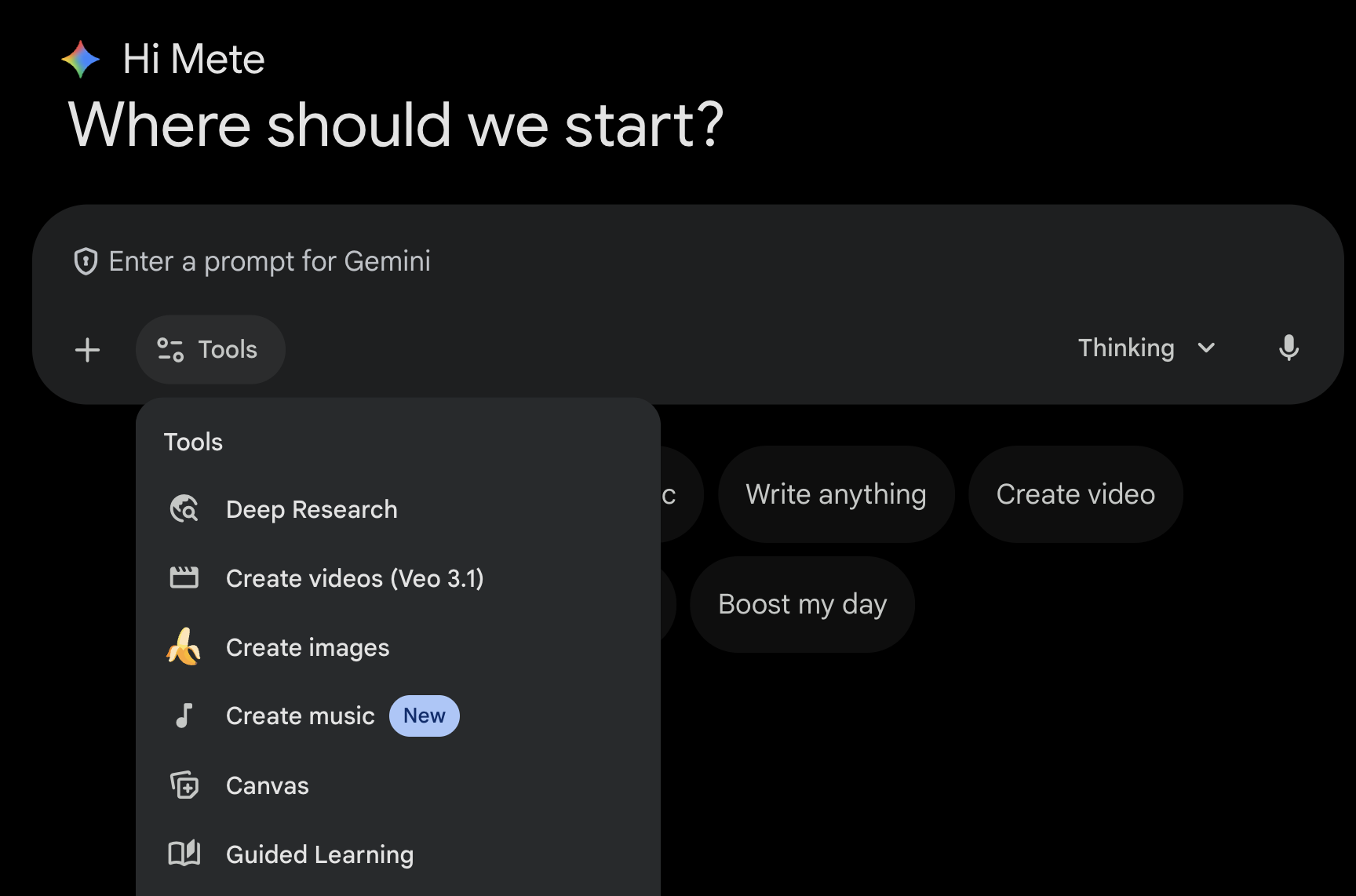

Gemini ऐप्लिकेशन 💬

Gemini ऐप्लिकेशन ( gemini.google.com) एक चैट-आधारित उपभोक्ता ऐप्लिकेशन है. यह Gemini से इंटरैक्ट करने का सबसे आसान तरीका है. इसमें Deep Research, इमेज, वीडियो, संगीत जनरेट करने जैसे टूल मौजूद हैं. इसमें Gemini के नए मॉडल के अलग-अलग वर्शन भी हैं. जैसे, Fast, Thinking, और Pro. Gemini ऐप्लिकेशन, रोज़ाना के इस्तेमाल के लिए सबसे सही है.

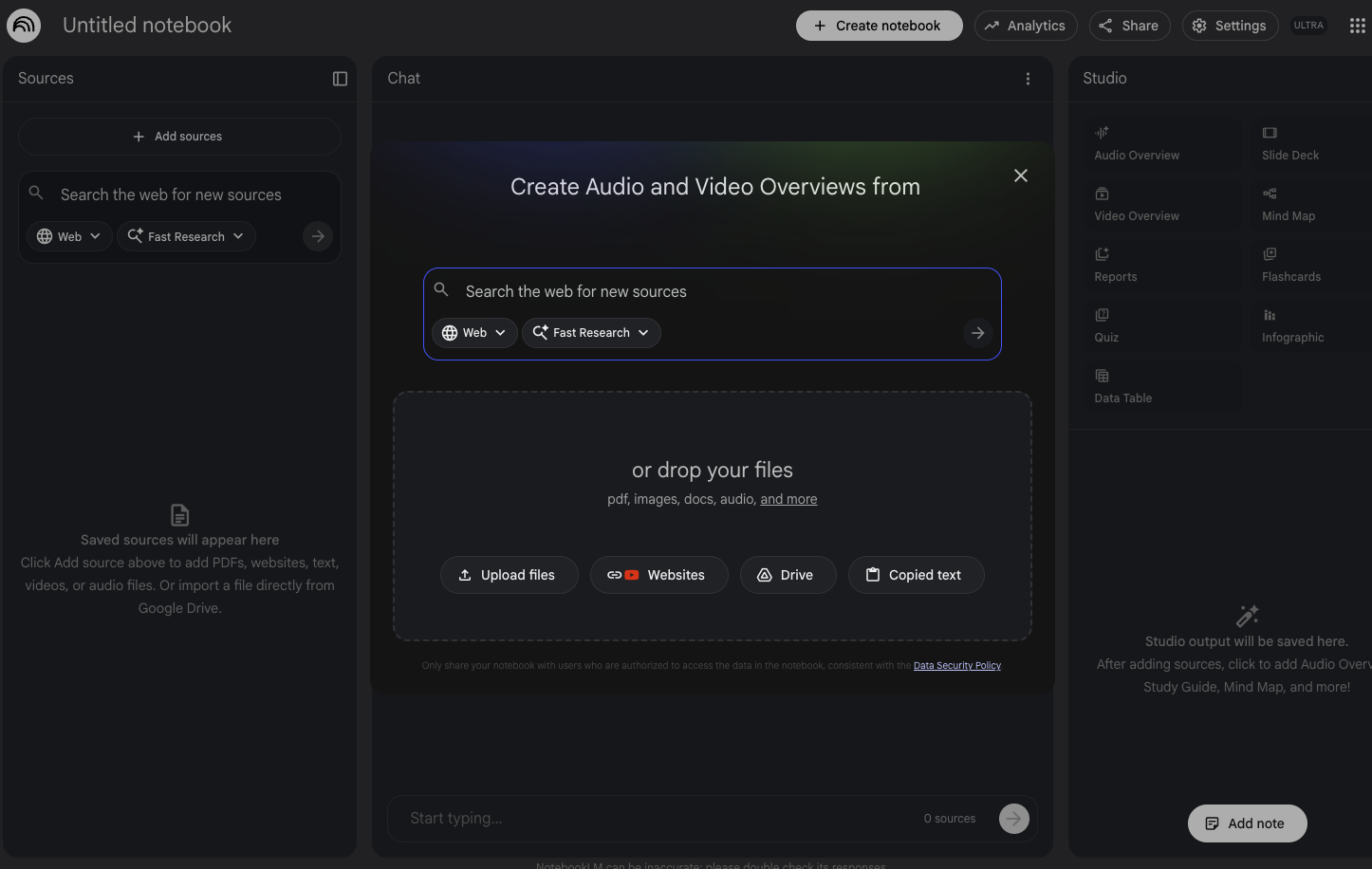

NotebookLM 📓

NotebookLM ( notebooklm.google.com) एक ऐसा टूल है जो एआई की मदद से काम करता है. यह रिसर्च करने में आपकी मदद करता है. PDF, वेबसाइट, YouTube वीडियो, ऑडियो फ़ाइलें, Google Docs, Google Slides वगैरह अपलोड करें. NotebookLM, इन सभी फ़ाइलों की खास जानकारी देगा और विषयों के बीच दिलचस्प कनेक्शन बनाएगा. ये सब, Gemini के टेक्स्ट, इमेज वगैरह को प्रोसेस करने वाले मॉडल के नए वर्शन की समझने की क्षमता की मदद से किया जाता है. यह आपके अपलोड किए गए सोर्स से, दिलचस्प और आकर्षक ऑडियो ओवरव्यू, वीडियो ओवरव्यू, इन्फ़ोग्राफ़िक वगैरह भी जनरेट करता है.

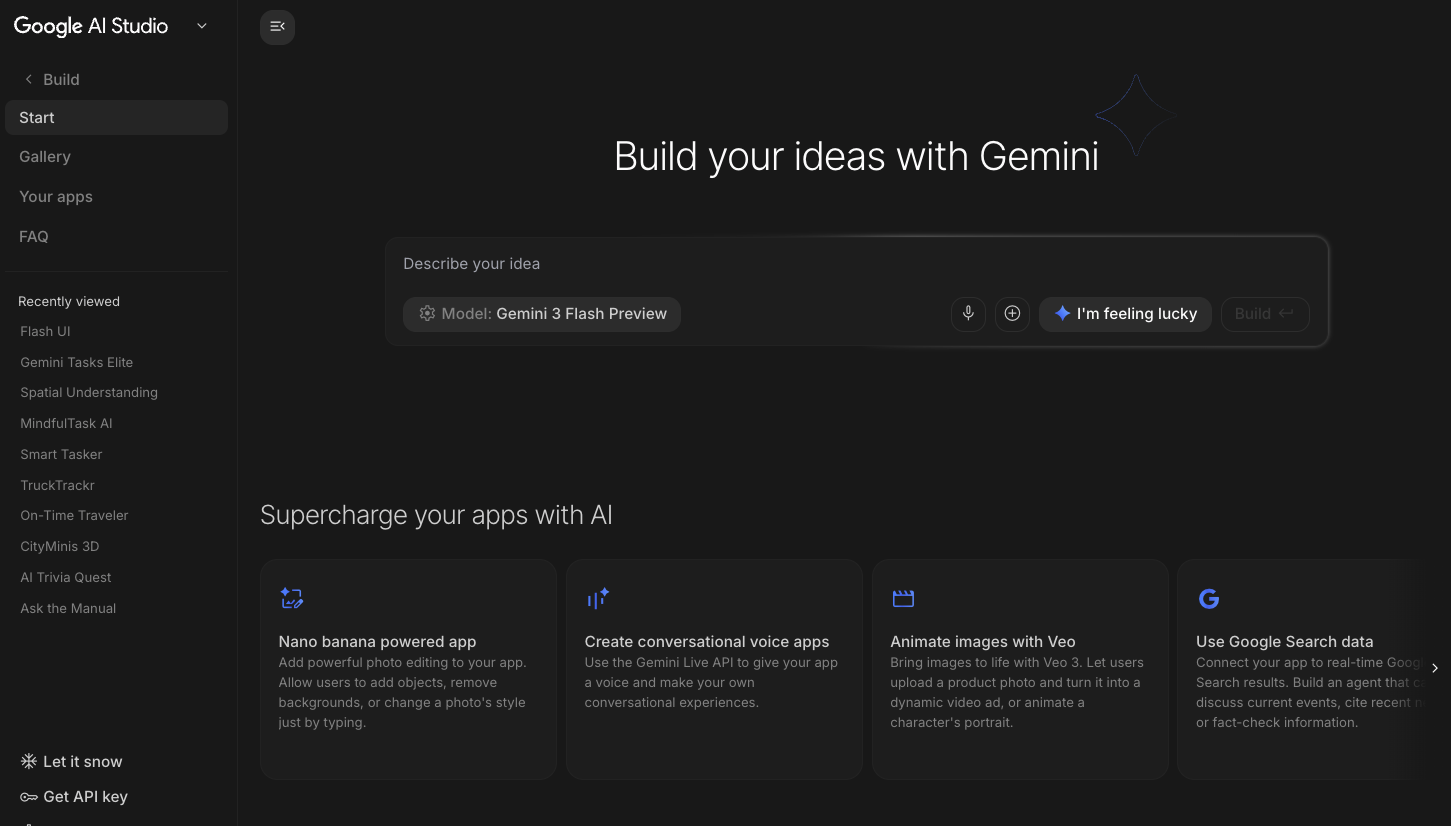

Google AI Studio 🎨

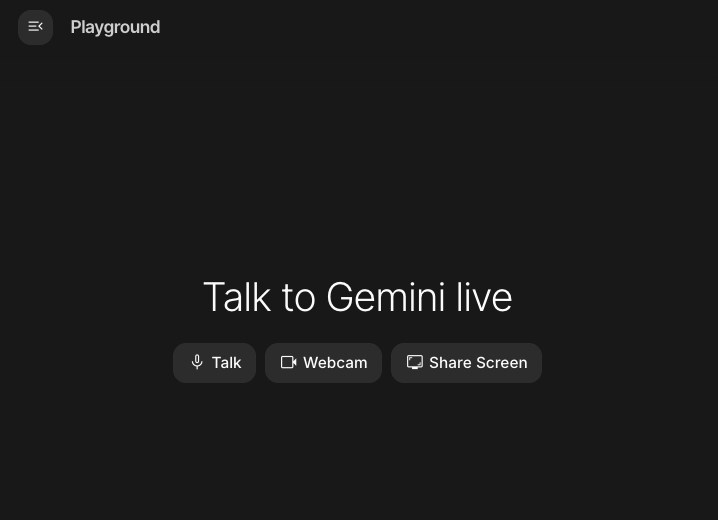

Google AI Studio ( ai.dev) की मदद से, Gemini का इस्तेमाल करके, तेज़ी से ऐप्लिकेशन बनाए जा सकते हैं. Google AI Studio में मौजूद Playground पैनल की मदद से, अलग-अलग मॉडल आज़माए जा सकते हैं. इनकी मदद से, टेक्स्ट, इमेज, और वीडियो जनरेट किए जा सकते हैं. साथ ही, Gemini Live API के साथ रीयल-टाइम में आवाज़ और वीडियो की सुविधा भी आज़माई जा सकती है. Google AI Studio में मौजूद बनाएं पैनल की मदद से, वेब ऐप्लिकेशन के लिए वाइब-कोड किया जा सकता है. साथ ही, उन्हें Google Cloud पर Cloud Run में डिप्लॉय किया जा सकता है और कोड को GitHub पर पुश किया जा सकता है.

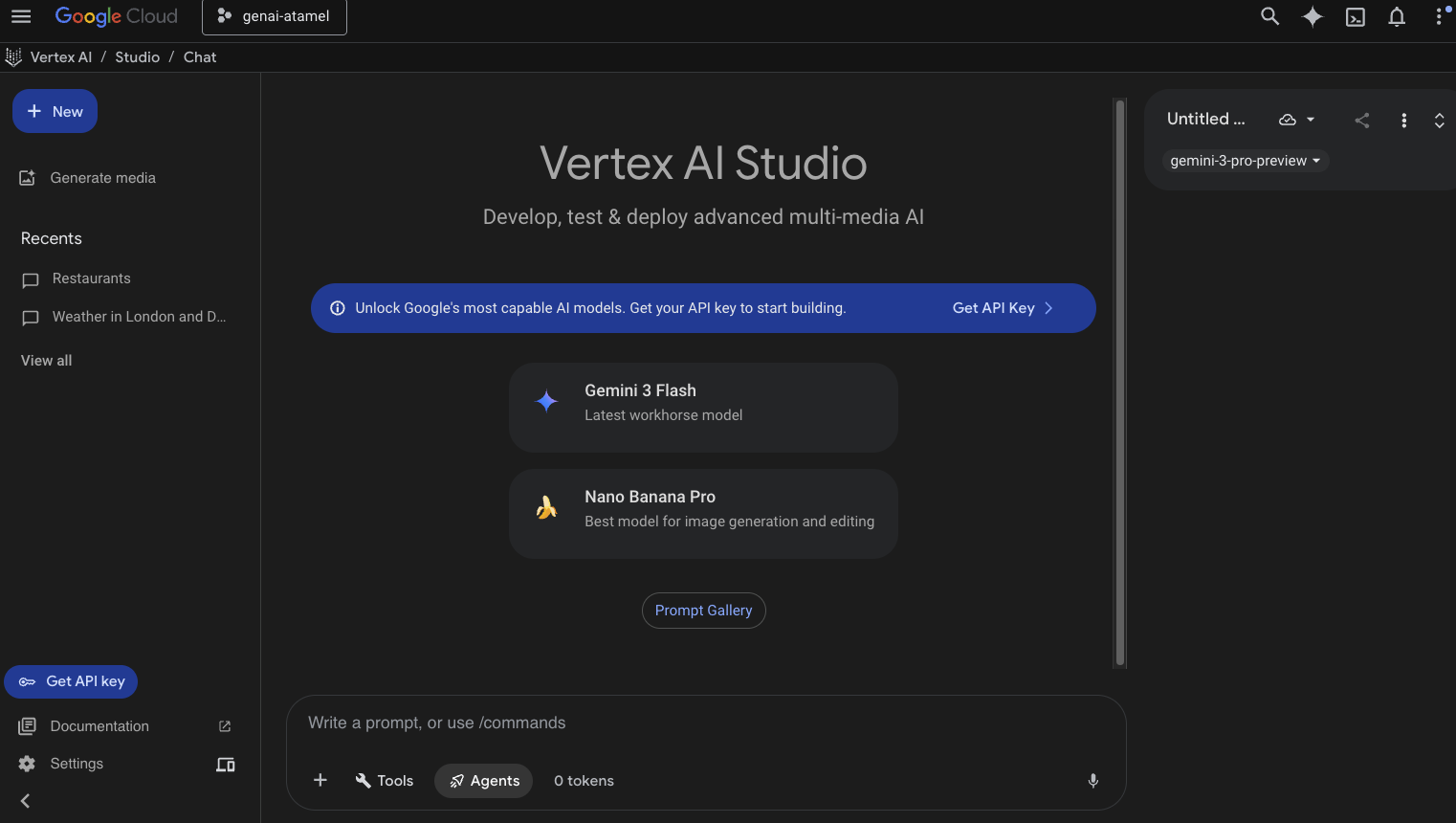

Vertex AI Studio ☁️

Vertex AI, पूरी तरह से मैनेज किया गया यूनिफ़ाइड एआई डेवलपमेंट प्लैटफ़ॉर्म है. इसका इस्तेमाल, Google Cloud में जनरेटिव एआई को बनाने और इस्तेमाल करने के लिए किया जाता है. Vertex AI Studio ( console.cloud.google.com/vertex-ai/studio) की मदद से, एंटरप्राइज़-रेडी जनरेटिव एआई ऐप्लिकेशन को टेस्ट, ट्यून, और डिप्लॉय किया जा सकता है.

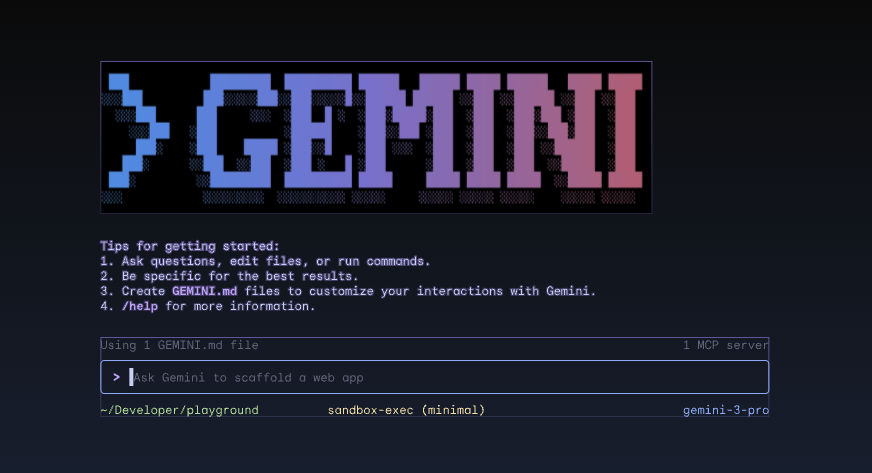

Gemini CLI ⚙️

Gemini CLI ( geminicli.com) एक ओपन-सोर्स एआई एजेंट है. इसकी मदद से, Gemini की सुविधा सीधे अपने टर्मिनल में पाई जा सकती है. इसे डेवलपर, इंजीनियर, एसआरई, और अन्य लोगों के लिए, टर्मिनल-फ़र्स्ट, एक्सटेंसिबल, और पावरफ़ुल टूल के तौर पर डिज़ाइन किया गया है. Gemini CLI, आपके लोकल एनवायरमेंट के साथ इंटिग्रेट होता है. यह फ़ाइलों को पढ़ सकता है और उनमें बदलाव कर सकता है. साथ ही, शेल कमांड को एक्ज़ीक्यूट कर सकता है और वेब पर खोज कर सकता है. यह सब आपके प्रोजेक्ट के कॉन्टेक्स्ट को ध्यान में रखते हुए किया जाता है.

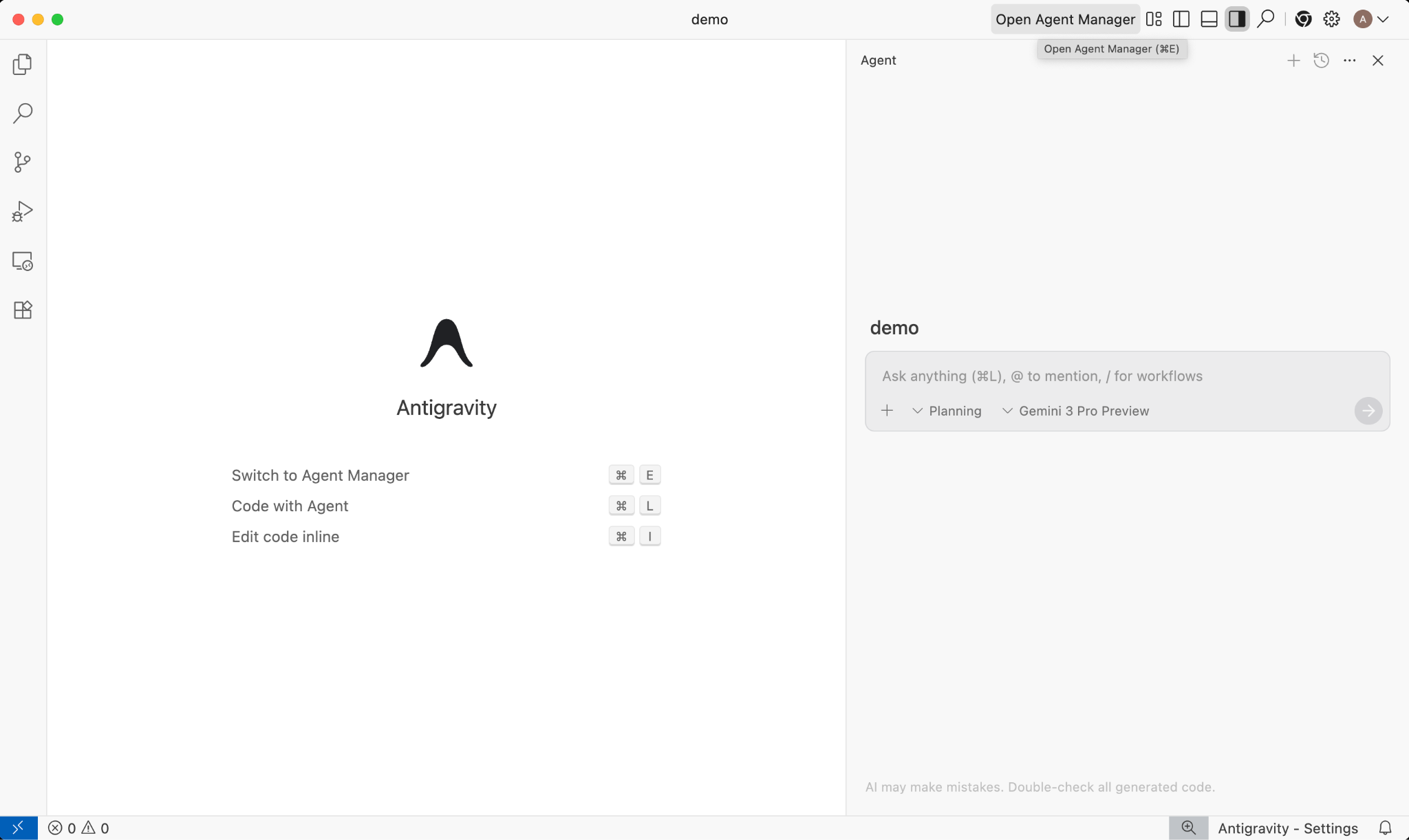

Google Antigravity 🚀

Google Antigravity ( antigravity.google) एक एजेंटिक डेवलपमेंट प्लैटफ़ॉर्म है. यह आईडीई को एजेंट-फ़र्स्ट एरा में बदल देता है. Antigravity की मदद से डेवलपर, टास्क के हिसाब से बेहतर तरीके से काम कर सकते हैं. साथ ही, अलग-अलग वर्कस्पेस में एजेंट मैनेज कर सकते हैं. हालांकि, इसमें एआई आईडीई का जाना-पहचाना अनुभव बरकरार रहता है.

Antigravity, एजेंट को उनके अपने प्लैटफ़ॉर्म पर ले जाता है. साथ ही, उन्हें एडिटर, टर्मिनल, और ब्राउज़र पर अपने-आप काम करने के लिए ज़रूरी टूल उपलब्ध कराता है. यह एजेंट को टास्क और आर्टफ़ैक्ट के ज़रिए पुष्टि करने और बेहतर तरीके से बातचीत करने पर ज़ोर देता है. इस सुविधा की मदद से एजेंट, सॉफ़्टवेयर से जुड़े ज़्यादा मुश्किल और शुरू से आखिर तक के टास्क को प्लान और पूरा कर सकते हैं. इससे डेवलपमेंट के सभी पहलुओं को बेहतर बनाया जा सकता है. जैसे, सुविधाएं बनाना, यूज़र इंटरफ़ेस (यूआई) को दोहराना, और बग ठीक करना. साथ ही, रिसर्च करना और रिपोर्ट जनरेट करना.

इन टूल को बेझिझक डाउनलोड करें और इनका इस्तेमाल करें. यहां कुछ सामान्य दिशा-निर्देश दिए गए हैं कि किस टूल का इस्तेमाल कब करना चाहिए:

- अगर आपने अभी-अभी Gemini App का इस्तेमाल शुरू किया है, तो शायद आप इसका इस्तेमाल सवाल पूछने या कुछ बुनियादी कोड जनरेट करने के लिए करेंगे.

- अगर आपको किसी वेब ऐप्लिकेशन के लिए वाइब-कोडिंग करनी है, तो शायद Google AI Studio आपके लिए सबसे सही टूल होगा.

- अगर आपको अपने लोकल डेवलपमेंट एनवायरमेंट के कॉन्टेक्स्ट का इस्तेमाल करके कोई जटिल ऐप्लिकेशन बनाना है, तो Gemini CLI या Google Antigravity को चुनें.

- अगर आपको Google Cloud को डिप्लॉय करना है या पहले से ही इसका इस्तेमाल किया जा रहा है और आपको एंटरप्राइज़ लेवल की सहायता और सुविधाएं चाहिए, तो Vertex AI और इसके Studio को चुनें.

ज़रूरत के हिसाब से, इन टूल को एक साथ इस्तेमाल किया जा सकता है. उदाहरण के लिए, GitHub पर पुश करने के लिए, AI Studio में वाइब कोडिंग से शुरुआत करें. इसके बाद, कोडिंग जारी रखने के लिए Antigravity का इस्तेमाल करें. इसके बाद, Google Cloud पर डिप्लॉय करें.

4. Gemini के मॉडल 🧠

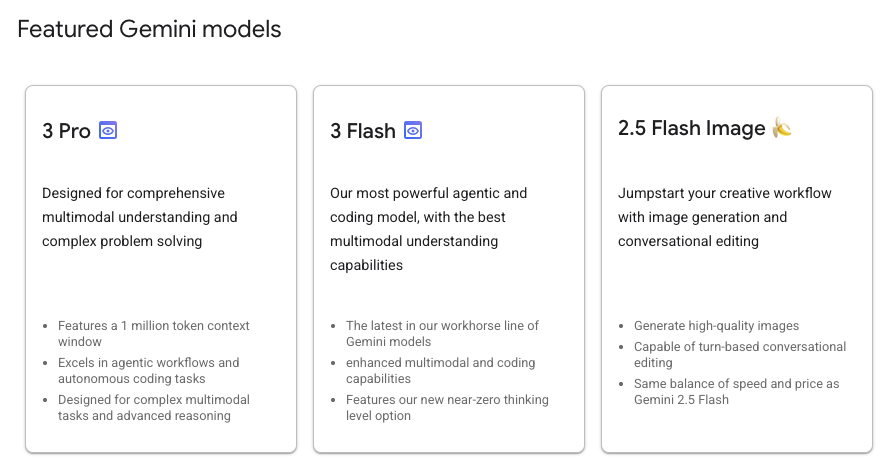

Gemini के मॉडल को हर कुछ महीनों में नए वर्शन के साथ बेहतर बनाया जाता है. आज (फ़रवरी 2026) की तारीख तक, Google Cloud पर Vertex AI में ये मॉडल उपलब्ध हैं:

इसके अलावा, सामान्य रूप से उपलब्ध Gemini मॉडल, Preview Gemini मॉडल, ओपन Gemma मॉडल, Embedding मॉडल, Imagegen मॉडल, Veo मॉडल वगैरह भी उपलब्ध हैं.

अलग-अलग इस्तेमाल के उदाहरणों के लिए, Vertex AI पर उपलब्ध मुख्य मॉडल के बारे में जानने के लिए, Google के मॉडल के दस्तावेज़ वाले पेज पर जाएं.

5. Google Gen AI SDK 📦

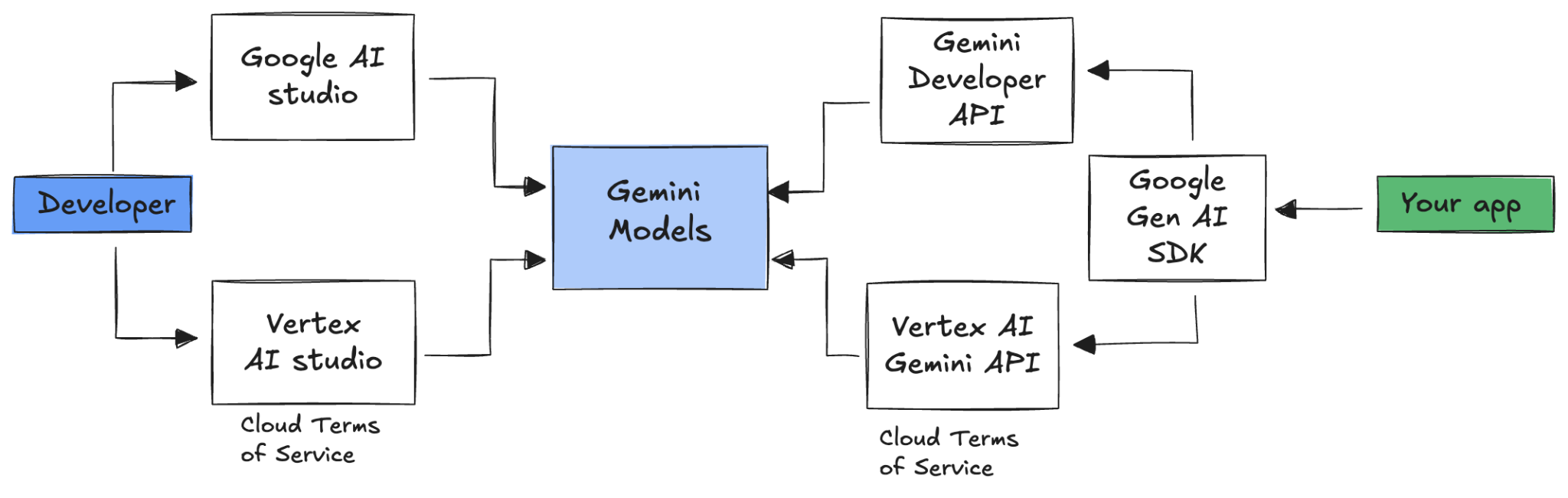

Gemini को अपने ऐप्लिकेशन के साथ इंटिग्रेट करने के लिए, Google Gen AI SDK का इस्तेमाल किया जा सकता है.

जैसा कि हमने पहले बताया था, Google AI Studio या Vertex AI Studio के ज़रिए Gemini मॉडल को ऐक्सेस किया जा सकता है. Google Gen AI SDK, Google AI API और Google Cloud API, दोनों के ज़रिए Gemini मॉडल के लिए एक जैसा इंटरफ़ेस उपलब्ध कराता है. कुछ अपवादों को छोड़कर, एक प्लैटफ़ॉर्म पर चलने वाला कोड दोनों प्लैटफ़ॉर्म पर चलेगा.

Google Gen AI SDK, फ़िलहाल Python, Go, Node, Java, और C# के साथ काम करता है.

उदाहरण के लिए, Python में Google AI से इस तरह बातचीत की जा सकती है:

client = genai.Client(

api_key=your-gemini-api-key)

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Why is the sky blue?")

Vertex AI में Gemini के ख़िलाफ़ ऐसा करने के लिए, आपको सिर्फ़ क्लाइंट के इनिशियलाइज़ेशन को बदलना होगा. बाकी सब कुछ पहले जैसा ही रहेगा:

client = genai.Client(

vertexai=True,

project=your-google-cloud-project,

location="us-central1")

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Why is the sky blue?")

इन सैंपल को खुद चलाने के लिए, github.com/meteatamel/genai-samples/tree/main/vertexai/gemini2/hello-world में main.py चलाएं.

6. Interactions API 🔄

Interactions API (बीटा वर्शन), Gemini के मॉडल और एजेंट के साथ इंटरैक्ट करने के लिए एक नया यूनिफ़ाइड इंटरफ़ेस है. यह generateContent एपीआई का बेहतर विकल्प है. इससे स्टेट मैनेजमेंट, टूल ऑर्केस्ट्रेशन, और लंबे समय तक चलने वाले टास्क को मैनेज करना आसान हो जाता है.

नए एपीआई के साथ सामान्य इंटरैक्शन करने का तरीका यहां बताया गया है:

interaction = client.interactions.create(

model="gemini-3-flash-preview",

input="Tell me a short joke."

)

print(interaction.outputs[-1].text)

पिछली बातचीत से इंटरैक्शन आईडी पास करके, स्टेटफ़ुल बातचीत की जा सकती है:

interaction1 = client.interactions.create(

model="gemini-3-flash-preview",

input="Hi, my name is Phil."

)

print(f"Model: {interaction1.outputs[-1].text}")

interaction2 = client.interactions.create(

model="gemini-3-flash-preview",

input="What is my name?",

previous_interaction_id=interaction1.id

)

print(f"Model: {interaction2.outputs[-1].text}")

Interactions API को एजेंट बनाने और उनके साथ इंटरैक्ट करने के लिए डिज़ाइन किया गया है. इसमें फ़ंक्शन कॉल करने, बिल्ट-इन टूल, स्ट्रक्चर्ड आउटपुट, और मॉडल कॉन्टेक्स्ट प्रोटोकॉल (एमसीपी) के लिए सहायता शामिल है. इसे Deep Research Agent के साथ कैसे इस्तेमाल किया जा सकता है, यह जानने के लिए यहां दिया गया Agents 🤖 चरण देखें.

इन सैंपल को खुद चलाने के लिए, github.com/meteatamel/genai-samples/blob/main/vertexai/interactions-api में main.py चलाएं.

7. लंबी कॉन्टेक्स्ट विंडो 🪟

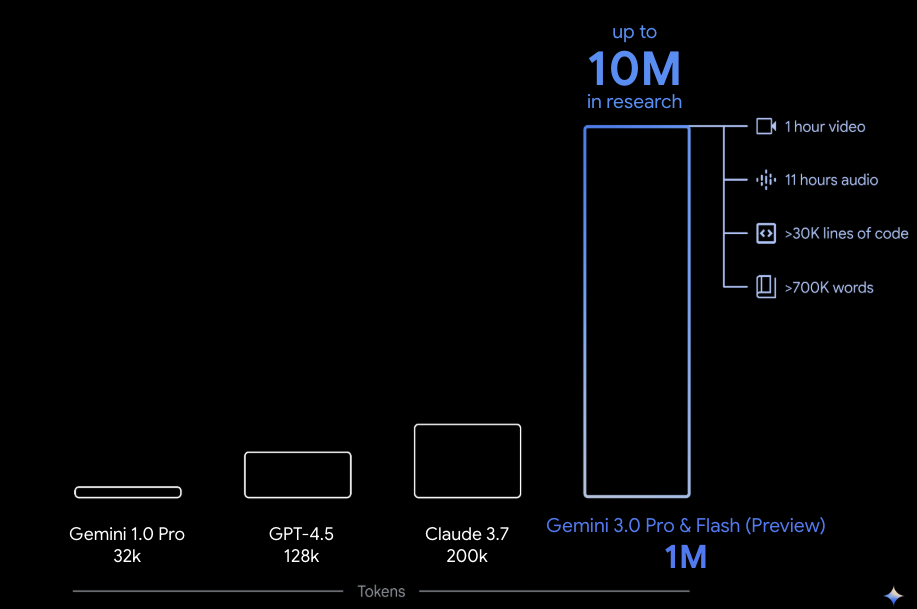

Gemini के कई मॉडल, 10 लाख या इससे ज़्यादा टोकन वाली बड़ी कॉन्टेक्स्ट विंडो के साथ उपलब्ध हैं. पहले, लार्ज लैंग्वेज मॉडल (एलएलएम) को एक बार में बहुत कम टेक्स्ट (या टोकन) दिया जा सकता था. Gemini की लंबी कॉन्टेक्स्ट विंडो की मदद से, कई नए इस्तेमाल के उदाहरण और डेवलपर पैराडाइम का इस्तेमाल किया जा सकता है.

लंबे कॉन्टेक्स्ट विंडो की सुविधा को आज़माने के लिए, Vertex AI Studio की प्रॉम्प्ट गैलरी पर जाएं और Extract Video Chapters प्रॉम्प्ट चुनें. इस प्रॉम्प्ट से, वीडियो के कॉन्टेंट को चैप्टर में ग्रुप किया जाता है. साथ ही, हर चैप्टर के लिए खास जानकारी दी जाती है.

दिए गए वीडियो के साथ इसे चलाने पर, आपको इससे मिलता-जुलता आउटपुट मिलेगा:

[

{

"timecode": "00:00",

"chapterSummary": "The video opens with scenic views of Rio de Janeiro, introducing the \"Marvelous City\" and its famous beaches like Ipanema and Copacabana, before pivoting to the existence of the favelas."

},

{

"timecode": "00:20",

"chapterSummary": "The narrator describes the favelas, home to one in five Rio residents, highlighting that while often associated with crime and poverty, this is only a small part of their story."

},

{

"timecode": "00:36",

"chapterSummary": "Google introduces its project to map the favelas, emphasizing that providing addresses to these uncharted areas is a crucial step in giving residents an identity."

},

{

"timecode": "00:43",

"chapterSummary": "The video concludes by focusing on the people of the favelas, inviting viewers to go beyond the map and explore their world through a 360-degree experience."

}

]

यह सिर्फ़ Gemini की लंबी कॉन्टेक्स्ट विंडो की वजह से मुमकिन है!

8. सोचने वाला मोड 🧠

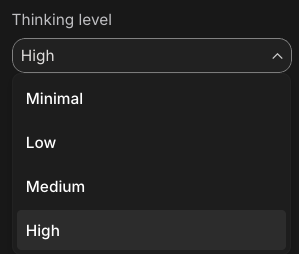

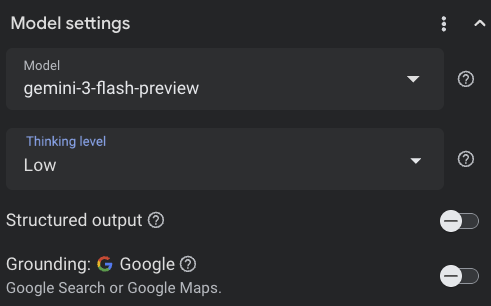

Gemini मॉडल, सोचने-समझने की एक इंटरनल प्रोसेस का इस्तेमाल करते हैं. इससे, मुश्किल टास्क के लिए तर्क करने की उनकी क्षमता काफ़ी बेहतर हो जाती है. सोचने के लेवल (Gemini 3) और बजट (Gemini 2.5) से, सोचने की प्रोसेस को कंट्रोल किया जाता है. मॉडल के रॉ थॉट देखने के लिए, include_thoughts फ़्लैग भी चालू किया जा सकता है.

थिंकिंग मोड को ऐक्शन में देखने के लिए, Google AI Studio ( ai.dev) खोलें और नई चैट शुरू करें. दाईं ओर मौजूद साइड पैनल में, सोचने का लेवल सेट किया जा सकता है:

सबसे ऊपर दाईं ओर मौजूद Get code बटन पर क्लिक करके, यह भी देखा जा सकता है कि कोड में सोचने का लेवल कैसे सेट किया जा सकता है. यह कुछ इस तरह का होता है:

response = client.models.generate_content(

model="gemini-3-pro-preview",

contents="How does AI work?",

config=types.GenerateContentConfig(

thinking_config=types.ThinkingConfig(

thinking_level="low",

include_thoughts=True

)

),

)

मॉडल के व्यवहार को समझने के लिए, अलग-अलग प्रॉम्प्ट और सोच के अलग-अलग लेवल का इस्तेमाल करें.

9. टूल 🧰

Gemini में कई टूल पहले से मौजूद होते हैं. जैसे, Google Search, Google Maps, कोड एक्ज़ीक्यूट करना, कंप्यूटर का इस्तेमाल करना, फ़ाइल खोजना वगैरह. फ़ंक्शन कॉलिंग की सुविधा का इस्तेमाल करके, अपने कस्टम टूल भी तय किए जा सकते हैं. आइए, इन सुविधाओं को इस्तेमाल करने के तरीके के बारे में जानते हैं.

Google Search 🔎

ज़्यादा सटीक, अप-टू-डेट, और काम के जवाब पाने के लिए, Google Search के नतीजों में मॉडल के जवाबों को शामिल किया जा सकता है.

Vertex AI Studio ( console.cloud.google.com/vertex-ai/studio) या Google AI Studio ( ai.dev) में, नई चैट शुरू करें और पक्का करें कि Google Search से मिली जानकारी का इस्तेमाल करने की सुविधा बंद हो:

इसके बाद, अपनी जगह के हिसाब से आज के मौसम के बारे में कोई सवाल पूछा जा सकता है. उदाहरण के लिए:

How's the weather in London today?

आम तौर पर, आपको पिछले दिन के हिसाब से जवाब मिलता है, क्योंकि मॉडल के पास नई जानकारी का ऐक्सेस नहीं होता. उदाहरण के लिए:

In London today (Friday, May 24, 2025), the weather is a bit of a mixed bag, typical for late May.

अब Google Search की मदद से जवाब पाने की सुविधा चालू करें और वही सवाल पूछें. आपको मौसम की मौजूदा जानकारी मिलनी चाहिए. साथ ही, जानकारी के स्रोत के लिंक भी मिलने चाहिए:

In London today (Wednesday, February 11, 2026), the weather is cool and mostly cloudy with a chance of light rain.

इस तरह, आपके कोड में Google Search की जानकारी शामिल होगी. ग्राउंडिंग का सैंपल पाने के लिए, Vertex AI studio में मौजूद 'कोड' बटन पर भी क्लिक किया जा सकता है:

google_search_tool = Tool(google_search=GoogleSearch())

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="How's the weather like today in London?",

config=GenerateContentConfig(tools=[google_search_tool])

)

Google Maps 🗺️

Google Maps की मदद से भी मॉडल के जवाबों को भरोसेमंद बनाया जा सकता है. Google Maps के पास 25 करोड़ से ज़्यादा जगहों की जानकारी होती है.

इसे काम करते हुए देखने के लिए, Vertex AI Studio में मॉडल की सेटिंग के ग्राउंडिंग सेक्शन में जाकर, Google Search के बजाय Google Maps को चुना जा सकता है. इसके बाद, ऐसा सवाल पूछा जा सकता है जिसके लिए Maps के डेटा की ज़रूरत हो. उदाहरण के लिए:

Can you show me some Greek restaurants and their map coordinates near me?

इसके लिए कोड कुछ ऐसा दिखता है:

google_maps_tool = Tool(google_maps=GoogleMaps())

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="What are the best restaurants near here?",

config=GenerateContentConfig(tools=[google_maps_tool]),

# Optional: Provide location context (this is in Los Angeles)

tool_config=ToolConfig(

retrieval_config=types.RetrievalConfig(

lat_lng=types.LatLng(

latitude=34.050481, longitude=-118.248526))),

)

कोड चलाने की सुविधा 🧑💻

Gemini, Python कोड जनरेट कर सकता है और उसे रन कर सकता है. इसके लिए, वह इन लाइब्रेरी का इस्तेमाल करता है: pandas, numpy, PyPDF2 वगैरह. यह उन ऐप्लिकेशन के लिए फ़ायदेमंद है जिनमें कोड के आधार पर तर्क करने की सुविधा काम आती है. जैसे, समीकरण हल करना

इसे आज़माने के लिए, Google AI Studio पर जाएं. इसके बाद, नई चैट शुरू करें और पक्का करें कि Code execution टॉगल चालू हो. इसके बाद, ऐसा सवाल पूछें जिसमें कोड लागू करने वाले टूल का इस्तेमाल किया जा सकता हो. उदाहरण के लिए:

What is the sum of the first 50 prime numbers?

Gemini को कुछ Python कोड जनरेट करके उसे चलाना चाहिए. आखिर में, सही जवाब 5117 है.

कोड लागू करने वाले टूल को कोड से इस तरह चलाया जा सकता है:

code_execution_tool = Tool(code_execution=ToolCodeExecution())

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="What is the sum of the first 50 prime numbers?",

config=GenerateContentConfig(

tools=[code_execution_tool],

temperature=0))

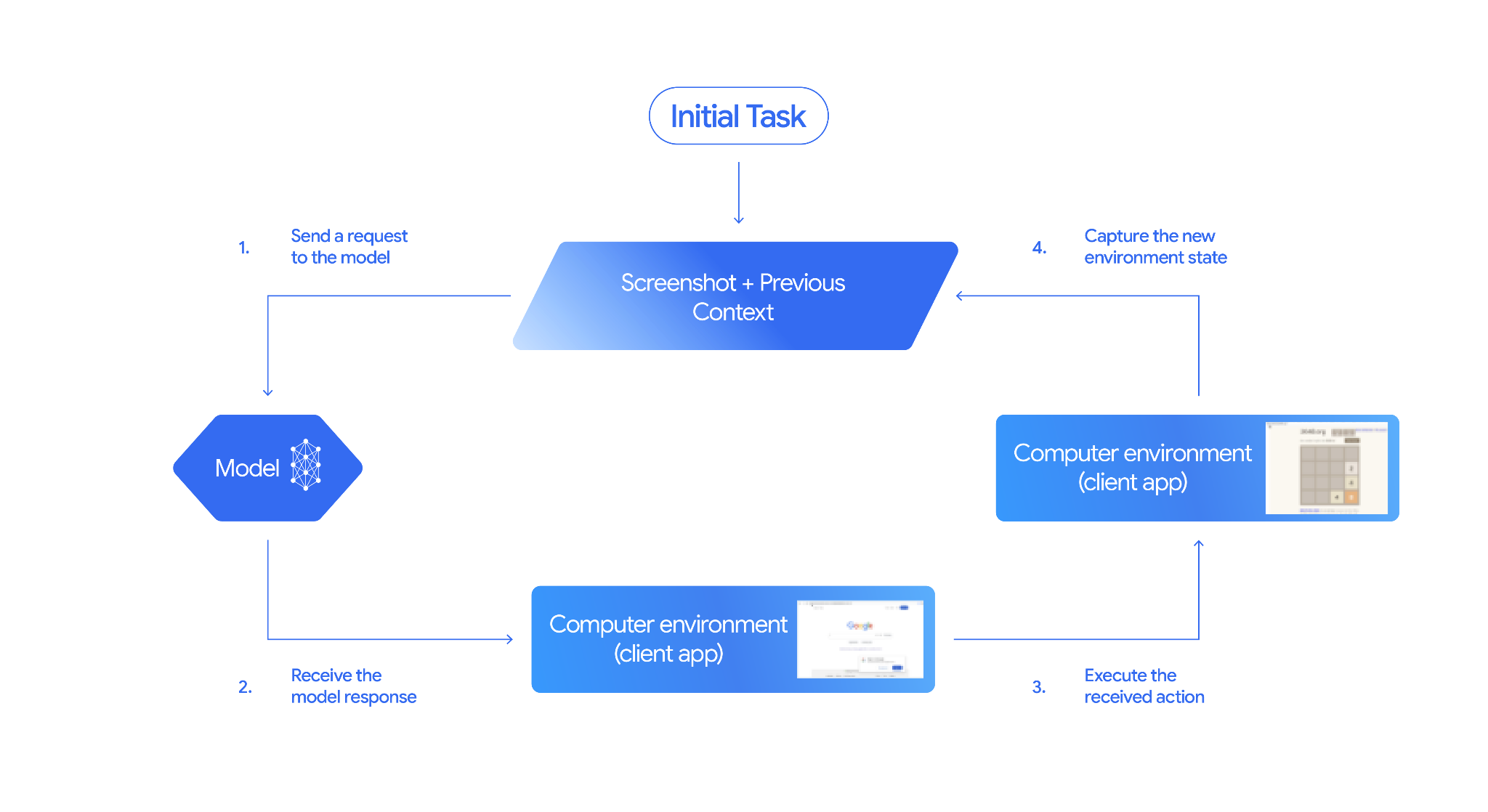

कंप्यूटर का इस्तेमाल 🖥️

Gemini Computer Use मॉडल (प्रीव्यू) की मदद से, ब्राउज़र कंट्रोल एजेंट बनाए जा सकते हैं. इससे टास्क को ऑटोमेट किया जा सकता है. यह इस लूप में काम करता है:

इसे आज़माने के लिए, github.com/google-gemini/computer-use-preview में जाकर main.py चलाएँ. Python वर्चुअल env बनाने और डिपेंडेंसी इंस्टॉल करने के लिए, रिपॉज़िटरी में दिए गए निर्देशों का पालन करें.

उदाहरण के लिए, Google AI Studio से अपना एपीआई पासकोड पाएं और Gemini से अपने लिए फ़्लाइट खोजने के लिए कहें:

export GEMINI_API_KEY=your-api-key

python main.py --query "Find me top 5 fights sorted by price with the following constraints:

Flight site to use: www.google.com/travel/flights

From: London

To: Larnaca

One-way or roundtrip: One way

Date to leave: Sometime next week

Date to return: N/A

Travel preferences:

-Direct flights

-No flights before 10am

-Carry-on luggage"

आपको दिखेगा कि Gemini ने गुप्त ब्राउज़र खोला है और आपके लिए फ़्लाइट की जानकारी खोजना शुरू कर दिया है!

फ़ाइल खोजें 📁

फ़ाइल सर्च टूल की मदद से, Retrieval Augmented Generation (RAG) को आसानी से इस्तेमाल किया जा सकता है. बस अपनी फ़ाइलें अपलोड करें. इसके बाद, यह आपके लिए RAG से जुड़ी सभी कार्रवाइयां करेगा. जैसे, टेक्स्ट को छोटे-छोटे हिस्सों में बांटना, टेक्स्ट को एम्बेड करना, और जानकारी को वापस पाना.

इसे इस्तेमाल करने का तरीका देखने के लिए, github.com/meteatamel/genai-beyond-basics/blob/main/samples/grounding/file-search-tool में जाकर, main.py चलाएँ.

Google AI Studio से अपना एपीआई पासकोड पाएं और फ़ाइल खोजने की सुविधा वाला स्टोर बनाएं:

export GEMINI_API_KEY=your-gemini-api-key

python main.py create_store my-file-search-store

स्टोर में PDF अपलोड करने के लिए:

python main.py upload_to_store fileSearchStores/myfilesearchstore-5a9x71ifjge9 cymbal-starlight-2024.pdf

स्टोर पर ले जाने वाले PDF के बारे में कोई सवाल पूछें:

python main.py generate_content "What's the cargo capacity of Cymbal Starlight?" fileSearchStores/myfilesearchstore-5a9x71ifjge9

आपको पीडीएफ़ के आधार पर जवाब मिलना चाहिए:

Generating content with file search store: fileSearchStores/myfilesearchstore-5a9x71ifjge9

Response: The Cymbal Starlight 2024 has a cargo capacity of 13.5 cubic feet, which is located in the trunk of the vehicle. It is important to distribute the weight evenly and not overload the trunk, as this could impact the vehicle's handling and stability. The vehicle can also accommodate up to two suitcases in the trunk, and it is recommended to use soft-sided luggage to maximize space and cargo straps to secure it while driving.

Grounding sources: cymbal-starlight-2024.pdf

फ़ंक्शन कॉलिंग 📲

अगर Gemini में मौजूद टूल आपके काम के नहीं हैं, तो Gemini में अपने टूल (फ़ंक्शन) भी बनाए जा सकते हैं. आपको सिर्फ़ Python फ़ंक्शन को टूल के तौर पर सबमिट करना होता है. इसके लिए, फ़ंक्शन की पूरी OpenAPI स्पेसिफ़िकेशन सबमिट करने की ज़रूरत नहीं होती. मॉडल और SDK टूल, इसका इस्तेमाल अपने-आप करते हैं.

उदाहरण के लिए, किसी जगह का अक्षांश और देशांतर दिखाने के लिए, आपके पास यह फ़ंक्शन हो सकता है:

def location_to_lat_long(location: str):

"""Given a location, returns the latitude and longitude

Args:

location: The location for which to get the weather.

Returns:

The latitude and longitude information in JSON.

"""

logger.info(f"Calling location_to_lat_long({location})")

url = f"https://geocoding-api.open-meteo.com/v1/search?name={location}&count=1"

return api_request(url)

अक्षांश और देशांतर के हिसाब से मौसम की जानकारी देने वाला फ़ंक्शन भी बनाया जा सकता है:

def lat_long_to_weather(latitude: str, longitude: str):

"""Given a latitude and longitude, returns the weather information

Args:

latitude: The latitude of a location

longitude: The longitude of a location

Returns:

The weather information for the location in JSON.

"""

logger.info(f"Calling lat_long_to_weather({latitude}, {longitude})")

url = (f"https://api.open-meteo.com/v1/forecast?latitude={latitude}&longitude={longitude}¤t=temperature_2m,"

f"relative_humidity_2m,surface_pressure,wind_speed_10m,wind_direction_10m&forecast_days=1")

return api_request(url)

अब इन दोनों फ़ंक्शन को Gemini को टूल के तौर पर पास किया जा सकता है. इससे Gemini, किसी जगह के मौसम की जानकारी फ़ेच कर पाएगा:

def generate_content_with_function_calls():

client = genai.Client(

vertexai=True,

project=PROJECT_ID,

location=LOCATION)

response = client.models.generate_content(

model=MODEL_ID,

contents=PROMPT,

config=GenerateContentConfig(

system_instruction=[

"You are a helpful weather assistant.",

"Your mission is to provide weather information for different cities."

"Make sure your responses are in plain text format (no markdown) and include all the cities asked.",

],

tools=[location_to_lat_long, lat_long_to_weather],

temperature=0),

)

print(response.text)

#print(response.automatic_function_calling_history)

इसे इस्तेमाल करके देखने के लिए, github.com/meteatamel/genai-beyond-basics/blob/main/samples/function-calling/weather में जाकर, main_genaisdk.py चलाएँ.

10. एजेंट 🤖

Gemini का Interactions API, एजेंट बनाने और उनसे इंटरैक्ट करने के लिए डिज़ाइन किया गया है. Gemini Deep Research Agent जैसे खास एजेंट का इस्तेमाल किया जा सकता है. Gemini Deep Research Agent, कई चरणों में रिसर्च करने वाले टास्क को अपने-आप प्लान करता है, उन्हें एक्ज़ीक्यूट करता है, और उनसे जुड़ी जानकारी को एक साथ मिलाकर पेश करता है. यह वेब खोज और आपके डेटा का इस्तेमाल करके, जटिल जानकारी को आसानी से समझता है. साथ ही, उद्धरणों के साथ विस्तृत रिपोर्ट तैयार करता है.

Interaction API के साथ Deep Research एजेंट का इस्तेमाल करने का तरीका यहां दिया गया है:

interaction = client.interactions.create(

input="Research the history of the Google TPUs.",

agent="deep-research-pro-preview-12-2025",

background=True

)

while True:

if interaction.status == "completed":

print("\nFinal Report:\n",

interaction.outputs[-1].text)

break

इस सैंपल को खुद चलाने के लिए, github.com/meteatamel/genai-samples/blob/main/vertexai/interactions-api में main.py चलाएं.

export GOOGLE_API_KEY=your-api-key

python main.py agent

कुछ समय बाद, आपको रिसर्च के नतीजे दिखेंगे:

User: Research the history of the Google TPUs with a focus on 2025 and 2026

Status: in_progress

Status: in_progress

Status: in_progress

...

Model Final Report:

# Architectural Convergence and Commercial Expansion: The History of Google TPUs (2015–2026)

## Key Findings

* **Strategic Pivot (2025):** Google transitioned the Tensor Processing Unit (TPU) from a primarily internal differentiator to a commercial merchant-silicon competitor, epitomized by the massive "Ironwood" (TPU v7) deployment and external sales strategy.

* **Technological Leap:** The introduction of TPU v7 "Ironwood" in 2025 marked a paradigm shift, utilizing 3nm process technology to deliver 42.5 exaFLOPS per pod, directly challenging NVIDIA's Blackwell architecture in the high-performance computing (HPC) sector.

...

11. इमेज जनरेट करने की सुविधा 📷

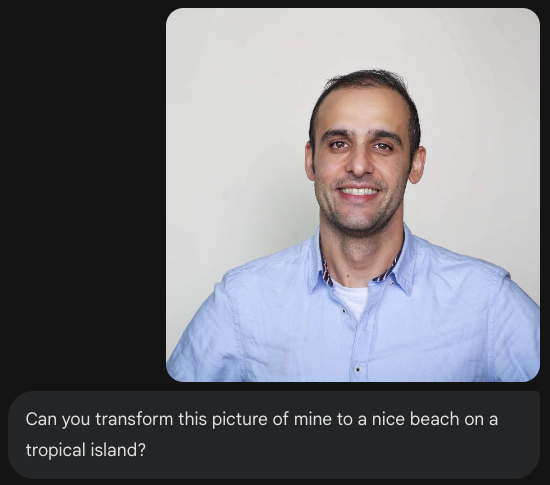

Nano Banana 🍌, Gemini में इमेज जनरेट करने की सुविधा का नाम है. Gemini, बातचीत के दौरान टेक्स्ट, इमेज या दोनों का इस्तेमाल करके इमेज जनरेट और प्रोसेस कर सकता है. इससे आपको विज़ुअल बनाने, उनमें बदलाव करने, और उन्हें कंट्रोल करने की सुविधा मिलती है.

Nano Banana, Gemini API में उपलब्ध दो अलग-अलग मॉडल को कहा जाता है:

- Nano Banana: यह Gemini 2.5 Flash Image मॉडल (

gemini-2.5-flash-image) है. इस मॉडल को तेज़ी से और बेहतर तरीके से काम करने के लिए डिज़ाइन किया गया है. इसे ऐसे टास्क के लिए ऑप्टिमाइज़ किया गया है जिनमें ज़्यादा डेटा की ज़रूरत होती है और जिन्हें कम समय में पूरा करना होता है. - Nano Banana Pro: यह Gemini 3 Pro Image Preview मॉडल (

gemini-3-pro-image-preview) है. इस मॉडल को ऐसेट बनाने के लिए डिज़ाइन किया गया है. यह मुश्किल निर्देशों को समझने और सटीक टेक्स्ट जनरेट करने के लिए, ऐडवांस रीज़निंग का इस्तेमाल करता है.

यहां कोड का एक स्निपेट दिया गया है. इसमें, मौजूदा इमेज को पास करके, Nano Banana से इमेज में बदलाव करने के लिए कहा जा सकता है:

from google import genai

from google.genai import types

from PIL import Image

client = genai.Client()

prompt = (

"Create a picture of my cat eating a nano-banana in a "

"fancy restaurant under the Gemini constellation",

)

image = Image.open("/path/to/cat_image.png")

response = client.models.generate_content(

model="gemini-2.5-flash-image",

contents=[prompt, image],

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save("generated_image.png")

Nano Banana, Gemini ऐप्लिकेशन, AI Studio या Vertex AI Studio में उपलब्ध है. इसे आज़माने का सबसे आसान तरीका, Gemini App है. Gemini App ( gemini.google.com) में, Tools में जाकर 🍌 Create images को चुनें. इसके बाद, कोई इमेज अपलोड करें और कुछ मज़ेदार आज़माएँ. उदाहरण के लिए, आप कह सकते हैं:

Can you transform this picture of mine to a nice beach on a tropical island?

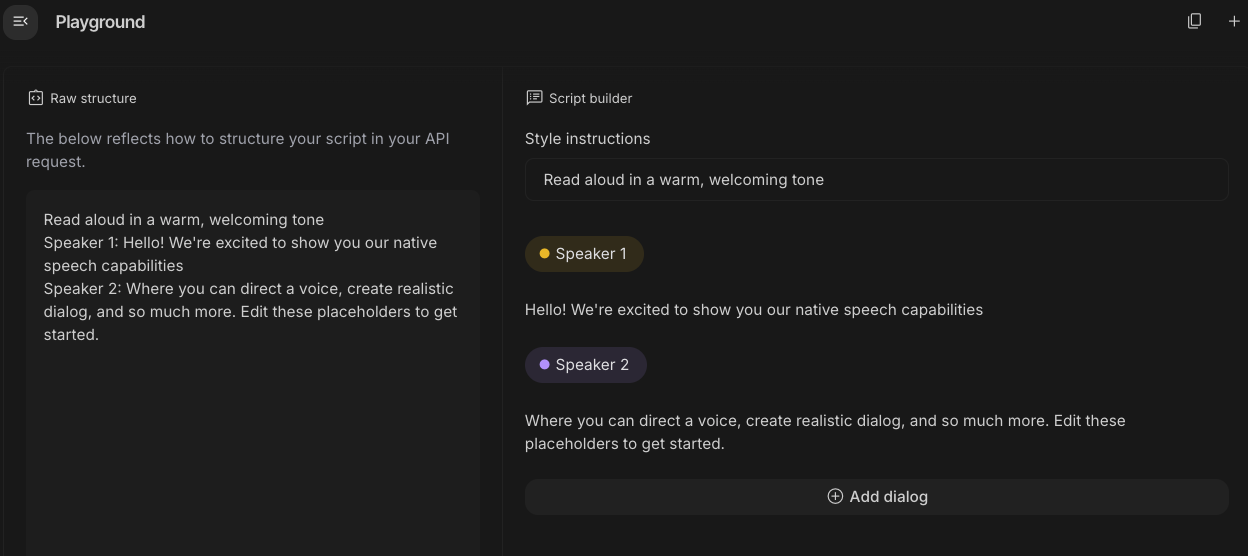

12. लिखे गए शब्दों को सुनने की सुविधा 🎶

Gemini, टेक्स्ट इनपुट को एक या एक से ज़्यादा स्पीकर वाले ऑडियो में बदल सकता है. इसके लिए, वह लिखे गए शब्दों को सुनने की सुविधा (टीटीएस) जनरेट करने की अपनी क्षमताओं का इस्तेमाल करता है. टीटीएस जनरेशन को कंट्रोल किया जा सकता है. इसका मतलब है कि इंटरैक्शन को स्ट्रक्चर करने के लिए, सामान्य भाषा का इस्तेमाल किया जा सकता है. साथ ही, ऑडियो की स्टाइल, लहजे, गति, और टोन को गाइड किया जा सकता है.

TTS की सुविधा इन दो मॉडल के साथ काम करती है:

टीटीएस की सुविधा, Live API के ज़रिए उपलब्ध कराई गई स्पीच जनरेशन की सुविधा से अलग होती है. Live API को इंटरैक्टिव, अनस्ट्रक्चर्ड ऑडियो, और मल्टीमॉडल इनपुट और आउटपुट के लिए डिज़ाइन किया गया है. लाइव एपीआई, बातचीत के बदलते कॉन्टेक्स्ट के हिसाब से काम करता है. वहीं, Gemini API के ज़रिए टीटीएस की सुविधा उन स्थितियों के लिए बनाई गई है जहां स्टाइल और आवाज़ पर बारीकी से कंट्रोल के साथ, सटीक टेक्स्ट सुनाने की ज़रूरत होती है. जैसे, पॉडकास्ट या ऑडियो बुक जनरेट करना.

सिंगल-स्पीकर टीटीएस के लिए कोड का स्निपेट यहां दिया गया है:

`

from google import genai

from google.genai import types

import wave

# Set up the wave file to save the output:

def wave_file(filename, pcm, channels=1, rate=24000, sample_width=2):

with wave.open(filename, "wb") as wf:

wf.setnchannels(channels)

wf.setsampwidth(sample_width)

wf.setframerate(rate)

wf.writeframes(pcm)

client = genai.Client()

response = client.models.generate_content(

model="gemini-2.5-flash-preview-tts",

contents="Say cheerfully: Have a wonderful day!",

config=types.GenerateContentConfig(

response_modalities=["AUDIO"],

speech_config=types.SpeechConfig(

voice_config=types.VoiceConfig(

prebuilt_voice_config=types.PrebuiltVoiceConfig(

voice_name='Kore',

)

)

),

)

)

data = response.candidates[0].content.parts[0].inline_data.data

file_name='out.wav'

wave_file(file_name, data) # Saves the file to current directory

ज़्यादा सैंपल देखने के लिए, लिखे गए शब्दों को सुनने की सुविधा (टीटीएस) से जुड़े दस्तावेज़ पर जाएं.

Google AI Studio के प्लेग्राउंड में जाकर भी, स्पीच जनरेट करने की सुविधा आज़माई जा सकती है. generate-speech ऐप्लिकेशन में अलग-अलग प्रॉम्प्ट का इस्तेमाल करें:

13. स्पेशल अंडरस्टैंडिंग 🌐

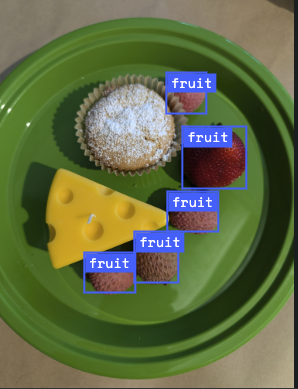

Gemini में ऑब्जेक्ट का पता लगाने और जगह की जानकारी समझने की बेहतर सुविधा है. इसे समझने का सबसे आसान तरीका है कि आप इसे इस्तेमाल करके देखें.

Google AI Studio के स्टार्टर ऐप्लेट पर जाएं और स्पेशल अंडरस्टैंडिंग ऐप्लिकेशन पर जाएं.

.env फ़ाइल में, Google AI Studio का पासकोड डालें. साथ ही, src/consts.tsx में मौजूद मॉडल को नए मॉडल में से किसी एक पर अपडेट करें. डिपेंडेंसी इंस्टॉल करें और ऐप्लिकेशन शुरू करें:

npm install

npm run dev

http://localhost:8000/ पर जाएं.

अब कुछ इमेज चुनें और Gemini की मदद से, इमेज में मौजूद कुछ आइटम का पता लगाएं.

उदाहरण के लिए, अलग-अलग इमेज में "छाया" या "फल" का पता लगाया जा सकता है:

अलग-अलग इमेज आज़माएं और देखें कि Gemini, अलग-अलग ऑब्जेक्ट का पता लगाकर उन्हें कितनी अच्छी तरह लेबल करता है.

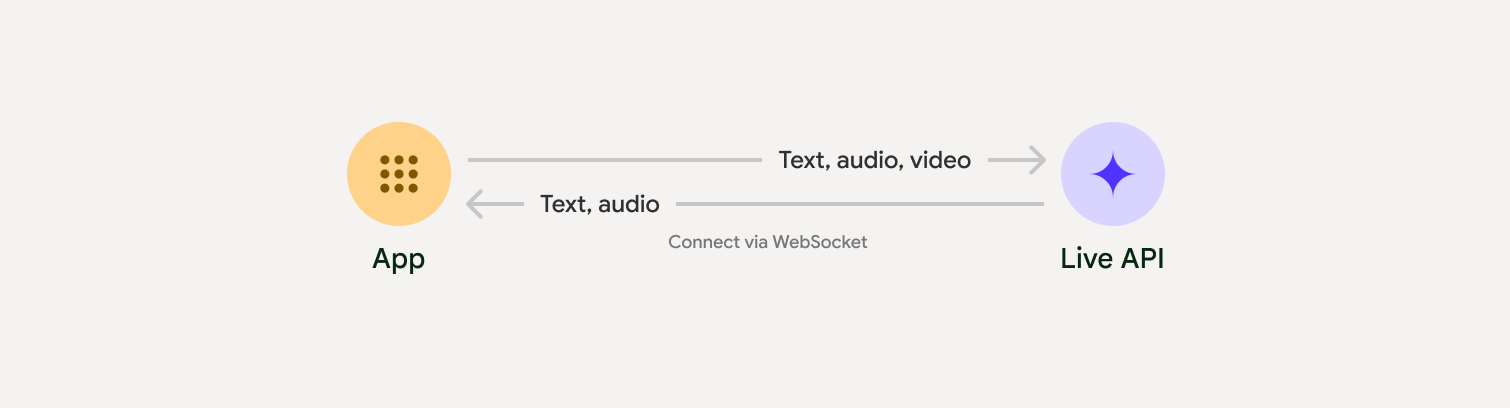

14. Live API 🎤

Live API की मदद से, Gemini के साथ कम समय में, रीयल-टाइम में आवाज़ और वीडियो से बातचीत की जा सकती है. यह ऑडियो, वीडियो या टेक्स्ट की लगातार स्ट्रीम को प्रोसेस करता है, ताकि तुरंत और इंसानों की तरह बोले गए जवाब दिए जा सकें. इससे आपके उपयोगकर्ताओं को बातचीत करने का एक स्वाभाविक अनुभव मिलता है.

Google AI Studio में Live API या Vertex AI Studio में Live API आज़माएं. दोनों ऐप्लिकेशन में, Gemini के साथ लाइव बातचीत करने के लिए, अपनी आवाज़, वीडियो, और स्क्रीन शेयर की जा सकती है.

वीडियो या स्क्रीन शेयर करना शुरू करें और Gemini से सामान्य सवाल पूछें. उदाहरण के लिए:

Can you describe what you see on the screen?

आपको यह जानकर हैरानी होगी कि Gemini के जवाब कितने स्वाभाविक लगते हैं.

15. नतीजा

इस कोडलैब में, हमने Gemini के इकोसिस्टम के बारे में बताया है. इसमें Gemini के प्रॉडक्ट फ़ैमिली ग्रुप से लेकर, Google Gen AI SDK का इस्तेमाल करके, मॉडल को अपने ऐप्लिकेशन में इंटिग्रेट करने का तरीका शामिल है. हमने Gemini की नई सुविधाओं के बारे में जाना. जैसे, लंबी कॉन्टेक्स्ट विंडो, सूझ-बूझ मोड, बिल्ट-इन ग्राउंडिंग टूल, Live API, और स्पेशल समझ. हमारा सुझाव है कि आप रेफ़रंस दस्तावेज़ों के बारे में ज़्यादा जानें और Gemini की सभी सुविधाओं का इस्तेमाल करके देखें.

रेफ़रंस

- Gemini ऐप्लिकेशन

- NotebookLM

- Google AI Studio

- Vertex AI Studio

- Gemini CLI

- Google Antigravity

- Gemini के मॉडल

- Google Gen AI SDK

- Python SDK

- Go SDK

- Node SDK

- Java SDK

- C# SDK

- Interactions API

- Gemini Deep Research Agent

- Nano Banana की मदद से इमेज जनरेट करना

- लिखे गए शब्दों को बोली में बदलने की सुविधा (टीटीएस)

- Live API