1. Przegląd

Ten moduł dotyczy korzystania z interfejsu wiersza poleceń Gemini, agenta opartego na AI o otwartym kodzie źródłowym w Google Cloud. Dowiesz się, jak używać interfejsu wiersza poleceń Gemini do różnych zadań, w tym do analizowania istniejących baz kodu, generowania dokumentacji i testów jednostkowych oraz refaktoryzacji komponentów interfejsu użytkownika i backendu aplikacji internetowej w języku Python.

Czego się nauczysz

W tym module nauczysz się:

- Jak używać interfejsu wiersza poleceń Gemini do wykonywania typowych zadań programistycznych.

Wymagania wstępne

- Zakładamy, że użytkownik zna środowiska konsoli Cloud i Cloud Shell.

2. Konfiguracja i wymagania

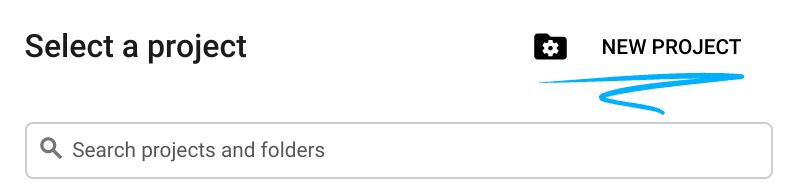

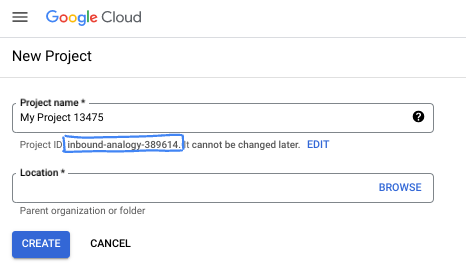

Konfigurowanie projektu w Google Cloud

- Zaloguj się w konsoli Google Cloud i utwórz nowy projekt lub użyj istniejącego. Jeśli nie masz jeszcze konta Gmail ani Google Workspace, musisz je utworzyć.

- Nazwa projektu to wyświetlana nazwa uczestników tego projektu. Jest to ciąg znaków, który nie jest używany przez interfejsy API Google. Zawsze możesz ją zaktualizować.

- Identyfikator projektu jest unikalny we wszystkich projektach Google Cloud i nie można go zmienić po ustawieniu. Konsola Cloud automatycznie generuje unikalny ciąg znaków. Zwykle nie musisz się tym przejmować. W większości ćwiczeń z programowania musisz odwoływać się do identyfikatora projektu (zwykle oznaczanego jako

PROJECT_ID). Jeśli wygenerowany identyfikator Ci się nie podoba, możesz wygenerować inny losowy identyfikator. Możesz też spróbować własnej nazwy i sprawdzić, czy jest dostępna. Po tym kroku nie można go zmienić i pozostaje on taki przez cały czas trwania projektu. - Warto wiedzieć, że istnieje trzecia wartość, numer projektu, której używają niektóre interfejsy API. Więcej informacji o tych 3 wartościach znajdziesz w dokumentacji.

- Następnie musisz włączyć płatności w konsoli Cloud, aby korzystać z zasobów i interfejsów API Google Cloud. Wykonanie tego ćwiczenia nie będzie kosztować dużo, a może nawet nic. Aby wyłączyć zasoby i uniknąć naliczania opłat po zakończeniu tego samouczka, możesz usunąć utworzone zasoby lub projekt. Nowi użytkownicy Google Cloud mogą skorzystać z bezpłatnego okresu próbnego, w którym mają do dyspozycji środki w wysokości 300 USD.

Konfiguracja środowiska

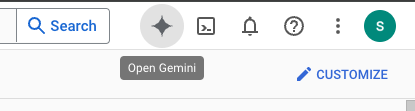

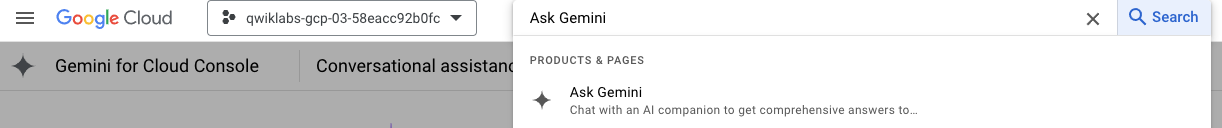

Otwórz rozmowę z Gemini.

Możesz też wpisać „Zapytaj Gemini” na pasku wyszukiwania.

Włącz interfejs Gemini for Google Cloud API:

Na następnym ekranie włącz GCA.

Kliknij „Start chatting” i wybierz jedno z przykładowych pytań lub wpisz własny prompt, aby wypróbować tę funkcję.

Prompty do wypróbowania:

- Wyjaśnij, czym jest Cloud Run, w 5 najważniejszych punktach.

- Jesteś menedżerem produktu Google Cloud Run. Wyjaśnij studentowi, czym jest Cloud Run, w 5 krótkich punktach.

- Jesteś menedżerem produktu Google Cloud Run. Wyjaśnij certyfikowanemu programiście Kubernetes, czym jest Cloud Run, w 5 krótkich punktach.

- Jesteś menedżerem produktu Google Cloud Run. Wyjaśnij starszemu programiście w 5 krótkich punktach, kiedy warto używać Cloud Run, a kiedy GKE.

Po zakończeniu zamknij okno czatu z Gemini Cloud Assist.

Więcej informacji o tworzeniu lepszych promptów znajdziesz w przewodniku po promptach.

Jak Gemini w Google Cloud korzysta z danych użytkowników

Zobowiązanie Google do ochrony prywatności

Google jako jedna z pierwszych firm w branży opublikowała zobowiązanie do ochrony prywatności w systemach AI/ML, w którym podkreślamy, że klienci powinni mieć najwyższy poziom bezpieczeństwa i kontroli nad danymi przechowywanymi w chmurze.

Dane, które przesyłasz i odbierasz

Pytania, które zadajesz Gemini, w tym wszelkie dane wejściowe lub kod, które przesyłasz do Gemini w celu analizy lub uzupełnienia, nazywane są promptami. Odpowiedzi lub uzupełnienia kodu, które otrzymujesz od Gemini, nazywamy odpowiedziami. Gemini nie używa Twoich promptów ani swoich odpowiedzi jako danych do trenowania swoich modeli.

Szyfrowanie promptów

Gdy przesyłasz prompty do Gemini, Twoje dane są szyfrowane podczas przesyłania jako dane wejściowe do modelu bazowego w Gemini.

Dane programu wygenerowane przez Gemini

Gemini jest trenowany na podstawie kodu Google Cloud oraz wybranego kodu innych firm. Ponosisz odpowiedzialność za bezpieczeństwo, testowanie i skuteczność swojego kodu, w tym za uzupełnianie, generowanie i analizowanie kodu oferowane przez Gemini.

Dowiedz się więcej o tym, jak Google przetwarza Twoje prompty.

3. Opcje testowania promptów

Jeśli chcesz zmienić istniejące prompty, masz kilka opcji.

Vertex AI Studio to część platformy Vertex AI w Google Cloud, która została zaprojektowana specjalnie z myślą o upraszczaniu i przyspieszaniu tworzenia i używania modeli generatywnej AI.

Google AI Studio to internetowe narzędzie do tworzenia prototypów i eksperymentowania z inżynierią promptów oraz interfejsem Gemini API.

- Aplikacja internetowa Gemini (gemini.google.com)

Aplikacja internetowa Google Gemini (gemini.google.com) to narzędzie internetowe, które pomaga odkrywać i wykorzystywać możliwości modeli AI Gemini od Google.

- aplikacja mobilna Google Gemini na Android i aplikacja Google na iOS;

4. Pobieranie i sprawdzanie aplikacji

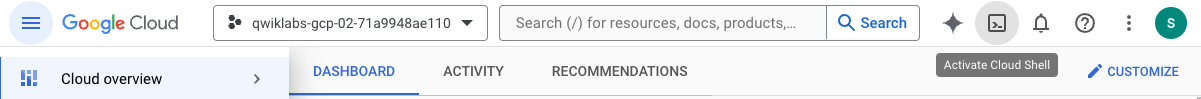

Aktywuj Cloud Shell, klikając ikonę po prawej stronie paska wyszukiwania.

Jeśli pojawi się prośba o autoryzację, kliknij „Autoryzuj”, aby kontynuować.

W terminalu uruchom poniższe polecenia, aby sklonować lokalnie repozytorium Git.

git clone https://github.com/gitrey/calendar-app-lab

cd calendar-app-lab

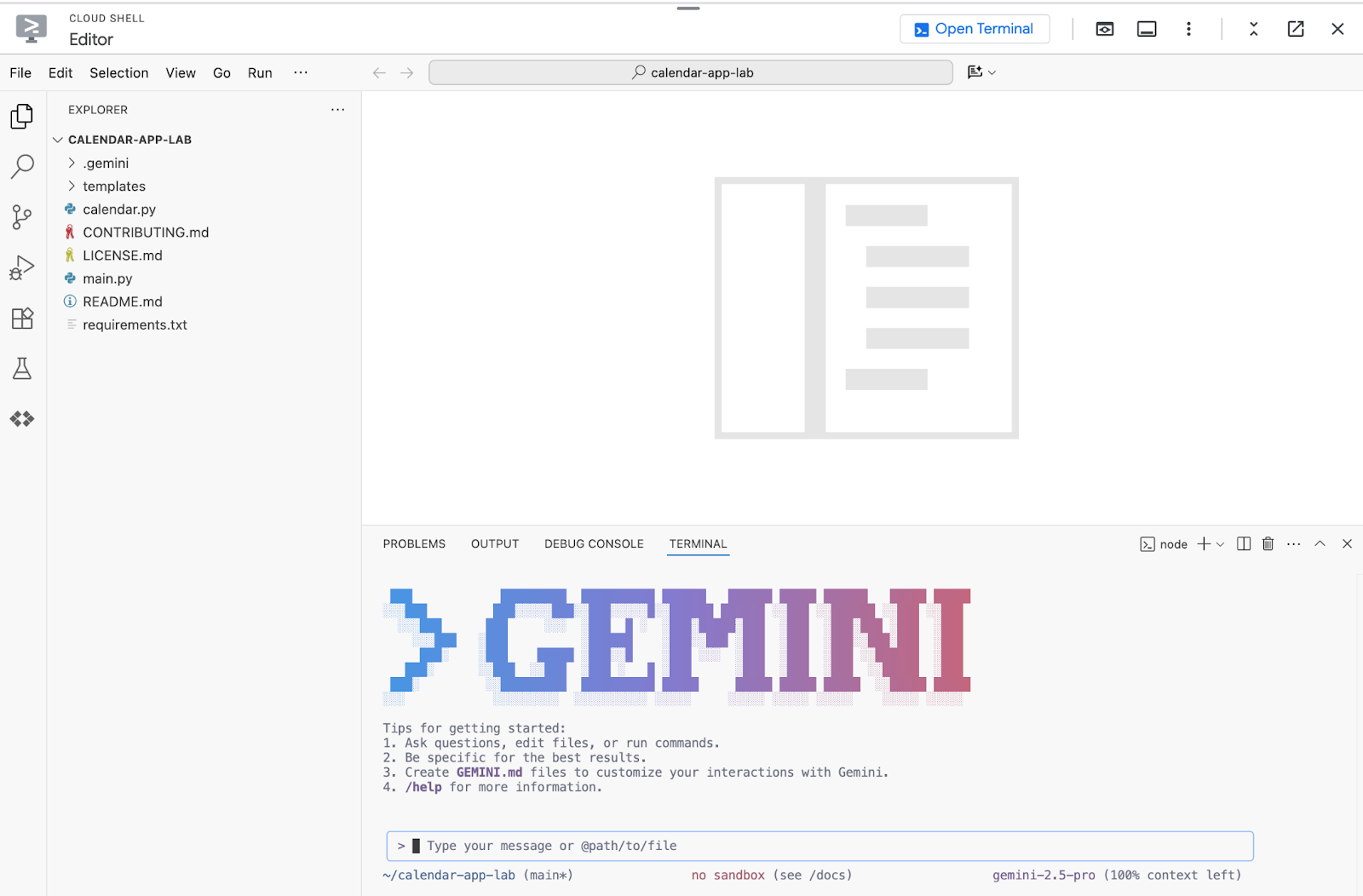

Uruchom „Edytor Cloud Shell”.

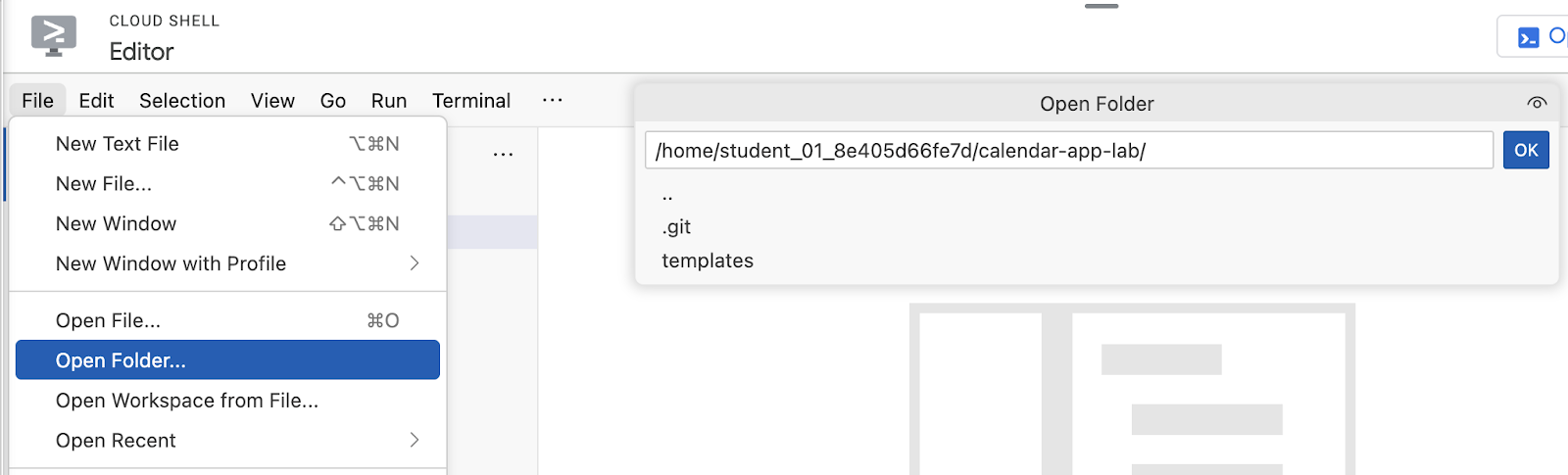

Otwórz folder „calendar-app-lab”.

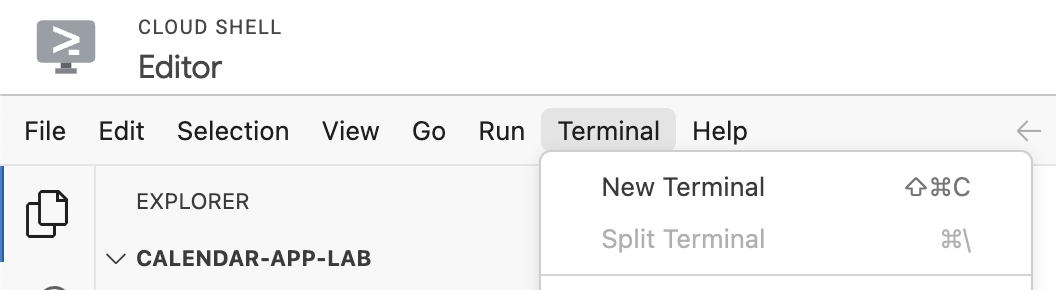

Uruchom nowy terminal w edytorze Cloud Shell.

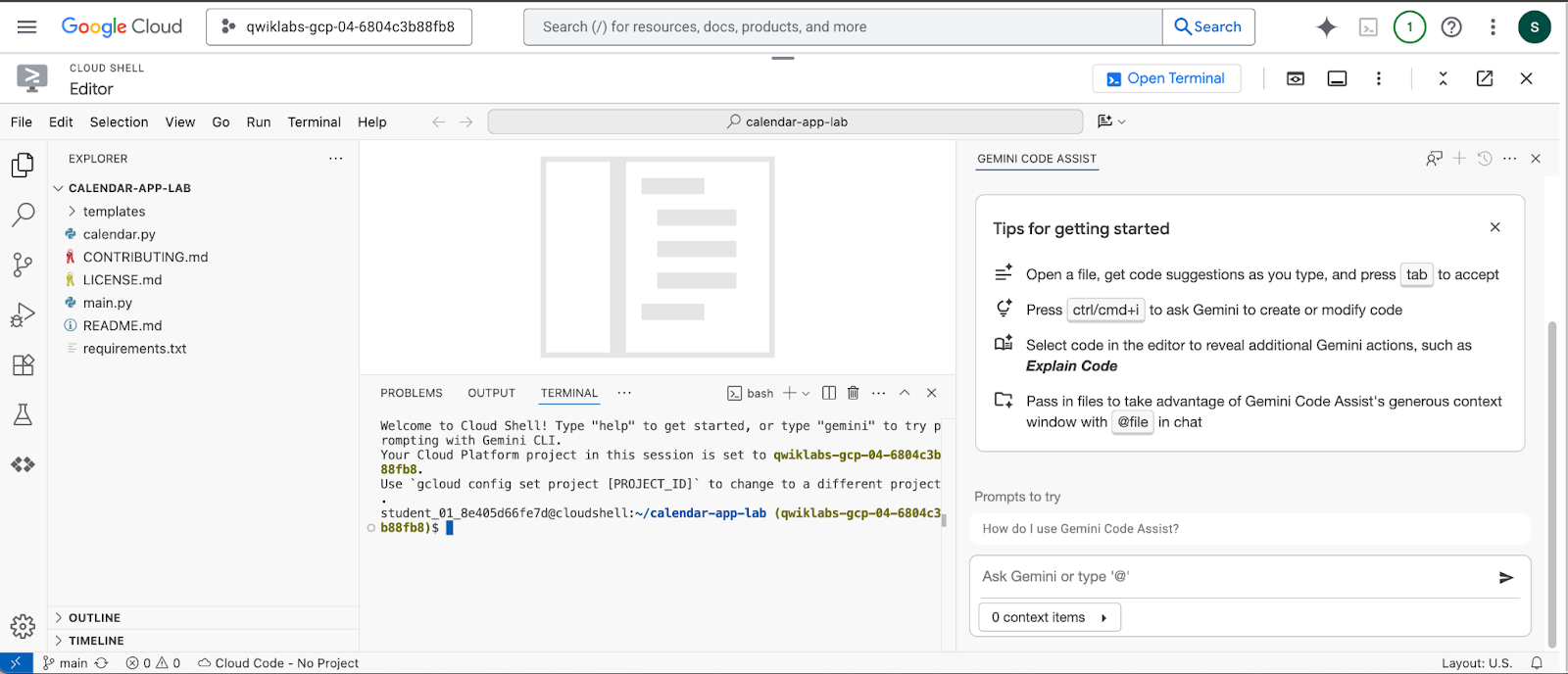

Środowisko powinno wyglądać podobnie do tego na zrzucie ekranu poniżej.

5. Wprowadzenie do interfejsu wiersza poleceń Gemini

Interfejs wiersza poleceń Gemini to agent AI o otwartym kodzie źródłowym, który integruje się z modelami Gemini od Google Cloud. Umożliwia programistom wykonywanie różnych zadań bezpośrednio z terminala, takich jak zrozumienie baz kodu, generowanie dokumentacji i testów jednostkowych oraz refaktoryzacja kodu. Główną zaletą interfejsu wiersza poleceń Gemini jest możliwość usprawnienia przepływów pracy programistów dzięki udostępnieniu możliwości generatywnej AI bezpośrednio w środowisku wiersza poleceń, co ogranicza przełączanie kontekstu i zwiększa produktywność.

Ten krok, czyli ustawienie zmiennej środowiskowej, nie jest wymagany w środowisku Qwiklabs. Przejdź do następnego kroku.

Jeśli w środowisku lokalnym używasz płatnej licencji Code Assist od organizacji, pamiętaj, aby ustawić projekt Google Cloud w terminalu. Więcej szczegółów

export GOOGLE_CLOUD_PROJECT="YOUR_PROJECT_NAME"

Sprawdź, czy jesteś w folderze głównym projektu:

cd ~/calendar-app-lab

Uruchom interfejs wiersza poleceń Gemini w oknie terminala:

gemini

Środowisko powinno wyglądać podobnie do tego na zrzucie ekranu poniżej.

Jeśli wykonujesz czynności w środowisku lokalnym, możesz włączyć integrację ze środowiskiem IDE.

W każdej chwili możesz to zmienić, uruchamiając /ide disable | enable.

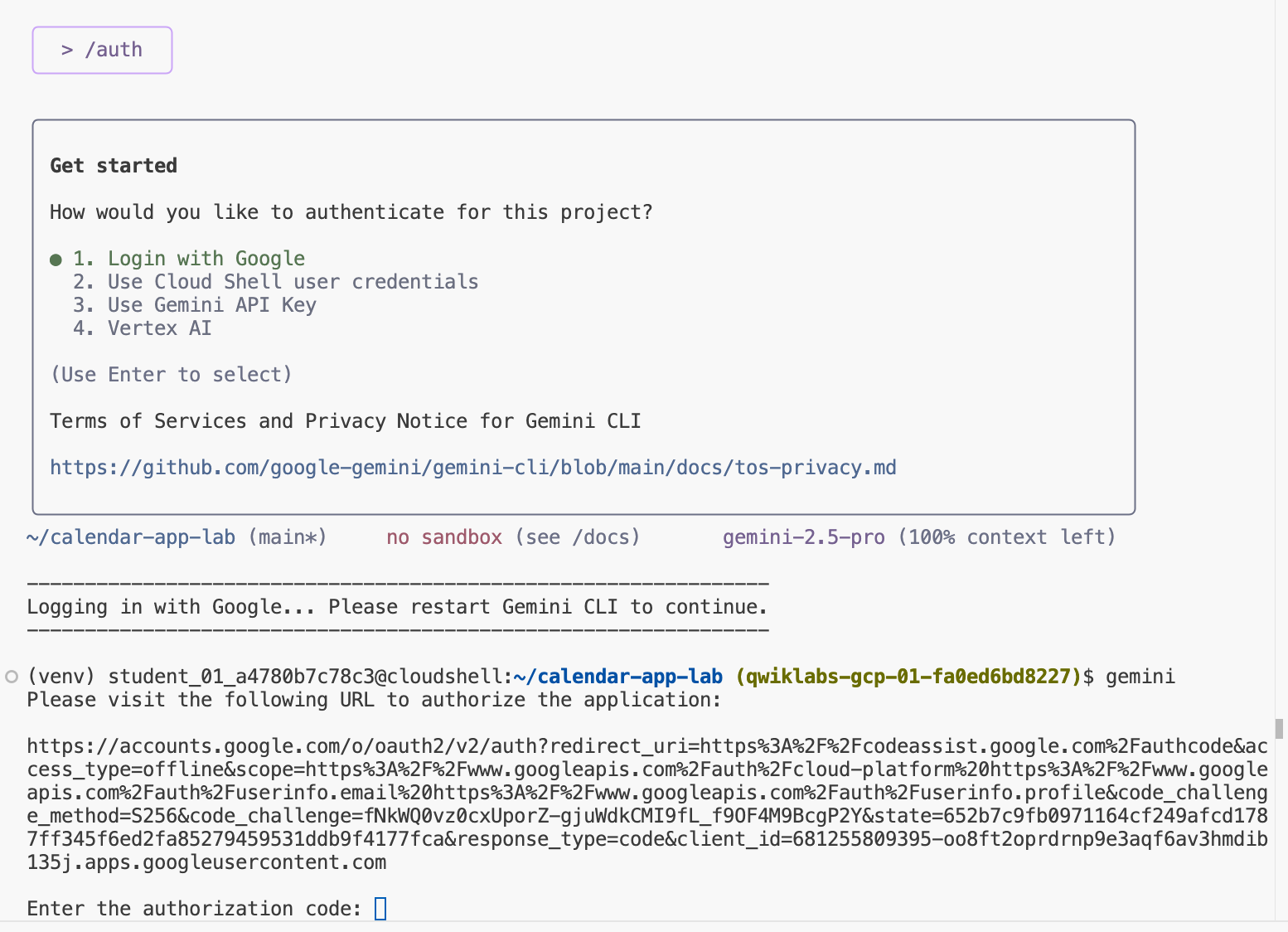

Jeśli moduł jest uruchomiony w środowisku Qwiklabs, wybierz „Use Cloud Shell user credentials”.

W przeciwnym razie uwierzytelnij interfejs wiersza poleceń Gemini, uruchamiając to polecenie i klikając „Login with Google”:

/auth

Po ponownym uruchomieniu interfejsu CLI pojawi się prośba o autoryzację aplikacji. W tym celu kliknij podany link.

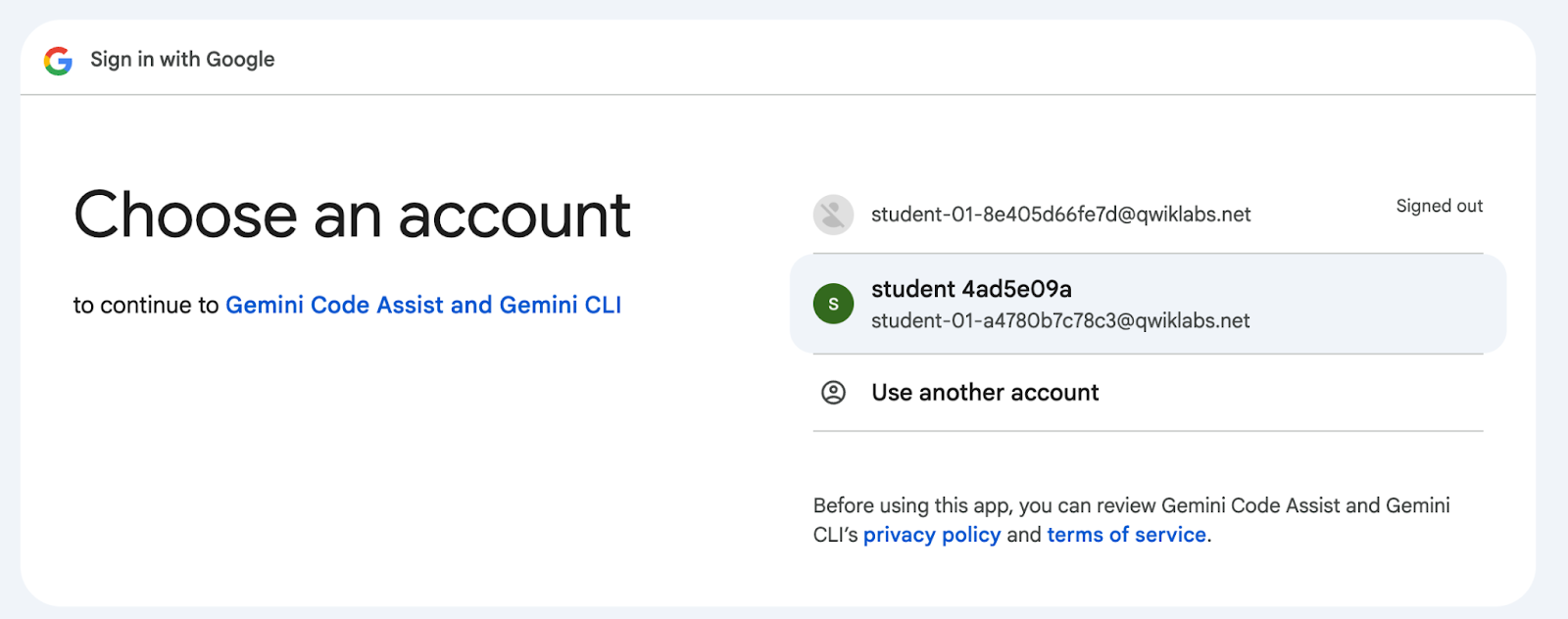

Otwórz link i wykonaj czynności, aby zalogować się za pomocą danych logowania ucznia Qwiklabs.

Skopiuj kod weryfikacyjny i wróć do terminala, aby zakończyć proces, wklejając kod.

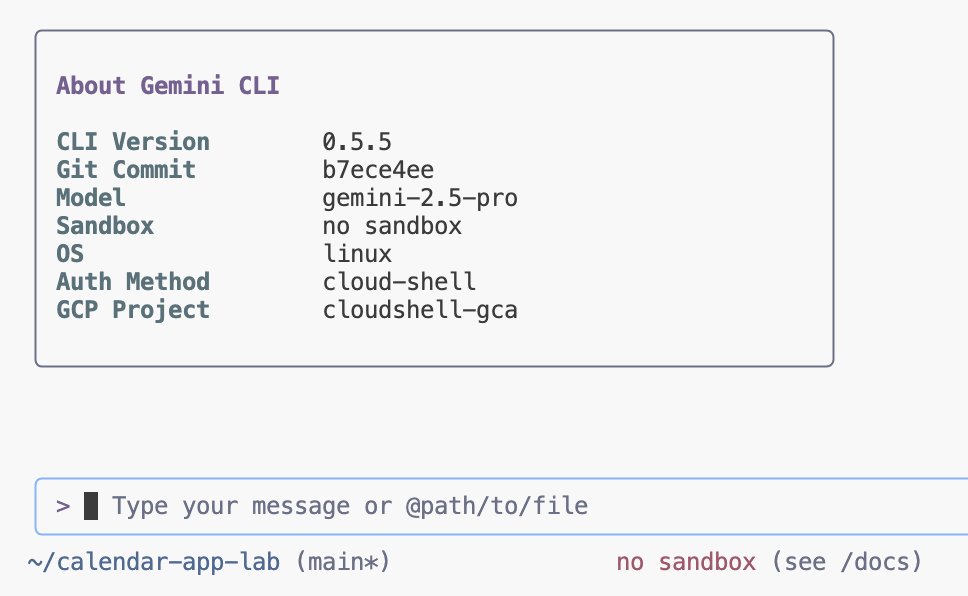

Aby sprawdzić metodę uwierzytelniania, uruchom to polecenie:

/about

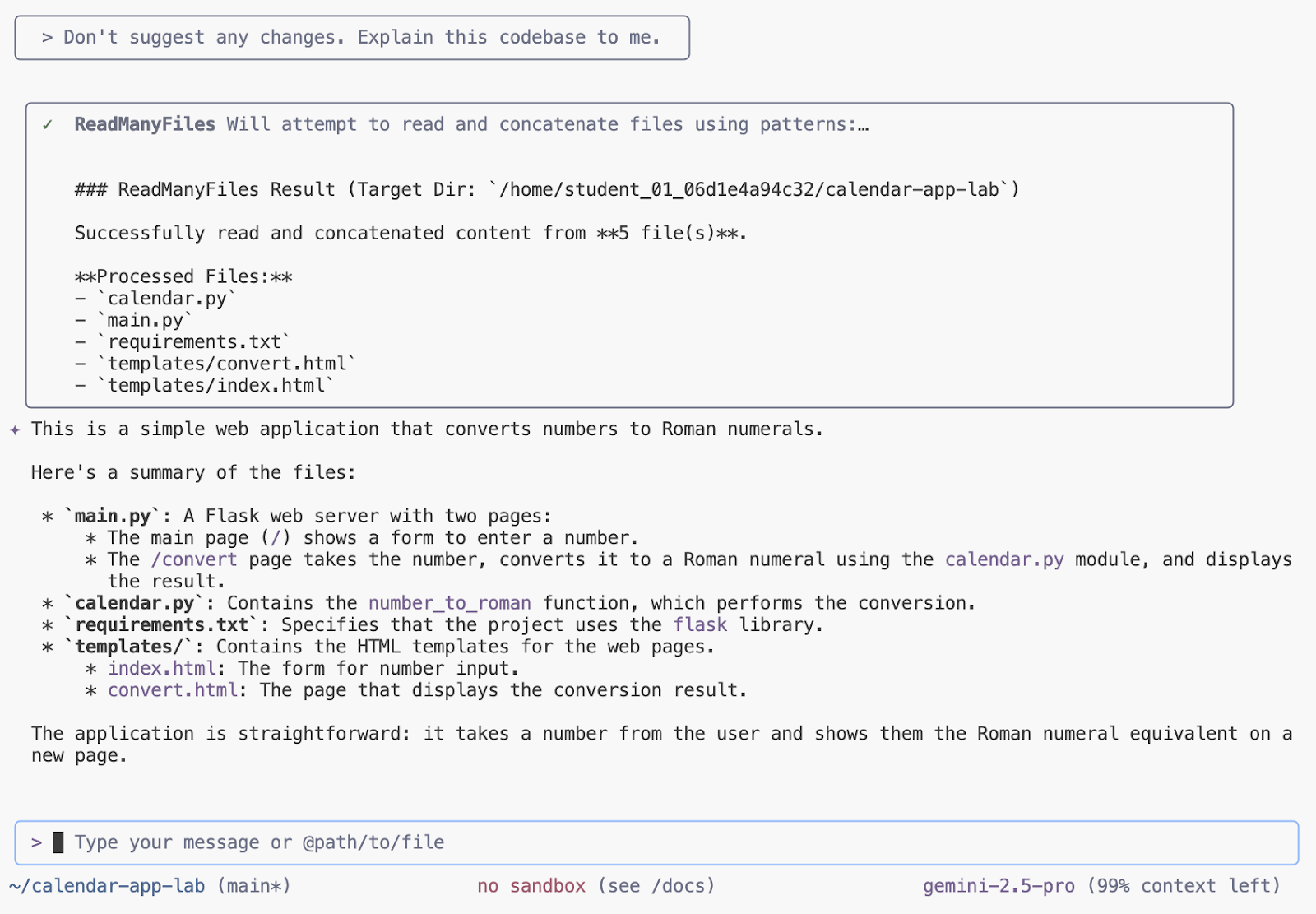

6. Zrozumienie bazy kodu

Za pomocą interfejsu wiersza poleceń Gemini możesz szybko poznać bazę kodu, prosząc go o streszczenie przeznaczenia plików lub katalogów oraz wyjaśnienie złożonych funkcji lub sekcji kodu. Dzięki temu deweloperzy mogą szybko rozpocząć pracę nad nowymi projektami lub zrozumieć nieznane części istniejącego kodu bez konieczności ręcznego sprawdzania.

Aby dowiedzieć się więcej o bazie kodu, w interfejsie wiersza poleceń Gemini wyślij ten prompt:

Don't suggest any changes. Explain this codebase to me.

Sprawdź dane wyjściowe:

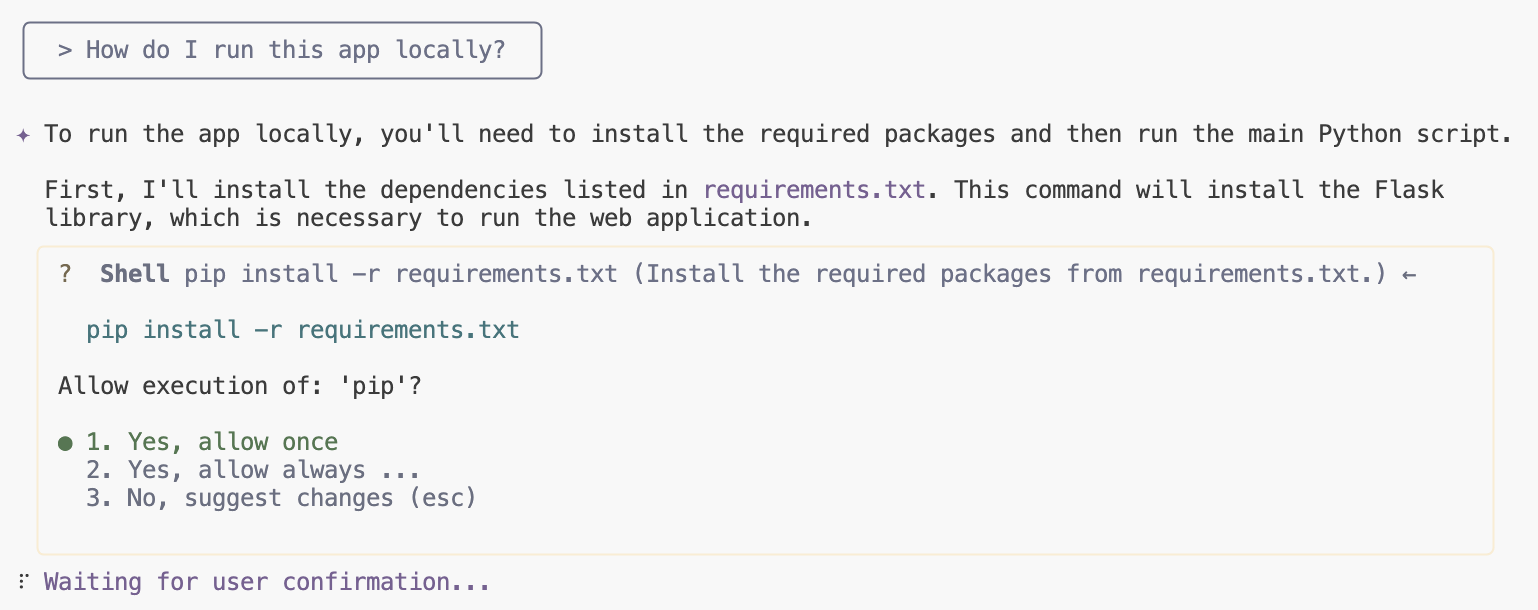

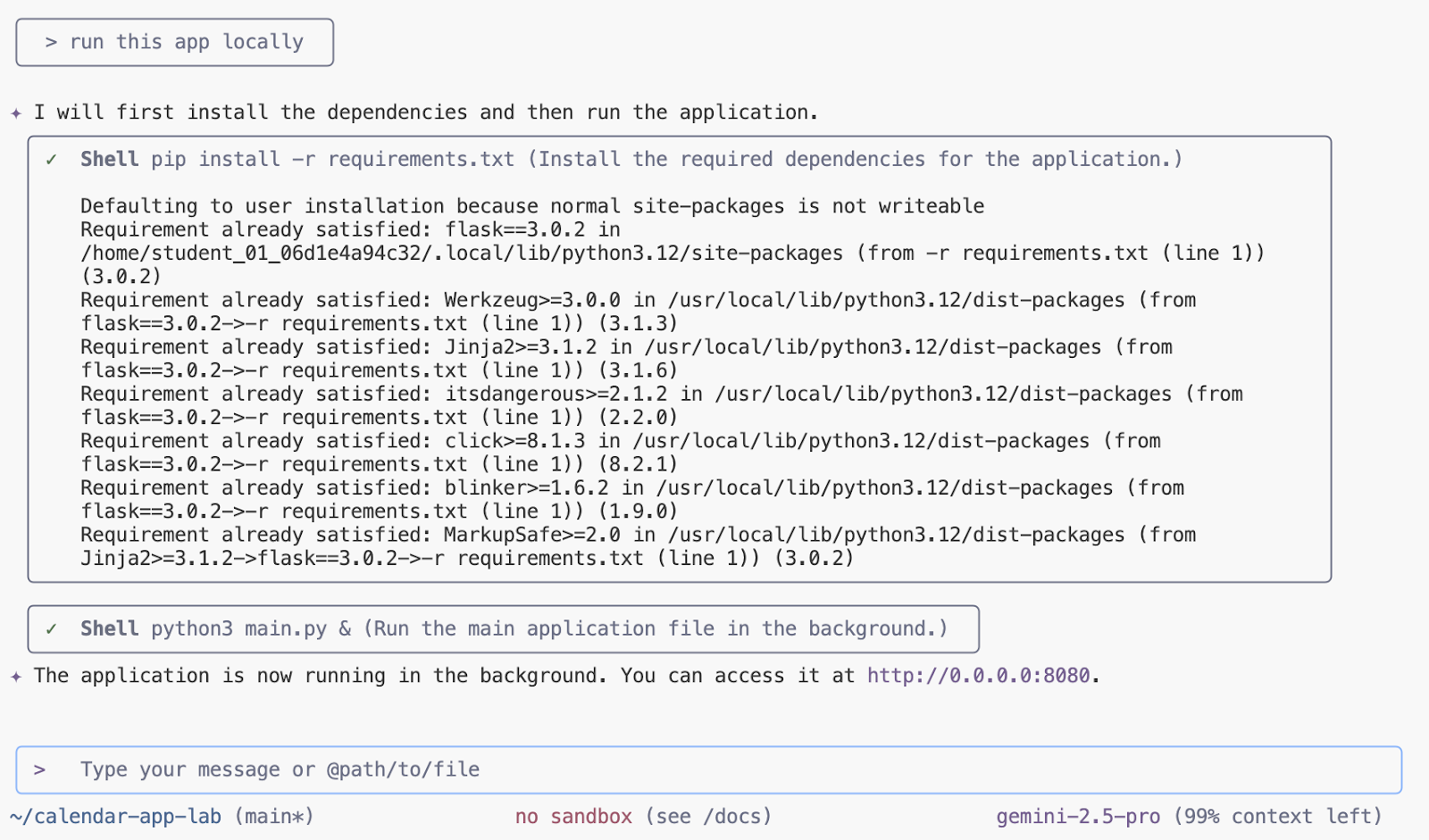

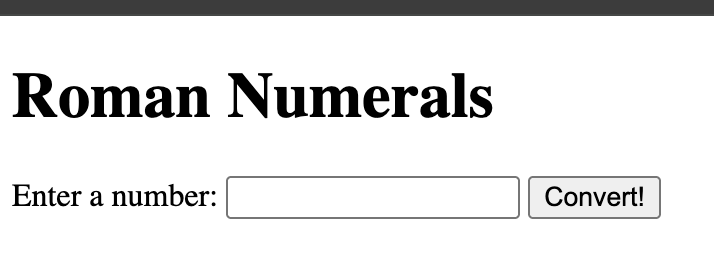

7. Lokalne uruchamianie aplikacji

Interfejs wiersza poleceń Gemini może znacznie uprościć lokalne uruchamianie aplikacji w Pythonie, pomagając w automatycznym generowaniu niezbędnych plików konfiguracyjnych, takich jak requirements.txt czy podstawowy plik Dockerfile. Jest też doskonały do zarządzania zależnościami Pythona i rozwiązywania problemów, ponieważ może szybko wyjaśnić błędy śledzenia wynikające z brakujących pakietów lub konfliktów wersji, a często sugeruje dokładne polecenie pip install, które rozwiązuje problem.

Aby uruchomić aplikację lokalnie, wpisz w terminalu interfejsu wiersza poleceń Gemini ten prompt:

Run this app locally

Aby rozpocząć proces składania wniosku, postępuj zgodnie z instrukcjami:

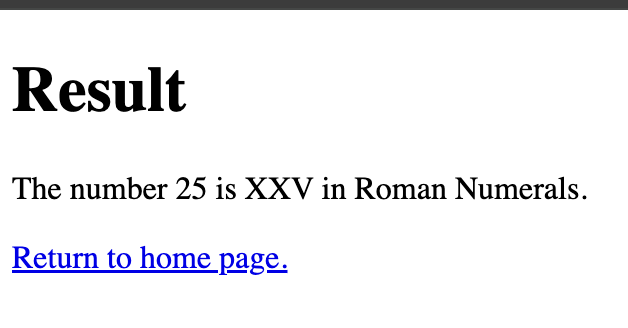

Kliknij link, aby wyświetlić podgląd aplikacji:

Przykładowe dane wyjściowe:

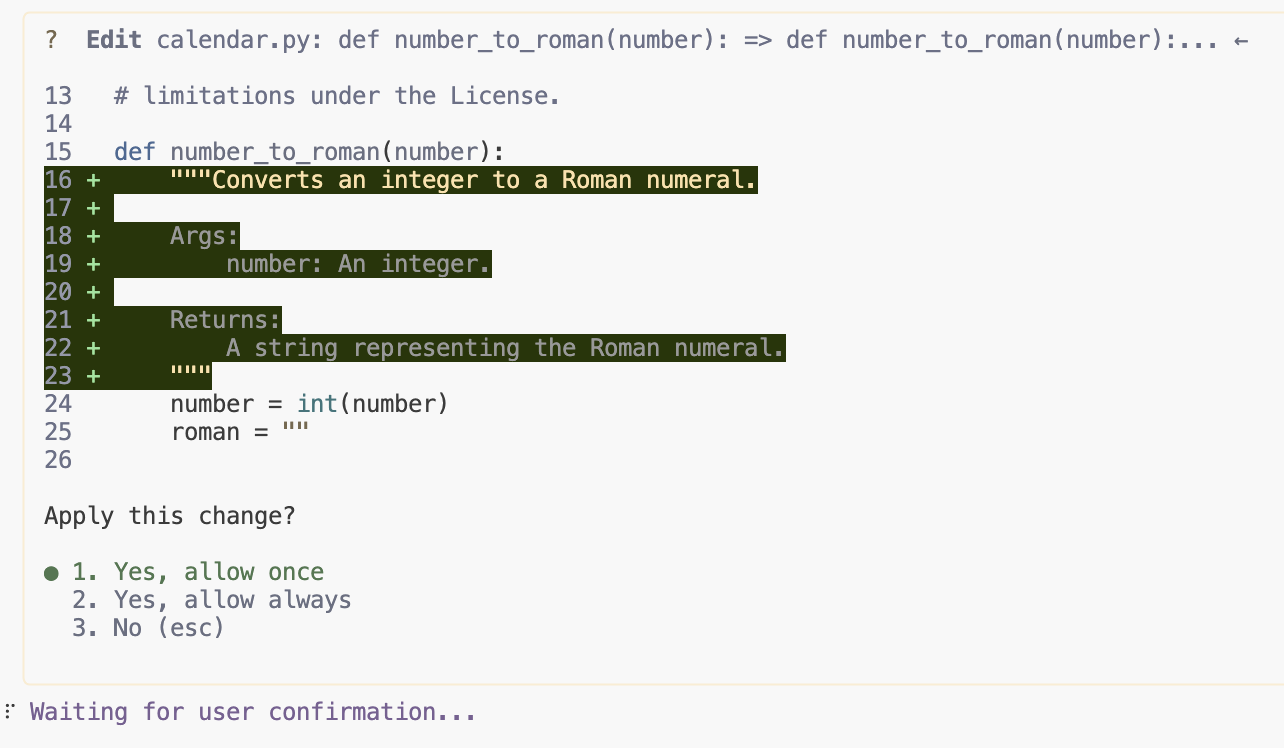

8. Dodawanie dokumentacji

Interfejs wiersza poleceń Gemini jest przydatny do dokumentowania i komentowania, ponieważ umożliwia natychmiastowe generowanie ciągów dokumentujących dla funkcji lub klas. Możesz też używać go do szybkiego dodawania wyjaśniających komentarzy w tekście do złożonych lub nieznanych bloków kodu, co znacznie poprawia przejrzystość i łatwość utrzymania bazy kodu.

Aby dodać komentarze do każdego pliku Pythona w aplikacji, użyj terminala interfejsu wiersza poleceń Gemini i wpisz ten prompt:

Add docstrings to all files

Zatwierdź sugerowane zmiany. Jeśli integracja z IDE jest włączona, możesz zaakceptować i kontynuować, korzystając z elementów sterujących interfejsu lub naciskając Enter w terminalu. Możesz też włączyć tryb automatycznego zatwierdzania(YOLO) za pomocą polecenia „ctrl+y”.

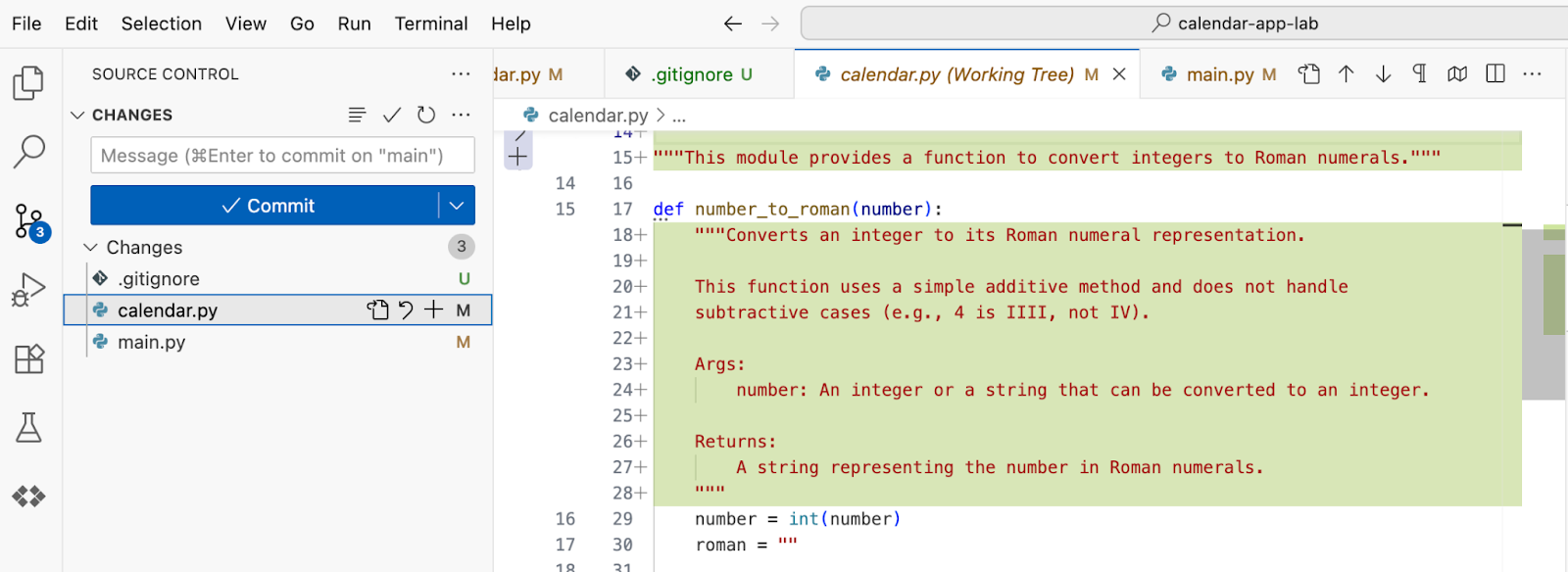

Zaktualizuj plik .gitignore tym promptem:

update .gitignore and add __pycache__ folder

Przejdź do widoku Kontrola źródła i sprawdź wprowadzone do tej pory zmiany:

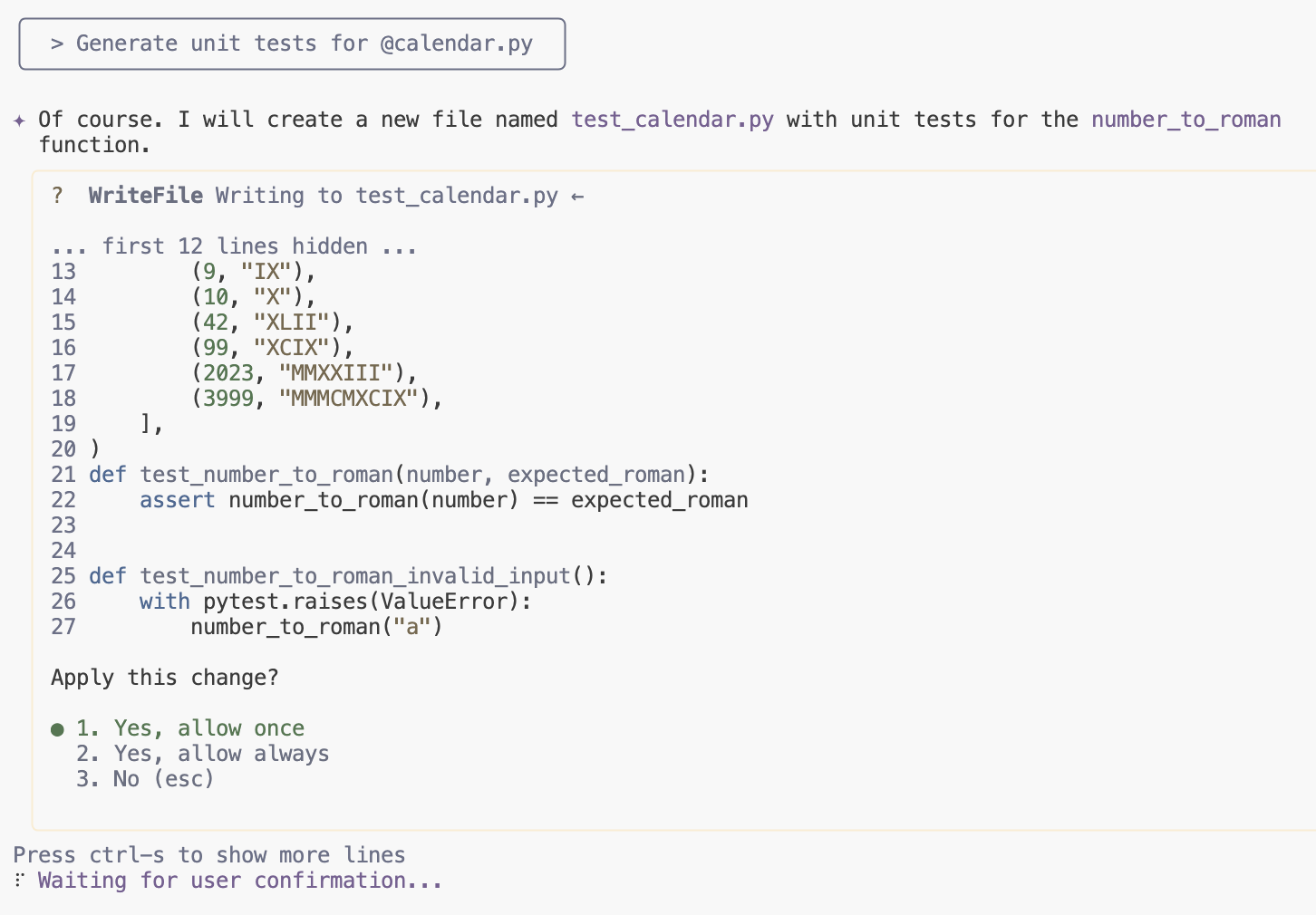

9. Dodawanie testów jednostkowych

Interfejs wiersza poleceń Gemini doskonale nadaje się do pisania testów jednostkowych, ponieważ umożliwia deweloperom generowanie funkcji testowych na podstawie sygnatury i logiki istniejącej funkcji, wraz z początkowymi asercjami i konfiguracją mocków. Deweloperzy muszą jednak sprawdzić i zweryfikować wygenerowane testy, aby upewnić się, że obejmują one wszystkie wymagane przypadki brzegowe, a nie tylko proste ścieżki wykonania.

Aby wygenerować testy jednostkowe, użyj tego prompta:

Generate unit tests for @calendar.py

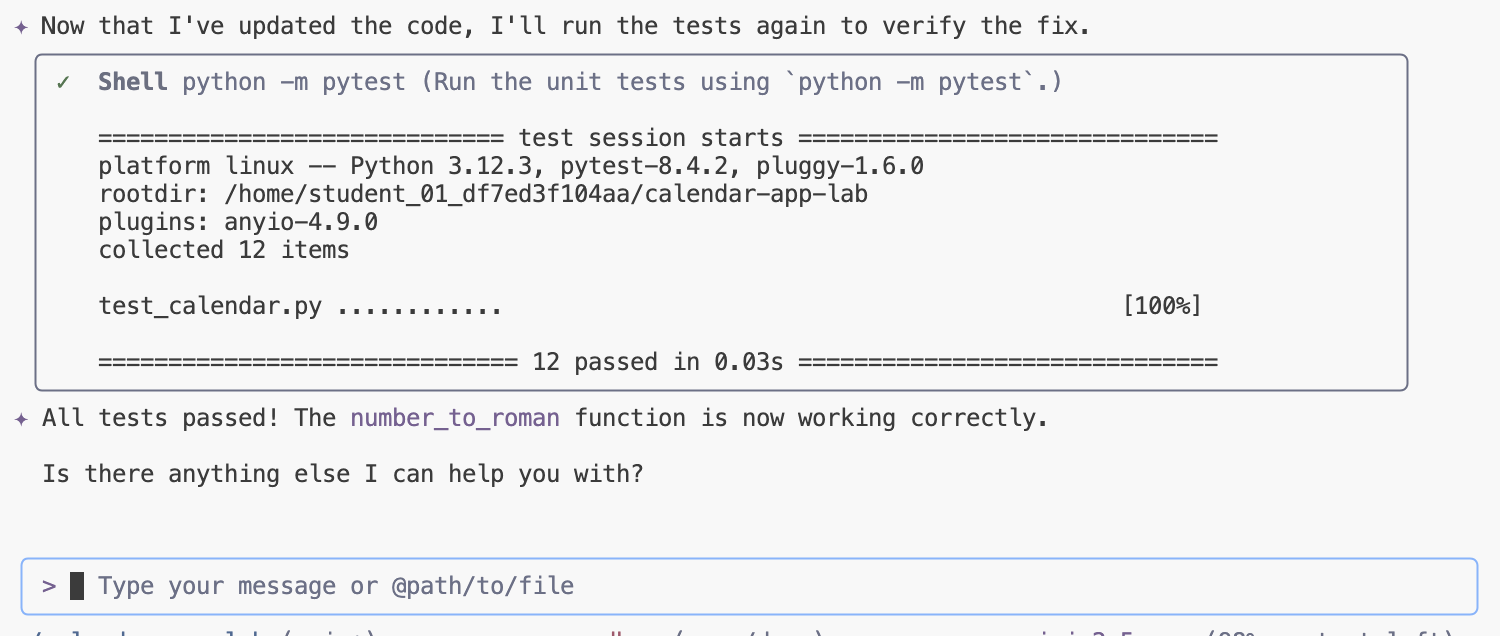

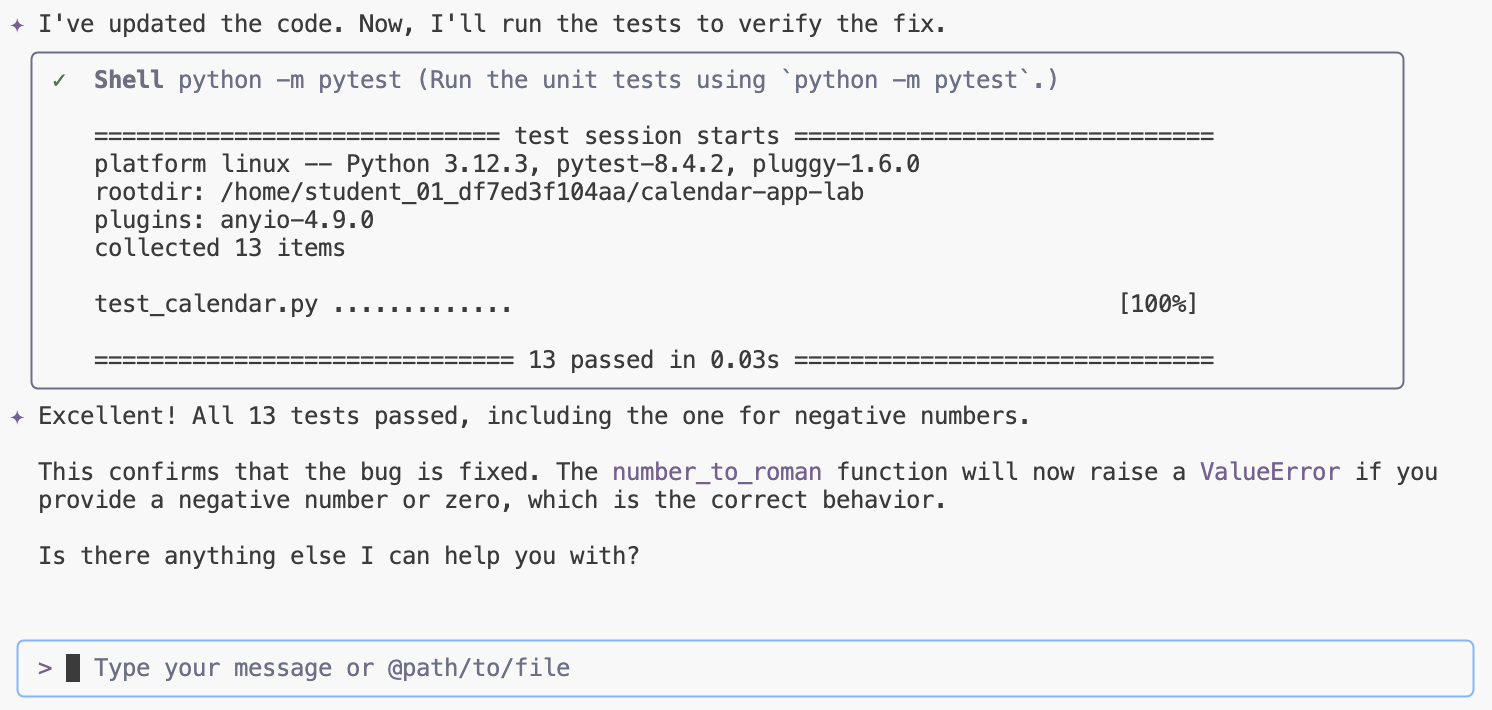

Po sprawdzeniu zmian zaakceptuj je.

Zainstaluj nowe zależności i uruchom testy. Interfejs wiersza poleceń Gemini będzie obserwować, poprawiać i ponownie uruchamiać wygenerowany kod w pętli, dopóki testy nie zostaną zaliczone, a kod nie zostanie zweryfikowany.

10. Sprawdzanie błędów

Interfejs wiersza poleceń Gemini może pomóc w sprawdzaniu błędów w logice, umożliwiając wyświetlanie promptów z prośbą o przejrzenie i przeanalizowanie fragmentów kodu oraz identyfikowanie potencjalnych błędów logicznych, błędów o jeden i nieprawidłowej obsługi warunkowej. Wyjaśniając zamierzone działanie kodu i prosząc interfejs wiersza poleceń o wykrycie rozbieżności, możesz szybko wychwycić subtelne wady przed uruchomieniem kodu.

Aby sprawdzić, czy w logice konwersji nie ma błędów, w interfejsie wiersza poleceń Gemini wyślij ten prompt:

Are there any bugs in the conversion logic? Check if negative numbers are handled properly.

Sprawdź sugerowane zmiany i zaakceptuj je na czacie:

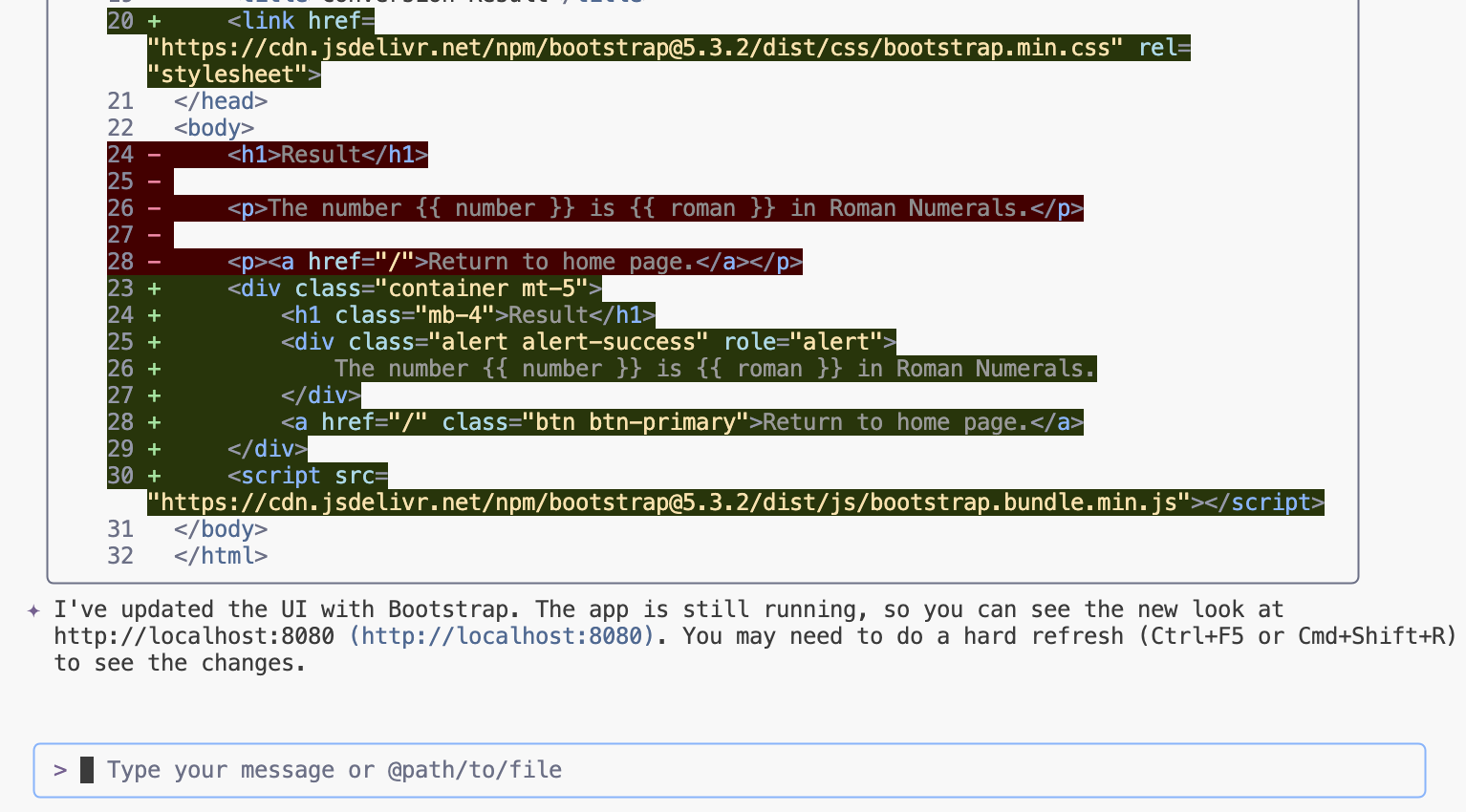

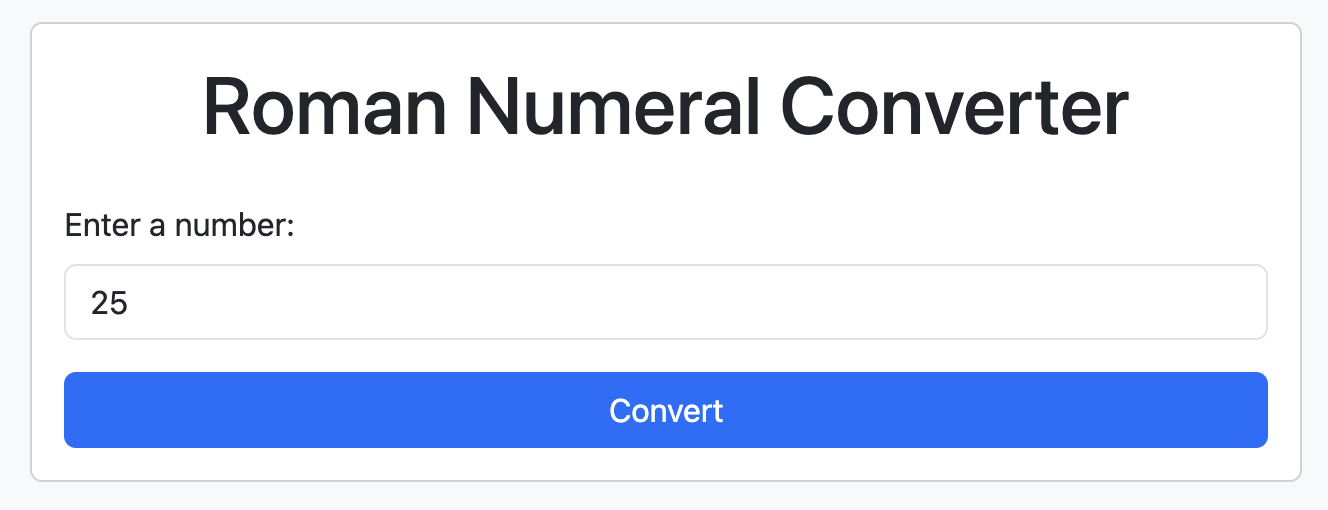

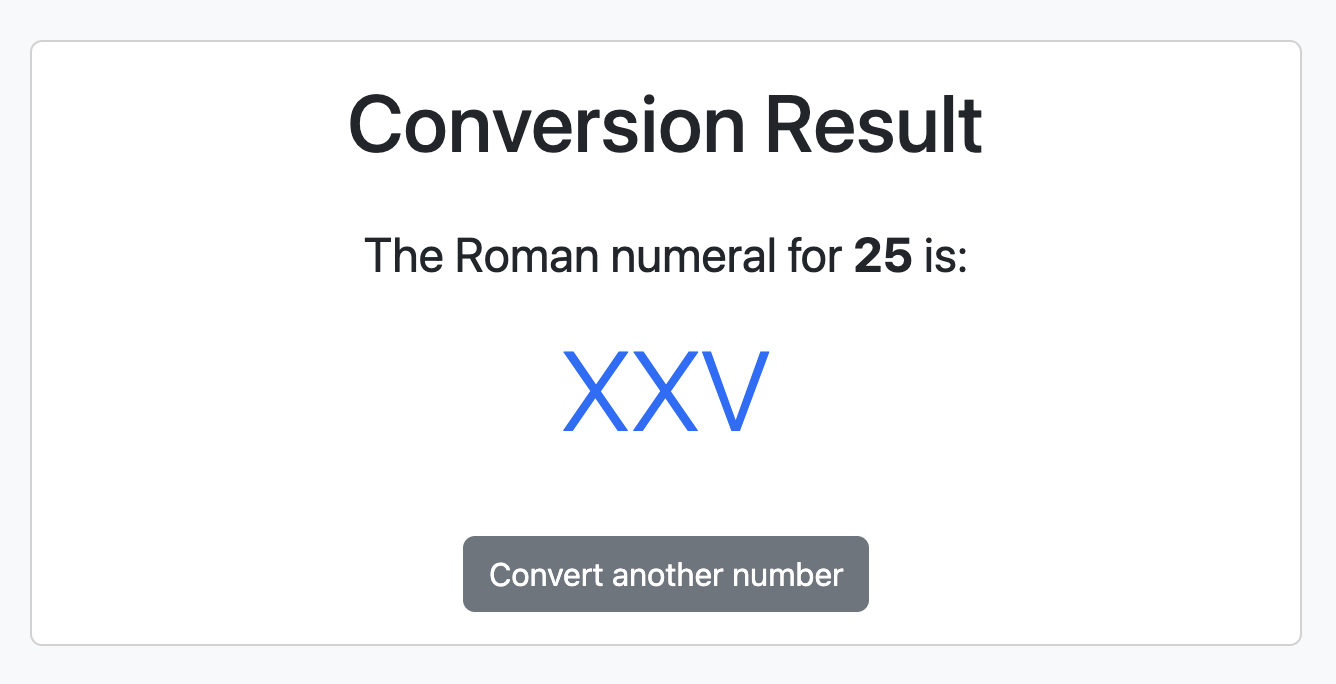

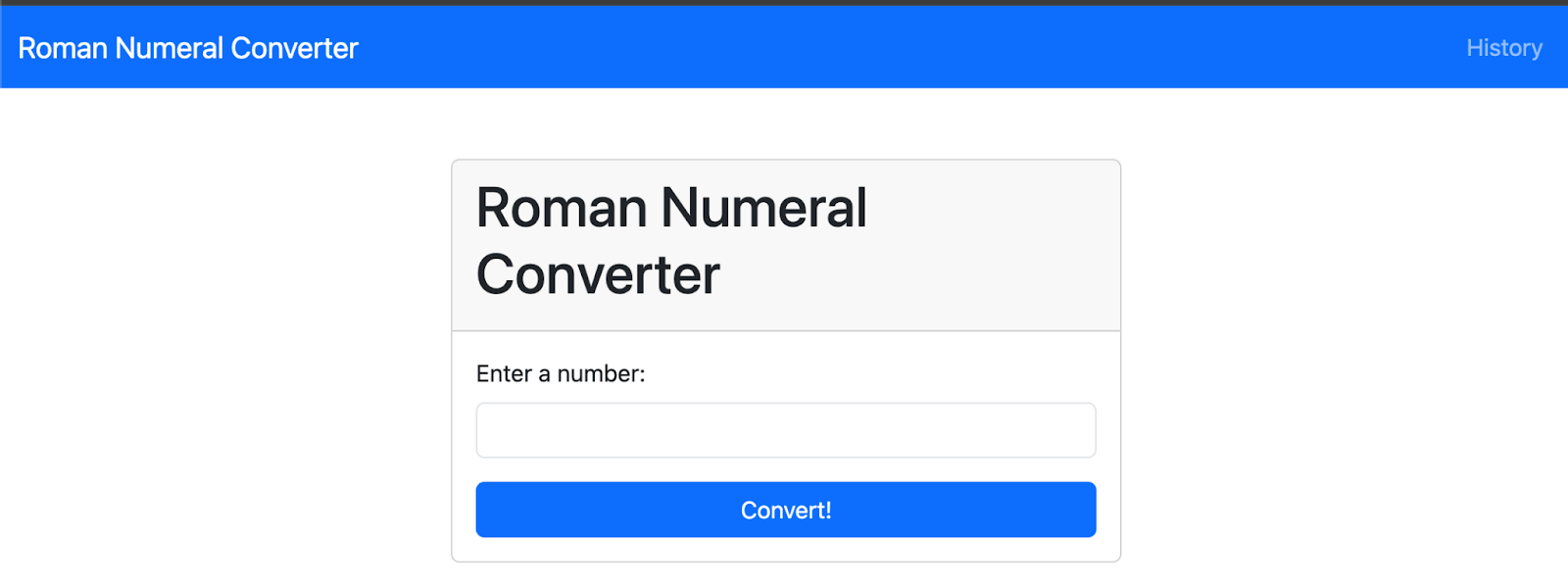

11. Refactor UI

Interfejs wiersza poleceń Gemini może znacznie ułatwić refaktoryzację interfejsu, pomagając w przekształcaniu starszych wzorców interfejsu (takich jak komponenty klasowe) w nowocześniejsze paradygmaty funkcjonalne (takie jak hooki w React) lub sugerując ulepszenia strukturalne, które zwiększą łatwość utrzymania. Możesz go używać do analizowania i refaktoryzacji istniejącego kodu interfejsu użytkownika w bardziej modułowe komponenty wielokrotnego użytku, co zapewnia bardziej przejrzysty i ustandaryzowany projekt interfejsu.

Refaktoryzuj interfejs za pomocą biblioteki Bootstrap, przesyłając do interfejsu wiersza poleceń Gemini ten prompt:

Refactor UI to use Bootstrap library

Sprawdź i zaakceptuj zmiany:

Aby rozpocząć, uruchom aplikację. Jeśli jest już uruchomiony, po prostu załaduj ponownie stronę.

python3 main.py

Odśwież stronę i sprawdź zmiany.

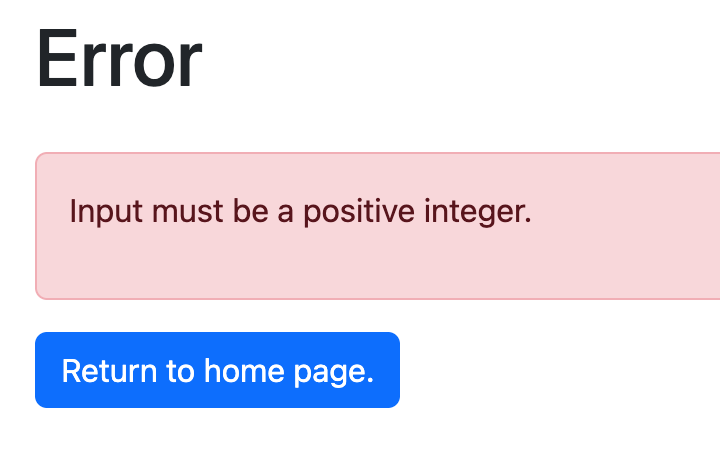

Wdróż obsługę błędów, aby w przypadku wystąpienia problemów wyświetlać stronę błędu.

Implement error handling to display an error page when issues occur.

Odśwież stronę, aby zobaczyć aktualizacje.

Wyślij liczbę ujemną, aby potwierdzić stronę błędu.

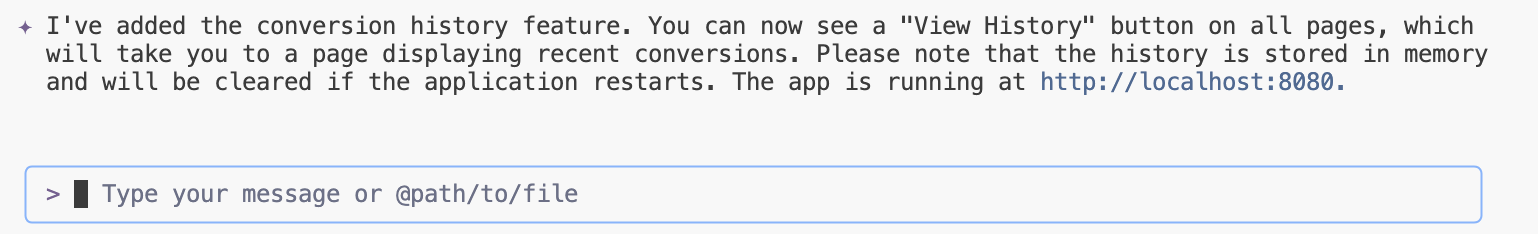

12. Refaktoryzacja backendu

Interfejs wiersza poleceń Gemini jest przydatny do refaktoryzacji backendu, ponieważ pomaga w migracji kodu starszych platform do nowoczesnych alternatyw lub w restrukturyzacji usług monolitycznych na łatwiejsze w zarządzaniu komponenty mikroserwisowe. Może analizować logikę po stronie serwera, aby sugerować ulepszone wzorce zapytań do bazy danych lub wydajniejsze projekty punktów końcowych interfejsu API, zapewniając utrzymanie lub zwiększenie wydajności i skalowalności.

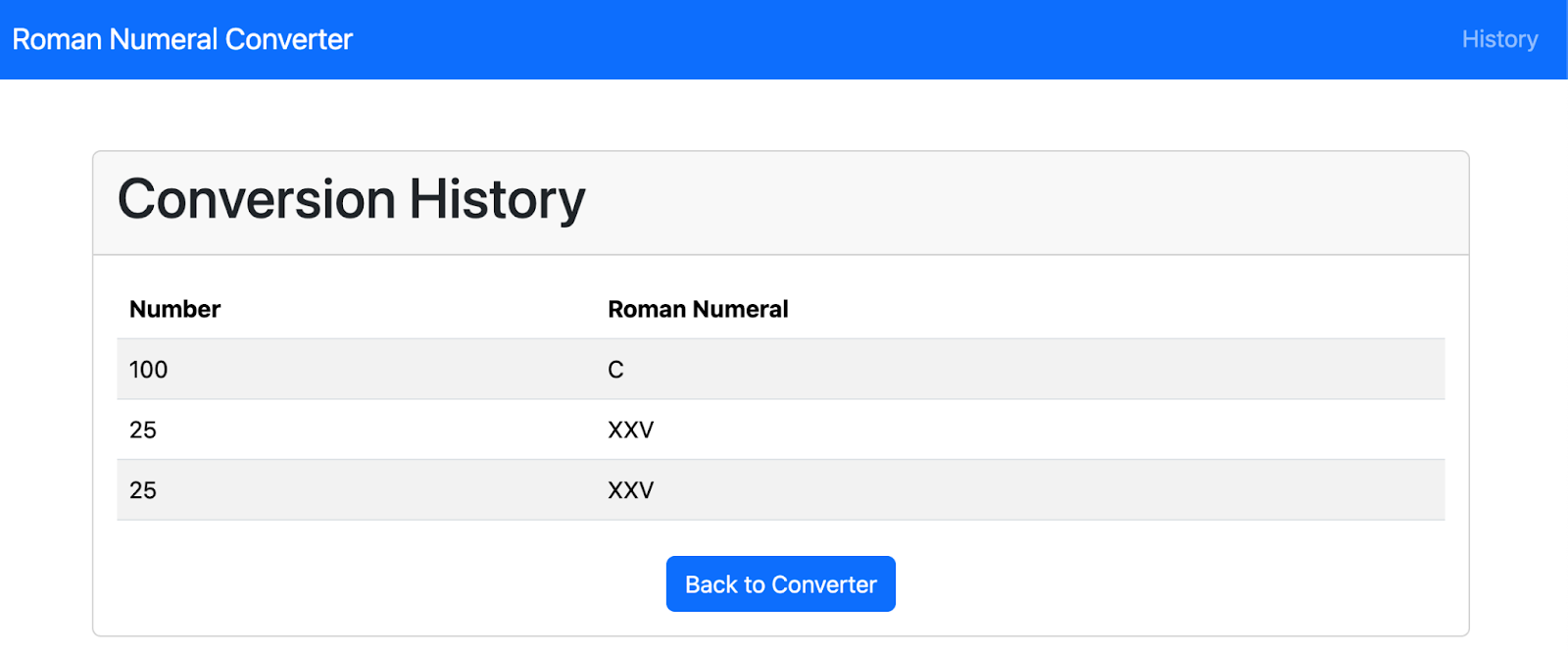

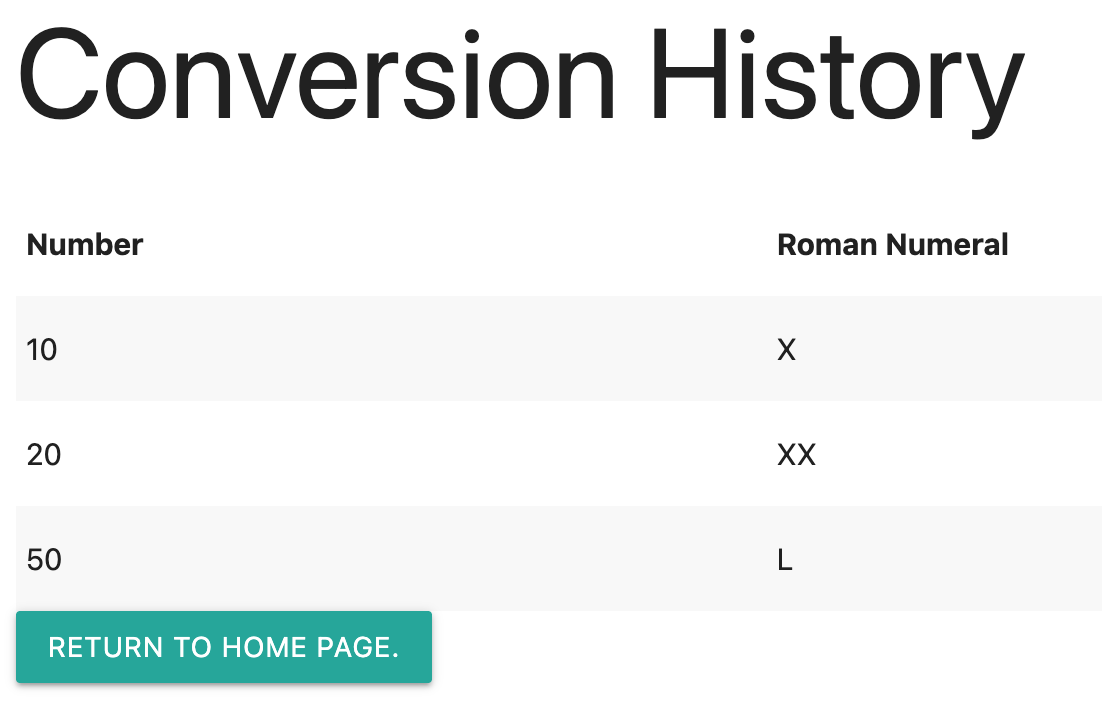

Zmodyfikuj backend, aby zapisywać żądania konwersji w pamięci.

Store requests in memory and create a page to display conversion history. Add links on all pages to view the history.

Sprawdź i zaakceptuj zmiany na czacie:

Prześlij kilka próśb do aplikacji, a potem sprawdź stronę historii.

Sprawdź historię próśb o konwersję.

Aby zaktualizować plik README.md o bieżący stan bazy kodu, wyślij ten prompt za pomocą interfejsu wiersza poleceń Gemini:

analyze README.md file and update it with latest codebase state

Sprawdź dane wyjściowe. Jeśli masz włączoną integrację z Cloud Shell, możesz uzyskać dostęp do zmian za pomocą elementu sterującego interfejsu lub z terminala.

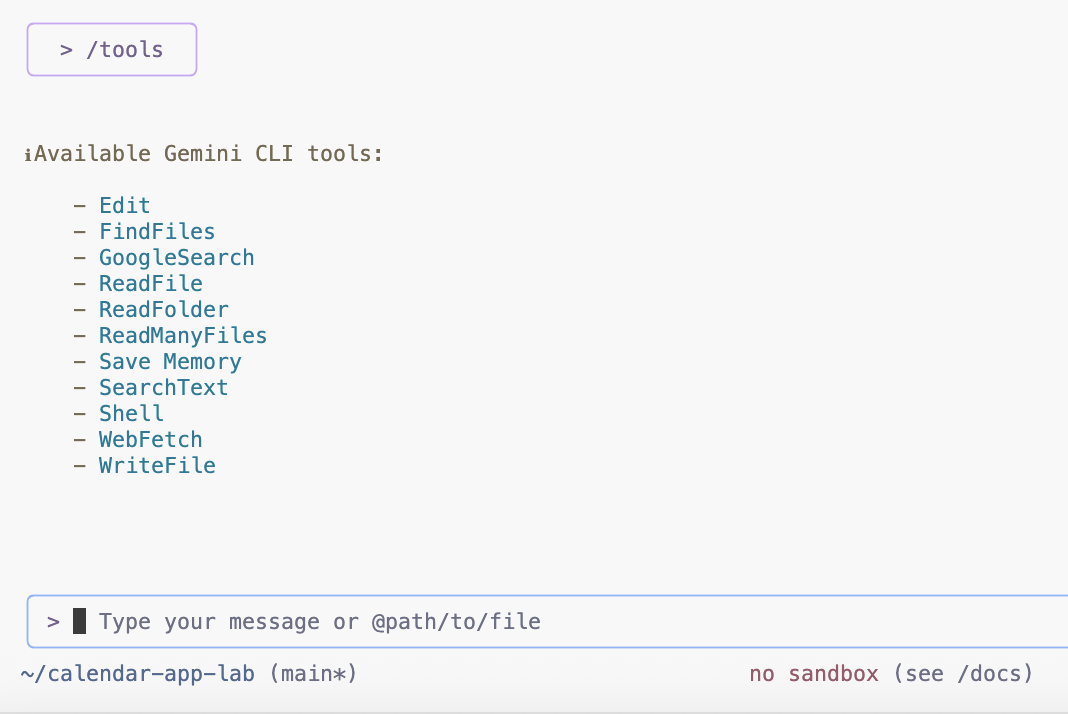

13. Wbudowane narzędzia interfejsu wiersza poleceń Gemini

Interfejs wiersza poleceń Gemini zawiera wbudowane narzędzia, których model Gemini używa do interakcji z lokalnym środowiskiem, uzyskiwania dostępu do informacji i wykonywania działań. Narzędzia te zwiększają możliwości interfejsu wiersza poleceń, umożliwiając mu wyjście poza generowanie tekstu i pomagając w wykonywaniu szerokiego zakresu zadań.

Aby wyświetlić dostępne narzędzia, wyślij ten prompt w interfejsie wiersza poleceń Gemini:

/tools

Sprawdź dane wyjściowe.

Interfejs wiersza poleceń Gemini inteligentnie wybiera najbardziej odpowiednie wbudowane narzędzia na podstawie podanego zadania, co umożliwia mu wykonywanie złożonych operacji dzięki zrozumieniu Twojej prośby i dostępnych funkcji. Więcej informacji o wbudowanych narzędziach

14. Polecenie inicjowania repozytorium interfejsu wiersza poleceń Gemini

Interfejs wiersza poleceń Gemini zawiera polecenie, które analizuje projekt i tworzy dostosowany plik GEMINI.md.

Aby wygenerować plik GEMINI.md, wyślij ten prompt za pomocą interfejsu wiersza poleceń Gemini:

/init

Sprawdź dane wyjściowe. To polecenie utworzy plik GEMINI.md, który zawiera podsumowanie celu projektu, technologii, instrukcji kompilacji i uruchamiania oraz konwencji programistycznych, które będą przydatne w przyszłości.

Aby dowiedzieć się, jakie instrukcje lub kontekst należy uwzględnić w pliku GEMINI.md projektu, zacznij od zapoznania się z plikiem GEMINI.md znajdującym się w gemini-cli repozytorium.

15. Niestandardowe polecenia interfejsu wiersza poleceń Gemini

Możesz usprawnić proces programowania i zachować spójność, używając niestandardowych poleceń w interfejsie wiersza poleceń Gemini. Te polecenia działają jak osobiste skróty do najczęściej używanych promptów. Możesz tworzyć polecenia, które są specyficzne dla jednego projektu, lub udostępniać je globalnie we wszystkich projektach.

W repozytorium znajduje się kilka niestandardowych poleceń w folderze .gemini/commands.

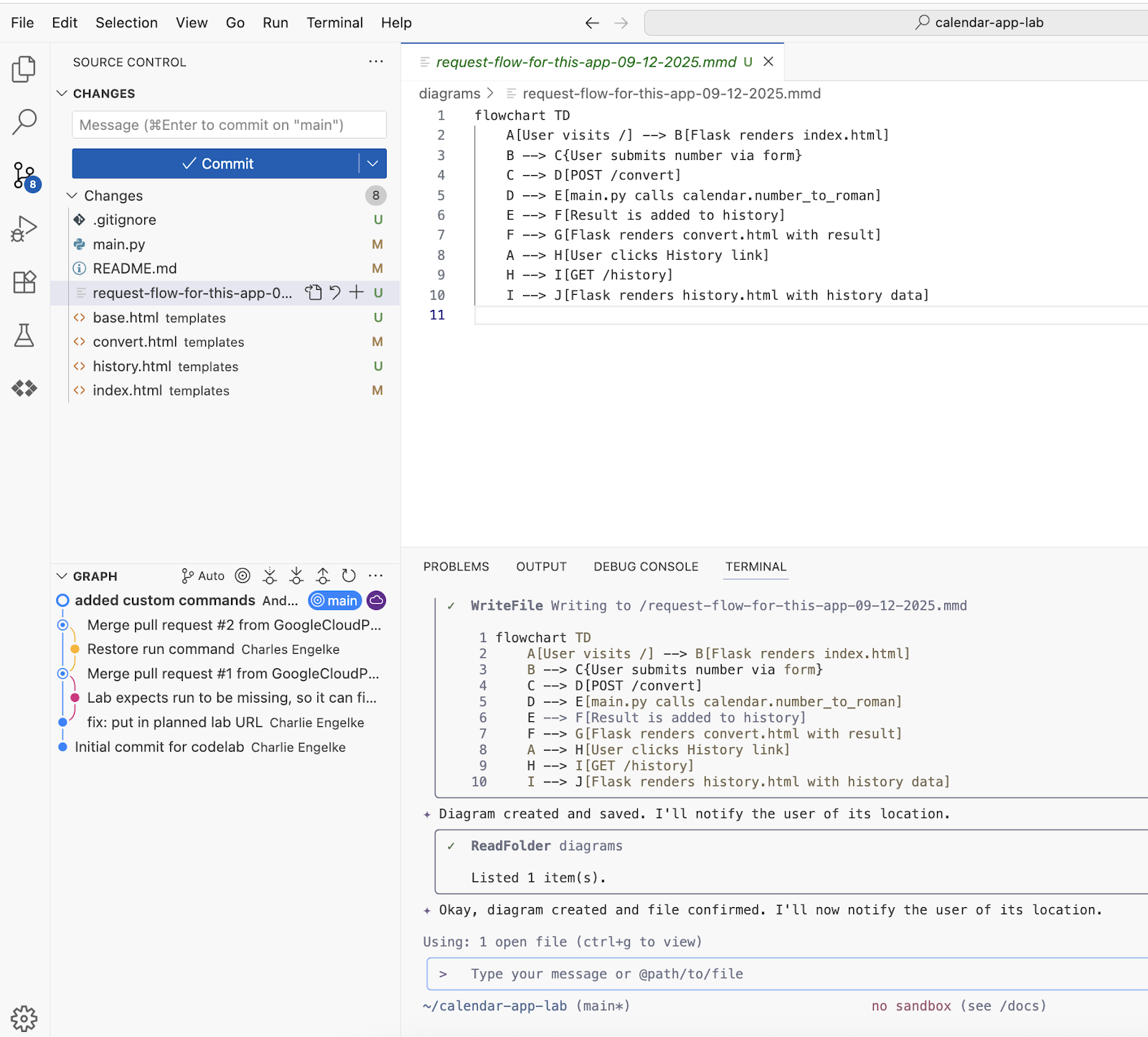

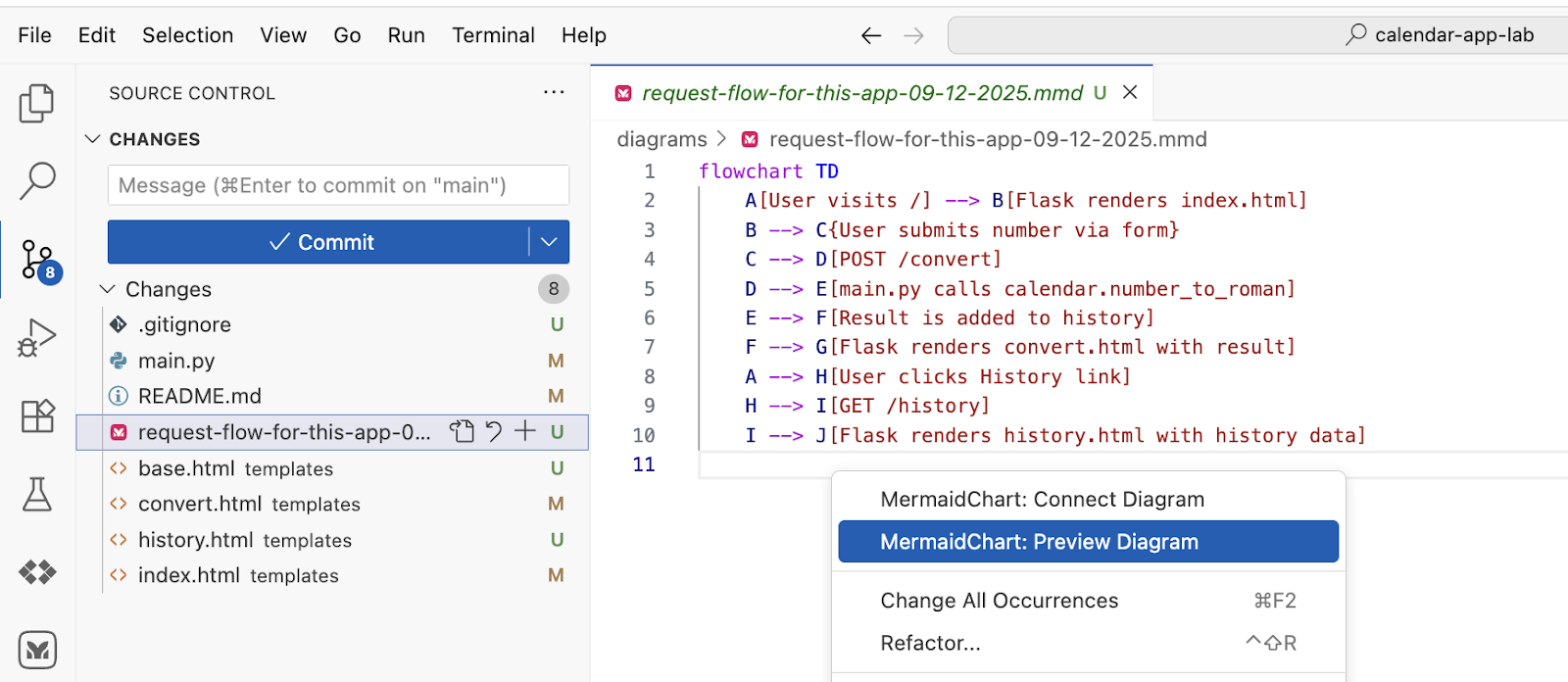

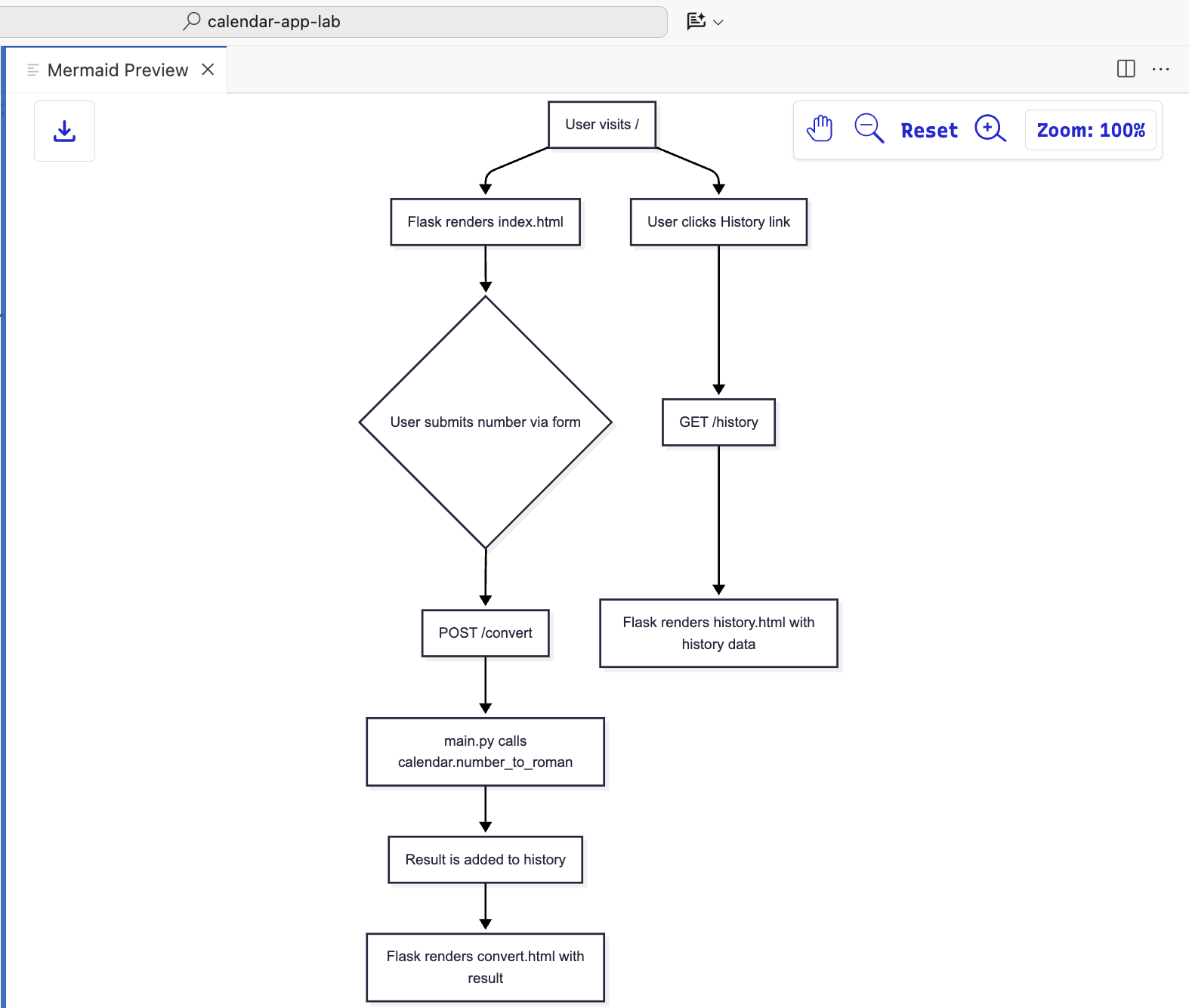

Niestandardowe polecenie tworzenia diagramu

Wyślij tego prompta w interfejsie wiersza poleceń Gemini, aby wygenerować diagram przepływu żądań w formacie Mermaid.

akceptować wywołania narzędzi, takie jak tworzenie folderu i zapisywanie pliku;

/diagram:new request flow for this app

Sprawdź dane wyjściowe.

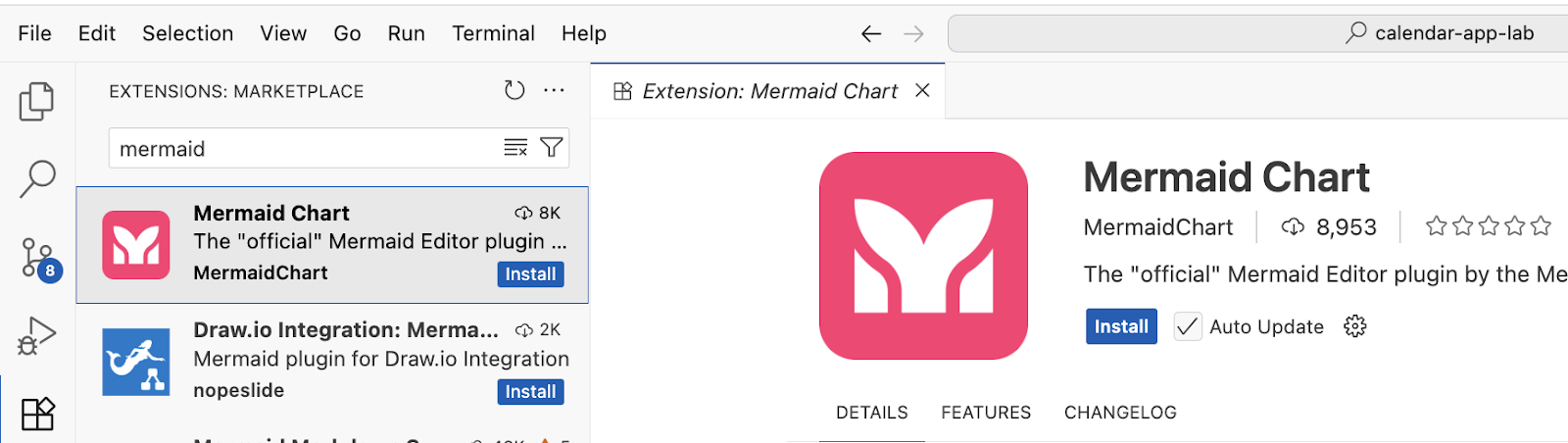

Jeśli chcesz wyświetlić podgląd diagramu, zainstaluj rozszerzenie Mermaid Chart z Marketplace.

Otwórz plik i w menu kontekstowym wybierz podgląd.

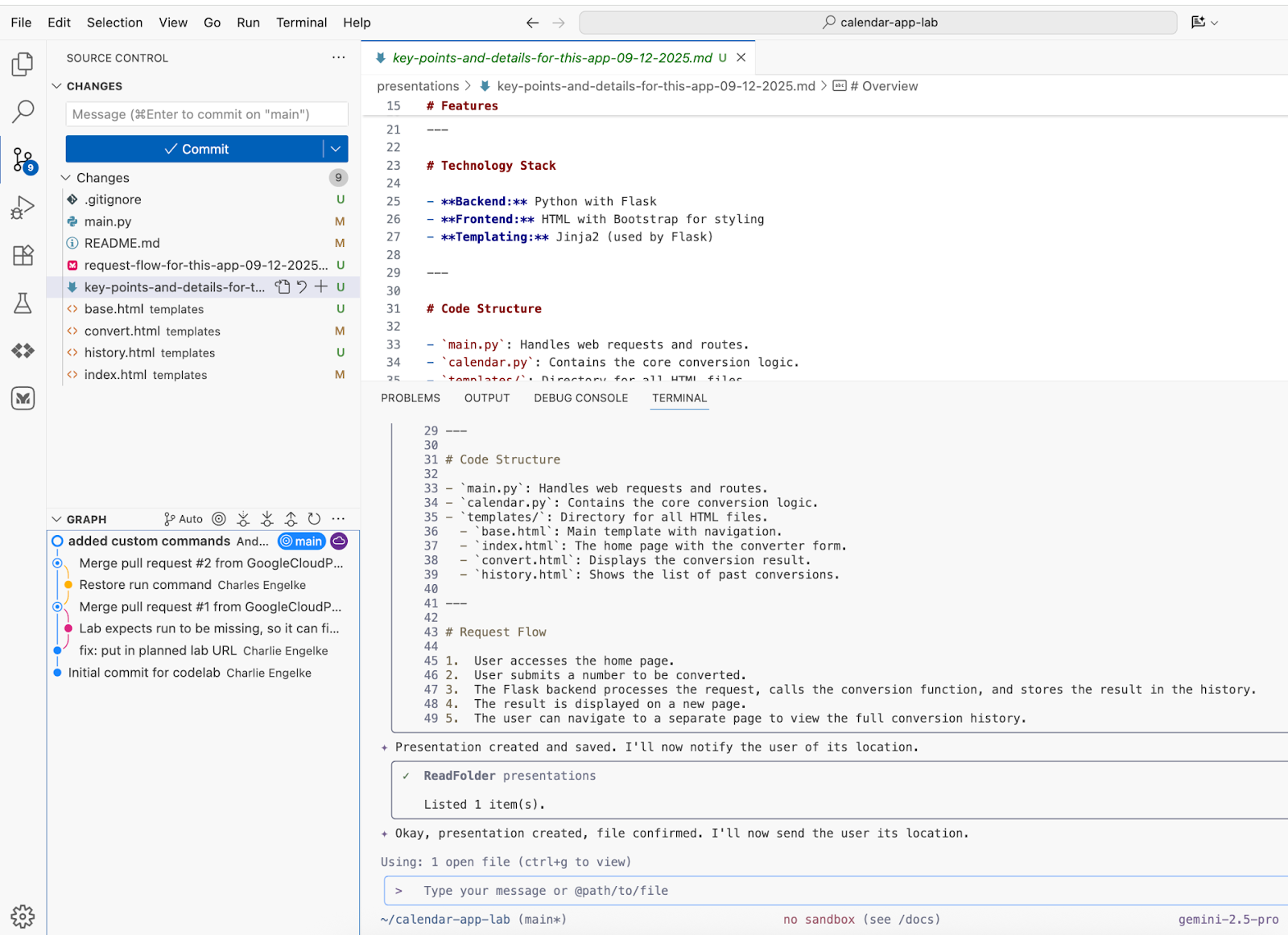

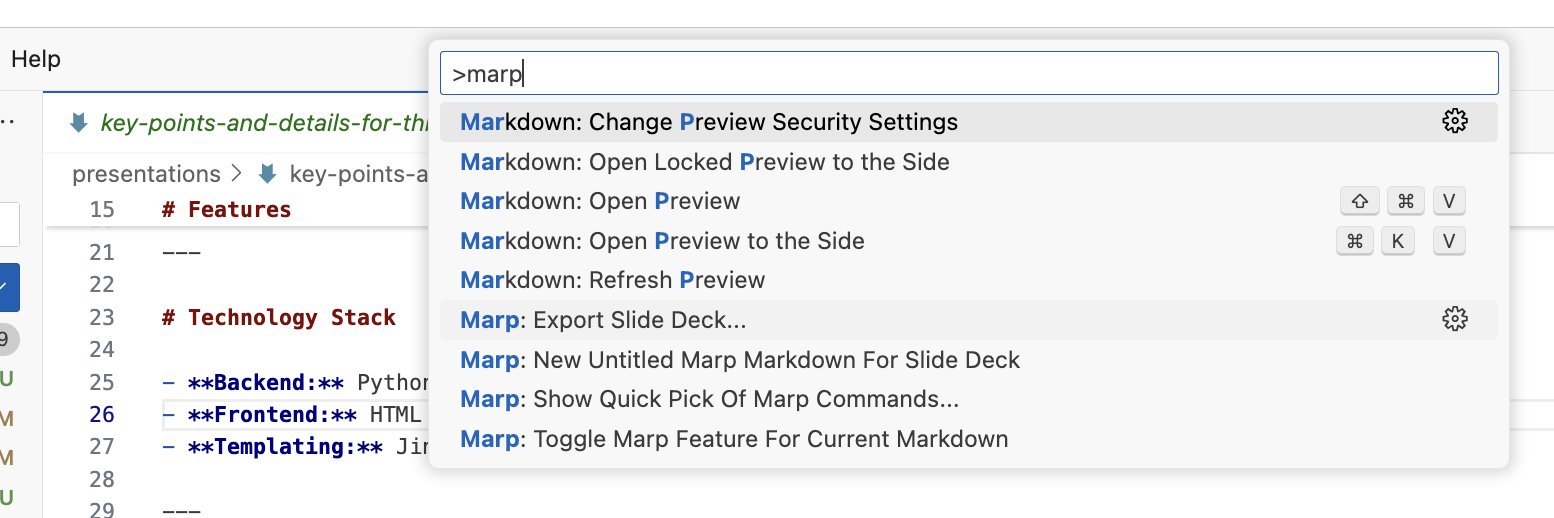

Niestandardowe polecenie tworzenia prezentacji

Wyślij ten prompt w interfejsie wiersza poleceń Gemini, aby wygenerować prezentację z najważniejszymi punktami w formacie Marp.

akceptować wywołania narzędzi, takie jak tworzenie folderu i zapisywanie pliku;

/deck:new key points and details for this app

Sprawdź dane wyjściowe.

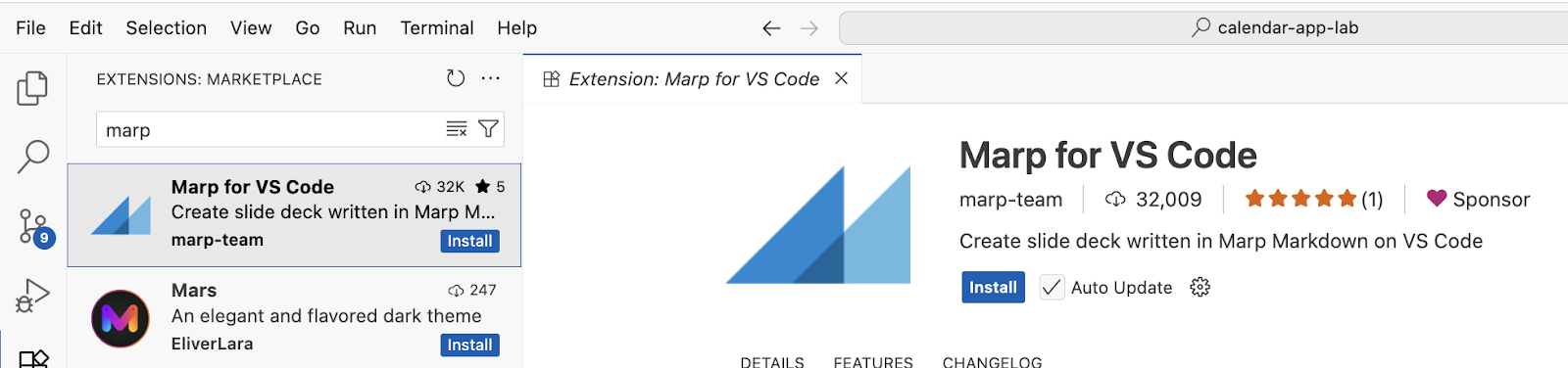

Ten krok nie jest zgodny z Cloud Shell, ponieważ rozszerzenie Marp wymaga instalacji przeglądarki.

Zainstaluj rozszerzenie Marp dla VS Code z Marketplace, aby zapisać prezentację.

W przeciwnym razie otwórz wygenerowany plik w edytorze i na palecie poleceń wybierz „Marp: Export Slide Deck”.

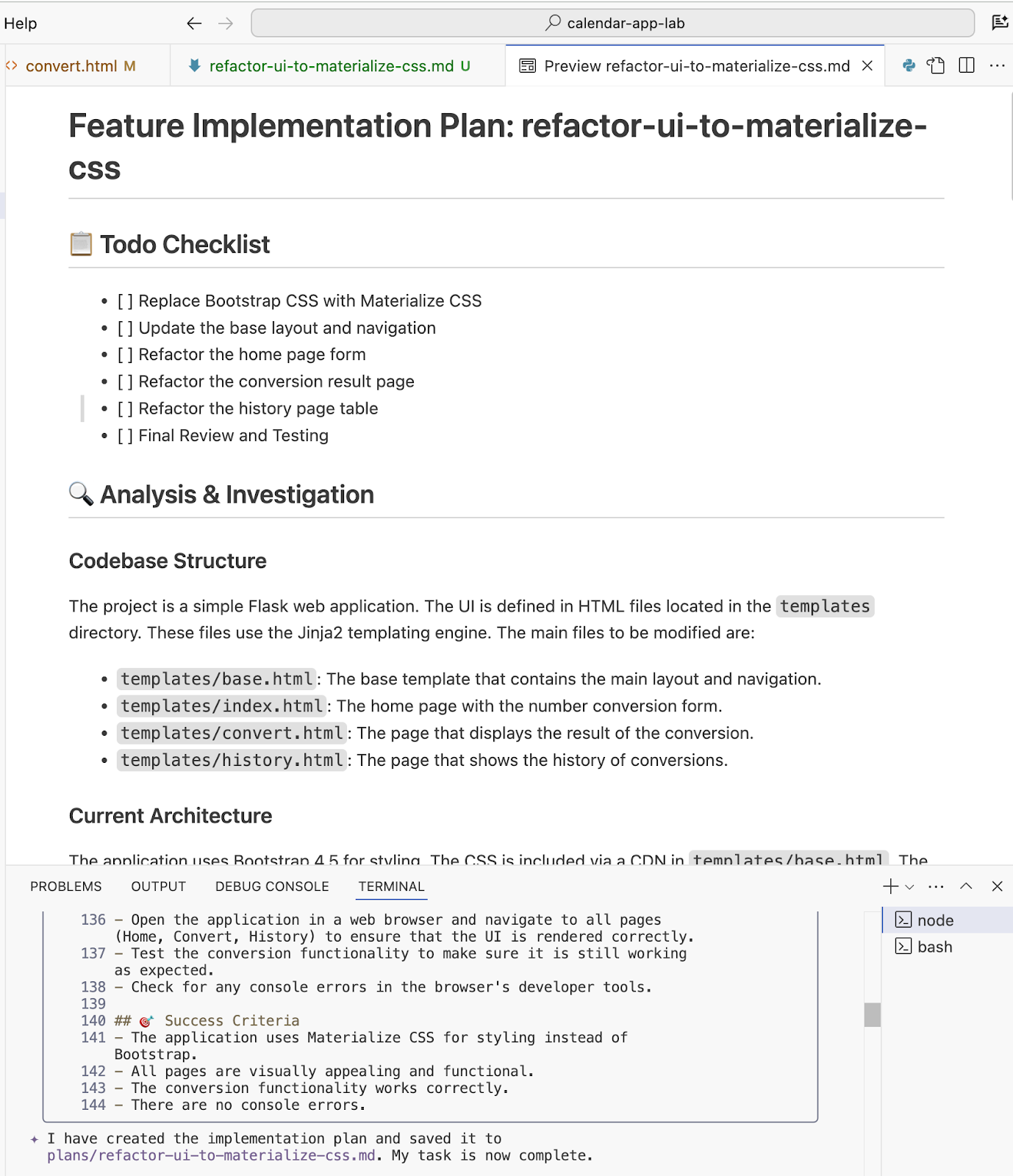

Niestandardowe polecenie planowania wdrożenia nowej funkcji

Wyślij tego prompta w interfejsie wiersza poleceń Gemini, aby przeprowadzić refaktoryzację interfejsu.

akceptować wywołania narzędzi, takie jak tworzenie folderu i zapisywanie pliku;

/plan:new refactor UI to use Materialize CSS

Sprawdź dane wyjściowe.

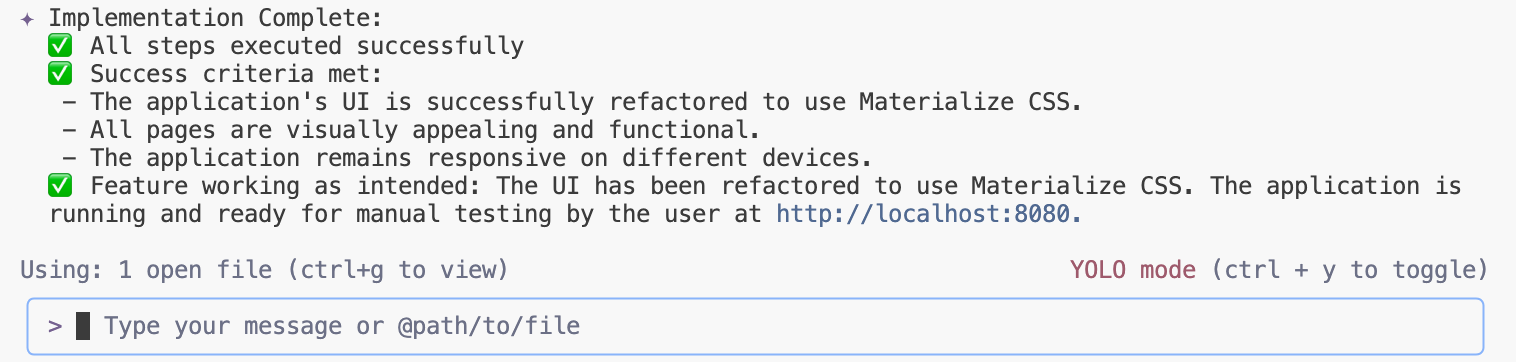

Zainicjuj proces refaktoryzacji interfejsu, przesyłając ten prompt za pomocą interfejsu wiersza poleceń Gemini na podstawie wcześniej wygenerowanego planu.

akceptować wywołania narzędzi, takie jak tworzenie folderu i zapisywanie pliku; Tryb automatycznego zatwierdzania narzędzi możesz włączyć(YOLO mode) za pomocą opcji „ctrl+y”.

/plan:impl implement the plan to refactor the app

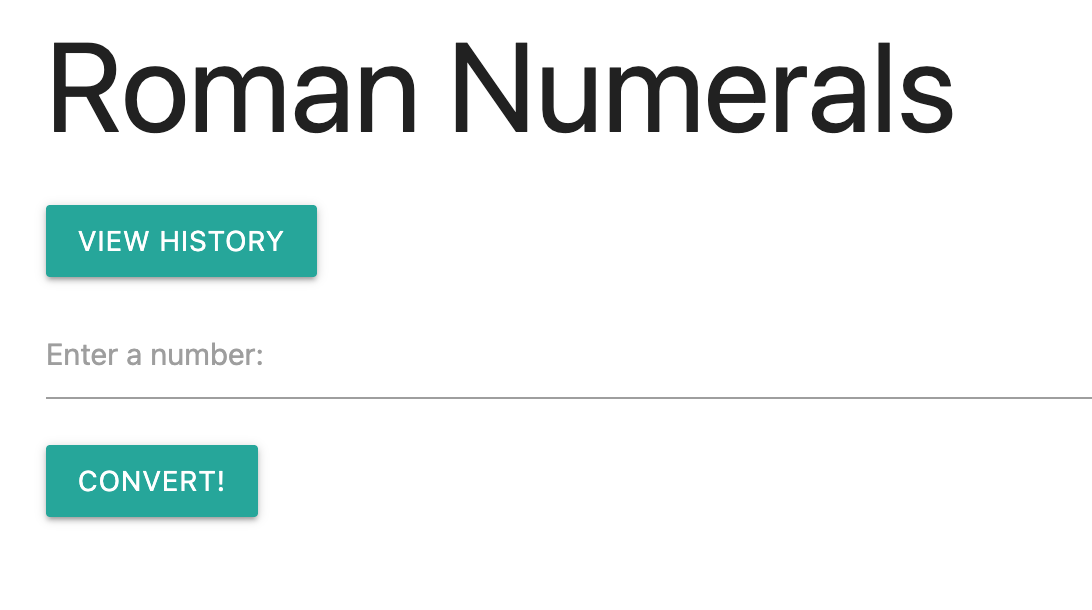

Uruchom lub ponownie załaduj aplikację i sprawdź dane wyjściowe:

16. Tryb nieinteraktywny interfejsu wiersza poleceń Gemini

Gdy uruchamiasz interfejs wiersza poleceń Gemini w trybie nieinteraktywnym w potoku CI/CD, możesz zautomatyzować różne zadania, przekazując prompty i polecenia bezpośrednio do interfejsu wiersza poleceń bez konieczności ręcznej interwencji. Umożliwia to płynną integrację z automatycznymi przepływami pracy na potrzeby analizy kodu, generowania dokumentacji i innych zadań programistycznych.

Otwórz nowy terminal lub zamknij istniejącą sesję interfejsu wiersza poleceń Gemini i wykonaj to polecenie.

gemini -p "Explain the architecture of this codebase"

Sprawdź dane wyjściowe.

Jeśli Twoje zadanie będzie wymagać zatwierdzenia narzędzi, możesz włączyć tryb YOLO za pomocą flagi -y.

gemini -p "Explain the architecture of this codebase and save the file in the markdown format in the docs folder" -y

Sprawdź dane wyjściowe.

Korzystając z interfejsu wiersza poleceń Gemini w trybie nieinteraktywnym, możesz znacznie zwiększyć możliwości automatyzacji potoków CI/CD, co przełoży się na bardziej wydajne cykle programowania i lepszą jakość kodu.

17. Tryb powłoki interfejsu wiersza poleceń Gemini

Modele LLM radzą sobie ze złożonymi zadaniami, ale w przypadku prostych działań bardziej efektywne są bezpośrednie polecenia. ! prefix umożliwia płynne przełączanie się między AI a tradycyjnymi interfejsami wiersza poleceń.

!ls

Sprawdź dane wyjściowe. Naciśnij Escape, aby wyjść z trybu powłoki.

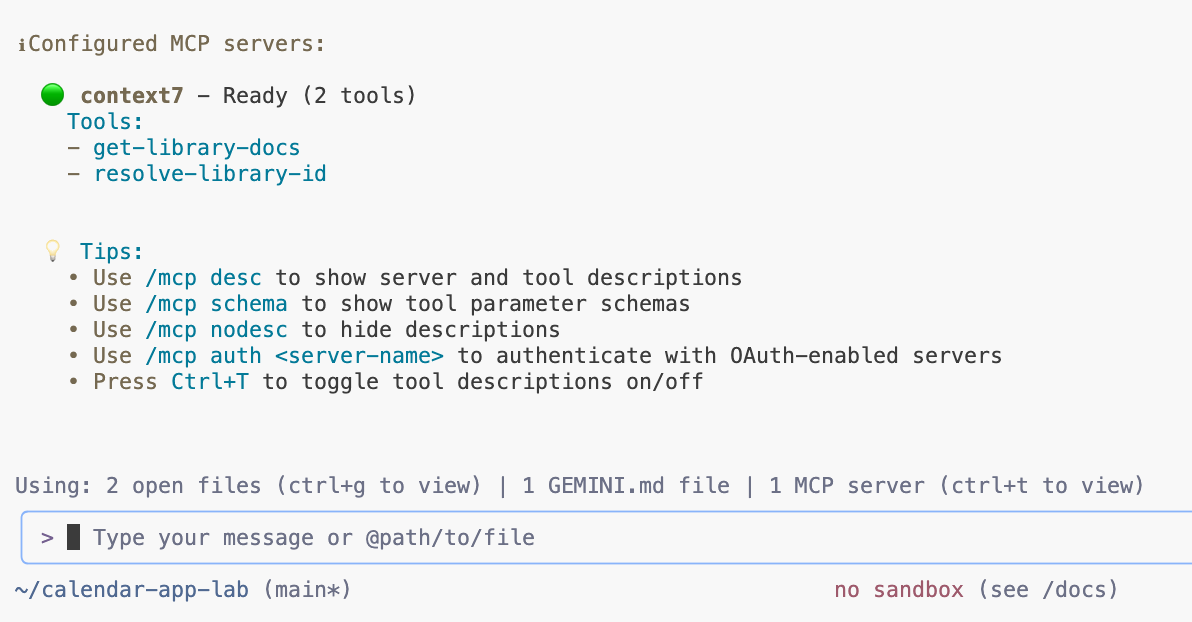

18. Obsługa MCP w interfejsie wiersza poleceń Gemini

Interfejs wiersza poleceń Gemini może integrować się z systemami innych firm, takimi jak Jira, Confluence czy GitHub, za pomocą protokołu Model Context Protocol (MCP). Jest to możliwe dzięki integracji niestandardowych narzędzi serwera MCP, co pozwala interfejsowi wiersza poleceń Gemini tworzyć i aktualizować zgłoszenia JIRA, pobierać informacje ze stron Confluence, tworzyć żądania scalenia itp.

Aby utworzyć plik konfiguracyjny, uruchom to polecenie w terminalu lub użyj trybu powłoki.

echo '{

"mcpServers": {

"context7": {

"httpUrl": "https://mcp.context7.com/mcp"

}

}

}' > .gemini/settings.json

Rozpocznij sesję interfejsu wiersza poleceń Gemini:

gemini

Sprawdź skonfigurowane serwery MCP:

/mcp

Sprawdź dane wyjściowe

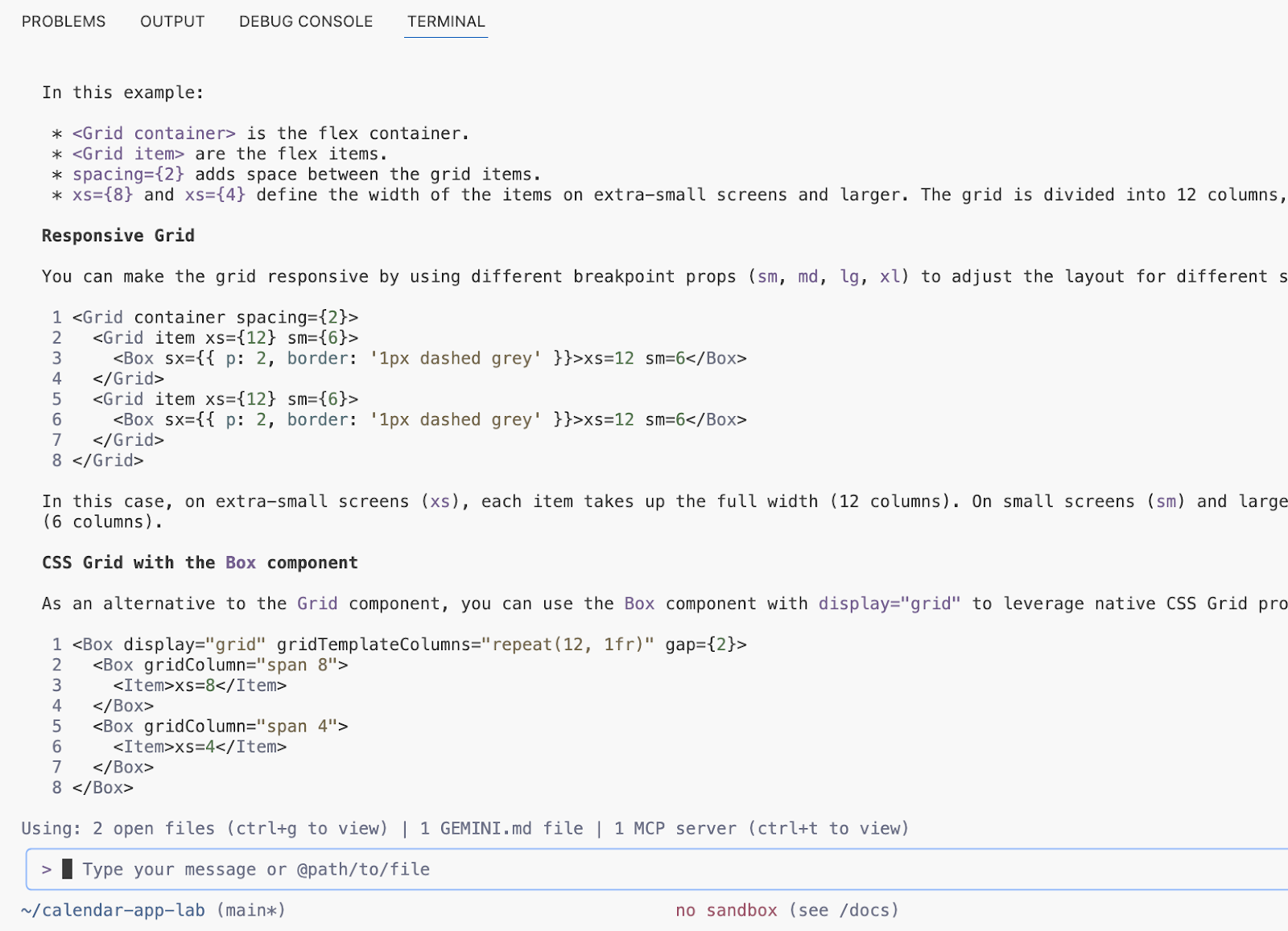

Wyślij prompta, aby przetestować skonfigurowany serwer MCP:

use context7 tools to look up how to implement flex grid in react mui library

Zatwierdź narzędzia i sprawdź dane wyjściowe.

19. Przykładowa konfiguracja serwerów MCP w środowisku lokalnym

W środowisku lokalnym możesz skonfigurować wiele serwerów MCP, korzystając z tej konfiguracji.

{

"mcpServers": {

"Snyk Security Scanner": {

"command": "snyk",

"args": [

"mcp",

"-t",

"stdio",

"--experimental"

],

"env": {}

},

"atlassian": {

"command": "npx",

"args": [

"-y",

"mcp-remote",

"https://mcp.atlassian.com/v1/sse"

]

},

"playwright": {

"command": "npx",

"args": [

"@playwright/mcp@latest"

]

},

"github": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-github"

],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "******"

}

}

}

}

Serwery MCP w tej konfiguracji przekształcają agenta interfejsu wiersza poleceń Gemini w dynamiczne narzędzie do programowania i współpracy, zapewniając standardowy dostęp do systemów zewnętrznych. W szczególności serwer Snyk Security Scanner umożliwia agentowi sprawdzanie kodu i zależności pod kątem luk w zabezpieczeniach bez opuszczania bieżącego obszaru roboczego, a serwer Atlassian łączy się z Jira i Confluence, dzięki czemu interfejs wiersza poleceń Gemini może tworzyć, wyszukiwać i aktualizować problemy lub dokumentację za pomocą języka naturalnego. Serwer Playwright zapewnia też agentowi funkcje automatyzacji przeglądarki, umożliwiając mu poruszanie się po internecie i interakcje z nim w celu wykonywania zadań takich jak testowanie czy wyodrębnianie danych. Serwer GitHub zapewnia agentowi bezpośredni, kontekstowy dostęp do Twoich repozytoriów, co umożliwia mu zarządzanie żądaniami pull request, rozwiązywanie problemów i analizowanie bazy kodu. Znacznie ogranicza to przełączanie kontekstu i zwiększa produktywność w całym procesie programowania.

20. Podsumowanie dotyczące interfejsu wiersza poleceń Gemini

Podsumowując, interfejs wiersza poleceń Gemini to zaawansowany i wszechstronny agent AI o otwartym kodzie źródłowym, który bezproblemowo integruje się z modelami Gemini w Google Cloud, co znacznie zwiększa produktywność programistów. W tym module poznaliśmy jego możliwości w zakresie usprawniania różnych typowych zadań programistycznych, od analizowania złożonych baz kodu i generowania niezbędnej dokumentacji oraz testów jednostkowych po wydajną refaktoryzację komponentów frontendu i backendu aplikacji internetowej w języku Python. Dzięki interfejsowi wiersza poleceń Gemini programiści mogą ograniczyć przełączanie kontekstu, zautomatyzować powtarzalne procesy i w efekcie dostarczać kod wyższej jakości z większą wydajnością. Możliwość wykorzystania generatywnej AI bezpośrednio w wierszu poleceń rewolucjonizuje proces tworzenia oprogramowania.

21. Gratulacje!

Gratulacje! Codelab został ukończony.

Omówione zagadnienia:

- Używanie interfejsu wiersza poleceń Gemini do wykonywania typowych zadań programistycznych

Co dalej?

- Wkrótce pojawią się kolejne sesje praktyczne.

Czyszczenie danych

Aby uniknąć obciążenia konta Google Cloud opłatami za zasoby zużyte w tym samouczku, możesz usunąć projekt zawierający te zasoby lub zachować projekt i usunąć poszczególne zasoby.

Usuwanie projektu

Najprostszym sposobem na uniknięcie płatności jest usunięcie projektu utworzonego w tym samouczku.

©2024 Google LLC. Wszelkie prawa zastrzeżone. Google i logo Google są znakami towarowymi Google LLC. Wszelkie inne nazwy firm i produktów mogą być znakami towarowymi odpowiednich podmiotów, z którymi są powiązane.