1. Was ist Bidi-Streaming?

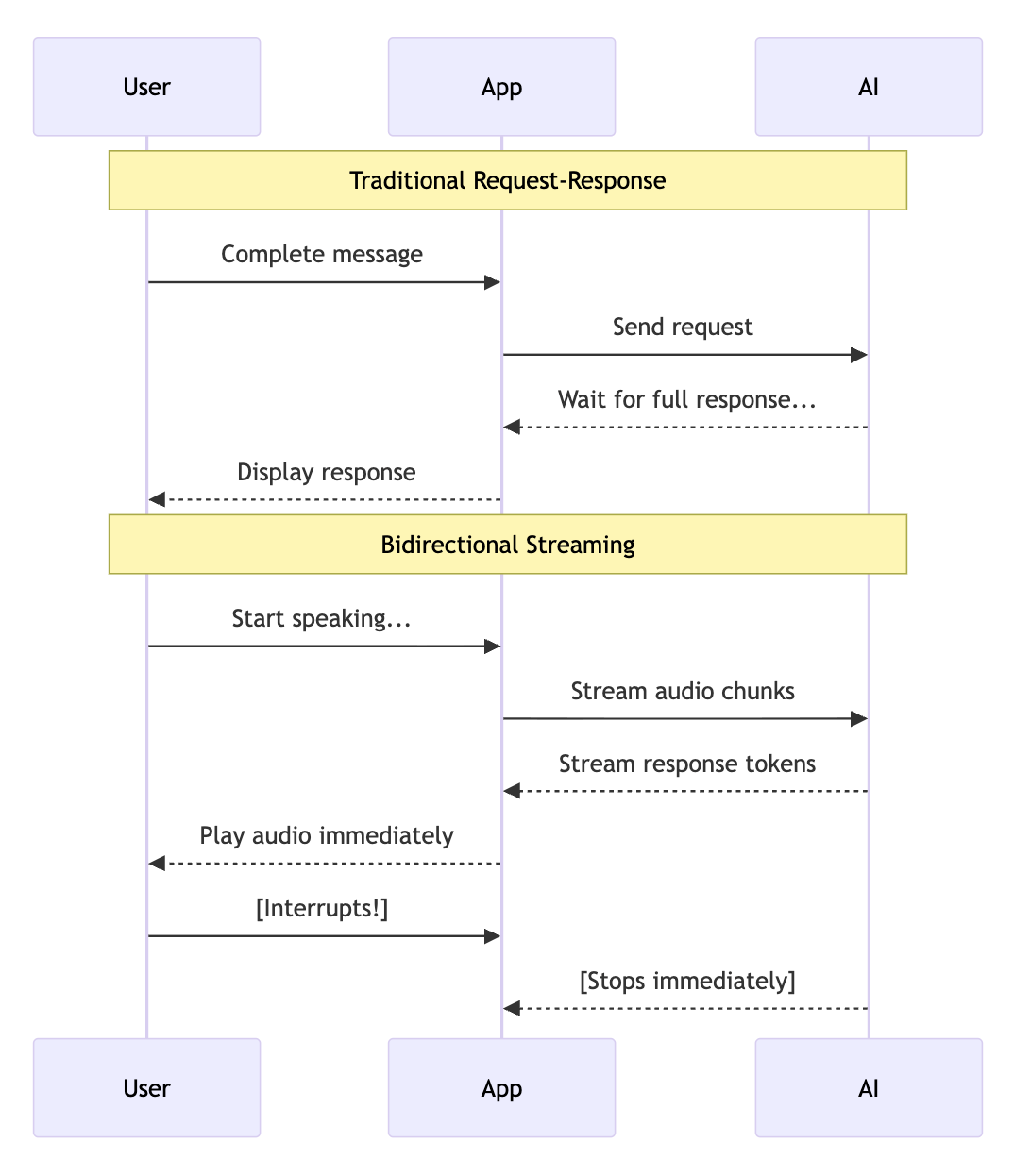

Bidirektionales Streaming (BiDi-Streaming) ermöglicht die gleichzeitige bidirektionale Kommunikation zwischen Ihrer Anwendung und KI-Modellen. Im Gegensatz zu herkömmlichen Anfrage-Antwort-Mustern, bei denen Sie eine vollständige Nachricht senden und auf eine vollständige Antwort warten, ermöglicht Bidi-Streaming Folgendes:

- Kontinuierliche Eingabe: Audio, Video oder Text streamen, während sie aufgenommen werden

- Echtzeitausgabe: KI-Antworten werden ausgegeben, sobald sie generiert werden.

- Natürliche Unterbrechung: Nutzer können die KI während der Antwort unterbrechen, genau wie in einem Gespräch mit einem Menschen.

Bedeutung:Durch Bidi-Streaming fühlen sich KI-Unterhaltungen natürlich an. Die KI kann antworten, während Sie noch Kontext liefern. Sie können sie unterbrechen, wenn Sie genug gehört haben – genau wie bei einem Gespräch mit einem Menschen.

Was ist das ADK-Toolkit für die Gemini Live API?

Das Agent Development Kit (ADK) bietet eine Abstraktion auf hoher Ebene für die Gemini Live API und übernimmt die komplexe Einrichtung des Echtzeit-Streamings, damit Sie sich auf die Entwicklung Ihrer Anwendung konzentrieren können.

Das ADK-Toolkit für die Gemini Live API verwaltet:

- Verbindungslebenszyklus: WebSocket-Verbindungen herstellen, aufrechterhalten und wiederherstellen

- Nachrichtenrouting: Audio, Text und Bilder an die richtigen Handler weiterleiten

- Sitzungsstatus: Unterhaltungsverlauf bei erneuten Verbindungen beibehalten

- Tool-Ausführung: Automatisches Aufrufen und Fortsetzen von Funktionsaufrufen

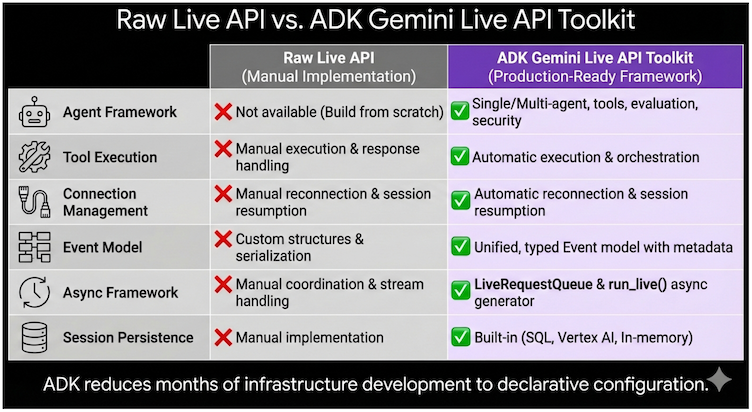

Warum ADK statt der reinen Live API?

Sie könnten direkt auf der Gemini Live API aufbauen, aber das ADK übernimmt die komplexe Infrastruktur, sodass Sie sich auf Ihre Anwendung konzentrieren können:

Funktion | Raw Live API | ADK-Toolkit für die Gemini Live API |

KI-Agentenframework | Ohne Vorlage erstellen | Einzel-/Multi-Agent mit Tools, Bewertung, Sicherheit |

Tool-Ausführung | Manuelle Bearbeitung | Automatische parallele Ausführung |

Verbindungsverwaltung | Manuelle Wiederverbindung | Transparente Sitzungswiederaufnahme |

Ereignismodell | Benutzerdefinierte Strukturen | Einheitliche, typisierte Event-Objekte |

Async-Framework | Manuelle Koordination | LiveRequestQueue + run_live()-Generator |

Sitzungspersistenz | Manuelle Implementierung | Integrierte SQL-, Vertex AI- oder In-Memory-Funktionen |

Fazit:Mit dem ADK lässt sich die Infrastrukturentwicklung von Monaten auf Tage verkürzen. Sie konzentrieren sich auf die Funktion Ihres Agents und nicht auf die Funktionsweise des Streamings.

Anwendungsfälle aus der Praxis

- Kundenservice: Ein Kunde zeigt seine defekte Kaffeemaschine über die Telefonkamera und erklärt das Problem. Die KI identifiziert das Modell und den Fehlerpunkt. Der Kunde kann die Unterhaltung unterbrechen, um Details zu korrigieren.

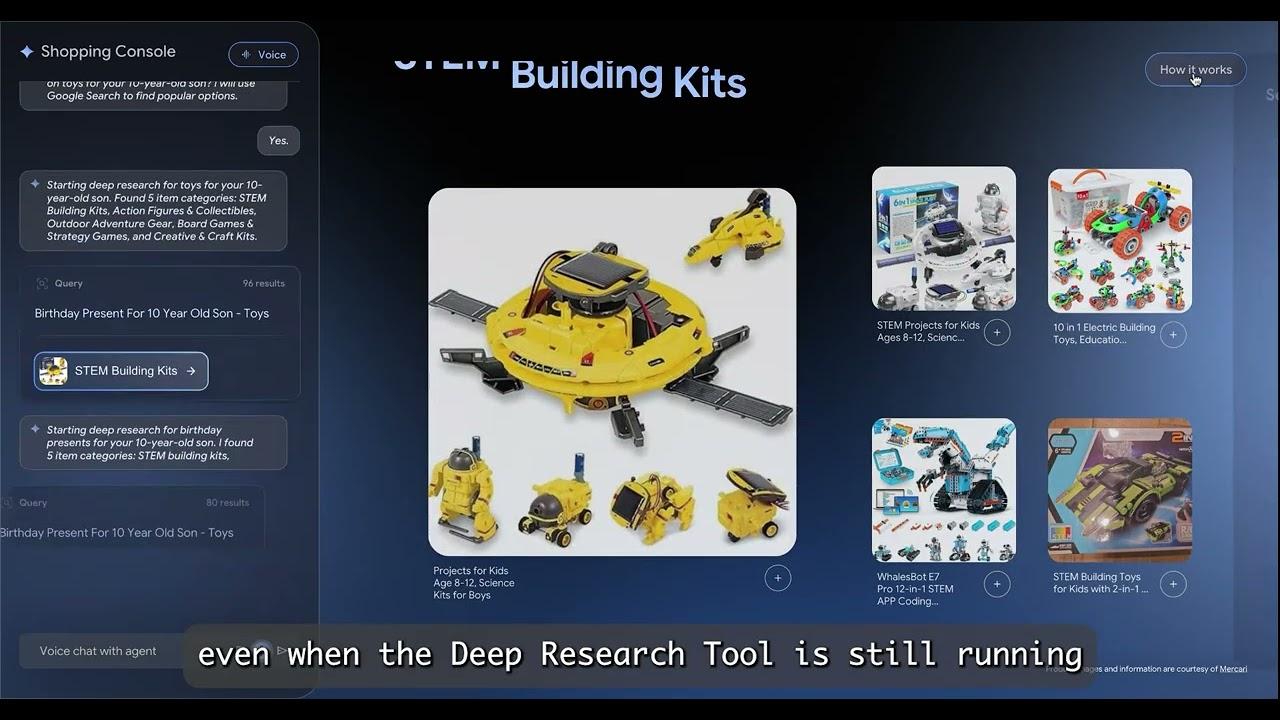

- E-Commerce: Ein Käufer hält Kleidung vor seine Webcam und fragt: „Finde Schuhe, die zu dieser Hose passen.“ Der Agent analysiert den Stil und führt einen flüssigen Dialog: „Zeig mir etwas Lässigeres“ → „Wie wäre es mit diesen Sneakers?“ → „Füge die blauen in Größe 10 hinzu.“

- Kundendienst: Ein Techniker mit einer Smartbrille streamt seine Sicht und fragt: „Ich höre ein seltsames Geräusch von diesem Kompressor – kannst du es identifizieren?“ Der Agent gibt Schritt-für-Schritt-Anleitungen, ohne dass Sie das Gerät berühren müssen.

- Gesundheitswesen: Ein Patient teilt ein Live-Video einer Hauterkrankung. Die KI führt eine vorläufige Analyse durch, stellt klärende Fragen und gibt Hinweise zu den nächsten Schritten.

- Finanzdienstleistungen: Ein Kunde überprüft sein Portfolio, während der Kundenservicemitarbeiter Diagramme anzeigt und die Auswirkungen von Transaktionen simuliert. Der Kunde kann seinen Bildschirm freigeben, um bestimmte Nachrichtenartikel zu besprechen.

Shopper’s Concierge 2 Demo: Echtzeit-Demo für Agentic RAG für E-Commerce, erstellt mit dem ADK Gemini Live API-Toolkit und Vertex AI Vector Search, Embeddings, Feature Store und Ranking API:

Weitere Informationen: Entwicklerleitfaden

Einen umfassenden Überblick finden Sie im Entwicklerleitfaden für das ADK-Toolkit für die Gemini Live API, einer fünfteiligen Reihe, die die Architektur bis zur Produktionsbereitstellung abdeckt:

Teil | Fokus | Lerninhalte |

Stiftung | Architektur, Live-API-Plattformen, 4-Phasen-Lebenszyklus | |

Upstream | Senden von Text, Audio und Video über LiveRequestQueue | |

Downstream | Ereignisverarbeitung, Tool-Ausführung, Multi-Agent-Workflows | |

Konfiguration | Sitzungsverwaltung, Kontingente, Produktionskontrollen | |

Multimodal | Audiospezifikationen, Modellarchitekturen, erweiterte Funktionen |

2. Workshop-Übersicht

Umfang

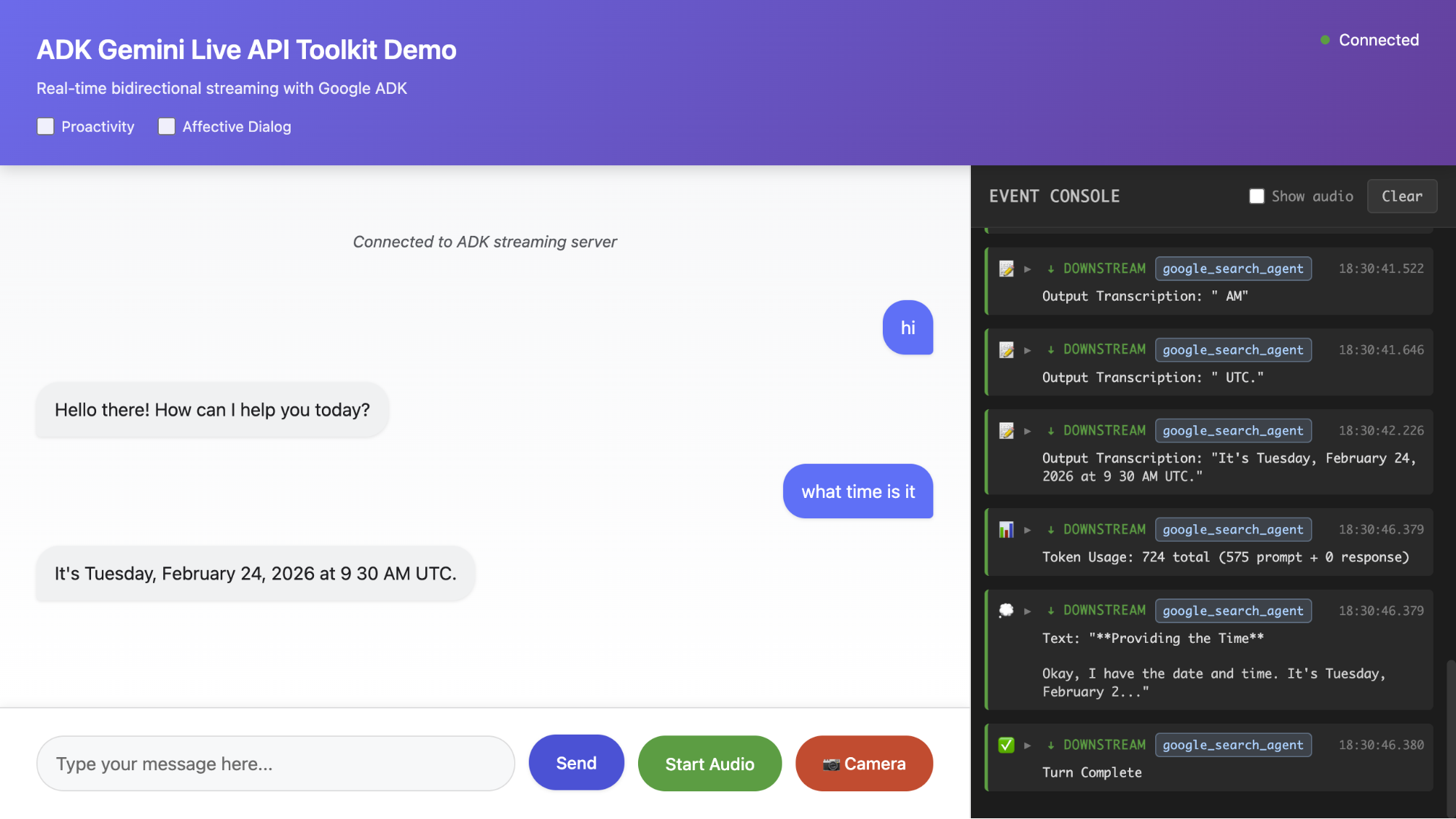

In diesem praxisorientierten Workshop entwickeln Sie eine vollständige bidirektionale Streaming-KI-Anwendung von Grund auf. Am Ende haben Sie eine funktionierende Sprach-KI, die Folgendes kann:

- Text-, Audio- und Bildeingaben akzeptieren

- Mit Streaming-Text oder natürlicher Sprache antworten

- Natürlich auf Unterbrechungen reagieren

- Tools wie die Google Suche verwenden

Anders als beim Lesen von Dokumentationen untersuchen Sie jede Komponente Schritt für Schritt und verstehen, wie die einzelnen Teile zusammenpassen, während Sie die App inkrementell erstellen.

Lernansatz

Wir verfolgen einen inkrementellen Ansatz:

- Schritt 1: Minimaler WebSocket-Server → „Hello World“-Antwort

- Schritt 2: KI-Agenten hinzufügen → KI-Verhalten und Tools definieren

- Schritt 3: Anwendungsinitialisierung → Runner- und Sitzungsdienst

- Schritt 4: Sitzung initialisieren → RunConfig und LiveRequestQueue

- Schritt 5: Upstream-Aufgabe → Kommunikation zwischen Client und Warteschlange

- Schritt 6: Downstream-Aufgabe → Streaming von Ereignissen an den Client

- Schritt 7: Audio hinzufügen → Spracheingabe und ‑ausgabe

- Schritt 8: Bildeingabe hinzufügen → Multimodale KI

Jeder Schritt baut auf dem vorherigen auf. Nach jedem Schritt wird ein Test durchgeführt, um den Fortschritt zu überprüfen.

Vorbereitung

- Google Cloud-Konto mit aktivierter Abrechnung

- Grundlegende Kenntnisse der Python- und asynchronen Programmierung (async/await)

- Webbrowser mit Zugriff auf Mikrofon und Webkamera (Chrome wird empfohlen)

Voraussichtlich benötigte Zeit

- Vollständiger Workshop: ca. 90 Minuten

- Kurze Version (nur Schritte 1 bis 4): ca. 45 Minuten

3. Workshop

Folgen Sie der Anleitung, um den Workshop zu starten:

https://github.com/kazunori279/adk-streaming-guide/blob/main/workshops/workshop.md

4. Zusammenfassung und wichtige Erkenntnisse

Was Sie erstellt haben

Sie haben eine vollständige bidirektionale Streaming-KI-Anwendung von Grund auf neu entwickelt. Die Anwendung verarbeitet Text-, Sprach- und Bildeingaben mit Streaming-Antworten in Echtzeit – die Grundlage für die Entwicklung produktionsreifer KI für Unterhaltungen.

Komponente | Was bewirkt die Funktion? | Step |

Agent | Definiert die KI-Persönlichkeit, Anweisungen und verfügbaren Tools (z.B. Google Suche) | Schritt 2 |

SessionService | Unterhaltungsverlauf wird bei erneuten Verbindungen beibehalten | Schritt 3 |

Runner | Orchestriert den Streaming-Lebenszyklus, verbindet den Agenten mit der Live API | Schritt 3 |

RunConfig | Konfiguriert die Antwortmodalität (TEXT/AUDIO), die Transkription und die Wiederaufnahme der Sitzung. | Schritt 4 |

LiveRequestQueue | Einheitliche Benutzeroberfläche zum Senden von Text, Audio und Bildern an das Modell | Schritt 5 |

run_live() | Asynchroner Generator, der Streaming-Ereignisse aus dem Modell ausgibt | Schritt 6 |

send_realtime() | Sendet Audio-/Bild-Blobs für kontinuierliche Streamingeingabe | Schritt 7–8 |

Ressourcen

Mit diesen offiziellen Ressourcen können Sie Ihr Wissen weiter vertiefen. Im ADK-Toolkit-Leitfaden für die Gemini Live API finden Sie weitere Informationen zu allen Themen dieses Workshops.

Ressource | URL |

ADK-Dokumentation | |

ADK-Toolkit für die Gemini Live API – Anleitung | |

Gemini Live API | |

Vertex AI Live API | https://cloud.google.com/vertex-ai/generative-ai/docs/live-api |

ADK-Beispielrepository |