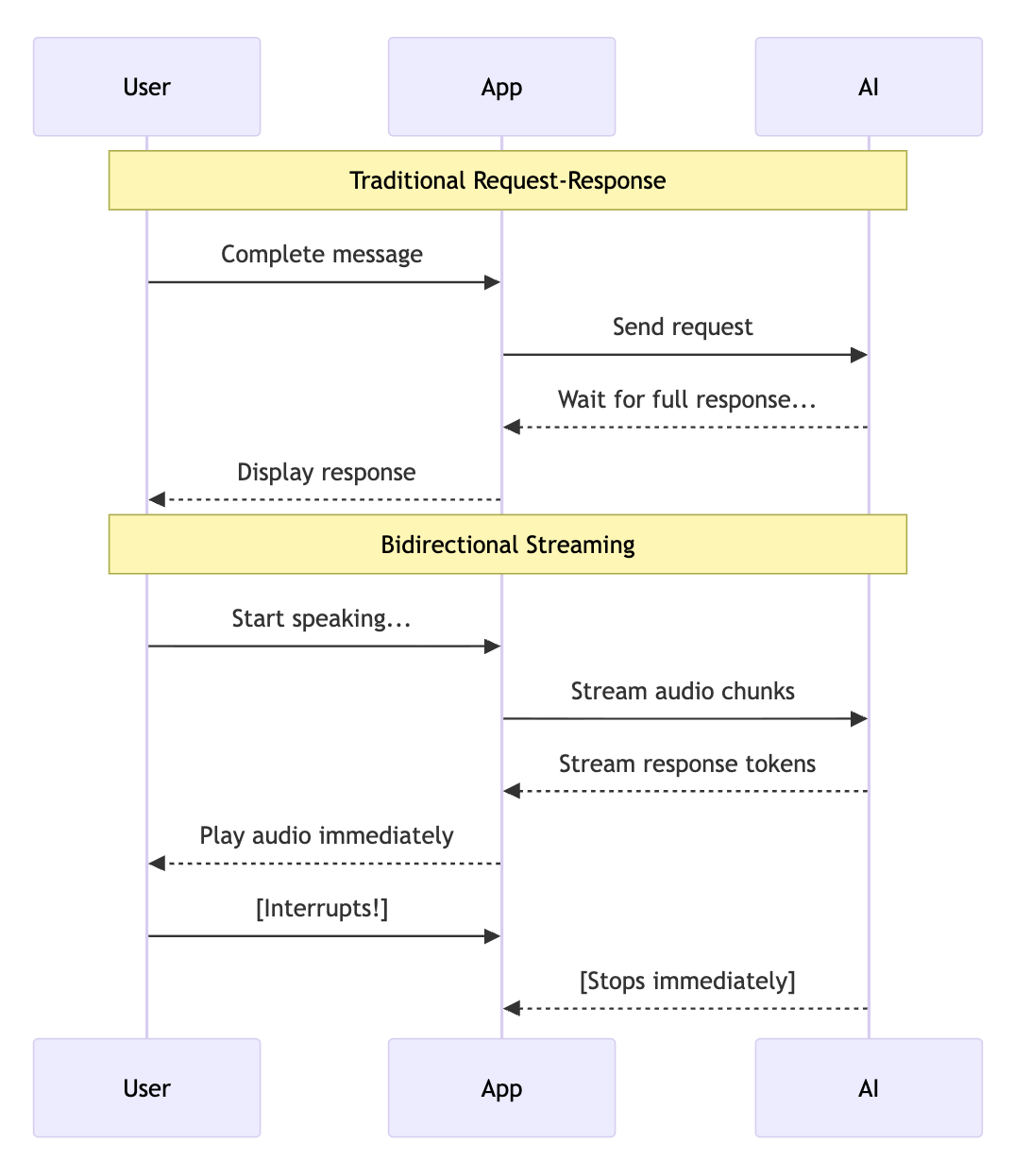

1. Apa itu streaming BiDi?

Streaming dua arah (bidi-streaming) memungkinkan komunikasi dua arah secara bersamaan antara aplikasi dan model AI Anda. Tidak seperti pola permintaan-respons tradisional yang mengharuskan Anda mengirim pesan lengkap dan menunggu balasan lengkap, streaming dua arah memungkinkan:

- Input berkelanjutan: Streaming audio, video, atau teks saat direkam

- Output real-time: Menerima respons AI saat respons tersebut dibuat

- Interupsi alami: Pengguna dapat menginterupsi AI di tengah respons, seperti dalam percakapan manusia

Mengapa ini penting: Bidi-streaming membuat percakapan AI terasa alami. AI dapat merespons saat Anda masih memberikan konteks, dan Anda dapat menghentikannya saat Anda sudah cukup mendengar—sama seperti berbicara dengan manusia.

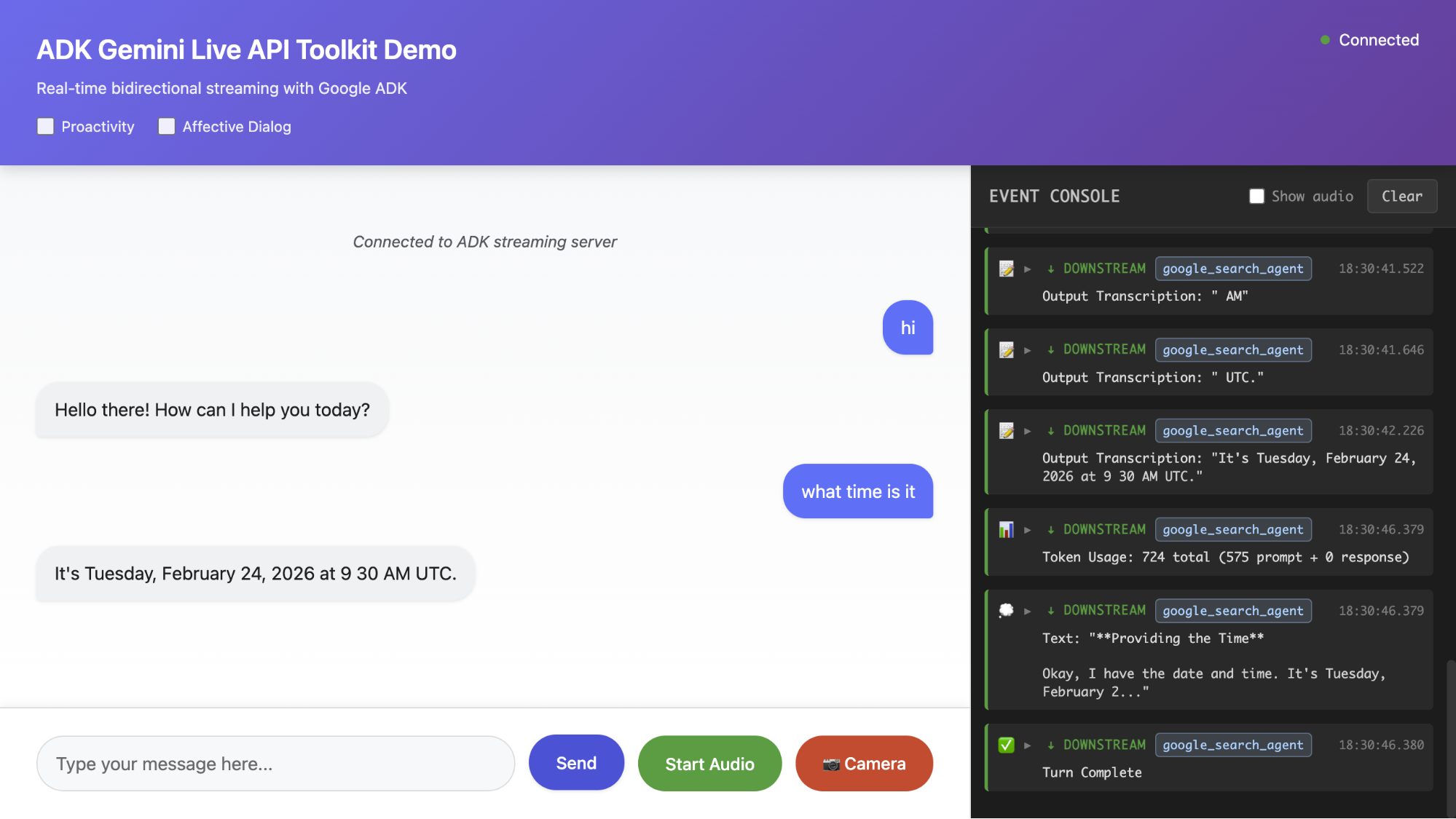

Apa itu ADK Gemini Live API Toolkit?

Agent Development Kit (ADK) menyediakan abstraksi tingkat tinggi melalui Gemini Live API, yang menangani kompleksitas streaming real-time sehingga Anda dapat berfokus pada pembuatan aplikasi.

ADK Gemini Live API Toolkit mengelola:

- Siklus proses koneksi: Membuat, mempertahankan, dan memulihkan koneksi WebSocket

- Perutean pesan: Mengarahkan audio, teks, dan gambar ke handler yang tepat

- Status sesi: Mempertahankan histori percakapan di seluruh koneksi ulang

- Eksekusi alat: Memanggil dan melanjutkan dari panggilan fungsi secara otomatis

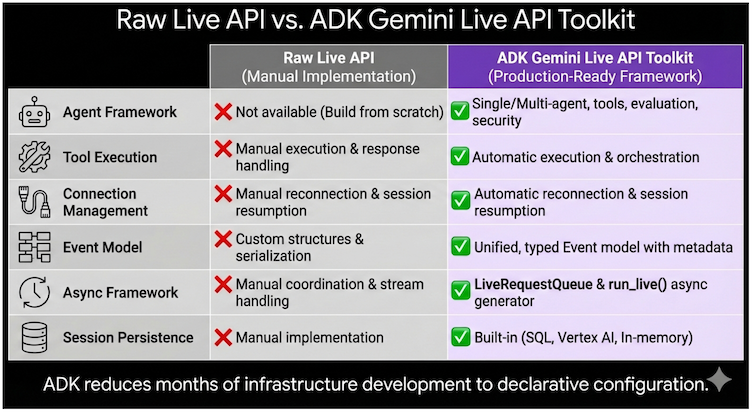

Mengapa ADK lebih baik daripada Live API mentah?

Anda dapat membangun langsung di Gemini Live API, tetapi ADK menangani infrastruktur yang kompleks sehingga Anda dapat berfokus pada aplikasi Anda:

Kemampuan | Raw Live API | ADK Gemini Live API Toolkit |

Framework Agen | Membuat dari awal | Agen tunggal/multi-agen dengan alat, evaluasi, keamanan |

Eksekusi Alat | Penanganan manual | Eksekusi paralel otomatis |

Pengelolaan Koneksi | Koneksi ulang manual | Pelanjutan sesi yang transparan |

Model Acara | Struktur kustom | Objek Peristiwa yang diketik dan terpadu |

Framework Asinkron | Koordinasi manual | Generator LiveRequestQueue + run_live() |

Persistensi Sesi | Implementasi manual | SQL bawaan, Vertex AI, atau dalam memori |

Intinya: ADK mengurangi pengembangan infrastruktur dari hitungan bulan menjadi hitungan hari. Anda berfokus pada tindakan yang dilakukan agen, bukan cara kerja streaming.

Kasus Penggunaan di Dunia Nyata

- Layanan Pelanggan: Pelanggan menunjukkan mesin kopi yang rusak melalui kamera ponsel sambil menjelaskan masalahnya. AI mengidentifikasi model dan titik kegagalan, dan pelanggan dapat menyela untuk mengoreksi detail di tengah percakapan.

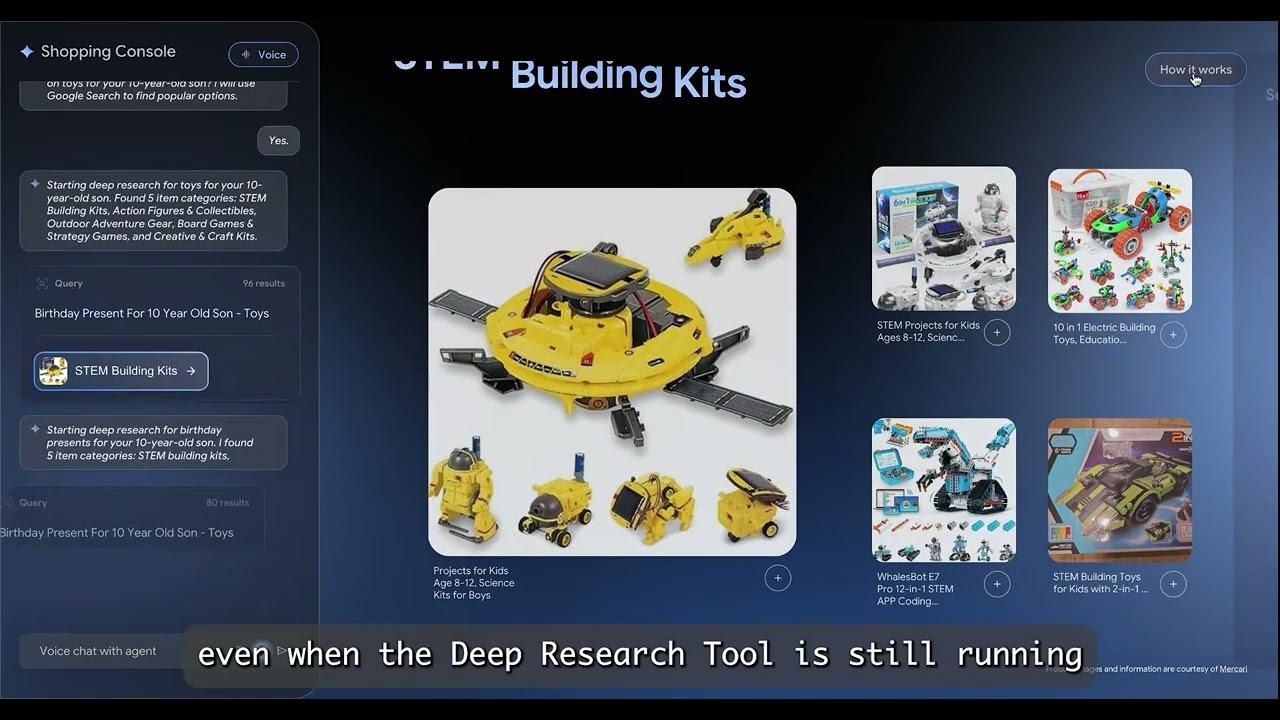

- E-commerce: Pembeli memegang pakaian di depan webcam dan bertanya "Temukan sepatu yang cocok dengan celana ini". Agen menganalisis gaya dan melakukan percakapan dua arah yang lancar: "Tampilkan sesuatu yang lebih kasual" → "Bagaimana dengan sepatu kets ini?" → "Tambahkan yang biru ukuran 10."

- Field Service: Seorang teknisi yang memakai kacamata pintar melakukan streaming tampilannya sambil bertanya, "Saya mendengar suara aneh dari kompresor ini—dapatkah Anda mengidentifikasinya?" Agen ini memberikan panduan langkah demi langkah secara handsfree.

- Layanan kesehatan: Pasien membagikan video langsung kondisi kulit. AI melakukan analisis awal, mengajukan pertanyaan klarifikasi, dan memandu langkah berikutnya.

- Layanan Keuangan: Klien meninjau portofolionya saat agen menampilkan diagram dan menyimulasikan dampak perdagangan. Klien dapat membagikan layarnya untuk mendiskusikan artikel berita tertentu.

Demo Shopper's Concierge 2: Demo RAG Agentik real-time untuk e-commerce, yang dibangun dengan ADK Gemini Live API Toolkit dan Vertex AI Vector Search, Embeddings, Feature Store, dan Ranking API:

Pelajari Lebih Lanjut: Panduan Developer

Untuk pembahasan mendalam yang komprehensif, lihat Panduan Developer ADK Gemini Live API Toolkit—seri 5 bagian yang mencakup arsitektur hingga deployment produksi:

Bagian | Fokus | Yang Akan Anda Pelajari |

Yayasan | Arsitektur, platform Live API, siklus proses 4 fase | |

Upstream | Mengirim teks, audio, video melalui LiveRequestQueue | |

Downstream | Penanganan peristiwa, eksekusi alat, alur kerja multi-agen | |

Konfigurasi | Pengelolaan sesi, kuota, kontrol produksi | |

Multimodal | Spesifikasi audio, arsitektur model, fitur lanjutan |

2. Ringkasan Workshop

Yang Akan Anda Buat

Dalam workshop praktik ini, Anda akan membangun aplikasi AI streaming dua arah yang lengkap dari awal. Pada akhirnya, Anda akan memiliki AI suara yang berfungsi dan dapat:

- Menerima input teks, audio, dan gambar

- Merespons dengan teks streaming atau ucapan alami

- Menangani gangguan secara alami

- Menggunakan alat seperti Google Penelusuran

Tidak seperti membaca dokumentasi, Anda akan memeriksa setiap komponen langkah demi langkah, memahami cara kerja setiap bagian saat Anda membangunnya secara bertahap.

Pendekatan Pembelajaran

Kami mengikuti pendekatan build inkremental:

- Langkah 1: Server WebSocket Minimal → Respons "Hello World"

- Langkah 2: Tambahkan Agen → Tentukan perilaku dan alat AI

- Langkah 3: Inisialisasi Aplikasi → Layanan runner dan sesi

- Langkah 4: Inisialisasi Sesi → RunConfig dan LiveRequestQueue

- Langkah 5: Tugas Hulu → Komunikasi dari klien ke antrean

- Langkah 6: Tugas Hilir → Streaming peristiwa ke klien

- Langkah 7: Tambahkan Audio → Input dan output suara

- Langkah 8: Tambahkan Input Gambar → AI Multimodal

Setiap langkah dibangun berdasarkan langkah sebelumnya. Anda akan melakukan pengujian setelah setiap langkah untuk melihat progres Anda.

Prasyarat

- Akun Google Cloud dengan penagihan diaktifkan

- Pengetahuan dasar tentang Python dan pemrograman asinkron (async/await)

- Browser web dengan akses mikrofon dan kamera web (Chrome direkomendasikan)

Estimasi Waktu

- Workshop lengkap: ~90 menit

- Versi cepat (Hanya Langkah 1-4): ~45 menit

3. Workshop

Mulai workshop dengan mengikuti petunjuk di sini:

https://github.com/kazunori279/adk-streaming-guide/blob/main/workshops/workshop.md

4. Penutup & Poin-Poin Penting

Yang Anda Buat

Anda telah membangun aplikasi AI streaming dua arah yang lengkap dari awal. Aplikasi ini menangani input teks, suara, dan gambar dengan respons streaming real-time—dasar untuk membangun AI percakapan yang siap produksi.

Komponen | Fungsinya | Langkah |

Agen | Menentukan kepribadian AI, petunjuk, dan alat yang tersedia (misalnya, Google Penelusuran) | Langkah 2 |

SessionService | Mempertahankan histori percakapan saat terhubung kembali | Langkah 3 |

Runner | Mengatur siklus proses streaming, menghubungkan agen ke Live API | Langkah 3 |

RunConfig | Mengonfigurasi modalitas respons (TEXT/AUDIO), transkripsi, kelanjutan sesi | Langkah 4 |

LiveRequestQueue | Antarmuka terpadu untuk mengirim teks, audio, dan gambar ke model | Langkah 5 |

run_live() | Generator asinkron yang menghasilkan peristiwa streaming dari model | Langkah 6 |

send_realtime() | Mengirim blob audio/gambar untuk input streaming berkelanjutan | Langkah 7-8 |

Resource

Lanjutkan pembelajaran dengan referensi resmi berikut. Panduan ADK Gemini Live API Toolkit memberikan cakupan yang lebih mendalam tentang semua hal dalam workshop ini.

Resource | URL |

Dokumentasi ADK | |

Panduan ADK Gemini Live API Toolkit | |

Gemini Live API | |

Vertex AI Live API | https://cloud.google.com/vertex-ai/generative-ai/docs/live-api |

Repositori Contoh ADK |