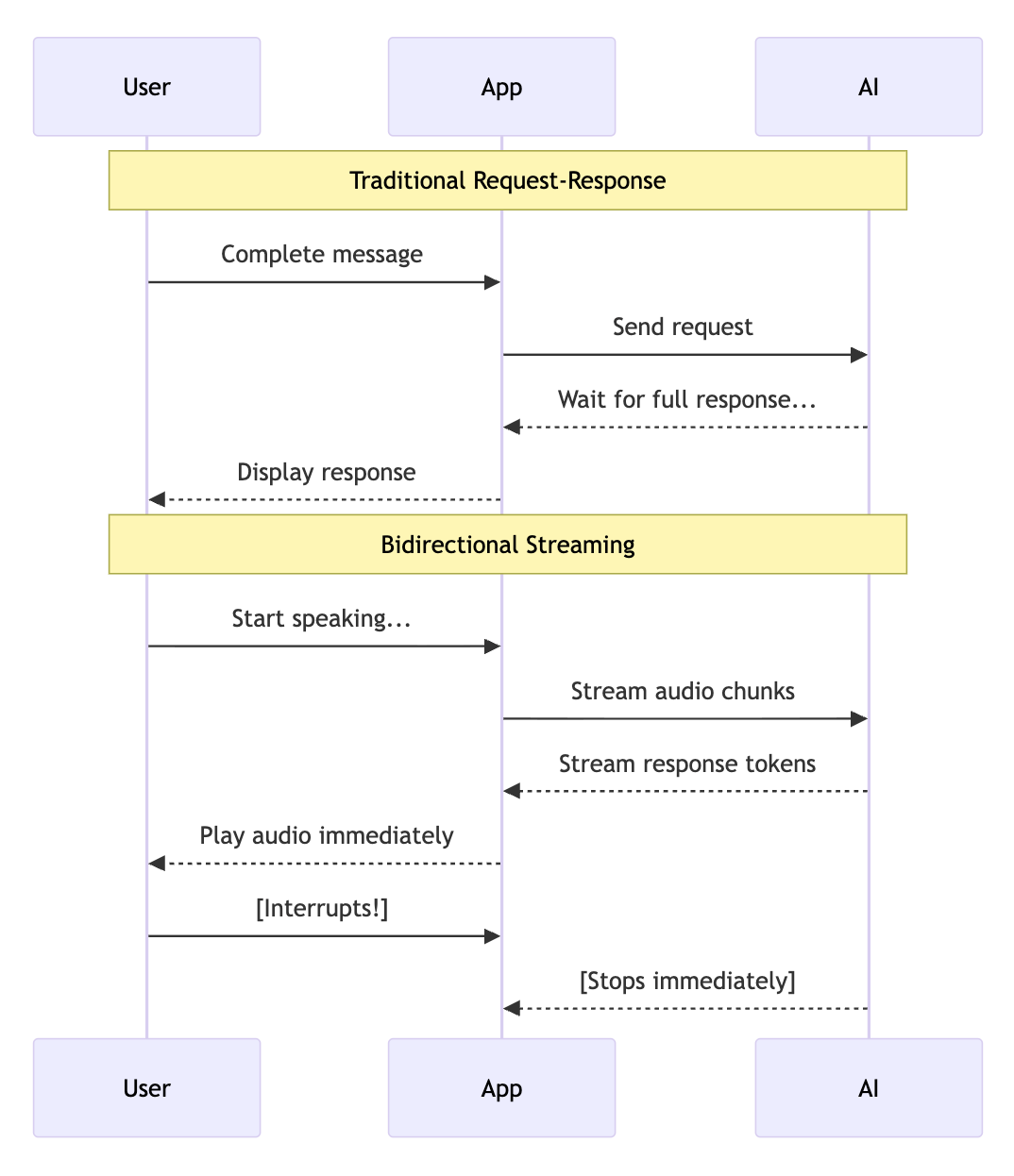

1. Czym jest strumieniowanie dwukierunkowe?

Strumieniowanie dwukierunkowe (bidi-streaming) umożliwia jednoczesną dwukierunkową komunikację między aplikacją a modelami AI. W odróżnieniu od tradycyjnych wzorców żądanie-odpowiedź, w których wysyłasz pełną wiadomość i czekasz na pełną odpowiedź, dwukierunkowe przesyłanie strumieniowe umożliwia:

- Ciągłe dane wejściowe: przesyłanie strumieniowe dźwięku, obrazu lub tekstu w miarę ich rejestrowania.

- Dane wyjściowe w czasie rzeczywistym: otrzymuj odpowiedzi AI w miarę ich generowania.

- Naturalne przerywanie: użytkownicy mogą przerywać AI w trakcie odpowiedzi, tak jak w rozmowie z człowiekiem.

Dlaczego to jest ważne: dwukierunkowe przesyłanie strumieniowe sprawia, że rozmowy z AI są naturalne. AI może odpowiadać, gdy nadal podajesz kontekst, a Ty możesz jej przerwać, gdy usłyszysz wystarczająco dużo – tak jak w rozmowie z człowiekiem.

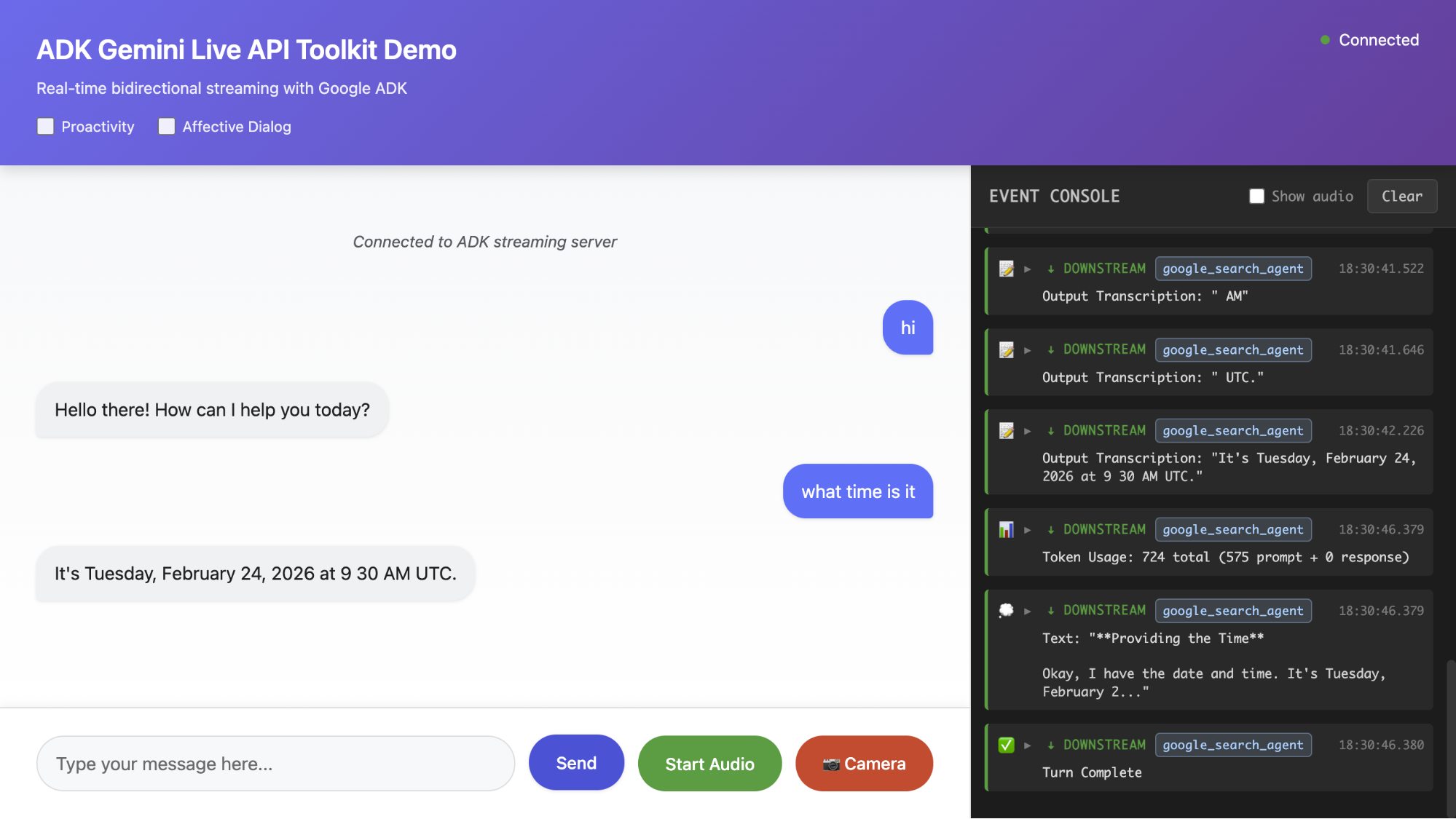

Czym jest pakiet narzędzi ADK Gemini Live API?

Pakiet Agent Development Kit (ADK) zapewnia abstrakcję wysokiego poziomu nad interfejsem Gemini Live API, obsługując złożone aspekty strumieniowania w czasie rzeczywistym, dzięki czemu możesz skupić się na tworzeniu aplikacji.

Pakiet narzędzi ADK Gemini Live API zarządza:

- Cykl życia połączenia: nawiązywanie, utrzymywanie i przywracanie połączeń WebSocket

- Routing wiadomości: kierowanie dźwięku, tekstu i obrazów do odpowiednich modułów obsługi.

- Stan sesji: zachowywanie historii rozmów podczas ponownych połączeń

- Wykonywanie narzędzi: automatyczne wywoływanie funkcji i wznawianie działania po wywołaniu funkcji.

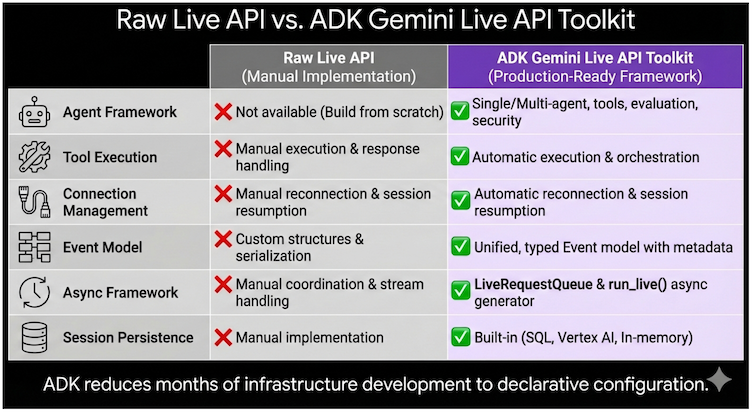

Dlaczego warto używać ADK zamiast interfejsu Live API?

Możesz tworzyć aplikacje bezpośrednio w interfejsie Gemini Live API, ale ADK obsługuje złożoną infrastrukturę, dzięki czemu możesz skupić się na swojej aplikacji:

Możliwość | Raw Live API | Pakiet narzędzi ADK Gemini Live API |

Platforma agenta | Utwórz od zera | Pojedynczy lub wieloagentowy z narzędziami, oceną i zabezpieczeniami |

Wykonanie narzędzia | Ręczna obsługa | Automatyczne wykonywanie równoległe |

Zarządzanie połączeniami | Ręczne ponowne łączenie | Przejrzyste wznawianie sesji |

Model zdarzeń | Struktury niestandardowe | Ujednolicone obiekty zdarzeń z określonym typem |

Platforma asynchroniczna | Ręczna koordynacja | Generator LiveRequestQueue + run_live() |

Trwałość sesji | Implementacja ręczna | Wbudowane SQL, Vertex AI lub w pamięci |

Podsumowanie: Pakiet ADK skraca czas tworzenia infrastruktury z miesięcy do dni. Skupiasz się na tym, co robi Twój agent, a nie na tym, jak działa streaming.

Praktyczne zastosowania

- Obsługa klienta: klient pokazuje wadliwy ekspres do kawy przez kamerę telefonu, wyjaśniając problem. AI rozpoznaje model i punkt awarii, a klient może przerwać rozmowę, aby poprawić szczegóły.

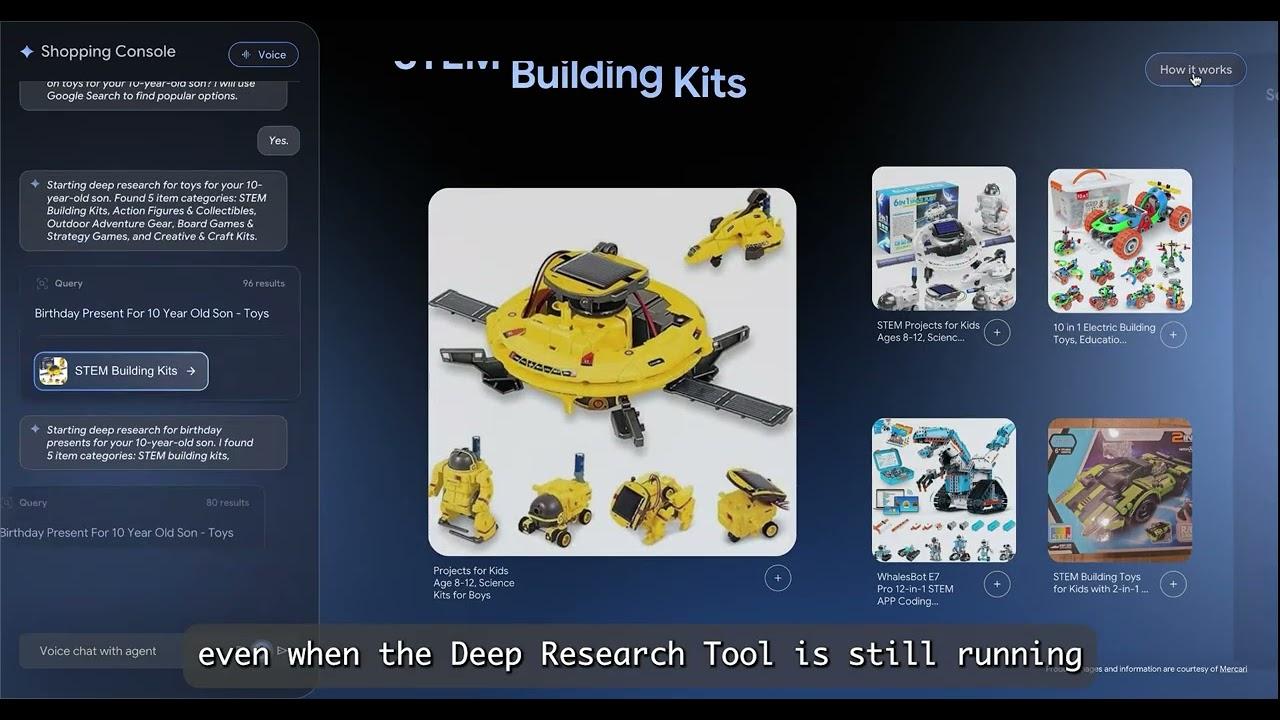

- Handel elektroniczny: kupujący trzyma ubranie przed kamerą internetową i pyta: „Znajdź buty pasujące do tych spodni”. Agent analizuje styl i prowadzi płynną rozmowę: „Pokaż mi coś bardziej swobodnego” → „A może te sneakersy?” → „Dodaj niebieskie w rozmiarze 10”.

- Serwis w terenie: technik w okularach inteligentnych przesyła strumieniowo obraz, zadając pytanie: „Słyszę dziwny dźwięk z tej sprężarki – czy możesz go zidentyfikować?”. Agent udziela szczegółowych wskazówek bez użycia rąk.

- Opieka zdrowotna: pacjent udostępnia transmisję na żywo przedstawiającą stan skóry. AI przeprowadza wstępną analizę, zadaje pytania wyjaśniające i wskazuje kolejne kroki.

- Usługi finansowe: klient przegląda swoje portfolio, a agent wyświetla wykresy i symuluje wpływ transakcji. Klient może udostępnić ekran, aby omówić konkretne artykuły z wiadomościami.

Wersja demonstracyjna Shopper's Concierge 2: demonstracja w czasie rzeczywistym techniki RAG opartej na agentach dla e-commerce, utworzona za pomocą pakietu narzędzi ADK Gemini Live API oraz interfejsów Vertex AI Vector Search, Embeddings, Feature Store i Ranking API:

Więcej informacji: Przewodnik dla programistów

Szczegółowe informacje znajdziesz w Przewodniku dla programistów korzystających z pakietu narzędzi ADK Gemini Live API, który składa się z 5 części i obejmuje tematy od architektury po wdrażanie w środowisku produkcyjnym:

Część | Ostrość | Czego się nauczysz |

Fundacja | Architektura, platformy Live API, 4-fazowy cykl życia | |

W górę | Wysyłanie tekstu, dźwięku i filmu za pomocą LiveRequestQueue | |

W dół | Obsługa zdarzeń, wykonywanie narzędzi, przepływy pracy z wieloma agentami | |

Konfiguracja | Zarządzanie sesjami, limity, kontrola produkcji | |

Tryb multimodalny | Dane techniczne audio, architektury modeli, funkcje zaawansowane |

2. Omówienie warsztatów

Co utworzysz

Podczas tych praktycznych warsztatów od podstaw stworzysz kompletną dwukierunkową aplikację AI do strumieniowania. Po zakończeniu tego procesu będziesz mieć działającą AI głosową, która może:

- przyjmować dane wejściowe w postaci tekstu, dźwięku i obrazów;

- Odpowiadanie za pomocą przesyłanego strumieniowo tekstu lub naturalnej mowy

- Naturalne reagowanie na przerwy

- korzystać z narzędzi takich jak wyszukiwarka Google,

W przeciwieństwie do czytania dokumentacji będziesz krok po kroku analizować każdy komponent, aby zrozumieć, jak poszczególne elementy łączą się ze sobą w miarę ich dodawania.

Podejście do nauki

Stosujemy podejście przyrostowe:

- Krok 1. Minimalny serwer WebSocket → odpowiedź „Hello World”

- Krok 2. Dodaj agenta → zdefiniuj zachowanie i narzędzia AI

- Krok 3. Inicjowanie aplikacji → usługa Runner i sesji

- Krok 4. Inicjowanie sesji → RunConfig i LiveRequestQueue

- Krok 5. Zadanie nadrzędne → komunikacja klienta z kolejką

- Krok 6. Zadanie podrzędne → przesyłanie strumieniowe zdarzeń do klienta

- Krok 7. Dodaj dźwięk → Głosowe wprowadzanie tekstu i generowanie mowy

- Krok 8. Dodaj wejście obrazu → AI multimodalna

Każdy krok opiera się na poprzednim. Po każdym kroku sprawdzisz swoje postępy.

Wymagania wstępne

- konto Google Cloud z włączonymi płatnościami;

- podstawowa znajomość Pythona i programowania asynchronicznego (async/await),

- przeglądarka internetowa z dostępem do mikrofonu i kamery internetowej (zalecamy korzystanie z przeglądarki Chrome);

Szacowany czas

- Pełne warsztaty: ok. 90 minut

- Wersja skrócona (tylko kroki 1–4): ok. 45 minut

3. Warsztat

Aby rozpocząć warsztaty, postępuj zgodnie z tymi instrukcjami:

https://github.com/kazunori279/adk-streaming-guide/blob/main/workshops/workshop.md

4. Podsumowanie i najważniejsze informacje

Co utworzysz

Udało Ci się od podstaw utworzyć kompletną dwukierunkową aplikację do strumieniowania AI. Aplikacja obsługuje dane wejściowe w postaci tekstu, głosu i obrazu, a odpowiedzi są przesyłane strumieniowo w czasie rzeczywistym. To podstawa do tworzenia konwersacyjnych AI przygotowanych do zastosowań produkcyjnych.

Komponent | Jak działa | Step |

Agent | Określa osobowość AI, instrukcje i dostępne narzędzia (np.wyszukiwarkę Google). | Krok 2 |

SessionService | Zachowuje historię rozmów po ponownym nawiązaniu połączenia | Krok 3 |

Biegacz | Orkiestruje cykl życia transmisji strumieniowej, łączy agenta z interfejsem Live API | Krok 3 |

RunConfig | Konfiguruje tryb odpowiedzi (TEXT/AUDIO), transkrypcję i wznawianie sesji. | Krok 4 |

LiveRequestQueue | Ujednolicony interfejs do wysyłania do modelu tekstu, dźwięku i obrazów | Krok 5 |

run_live() | Generator asynchroniczny, który zwraca zdarzenia przesyłane strumieniowo z modelu | Krok 6 |

send_realtime() | Wysyła obiekty blob audio/obrazu jako dane wejściowe do ciągłego strumieniowania. | Krok 7–8 |

Zasoby

Kontynuuj naukę, korzystając z tych oficjalnych zasobów. Przewodnik po pakiecie narzędzi ADK Gemini Live API zawiera więcej informacji o wszystkim, co zostało omówione na tych warsztatach.

Zasób | Adres URL |

Dokumentacja pakietu ADK | |

Przewodnik po pakiecie narzędzi ADK Gemini Live API | |

Gemini Live API | |

Vertex AI Live API | https://cloud.google.com/vertex-ai/generative-ai/docs/live-api |

Repozytorium przykładów pakietu ADK |