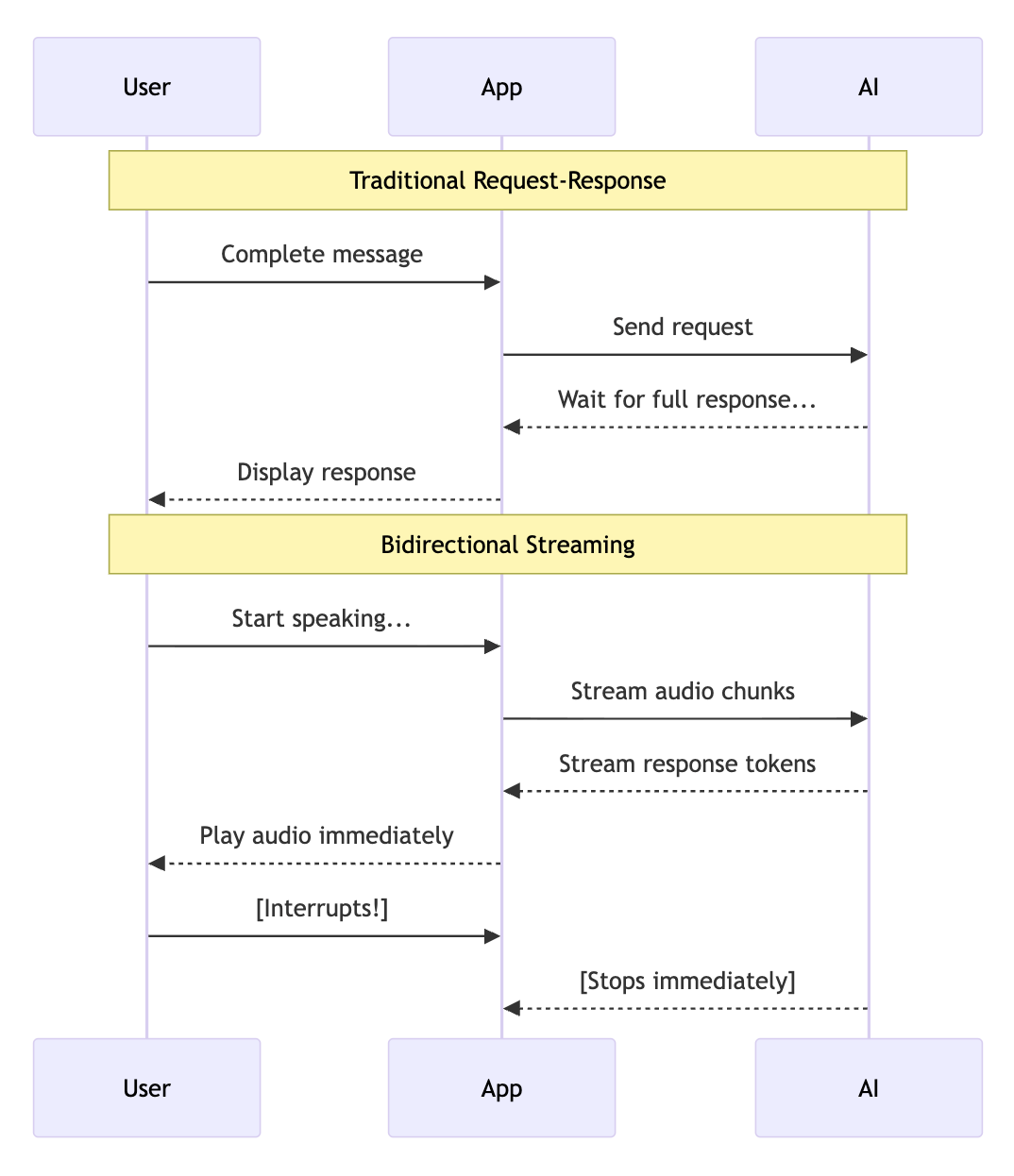

1. O que é streaming Bidi?

O streaming bidirecional (bidi-streaming) permite a comunicação simultânea de duas vias entre seu aplicativo e os modelos de IA. Ao contrário dos padrões tradicionais de solicitação-resposta, em que você envia uma mensagem completa e espera uma resposta completa, o streaming bidirecional permite:

- Entrada contínua: transmita áudio, vídeo ou texto conforme eles são capturados.

- Saída em tempo real: receba respostas de IA à medida que elas são geradas

- Interrupção natural: os usuários podem interromper a IA no meio da resposta, assim como em uma conversa humana.

Por que isso é importante:o streaming bidirecional faz com que as conversas com IA pareçam naturais. A IA pode responder enquanto você ainda está fornecendo contexto, e você pode interrompê-la quando já tiver ouvido o suficiente — exatamente como se estivesse conversando com um humano.

O que é o kit de ferramentas da API Gemini Live do ADK?

O Kit de Desenvolvimento de Agente (ADK) oferece uma abstração de alto nível da API Gemini Live, processando a complexa infraestrutura de streaming em tempo real para que você possa se concentrar na criação do aplicativo.

O kit de ferramentas da API Gemini Live do ADK gerencia:

- Ciclo de vida da conexão: como estabelecer, manter e recuperar conexões WebSocket

- Roteamento de mensagens: direcionamento de áudio, texto e imagens para os manipuladores certos

- Estado da sessão: persistência do histórico de conversas em reconexões

- Execução de ferramentas: chamando e retomando automaticamente das chamadas de função

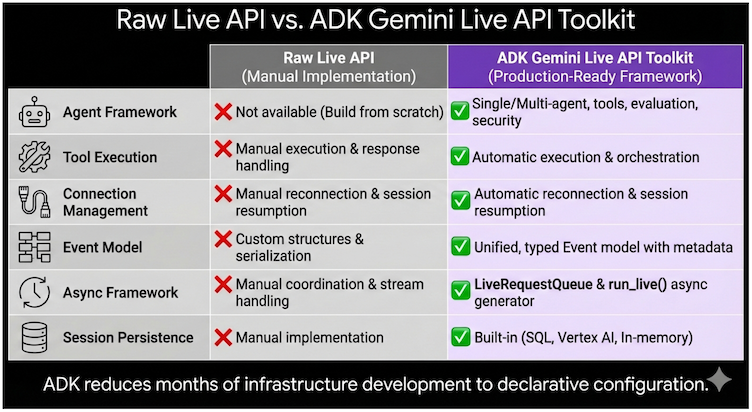

Por que o ADK em vez da API Live bruta?

Você pode criar diretamente na API Gemini Live, mas o ADK lida com a infraestrutura complexa para que você possa se concentrar no aplicativo:

Capacidade | API Raw Live | Kit de ferramentas da API Gemini Live do ADK |

Framework do agente | Criar do zero | Agente único/múltiplo com ferramentas, avaliação e segurança |

Execução da ferramenta | Manuseio manual | Execução paralela automática |

Gerenciamento de conexões | Reconexão manual | Retomada transparente da sessão |

Modelo de evento | Estruturas personalizadas | Objetos de evento unificados e tipados |

Framework assíncrono | Coordenação manual | LiveRequestQueue + gerador run_live() |

Persistência da sessão | Implementação manual | SQL, Vertex AI ou na memória integrados |

Em resumo:o ADK reduz meses de desenvolvimento de infraestrutura para dias de desenvolvimento de aplicativos. Você se concentra no que o agente faz, não em como o streaming funciona.

Casos de uso reais

- Atendimento ao cliente: um cliente mostra a máquina de café com defeito pela câmera do smartphone enquanto explica o problema. A IA identifica o modelo e o ponto de falha, e o cliente pode interromper para corrigir detalhes no meio da conversa.

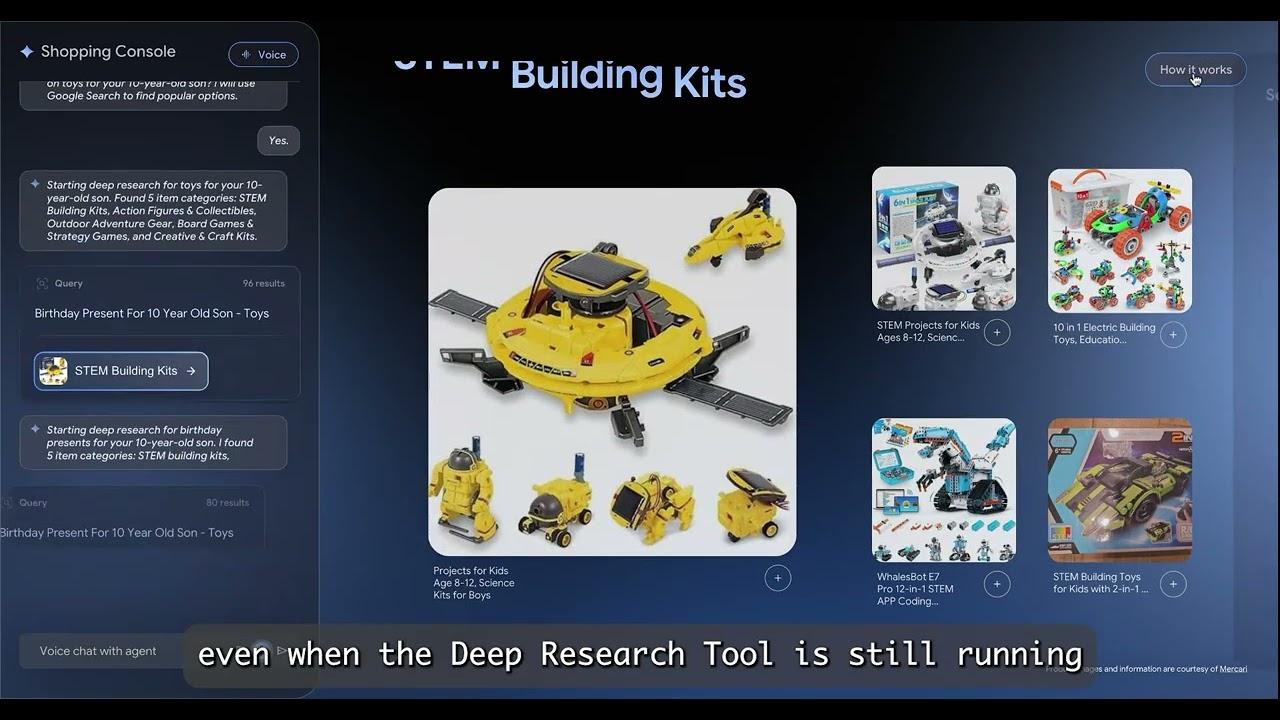

- E-commerce: um comprador mostra uma roupa para a webcam e pede: "Encontre sapatos que combinem com essas calças". O agente analisa o estilo e interage de forma fluida: "Mostre algo mais casual" → "Que tal estes tênis?" → "Adicione os azuis no tamanho 10."

- Field Service: um técnico usando óculos inteligentes transmite a visão dele enquanto pergunta: "Estou ouvindo um ruído estranho desse compressor. Você pode identificar o que é?" O agente oferece orientação detalhada usando viva-voz.

- Saúde: um paciente compartilha um vídeo ao vivo de uma condição de pele. A IA faz uma análise preliminar, faz perguntas para esclarecer e orienta as próximas etapas.

- Serviços financeiros: um cliente analisa o portfólio enquanto o agente mostra gráficos e simula impactos de negociação. O cliente pode compartilhar a tela para discutir artigos de notícias específicos.

Demonstração do Shopper's Concierge 2: demonstração de RAG de agente em tempo real para e-commerce, criada com o ADK Gemini Live API Toolkit e a pesquisa de vetor, embeddings, Feature Store e API Ranking da Vertex AI:

Saiba mais: guia para desenvolvedores

Para uma análise detalhada, consulte o Guia do desenvolvedor do kit de ferramentas da API Gemini Live do ADK, uma série de cinco partes que aborda desde a arquitetura até a implantação em produção:

Parte | Foco | O que você aprenderá |

Base | Arquitetura, plataformas de API ativa, ciclo de vida de quatro fases | |

Upstream | Envio de texto, áudio e vídeo usando LiveRequestQueue | |

Downstream | Processamento de eventos, execução de ferramentas, fluxos de trabalho multiagentes | |

Configuração | Gerenciamento de sessões, cotas, controles de produção | |

Multimodal | Especificações de áudio, arquiteturas de modelo, recursos avançados |

2. Visão geral do workshop

O que você criará

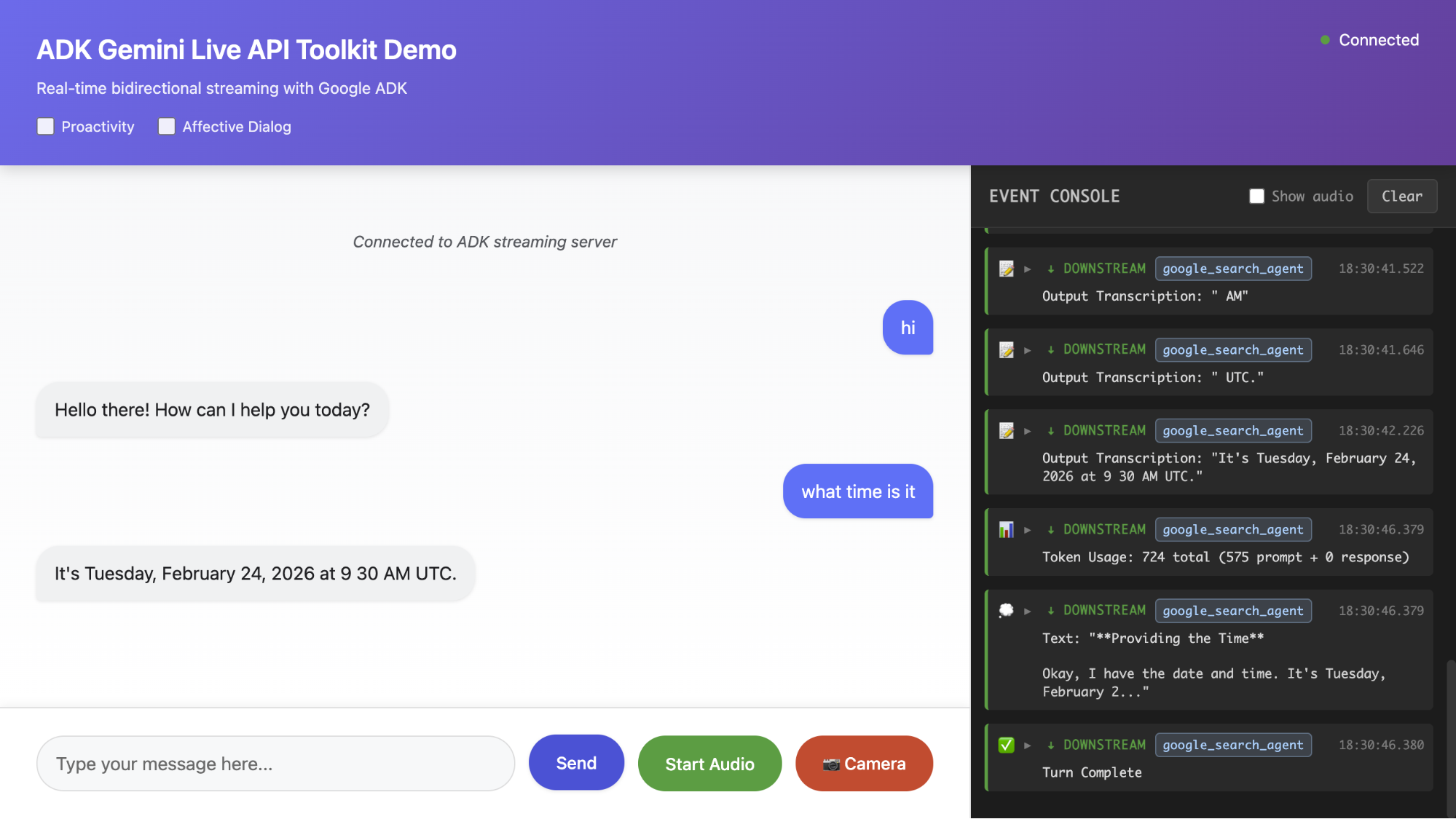

Neste workshop prático, você vai criar um aplicativo de IA de streaming bidirecional completo do zero. Ao final, você terá uma IA de voz funcional que pode:

- Aceitar entradas de texto, áudio e imagem

- Responder com texto de streaming ou fala natural

- Lidar com interrupções naturalmente

- Usar ferramentas como a Pesquisa Google

Ao contrário da leitura de documentação, você examina cada componente etapa por etapa, entendendo como as peças se encaixam à medida que você cria incrementalmente.

Abordagem de aprendizado

Seguimos uma abordagem de build incremental:

- Etapa 1: servidor WebSocket mínimo → resposta "Hello World"

- Etapa 2: adicionar o agente → Definir o comportamento e as ferramentas de IA

- Etapa 3: inicialização do aplicativo → serviço de execução e sessão

- Etapa 4: inicialização da sessão → RunConfig e LiveRequestQueue

- Etapa 5: tarefa upstream → comunicação do cliente com a fila

- Etapa 6: tarefa downstream → eventos para transmissão de cliente

- Etapa 7: adicionar áudio → Entrada e saída de voz

- Etapa 8: adicionar entrada de imagem → IA multimodal

Cada etapa se baseia na anterior. Você vai fazer um teste depois de cada etapa para acompanhar seu progresso.

Pré-requisitos

- Conta do Google Cloud com o faturamento ativado

- Conhecimento básico de Python e programação assíncrona (async/await)

- Navegador da Web com acesso a microfone e webcam (recomendamos o Chrome)

Tempo estimado

- Workshop completo: ~90 minutos

- Versão rápida (somente etapas 1 a 4): ~45 minutos

3. Workshop

Comece o workshop seguindo as instruções aqui:

https://github.com/kazunori279/adk-streaming-guide/blob/main/workshops/workshop.md

4. Finalização e principais conclusões

O que você criou

Você criou um aplicativo de IA de streaming bidirecional completo do zero. O aplicativo processa entradas de texto, voz e imagem com respostas de streaming em tempo real, a base para criar IA de conversação pronta para produção.

Componente | O que ele faz | Etapa |

Agente | Define a personalidade, as instruções e as ferramentas disponíveis da IA (por exemplo, a Pesquisa Google). | Etapa 2 |

SessionService | Mantém o histórico de conversas em reconexões | Etapa 3 |

Executor | Orchestra o ciclo de vida do streaming e conecta o agente à API Live. | Etapa 3 |

RunConfig | Configura a modalidade de resposta (TEXT/AUDIO), a transcrição e a retomada da sessão. | Etapa 4 |

LiveRequestQueue | Interface unificada para enviar texto, áudio e imagens ao modelo | Etapa 5 |

run_live() | Gerador assíncrono que gera eventos de streaming do modelo. | Etapa 6 |

send_realtime() | Envia blobs de áudio/imagem para entrada de streaming contínuo. | Etapas 7 e 8 |

Recursos

Continue aprendendo com estes recursos oficiais. O guia do kit de ferramentas da API Gemini Live do ADK oferece uma cobertura mais detalhada de tudo neste workshop.

Recurso | URL |

Documentação do ADK | |

Guia do kit de ferramentas da API Gemini Live do ADK | |

API Gemini Live | |

API Vertex AI Live | https://cloud.google.com/vertex-ai/generative-ai/docs/live-api |

Repositório de amostras do ADK |