1. Hinweis

Einer der aufregendsten Durchbrüche im Bereich des maschinellen Lernens in letzter Zeit sind Large Language Models (LLMs). Sie können verwendet werden, um Text zu generieren, Sprachen zu übersetzen und Fragen umfassend und informativ zu beantworten. LLMs wie Google LaMDA und PaLM werden mit riesigen Mengen an Textdaten trainiert, wodurch sie die statistischen Muster und Beziehungen zwischen Wörtern und Sätzen lernen können. So können sie Text generieren, der von Menschen verfassten Texten ähnelt, und Sprachen mit hoher Genauigkeit übersetzen.

LLMs sind sehr groß und verbrauchen in der Regel viel Rechenleistung. Daher werden sie normalerweise in der Cloud bereitgestellt und sind aufgrund der begrenzten Rechenleistung auf Mobilgeräten eine große Herausforderung für das On-Device Machine Learning (ODML). Es ist jedoch möglich, kleinere LLMs (z. B. GPT-2) auf einem modernen Android-Gerät auszuführen und dennoch beeindruckende Ergebnisse zu erzielen.

Hier sehen Sie eine Demo der Ausführung einer Version des Google PaLM-Modells mit 1,5 Milliarden Parametern auf dem Google Pixel 7 Pro ohne Wiedergabegeschwindigkeit.

In diesem Codelab lernen Sie die Techniken und Tools kennen, mit denen Sie eine LLM-basierte App erstellen können (mit GPT-2 als Beispielmodell):

- KerasNLP zum Laden eines vortrainierten LLM

- KerasNLP zum Optimieren eines LLM

- TensorFlow Lite zum Konvertieren, Optimieren und Bereitstellen des LLM auf Android

Vorbereitung

- Mittelstufe-Kenntnisse in Keras und TensorFlow Lite

- Grundkenntnisse in der Android-Entwicklung

Lerninhalte

- Verwendung von KerasNLP zum Laden und Optimieren eines vortrainierten LLM

- Quantisierung und Konvertierung eines LLM in TensorFlow Lite

- Ausführen von Inferenz auf dem konvertierten TensorFlow Lite-Modell

Voraussetzungen

- Zugriff auf Colab

- Die neueste Version von Android Studio

- Ein modernes Android-Gerät mit mehr als 4 GB RAM

2. Einrichten

So laden Sie den Code für dieses Codelab herunter:

- Rufen Sie das GitHub-Repository für dieses Codelab auf.

- Klicken Sie auf Code > ZIP herunterladen , um den gesamten Code für dieses Codelab herunterzuladen.

- Entpacken Sie die heruntergeladene ZIP-Datei, um einen Stammordner

examplesmit allen erforderlichen Ressourcen zu entpacken.

3. Start-App ausführen

- Importieren Sie den Ordner

examples/lite/examples/generative_ai/androidin Android Studio. - Starten Sie den Android-Emulator und klicken Sie dann im Navigationsmenü auf

Ausführen.

Ausführen.

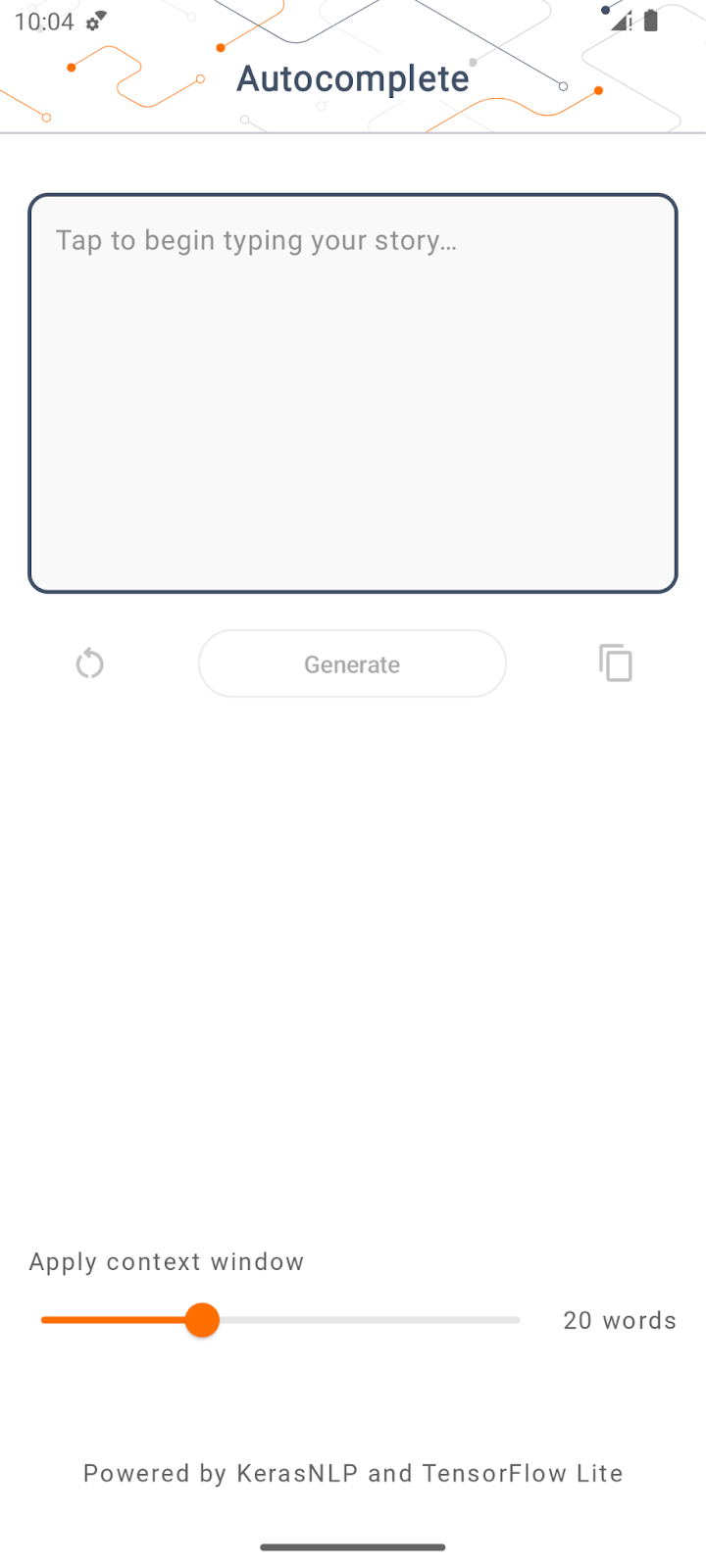

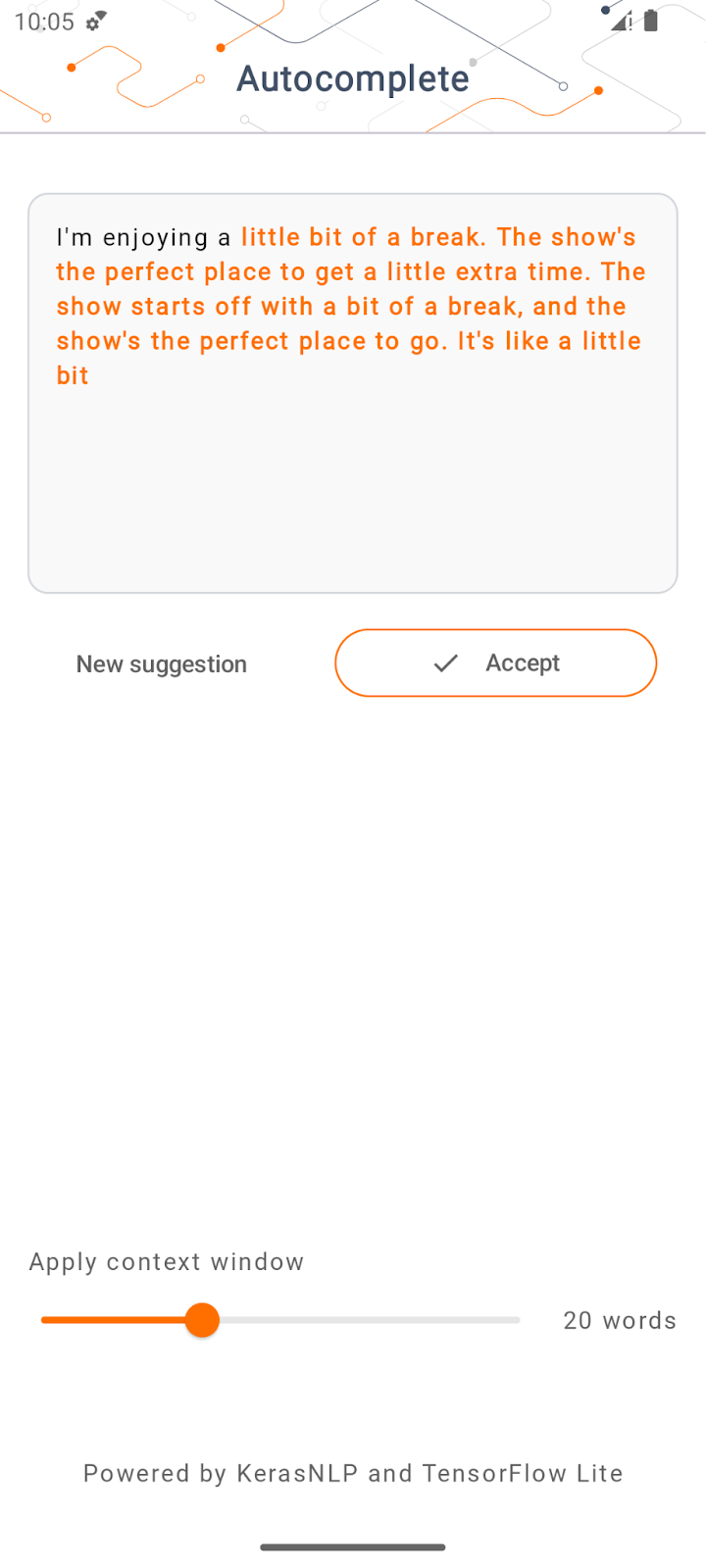

App ausführen und erkunden

Die App sollte auf Ihrem Android-Gerät gestartet werden. Sie heißt „Auto-complete“. Die Benutzeroberfläche ist recht einfach: Sie können einige Startwörter in das Textfeld eingeben und auf Generieren tippen. Die App führt dann eine Inferenz auf einem LLM aus und generiert basierend auf Ihrer Eingabe zusätzlichen Text.

Wenn Sie jetzt nach der Eingabe einiger Wörter auf Generieren tippen, passiert nichts. Das liegt daran, dass noch kein LLM ausgeführt wird.

4. LLM für die Bereitstellung auf dem Gerät vorbereiten

- Öffnen Sie das Colab und arbeiten Sie das Notebook durch, das im GitHub-Repository von TensorFlow Codelabs gehostet wird.

5. Android-App fertigstellen

Nachdem Sie das GPT-2-Modell in TensorFlow Lite konvertiert haben, können Sie es endlich in der App bereitstellen.

Anwendung ausführen

- Ziehen Sie die im letzten Schritt heruntergeladene Modelldatei

autocomplete.tflitein Android Studio in den Ordnerapp/src/main/assets/.

- Klicken Sie im Navigationsmenü auf

Ausführen und warten Sie, bis die App geladen wurde.

Ausführen und warten Sie, bis die App geladen wurde. - Geben Sie einige Startwörter in das Textfeld ein und tippen Sie dann auf Generieren.

6. Hinweise zur verantwortungsbewussten Anwendung von KI

Wie in der ursprünglichen Ankündigung von OpenAI GPT-2 erwähnt, gibt es bemerkenswerte Einschränkungen und Einschränkungen beim GPT-2-Modell. Tatsächlich haben LLMs heute im Allgemeinen einige bekannte Herausforderungen wie Halluzinationen, anstößige Ausgaben, Fairness und Bias. Das liegt daran, dass diese Modelle mit realen Daten trainiert werden, die Probleme aus der realen Welt widerspiegeln.

Dieses Codelab wurde nur erstellt, um zu zeigen, wie Sie mit TensorFlow-Tools eine App erstellen, die auf LLMs basiert. Das in diesem Codelab erstellte Modell dient nur zu Schulungszwecken und ist nicht für die Produktion vorgesehen.

Für die Produktionsnutzung von LLMs ist eine sorgfältige Auswahl der Trainings-Datasets und umfassende Sicherheitsmaßnahmen erforderlich. Weitere Informationen zur verantwortungsbewussten Anwendung von KI im Zusammenhang mit LLMs finden Sie in der technischen Sitzung Safe and Responsible Development with Generative Language Models auf der Google I/O 2023 und im Responsible AI Toolkit.

7. Fazit

Glückwunsch! Sie haben eine App erstellt, mit der Sie kohärenten Text basierend auf Nutzereingaben generieren können, indem Sie ein vortrainiertes Large Language Model ausschließlich auf dem Gerät ausführen.