1. Wprowadzenie

Z tego ćwiczenia dowiesz się, jak przeprowadzać wyszukiwanie hybrydowe w AlloyDB za pomocą rozszerzenia RUM (Ranking Update Method) i indeksu ScaNN (Scalable Nearest Neighbor). Ten moduł należy do kolekcji modułów poświęconych funkcjom AlloyDB AI. Więcej informacji znajdziesz na stronie AlloyDB AI w dokumentacji.

Wymagania wstępne

- Podstawowa wiedza o konsoli Google Cloud

- Podstawowe umiejętności w zakresie interfejsu wiersza poleceń i powłoki Google

Czego się nauczysz

- Jak wdrożyć klaster AlloyDB i instancję główną

- Jak połączyć się z AlloyDB z maszyny wirtualnej Google Compute Engine

- Tworzenie bazy danych i włączanie AlloyDB AI

- Wczytywanie danych do bazy danych

- Jak korzystać z AlloyDB Studio

- Generowanie wektorów dystrybucyjnych za pomocą Vertex AI

- Jak utworzyć indeks wektorowy ScaNN, aby zwiększyć skuteczność wyszukiwania wektorowego

- Jak utworzyć zewnętrzną otoczkę danych (FDW) dla Elasticsearch

- Przeprowadź wyszukiwanie hybrydowe, łącząc wyszukiwanie semantyczne w AlloyDB z wyszukiwaniem pełnotekstowym w Elastic.

Czego potrzebujesz

- Konto Google Cloud i projekt Google Cloud

- przeglądarka, np. Chrome;

2. Konfiguracja i wymagania

Konfiguracja projektu

Zaloguj się w konsoli Google Cloud. Jeśli nie masz jeszcze konta Gmail ani Google Workspace, musisz je utworzyć.

Używaj konta osobistego zamiast konta służbowego lub szkolnego.

Tworzenie projektu Google Cloud

- W konsoli Google Cloud na stronie selektora projektu wybierz lub utwórz projekt w chmurze Google.

- Sprawdź, czy w projekcie Cloud włączone są płatności. Dowiedz się, jak sprawdzić, czy w projekcie są włączone płatności.

Włącz płatności

Aby włączyć płatności, masz 2 możliwości. Możesz użyć osobistego konta rozliczeniowego lub wykorzystać środki, wykonując te czynności.

Konfigurowanie osobistego konta rozliczeniowego

Jeśli skonfigurujesz płatności za pomocą środków w Google Cloud, możesz pominąć ten krok.

Aby skonfigurować osobiste konto rozliczeniowe, włącz płatności w konsoli Google Cloud.

Uwagi:

- Pod względem opłat za zasoby chmury ukończenie tego modułu powinno kosztować mniej niż 3 USD.

- Jeśli chcesz uniknąć dalszych opłat, wykonaj czynności opisane na końcu tego modułu, aby usunąć zasoby.

- Nowi użytkownicy mogą skorzystać z bezpłatnego okresu próbnego, w którym mają do dyspozycji środki w wysokości 300 USD.

Uruchom Cloud Shell

Z Google Cloud możesz korzystać zdalnie na laptopie, ale w tym ćwiczeniu użyjesz Google Cloud Shell, czyli środowiska wiersza poleceń działającego w chmurze.

Cloud Shell to środowisko wiersza poleceń działające w Google Cloud, które zawiera niezbędne narzędzia.

- Kliknij Aktywuj Cloud Shell u góry konsoli Google Cloud.

- Po połączeniu z Cloud Shell sprawdź uwierzytelnianie:

gcloud auth list - Sprawdź, czy projekt jest skonfigurowany:

gcloud config get project - Jeśli projekt nie jest ustawiony zgodnie z oczekiwaniami, ustaw go:

export PROJECT_ID=<YOUR_PROJECT_ID> gcloud config set project $PROJECT_ID

Ta maszyna wirtualna zawiera wszystkie potrzebne narzędzia dla programistów. Zawiera również stały katalog domowy o pojemności 5 GB i działa w Google Cloud, co znacznie zwiększa wydajność sieci i usprawnia proces uwierzytelniania. Wszystkie zadania w tym laboratorium możesz wykonać w przeglądarce. Nie musisz niczego instalować.

3. Zanim zaczniesz

Włącz API

Dane wyjściowe:

Aby korzystać z AlloyDB, Compute Engine, usług sieciowych i Vertex AI, musisz włączyć odpowiednie interfejsy API w projekcie Google Cloud.

Włączanie interfejsów API

W terminalu Cloud Shell sprawdź, czy identyfikator projektu jest skonfigurowany:

gcloud config set project [YOUR-PROJECT-ID]

Ustaw zmienną środowiskową PROJECT_ID:

PROJECT_ID=$(gcloud config get-value project)

Włącz wszystkie niezbędne interfejsy API:

gcloud services enable alloydb.googleapis.com \

compute.googleapis.com \

cloudresourcemanager.googleapis.com \

servicenetworking.googleapis.com \

aiplatform.googleapis.com \

secretmanager.googleapis.com

Oczekiwane dane wyjściowe

student@cloudshell:~ (test-project-001-402417)$ gcloud config set project test-project-001-402417

Updated property [core/project].

student@cloudshell:~ (test-project-001-402417)$ PROJECT_ID=$(gcloud config get-value project)

Your active configuration is: [cloudshell-14650]

student@cloudshell:~ (test-project-001-402417)$

student@cloudshell:~ (test-project-001-402417)$ gcloud services enable alloydb.googleapis.com \

compute.googleapis.com \

cloudresourcemanager.googleapis.com \

servicenetworking.googleapis.com \

aiplatform.googleapis.com \

secretmanager.googleapis.com

Operation "operations/acat.p2-4470404856-1f44ebd8-894e-4356-bea7-b84165a57442" finished successfully.

Przedstawiamy interfejsy API

- AlloyDB API (

alloydb.googleapis.com) umożliwia tworzenie klastrów AlloyDB for PostgreSQL, zarządzanie nimi i ich skalowanie. Jest to usługa bazy danych zgodna z PostgreSQL w pełni zarządzana, która została zaprojektowana z myślą o wymagających firmowych zbiorach zadań transakcyjnych i analitycznych. - Compute Engine API (

compute.googleapis.com) umożliwia tworzenie maszyn wirtualnych, dysków trwałych i ustawień sieciowych oraz zarządzanie nimi. Zapewnia podstawową infrastrukturę jako usługę (IaaS) potrzebną do uruchamiania zbiorów zadań i hostowania infrastruktury bazowej dla wielu usług zarządzanych. - Cloud Resource Manager API (

cloudresourcemanager.googleapis.com) umożliwia zautomatyzowane zarządzanie metadanymi i konfiguracją projektu Google Cloud. Umożliwia organizowanie zasobów, obsługę zasad Identity and Access Management (IAM) i weryfikowanie uprawnień w hierarchii projektu. - Service Networking API (

servicenetworking.googleapis.com) umożliwia automatyzację konfiguracji prywatnej łączności między siecią Virtual Private Cloud (VPC) a usługami zarządzanymi Google. Jest to szczególnie ważne w przypadku ustanawiania dostępu do usług za pomocą prywatnego adresu IP, np. w przypadku AlloyDB, aby mogły one bezpiecznie komunikować się z innymi zasobami. - Interfejs Vertex AI API (

aiplatform.googleapis.com) umożliwia aplikacjom tworzenie, wdrażanie i skalowanie modeli uczenia maszynowego. Zapewnia on ujednolicony interfejs dla wszystkich usług AI w Google Cloud, w tym dostęp do modeli generatywnej AI (takich jak Gemini) i trenowania modeli niestandardowych. - Secret Manager API (

secretmanager.googleapis.com) to usługa zarządzania danymi tajnymi i informacjami logowania, która umożliwia przechowywanie i zarządzanie danymi wrażliwymi, takimi jak klucze API, nazwy użytkowników, hasła, certyfikaty itp.

Opcjonalnie możesz skonfigurować domyślny region, aby używać modeli wektorów dystrybucyjnych Vertex AI. Więcej informacji o lokalizacjach, w których dostępna jest usługa Vertex AI W przykładzie używamy regionu us-central1.

gcloud config set compute/region us-central1

4. Wdrażanie AlloyDB

Przed utworzeniem klastra AlloyDB musimy mieć dostępny zakres prywatnych adresów IP w naszej sieci VPC, który będzie używany przez przyszłą instancję AlloyDB. Jeśli go nie mamy, musimy go utworzyć i przypisać do użytku przez wewnętrzne usługi Google. Dopiero wtedy będziemy mogli utworzyć klaster i instancję.

Tworzenie prywatnego zakresu adresów IP

Musimy skonfigurować prywatny dostęp do usług w naszej sieci VPC dla AlloyDB. Zakładamy, że w projekcie mamy sieć VPC „default”, która będzie używana do wszystkich działań.

Utwórz zakres prywatnych adresów IP:

gcloud compute addresses create psa-range \

--global \

--purpose=VPC_PEERING \

--prefix-length=24 \

--description="VPC private service access" \

--network=default

Utwórz połączenie prywatne, używając przydzielonego zakresu adresów IP:

gcloud services vpc-peerings connect \

--service=servicenetworking.googleapis.com \

--ranges=psa-range \

--network=default \

--export-custom-routes

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-402417)$ gcloud compute addresses create psa-range \

--global \

--purpose=VPC_PEERING \

--prefix-length=24 \

--description="VPC private service access" \

--network=default

Created [https://www.googleapis.com/compute/v1/projects/test-project-402417/global/addresses/psa-range].

student@cloudshell:~ (test-project-402417)$ gcloud services vpc-peerings connect \

--service=servicenetworking.googleapis.com \

--ranges=psa-range \

--network=default

Operation "operations/pssn.p24-4470404856-595e209f-19b7-4669-8a71-cbd45de8ba66" finished successfully.

student@cloudshell:~ (test-project-402417)$

Tworzenie klastra AlloyDB

W tej sekcji utworzymy klaster AlloyDB w regionie us-central1.

Określ hasło użytkownika postgres. Możesz zdefiniować własne hasło lub użyć funkcji losowej, aby je wygenerować.

export PGPASSWORD=`openssl rand -hex 12`

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-402417)$ export PGPASSWORD=`openssl rand -hex 12`

Zapisz hasło do PostgreSQL, aby użyć go w przyszłości.

echo $PGPASSWORD

To hasło będzie Ci potrzebne w przyszłości do połączenia z instancją jako użytkownik postgres. Proponuję skopiować go w bezpieczne miejsce (np. do menedżera haseł).

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-402417)$ echo $PGPASSWORD <generated password>

Tworzenie klastra AlloyDB

Określ region i nazwę klastra AlloyDB. Użyjemy regionu us-central1 i nazwy klastra alloydb-hybrid-search:

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

Uruchom polecenie, aby utworzyć klaster:

gcloud alloydb clusters create $ADBCLUSTER \

--password=$PGPASSWORD \

--network=default \

--region=$REGION

Oczekiwane dane wyjściowe konsoli:

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

gcloud alloydb clusters create $ADBCLUSTER \

--password=$PGPASSWORD \

--network=default \

--region=$REGION

Operation ID: operation-1697655441138-6080235852277-9e7f04f5-2012fce4

Creating cluster...done.

Utwórz instancję główną AlloyDB dla klastra w tej samej sesji Cloud Shell. Jeśli połączenie zostanie przerwane, musisz ponownie zdefiniować zmienne środowiskowe regionu i nazwy klastra.

gcloud alloydb instances create $ADBCLUSTER-pr \

--instance-type=PRIMARY \

--cpu-count=2 \

--region=$REGION \

--cluster=$ADBCLUSTER

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (alloydb-hybrid-search)$ gcloud alloydb instances create $ADBCLUSTER-pr \

--instance-type=PRIMARY \

--cpu-count=2 \

--region=$REGION \

--availability-type ZONAL \

--cluster=$ADBCLUSTER

Operation ID: operation-1697659203545-6080315c6e8ee-391805db-25852721

Creating instance...done.

5. Łączenie z AlloyDB

AlloyDB jest wdrażana przy użyciu połączenia prywatnego, więc do pracy z bazą danych potrzebujemy maszyny wirtualnej z zainstalowanym klientem PostgreSQL. Użyjemy tej maszyny wirtualnej również do uruchomienia instancji Elasticsearch.

Wdrażanie maszyny wirtualnej GCE

Utwórz maszynę wirtualną GCE w tym samym regionie i sieci VPC co klaster AlloyDB. Upewnij się, że dysk rozruchowy jest wystarczająco duży, aby można było uruchomić Elastic. W tym przypadku w parametrze --create-disk określamy dysk rozruchowy o rozmiarze 20 GB.

W Cloud Shell wykonaj to polecenie:

export ZONE=us-central1-a

gcloud compute instances create instance-1 \

--zone=$ZONE \

--create-disk=auto-delete=yes,boot=yes,size=20,image=projects/debian-cloud/global/images/$(gcloud compute images list --filter="family=debian-12 AND family!=debian-12-arm64" --format="value(name)") \

--scopes=https://www.googleapis.com/auth/cloud-platform

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (alloydb-hybrid-search)$ export ZONE=us-central1-a

student@cloudshell:~ (talloydb-hybrid-search)$ export ZONE=us-central1-a

gcloud compute instances create instance-1 \

--zone=$ZONE \

--create-disk=auto-delete=yes,boot=yes,image=projects/debian-cloud/global/images/$(gcloud compute images list --filter="family=debian-12 AND family!=debian-12-arm64" --format="value(name)") \

--scopes=https://www.googleapis.com/auth/cloud-platform

Created [https://www.googleapis.com/compute/v1/projects/test-project-402417/zones/us-central1-a/instances/instance-1].

NAME: instance-1

ZONE: us-central1-a

MACHINE_TYPE: n1-standard-1

PREEMPTIBLE:

INTERNAL_IP: 10.128.0.2

EXTERNAL_IP: 34.71.192.233

STATUS: RUNNING

Instalowanie klienta Postgres

Zainstaluj oprogramowanie klienta PostgreSQL na wdrożonej maszynie wirtualnej.

Połącz się z maszyną wirtualną:

gcloud compute ssh instance-1 --zone=us-central1-a

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (alloydb-hybrid-search)$ gcloud compute ssh instance-1 --zone=us-central1-a Updating project ssh metadata...working..Updated [https://www.googleapis.com/compute/v1/projects/alloydb-hybrid-search]. Updating project ssh metadata...done. Waiting for SSH key to propagate. Warning: Permanently added 'compute.5110295539541121102' (ECDSA) to the list of known hosts. Linux instance-1.us-central1-a.c.gleb-test-short-001-418811.internal 6.1.0-18-cloud-amd64 #1 SMP PREEMPT_DYNAMIC Debian 6.1.76-1 (2024-02-01) x86_64 The programs included with the Debian GNU/Linux system are free software; the exact distribution terms for each program are described in the individual files in /usr/share/doc/*/copyright. Debian GNU/Linux comes with ABSOLUTELY NO WARRANTY, to the extent permitted by applicable law. student@instance-1:~$

Zainstaluj oprogramowanie, uruchamiając w maszynie wirtualnej to polecenie:

sudo apt-get update

sudo apt-get install --yes postgresql-client

Oczekiwane dane wyjściowe konsoli:

student@instance-1:~$ sudo apt-get update sudo apt-get install --yes postgresql-client Get:1 https://packages.cloud.google.com/apt google-compute-engine-bullseye-stable InRelease [5146 B] Get:2 https://packages.cloud.google.com/apt cloud-sdk-bullseye InRelease [6406 B] Hit:3 https://deb.debian.org/debian bullseye InRelease Get:4 https://deb.debian.org/debian-security bullseye-security InRelease [48.4 kB] Get:5 https://packages.cloud.google.com/apt google-compute-engine-bullseye-stable/main amd64 Packages [1930 B] Get:6 https://deb.debian.org/debian bullseye-updates InRelease [44.1 kB] Get:7 https://deb.debian.org/debian bullseye-backports InRelease [49.0 kB] ...redacted... update-alternatives: using /usr/share/postgresql/13/man/man1/psql.1.gz to provide /usr/share/man/man1/psql.1.gz (psql.1.gz) in auto mode Setting up postgresql-client (13+225) ... Processing triggers for man-db (2.9.4-2) ... Processing triggers for libc-bin (2.31-13+deb11u7) ...

Łączenie się z instancją

Połącz się z instancją podstawową z maszyny wirtualnej za pomocą psql.

Na tej samej karcie Cloud Shell, na której otwarto sesję SSH z maszyną wirtualną instance-1.

Aby połączyć się z AlloyDB z maszyny wirtualnej GCE, użyj podanej wartości hasła AlloyDB (PGPASSWORD) i identyfikatora klastra AlloyDB:

export PGPASSWORD=<Noted password>

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

export INSTANCE_IP=$(gcloud alloydb instances describe $ADBCLUSTER-pr --cluster=$ADBCLUSTER --region=$REGION --format="value(ipAddress)")

psql "host=$INSTANCE_IP user=postgres sslmode=require"

Oczekiwane dane wyjściowe konsoli:

student@instance-1:~$ export PGPASSWORD=<noted password> student@instance-1:~$ ADBCLUSTER=alloydb-aip-01 student@instance-1:~$ REGION=us-central1 student@instance-1:~$ INSTANCE_IP=$(gcloud alloydb instances describe $ADBCLUSTER-pr --cluster=$ADBCLUSTER --region=$REGION --format="value(ipAddress)") gleb@instance-1:~$ psql "host=$INSTANCE_IP user=postgres sslmode=require" psql (15.6 (Debian 15.6-0+deb12u1), server 15.5) SSL connection (protocol: TLSv1.3, cipher: TLS_AES_256_GCM_SHA384, compression: off) Type "help" for help. postgres=>

Zamknij sesję psql:

exit

6. Przygotowywanie bazy danych

Musimy utworzyć bazę danych, włączyć integrację z Vertex AI, utworzyć obiekty bazy danych i zaimportować dane.

Przyznawanie AlloyDB niezbędnych uprawnień

Dodaj uprawnienia Vertex AI do agenta usługi AlloyDB.

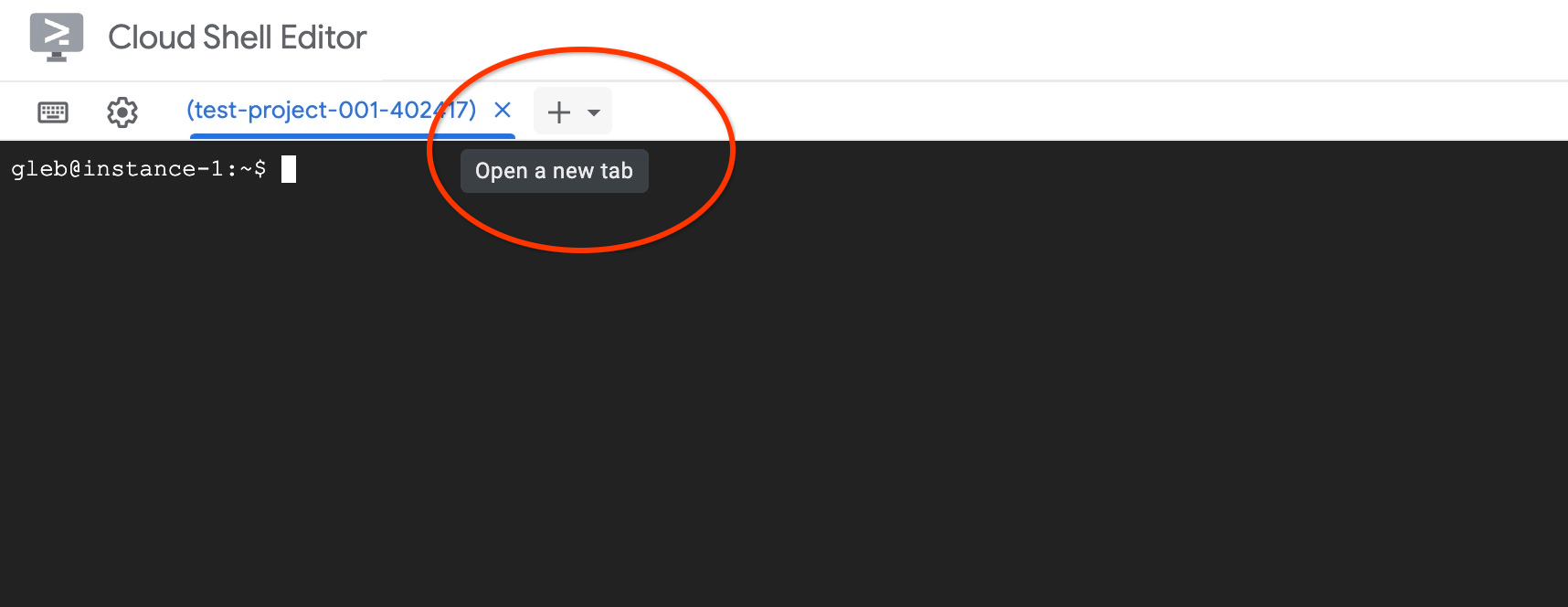

Otwórz kolejną kartę Cloud Shell, klikając znak „+” u góry.

Na nowej karcie Cloud Shell wykonaj to polecenie:

PROJECT_ID=$(gcloud config get-value project)

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:service-$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/aiplatform.user"

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-001-402417)$ PROJECT_ID=$(gcloud config get-value project) Your active configuration is: [cloudshell-11039] student@cloudshell:~ (test-project-001-402417)$ gcloud projects add-iam-policy-binding $PROJECT_ID \ --member="serviceAccount:service-$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")@gcp-sa-alloydb.iam.gserviceaccount.com" \ --role="roles/aiplatform.user" Updated IAM policy for project [test-project-001-402417]. bindings: - members: - serviceAccount:service-4470404856@gcp-sa-alloydb.iam.gserviceaccount.com role: roles/aiplatform.user - members: ... etag: BwYIEbe_Z3U= version: 1

Zamknij kartę, klikając „X” lub wykonując polecenie:

exit

Utwórz bazę danych

Utwórz bazę danych o nazwie quickstart.

W sesji maszyny wirtualnej GCE wykonaj to polecenie:

Utwórz bazę danych:

psql "host=$INSTANCE_IP user=postgres" -c "CREATE DATABASE quickstart_db"

Oczekiwane dane wyjściowe konsoli:

student@instance-1:~$ psql "host=$INSTANCE_IP user=postgres" -c "CREATE DATABASE quickstart_db" CREATE DATABASE student@instance-1:~$

Włączanie integracji z Vertex AI

Włącz integrację z Vertex AI i rozszerzenia pgvector w bazie danych.

Na maszynie wirtualnej GCE wykonaj te czynności:

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS google_ml_integration CASCADE"

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS vector"

Oczekiwane dane wyjściowe konsoli:

student@instance-1:~$ psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS google_ml_integration CASCADE" psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS vector" CREATE EXTENSION CREATE EXTENSION student@instance-1:~$

Importowanie danych

Pobierz przygotowane dane i zaimportuj je do nowej bazy danych.

Na maszynie wirtualnej GCE wykonaj te czynności:

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_demo_schema.sql |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_products from stdin csv header"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_inventory.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_inventory from stdin csv header"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_stores.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_stores from stdin csv header"

Oczekiwane dane wyjściowe konsoli:

student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_demo_schema.sql |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" SET SET SET SET SET set_config ------------ (1 row) SET SET SET SET SET SET CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE SEQUENCE ALTER TABLE ALTER SEQUENCE ALTER TABLE ALTER TABLE ALTER TABLE student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_products from stdin csv header" COPY 941 student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_inventory.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_inventory from stdin csv header" COPY 263861 student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_stores.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_stores from stdin csv header" COPY 4654 student@instance-1:~$

Następnie ustaw niezbędne flagi bazy danych. Możesz użyć konsoli internetowej i zarządzać flagami w instancji podstawowej lub użyć polecenia gcloud w ten sposób:

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

gcloud beta alloydb instances update $ADBCLUSTER-pr \

--database-flags google_ml_integration.enable_faster_embedding_generation=on,scann.enable_preview_features=on,google_ml_integration.enable_preview_ai_functions=on,google_ml_integration.enable_ai_query_engine=on \

--region=$REGION \

--cluster=$ADBCLUSTER \

--project=$PROJECT_ID \

--update-mode=FORCE_APPLY

Oczekiwane dane wyjściowe konsoli

export PROJECT_ID=$(gcloud config get-value project) export REGION=us-central1 export ADBCLUSTER=alloydb-hybrid-search gcloud beta alloydb instances update $ADBCLUSTER-pr \ --database-flags google_ml_integration.enable_faster_embedding_generation=on,scann.enable_preview_features=on,google_ml_integration.enable_preview_ai_functions=on,google_ml_integration.enable_ai_query_engine=on \ --region=$REGION \ --cluster=$ADBCLUSTER \ --project=$PROJECT_ID \ --update-mode=FORCE_APPLY Your active configuration is: [cloudshell-724] Operation ID: operation-1775159889986-64e7f9ea9858a-b031e866-4c7c36df

Włączenie flag bazy danych wymaga ponownego uruchomienia instancji i potrwa kilka minut. Po zakończeniu stan instancji AlloyDB zmieni się na „Gotowa”.

7. Generowanie wektorów dystrybucyjnych

Po zaimportowaniu danych mamy te tabele: cymbal_products, która zawiera informacje o produktach, cymbal_inventory, która śledzi stan magazynowy każdego produktu w każdym sklepie, oraz cymbal_stores, która jest listą sklepów. Aby przeprowadzić wyszukiwanie semantyczne w naszych produktach, musimy wygenerować osadzenia wektorowe opisów produktów za pomocą funkcji initialize_embeddings. Użyjemy integracji Vertex AI, aby obliczyć dane wektorowe na podstawie opisów produktów i dodać je do tabeli. Więcej informacji o używanej technologii znajdziesz w dokumentacji.

Aby skorzystać z integracji, połącz się z bazą danych za pomocą AlloyDB Studio lub psql z maszyny wirtualnej, używając adresu IP instancji AlloyDB i hasła postgres:

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db"

Sprawdź wersję rozszerzenia google_ml_integration.

SELECT extversion FROM pg_extension WHERE extname = 'google_ml_integration';

Wersja powinna być co najmniej 1.5.2. Oto przykład danych wyjściowych:

quickstart_db=> SELECT extversion FROM pg_extension WHERE extname = 'google_ml_integration'; extversion ------------ 1.5.2 (1 row)

Domyślna wersja powinna być nowsza niż 1.5.2, ale jeśli Twoja instancja pokazuje starszą wersję, prawdopodobnie wymaga aktualizacji. Sprawdź, czy konserwacja została wyłączona w przypadku instancji.

Zainstaluj rozszerzenie wektorowe i utwórz nową kolumnę do przechowywania wektorów dystrybucyjnych w cymbal_products.

CREATE EXTENSION IF NOT EXISTS vector;

ALTER TABLE cymbal_products ADD COLUMN product_embedding vector(768);

Oczekiwane dane wyjściowe konsoli:

quickstart_db=> ALTER TABLE cymbal_products ADD COLUMN product_embedding vector(768); ALTER TABLE quickstart_db=>

Aby zwiększyć efektywność, będziemy korzystać z generowania zbiorczego. Więcej informacji o różnych opcjach i technikach generowania wektorów dystrybucyjnych znajdziesz w tym przewodniku. Wcześniej włączyliśmy flagę goole_ml_integration.enable_faster_embedding_generation, która umożliwia zbiorcze generowanie umieszczania.

Na koniec chcemy też, aby osadzanie odświeżało się, gdy wartości kolumn są zmieniane przez uwzględnienie argumentu incremental_refresh_mode w wywołaniu funkcji. Zwiększa to obciążenie naszej bazy danych, ale jest to kompromis, na który się decydujemy, aby automatycznie synchronizować osadzanie z treściami. Jeśli chcesz ręcznie zaktualizować osadzanie, instrukcje znajdziesz w dokumentacji.

Teraz, aby połączyć to wszystko i wygenerować wektory, używamy funkcji initialize_embeddings i przekazujemy batch_size o wartości 50 jako wskazówkę dotyczącą partii oraz ustawiamy incremental_refresh_mode na transactional.

CALL ai.initialize_embeddings(

model_id => 'text-embedding-005',

table_name => 'cymbal_products',

content_column => 'product_description',

embedding_column => 'product_embedding',

batch_size => 50,

incremental_refresh_mode => 'transactional'

);

Jeśli teraz wstawimy do tabeli nowy wiersz z wartością NULL w kolumnie product_embedding,

INSERT INTO "cymbal_products" ("uniq_id", "crawl_timestamp", "product_url", "product_name", "product_description", "list_price", "sale_price", "brand", "item_number", "gtin", "package_size", "category", "postal_code", "available", "product_embedding") VALUES ('fd604542e04b470f9e6348e640cff794', NOW(), 'https://example.com/new_product', 'New Cymbal Product', 'This is a new cymbal product description.', 199.99, 149.99, 'Example Brand', 'EB123', '1234567890', 'Single', 'Cymbals', '12345', TRUE, NULL);

Gdy teraz zapytamy o wiersz, który właśnie wstawiliśmy, zobaczymy, że kolumna product_embedding została automatycznie zaktualizowana.

SELECT uniq_id, (product_embedding::real[])[1:5] as product_embedding FROM cymbal_products WHERE uniq_id='fd604542e04b470f9e6348e640cff794';

Dane wyjściowe powinny wyglądać mniej więcej tak:

quickstart_db=> SELECT uniq_id,(product_embedding::real[])[1:5] as product_embedding FROM cymbal_products WHERE uniq_id='fd604542e04b470f9e6348e640cff794';

uniq_id | product_embedding

----------------------------------+---------------------------------------------------------------

fd604542e04b470f9e6348e640cff794 | {0.015003494,-0.005349732,-0.059790313,-0.0087091,-0.0271452}

(1 row)

Time: 3.295 ms

8. Tworzenie indeksu wektorowego

Aby zwiększyć skuteczność wyszukiwania wektorowego, dodamy indeks ScaNN.

Tworzenie indeksu ScaNN

Aby utworzyć indeks SCANN, musimy włączyć jeszcze jedno rozszerzenie. Rozszerzenie alloydb_scann udostępnia interfejs do pracy z indeksem wektorowym typu ANN za pomocą algorytmu ScaNN Google.

CREATE EXTENSION IF NOT EXISTS alloydb_scann;

Oczekiwane dane wyjściowe:

quickstart_db=> CREATE EXTENSION IF NOT EXISTS alloydb_scann; CREATE EXTENSION Time: 27.468 ms quickstart_db=>

Indeks można utworzyć w trybie RĘCZNYM lub AUTOMATYCZNYM. Tryb RĘCZNY jest domyślnie włączony. Możesz utworzyć indeks i zarządzać nim tak jak każdym innym indeksem. Jeśli jednak włączysz tryb AUTOMATYCZNY, możesz utworzyć indeks, który nie wymaga od Ciebie żadnej konserwacji. Szczegółowe informacje o wszystkich opcjach znajdziesz w dokumentacji. W naszym przypadku nie mamy wystarczającej liczby wierszy, aby utworzyć indeks w trybie AUTO, więc utworzymy go w trybie MANUAL i uwzględnimy parametry dostrajania. Więcej informacji o dostrajaniu parametrów indeksu znajdziesz w dokumentacji.

CREATE INDEX cymbal_products_embeddings_scann ON cymbal_products

USING scann (product_embedding cosine)

WITH (mode='MANUAL', num_leaves=31, max_num_levels = 2);

Oczekiwane dane wyjściowe:

quickstart_db=> CREATE INDEX cymbal_products_embeddings_scann ON cymbal_products USING scann (product_embedding cosine) WITH (num_leaves=31, max_num_levels = 2); CREATE INDEX quickstart_db=>

Sprawdzanie użycia indeksu

Teraz możemy uruchomić zapytanie w ramach wyszukiwania wektorowego w trybie EXPLAIN i sprawdzić, czy indeks jest używany.

EXPLAIN (analyze)

WITH trees as (

SELECT

cp.product_name,

left(cp.product_description,80) as description,

cp.sale_price,

cs.zip_code,

cp.uniq_id as product_id

FROM

cymbal_products cp

JOIN cymbal_inventory ci on

ci.uniq_id=cp.uniq_id

JOIN cymbal_stores cs on

cs.store_id=ci.store_id

AND ci.inventory>0

AND cs.store_id = 1583

ORDER BY

(cp.product_embedding <=> embedding('text-embedding-005','What kind of fruit trees grow well here?')::vector) ASC

LIMIT 1)

SELECT json_agg(trees) FROM trees;

Oczekiwane dane wyjściowe (w celu uniknięcia wątpliwości):

... Aggregate (cost=16.59..16.60 rows=1 width=32) (actual time=2.875..2.877 rows=1 loops=1) -> Subquery Scan on trees (cost=8.42..16.59 rows=1 width=142) (actual time=2.860..2.862 rows=1 loops=1) -> Limit (cost=8.42..16.58 rows=1 width=158) (actual time=2.855..2.856 rows=1 loops=1) -> Nested Loop (cost=8.42..6489.19 rows=794 width=158) (actual time=2.854..2.855 rows=1 loops=1) -> Nested Loop (cost=8.13..6466.99 rows=794 width=938) (actual time=2.742..2.743 rows=1 loops=1) -> Index Scan using cymbal_products_embeddings_scann on cymbal_products cp (cost=7.71..111.99 rows=876 width=934) (actual time=2.724..2.724 rows=1 loops=1) Order By: (embedding <=> '[0.008864171,0.03693164,-0.024245683,-0.00355923,0.0055611245,0.015985578,...<redacted>...5685,-0.03914233,-0.018452475,0.00826032,-0.07372604]'::vector) ...

Z danych wyjściowych wyraźnie widać, że zapytanie używało „Index Scan using cymbal_products_embeddings_scann on cymbal_products”.

9. Tworzenie instancji elastycznej

Elasticsearch jest znakiem towarowym Elastic NV i nie jest powiązany z Google LLC. W przypadku wyszukiwania pełnotekstowego w wyszukiwaniu hybrydowym będziemy używać Elasticsearch. Jeśli masz instancję Elasticsearch, możesz pominąć te kroki i utworzyć klucz interfejsu API tylko do odczytu, którego AlloyDB może używać do uzyskiwania dostępu do klastra Elasticsearch. W przeciwnym razie możesz uruchomić instancję Elasticsearch na utworzonej wcześniej maszynie wirtualnej.

Połącz się z maszyną wirtualną przez SSH i zainstaluj Dockera

sudo apt-get update

sudo apt-get install -y ca-certificates curl gnupg

sudo install -m 0755 -d /etc/apt/keyrings

curl -fsSL https://download.docker.com/linux/debian/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

echo \

"deb [arch="$(dpkg --print-architecture)" signed-by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/debian \

"$(. /etc/os-release && echo "$VERSION_CODENAME")" stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt-get update

sudo apt-get install -y docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

Teraz możesz zmodyfikować polecenie Dockera, które ma być uruchamiane przez użytkownika.

sudo usermod -aG docker $USER

newgrp docker

Aby utworzyć elastyczny kontener, wykonaj w terminalu maszyny wirtualnej to polecenie:

curl -fsSL https://elastic.co/start-local | sh

Oczekiwane dane wyjściowe (z redakcją)

🎉 Congrats, Elasticsearch and Kibana are installed and running in Docker! 🌐 Open your browser at http://localhost:5601 Username: elastic Password: [password_value] 🔌 Elasticsearch API endpoint: http://localhost:9200 🔑 API key: [API Key] Learn more at https://github.com/elastic/start-local

Skopiuj dane wyjściowe i wklej je do tego pliku:

nano elastic-last-run.txt

Aby zapisać i zamknąć plik, naciśnij Ctrl + O, Enter, Ctrl + X.

Domyślnie kontener Dockera nasłuchuje na porcie http://localhost:9200 i może mieć problemy z otrzymywaniem zewnętrznych żądań z AlloyDB. Musimy skonfigurować docker-compose.yml, aby nasłuchiwał na 9200:9200

Po uruchomieniu skryptu powinien zostać utworzony nowy katalog elastic-start-local. Otwórz ten katalog i edytuj plik Dockerfile.

cd elastic-start-local/

nano docker-compose.yml

U góry znajdziesz

elasticsearch:

image: docker.elastic.co/elasticsearch/elasticsearch:${ES_LOCAL_VERSION}

container_name: ${ES_LOCAL_CONTAINER_NAME}

volumes:

- dev-elasticsearch:/usr/share/elasticsearch/data

ports:

- localhost:9200

Zmień pole ports na

ports:

- 9200:9200

Zapisz i zamknij, naciskając Ctrl + O, Enter, Ctrl + X. Teraz uruchom ponownie stos.

docker compose up -d

Teraz wypełnimy instancję Elastic opisami i nazwami produktów. Skopiuj plik CSV z produktami z Cloud Storage na maszynę wirtualną.

gcloud storage cp gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv .

Oczekiwane dane wyjściowe

gcloud storage cp gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv . Copying gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv to file://./cymbal_products.csv Completed files 1/1 | 1.4MiB/1.4MiB Average throughput: 147.9MiB/s

Teraz utwórz skrypt w języku Python, aby wyodrębnić plik CSV i sformatować dane do formatu NDJSON na potrzeby przesyłania zbiorczego.

nano convert.py

Wklej do pliku ten kod:

import csv

import json

# Configuration

input_file = 'cymbal_products.csv'

output_file = 'products.json'

index_name = 'elasticindexdemo'

def convert():

try:

with open(input_file, mode='r', encoding='utf-8') as f_in, \

open(output_file, mode='w', encoding='utf-8') as f_out:

reader = csv.DictReader(f_in)

count = 0

for row in reader:

metadata = {

"index": {

"_index": index_name,

"_id": row['uniq_id'].strip()

}

}

# 2. Data/Source line

document = {

"uniq_id": row['uniq_id'].strip(),

"product_name": row['product_name'].strip(),

"product_description": row['product_description'].strip()

}

# Write to file

f_out.write(json.dumps(metadata) + '\n')

f_out.write(json.dumps(document) + '\n')

count += 1

print(f"Success: Processed {count} products.")

print(f"Output saved to: {output_file}")

except Exception as e:

print(f"An error occurred: {e}")

if __name__ == "__main__":

convert()

Zapisz plik i go uruchom.

python3 convert.py

Oczekiwane dane wyjściowe

~$ python3 convert.py Success: Processed 941 products. Output saved to: products.json

W przypadku zbiorczego wczytywania danych musimy pobrać klucz interfejsu API z poprzedniego pliku uruchomienia i użyć go do autoryzacji w instancji. Następnie przekazywany jest utworzony wcześniej plik JSON. W przypadku środowisk produkcyjnych najlepiej jest zdefiniować indeks i typy danych w Elasticsearch. Zbiór danych w tym laboratorium jest niewielki, więc pozwalamy Elasticsearchowi zarządzać danymi. Najpierw pobierz klucz interfejsu API z pliku i zapisz go w zmiennej.

AUTH_HDR=$(grep "API key" elastic-last-run.txt | sed -e "s/^.*API key:[[:space:]]*/ApiKey /g")

Używając zapisanej zmiennej, uruchom to polecenie cURL, które przesyła dane z pliku JSON.

curl -s -X POST "localhost:9200/elasticindexdemo/_bulk?pretty" \

-H "Content-Type: application/x-ndjson" \

-H "Authorization: $AUTH_HDR" \

--data-binary "@products.json"

Oczekiwane dane wyjściowe

~$ curl -s -X POST "localhost:9200/elasticindexdemo/_bulk?pretty" \

-H "Content-Type: application/x-ndjson" \

-H "Authorization: $AUTH_HDR" \

--data-binary "@products.json"

{

"errors" : false,

"took" : 1003,

"items" : [

{

"index" : {

"_index" : "elasticindexdemo",

"_id" : "a73d5f754f225ecb9fdc64232a57bc37",

"_version" : 1,

"result" : "created",

"_shards" : {

"total" : 2,

"successful" : 1,

"failed" : 0

},

"_seq_no" : 0,

"_primary_term" : 1,

"status" : 201

}

},

...]

}

Done

Na koniec musimy pobrać klucz interfejsu API instancji Elasticsearch, aby zapisać go do użycia przez AlloyDB. Uruchom to polecenie i skopiuj wartość klucza interfejsu API.

cat elastic-last-run.txt

Za pomocą klucza interfejsu API musimy utworzyć obiekt tajny w usłudze Secret Manager. W Cloud Shell uruchom to polecenie, podając swój klucz interfejsu API:

echo -n "[YOUR_API_KEY_VALUE]" | \

gcloud secrets create elasticsearch \

--replication-policy="automatic" \

--data-file=-

10. Tworzenie zewnętrznego modułu danych w AlloyDB

Czas trwania: 20:00

Aby wysyłać zapytania do danych przechowywanych w Elasticsearch z AlloyDB, musimy utworzyć zewnętrzny moduł danych (FDW) dla Elastic i tabelę zewnętrzną. Wcześniej klucz interfejsu Elastic API był przechowywany w usłudze Secret Manager. Aby AlloyDB mógł uzyskać dostęp do obiektu tajnego, przyznaj kontu usługi wymagane uprawnienia.

W Cloud Shell przyznaj kontu usługi dostęp do obiektu tajnego elasticsearch.

gcloud secrets add-iam-policy-binding elasticsearch \

--member="serviceAccount:service-$(gcloud projects describe $(gcloud config get-value project) --format='value(projectNumber)')@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/secretmanager.secretAccessor"

Oczekiwane dane wyjściowe

gcloud secrets add-iam-policy-binding elasticsearch \

--member="serviceAccount:service-$(gcloud projects describe $(gcloud config get-value project) --format='value(projectNumber)')@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/secretmanager.secretAccessor"

Updated IAM policy for secret [elasticsearch].

bindings:

- members:

- serviceAccount:service-257907437930@gcp-sa-alloydb.iam.gserviceaccount.com

role: roles/secretmanager.secretAccessor

etag: BwZOghJiP5U=

version: 1

Otwórz klaster AlloyDB i AlloyDB Studio (możesz też użyć psql, aby połączyć się z maszyny wirtualnej). Zaloguj się w quickstart_db jako użytkownik postgres.

Włącz rozszerzenie FDW

CREATE EXTENSION external_search_fdw;

Oczekiwane dane wyjściowe

Statement executed successfully

Aby uzyskać dostęp do Elasticsearch, utwórz obcy serwer danych. Wewnętrzny adres IP maszyny wirtualnej znajdziesz w sekcji Compute Engine > Instancje maszyn wirtualnych. Aby uzyskać ścieżkę obiektu tajnego, otwórz Secret Manager i wybierz obiekt tajny. Ścieżka powinna być widoczna u góry. Aby pobrać najnowszą wersję klucza tajnego, dodaj /versions/latest.

CREATE SERVER elastic_demo_server

FOREIGN DATA WRAPPER external_search_fdw

OPTIONS(

server 'http://[VM INTERNAL IP ADDRESS]:9200',

search_provider 'elastic',

auth_method 'ApiKey',

secret_path '[SECRET PATH]/versions/latest'

);

Następnie zdefiniuj tabelę obcą. Po metadanych podaj definicję schematu pola Elasticsearch, aby dopasować go do wcześniej załadowanych danych. W tabeli zdalnej podaj nazwę indeksu Elastic.

CREATE FOREIGN TABLE elasticindexdemo (

metadata external_search_fdw_schema.OpaqueMetadata,

uniq_id TEXT,

product_name TEXT,

product_description TEXT

)

SERVER elastic_demo_server

OPTIONS(

remote_table_name 'elasticindexdemo'

);

Utwórz mapowanie użytkowników dla serwera

CREATE USER MAPPING FOR CURRENT_USER SERVER elastic_demo_server;

Teraz możesz przetestować obcą tabelę.

SELECT uniq_id, product_name

FROM elasticindexdemo

ORDER BY metadata <@> 'product_description:lamp' DESC

limit 10;

Oczekiwane dane wyjściowe

"uniq_id","product_name" "59c05332f09426c23d8d005528e3c12e","CVL Mini Vintage Metal Lamp Shade: Black Metal with Punched Pattern" "c24dd78c0d570105256e1bf1cb2fea9d","Better Homes & Gardens Tapered Drum Shade, White Box Pleat" "7ba20db2bcfab28f88fc714d73af1eb8","4 Pack E27 Wireless Remote Control Light Lamp Bulb Holder Cap Socket Switch 30m" "0fad1469ea9dfa80b35cfe5266b8bfe7","Star Projector Lamp, 360 Degree Star Night Light Romantic Room Rotating Cosmos Star Projuctor With USB Cable, Light Lamp Starry Moon Sky Night Projector Kid Bedroom Lamp" "70b37e483ef3678078236d36954525ce","Lucille 10.5\""h Duck Egg Blue Empire Stitched Lamp Shade 7x10x8" "b7a4b9151598f4cae7707cbedabe3c1b","10x12x8\"" SLIP UNO FITTER Hardback Shallow Drum Lamp Shade Textured Slate" "5962cf47b88186eed76d14f6376882df","E27 To E14 Lampshade Lamp Light Shades Socket Reducing Ring Adapter Washer" "7c54fdebfe0b1dd3f649741b8928a95b","iMounTEK LED Projector Lamp Kids Night Light Star Moon Projection Night Lamp 360\u00b0 Rotation Timer for Children Bedroom" "4531201095c2653530747e215fcc1435","Home Concept Inc 11 Classics Brass Empire Lamp Shade" "350527adb4299a015bcce74dee97805e","6 Colors LED Star Projector Lamp 360 Degree Romantic Rotating Night Cosmos Star Sky Moon Projector Kids Sleep Night Light For Children Gift Bedroom Decor"

11. Korzystanie z wyszukiwania hybrydowego

Czas trwania: 15:00

Teraz, gdy wszystko jest skonfigurowane, możemy użyć funkcji ai.hybrid_search(), aby połączyć wyszukiwanie wektorowe i wyszukiwanie pełnotekstowe. Więcej informacji o wyszukiwaniu hybrydowym znajdziesz w dokumentacji. W przypadku wyszukiwania hybrydowego wyniki zapytania są domyślnie porządkowane przy użyciu algorytmu wzajemnego scalania pozycji, który porządkuje wyniki z wielu zapytań. Najpierw wypróbujmy wyszukiwanie wektorowe i wyszukiwanie hybrydowe osobno, aby przeanalizować różnice między nimi.

Poniższe zapytanie wykonuje wyszukiwanie wektorowe, aby znaleźć produkty podobne do wiśni. Tablica zawiera listę wyszukiwań do wykonania. W tym przypadku używamy tylko wyszukiwania wektorowego, ale później udostępnimy zarówno wyszukiwanie wektorowe, jak i wyszukiwanie pełnotekstowe.

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"data_type": "vector",

"table_name": "cymbal_products",

"key_column": "uniq_id",

"vec_column": "product_embedding",

"distance_operator": "public.<=>",

"limit": 3,

"query_vector": "ai.embedding(''text-embedding-005'', ''cherry'')::vector"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

W wynikach wyszukiwania wiśnia jest pierwszym wynikiem, ale zwróć uwagę, że kolejne dwa to też drzewa owocowe. Dzieje się tak, ponieważ gdy używamy wyszukiwania wektorowego w kolumnie product_description, znajdujemy dopasowania semantyczne do naszego warunku wyszukiwania.

"id","score","product_name","product_description" "d536e9e823296a2eba198e52dd23e712","0.01639344262295082","Cherry Tree","This is a beautiful cherry tree that will produce delicious cherries. It is an deciduous tree that grows to be about 15 feet tall. The leaves are dark green in the summer and turn a beautiful red in the fall. Cherry trees are known for their beauty and their ability to provide shade and privacy. Cherry trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 4-9." "b70c44b1a38c0a2329fa583c9109a80f","0.016129032258064516","Peach Tree","This is a beautiful peach tree that will produce delicious peaches. It is an evergreen tree that grows to be about 20 feet tall. The leaves are dark green in the summer and turn a beautiful yellow in the fall. Peach trees are known for their beauty and their ability to provide shade and privacy. Peach trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 2-9." "23e41a71d63d8bbc9bdfa1d118cfddc5","0.015873015873015872","Apple Tree","This is a beautiful apple tree that will produce delicious apples. It is a deciduous tree that grows to be about 30 feet tall. The leaves are dark green in the summer and turn a beautiful red, orange, and yellow in the fall. Apple trees are known for their strength and durability. They are also a popular choice for shade trees. Apple trees prefer a cool, moist climate and loamy soil. They are best suited for USDA zones 4-8."

Aby przeprowadzić wyszukiwanie pełnotekstowe, uruchom to zapytanie

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"limit": 3,

"data_type": "external_search_fdw",

"table_name": "elasticindexdemo",

"key_column": "uniq_id",

"query_text_input": "product_description:(cherry)"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

Zwróć uwagę, że w wynikach wyszukiwania pełnotekstowego, które wykorzystuje dopasowanie ścisłe, pojawiają się wszystkie produkty, których opis zawiera słowo „wiśnia”.

"id","score","product_name","product_description" "d536e9e823296a2eba198e52dd23e712","0.01639344262295082","Cherry Tree","This is a beautiful cherry tree that will produce delicious cherries. It is an deciduous tree that grows to be about 15 feet tall. The leaves are dark green in the summer and turn a beautiful red in the fall. Cherry trees are known for their beauty and their ability to provide shade and privacy. Cherry trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 4-9." "390cf08feac229e7b752709fd1f943b3","0.016129032258064516","Woven Round Placemat, Set of Twelve, Grass","...These placemats are great for special occasions and holidays, but are also perfect to accessorize your everyday place settings.|Measurements. 15-inch round diameter is the perfect size for most table sizes and shapes.|Pop Colors. Choose from 7 pop woven color placemats including: Black, Cherry, Grass, Taupe, Navy, Sun and Graphite." "2c9aa7ac98c30abf78dd9c62a68a34e6","0.015873015873015872","48 Scented Wax Melts Wax Cubes: Jelly Belly Jelly Beans Candy Bulk Soy Wax Melts For Candle Warmer, Wax Warmers, Wax Melt Warmers In 8 Pack Set","...From These Flavors: Lemon Drop, Mixed Berry Smoothie, Sizzling Cinnamon, Crushed Pineapple, Juicy Pear, Cotton Candy, Toasted Marshmallow, French Vanilla, Watermelon, Red Apple, Very Cherry, Buttered Popcorn..."

Możesz teraz łączyć wyszukiwanie semantyczne i wyszukiwanie pełnotekstowe, aby uzyskiwać trafniejsze wyniki. Załóżmy, że chcemy znaleźć drzewo, które może być wyższe od domu, i chcemy, aby pochodziło z Kalifornii. Podzieliliśmy zapytanie, aby wykorzystać intencje semantyczne zamiast dosłownego dopasowania. Wyszukiwanie wektorowe obsługuje część opisową: „drzewo, które może być wyższe od domu”, ponieważ rozumie pojęcie wysokości i skali bez konieczności używania dokładnych słów kluczowych. Wyszukiwanie pełnotekstowe traktuje natomiast słowo „Kalifornia” jako ścisły filtr, aby zapewnić dokładne dopasowanie geograficzne, a nie tylko coś podobnego pod względem koncepcji.

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"data_type": "vector",

"table_name": "cymbal_products",

"key_column": "uniq_id",

"vec_column": "product_embedding",

"distance_operator": "public.<=>",

"limit": 3,

"query_vector": "ai.embedding(''text-embedding-005'', ''tree that can grow taller than a house'')::vector"

}'::JSONB,

'{

"limit": 3,

"data_type": "external_search_fdw",

"table_name": "elasticindexdemo",

"key_column": "uniq_id",

"query_text_input": "product_description:(California)"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

Oczekiwane wyniki:

"id","score","product_name","product_description" "a589fd36a8a20fd9472d2403d6ed692a","0.00819672631147241","California Redwood","This is a beautiful redwood tree that can grow to be over 300 feet tall. It is an evergreen tree that grows in the coastal forests of California. Redwoods are known for their beauty and their strength. They are best suited for USDA zones 7-10." "ef9432802da24041594c2cf368dfb4d2","0.008064521129029258","Madrone","This is a beautiful madrona tree that can grow to be over 80 feet tall. It is an evergreen tree that grows in the coastal forests of California. Madronas are known for their beauty and their bark. They are best suited for USDA zones 7-10." "1360d8642bc218e4ea28e9c32b2e1721","0.007936512936504936","California Sycamore","This is a beautiful sycamore tree that can grow to be over 100 feet tall. It is an deciduous tree that grows in the valleys and foothills of California. California sycamores are known for their beauty and their shade. They are best suited for USDA zones 7-10."

12. Zwalnianie miejsca w środowisku

Po zakończeniu modułu zniszcz instancje i klaster AlloyDB.

Usuwanie klastra AlloyDB i wszystkich instancji

Jeśli korzystasz z wersji próbnej AlloyDB. Nie usuwaj klastra próbnego, jeśli planujesz testować inne laboratoria i zasoby przy użyciu tego klastra. Nie będzie można utworzyć kolejnego klastra próbnego w tym samym projekcie.

Klaster zostanie zniszczony z opcją force, która powoduje też usunięcie wszystkich instancji należących do klastra.

W Cloud Shell zdefiniuj projekt i zmienne środowiskowe, jeśli połączenie zostało przerwane i wszystkie poprzednie ustawienia zostały utracone:

gcloud config set project <your project id>

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

export PROJECT_ID=$(gcloud config get-value project)

Usuń klaster:

gcloud alloydb clusters delete $ADBCLUSTER --region=$REGION --force

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-001-402417)$ gcloud alloydb clusters delete $ADBCLUSTER --region=$REGION --force All of the cluster data will be lost when the cluster is deleted. Do you want to continue (Y/n)? Y Operation ID: operation-1697820178429-6082890a0b570-4a72f7e4-4c5df36f Deleting cluster...done.

Usuwanie kopii zapasowych AlloyDB

Usuń wszystkie kopie zapasowe AlloyDB dla klastra:

for i in $(gcloud alloydb backups list --filter="CLUSTER_NAME: projects/$PROJECT_ID/locations/$REGION/clusters/$ADBCLUSTER" --format="value(name)" --sort-by=~createTime) ; do gcloud alloydb backups delete $(basename $i) --region $REGION --quiet; done

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-001-402417)$ for i in $(gcloud alloydb backups list --filter="CLUSTER_NAME: projects/$PROJECT_ID/locations/$REGION/clusters/$ADBCLUSTER" --format="value(name)" --sort-by=~createTime) ; do gcloud alloydb backups delete $(basename $i) --region $REGION --quiet; done Operation ID: operation-1697826266108-60829fb7b5258-7f99dc0b-99f3c35f Deleting backup...done.

Teraz możemy usunąć maszynę wirtualną.

Usuwanie maszyny wirtualnej GCE

W Cloud Shell wykonaj to polecenie:

export GCEVM=instance-1

export ZONE=us-central1-a

gcloud compute instances delete $GCEVM \

--zone=$ZONE \

--quiet

Oczekiwane dane wyjściowe konsoli:

student@cloudshell:~ (test-project-001-402417)$ export GCEVM=instance-1

export ZONE=us-central1-a

gcloud compute instances delete $GCEVM \

--zone=$ZONE \

--quiet

Deleted

13. Gratulacje

Gratulujemy ukończenia ćwiczenia!

Omówione zagadnienia

- Jak wdrożyć klaster AlloyDB i instancję główną

- Jak połączyć się z AlloyDB z maszyny wirtualnej Google Compute Engine

- Tworzenie bazy danych i włączanie AlloyDB AI

- Wczytywanie danych do bazy danych

- Jak korzystać z AlloyDB Studio

- Generowanie wektorów dystrybucyjnych za pomocą Vertex AI

- Jak utworzyć indeks wektorowy ScaNN, aby zwiększyć skuteczność wyszukiwania wektorowego

- Jak utworzyć zewnętrzną otoczkę danych (FDW) dla Elasticsearch

- Przeprowadź wyszukiwanie hybrydowe, łącząc wyszukiwanie semantyczne w AlloyDB z wyszukiwaniem pełnotekstowym w Elastic.

Następne kroki

Więcej ćwiczeń w Codelabs dotyczących AlloyDB znajdziesz na oficjalnej stronie Codelabs.