1. บทนำ

ใน Codelab นี้ คุณจะได้เรียนรู้วิธีทำการค้นหาแบบไฮบริดใน AlloyDB โดยใช้ส่วนขยาย (วิธีการอัปเดตการจัดอันดับ) RUM และดัชนี Scalable Nearest Neighbor (ScaNN) ห้องทดลองนี้เป็นส่วนหนึ่งของคอลเล็กชันห้องทดลองที่มุ่งเน้นฟีเจอร์ AlloyDB AI ดูข้อมูลเพิ่มเติมได้ที่หน้า AlloyDB AI ในเอกสารประกอบ

ข้อกำหนดเบื้องต้น

- ความเข้าใจพื้นฐานเกี่ยวกับ Google Cloud Console

- ทักษะพื้นฐานในอินเทอร์เฟซบรรทัดคำสั่งและ Google Shell

สิ่งที่คุณจะได้เรียนรู้

- วิธีติดตั้งใช้งานคลัสเตอร์และอินสแตนซ์หลักของ AlloyDB

- วิธีเชื่อมต่อกับ AlloyDB จาก VM ของ Google Compute Engine

- วิธีสร้างฐานข้อมูลและเปิดใช้ AlloyDB AI

- วิธีโหลดข้อมูลลงในฐานข้อมูล

- วิธีใช้ AlloyDB Studio

- สร้างการฝังด้วย Vertex AI

- วิธีสร้างดัชนีเวกเตอร์ ScaNN เพื่อเพิ่มประสิทธิภาพการค้นหาเวกเตอร์

- วิธีสร้าง Foreign Data Wrapper (FDW) สำหรับ Elasticsearch

- ทำการค้นหาแบบไฮบริดโดยรวมการค้นหาเชิงความหมายใน AlloyDB กับการค้นหาข้อความแบบเต็มใน Elastic

สิ่งที่คุณต้องมี

- บัญชี Google Cloud และโปรเจ็กต์ Google Cloud

- เว็บเบราว์เซอร์ เช่น Chrome

2. การตั้งค่าและข้อกำหนด

การตั้งค่าโปรเจ็กต์

ลงชื่อเข้าใช้ คอนโซล Google Cloud หากยังไม่มีบัญชี Gmail หรือ Google Workspace คุณต้องสร้างบัญชี

ใช้บัญชีส่วนตัวแทนบัญชีงานหรือบัญชีโรงเรียน

สร้างโปรเจ็กต์ Google Cloud

- ในคอนโซล Google Cloud ในหน้าตัวเลือกโปรเจ็กต์ ให้เลือกหรือสร้างโปรเจ็กต์ Google Cloud

- ตรวจสอบว่าได้เปิดใช้การเรียกเก็บเงินสำหรับโปรเจ็กต์ที่อยู่ในระบบคลาวด์แล้ว ดูวิธีตรวจสอบว่าได้เปิดใช้การเรียกเก็บเงินในโปรเจ็กต์แล้วหรือไม่

เปิดใช้การเรียกเก็บเงิน

คุณมี 2 ตัวเลือกในการเปิดใช้การเรียกเก็บเงิน คุณจะใช้บัญชีสำหรับการเรียกเก็บเงินส่วนตัวหรือแลกสิทธิ์เครดิตได้โดยทำตามขั้นตอนต่อไปนี้

ตั้งค่าบัญชีสำหรับการเรียกเก็บเงินส่วนตัว

หากตั้งค่าการเรียกเก็บเงินโดยใช้เครดิต Google Cloud คุณจะข้ามขั้นตอนนี้ได้

หากต้องการตั้งค่าบัญชีสำหรับการเรียกเก็บเงินส่วนตัว ให้ไปที่นี่เพื่อเปิดใช้การเรียกเก็บเงินใน Cloud Console

ข้อควรทราบ

- การทำแล็บนี้ควรมีค่าใช้จ่ายน้อยกว่า $3 USD ในทรัพยากรระบบคลาวด์

- คุณสามารถทำตามขั้นตอนที่ส่วนท้ายของแล็บนี้เพื่อลบทรัพยากรเพื่อหลีกเลี่ยงการเรียกเก็บเงินเพิ่มเติม

- ผู้ใช้ใหม่มีสิทธิ์ใช้ช่วงทดลองใช้ฟรีมูลค่า$300 USD

เริ่มต้น Cloud Shell

แม้ว่าคุณจะใช้งาน Google Cloud จากระยะไกลจากแล็ปท็อปได้ แต่ใน Codelab นี้คุณจะใช้ Google Cloud Shell ซึ่งเป็นสภาพแวดล้อมบรรทัดคำสั่งที่ทำงานในระบบคลาวด์

Cloud Shell คือสภาพแวดล้อมบรรทัดคำสั่งที่ทำงานใน Google Cloud ซึ่งโหลดเครื่องมือที่จำเป็นไว้ล่วงหน้า

- คลิกเปิดใช้งาน Cloud Shell ที่ด้านบนของคอนโซล Google Cloud

- เมื่อเชื่อมต่อกับ Cloud Shell แล้ว ให้ยืนยันการตรวจสอบสิทธิ์โดยทำดังนี้

gcloud auth list - ตรวจสอบว่าได้กำหนดค่าโปรเจ็กต์แล้ว

gcloud config get project - หากไม่ได้ตั้งค่าโปรเจ็กต์ตามที่คาดไว้ ให้ตั้งค่าดังนี้

export PROJECT_ID=<YOUR_PROJECT_ID> gcloud config set project $PROJECT_ID

เครื่องเสมือนนี้มาพร้อมเครื่องมือพัฒนาซอฟต์แวร์ทั้งหมดที่คุณต้องการ โดยมีไดเรกทอรีหลักแบบถาวรขนาด 5 GB และทำงานบน Google Cloud ซึ่งช่วยเพิ่มประสิทธิภาพเครือข่ายและการตรวจสอบสิทธิ์ได้อย่างมาก คุณสามารถทำงานทั้งหมดใน Codelab นี้ได้ภายในเบราว์เซอร์ คุณไม่จำเป็นต้องติดตั้งอะไร

3. ก่อนเริ่มต้น

เปิดใช้ API

เอาต์พุต:

หากต้องการใช้ AlloyDB, Compute Engine, Networking Services และ Vertex AI คุณต้องเปิดใช้ API ที่เกี่ยวข้องในโปรเจ็กต์ Google Cloud

การเปิดใช้ API

ใน Cloud Shell ในเทอร์มินัล ให้ตรวจสอบว่าได้ตั้งค่ารหัสโปรเจ็กต์แล้ว

gcloud config set project [YOUR-PROJECT-ID]

ตั้งค่าตัวแปรสภาพแวดล้อม PROJECT_ID:

PROJECT_ID=$(gcloud config get-value project)

เปิดใช้ API ที่จำเป็นทั้งหมด

gcloud services enable alloydb.googleapis.com \

compute.googleapis.com \

cloudresourcemanager.googleapis.com \

servicenetworking.googleapis.com \

aiplatform.googleapis.com \

secretmanager.googleapis.com

ผลลัพธ์ที่คาดหวัง

student@cloudshell:~ (test-project-001-402417)$ gcloud config set project test-project-001-402417

Updated property [core/project].

student@cloudshell:~ (test-project-001-402417)$ PROJECT_ID=$(gcloud config get-value project)

Your active configuration is: [cloudshell-14650]

student@cloudshell:~ (test-project-001-402417)$

student@cloudshell:~ (test-project-001-402417)$ gcloud services enable alloydb.googleapis.com \

compute.googleapis.com \

cloudresourcemanager.googleapis.com \

servicenetworking.googleapis.com \

aiplatform.googleapis.com \

secretmanager.googleapis.com

Operation "operations/acat.p2-4470404856-1f44ebd8-894e-4356-bea7-b84165a57442" finished successfully.

ขอแนะนำ API

- AlloyDB API (

alloydb.googleapis.com) ช่วยให้คุณสร้าง จัดการ และปรับขนาดคลัสเตอร์ AlloyDB สำหรับ PostgreSQL ได้ โดยให้บริการฐานข้อมูลที่เข้ากันได้กับ PostgreSQL ซึ่งมีการจัดการครบวงจร ออกแบบมาสำหรับภาระงานด้านการทำธุรกรรมและการวิเคราะห์ขององค์กรที่ต้องการประสิทธิภาพสูง - Compute Engine API (

compute.googleapis.com) ช่วยให้คุณสร้างและจัดการเครื่องเสมือน (VM), Persistent Disk และการตั้งค่าเครือข่ายได้ โดยมีรากฐานหลักของ Infrastructure-as-a-Service (IaaS) ที่จำเป็นต่อการเรียกใช้เวิร์กโหลดและโฮสต์โครงสร้างพื้นฐานสำหรับบริการที่มีการจัดการจำนวนมาก - Cloud Resource Manager API (

cloudresourcemanager.googleapis.com) ช่วยให้คุณจัดการข้อมูลเมตาและการกำหนดค่าของโปรเจ็กต์ที่อยู่ในระบบคลาวด์ Google แบบเป็นโปรแกรมได้ ซึ่งช่วยให้คุณจัดระเบียบทรัพยากร จัดการนโยบาย Identity and Access Management (IAM) และตรวจสอบสิทธิ์ในลำดับชั้นของโปรเจ็กต์ได้ - Service Networking API (

servicenetworking.googleapis.com) ช่วยให้คุณตั้งค่าการเชื่อมต่อส่วนตัวระหว่างเครือข่าย Virtual Private Cloud (VPC) กับบริการที่มีการจัดการของ Google โดยอัตโนมัติได้ โดยเฉพาะอย่างยิ่งจำเป็นต้องสร้างการเข้าถึง IP ส่วนตัวสำหรับบริการต่างๆ เช่น AlloyDB เพื่อให้สื่อสารกับทรัพยากรอื่นๆ ได้อย่างปลอดภัย - Vertex AI API (

aiplatform.googleapis.com) ช่วยให้แอปพลิเคชันของคุณสร้าง ทำให้ใช้งานได้ และปรับขนาดโมเดลแมชชีนเลิร์นนิงได้ โดยมีอินเทอร์เฟซแบบรวมสำหรับบริการ AI ทั้งหมดของ Google Cloud รวมถึงสิทธิ์เข้าถึงโมเดล Generative AI (เช่น Gemini) และการฝึกโมเดลที่กำหนดเอง - Secret Manager API (

secretmanager.googleapis.com) เป็นบริการจัดการข้อมูลลับและข้อมูลเข้าสู่ระบบที่ช่วยให้คุณจัดเก็บและจัดการข้อมูลที่ละเอียดอ่อน เช่น คีย์ API, ชื่อผู้ใช้, รหัสผ่าน, ใบรับรอง และอื่นๆ

คุณจะกำหนดค่าภูมิภาคเริ่มต้นเพื่อใช้โมเดลการฝัง Vertex AI หรือไม่ก็ได้ อ่านเพิ่มเติมเกี่ยวกับสถานที่ที่ Vertex AI พร้อมให้บริการ ในตัวอย่างนี้ เราใช้ภูมิภาค us-central1

gcloud config set compute/region us-central1

4. ติดตั้งใช้งาน AlloyDB

ก่อนสร้างคลัสเตอร์ AlloyDB เราต้องมีช่วง IP ส่วนตัวที่พร้อมใช้งานใน VPC เพื่อให้อินสแตนซ์ AlloyDB ในอนาคตใช้ หากเราไม่มี เราจะต้องสร้างขึ้น กำหนดให้ใช้โดยบริการภายในของ Google หลังจากนั้นเราจะสร้างคลัสเตอร์และอินสแตนซ์ได้

สร้างช่วง IP ส่วนตัว

เราต้องกำหนดค่าการกำหนดค่าการเข้าถึงบริการส่วนตัวใน VPC สำหรับ AlloyDB สมมติว่าเรามีเครือข่าย VPC "เริ่มต้น" ในโปรเจ็กต์และจะใช้สำหรับการดำเนินการทั้งหมด

สร้างช่วง IP ส่วนตัว

gcloud compute addresses create psa-range \

--global \

--purpose=VPC_PEERING \

--prefix-length=24 \

--description="VPC private service access" \

--network=default

สร้างการเชื่อมต่อส่วนตัวโดยใช้ช่วง IP ที่จัดสรร

gcloud services vpc-peerings connect \

--service=servicenetworking.googleapis.com \

--ranges=psa-range \

--network=default \

--export-custom-routes

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-402417)$ gcloud compute addresses create psa-range \

--global \

--purpose=VPC_PEERING \

--prefix-length=24 \

--description="VPC private service access" \

--network=default

Created [https://www.googleapis.com/compute/v1/projects/test-project-402417/global/addresses/psa-range].

student@cloudshell:~ (test-project-402417)$ gcloud services vpc-peerings connect \

--service=servicenetworking.googleapis.com \

--ranges=psa-range \

--network=default

Operation "operations/pssn.p24-4470404856-595e209f-19b7-4669-8a71-cbd45de8ba66" finished successfully.

student@cloudshell:~ (test-project-402417)$

สร้างคลัสเตอร์ AlloyDB

ในส่วนนี้ เราจะสร้างคลัสเตอร์ AlloyDB ในภูมิภาค us-central1

กำหนดรหัสผ่านสำหรับผู้ใช้ postgres คุณกำหนดรหัสผ่านเองหรือใช้ฟังก์ชันแบบสุ่มเพื่อสร้างรหัสผ่านก็ได้

export PGPASSWORD=`openssl rand -hex 12`

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-402417)$ export PGPASSWORD=`openssl rand -hex 12`

จดรหัสผ่าน PostgreSQL ไว้ใช้ในอนาคต

echo $PGPASSWORD

คุณจะต้องใช้รหัสผ่านดังกล่าวในอนาคตเพื่อเชื่อมต่อกับอินสแตนซ์ในฐานะผู้ใช้ postgres เราขอแนะนำให้คัดลอกรหัสผ่านไปยังที่ปลอดภัย (เช่น เครื่องมือจัดการรหัสผ่าน)

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-402417)$ echo $PGPASSWORD <generated password>

สร้างคลัสเตอร์ AlloyDB

กำหนดชื่อภูมิภาคและคลัสเตอร์ AlloyDB เราจะใช้ภูมิภาค us-central1 และ alloydb-hybrid-search เป็นชื่อคลัสเตอร์

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

เรียกใช้คำสั่งเพื่อสร้างคลัสเตอร์

gcloud alloydb clusters create $ADBCLUSTER \

--password=$PGPASSWORD \

--network=default \

--region=$REGION

เอาต์พุตของคอนโซลที่คาดไว้

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

gcloud alloydb clusters create $ADBCLUSTER \

--password=$PGPASSWORD \

--network=default \

--region=$REGION

Operation ID: operation-1697655441138-6080235852277-9e7f04f5-2012fce4

Creating cluster...done.

สร้างอินสแตนซ์หลักของ AlloyDB สำหรับคลัสเตอร์ในเซสชัน Cloud Shell เดียวกัน หากการเชื่อมต่อถูกตัด คุณจะต้องกำหนดตัวแปรสภาพแวดล้อมของภูมิภาคและชื่อคลัสเตอร์อีกครั้ง

gcloud alloydb instances create $ADBCLUSTER-pr \

--instance-type=PRIMARY \

--cpu-count=2 \

--region=$REGION \

--cluster=$ADBCLUSTER

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (alloydb-hybrid-search)$ gcloud alloydb instances create $ADBCLUSTER-pr \

--instance-type=PRIMARY \

--cpu-count=2 \

--region=$REGION \

--availability-type ZONAL \

--cluster=$ADBCLUSTER

Operation ID: operation-1697659203545-6080315c6e8ee-391805db-25852721

Creating instance...done.

5. เชื่อมต่อกับ AlloyDB

AlloyDB ได้รับการติดตั้งใช้งานโดยใช้การเชื่อมต่อแบบส่วนตัวเท่านั้น ดังนั้นเราจึงต้องใช้ VM ที่ติดตั้งไคลเอ็นต์ PostgreSQL เพื่อทำงานกับฐานข้อมูล นอกจากนี้ เราจะใช้ VM นี้เพื่อเรียกใช้อินสแตนซ์ Elasticsearch ด้วย

ติดตั้งใช้งาน GCE VM

สร้าง VM ของ GCE ในภูมิภาคและ VPC เดียวกันกับคลัสเตอร์ AlloyDB ตรวจสอบว่าดิสก์สำหรับบูตมีขนาดใหญ่พอที่จะเรียกใช้ Elastic ในที่นี้ เราจะระบุดิสก์บูตขนาด 20 GB ในแฟล็ก --create-disk

ใน Cloud Shell ให้เรียกใช้คำสั่งต่อไปนี้

export ZONE=us-central1-a

gcloud compute instances create instance-1 \

--zone=$ZONE \

--create-disk=auto-delete=yes,boot=yes,size=20,image=projects/debian-cloud/global/images/$(gcloud compute images list --filter="family=debian-12 AND family!=debian-12-arm64" --format="value(name)") \

--scopes=https://www.googleapis.com/auth/cloud-platform

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (alloydb-hybrid-search)$ export ZONE=us-central1-a

student@cloudshell:~ (talloydb-hybrid-search)$ export ZONE=us-central1-a

gcloud compute instances create instance-1 \

--zone=$ZONE \

--create-disk=auto-delete=yes,boot=yes,image=projects/debian-cloud/global/images/$(gcloud compute images list --filter="family=debian-12 AND family!=debian-12-arm64" --format="value(name)") \

--scopes=https://www.googleapis.com/auth/cloud-platform

Created [https://www.googleapis.com/compute/v1/projects/test-project-402417/zones/us-central1-a/instances/instance-1].

NAME: instance-1

ZONE: us-central1-a

MACHINE_TYPE: n1-standard-1

PREEMPTIBLE:

INTERNAL_IP: 10.128.0.2

EXTERNAL_IP: 34.71.192.233

STATUS: RUNNING

ติดตั้งไคลเอ็นต์ Postgres

ติดตั้งซอฟต์แวร์ไคลเอ็นต์ PostgreSQL ใน VM ที่ติดตั้งใช้งาน

เชื่อมต่อกับ VM โดยใช้คำสั่งต่อไปนี้

gcloud compute ssh instance-1 --zone=us-central1-a

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (alloydb-hybrid-search)$ gcloud compute ssh instance-1 --zone=us-central1-a Updating project ssh metadata...working..Updated [https://www.googleapis.com/compute/v1/projects/alloydb-hybrid-search]. Updating project ssh metadata...done. Waiting for SSH key to propagate. Warning: Permanently added 'compute.5110295539541121102' (ECDSA) to the list of known hosts. Linux instance-1.us-central1-a.c.gleb-test-short-001-418811.internal 6.1.0-18-cloud-amd64 #1 SMP PREEMPT_DYNAMIC Debian 6.1.76-1 (2024-02-01) x86_64 The programs included with the Debian GNU/Linux system are free software; the exact distribution terms for each program are described in the individual files in /usr/share/doc/*/copyright. Debian GNU/Linux comes with ABSOLUTELY NO WARRANTY, to the extent permitted by applicable law. student@instance-1:~$

ติดตั้งคำสั่งเรียกใช้ซอฟต์แวร์ภายใน VM โดยทำดังนี้

sudo apt-get update

sudo apt-get install --yes postgresql-client

เอาต์พุตของคอนโซลที่คาดไว้

student@instance-1:~$ sudo apt-get update sudo apt-get install --yes postgresql-client Get:1 https://packages.cloud.google.com/apt google-compute-engine-bullseye-stable InRelease [5146 B] Get:2 https://packages.cloud.google.com/apt cloud-sdk-bullseye InRelease [6406 B] Hit:3 https://deb.debian.org/debian bullseye InRelease Get:4 https://deb.debian.org/debian-security bullseye-security InRelease [48.4 kB] Get:5 https://packages.cloud.google.com/apt google-compute-engine-bullseye-stable/main amd64 Packages [1930 B] Get:6 https://deb.debian.org/debian bullseye-updates InRelease [44.1 kB] Get:7 https://deb.debian.org/debian bullseye-backports InRelease [49.0 kB] ...redacted... update-alternatives: using /usr/share/postgresql/13/man/man1/psql.1.gz to provide /usr/share/man/man1/psql.1.gz (psql.1.gz) in auto mode Setting up postgresql-client (13+225) ... Processing triggers for man-db (2.9.4-2) ... Processing triggers for libc-bin (2.31-13+deb11u7) ...

เชื่อมต่อกับอินสแตนซ์

เชื่อมต่อกับอินสแตนซ์หลักจาก VM โดยใช้ psql

ในแท็บ Cloud Shell เดียวกันกับเซสชัน SSH ที่เปิดไปยัง VM ของอินสแตนซ์-1

ใช้ค่ารหัสผ่าน AlloyDB (PGPASSWORD) ที่จดไว้และรหัสคลัสเตอร์ AlloyDB เพื่อเชื่อมต่อกับ AlloyDB จาก GCE VM โดยทำดังนี้

export PGPASSWORD=<Noted password>

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

export INSTANCE_IP=$(gcloud alloydb instances describe $ADBCLUSTER-pr --cluster=$ADBCLUSTER --region=$REGION --format="value(ipAddress)")

psql "host=$INSTANCE_IP user=postgres sslmode=require"

เอาต์พุตของคอนโซลที่คาดไว้

student@instance-1:~$ export PGPASSWORD=<noted password> student@instance-1:~$ ADBCLUSTER=alloydb-aip-01 student@instance-1:~$ REGION=us-central1 student@instance-1:~$ INSTANCE_IP=$(gcloud alloydb instances describe $ADBCLUSTER-pr --cluster=$ADBCLUSTER --region=$REGION --format="value(ipAddress)") gleb@instance-1:~$ psql "host=$INSTANCE_IP user=postgres sslmode=require" psql (15.6 (Debian 15.6-0+deb12u1), server 15.5) SSL connection (protocol: TLSv1.3, cipher: TLS_AES_256_GCM_SHA384, compression: off) Type "help" for help. postgres=>

ปิดเซสชัน psql

exit

6. เตรียมฐานข้อมูล

เราต้องสร้างฐานข้อมูล เปิดใช้การผสานรวม Vertex AI สร้างออบเจ็กต์ฐานข้อมูล และนําเข้าข้อมูล

ให้สิทธิ์ที่จำเป็นแก่ AlloyDB

เพิ่มสิทธิ์ Vertex AI ให้กับตัวแทนบริการของ AlloyDB

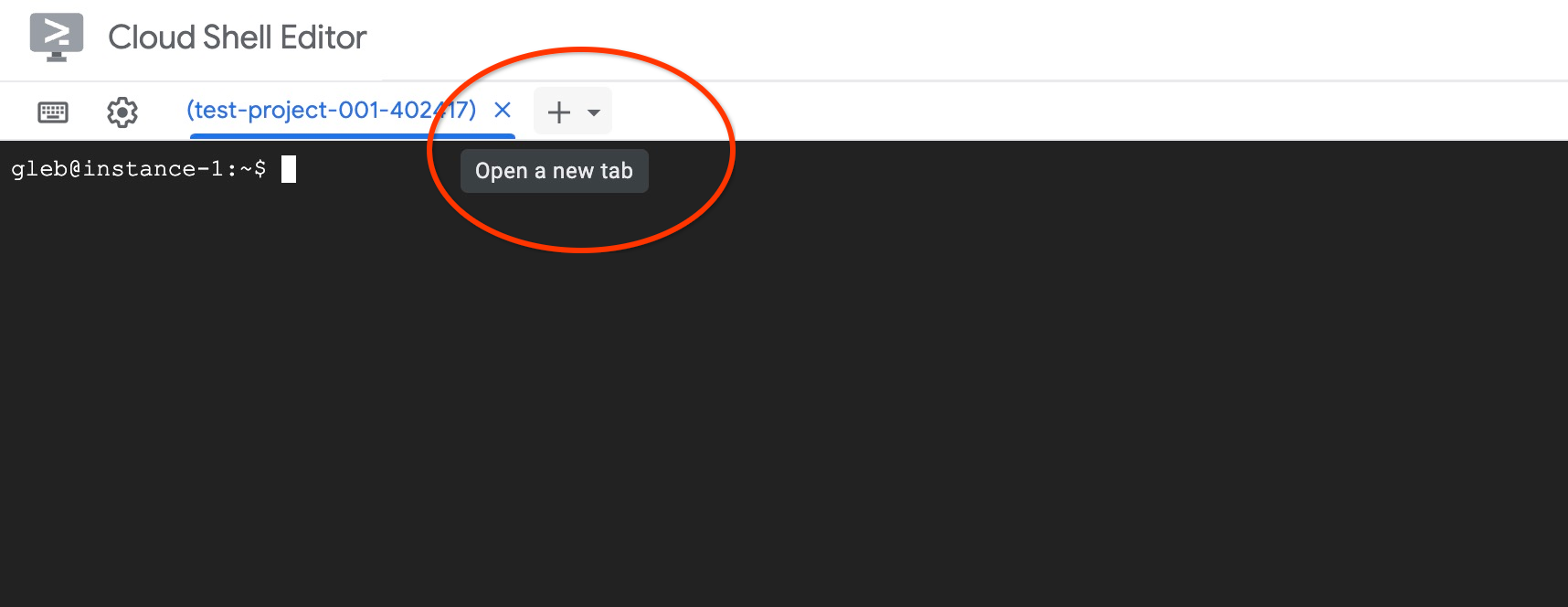

เปิดแท็บ Cloud Shell อีกแท็บโดยใช้เครื่องหมาย "+" ที่ด้านบน

ในแท็บ Cloud Shell ใหม่ ให้เรียกใช้คำสั่งต่อไปนี้

PROJECT_ID=$(gcloud config get-value project)

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:service-$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/aiplatform.user"

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-001-402417)$ PROJECT_ID=$(gcloud config get-value project) Your active configuration is: [cloudshell-11039] student@cloudshell:~ (test-project-001-402417)$ gcloud projects add-iam-policy-binding $PROJECT_ID \ --member="serviceAccount:service-$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")@gcp-sa-alloydb.iam.gserviceaccount.com" \ --role="roles/aiplatform.user" Updated IAM policy for project [test-project-001-402417]. bindings: - members: - serviceAccount:service-4470404856@gcp-sa-alloydb.iam.gserviceaccount.com role: roles/aiplatform.user - members: ... etag: BwYIEbe_Z3U= version: 1

ปิดแท็บโดยคลิก "X" หรือเรียกใช้คำสั่งต่อไปนี้

exit

สร้างฐานข้อมูล

สร้างฐานข้อมูลชื่อ quickstart

ในเซสชัน GCE VM ให้เรียกใช้คำสั่งต่อไปนี้

สร้างฐานข้อมูล

psql "host=$INSTANCE_IP user=postgres" -c "CREATE DATABASE quickstart_db"

เอาต์พุตของคอนโซลที่คาดไว้

student@instance-1:~$ psql "host=$INSTANCE_IP user=postgres" -c "CREATE DATABASE quickstart_db" CREATE DATABASE student@instance-1:~$

เปิดใช้การผสานรวม Vertex AI

เปิดใช้การผสานรวม Vertex AI และส่วนขยาย pgvector ในฐานข้อมูล

ใน GCE VM ให้ดำเนินการดังนี้

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS google_ml_integration CASCADE"

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS vector"

เอาต์พุตของคอนโซลที่คาดไว้

student@instance-1:~$ psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS google_ml_integration CASCADE" psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "CREATE EXTENSION IF NOT EXISTS vector" CREATE EXTENSION CREATE EXTENSION student@instance-1:~$

นำเข้าข้อมูล

ดาวน์โหลดข้อมูลที่เตรียมไว้แล้วนำเข้าไปยังฐานข้อมูลใหม่

ใน GCE VM ให้ดำเนินการดังนี้

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_demo_schema.sql |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_products from stdin csv header"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_inventory.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_inventory from stdin csv header"

gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_stores.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_stores from stdin csv header"

เอาต์พุตของคอนโซลที่คาดไว้

student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_demo_schema.sql |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" SET SET SET SET SET set_config ------------ (1 row) SET SET SET SET SET SET CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE TABLE ALTER TABLE CREATE SEQUENCE ALTER TABLE ALTER SEQUENCE ALTER TABLE ALTER TABLE ALTER TABLE student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_products from stdin csv header" COPY 941 student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_inventory.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_inventory from stdin csv header" COPY 263861 student@instance-1:~$ gcloud storage cat gs://cloud-training/gcc/gcc-tech-004/cymbal_stores.csv |psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db" -c "\copy cymbal_stores from stdin csv header" COPY 4654 student@instance-1:~$

จากนั้นมาตั้งค่าสถานะฐานข้อมูลที่จำเป็นกัน คุณใช้เว็บคอนโซลและจัดการฟีเจอร์ในอินสแตนซ์หลัก หรือใช้คำสั่ง gcloud ได้ดังนี้

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

gcloud beta alloydb instances update $ADBCLUSTER-pr \

--database-flags google_ml_integration.enable_faster_embedding_generation=on,scann.enable_preview_features=on,google_ml_integration.enable_preview_ai_functions=on,google_ml_integration.enable_ai_query_engine=on \

--region=$REGION \

--cluster=$ADBCLUSTER \

--project=$PROJECT_ID \

--update-mode=FORCE_APPLY

เอาต์พุตของคอนโซลที่คาดไว้

export PROJECT_ID=$(gcloud config get-value project) export REGION=us-central1 export ADBCLUSTER=alloydb-hybrid-search gcloud beta alloydb instances update $ADBCLUSTER-pr \ --database-flags google_ml_integration.enable_faster_embedding_generation=on,scann.enable_preview_features=on,google_ml_integration.enable_preview_ai_functions=on,google_ml_integration.enable_ai_query_engine=on \ --region=$REGION \ --cluster=$ADBCLUSTER \ --project=$PROJECT_ID \ --update-mode=FORCE_APPLY Your active configuration is: [cloudshell-724] Operation ID: operation-1775159889986-64e7f9ea9858a-b031e866-4c7c36df

การเปิดใช้แฟล็กฐานข้อมูลต้องรีสตาร์ทอินสแตนซ์และจะใช้เวลา 2-3 นาที เมื่อเสร็จแล้ว สถานะอินสแตนซ์ AlloyDB จะเป็น "พร้อม"

7. สร้างการฝังเวกเตอร์

หลังจากนำเข้าข้อมูลแล้ว เราจะมีตารางต่อไปนี้ cymbal_products ซึ่งจัดเก็บข้อมูลเกี่ยวกับผลิตภัณฑ์ cymbal_inventory ซึ่งติดตามสต็อกสินค้าในแต่ละร้านค้า และ cymbal_stores ซึ่งเป็นรายการร้านค้า หากต้องการทำการค้นหาเชิงความหมายในผลิตภัณฑ์ของเรา เราต้องสร้างการฝังเวกเตอร์ของคำอธิบายผลิตภัณฑ์ด้วยฟังก์ชัน initialize_embeddings เราจะใช้การผสานรวม Vertex AI เพื่อคำนวณข้อมูลเวกเตอร์ตามรายละเอียดผลิตภัณฑ์ของเราและเพิ่มลงในตาราง ดูข้อมูลเพิ่มเติมเกี่ยวกับเทคโนโลยีที่ใช้ได้ในเอกสารประกอบ

หากต้องการใช้การผสานรวม ให้เชื่อมต่อกับฐานข้อมูลด้วย AlloyDB Studio หรือใช้ psql จาก VM โดยใช้ IP ของอินสแตนซ์ AlloyDB และรหัสผ่าน postgres

psql "host=$INSTANCE_IP user=postgres dbname=quickstart_db"

ตรวจสอบเวอร์ชันของส่วนขยาย google_ml_integration

SELECT extversion FROM pg_extension WHERE extname = 'google_ml_integration';

โดยควรเป็นเวอร์ชัน 1.5.2 ขึ้นไป ตัวอย่างเอาต์พุตมีดังนี้

quickstart_db=> SELECT extversion FROM pg_extension WHERE extname = 'google_ml_integration'; extversion ------------ 1.5.2 (1 row)

เวอร์ชันเริ่มต้นควรเป็น 1.5.2 ขึ้นไป แต่หากอินสแตนซ์แสดงเวอร์ชันเก่ากว่า คุณอาจต้องอัปเดต ตรวจสอบว่ามีการปิดใช้การบำรุงรักษาสำหรับอินสแตนซ์หรือไม่

ติดตั้งส่วนขยายเวกเตอร์และสร้างคอลัมน์ใหม่เพื่อจัดเก็บการฝังใน cymbal_products

CREATE EXTENSION IF NOT EXISTS vector;

ALTER TABLE cymbal_products ADD COLUMN product_embedding vector(768);

เอาต์พุตของคอนโซลที่คาดไว้

quickstart_db=> ALTER TABLE cymbal_products ADD COLUMN product_embedding vector(768); ALTER TABLE quickstart_db=>

เราจะใช้การสร้างการฝังแบบเป็นชุดเพื่อปรับปรุงประสิทธิภาพ คุณอ่านข้อมูลเพิ่มเติมเกี่ยวกับตัวเลือกและเทคนิคการสร้างการฝังต่างๆ ได้ในคู่มือ ก่อนหน้านี้เราได้เปิดใช้goole_ml_integration.enable_faster_embedding_generation Flag ซึ่งช่วยให้เราสร้างการฝังแบบเป็นชุดได้

สุดท้ายนี้ เรายังต้องการให้การฝังรีเฟรชเมื่อค่าคอลัมน์มีการเปลี่ยนแปลงโดยการรวมอาร์กิวเมนต์ incremental_refresh_mode ไว้ในการเรียกใช้ฟังก์ชัน ซึ่งจะทำให้ฐานข้อมูลของเรามีค่าใช้จ่ายเพิ่มเติม แต่เราก็ยอมรับข้อแลกเปลี่ยนนี้เพื่อให้ระบบซิงค์การฝังกับเนื้อหาโดยอัตโนมัติ หากต้องการอัปเดตการฝังด้วยตนเอง โปรดดูวิธีการในเอกสารประกอบ

เมื่อนำทุกอย่างมารวมกันและสร้างการฝัง เราจะใช้ฟังก์ชัน initialize_embeddings และส่ง batch_size เป็นคำแนะนำเกี่ยวกับกลุ่มที่มีขนาด 50 และตั้งค่า incremental_refresh_mode เป็น transactional

CALL ai.initialize_embeddings(

model_id => 'text-embedding-005',

table_name => 'cymbal_products',

content_column => 'product_description',

embedding_column => 'product_embedding',

batch_size => 50,

incremental_refresh_mode => 'transactional'

);

และตอนนี้หากเราแทรกแถวใหม่ลงในตารางที่มีค่า NULL สำหรับคอลัมน์ product_embedding

INSERT INTO "cymbal_products" ("uniq_id", "crawl_timestamp", "product_url", "product_name", "product_description", "list_price", "sale_price", "brand", "item_number", "gtin", "package_size", "category", "postal_code", "available", "product_embedding") VALUES ('fd604542e04b470f9e6348e640cff794', NOW(), 'https://example.com/new_product', 'New Cymbal Product', 'This is a new cymbal product description.', 199.99, 149.99, 'Example Brand', 'EB123', '1234567890', 'Single', 'Cymbals', '12345', TRUE, NULL);

ตอนนี้เมื่อเราค้นหาแถวที่เพิ่งแทรกไป เราจะเห็นว่าคอลัมน์ product_embedding ได้รับการอัปเดตโดยอัตโนมัติ

SELECT uniq_id, (product_embedding::real[])[1:5] as product_embedding FROM cymbal_products WHERE uniq_id='fd604542e04b470f9e6348e640cff794';

เอาต์พุตควรมีลักษณะดังนี้

quickstart_db=> SELECT uniq_id,(product_embedding::real[])[1:5] as product_embedding FROM cymbal_products WHERE uniq_id='fd604542e04b470f9e6348e640cff794';

uniq_id | product_embedding

----------------------------------+---------------------------------------------------------------

fd604542e04b470f9e6348e640cff794 | {0.015003494,-0.005349732,-0.059790313,-0.0087091,-0.0271452}

(1 row)

Time: 3.295 ms

8. สร้างดัชนีเวกเตอร์

เราจะเพิ่มดัชนี ScaNN เพื่อปรับปรุงประสิทธิภาพการค้นหาเวกเตอร์

สร้างดัชนี ScaNN

หากต้องการสร้างดัชนี SCANN เราต้องเปิดใช้อีก 1 ส่วนขยาย ส่วนขยาย alloydb_scann มีอินเทอร์เฟซสําหรับทํางานกับดัชนีเวกเตอร์ประเภท ANN โดยใช้อัลกอริทึม ScaNN ของ Google

CREATE EXTENSION IF NOT EXISTS alloydb_scann;

ผลลัพธ์ที่คาดไว้

quickstart_db=> CREATE EXTENSION IF NOT EXISTS alloydb_scann; CREATE EXTENSION Time: 27.468 ms quickstart_db=>

คุณสร้างดัชนีได้ในโหมด MANUAL หรือ AUTO โหมด MANUAL จะเปิดใช้โดยค่าเริ่มต้น และคุณสามารถสร้างดัชนีและดูแลรักษาได้เช่นเดียวกับดัชนีอื่นๆ แต่หากเปิดใช้โหมดอัตโนมัติ คุณจะสร้างดัชนีได้โดยไม่ต้องมีการบำรุงรักษาจากฝั่งคุณ อ่านรายละเอียดเกี่ยวกับตัวเลือกทั้งหมดได้ในเอกสารประกอบ ในกรณีของเรา เรามีแถวไม่เพียงพอที่จะสร้างดัชนีในโหมดอัตโนมัติ ดังนั้นเราจะสร้างดัชนีเป็นโหมดแมนนวลและรวมพารามิเตอร์การปรับแต่ง คุณอ่านเกี่ยวกับการปรับพารามิเตอร์ดัชนีได้ในเอกสารประกอบ

CREATE INDEX cymbal_products_embeddings_scann ON cymbal_products

USING scann (product_embedding cosine)

WITH (mode='MANUAL', num_leaves=31, max_num_levels = 2);

ผลลัพธ์ที่คาดไว้

quickstart_db=> CREATE INDEX cymbal_products_embeddings_scann ON cymbal_products USING scann (product_embedding cosine) WITH (num_leaves=31, max_num_levels = 2); CREATE INDEX quickstart_db=>

ตรวจสอบการใช้ดัชนี

ตอนนี้เราสามารถเรียกใช้การค้นหาเวกเตอร์ในโหมด EXPLAIN และยืนยันว่ามีการใช้ดัชนีหรือไม่

EXPLAIN (analyze)

WITH trees as (

SELECT

cp.product_name,

left(cp.product_description,80) as description,

cp.sale_price,

cs.zip_code,

cp.uniq_id as product_id

FROM

cymbal_products cp

JOIN cymbal_inventory ci on

ci.uniq_id=cp.uniq_id

JOIN cymbal_stores cs on

cs.store_id=ci.store_id

AND ci.inventory>0

AND cs.store_id = 1583

ORDER BY

(cp.product_embedding <=> embedding('text-embedding-005','What kind of fruit trees grow well here?')::vector) ASC

LIMIT 1)

SELECT json_agg(trees) FROM trees;

ผลลัพธ์ที่คาดหวัง (แก้ไขเพื่อความชัดเจน)

... Aggregate (cost=16.59..16.60 rows=1 width=32) (actual time=2.875..2.877 rows=1 loops=1) -> Subquery Scan on trees (cost=8.42..16.59 rows=1 width=142) (actual time=2.860..2.862 rows=1 loops=1) -> Limit (cost=8.42..16.58 rows=1 width=158) (actual time=2.855..2.856 rows=1 loops=1) -> Nested Loop (cost=8.42..6489.19 rows=794 width=158) (actual time=2.854..2.855 rows=1 loops=1) -> Nested Loop (cost=8.13..6466.99 rows=794 width=938) (actual time=2.742..2.743 rows=1 loops=1) -> Index Scan using cymbal_products_embeddings_scann on cymbal_products cp (cost=7.71..111.99 rows=876 width=934) (actual time=2.724..2.724 rows=1 loops=1) Order By: (embedding <=> '[0.008864171,0.03693164,-0.024245683,-0.00355923,0.0055611245,0.015985578,...<redacted>...5685,-0.03914233,-0.018452475,0.00826032,-0.07372604]'::vector) ...

จากเอาต์พุต เราจะเห็นได้อย่างชัดเจนว่าคําค้นหาใช้ "Index Scan using cymbal_products_embeddings_scann on cymbal_products"

9. การสร้างอินสแตนซ์แบบยืดหยุ่น

Elasticsearch เป็นเครื่องหมายการค้าของ Elastic NV และไม่มีส่วนเกี่ยวข้องกับ Google LLC เราจะใช้ Elasticsearch สำหรับการค้นหาข้อความแบบเต็ม (FTS) ซึ่งเป็นส่วนหนึ่งของการค้นหาแบบไฮบริด หากมีอินสแตนซ์ Elasticsearch คุณสามารถข้ามขั้นตอนต่อไปนี้และสร้างคีย์ API แบบอ่านอย่างเดียวสำหรับส่วนตัว/ผู้ใช้ที่ AlloyDB ใช้เพื่อเข้าถึงคลัสเตอร์ Elasticsearch ได้ หรือจะเปิดใช้อินสแตนซ์ Elasticsearch ใน VM ที่คุณสร้างไว้ก่อนหน้านี้ก็ได้

SSH เข้าสู่ VM และติดตั้ง Docker

sudo apt-get update

sudo apt-get install -y ca-certificates curl gnupg

sudo install -m 0755 -d /etc/apt/keyrings

curl -fsSL https://download.docker.com/linux/debian/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

echo \

"deb [arch="$(dpkg --print-architecture)" signed-by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/debian \

"$(. /etc/os-release && echo "$VERSION_CODENAME")" stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt-get update

sudo apt-get install -y docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

ตอนนี้คุณสามารถแก้ไขคำสั่ง Docker เพื่อให้ผู้ใช้เรียกใช้ได้แล้ว

sudo usermod -aG docker $USER

newgrp docker

ในเทอร์มินัลของ VM ให้เรียกใช้คำสั่งต่อไปนี้เพื่อสร้างคอนเทนเนอร์ยืดหยุ่น

curl -fsSL https://elastic.co/start-local | sh

ผลลัพธ์ที่คาดหวัง (แก้ไข)

🎉 Congrats, Elasticsearch and Kibana are installed and running in Docker! 🌐 Open your browser at http://localhost:5601 Username: elastic Password: [password_value] 🔌 Elasticsearch API endpoint: http://localhost:9200 🔑 API key: [API Key] Learn more at https://github.com/elastic/start-local

คัดลอกเอาต์พุตและวางลงในไฟล์ต่อไปนี้

nano elastic-last-run.txt

Ctrl + O, Enter, Ctrl + X เพื่อบันทึกและออก

โดยค่าเริ่มต้น คอนเทนเนอร์ Docker จะรับฟังใน http://localhost:9200 และอาจมีปัญหาในการรับคำขอภายนอกจาก AlloyDB เราต้องกำหนดค่า docker-compose.yml ให้รับฟังใน 9200:9200

หลังจากเรียกใช้สคริปต์แล้ว ระบบควรสร้างไดเรกทอรี elastic-start-local ใหม่ ไปที่ไดเรกทอรีนี้และแก้ไข Dockerfile

cd elastic-start-local/

nano docker-compose.yml

คุณจะเห็นข้อมูลต่อไปนี้ที่ด้านบน

elasticsearch:

image: docker.elastic.co/elasticsearch/elasticsearch:${ES_LOCAL_VERSION}

container_name: ${ES_LOCAL_CONTAINER_NAME}

volumes:

- dev-elasticsearch:/usr/share/elasticsearch/data

ports:

- localhost:9200

แก้ไขฟิลด์ ports เป็น

ports:

- 9200:9200

บันทึกและออกโดยใช้ Ctrl + O, Enter, Ctrl + X ตอนนี้ให้รีสตาร์ทสแต็ก

docker compose up -d

ตอนนี้เราจะป้อนคำอธิบายและชื่อผลิตภัณฑ์ลงในอินสแตนซ์ Elastic คัดลอก CSV ของผลิตภัณฑ์จากพื้นที่เก็บข้อมูลระบบคลาวด์ไปยัง VM

gcloud storage cp gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv .

ผลลัพธ์ที่คาดหวัง

gcloud storage cp gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv . Copying gs://cloud-training/gcc/gcc-tech-004/cymbal_products.csv to file://./cymbal_products.csv Completed files 1/1 | 1.4MiB/1.4MiB Average throughput: 147.9MiB/s

ตอนนี้ให้สร้างสคริปต์ Python เพื่อแยก CSV และจัดรูปแบบข้อมูลเป็น NDJSON สำหรับการอัปโหลดแบบกลุ่ม

nano convert.py

วางข้อมูลต่อไปนี้ในไฟล์

import csv

import json

# Configuration

input_file = 'cymbal_products.csv'

output_file = 'products.json'

index_name = 'elasticindexdemo'

def convert():

try:

with open(input_file, mode='r', encoding='utf-8') as f_in, \

open(output_file, mode='w', encoding='utf-8') as f_out:

reader = csv.DictReader(f_in)

count = 0

for row in reader:

metadata = {

"index": {

"_index": index_name,

"_id": row['uniq_id'].strip()

}

}

# 2. Data/Source line

document = {

"uniq_id": row['uniq_id'].strip(),

"product_name": row['product_name'].strip(),

"product_description": row['product_description'].strip()

}

# Write to file

f_out.write(json.dumps(metadata) + '\n')

f_out.write(json.dumps(document) + '\n')

count += 1

print(f"Success: Processed {count} products.")

print(f"Output saved to: {output_file}")

except Exception as e:

print(f"An error occurred: {e}")

if __name__ == "__main__":

convert()

บันทึกไฟล์และเรียกใช้

python3 convert.py

ผลลัพธ์ที่คาดหวัง

~$ python3 convert.py Success: Processed 941 products. Output saved to: products.json

สำหรับการโหลดข้อมูลแบบเป็นกลุ่ม เราต้องดึงคีย์ API จากไฟล์ที่เรียกใช้ก่อนหน้าและใช้เพื่อให้สิทธิ์เข้าถึงอินสแตนซ์ จากนั้นจะมีการส่งไฟล์ JSON ที่สร้างไว้ก่อนหน้านี้ สำหรับสถานการณ์การใช้งานจริง คุณควรกำหนดดัชนีและประเภทข้อมูลใน Elasticsearch เนื่องจากชุดข้อมูลใน Codelab นี้มีขนาดเล็ก เราจึงให้ Elasticsearch จัดการข้อมูล ก่อนอื่น ให้ดึงคีย์ API จากไฟล์แล้วบันทึกลงในตัวแปร

AUTH_HDR=$(grep "API key" elastic-last-run.txt | sed -e "s/^.*API key:[[:space:]]*/ApiKey /g")

ใช้ตัวแปรที่เราบันทึกไว้เพื่อเรียกใช้คำสั่ง curl ต่อไปนี้ ซึ่งจะอัปโหลดข้อมูลจาก JSON

curl -s -X POST "localhost:9200/elasticindexdemo/_bulk?pretty" \

-H "Content-Type: application/x-ndjson" \

-H "Authorization: $AUTH_HDR" \

--data-binary "@products.json"

ผลลัพธ์ที่คาดหวัง

~$ curl -s -X POST "localhost:9200/elasticindexdemo/_bulk?pretty" \

-H "Content-Type: application/x-ndjson" \

-H "Authorization: $AUTH_HDR" \

--data-binary "@products.json"

{

"errors" : false,

"took" : 1003,

"items" : [

{

"index" : {

"_index" : "elasticindexdemo",

"_id" : "a73d5f754f225ecb9fdc64232a57bc37",

"_version" : 1,

"result" : "created",

"_shards" : {

"total" : 2,

"successful" : 1,

"failed" : 0

},

"_seq_no" : 0,

"_primary_term" : 1,

"status" : 201

}

},

...]

}

Done

สุดท้าย เราต้องคว้าคีย์ API ไปยังอินสแตนซ์ Elasticsearch เพื่อให้บันทึกไว้ให้ AlloyDB ใช้ได้ เรียกใช้คำสั่งต่อไปนี้และคัดลอกค่าคีย์ API

cat elastic-last-run.txt

เมื่อมีคีย์ API แล้ว เราต้องสร้าง Secret ใน Secret Manager ใน Cloud Shell ให้เรียกใช้คำสั่งต่อไปนี้ด้วยคีย์ API

echo -n "[YOUR_API_KEY_VALUE]" | \

gcloud secrets create elasticsearch \

--replication-policy="automatic" \

--data-file=-

10. การสร้าง Foreign Data Wrapper ใน AlloyDB

ระยะเวลา 20:00

หากต้องการค้นหาข้อมูลที่จัดเก็บไว้ใน Elasticsearch จาก AlloyDB เราต้องสร้าง Foreign Data Wrapper (FDW) สำหรับ Elastic และตารางภายนอก ก่อนหน้านี้คุณจัดเก็บคีย์ API ของ Elastic ไว้ใน Secret Manager เพื่อให้ AlloyDB เข้าถึงข้อมูลลับได้ ให้สิทธิ์ที่จำเป็นแก่บัญชีบริการ

ใน Cloud Shell ให้สิทธิ์เข้าถึง elasticsearch แก่บัญชีบริการ

gcloud secrets add-iam-policy-binding elasticsearch \

--member="serviceAccount:service-$(gcloud projects describe $(gcloud config get-value project) --format='value(projectNumber)')@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/secretmanager.secretAccessor"

ผลลัพธ์ที่คาดหวัง

gcloud secrets add-iam-policy-binding elasticsearch \

--member="serviceAccount:service-$(gcloud projects describe $(gcloud config get-value project) --format='value(projectNumber)')@gcp-sa-alloydb.iam.gserviceaccount.com" \

--role="roles/secretmanager.secretAccessor"

Updated IAM policy for secret [elasticsearch].

bindings:

- members:

- serviceAccount:service-257907437930@gcp-sa-alloydb.iam.gserviceaccount.com

role: roles/secretmanager.secretAccessor

etag: BwZOghJiP5U=

version: 1

ไปที่คลัสเตอร์ AlloyDB แล้วเปิด AlloyDB Studio (คุณยังใช้ psql เพื่อเชื่อมต่อจาก VM ได้ด้วย) เข้าสู่ระบบ quickstart_db ในฐานะผู้ใช้ postgres

เปิดใช้ส่วนขยาย FDW

CREATE EXTENSION external_search_fdw;

ผลลัพธ์ที่คาดหวัง

Statement executed successfully

หากต้องการเข้าถึง Elasticsearch ให้สร้างเซิร์ฟเวอร์ข้อมูลภายนอก คุณดูที่อยู่ IP ภายในของ VM ได้ใน Compute Engine > อินสแตนซ์ VM สำหรับเส้นทางของข้อมูลลับ ให้ไปที่ Secret Manager แล้วเลือกข้อมูลลับของคุณ เส้นทางควรอยู่ที่ด้านบน ตรวจสอบว่าคุณได้ใส่ /versions/latest เพื่อดึงข้อมูลลับเวอร์ชันล่าสุด

CREATE SERVER elastic_demo_server

FOREIGN DATA WRAPPER external_search_fdw

OPTIONS(

server 'http://[VM INTERNAL IP ADDRESS]:9200',

search_provider 'elastic',

auth_method 'ApiKey',

secret_path '[SECRET PATH]/versions/latest'

);

จากนั้นกำหนดตารางภายนอก หลังจากข้อมูลเมตา ให้ระบุนิยามสคีมาฟิลด์ Elasticsearch เพื่อให้ตรงกับข้อมูลที่โหลดก่อนหน้านี้ ในตารางระยะไกล ให้ระบุชื่อดัชนี Elastic

CREATE FOREIGN TABLE elasticindexdemo (

metadata external_search_fdw_schema.OpaqueMetadata,

uniq_id TEXT,

product_name TEXT,

product_description TEXT

)

SERVER elastic_demo_server

OPTIONS(

remote_table_name 'elasticindexdemo'

);

สร้างการแมปผู้ใช้สำหรับเซิร์ฟเวอร์

CREATE USER MAPPING FOR CURRENT_USER SERVER elastic_demo_server;

ตอนนี้คุณทดสอบตารางต่างประเทศได้แล้ว

SELECT uniq_id, product_name

FROM elasticindexdemo

ORDER BY metadata <@> 'product_description:lamp' DESC

limit 10;

ผลลัพธ์ที่คาดหวัง

"uniq_id","product_name" "59c05332f09426c23d8d005528e3c12e","CVL Mini Vintage Metal Lamp Shade: Black Metal with Punched Pattern" "c24dd78c0d570105256e1bf1cb2fea9d","Better Homes & Gardens Tapered Drum Shade, White Box Pleat" "7ba20db2bcfab28f88fc714d73af1eb8","4 Pack E27 Wireless Remote Control Light Lamp Bulb Holder Cap Socket Switch 30m" "0fad1469ea9dfa80b35cfe5266b8bfe7","Star Projector Lamp, 360 Degree Star Night Light Romantic Room Rotating Cosmos Star Projuctor With USB Cable, Light Lamp Starry Moon Sky Night Projector Kid Bedroom Lamp" "70b37e483ef3678078236d36954525ce","Lucille 10.5\""h Duck Egg Blue Empire Stitched Lamp Shade 7x10x8" "b7a4b9151598f4cae7707cbedabe3c1b","10x12x8\"" SLIP UNO FITTER Hardback Shallow Drum Lamp Shade Textured Slate" "5962cf47b88186eed76d14f6376882df","E27 To E14 Lampshade Lamp Light Shades Socket Reducing Ring Adapter Washer" "7c54fdebfe0b1dd3f649741b8928a95b","iMounTEK LED Projector Lamp Kids Night Light Star Moon Projection Night Lamp 360\u00b0 Rotation Timer for Children Bedroom" "4531201095c2653530747e215fcc1435","Home Concept Inc 11 Classics Brass Empire Lamp Shade" "350527adb4299a015bcce74dee97805e","6 Colors LED Star Projector Lamp 360 Degree Romantic Rotating Night Cosmos Star Sky Moon Projector Kids Sleep Night Light For Children Gift Bedroom Decor"

11. การใช้การค้นหาแบบไฮบริด

ระยะเวลา 15:00

เมื่อตั้งค่าทุกอย่างแล้ว เราจะใช้ฟังก์ชัน ai.hybrid_search() เพื่อรวมการค้นหาเวกเตอร์และการค้นหาข้อความแบบเต็มได้ อ่านเพิ่มเติมเกี่ยวกับการค้นหาแบบไฮบริดได้ในเอกสารประกอบ เมื่อใช้การค้นหาแบบไฮบริด โดยค่าเริ่มต้น ผลการค้นหาจะใช้อัลกอริทึม Reciprocal Rank Fusion เพื่อจัดอันดับผลลัพธ์จากคำค้นหาหลายรายการ ก่อนอื่นเรามาลองใช้การค้นหาเวกเตอร์และการค้นหาแบบไฮบริดแยกกันเพื่อวิเคราะห์ความแตกต่างกัน

คำค้นหาต่อไปนี้จะทำการค้นหาเวกเตอร์เพื่อค้นหาผลิตภัณฑ์ที่คล้ายกับเชอร์รี อาร์เรย์จะแสดงรายการการค้นหาที่จะดำเนินการ ในกรณีนี้เราใช้เฉพาะการค้นหาเวกเตอร์ แต่ในภายหลังเราจะให้ทั้งเวกเตอร์และ FTS

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"data_type": "vector",

"table_name": "cymbal_products",

"key_column": "uniq_id",

"vec_column": "product_embedding",

"distance_operator": "public.<=>",

"limit": 3,

"query_vector": "ai.embedding(''text-embedding-005'', ''cherry'')::vector"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

ในเอาต์พุต ต้นเชอร์รีเป็นผลลัพธ์แรก แต่โปรดสังเกตว่าผลลัพธ์อีก 2 รายการถัดไปก็เป็นต้นไม้ผลเช่นกัน เนื่องจากเมื่อใช้การค้นหาเวกเตอร์ในคอลัมน์ product_description เราจะพบรายการที่ตรงกันเชิงความหมายกับเงื่อนไขการค้นหา

"id","score","product_name","product_description" "d536e9e823296a2eba198e52dd23e712","0.01639344262295082","Cherry Tree","This is a beautiful cherry tree that will produce delicious cherries. It is an deciduous tree that grows to be about 15 feet tall. The leaves are dark green in the summer and turn a beautiful red in the fall. Cherry trees are known for their beauty and their ability to provide shade and privacy. Cherry trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 4-9." "b70c44b1a38c0a2329fa583c9109a80f","0.016129032258064516","Peach Tree","This is a beautiful peach tree that will produce delicious peaches. It is an evergreen tree that grows to be about 20 feet tall. The leaves are dark green in the summer and turn a beautiful yellow in the fall. Peach trees are known for their beauty and their ability to provide shade and privacy. Peach trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 2-9." "23e41a71d63d8bbc9bdfa1d118cfddc5","0.015873015873015872","Apple Tree","This is a beautiful apple tree that will produce delicious apples. It is a deciduous tree that grows to be about 30 feet tall. The leaves are dark green in the summer and turn a beautiful red, orange, and yellow in the fall. Apple trees are known for their strength and durability. They are also a popular choice for shade trees. Apple trees prefer a cool, moist climate and loamy soil. They are best suited for USDA zones 4-8."

หากต้องการทำการค้นหาข้อความแบบเต็ม ให้เรียกใช้การค้นหาต่อไปนี้

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"limit": 3,

"data_type": "external_search_fdw",

"table_name": "elasticindexdemo",

"key_column": "uniq_id",

"query_text_input": "product_description:(cherry)"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

โปรดทราบว่าในผลการค้นหา เนื่องจากฟีเจอร์การค้นหาข้อความแบบเต็มใช้การทำงานแบบตรงทั้งหมด ผลการค้นหาจึงแสดงทุกอย่างที่มีคำว่า "เชอร์รี" ในรายละเอียดผลิตภัณฑ์

"id","score","product_name","product_description" "d536e9e823296a2eba198e52dd23e712","0.01639344262295082","Cherry Tree","This is a beautiful cherry tree that will produce delicious cherries. It is an deciduous tree that grows to be about 15 feet tall. The leaves are dark green in the summer and turn a beautiful red in the fall. Cherry trees are known for their beauty and their ability to provide shade and privacy. Cherry trees prefer a cool, moist climate and sandy soil. They are best suited for USDA zones 4-9." "390cf08feac229e7b752709fd1f943b3","0.016129032258064516","Woven Round Placemat, Set of Twelve, Grass","...These placemats are great for special occasions and holidays, but are also perfect to accessorize your everyday place settings.|Measurements. 15-inch round diameter is the perfect size for most table sizes and shapes.|Pop Colors. Choose from 7 pop woven color placemats including: Black, Cherry, Grass, Taupe, Navy, Sun and Graphite." "2c9aa7ac98c30abf78dd9c62a68a34e6","0.015873015873015872","48 Scented Wax Melts Wax Cubes: Jelly Belly Jelly Beans Candy Bulk Soy Wax Melts For Candle Warmer, Wax Warmers, Wax Melt Warmers In 8 Pack Set","...From These Flavors: Lemon Drop, Mixed Berry Smoothie, Sizzling Cinnamon, Crushed Pineapple, Juicy Pear, Cotton Candy, Toasted Marshmallow, French Vanilla, Watermelon, Red Apple, Very Cherry, Buttered Popcorn..."

ตอนนี้คุณสามารถรวมการค้นหาเชิงความหมายและ FTS เพื่อให้ได้ผลลัพธ์ที่มีความหมายมากขึ้น สมมติว่าเราต้องการค้นหาต้นไม้ที่สูงกว่าบ้านและมาจากแคลิฟอร์เนีย เราจะแยกคำค้นหาเพื่อใช้ประโยชน์จากความตั้งใจเชิงความหมายเทียบกับการจับคู่แบบตรงตัว การค้นหาเวกเตอร์จะจัดการส่วนที่เป็นคำอธิบาย เช่น "ต้นไม้ที่สูงกว่าบ้าน" เนื่องจากเข้าใจแนวคิดเรื่องความสูงและขนาดโดยไม่ต้องใช้คีย์เวิร์ดที่ตรงกัน ในขณะเดียวกัน การค้นหาแบบเต็มข้อความจะจัดการ "แคลิฟอร์เนีย" เป็นตัวกรองที่เข้มงวดเพื่อให้มั่นใจว่าเราจะได้รับการจับคู่ทางภูมิศาสตร์ที่ตรงกันทุกประการ ไม่ใช่แค่สิ่งที่คล้ายกันในเชิงแนวคิด

SELECT id, score, cymbal_products.product_name, cymbal_products.product_description

FROM ai.hybrid_search(

ARRAY[

'{

"data_type": "vector",

"table_name": "cymbal_products",

"key_column": "uniq_id",

"vec_column": "product_embedding",

"distance_operator": "public.<=>",

"limit": 3,

"query_vector": "ai.embedding(''text-embedding-005'', ''tree that can grow taller than a house'')::vector"

}'::JSONB,

'{

"limit": 3,

"data_type": "external_search_fdw",

"table_name": "elasticindexdemo",

"key_column": "uniq_id",

"query_text_input": "product_description:(California)"

}'::JSONB

]

) JOIN cymbal_products ON id = cymbal_products.uniq_id;

ผลลัพธ์ที่คาดหวัง

"id","score","product_name","product_description" "a589fd36a8a20fd9472d2403d6ed692a","0.00819672631147241","California Redwood","This is a beautiful redwood tree that can grow to be over 300 feet tall. It is an evergreen tree that grows in the coastal forests of California. Redwoods are known for their beauty and their strength. They are best suited for USDA zones 7-10." "ef9432802da24041594c2cf368dfb4d2","0.008064521129029258","Madrone","This is a beautiful madrona tree that can grow to be over 80 feet tall. It is an evergreen tree that grows in the coastal forests of California. Madronas are known for their beauty and their bark. They are best suited for USDA zones 7-10." "1360d8642bc218e4ea28e9c32b2e1721","0.007936512936504936","California Sycamore","This is a beautiful sycamore tree that can grow to be over 100 feet tall. It is an deciduous tree that grows in the valleys and foothills of California. California sycamores are known for their beauty and their shade. They are best suited for USDA zones 7-10."

12. ล้างสภาพแวดล้อม

ทำลายอินสแตนซ์และคลัสเตอร์ AlloyDB เมื่อคุณทำแล็บเสร็จแล้ว

ลบคลัสเตอร์ AlloyDB และอินสแตนซ์ทั้งหมด

หากคุณเคยใช้ AlloyDB เวอร์ชันทดลองใช้ อย่าลบคลัสเตอร์ทดลองหากคุณวางแผนที่จะทดสอบห้องทดลองและทรัพยากรอื่นๆ โดยใช้คลัสเตอร์ทดลอง คุณจะสร้างคลัสเตอร์ทดลองอื่นในโปรเจ็กต์เดียวกันไม่ได้

คลัสเตอร์จะถูกทำลายด้วยตัวเลือก force ซึ่งจะลบอินสแตนซ์ทั้งหมดที่เป็นของคลัสเตอร์ด้วย

ใน Cloud Shell ให้กำหนดตัวแปรโปรเจ็กต์และตัวแปรสภาพแวดล้อมหากคุณถูกตัดการเชื่อมต่อและสูญเสียการตั้งค่าก่อนหน้านี้ทั้งหมด

gcloud config set project <your project id>

export REGION=us-central1

export ADBCLUSTER=alloydb-hybrid-search

export PROJECT_ID=$(gcloud config get-value project)

ลบคลัสเตอร์

gcloud alloydb clusters delete $ADBCLUSTER --region=$REGION --force

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-001-402417)$ gcloud alloydb clusters delete $ADBCLUSTER --region=$REGION --force All of the cluster data will be lost when the cluster is deleted. Do you want to continue (Y/n)? Y Operation ID: operation-1697820178429-6082890a0b570-4a72f7e4-4c5df36f Deleting cluster...done.

ลบข้อมูลสำรองของ AlloyDB

ลบข้อมูลสำรอง AlloyDB ทั้งหมดสำหรับคลัสเตอร์

for i in $(gcloud alloydb backups list --filter="CLUSTER_NAME: projects/$PROJECT_ID/locations/$REGION/clusters/$ADBCLUSTER" --format="value(name)" --sort-by=~createTime) ; do gcloud alloydb backups delete $(basename $i) --region $REGION --quiet; done

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-001-402417)$ for i in $(gcloud alloydb backups list --filter="CLUSTER_NAME: projects/$PROJECT_ID/locations/$REGION/clusters/$ADBCLUSTER" --format="value(name)" --sort-by=~createTime) ; do gcloud alloydb backups delete $(basename $i) --region $REGION --quiet; done Operation ID: operation-1697826266108-60829fb7b5258-7f99dc0b-99f3c35f Deleting backup...done.

ตอนนี้เราสามารถทำลาย VM ได้แล้ว

ลบ VM ใน GCE

ใน Cloud Shell ให้เรียกใช้คำสั่งต่อไปนี้

export GCEVM=instance-1

export ZONE=us-central1-a

gcloud compute instances delete $GCEVM \

--zone=$ZONE \

--quiet

เอาต์พุตของคอนโซลที่คาดไว้

student@cloudshell:~ (test-project-001-402417)$ export GCEVM=instance-1

export ZONE=us-central1-a

gcloud compute instances delete $GCEVM \

--zone=$ZONE \

--quiet

Deleted

13. ขอแสดงความยินดี

ขอแสดงความยินดีที่ทำ Codelab เสร็จสมบูรณ์

สิ่งที่เราได้พูดถึง

- วิธีติดตั้งใช้งานคลัสเตอร์และอินสแตนซ์หลักของ AlloyDB

- วิธีเชื่อมต่อกับ AlloyDB จาก VM ของ Google Compute Engine

- วิธีสร้างฐานข้อมูลและเปิดใช้ AlloyDB AI

- วิธีโหลดข้อมูลลงในฐานข้อมูล

- วิธีใช้ AlloyDB Studio

- สร้างการฝังด้วย Vertex AI

- วิธีสร้างดัชนีเวกเตอร์ ScaNN เพื่อเพิ่มประสิทธิภาพการค้นหาเวกเตอร์

- วิธีสร้าง Foreign Data Wrapper (FDW) สำหรับ Elasticsearch

- ทำการค้นหาแบบไฮบริดโดยรวมการค้นหาเชิงความหมายใน AlloyDB กับการค้นหาข้อความแบบเต็มใน Elastic

ขั้นตอนถัดไป

คุณดู Codelab ของ AlloyDB เพิ่มเติมได้ในเว็บไซต์ Codelab อย่างเป็นทางการ