1. 소개

이 Codelab에서는 AI 에이전트를 사용하여 복잡한 인프라 마이그레이션을 자동으로 실행하는 방법을 알아봅니다. Kubernetes 매니페스트를 수동으로 작성하거나 자동화 스크립트를 실행하는 대신 자연어로 인텐트 를 표현하면 에이전트가 모델 컨텍스트 프로토콜 (MCP) 및 Gemini Cloud Assist 서버를 사용하여 구성을 생성하고 적용합니다.

GCA MCP 서버 기능

GCA MCP 서버는 에이전트에 다음과 같은 여러 전문 도구를 제공합니다.

ask_cloud_assist: Google Cloud Platform 지원 및 Gemini Cloud Assist 에이전트의 기본 인터페이스입니다. Gemini Cloud Assist의 모든 기능은 이 도구를 통해 액세스할 수 있으며 다른 MCP 도구의 기능을 포함합니다.design_infra: Google Cloud Platform에서 인프라를 설계하고 설계하는 워크플로를 지원합니다.investigate_issue: Google Cloud에서 문제 해결을 위한 워크플로를 지원합니다. 조사 리소스를 통해 빠른 문제 해결 또는 심층적인 문제 해결을 실행할 수 있습니다.invoke_operation: Google Cloud에서 리소스를 만들고, 업데이트하고, 삭제하는 워크플로를 지원합니다. 이 도구는 에이전트 작업이 사용 설정된 경우에만 작동합니다. Gemini Cloud Assist의 쓰기 작업은 이 도구의 호출을 통해서만 실행할 수 있습니다.optimize_costs: Google Cloud 비용을 분석, 추적, 최적화하는 워크플로를 지원합니다. 지출에 대한 세부 분석을 제공하고 유휴 또는 사용률이 낮은 리소스를 찾아 비용 효율성을 높일 수 있는 기회를 파악합니다.

GKE 클러스터와 다운로드된 모델이 포함된 사전 준비된 환경으로 시작합니다. 그런 다음 gemini-cli를 사용하여 에이전트에 Cloud Run에서 GKE로 워크로드를 마이그레이션하고 스토리지 버킷의 준비된 모델을 사용하여 vLLM으로 Gemma 추론 인스턴스를 시작하도록 요청합니다.

실습할 내용

- Terraform을 사용하여 GKE 클러스터를 준비하고 Gemma 모델을 다운로드합니다.

- 에이전트 규칙 및 MCP 서버로

gemini-cli를 구성합니다. - 특정 자연어 프롬프트를 사용하여 에이전트에 전체 마이그레이션 및 배포를 실행하도록 안내합니다.

- 에이전트가 실행한 배포를 확인합니다.

필요한 항목

- 웹브라우저(예: Chrome)

- 결제가 사용 설정된 Google Cloud 프로젝트.

- Hugging Face 토큰 (준비 단계에서 Gemma 모델을 다운로드하는 데 필요)

이 Codelab은 초보자를 포함한 모든 수준의 개발자를 대상으로 합니다.

예상 소요 시간: 45~60분

2. 시작하기 전에

Google Cloud 프로젝트 만들기 또는 선택

- Google Cloud 콘솔에서 Google Cloud 프로젝트를 선택하거나 만듭니다.

- Cloud 프로젝트에 결제가 사용 설정되어 있는지 확인합니다.

Cloud Shell 시작

- Google Cloud 콘솔 상단에서 Cloud Shell 활성화 를 클릭합니다.

- 인증 확인

gcloud auth list

- 프로젝트 확인하기

gcloud config get project

- 필요한 경우 설정합니다.

export PROJECT_ID=<YOUR_PROJECT_ID>

gcloud config set project $PROJECT_ID

API 사용 설정

이 명령어를 실행하여 필요한 모든 API를 사용 설정합니다.

gcloud services enable \

run.googleapis.com \

container.googleapis.com \

aiplatform.googleapis.com \

compute.googleapis.com \

cloudbuild.googleapis.com \

cloudresourcemanager.googleapis.com

또한 Gemini Cloud Assist MCP 서비스를 사용 설정합니다.

gcloud beta services mcp enable geminicloudassist.googleapis.com

3. 환경 준비

이 단계에서는 커스텀 챗봇 이미지를 빌드하고, GKE 클러스터를 만들고, Gemma 모델을 Cloud Storage 버킷에 다운로드하여 환경을 준비합니다.

조직은 Gemini API로 시작하는 경우가 많지만 나중에 더 많은 제어, 맞춤설정 또는 비즈니스에 특정한 미세 조정된 버전을 사용하기 위해 자체 호스팅 모델로 마이그레이션하기로 결정합니다. 이 Codelab에서는 GKE에서 직접 호스팅할 수 있는 강력한 개방형 모델의 예로 Gemma를 사용합니다. Cloud Storage 버킷에 준비하면 클러스터에서 사용할 수 있습니다.

데모 애셋 다운로드

GitHub 저장소에서 특정 폴더를 클론합니다.

git clone --filter=blob:none --sparse https://github.com/GoogleCloudPlatform/next-26-keynotes.git

cd next-26-keynotes

git sparse-checkout set devkey/intent-to-infrastructure

cd devkey/intent-to-infrastructure

챗봇 이미지 빌드

인프라를 프로비저닝하기 전에 커스텀 챗봇 이미지를 빌드하고 Artifact Registry에 푸시해야 합니다. 이 이미지는 다음 단계에서 Cloud Run에서 사용됩니다.

asia-southeast1에서chatbot-repo라는 Artifact Registry 저장소를 만듭니다.gcloud artifacts repositories create chatbot-repo \ --repository-format=docker \ --location=asia-southeast1 \ --description="Chatbot Docker repository"src디렉터리로 이동합니다.cd src- Cloud Build를 사용하여 이미지를 빌드하고 푸시합니다.

gcloud builds submit --config cloudbuild.yaml \ --substitutions=_LOCATION="asia-southeast1",_REPOSITORY_ID="chatbot-repo",_IMAGE_NAME="chatbot",_IMAGE_TAG="latest" - 프로젝트 루트로 돌아갑니다.

cd ..

기본 인프라 프로비저닝

terraform 디렉터리로 이동하고 1단계를 실행하여 GKE 클러스터를 만듭니다.

cd terraform

./deploy.sh demo step1 apply

이 스크립트는 Terraform을 사용하여 기본 인프라를 프로비저닝합니다. VPC, GKE 클러스터, 서비스 계정을 만들고 방금 빌드한 챗봇 이미지를 사용하여 초기 Cloud Run 서비스를 배포합니다.

이 과정에서 Terraform은 계획을 표시하고 확인을 요청합니다. yes를 입력하여 승인하고 계속 진행해야 합니다.

Do you want to perform these actions?

Terraform will perform the actions described above.

Only 'yes' will be accepted to approve.

전체 프로세스를 완료하는 데 15~20분이 걸릴 수 있습니다.

배포가 완료되면 터미널에 출력된 Terraform 출력에서 cloud_run_url을 찾습니다. URL을 클릭하여 브라우저에서 챗봇을 엽니다. 이제 현재 Gemini 2.5 Flash에 대해 실행 중인 챗봇과 상호작용할 수 있습니다.

모델 다운로드

이 단계에서는 Gemma 모델을 Cloud Storage 버킷에 준비합니다. 관리형 Gemini API로 시작하지만 커스텀 미세 조정된 모델 또는 다른 커스텀 개방형 모델을 실행하도록 선택할 수 있습니다. 또는 보안 또는 규정 준수상의 이유로 모델 실행을 자체 클러스터 내에서 관리하도록 유지할 수도 있습니다. 여기에서 모델을 준비하면 관리형 Gemini API에서 GKE의 자체 호스팅 모델로 마이그레이션할 수 있습니다.

2단계를 실행하여 Gemma 모델을 GCS 버킷에 다운로드합니다. Hugging Face 토큰이 필요합니다. 이 프로세스는 GKE 클러스터에서 실행되며 Hugging Face에서 모델을 다운로드하고 나중에 사용할 수 있도록 버킷에 업로드하는 데 약 15분 (트래픽에 따라 더 오래 걸릴 수 있음)이 걸립니다.

./deploy.sh demo step2 apply -var="hf_token=<YOUR_HF_TOKEN>"

이 Terraform 명령어는 다운로드를 처리하기 위해 GKE 클러스터에 Kubernetes 작업을 만듭니다. Terraform 스크립트는 작업이 실행되는 동안 활성 상태로 유지됩니다.

다른 셸 세션에서 진행 상황을 모니터링하거나 실행 후 완료되었는지 확인하려면 다음을 실행하면 됩니다.

kubectl get jobs

4. 에이전트 및 MCP 설정

이제 마이그레이션을 실행할 에이전트를 구성합니다. gemini-cli를 사용하고 환경과 상호작용하는 규칙을 적용합니다.

Gemini Cloud Assist (GCA) MCP 서버 는 이 흐름의 중요한 구성요소입니다. 클라이언트 측 에이전트와 Google Cloud 간의 브리지 역할을 하여 조사를 실행하고, 계획 (예: gcloud 및 kubectl 명령어)을 생성하고, 클라우드 프로젝트의 리소스에 변경사항을 직접 적용할 수 있도록 합니다.

roles/geminicloudassist.user와 같이 MCP 도구를 호출할 수 있는 역할이 부여되었는지 확인합니다. 나중에 권한 문제가 발생하면 Cloud Assist의 IAM 역할 구성에 관한 문서를 참고하세요.

Gemini Cloud Assist를 서드 파티 도구와 통합하는 방법에 관한 자세한 안내는 MCP를 사용하여 Gemini Cloud Cloud Assist를 서드 파티 도구와 통합 문서를 참고하세요.

Gemini Cloud Assist 확장 프로그램 설치

- 다음을 실행하여 애플리케이션 기본 사용자 인증 정보 (ADC)를 통해 인증합니다.

gcloud auth application-default login

- MCP 서버를 Gemini CLI 확장 프로그램으로 설치합니다.

gemini extensions install https://github.com/GoogleCloudPlatform/gemini-cloud-assist-mcp

- 기술이 성공적으로 설치되었는지 확인합니다.

gemini를 시작하고 다음 명령어를 실행하여 활성 기술을 나열합니다.

/skills list

목록에 Gemini Cloud Assist와 관련된 기능이 표시되는지 확인합니다. exit를 입력하여 Cloud Shell 프롬프트로 돌아갑니다.

Gemini Cloud Assist에서 변경 사용 설정

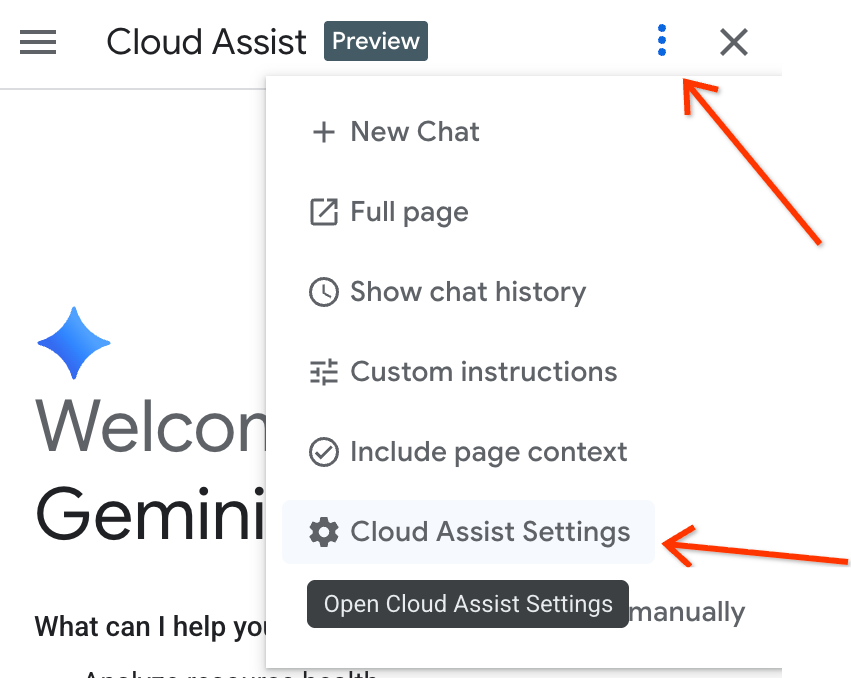

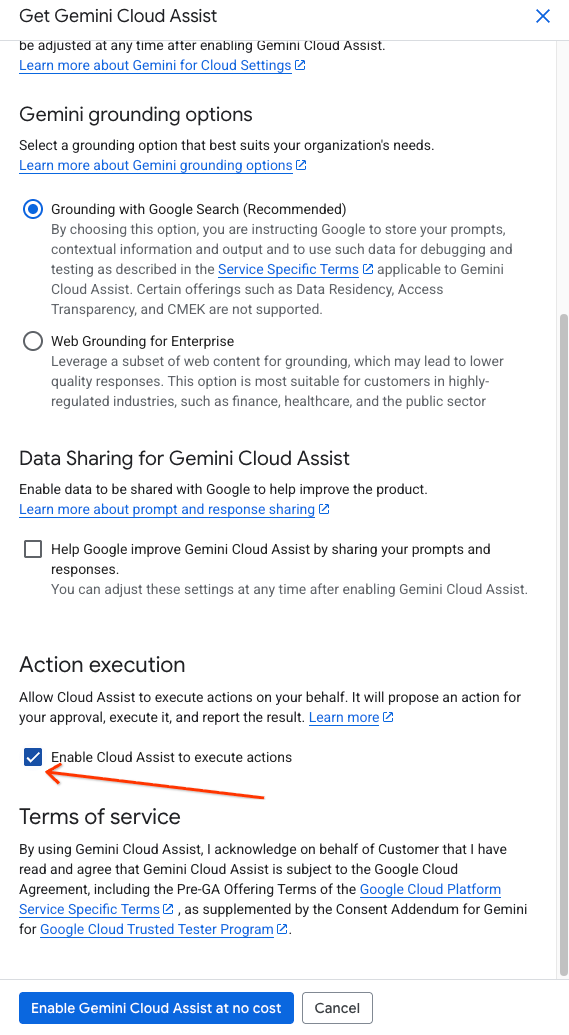

에이전트가 인프라에 변경사항을 적용하도록 허용하려면 Gemini Cloud Assist UI에서 변경 기능을 사용 설정해야 합니다.

- Google Cloud 콘솔 창의 오른쪽 상단에 있는 Gemini 로고를 클릭하여 Gemini Assist 사이드바를 엽니다.

- 사이드바에 나열된 필요한 API를 사용 설정합니다.

- 사이드바에서 설정으로 이동하고 "Cloud Assist를 사용 설정하여 작업 실행"을 선택합니다.

에이전트 규칙 구성

프로젝트 디렉터리에는 폴더 (intent-to-infrastructure)의 루트에 커스텀 gemini.md 파일이 포함되어 있습니다. 이 파일에는 에이전트가 올바른 도구를 사용하도록 안내하는 규칙이 포함되어 있습니다.

이 파일이 디렉터리에 있는지 확인합니다. Terraform 파일, 애플리케이션 코드, gemini.md 규칙 파일에 액세스할 수 있도록 이 디렉터리에서 gemini를 실행해야 합니다.

5. 1단계: 챗봇을 GKE로 마이그레이션

이제 에이전트를 사용하여 마이그레이션의 첫 번째 부분인 챗봇 애플리케이션을 Cloud Run에서 GKE로 이동하는 작업을 실행합니다.

intent-to-infrastructure디렉터리의 루트에서gemini를 시작합니다 (gemini.md에 액세스할 수 있는지 확인).- 먼저 에이전트에 프로젝트를 탐색하여 애플리케이션과 인프라를 파악하도록 요청합니다. 다음 프롬프트를 입력합니다.

Tell me about the app and infrastructure in this project

에이전트는 디렉터리의 파일을 읽고 챗봇 애플리케이션과 Terraform 구성에 관한 개요를 제공해야 합니다.

- 이제 다음 프롬프트를 사용하여 에이전트에 마이그레이션을 실행하도록 안내합니다.

Convert my Cloud Run service to the equivalent on GKE.

- 에이전트는 다음을 실행해야 합니다.

ask_cloud_assist도구를 사용하여 컨텍스트를 파악합니다.design_infra도구를 사용하여 챗봇 애플리케이션의 Kubernetes YAML을 생성합니다.- '이 구성을 적용하시겠습니까?'라고 묻습니다.

yes로 응답하여 변경사항을 적용합니다. 에이전트는invoke_operation을 사용하여 리소스를 GKE 클러스터에 배포합니다.

1단계 확인

- 서비스 목록을 가져옵니다.

kubectl get services

챗봇 애플리케이션의 서비스가 실행 중인 것을 확인할 수 있습니다.

- 챗봇에 액세스하도록 서비스의 포트를 전달합니다.

kubectl port-forward svc/chatbot-service 8080:80

(참고:

chatbot-service

를 에이전트가 생성한 서비스의 실제 이름으로 바꿉니다(다른 경우).

챗봇을 테스트합니다. Cloud Run에서 구성된 대로 Gemini API를 사용하여 계속 응답해야 합니다.

6. 2단계: vLLM을 통해 Gemma 배포 및 다시 연결

이 단계에서는 에이전트를 사용하여 GKE에 자체 호스팅 Gemma 모델을 배포하고 애플리케이션을 다시 연결합니다.

- 동일한

gemini세션에서 다음 프롬프트를 입력합니다.

Now that the chatbot is on GKE, add a vLLM service running the Gemma model from my storage bucket in the same cluster. Make sure to give the vLLM service at least 10 minutes to start up to account for loading the large model. Then, update the chatbot service to reference this vLLM service instead of the Gemini API.

- 에이전트는 다음을 실행해야 합니다.

design_infra를 사용하여 vLLM 배포 및 서비스의 YAML을 생성합니다.- 챗봇 배포 YAML을 업데이트하여 환경 변수 (또는 구성)가 Gemini API 대신 새 vLLM 서비스를 가리키도록 변경합니다.

- 변경사항을 적용할지 확인을 요청합니다.

yes로 응답하여 변경사항을 적용합니다.

2단계 확인

- 포드 목록을 다시 가져옵니다.

kubectl get pods

이제 챗봇과 vLLM의 포드가 모두 표시됩니다.

- vLLM이 준비되면 필요한 경우 챗봇 서비스를 다시 포트 전달하고 테스트합니다. 이제 자체 호스팅 Gemma 모델로 구동됩니다.

7. 삭제

Google Cloud 계정에 비용이 계속 청구되지 않도록 하려면 이 Codelab 중에 만든 리소스를 삭제합니다.

기본 인프라의 삭제 명령어를 실행합니다.

cd terraform

./deploy.sh demo step1 destroy

또한 로컬 환경을 정리하려면 Gemini Cloud Assist 확장 프로그램을 제거하거나 사용 중지할 수 있습니다. 확장 프로그램 이름 뒤에 gemini extensions uninstall 또는 gemini extensions disable을 사용합니다.

8. 다음 단계

Gemini Cloud Assist 및 고급 기능에 관해 자세히 알아보려면 다음 리소스를 참고하세요.

9. 축하합니다

축하합니다. 자연어와 MCP를 사용하여 에이전트 기반 워크로드 마이그레이션을 GKE로 성공적으로 실행했습니다.