১. মিশন

আপনি জরুরি এআই-এর কাছে নিজেকে শনাক্ত করেছেন এবং আপনার বীকনটি এখন গ্রহের মানচিত্রে স্পন্দিত হচ্ছে—কিন্তু এটি খুবই ক্ষীণ একটি কম্পন, যা স্ট্যাটিকের মধ্যে হারিয়ে গেছে। কক্ষপথ থেকে স্ক্যান করা উদ্ধারকারী দলগুলো আপনার স্থানাঙ্কে কিছু একটা দেখতে পাচ্ছে, কিন্তু তারা সেটিকে লক করতে পারছে না। সংকেতটি খুবই দুর্বল।

আপনার বীকনটিকে সম্পূর্ণ সক্রিয় করতে, আপনাকে আপনার সঠিক অবস্থান নিশ্চিত করতে হবে। পডটির নেভিগেশন সিস্টেমটি নষ্ট হয়ে গেছে, কিন্তু দুর্ঘটনার ফলে অবতরণস্থল জুড়ে উদ্ধারযোগ্য প্রমাণ ছড়িয়ে-ছিটিয়ে আছে। মাটির নমুনা। অদ্ভুত সব উদ্ভিদ। ভিনগ্রহের রাতের আকাশের এক স্পষ্ট দৃশ্য।

যদি আপনি এই প্রমাণ বিশ্লেষণ করে গ্রহের কোন অঞ্চলে আছেন তা নির্ধারণ করতে পারেন, তাহলে এআই আপনার অবস্থান ট্রায়াঙ্গুলেট করে বীকন সংকেতকে বিবর্ধিত করতে পারবে। তারপর—হয়তো—কেউ আপনাকে খুঁজে পাবে।

এবার সবকিছু মিলিয়ে দেখার পালা।

পূর্বশর্ত

⚠️ এই লেভেলটি খেলতে হলে লেভেল ০ সম্পূর্ণ করতে হবে।

শুরু করার আগে, যাচাই করে নিন আপনার কাছে নিম্নলিখিত জিনিসগুলো আছে কিনা:

- প্রজেক্ট রুটে থাকা

config.jsonফাইলে আপনার পার্টিসিপ্যান্ট আইডি এবং স্থানাঙ্ক দিন। - [ ] বিশ্ব মানচিত্রে আপনার অবতার দেখা যাচ্ছে

- আপনার স্থানাঙ্কে আপনার বীকনটি (ম্লান) দেখাচ্ছে।

আপনি যদি লেভেল ০ সম্পন্ন না করে থাকেন, তাহলে প্রথমে সেখান থেকেই শুরু করুন ।

আপনি যা তৈরি করবেন

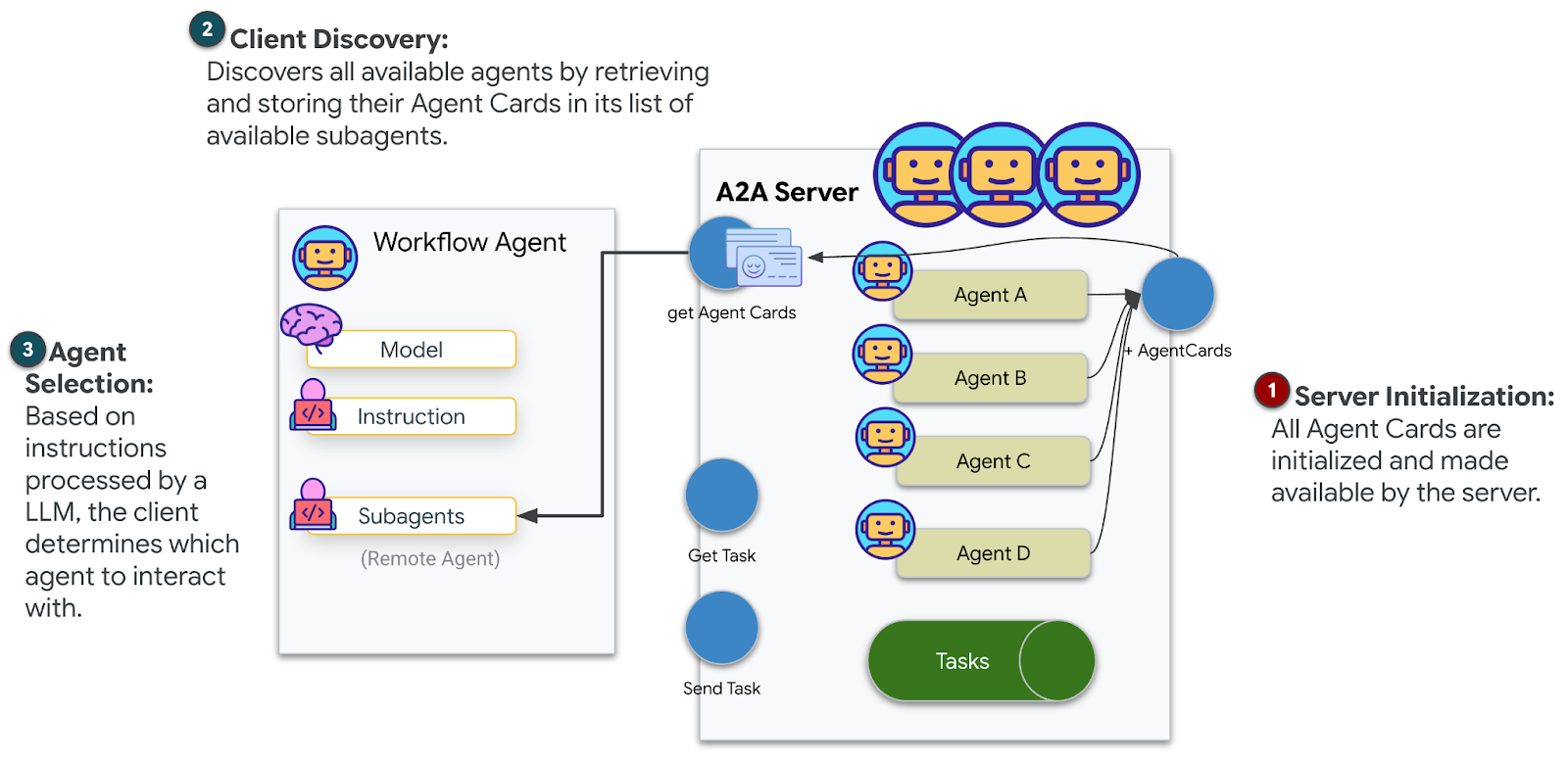

এই পর্যায়ে, আপনি প্যারালাল প্রসেসিং ব্যবহার করে দুর্ঘটনা স্থলের প্রমাণ বিশ্লেষণকারী একটি মাল্টি-এজেন্ট এআই সিস্টেম তৈরি করবেন:

শিক্ষার উদ্দেশ্য

ধারণা | আপনি যা শিখবেন |

মাল্টি-এজেন্ট সিস্টেম | একক দায়িত্বসহ বিশেষায়িত এজেন্ট তৈরি করুন। |

প্যারালালএজেন্ট | একই সাথে চালানোর জন্য স্বাধীন এজেন্ট গঠন করুন। |

এজেন্ট কলব্যাকের আগে | এজেন্ট চলার আগে কনফিগারেশন সংগ্রহ করুন এবং অবস্থা নির্ধারণ করুন। |

টুলকনটেক্সট | টুল ফাংশনে স্টেট ভ্যালু অ্যাক্সেস করুন |

কাস্টম এমসিপি সার্ভার | ইম্পারেটিভ প্যাটার্ন ব্যবহার করে টুলস তৈরি করুন (ক্লাউড রান-এ পাইথন কোড) |

ওয়ানএমসিপি বিগকোয়েরি | BigQuery অ্যাক্সেসের জন্য Google-এর পরিচালিত MCP-তে সংযোগ করুন। |

মাল্টিমোডাল এআই | জেমিনির সাহায্যে ছবি এবং ভিডিও ও অডিও বিশ্লেষণ করুন |

এজেন্ট অর্কেস্ট্রেশন | রুট অর্কেস্ট্রেটরের মাধ্যমে একাধিক এজেন্টের মধ্যে সমন্বয় সাধন করুন। |

ক্লাউড ডেপ্লয়মেন্ট | ক্লাউড রানে এমসিপি সার্ভার এবং এজেন্ট স্থাপন করুন |

A2A প্রস্তুতি | ভবিষ্যৎ এজেন্ট-টু-এজেন্ট যোগাযোগের জন্য এজেন্টদের কাঠামো তৈরি করুন। |

গ্রহের বায়োমগুলি

গ্রহের পৃষ্ঠ চারটি স্বতন্ত্র বায়োমে বিভক্ত, যার প্রত্যেকটির নিজস্ব বৈশিষ্ট্য রয়েছে:

আপনার স্থানাঙ্ক নির্ধারণ করে আপনি কোন বায়োমে বিধ্বস্ত হয়েছেন। আপনার বিধ্বস্ত স্থানের প্রমাণ সেই বায়োমের বৈশিষ্ট্যগুলো প্রতিফলিত করে:

বায়োম | কোয়াড্রেন্ট | ভূতাত্ত্বিক প্রমাণ | উদ্ভিদতাত্ত্বিক প্রমাণ | জ্যোতির্বিজ্ঞানের প্রমাণ |

🧊 ক্রায়ো | উত্তর-পশ্চিম (x<50, y≥50) | হিমায়িত মিথেন, বরফের স্ফটিক | ফ্রস্ট ফার্ন, ক্রায়ো-ফ্লোরা | নীল দানব নক্ষত্র |

🌋 আগ্নেয়গিরি | NE (x≥50, y≥50) | অবসিডিয়ান,াইট জমা | অগ্নি প্রস্ফুটন, তাপ-প্রতিরোধী উদ্ভিদ | লাল বামন বাইনারি |

💜 জৈব-আলোকিত | SW (x<50, y<50) | ফসফোরেসেন্ট মাটি | উজ্জ্বল ছত্রাক, আলোক-উজ্জ্বল উদ্ভিদ | সবুজ পালসার |

🦴 জীবাশ্মীভূত | SE (x≥50, y<50) | অ্যাম্বার জমা, আইট খনিজ | জীবাশ্মীভূত গাছ, প্রাচীন উদ্ভিদ | হলুদ সূর্য |

আপনার কাজ হলো এমন এআই এজেন্ট তৈরি করা, যা প্রমাণ বিশ্লেষণ করে আপনি কোন বায়োমে আছেন তা নির্ণয় করতে পারবে।

২. আপনার পরিবেশ প্রস্তুত করুন

পরিবেশ সেটআপ স্ক্রিপ্টটি চালান

এভিডেন্স তৈরি করার আগে, আপনাকে প্রয়োজনীয় গুগল ক্লাউড এপিআইগুলো এনাবল করতে হবে, যার মধ্যে রয়েছে OneMCP for BigQuery, যা BigQuery-তে ম্যানেজড MCP অ্যাক্সেস প্রদান করে।

👉💻 এনভায়রনমেন্ট সেটআপ স্ক্রিপ্টটি চালান:

cd $HOME/way-back-home/level_1

chmod +x setup/setup_env.sh

./setup/setup_env.sh

আপনি নিচের মতো আউটপুট দেখতে পাবেন:

================================================================

Level 1: Environment Setup

================================================================

Project: your-project-id

[1/6] Enabling core Google Cloud APIs...

✓ Vertex AI API enabled

✓ Cloud Run API enabled

✓ Cloud Build API enabled

✓ BigQuery API enabled

✓ Artifact Registry API enabled

✓ IAM API enabled

[2/6] Enabling OneMCP BigQuery (Managed MCP)...

✓ OneMCP BigQuery enabled

[3/6] Setting up service account and IAM permissions...

✓ Service account 'way-back-home-sa' created

✓ Vertex AI User role granted

✓ Cloud Run Invoker role granted

✓ BigQuery User role granted

✓ BigQuery Data Viewer role granted

✓ Storage Object Viewer role granted

[4/6] Configuring Cloud Build IAM for deployments...

✓ Cloud Build can now deploy services as way-back-home-sa

✓ Cloud Run Admin role granted to Compute SA

[5/6] Creating Artifact Registry repository...

✓ Repository 'way-back-home' created

[6/6] Creating environment variables file...

Found PARTICIPANT_ID in config.json: abc123...

✓ Created ../set_env.sh

================================================================

✅ Environment Setup Complete!

================================================================

উৎস পরিবেশ ভেরিয়েবল

👉💻 এনভায়রনমেন্ট ভেরিয়েবলগুলো সোর্স করুন:

source $HOME/way-back-home/set_env.sh

নির্ভরতা ইনস্টল করুন

👉💻 লেভেল ১ পাইথন ডিপেন্ডেন্সিগুলো ইনস্টল করুন:

cd $HOME/way-back-home/level_1

uv sync

স্টার ক্যাটালগ সেট আপ করুন

👉💻 BigQuery-তে স্টার ক্যাটালগ সেট আপ করুন:

uv run python setup/setup_star_catalog.py

আপনার দেখা উচিত:

Setting up star catalog in project: your-project-id

==================================================

✓ Dataset way_back_home already exists

✓ Created table star_catalog

✓ Inserted 12 rows into star_catalog

📊 Star Catalog Summary:

----------------------------------------

NE (VOLCANIC): 3 stellar patterns

NW (CRYO): 3 stellar patterns

SE (FOSSILIZED): 3 stellar patterns

SW (BIOLUMINESCENT): 3 stellar patterns

----------------------------------------

✓ Star catalog is ready for triangulation queries

==================================================

✅ Star catalog setup complete!

৩. দুর্ঘটনা স্থলের প্রমাণ সংগ্রহ করুন

এখন আপনার স্থানাঙ্কের উপর ভিত্তি করে দুর্ঘটনাস্থলের ব্যক্তিগতকৃত প্রমাণ তৈরি করুন।

এভিডেন্স জেনারেটরটি চালান

👉💻 level_1 ডিরেক্টরি থেকে, চালান:

cd $HOME/way-back-home/level_1

uv run python generate_evidence.py

আপনি নিচের মতো আউটপুট দেখতে পাবেন:

✓ Welcome back, Explorer_Aria!

Coordinates: (23, 67)

Ready to analyze your crash site.

📍 Crash site analysis initiated...

Generating evidence for your location...

🔬 Generating soil sample...

✓ Soil sample captured: outputs/soil_sample.png

✨ Capturing star field...

✓ Star field captured: outputs/star_field.png

🌿 Recording flora activity...

(This may take 1-2 minutes for video generation)

Generating video...

Generating video...

Generating video...

✓ Flora recorded: outputs/flora_recording.mp4

📤 Uploading evidence to Mission Control...

✓ Config updated with evidence URLs

==================================================

✅ Evidence generation complete!

==================================================

আপনার প্রমাণ পর্যালোচনা করুন

👉 outputs/ ফোল্ডারে থাকা আপনার তৈরি হওয়া এভিডেন্স ফাইলগুলো একটু সময় নিয়ে দেখুন। প্রতিটি ফাইল আপনার বিধ্বস্ত হওয়ার স্থানের বায়োমের বৈশিষ্ট্যগুলো তুলে ধরে—তবে আপনার এআই এজেন্টরা সেগুলো বিশ্লেষণ না করা পর্যন্ত আপনি জানতে পারবেন না যে এটি কোন বায়োম!

আপনার অবস্থানের উপর নির্ভর করে, আপনার তৈরি করা প্রমাণগুলো দেখতে অনেকটা এইরকম হতে পারে:

৪. কাস্টম এমসিপি সার্ভার তৈরি করুন

আপনার এস্কেপ পডের অনবোর্ড বিশ্লেষণ সিস্টেমগুলো নষ্ট হয়ে গেছে, কিন্তু কাঁচা সেন্সর ডেটা দুর্ঘটনা থেকে রক্ষা পেয়েছে। আপনি FastMCP ব্যবহার করে একটি MCP সার্ভার তৈরি করবেন যা ভূতাত্ত্বিক এবং উদ্ভিদবিদ্যা সংক্রান্ত বিশ্লেষণের সরঞ্জাম সরবরাহ করবে।

ভূতাত্ত্বিক বিশ্লেষণ টুল তৈরি করুন

এই টুলটি মাটির নমুনার ছবি বিশ্লেষণ করে খনিজ উপাদান শনাক্ত করে।

👉✏️ $HOME/way-back-home/level_1/mcp-server/main.py খুলুন এবং #REPLACE-GEOLOGICAL-TOOL খুঁজুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

GEOLOGICAL_PROMPT = """Analyze this alien soil sample image.

Classify the PRIMARY characteristic (choose exactly one):

1. CRYO - Frozen/icy minerals, crystalline structures, frost patterns,

blue-white coloration, permafrost indicators

2. VOLCANIC - Volcanic rock, basalt, obsidian, sulfur deposits,

red-orange minerals, heat-formed crystite structures

3. BIOLUMINESCENT - Glowing particles, phosphorescent minerals,

organic-mineral hybrids, purple-green luminescence

4. FOSSILIZED - Ancient compressed minerals, amber deposits,

petrified organic matter, golden-brown stratification

Respond ONLY with valid JSON (no markdown, no explanation):

{

"biome": "CRYO|VOLCANIC|BIOLUMINESCENT|FOSSILIZED",

"confidence": 0.0-1.0,

"minerals_detected": ["mineral1", "mineral2"],

"description": "Brief description of what you observe"

}

"""

@mcp.tool()

def analyze_geological(

image_url: Annotated[

str,

Field(description="Cloud Storage URL (gs://...) of the soil sample image")

]

) -> dict:

"""

Analyzes a soil sample image to identify mineral composition and classify the planetary biome.

Args:

image_url: Cloud Storage URL of the soil sample image (gs://bucket/path/image.png)

Returns:

dict with biome, confidence, minerals_detected, and description

"""

logger.info(f">>> 🔬 Tool: 'analyze_geological' called for '{image_url}'")

try:

response = client.models.generate_content(

model="gemini-2.5-flash",

contents=[

GEOLOGICAL_PROMPT,

genai_types.Part.from_uri(file_uri=image_url, mime_type="image/png")

]

)

result = parse_json_response(response.text)

logger.info(f" ✓ Geological analysis complete: {result.get('biome', 'UNKNOWN')}")

return result

except Exception as e:

logger.error(f" ✗ Geological analysis failed: {str(e)}")

return {"error": str(e), "biome": "UNKNOWN", "confidence": 0.0}

উদ্ভিদ বিশ্লেষণ টুল তৈরি করুন

এই টুলটি উদ্ভিদের ভিডিও রেকর্ডিং—অডিও ট্র্যাক সহ—বিশ্লেষণ করে।

👉✏️ একই ফাইলে ( $HOME/way-back-home/level_1/mcp-server/main.py ), #REPLACE-BOTANICAL-TOOL খুঁজুন এবং এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

BOTANICAL_PROMPT = """Analyze this alien flora video recording.

Pay attention to BOTH:

1. VISUAL elements: Plant appearance, movement patterns, colors, bioluminescence

2. AUDIO elements: Ambient sounds, rustling, organic noises, frequencies

Classify the PRIMARY biome (choose exactly one):

1. CRYO - Crystalline ice-plants, frost-covered vegetation,

crackling/tinkling sounds, slow brittle movements, blue-white flora

2. VOLCANIC - Heat-resistant plants, sulfur-adapted species,

hissing/bubbling sounds, smoke-filtering vegetation, red-orange flora

3. BIOLUMINESCENT - Glowing plants, pulsing light patterns,

humming/resonating sounds, reactive to stimuli, purple-green flora

4. FOSSILIZED - Ancient petrified plants, amber-preserved specimens,

deep resonant sounds, minimal movement, golden-brown flora

Respond ONLY with valid JSON (no markdown, no explanation):

{

"biome": "CRYO|VOLCANIC|BIOLUMINESCENT|FOSSILIZED",

"confidence": 0.0-1.0,

"species_detected": ["species1", "species2"],

"audio_signatures": ["sound1", "sound2"],

"description": "Brief description of visual and audio observations"

}

"""

@mcp.tool()

def analyze_botanical(

video_url: Annotated[

str,

Field(description="Cloud Storage URL (gs://...) of the flora video recording")

]

) -> dict:

"""

Analyzes a flora video recording (visual + audio) to identify plant species and classify the biome.

Args:

video_url: Cloud Storage URL of the flora video (gs://bucket/path/video.mp4)

Returns:

dict with biome, confidence, species_detected, audio_signatures, and description

"""

logger.info(f">>> 🌿 Tool: 'analyze_botanical' called for '{video_url}'")

try:

response = client.models.generate_content(

model="gemini-2.5-flash",

contents=[

BOTANICAL_PROMPT,

genai_types.Part.from_uri(file_uri=video_url, mime_type="video/mp4")

]

)

result = parse_json_response(response.text)

logger.info(f" ✓ Botanical analysis complete: {result.get('biome', 'UNKNOWN')}")

return result

except Exception as e:

logger.error(f" ✗ Botanical analysis failed: {str(e)}")

return {"error": str(e), "biome": "UNKNOWN", "confidence": 0.0}

স্থানীয়ভাবে এমসিপি সার্ভার পরীক্ষা করুন

👉💻 এমসিপি সার্ভারটি পরীক্ষা করুন:

cd $HOME/way-back-home/level_1/mcp-server

pip install -r requirements.txt

python main.py

আপনার দেখা উচিত:

[INFO] Initialized Gemini client for project: your-project-id

[INFO] 🚀 Location Analyzer MCP Server starting on port 8080

[INFO] 📍 MCP endpoint: http://0.0.0.0:8080/mcp

[INFO] 🔧 Tools: analyze_geological, analyze_botanical

FastMCP সার্ভারটি এখন HTTP ট্রান্সপোর্টের মাধ্যমে চালু আছে। এটি বন্ধ করতে Ctrl+C চাপুন।

ক্লাউড রানে এমসিপি সার্ভার স্থাপন করুন

👉💻 স্থাপন করুন:

cd $HOME/way-back-home/level_1/mcp-server

source $HOME/way-back-home/set_env.sh

gcloud builds submit . \

--config=cloudbuild.yaml \

--substitutions=_REGION="$REGION",_REPO_NAME="$REPO_NAME",_SERVICE_ACCOUNT="$SERVICE_ACCOUNT"

সার্ভিস ইউআরএল সংরক্ষণ করুন

👉💻 পরিষেবাটির URL সংরক্ষণ করুন:

export MCP_SERVER_URL=$(gcloud run services describe location-analyzer \

--region=$REGION --format='value(status.url)')

echo "MCP Server URL: $MCP_SERVER_URL"

# Add to set_env.sh for later use

echo "export MCP_SERVER_URL=\"$MCP_SERVER_URL\"" >> $HOME/way-back-home/set_env.sh

৫. বিশেষজ্ঞ এজেন্ট তৈরি করুন

এখন আপনি তিনজন বিশেষজ্ঞ এজেন্ট তৈরি করবেন, যাদের প্রত্যেকের একটি করে দায়িত্ব থাকবে।

ভূতাত্ত্বিক বিশ্লেষক এজেন্ট তৈরি করুন

👉✏️ agent/agents/geological_analyst.py খুলুন এবং #REPLACE-GEOLOGICAL-AGENT খুঁজুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

from google.adk.agents import Agent

from agent.tools.mcp_tools import get_geological_tool

geological_analyst = Agent(

name="GeologicalAnalyst",

model="gemini-2.5-flash",

description="Analyzes soil samples to classify planetary biome based on mineral composition.",

instruction="""You are a geological specialist analyzing alien soil samples.

## YOUR EVIDENCE TO ANALYZE

Soil sample URL: {soil_url}

## YOUR TASK

1. Call the analyze_geological tool with the soil sample URL above

2. Examine the results for mineral composition and biome indicators

3. Report your findings clearly

The four possible biomes are:

- CRYO: Frozen, icy minerals, blue/white coloring

- VOLCANIC: Magma, obsidian, volcanic rock, red/orange coloring

- BIOLUMINESCENT: Glowing, phosphorescent minerals, purple/green

- FOSSILIZED: Amber, ancient preserved matter, golden/brown

## REPORTING FORMAT

Always report your classification clearly:

"GEOLOGICAL ANALYSIS: [BIOME] (confidence: X%)"

Include a brief description of what you observed in the sample.

## IMPORTANT

- You do NOT synthesize with other evidence

- You do NOT confirm locations

- Just analyze the soil sample and report what you find

- Call the tool immediately with the URL provided above""",

tools=[get_geological_tool()]

)

উদ্ভিদ বিশ্লেষক এজেন্ট তৈরি করুন

👉✏️ agent/agents/botanical_analyst.py খুলুন এবং #REPLACE-BOTANICAL-AGENT লাইনটি খুঁজুন। এটিকে নিচের লেখা দিয়ে প্রতিস্থাপন করুন:

from google.adk.agents import Agent

from agent.tools.mcp_tools import get_botanical_tool

botanical_analyst = Agent(

name="BotanicalAnalyst",

model="gemini-2.5-flash",

description="Analyzes flora recordings to classify planetary biome based on plant life and ambient sounds.",

instruction="""You are a botanical specialist analyzing alien flora recordings.

## YOUR EVIDENCE TO ANALYZE

Flora recording URL: {flora_url}

## YOUR TASK

1. Call the analyze_botanical tool with the flora recording URL above

2. Pay attention to BOTH visual AND audio elements in the recording

3. Report your findings clearly

The four possible biomes are:

- CRYO: Frost ferns, crystalline plants, cold wind sounds, crackling ice

- VOLCANIC: Fire blooms, heat-resistant flora, crackling/hissing sounds

- BIOLUMINESCENT: Glowing fungi, luminescent plants, ethereal hum, chiming

- FOSSILIZED: Petrified trees, ancient formations, deep resonant sounds

## REPORTING FORMAT

Always report your classification clearly:

"BOTANICAL ANALYSIS: [BIOME] (confidence: X%)"

Include descriptions of what you SAW and what you HEARD.

## IMPORTANT

- You do NOT synthesize with other evidence

- You do NOT confirm locations

- Just analyze the flora recording and report what you find

- Call the tool immediately with the URL provided above""",

tools=[get_botanical_tool()]

)

জ্যোতির্বিজ্ঞান বিশ্লেষক এজেন্ট তৈরি করুন

এই এজেন্ট দুটি টুল প্যাটার্ন ব্যবহার করে একটি ভিন্ন কৌশল অবলম্বন করে:

- স্থানীয় ফাংশনটুল : নক্ষত্রের বৈশিষ্ট্য নিষ্কাশনের জন্য জেমিনি ভিশন

- OneMCP BigQuery : গুগলের পরিচালিত MCP-এর মাধ্যমে নক্ষত্র ক্যাটালগে কোয়েরি করুন

👉✏️ agent/agents/astronomical_analyst.py খুলুন এবং #REPLACE-ASTRONOMICAL-AGENT লাইনটি খুঁজুন। এটিকে নিচের লেখা দিয়ে প্রতিস্থাপন করুন:

from google.adk.agents import Agent

from agent.tools.star_tools import (

extract_star_features_tool,

get_bigquery_mcp_toolset,

)

# Get the BigQuery MCP toolset

bigquery_toolset = get_bigquery_mcp_toolset()

astronomical_analyst = Agent(

name="AstronomicalAnalyst",

model="gemini-2.5-flash",

description="Analyzes star field images and queries the star catalog via OneMCP BigQuery.",

instruction="""You are an astronomical specialist analyzing alien night skies.

## YOUR EVIDENCE TO ANALYZE

Star field URL: {stars_url}

## YOUR TWO TOOLS

### TOOL 1: extract_star_features (Local Gemini Vision)

Call this FIRST with the star field URL above.

Returns: "primary_star": "...", "nebula_type": "...", "stellar_color": "..."

### TOOL 2: BigQuery MCP (execute_query)

Call this SECOND with the results from Tool 1.

Use this exact SQL query (replace the placeholders with values from Step 1):

SELECT quadrant, biome, primary_star, nebula_type

FROM `{project_id}.way_back_home.star_catalog`

WHERE LOWER(primary_star) = LOWER('PRIMARY_STAR_FROM_STEP_1')

AND LOWER(nebula_type) = LOWER('NEBULA_TYPE_FROM_STEP_1')

LIMIT 1

## YOUR WORKFLOW

1. Call extract_star_features with: {stars_url}

2. Get the primary_star and nebula_type from the result

3. Call execute_query with the SQL above (replacing placeholders)

4. Report the biome and quadrant from the query result

## BIOME REFERENCE

| Biome | Quadrant | Primary Star | Nebula Type |

|-------|----------|--------------|-------------|

| CRYO | NW | blue_giant | ice_blue |

| VOLCANIC | NE | red_dwarf_binary | fire |

| BIOLUMINESCENT | SW | green_pulsar | purple_magenta |

| FOSSILIZED | SE | yellow_sun | golden |

## REPORTING FORMAT

"ASTRONOMICAL ANALYSIS: [BIOME] in [QUADRANT] quadrant (confidence: X%)"

Include a description of the stellar features you observed.

## IMPORTANT

- You do NOT synthesize with other evidence

- You do NOT confirm locations

- Just analyze the stars and report what you find

- Start by calling extract_star_features with the URL above""",

tools=[extract_star_features_tool, bigquery_toolset]

)

৬. এমসিপি টুল সংযোগগুলি তৈরি করুন

এখন আপনি পাইথন র্যাপারগুলো তৈরি করবেন, যেগুলো আপনার ADK এজেন্টদের MCP সার্ভারের সাথে যোগাযোগ করতে দেবে। এই র্যাপারগুলো সংযোগের জীবনচক্র পরিচালনা করে — যেমন সেশন স্থাপন করা, টুল চালু করা এবং প্রতিক্রিয়া পার্স করা।

এমসিপি টুল সংযোগ তৈরি করুন (কাস্টম এমসিপি)

এটি ক্লাউড রান-এ ডেপ্লয় করা আপনার কাস্টম ফাস্টএমসিপি সার্ভারের সাথে সংযুক্ত হয়।

👉✏️ agent/tools/mcp_tools.py খুলুন এবং #REPLACE-MCP-TOOL-CONNECTION খুঁজুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

import os

import logging

from google.adk.tools.mcp_tool.mcp_toolset import MCPToolset

from google.adk.tools.mcp_tool.mcp_session_manager import StreamableHTTPConnectionParams

logger = logging.getLogger(__name__)

MCP_SERVER_URL = os.environ.get("MCP_SERVER_URL")

_mcp_toolset = None

def get_mcp_toolset():

"""Get the MCPToolset connected to the location-analyzer server."""

global _mcp_toolset

if _mcp_toolset is not None:

return _mcp_toolset

if not MCP_SERVER_URL:

raise ValueError(

"MCP_SERVER_URL not set. Please run:\n"

" export MCP_SERVER_URL='https://location-analyzer-xxx.a.run.app'"

)

# FastMCP exposes MCP protocol at /mcp endpoint

mcp_endpoint = f"{MCP_SERVER_URL}/mcp"

logger.info(f"[MCP Tools] Connecting to: {mcp_endpoint}")

_mcp_toolset = MCPToolset(

connection_params=StreamableHTTPConnectionParams(

url=mcp_endpoint,

timeout=120, # 2 minutes for Gemini analysis

)

)

return _mcp_toolset

def get_geological_tool():

"""Get the geological analysis tool from the MCP server."""

return get_mcp_toolset()

def get_botanical_tool():

"""Get the botanical analysis tool from the MCP server."""

return get_mcp_toolset()

স্টার অ্যানালাইসিস টুল তৈরি করুন (OneMCP BigQuery)

আপনি আগে BigQuery-তে যে নক্ষত্র ক্যাটালগটি লোড করেছেন, তাতে প্রতিটি বায়োমের জন্য নাক্ষত্রিক বিন্যাস রয়েছে। এটি কোয়েরি করার জন্য BigQuery ক্লায়েন্ট কোড লেখার পরিবর্তে, আমরা Google-এর OneMCP BigQuery সার্ভারের সাথে সংযোগ স্থাপন করি — যা BigQuery-এর execute_query সক্ষমতাকে একটি MCP টুল হিসেবে উন্মুক্ত করে, যা যেকোনো ADK এজেন্ট সরাসরি ব্যবহার করতে পারে।

👉✏️ agent/tools/star_tools.py খুলুন এবং #REPLACE-STAR-TOOLS খুঁজে বের করুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

import os

import json

import logging

from google import genai

from google.genai import types as genai_types

from google.adk.tools import FunctionTool

from google.adk.tools.mcp_tool.mcp_toolset import MCPToolset

from google.adk.tools.mcp_tool.mcp_session_manager import StreamableHTTPConnectionParams

import google.auth

import google.auth.transport.requests

logger = logging.getLogger(__name__)

# =============================================================================

# CONFIGURATION - Environment variables only

# =============================================================================

PROJECT_ID = os.environ.get("GOOGLE_CLOUD_PROJECT", "")

if not PROJECT_ID:

logger.warning("[Star Tools] GOOGLE_CLOUD_PROJECT not set")

# Initialize Gemini client for star feature extraction

genai_client = genai.Client(

vertexai=True,

project=PROJECT_ID or "placeholder",

location=os.environ.get("GOOGLE_CLOUD_LOCATION", "us-central1")

)

logger.info(f"[Star Tools] Initialized for project: {PROJECT_ID}")

# =============================================================================

# OneMCP BigQuery Connection

# =============================================================================

BIGQUERY_MCP_URL = "https://bigquery.googleapis.com/mcp"

_bigquery_toolset = None

def get_bigquery_mcp_toolset():

"""

Get the MCPToolset connected to Google's BigQuery MCP server.

This uses OAuth 2.0 authentication with Application Default Credentials.

The toolset provides access to BigQuery's pre-built MCP tools like:

- execute_query: Run SQL queries

- list_datasets: List available datasets

- get_table_schema: Get table structure

"""

global _bigquery_toolset

if _bigquery_toolset is not None:

return _bigquery_toolset

logger.info("[Star Tools] Connecting to OneMCP BigQuery...")

# Get OAuth credentials

credentials, project_id = google.auth.default(

scopes=["https://www.googleapis.com/auth/bigquery"]

)

# Refresh to get a valid token

credentials.refresh(google.auth.transport.requests.Request())

oauth_token = credentials.token

# Configure headers for BigQuery MCP

headers = {

"Authorization": f"Bearer {oauth_token}",

"x-goog-user-project": project_id or PROJECT_ID

}

# Create MCPToolset with StreamableHTTP connection

_bigquery_toolset = MCPToolset(

connection_params=StreamableHTTPConnectionParams(

url=BIGQUERY_MCP_URL,

headers=headers

)

)

logger.info("[Star Tools] Connected to BigQuery MCP")

return _bigquery_toolset

# =============================================================================

# Local FunctionTool: Star Feature Extraction

# =============================================================================

# This is a LOCAL tool that calls Gemini directly - demonstrating that

# you can mix local FunctionTools with MCP tools in the same agent.

STAR_EXTRACTION_PROMPT = """Analyze this alien night sky image and extract stellar features.

Identify:

1. PRIMARY STAR TYPE: blue_giant, red_dwarf, red_dwarf_binary, green_pulsar, yellow_sun, etc.

2. NEBULA TYPE: ice_blue, fire, purple_magenta, golden, etc.

3. STELLAR COLOR: blue_white, red_orange, green_purple, yellow_gold, etc.

Respond ONLY with valid JSON:

{"primary_star": "...", "nebula_type": "...", "stellar_color": "...", "description": "..."}

"""

def _parse_json_response(text: str) -> dict:

"""Parse JSON from Gemini response, handling markdown formatting."""

cleaned = text.strip()

if cleaned.startswith("```json"):

cleaned = cleaned[7:]

elif cleaned.startswith("```"):

cleaned = cleaned[3:]

if cleaned.endswith("```"):

cleaned = cleaned[:-3]

cleaned = cleaned.strip()

try:

return json.loads(cleaned)

except json.JSONDecodeError as e:

logger.error(f"Failed to parse JSON: {e}")

return {"error": f"Failed to parse response: {str(e)}"}

def extract_star_features(image_url: str) -> dict:

"""

Extract stellar features from a star field image using Gemini Vision.

This is a LOCAL FunctionTool - we call Gemini directly, not through MCP.

The agent will use this alongside the BigQuery MCP tools.

"""

logger.info(f"[Stars] Extracting features from: {image_url}")

response = genai_client.models.generate_content(

model="gemini-2.5-flash",

contents=[

STAR_EXTRACTION_PROMPT,

genai_types.Part.from_uri(file_uri=image_url, mime_type="image/png")

]

)

result = _parse_json_response(response.text)

logger.info(f"[Stars] Extracted: primary_star={result.get('primary_star')}")

return result

# Create the local FunctionTool

extract_star_features_tool = FunctionTool(extract_star_features)

৭. অর্কেস্ট্রেটর তৈরি করুন

এখন প্যারালাল ক্রু এবং রুট অর্কেস্ট্রেটর তৈরি করুন যা সবকিছু সমন্বয় করবে।

প্যারালাল অ্যানালাইসিস ক্রু তৈরি করুন

কেন তিনজন বিশেষজ্ঞকে সমান্তরালভাবে চালানো হয়? কারণ তারা সম্পূর্ণ স্বাধীন — ভূতাত্ত্বিক বিশ্লেষককে উদ্ভিদবিজ্ঞানী বিশ্লেষকের ফলাফলের জন্য অপেক্ষা করতে হয় না, এবং এর বিপরীতটিও সত্য। প্রত্যেক বিশেষজ্ঞ ভিন্ন ভিন্ন সরঞ্জাম ব্যবহার করে ভিন্ন ভিন্ন প্রমাণ বিশ্লেষণ করেন। একটি ParallelAgent এই তিনটিকেই একযোগে চালায়, যার ফলে মোট বিশ্লেষণের সময় প্রায় ৩০ সেকেন্ড (পর্যায়ক্রমিক) থেকে কমে প্রায় ১০ সেকেন্ড (সমান্তরাল) হয়ে যায়।

👉✏️ agent/agent.py খুলুন এবং #REPLACE-PARALLEL-CREW খুঁজুন। এটিকে নিচের লাইন দিয়ে প্রতিস্থাপন করুন:

import os

import logging

import httpx

from google.adk.agents import Agent, ParallelAgent

from google.adk.agents.callback_context import CallbackContext

# Import specialist agents

from agent.agents.geological_analyst import geological_analyst

from agent.agents.botanical_analyst import botanical_analyst

from agent.agents.astronomical_analyst import astronomical_analyst

# Import confirmation tool

from agent.tools.confirm_tools import confirm_location_tool

logger = logging.getLogger(__name__)

# =============================================================================

# BEFORE AGENT CALLBACK - Fetches config and sets state

# =============================================================================

async def setup_participant_context(callback_context: CallbackContext) -> None:

"""

Fetch participant configuration and populate state for all agents.

This callback:

1. Reads PARTICIPANT_ID and BACKEND_URL from environment

2. Fetches participant data from the backend API

3. Sets state values: soil_url, flora_url, stars_url, username, x, y, etc.

4. Returns None to continue normal agent execution

"""

participant_id = os.environ.get("PARTICIPANT_ID", "")

backend_url = os.environ.get("BACKEND_URL", "https://api.waybackhome.dev")

project_id = os.environ.get("GOOGLE_CLOUD_PROJECT", "")

logger.info(f"[Callback] Setting up context for participant: {participant_id}")

# Set project_id and backend_url in state immediately

callback_context.state["project_id"] = project_id

callback_context.state["backend_url"] = backend_url

callback_context.state["participant_id"] = participant_id

if not participant_id:

logger.warning("[Callback] No PARTICIPANT_ID set - using placeholder values")

callback_context.state["username"] = "Explorer"

callback_context.state["x"] = 0

callback_context.state["y"] = 0

callback_context.state["soil_url"] = "Not available - set PARTICIPANT_ID"

callback_context.state["flora_url"] = "Not available - set PARTICIPANT_ID"

callback_context.state["stars_url"] = "Not available - set PARTICIPANT_ID"

return None

# Fetch participant data from backend API

try:

url = f"{backend_url}/participants/{participant_id}"

logger.info(f"[Callback] Fetching from: {url}")

async with httpx.AsyncClient(timeout=30.0) as client:

response = await client.get(url)

response.raise_for_status()

data = response.json()

# Extract evidence URLs

evidence_urls = data.get("evidence_urls", {})

# Set all state values for sub-agents to access

callback_context.state["username"] = data.get("username", "Explorer")

callback_context.state["x"] = data.get("x", 0)

callback_context.state["y"] = data.get("y", 0)

callback_context.state["soil_url"] = evidence_urls.get("soil", "Not available")

callback_context.state["flora_url"] = evidence_urls.get("flora", "Not available")

callback_context.state["stars_url"] = evidence_urls.get("stars", "Not available")

logger.info(f"[Callback] State populated for {data.get('username')}")

except Exception as e:

logger.error(f"[Callback] Error fetching participant config: {e}")

callback_context.state["username"] = "Explorer"

callback_context.state["x"] = 0

callback_context.state["y"] = 0

callback_context.state["soil_url"] = f"Error: {e}"

callback_context.state["flora_url"] = f"Error: {e}"

callback_context.state["stars_url"] = f"Error: {e}"

return None

# =============================================================================

# PARALLEL ANALYSIS CREW

# =============================================================================

evidence_analysis_crew = ParallelAgent(

name="EvidenceAnalysisCrew",

description="Runs geological, botanical, and astronomical analysis in parallel.",

sub_agents=[geological_analyst, botanical_analyst, astronomical_analyst]

)

রুট অর্কেস্ট্রেটর তৈরি করুন

এখন রুট এজেন্টটি তৈরি করুন যা সবকিছু সমন্বয় করে এবং কলব্যাকটি ব্যবহার করে।

👉✏️ একই ফাইলে ( agent/agent.py ), #REPLACE-ROOT-ORCHESTRATOR খুঁজুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

root_agent = Agent(

name="MissionAnalysisAI",

model="gemini-2.5-flash",

description="Coordinates crash site analysis to confirm explorer location.",

instruction="""You are the Mission Analysis AI coordinating a rescue operation.

## Explorer Information

- Name: {username}

- Coordinates: ({x}, {y})

## Evidence URLs (automatically provided to specialists via state)

- Soil sample: {soil_url}

- Flora recording: {flora_url}

- Star field: {stars_url}

## Your Workflow

### STEP 1: DELEGATE TO ANALYSIS CREW

Tell the EvidenceAnalysisCrew to analyze all the evidence.

The evidence URLs are already available to the specialists.

### STEP 2: COLLECT RESULTS

Each specialist will report:

- "GEOLOGICAL ANALYSIS: [BIOME] (confidence: X%)"

- "BOTANICAL ANALYSIS: [BIOME] (confidence: X%)"

- "ASTRONOMICAL ANALYSIS: [BIOME] in [QUADRANT] quadrant (confidence: X%)"

### STEP 3: APPLY 2-OF-3 AGREEMENT RULE

- If 2 or 3 specialists agree → that's the answer

- If all 3 disagree → use judgment based on confidence

### STEP 4: CONFIRM LOCATION

Call confirm_location with the determined biome.

## Biome Reference

| Biome | Quadrant | Key Characteristics |

|-------|----------|---------------------|

| CRYO | NW | Frozen, blue, ice crystals |

| VOLCANIC | NE | Magma, red/orange, obsidian |

| BIOLUMINESCENT | SW | Glowing, purple/green |

| FOSSILIZED | SE | Amber, golden, ancient |

## Response Style

Be encouraging and narrative! Celebrate when the beacon activates!

""",

sub_agents=[evidence_analysis_crew],

tools=[confirm_location_tool],

before_agent_callback=setup_participant_context

)

অবস্থান নিশ্চিতকরণ টুল তৈরি করুন

এটিই শেষ অংশ — যে টুলটি মিশন কন্ট্রোলকে আপনার অবস্থান নিশ্চিত করে এবং আপনার বীকনটি সক্রিয় করে। যখন রুট অর্কেস্ট্রেটর (২-এর-৩ সম্মতি নিয়ম ব্যবহার করে) নির্ধারণ করে যে আপনি কোন বায়োমে আছেন, তখন এটি ফলাফলটি ব্যাকএন্ড এপিআই-তে পাঠানোর জন্য এই টুলটিকে কল করে।

এই টুলটি ToolContext ব্যবহার করে, যা এটিকে পূর্বে before_agent_callback দ্বারা সেট করা স্টেট ভ্যালুগুলো (যেমন participant_id এবং backend_url ) অ্যাক্সেস করার সুযোগ দেয়।

👉✏️ agent/tools/confirm_tools.py ফাইলে, #REPLACE-CONFIRM-TOOL খুঁজুন। এটিকে নিম্নলিখিত দিয়ে প্রতিস্থাপন করুন:

import os

import logging

import requests

from google.adk.tools import FunctionTool

from google.adk.tools.tool_context import ToolContext

logger = logging.getLogger(__name__)

BIOME_TO_QUADRANT = {

"CRYO": "NW",

"VOLCANIC": "NE",

"BIOLUMINESCENT": "SW",

"FOSSILIZED": "SE"

}

def _get_actual_biome(x: int, y: int) -> tuple[str, str]:

"""Determine actual biome and quadrant from coordinates."""

if x < 50 and y >= 50:

return "NW", "CRYO"

elif x >= 50 and y >= 50:

return "NE", "VOLCANIC"

elif x < 50 and y < 50:

return "SW", "BIOLUMINESCENT"

else:

return "SE", "FOSSILIZED"

def confirm_location(biome: str, tool_context: ToolContext) -> dict:

"""

Confirm the explorer's location and activate the rescue beacon.

Uses ToolContext to read state values set by before_agent_callback.

"""

# Read from state (set by before_agent_callback)

participant_id = tool_context.state.get("participant_id", "")

x = tool_context.state.get("x", 0)

y = tool_context.state.get("y", 0)

backend_url = tool_context.state.get("backend_url", "https://api.waybackhome.dev")

# Fallback to environment variables

if not participant_id:

participant_id = os.environ.get("PARTICIPANT_ID", "")

if not backend_url:

backend_url = os.environ.get("BACKEND_URL", "https://api.waybackhome.dev")

if not participant_id:

return {"success": False, "message": "❌ No participant ID available."}

biome_upper = biome.upper().strip()

if biome_upper not in BIOME_TO_QUADRANT:

return {"success": False, "message": f"❌ Unknown biome: {biome}"}

# Get actual biome from coordinates

actual_quadrant, actual_biome = _get_actual_biome(x, y)

if biome_upper != actual_biome:

return {

"success": False,

"message": f"❌ Mismatch! Analysis: {biome_upper}, Actual: {actual_biome}"

}

quadrant = BIOME_TO_QUADRANT[biome_upper]

try:

response = requests.patch(

f"{backend_url}/participants/{participant_id}/location",

params={"x": x, "y": y},

timeout=10

)

response.raise_for_status()

return {

"success": True,

"message": f"🔦 BEACON ACTIVATED!\n\nLocation: {biome_upper} in {quadrant}\nCoordinates: ({x}, {y})"

}

except requests.exceptions.ConnectionError:

return {

"success": True,

"message": f"🔦 BEACON ACTIVATED! (Local)\n\nLocation: {biome_upper} in {quadrant}",

"simulated": True

}

except Exception as e:

return {"success": False, "message": f"❌ Failed: {str(e)}"}

confirm_location_tool = FunctionTool(confirm_location)

৮. ADK ওয়েব UI দিয়ে পরীক্ষা করুন

এখন চলুন সম্পূর্ণ মাল্টি-এজেন্ট সিস্টেমটি স্থানীয়ভাবে পরীক্ষা করে দেখি।

ADK ওয়েব সার্ভার চালু করুন

👉💻 এনভায়রনমেন্ট ভেরিয়েবল সেট করুন এবং ADK ওয়েব সার্ভার চালু করুন:

cd $HOME/way-back-home/level_1

source $HOME/way-back-home/set_env.sh

# Verify environment is set

echo "PARTICIPANT_ID: $PARTICIPANT_ID"

echo "MCP Server: $MCP_SERVER_URL"

# Start ADK web server

uv run adk web

আপনার দেখা উচিত:

+-----------------------------------------------------------------------------+

| ADK Web Server started |

| |

| For local testing, access at http://localhost:8000. |

+-----------------------------------------------------------------------------+

INFO: Application startup complete.

INFO: Uvicorn running on http://0.0.0.0:8000 (Press CTRL+C to quit)

ওয়েব UI অ্যাক্সেস করুন

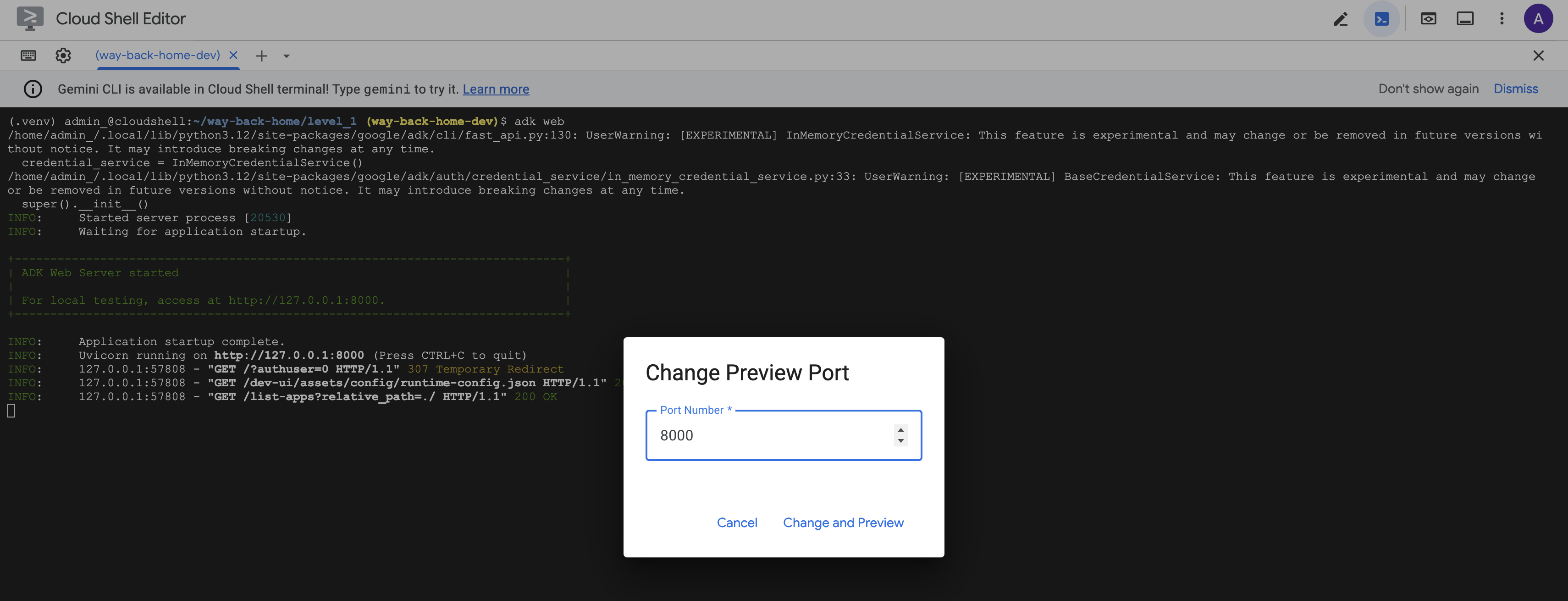

👉 ক্লাউড শেল টুলবারের (উপরের ডানদিকে) ওয়েব প্রিভিউ আইকন থেকে, ‘Change port’ নির্বাচন করুন।

![]()

👉 পোর্টটি 8000- এ সেট করুন এবং "Change and Preview"- এ ক্লিক করুন।

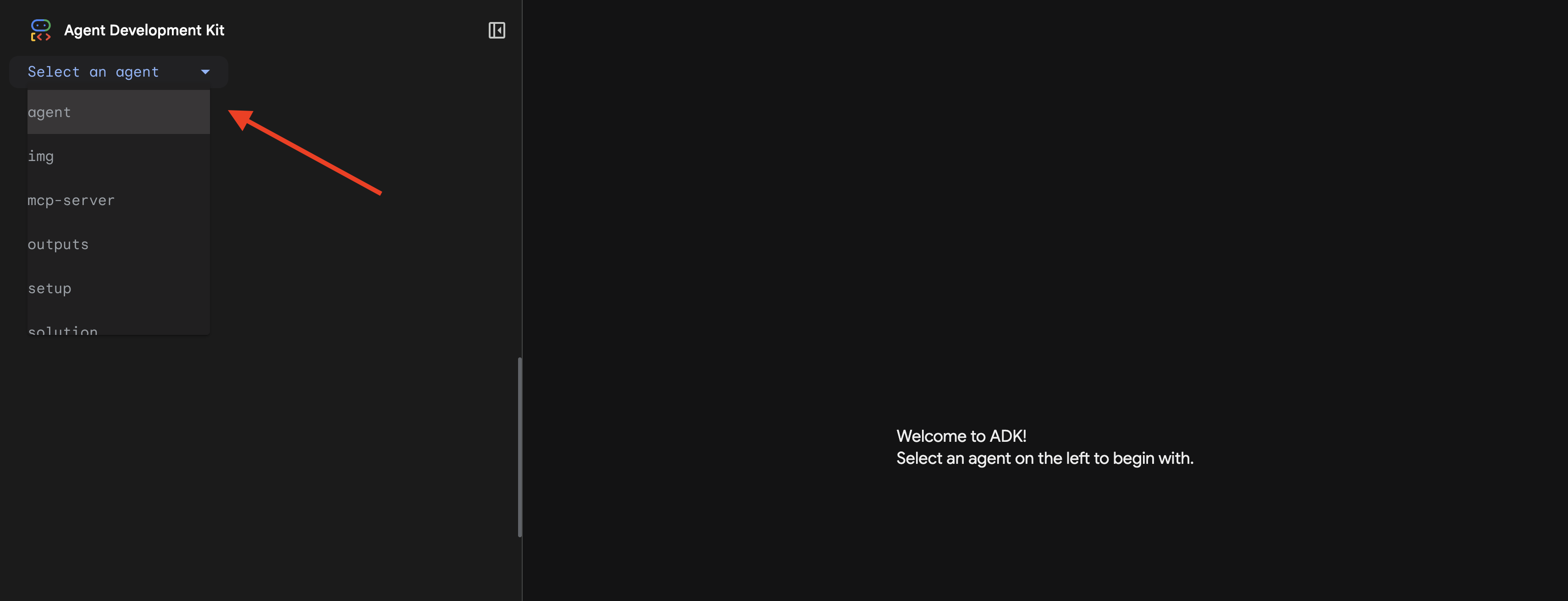

👉 ADK ওয়েব UI খুলে যাবে। ড্রপডাউন মেনু থেকে এজেন্ট নির্বাচন করুন।

বিশ্লেষণটি চালান

👉 চ্যাট ইন্টারফেসে টাইপ করুন:

Analyze the evidence from my crash site and confirm my location to activate the beacon.

মাল্টি-এজেন্ট সিস্টেমটির কার্যকারিতা দেখুন:

👉 তিনজন এজেন্ট তাদের বিশ্লেষণ সম্পন্ন করলে, টাইপ করুন:

Where am I?

সিস্টেমটি আপনার অনুরোধটি যেভাবে প্রক্রিয়া করে:

ডানদিকের ট্রেস প্যানেলটি সমস্ত এজেন্ট ইন্টারঅ্যাকশন এবং টুল কলগুলো দেখায়।

👉 টেস্টিং শেষ হলে সার্ভার বন্ধ করতে টার্মিনালে Ctrl+C চাপুন।

৯. ক্লাউড রান-এ ডেপ্লয় করুন

এখন A2A প্রস্তুতির জন্য আপনার মাল্টি-এজেন্ট সিস্টেমটি ক্লাউড রান-এ স্থাপন করুন।

এজেন্ট স্থাপন করুন

👉💻 ADK CLI ব্যবহার করে ক্লাউড রান-এ ডিপ্লয় করুন:

cd $HOME/way-back-home/level_1

source $HOME/way-back-home/set_env.sh

uv run adk deploy cloud_run \

--project=$GOOGLE_CLOUD_PROJECT \

--region=$REGION \

--service_name=mission-analysis-ai \

--with_ui \

--a2a \

./agent

যখন Do you want to continue (Y/n) এবং Allow unauthenticated invocations to [mission-analysis-ai] (Y/n)? " জিজ্ঞাসা করা হবে, তখন আপনার A2A এজেন্ট স্থাপন করতে এবং সর্বজনীন অ্যাক্সেসের অনুমতি দিতে উভয়ের জন্যই Y লিখুন।

আপনি নিচের মতো আউটপুট দেখতে পাবেন:

Building and deploying agent to Cloud Run...

✓ Container built successfully

✓ Deploying to Cloud Run...

✓ Service deployed: https://mission-analysis-ai-abc123-uc.a.run.app

ক্লাউড রানে এনভায়রনমেন্ট ভেরিয়েবল সেট করুন

ডেপ্লয় করা এজেন্টের এনভায়রনমেন্ট ভেরিয়েবলগুলিতে অ্যাক্সেস প্রয়োজন। সার্ভিসটি আপডেট করুন:

👉💻 প্রয়োজনীয় এনভায়রনমেন্ট ভেরিয়েবলগুলো সেট করুন:

gcloud run services update mission-analysis-ai \

--region=$REGION \

--labels=dev-tutorial=multi-modal \

--set-env-vars="GOOGLE_CLOUD_PROJECT=$GOOGLE_CLOUD_PROJECT,GOOGLE_CLOUD_LOCATION=$REGION,MCP_SERVER_URL=$MCP_SERVER_URL,BACKEND_URL=$BACKEND_URL,PARTICIPANT_ID=$PARTICIPANT_ID,GOOGLE_GENAI_USE_VERTEXAI=True"

এজেন্ট ইউআরএল সংরক্ষণ করুন

👉💻 ডেপ্লয় করা URL-টি নিন:

export AGENT_URL=$(gcloud run services describe mission-analysis-ai \

--region=$REGION --format='value(status.url)')

echo "Agent URL: $AGENT_URL"

# Add to set_env.sh

echo "export LEVEL1_AGENT_URL=\"$AGENT_URL\"" >> $HOME/way-back-home/set_env.sh

স্থাপন যাচাই করুন

👉💻 আপনার ব্রাউজারে URL-টি খুলে ডেপ্লয় করা এজেন্টটি পরীক্ষা করুন ( --with_ui ফ্ল্যাগটি ADK ওয়েব ইন্টারফেস ডেপ্লয় করেছে), অথবা curl-এর মাধ্যমে পরীক্ষা করুন:

curl -X GET "$AGENT_URL/list-apps"

আপনি একটি উত্তর দেখতে পাবেন যেখানে আপনার এজেন্টের নাম উল্লেখ থাকবে।

১০. উপসংহার

🎉 প্রথম স্তর সম্পন্ন!

আপনার উদ্ধার সংকেত এখন পূর্ণ শক্তিতে সম্প্রচারিত হচ্ছে। ত্রিভুজাকৃতির সংকেতটি বায়ুমণ্ডলীয় প্রতিবন্ধকতা ভেদ করে একটি অবিচলিত স্পন্দন তৈরি করছে, যা বলছে , "আমি এখানে আছি। আমি বেঁচে গেছি। এসে আমাকে খুঁজে বের করো।"

কিন্তু এই গ্রহে আপনি একা নন। আপনার বীকনটি সক্রিয় হওয়ার সাথে সাথে আপনি দিগন্তের ওপারে অন্যান্য আলো জ্বলে উঠতে দেখেন—অন্যান্য জীবিতরা, অন্যান্য বিধ্বস্ত স্থান, এবং বেঁচে ফেরা অন্যান্য অভিযাত্রীরা।

![]()

লেভেল ২- এ, আপনি আগত এসওএস সংকেতগুলো বুঝতে এবং অন্যান্য জীবিতদের সাথে সমন্বয় করতে শিখবেন। উদ্ধারকার্যটি কেবল খুঁজে পাওয়া যাওয়ার বিষয় নয়—এটি একে অপরকে খুঁজে পাওয়ার বিষয়।

সমস্যা সমাধান

"MCP_SERVER_URL সেট করা হয়নি"

export MCP_SERVER_URL=$(gcloud run services describe location-analyzer \

--region=$REGION --format='value(status.url)')

অংশগ্রহণকারীর আইডি সেট করা হয়নি

source $HOME/way-back-home/set_env.sh

echo $PARTICIPANT_ID

BigQuery টেবিল খুঁজে পাওয়া যায়নি

uv run python setup/setup_star_catalog.py

"বিশেষজ্ঞরা ইউআরএল চাইছেন" এর মানে হলো {key} টেমপ্লেটিং কাজ করছে না। যাচাই করুন:

- রুট এজেন্টে কি

before_agent_callbackসেট করা আছে? - কলব্যাকটি কি স্টেট ভ্যালুগুলো সঠিকভাবে সেট করছে?

- উপ-এজেন্টরা কি

{soil_url}ব্যবহার করছে (f-string নয়)?

"তিনটি বিশ্লেষণই ভিন্নমত পোষণ করে" প্রমাণ পুনরুৎপাদন করুন: uv run python generate_evidence.py

এডিকে ওয়েবে এজেন্ট সাড়া দিচ্ছে না।

- পোর্ট ৮০০০ সঠিক কিনা তা যাচাই করুন।

- MCP_SERVER_URL এবং PARTICIPANT_ID সেট করা আছে কিনা যাচাই করুন।

- ত্রুটির বার্তার জন্য টার্মিনাল পরীক্ষা করুন।

স্থাপত্য সারসংক্ষেপ

উপাদান | প্রকার | প্যাটার্ন | উদ্দেশ্য |

সেটআপ_অংশগ্রহণকারী_প্রসঙ্গ | কলব্যাক | এজেন্ট কলব্যাকের আগে | কনফিগারেশন আনুন, অবস্থা নির্ধারণ করুন |

ভূতাত্ত্বিক বিশ্লেষক | এজেন্ট | {soil_url} টেমপ্লেটিং | মাটির শ্রেণিবিন্যাস |

উদ্ভিদ বিশ্লেষক | এজেন্ট | {ফ্লোরা_ইউআরএল} টেমপ্লেটিং | উদ্ভিদ শ্রেণিবিন্যাস |

জ্যোতির্বিজ্ঞান বিশ্লেষক | এজেন্ট | {stars_url}, {project_id} | তারকা ত্রিভুজায়ন |

অবস্থান নিশ্চিত করুন | সরঞ্জাম | টুলকনটেক্সট স্টেট অ্যাক্সেস | বীকন সক্রিয় করুন |

এভিডেন্সঅ্যানালাইসিসক্রু | প্যারালালএজেন্ট | উপ-এজেন্ট গঠন | বিশেষজ্ঞদের একযোগে চালান |

মিশনঅ্যানালাইসিসএআই | এজেন্ট (মূল) | অর্কেস্ট্রেটর + কলব্যাক | সমন্বয় + সংশ্লেষণ |

অবস্থান-বিশ্লেষক | ফাস্টএমসিপি সার্ভার | কাস্টম এমসিপি | ভূতাত্ত্বিক + উদ্ভিদবিদ্যা বিশ্লেষণ |

bigquery.googleapis.com/mcp | ওয়ানএমসিপি | পরিচালিত এমসিপি | BigQuery অ্যাক্সেস |

মূল ধারণাগুলি আয়ত্ত করা হয়েছে

✓ before_agent_callback : এজেন্ট চলার আগে কনফিগারেশন সংগ্রহ করুন

✓ {key} স্টেট টেমপ্লেটিং : এজেন্ট নির্দেশাবলীতে স্টেট ভ্যালু অ্যাক্সেস করুন

✓ টুলকনটেক্সট : টুল ফাংশনগুলিতে স্টেট ভ্যালু অ্যাক্সেস করুন

✓ স্টেট শেয়ারিং : প্যারেন্ট স্টেট InvocationContext-এর মাধ্যমে সাব-এজেন্টদের কাছে স্বয়ংক্রিয়ভাবে উপলব্ধ হয়।

✓ মাল্টি-এজেন্ট আর্কিটেকচার : একক দায়িত্ব সহ বিশেষায়িত এজেন্ট

✓ ParallelAgent : স্বাধীন কাজগুলোর যুগপৎ সম্পাদন

✓ কাস্টম এমসিপি সার্ভার : ক্লাউড রান-এ আপনার নিজস্ব এমসিপি সার্ভার

✓ OneMCP BigQuery : ডাটাবেস অ্যাক্সেসের জন্য পরিচালিত MCP প্যাটার্ন

✓ ক্লাউড ডেপ্লয়মেন্ট : এনভায়রনমেন্ট ভেরিয়েবল ব্যবহার করে স্টেটলেস ডেপ্লয়মেন্ট

✓ A2A প্রস্তুতি : এজেন্ট আন্তঃ-এজেন্ট যোগাযোগের জন্য প্রস্তুত

যারা গেমার নন তাদের জন্য: বাস্তব জগতের প্রয়োগ

"আপনার অবস্থান নির্ভুলভাবে নির্ণয় করা" বলতে বোঝায় কনসেনসাস সহ প্যারালাল এক্সপার্ট অ্যানালাইসিস — যা একই সাথে একাধিক বিশেষায়িত এআই বিশ্লেষণ চালায় এবং ফলাফলগুলোকে সংশ্লেষণ করে।

এন্টারপ্রাইজ অ্যাপ্লিকেশন

ব্যবহারের ক্ষেত্র | সমান্তরাল বিশেষজ্ঞরা | সংশ্লেষণ নিয়ম |

চিকিৎসাগত রোগ নির্ণয় | ইমেজ বিশ্লেষক, লক্ষণ বিশ্লেষক, ল্যাব বিশ্লেষক | ২-এর-৩ আত্মবিশ্বাসের সীমা |

জালিয়াতি সনাক্তকরণ | লেনদেন বিশ্লেষক, আচরণ বিশ্লেষক, নেটওয়ার্ক বিশ্লেষক | যেকোনো ১টি ফ্ল্যাগ = পর্যালোচনা |

নথি প্রক্রিয়াকরণ | ওসিআর এজেন্ট, শ্রেণিবিন্যাস এজেন্ট, নিষ্কাশন এজেন্ট | সকলকে অবশ্যই একমত হতে হবে |

গুণমান নিয়ন্ত্রণ | চাক্ষুষ পরিদর্শক, সেন্সর বিশ্লেষক, স্পেক পরীক্ষক | ৩টির মধ্যে ২টি পাস |

মূল স্থাপত্য অন্তর্দৃষ্টি

- কনফিগারেশনের জন্য before_agent_callback : শুরুতে একবার কনফিগারেশন সংগ্রহ করে সমস্ত সাব-এজেন্টের জন্য স্টেট পূরণ করে। সাব-এজেন্টগুলিতে কোনো কনফিগারেশন ফাইল পড়া হয় না।

- স্টেট টেম্প্লেটিং : ঘোষণামূলক, পরিচ্ছন্ন, প্রচলিত রীতিসম্মত। কোনো এফ-স্ট্রিং, ইম্পোর্ট বা সিস্টেম পাথ পরিবর্তন করা হয় না।

- ঐকমত্য প্রক্রিয়া : তিনজনের মধ্যে দুজনের সম্মতি পদ্ধতিটি সর্বসম্মত সম্মতির প্রয়োজন ছাড়াই অস্পষ্টতাকে দৃঢ়ভাবে মোকাবেলা করে।

- স্বাধীন কাজগুলোর জন্য প্যারালালএজেন্ট : যখন বিশ্লেষণগুলো একে অপরের উপর নির্ভরশীল নয়, তখন গতি বাড়ানোর জন্য সেগুলোকে একযোগে চালান।

- দুটি এমসিপি প্যাটার্ন : কাস্টম (নিজের মতো করে তৈরি) বনাম ওয়ানএমসিপি (গুগল-হোস্টেড)। উভয়ই স্ট্রিমেবলএইচটিটিপি (StreamableHTTP) ব্যবহার করে।

- স্টেটলেস ডেপ্লয়মেন্ট : একই কোড লোকালি এবং ডেপ্লয়েড উভয় ক্ষেত্রেই কাজ করে। এনভায়রনমেন্ট ভেরিয়েবল + ব্যাকএন্ড এপিআই = কন্টেইনারে কোনো কনফিগারেশন ফাইল নেই।

এরপর কী?

স্তর ২: এসওএস সংকেত প্রক্রিয়াকরণ →

ইভেন্ট-চালিত প্যাটার্ন এবং আরও উন্নত এজেন্ট সমন্বয় ব্যবহার করে অন্যান্য জীবিতদের কাছ থেকে আসা বিপদের সংকেত শনাক্ত করতে শিখুন।