১. মিশন

আপনি মহাকাশের নীরব, অনাবিষ্কৃত বিস্তারে ভেসে বেড়াচ্ছেন। একটি বিশাল সৌর স্পন্দন আপনার মহাকাশযানটিকে একটি মাত্রিক ফাটলের মধ্য দিয়ে ছিঁড়ে ফেলেছে, ফলে আপনি মহাবিশ্বের এমন এক অংশে আটকা পড়েছেন যা কোনো নক্ষত্র মানচিত্রে নেই।

কয়েক দিনের ক্লান্তিকর মেরামতের পর অবশেষে ইঞ্জিনগুলোর চেনা গুঞ্জন ফিরে এসেছে। আপনার রকেটশিপটি এখন সচল। আপনি এমনকি মাদারশিপের সাথে একটি দূরপাল্লার সংযোগও স্থাপন করতে পেরেছেন। যাত্রা আসন্ন। আপনি বাড়ি ফেরার জন্য প্রস্তুত।

কিন্তু আপনি যখন জাম্প ড্রাইভ চালু করার প্রস্তুতি নিচ্ছেন, ঠিক তখনই স্ট্যাটিকের মধ্যে দিয়ে একটি বিপদ সংকেত ভেসে আসে। আপনার সেন্সরগুলো 'ওজিম্যান্ডিয়াস' নামের একটি গ্রহ থেকে আসা সাহায্যের আবেদন শনাক্ত করে। এই মৃতপ্রায় গ্রহে বেঁচে থাকা মানুষেরা আটকা পড়েছে, তাদের মহাকাশযানটি মাটিতে আটকে গেছে। আপনার অভিযানটি অত্যন্ত গুরুত্বপূর্ণ: গ্রহটির বায়ুমণ্ডল ধসে পড়ার আগেই তাদের উদ্ধার করতে হবে।

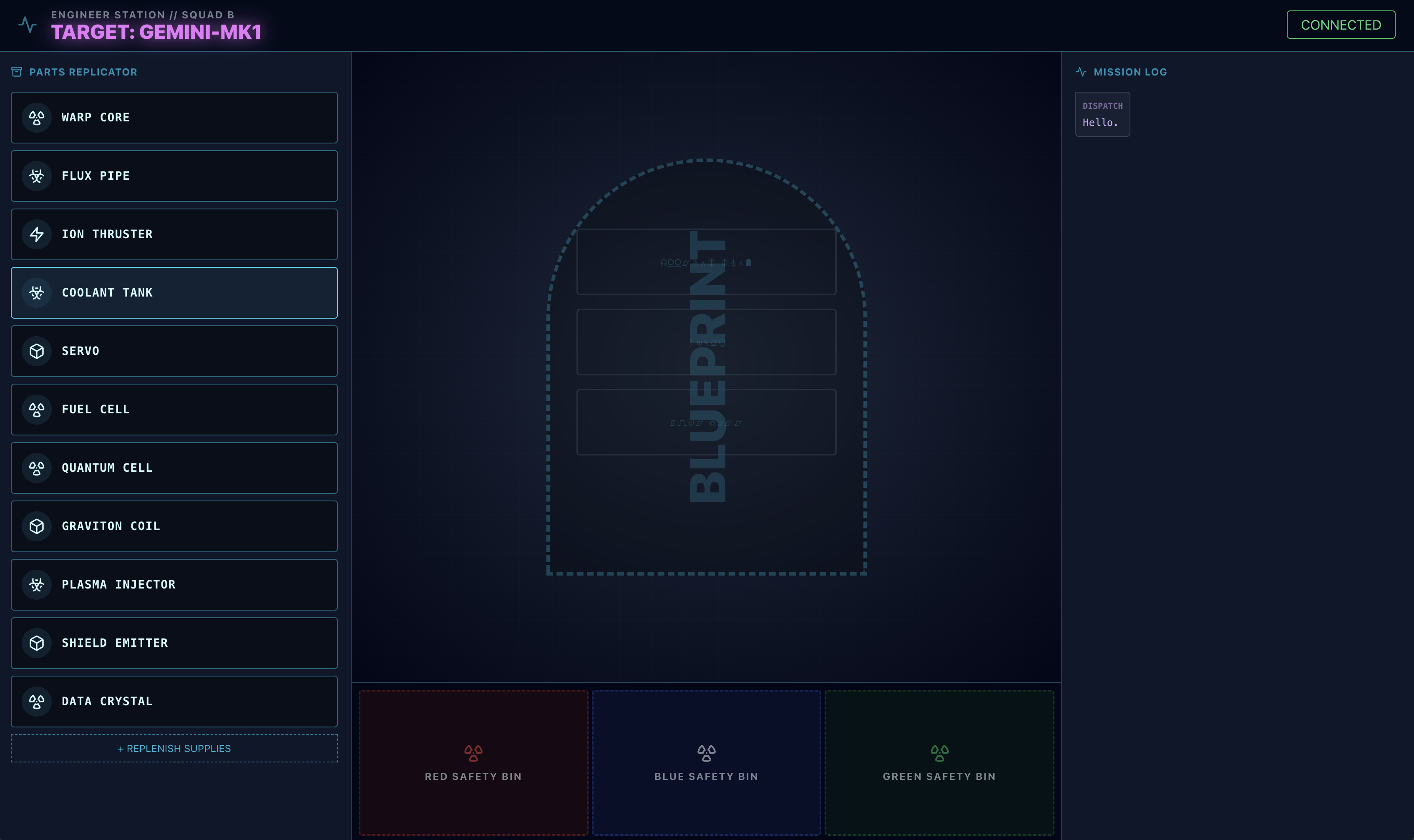

তাদের পালানোর একমাত্র উপায় হলো ভিনগ্রহের প্রযুক্তিতে তৈরি একটি প্রাচীন, পরিত্যক্ত রকেট। এটি সচল থাকলেও, এর ওয়ার্প ড্রাইভটি ভেঙে গেছে। বেঁচে থাকাদের বাঁচাতে হলে, আপনাকে দূর থেকে তাদের ভোলাটাইল ওয়ার্কবেঞ্চে সংযোগ স্থাপন করে নিজ হাতে একটি প্রতিস্থাপন ড্রাইভ তৈরি করতে হবে।

চ্যালেঞ্জ

এই ভিনগ্রহী প্রযুক্তি সম্পর্কে আপনার কোনো অভিজ্ঞতা নেই, যা অত্যন্ত ভঙ্গুর হিসেবে পরিচিত। এর একটি অংশ অস্থিতিশীল হয়ে কয়েক সেকেন্ডের মধ্যেই তেজস্ক্রিয় বিপদে পরিণত হতে পারে। ভোলাটাইল ওয়ার্কবেঞ্চটি চালানোর জন্য আপনি একবারই সুযোগ পাবেন। আপনার বর্তমান এআই সহকারীটি একই সাথে ভিজ্যুয়াল ডেটা এবং টেকনিক্যাল ম্যানুয়াল বুঝতে হিমশিম খাচ্ছে, যার ফলে বিভ্রান্তিকর নির্দেশনা আসছে এবং বিপদের সতর্কবার্তাগুলো উপেক্ষা করা হচ্ছে।

সফল হতে হলে, আপনাকে আপনার এআই-কে একটি একক সত্তা থেকে একটি সহযোগিতামূলক বহু-এজেন্ট সিস্টেমে উন্নীত করতে হবে।

আপনার মিশনের উদ্দেশ্যসমূহ:

আপনার নতুন মাল্টি-এজেন্ট সিস্টেম থেকে প্রাপ্ত বিশেষায়িত ও রিয়েল-টাইম নির্দেশাবলী অনুসরণ করে ওয়ার্প ড্রাইভটি একত্রিত করুন।

আপনি যা তৈরি করবেন

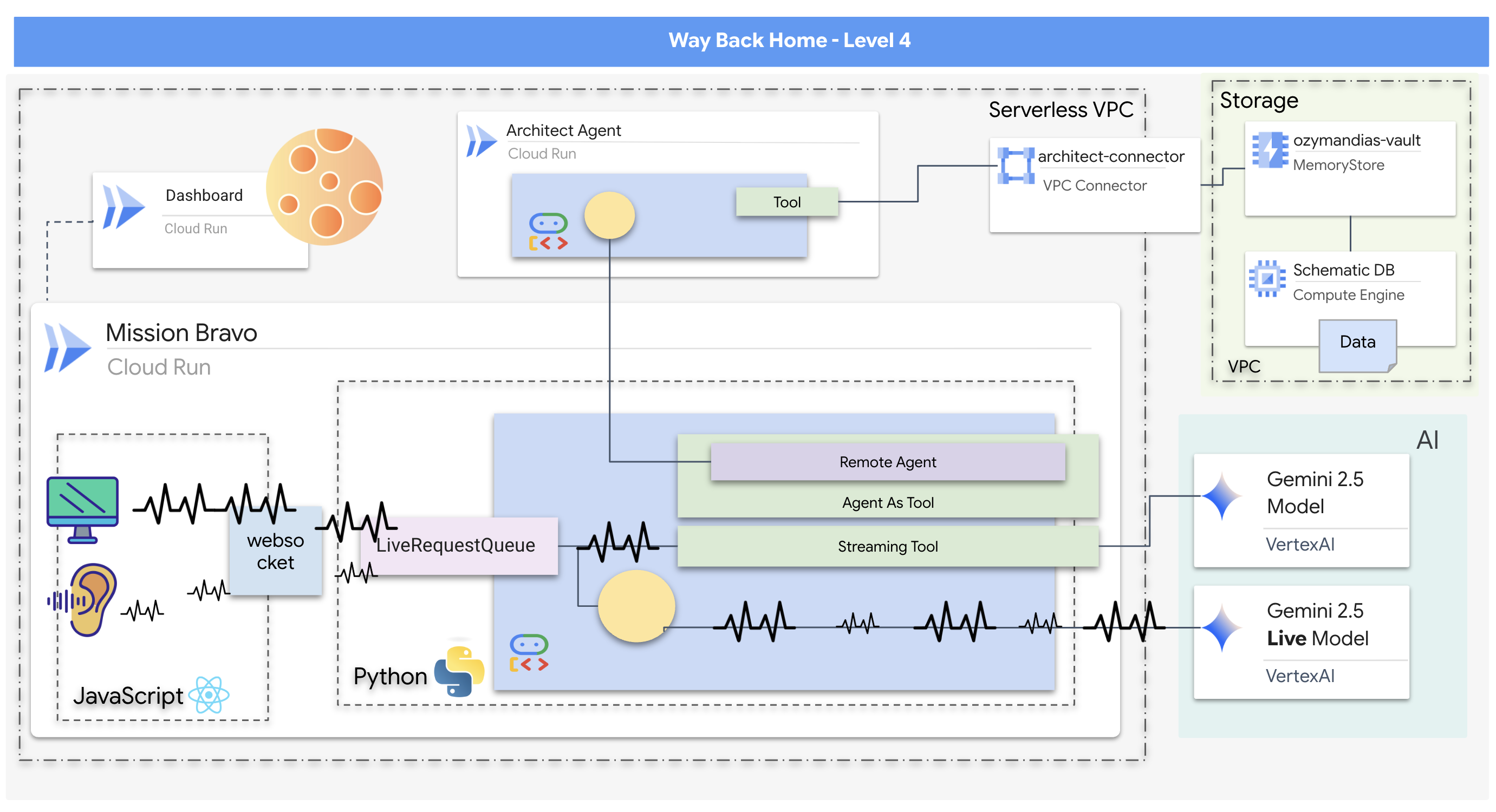

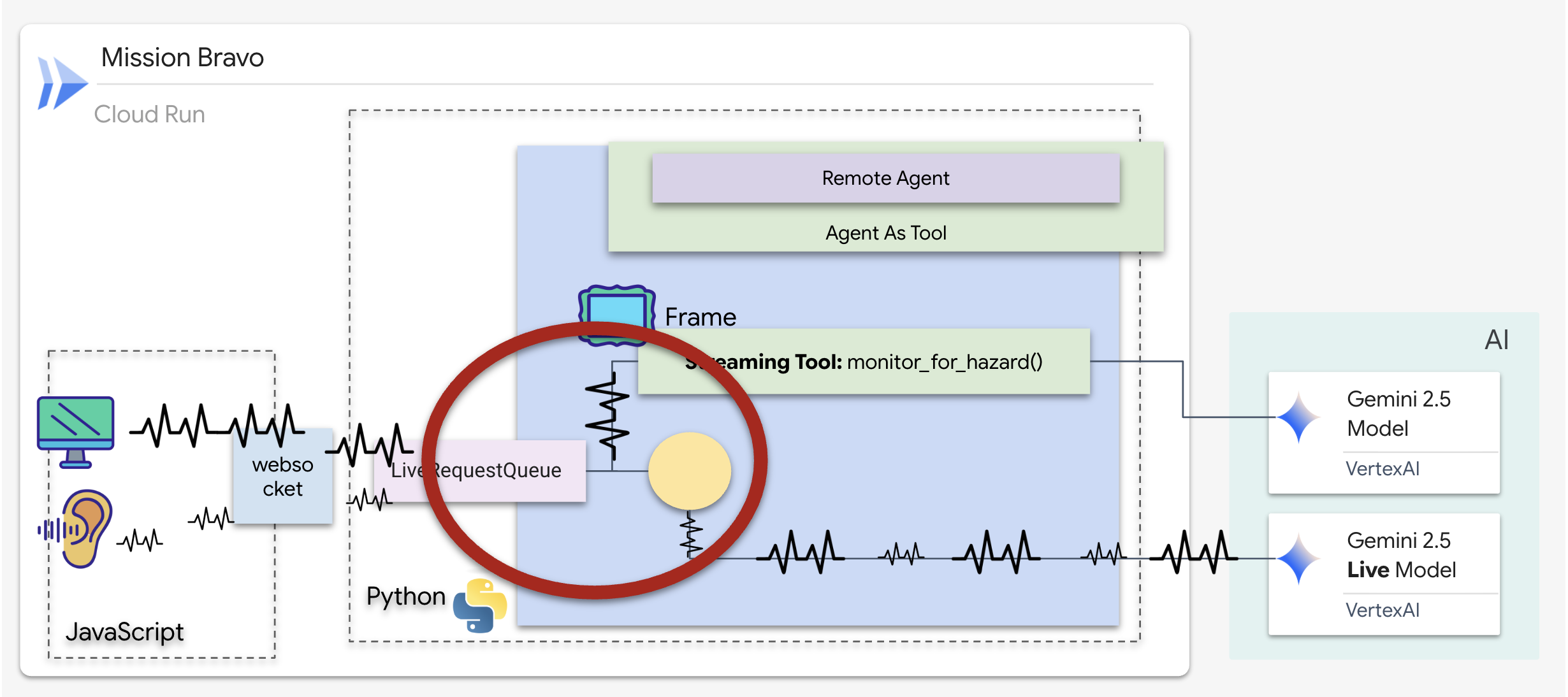

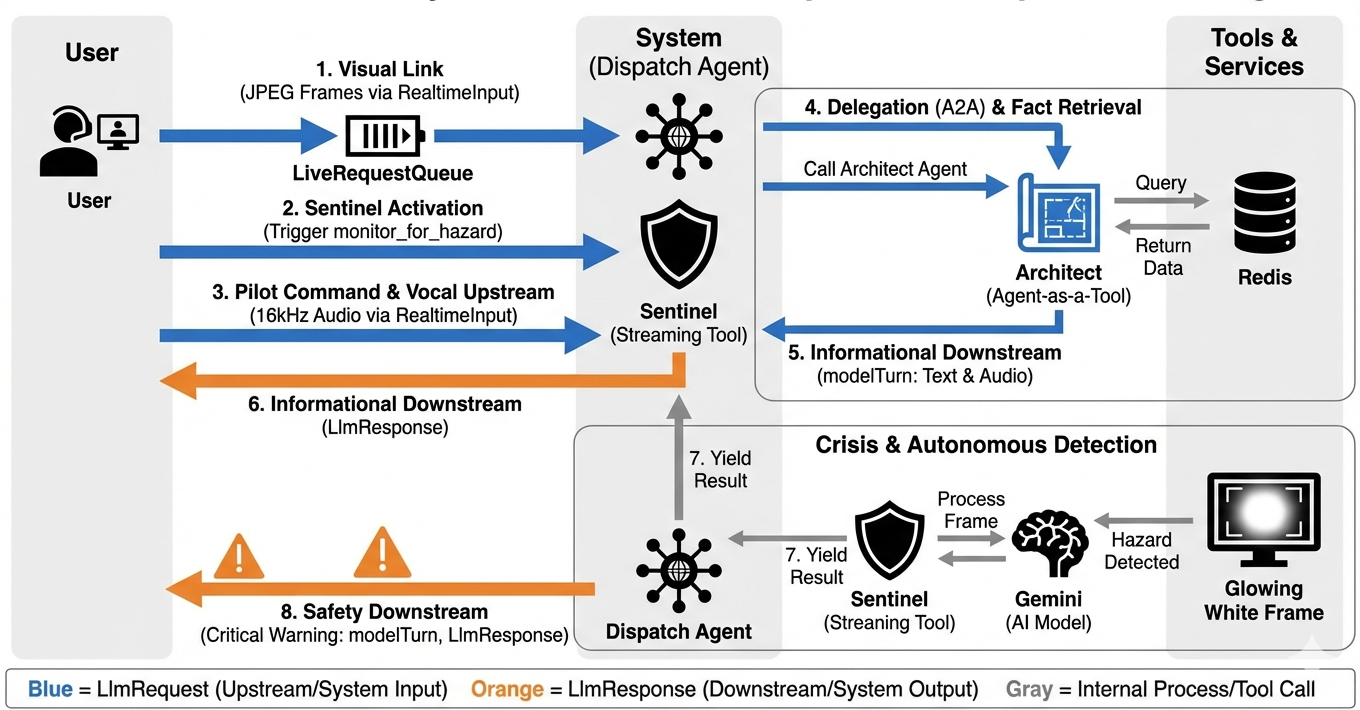

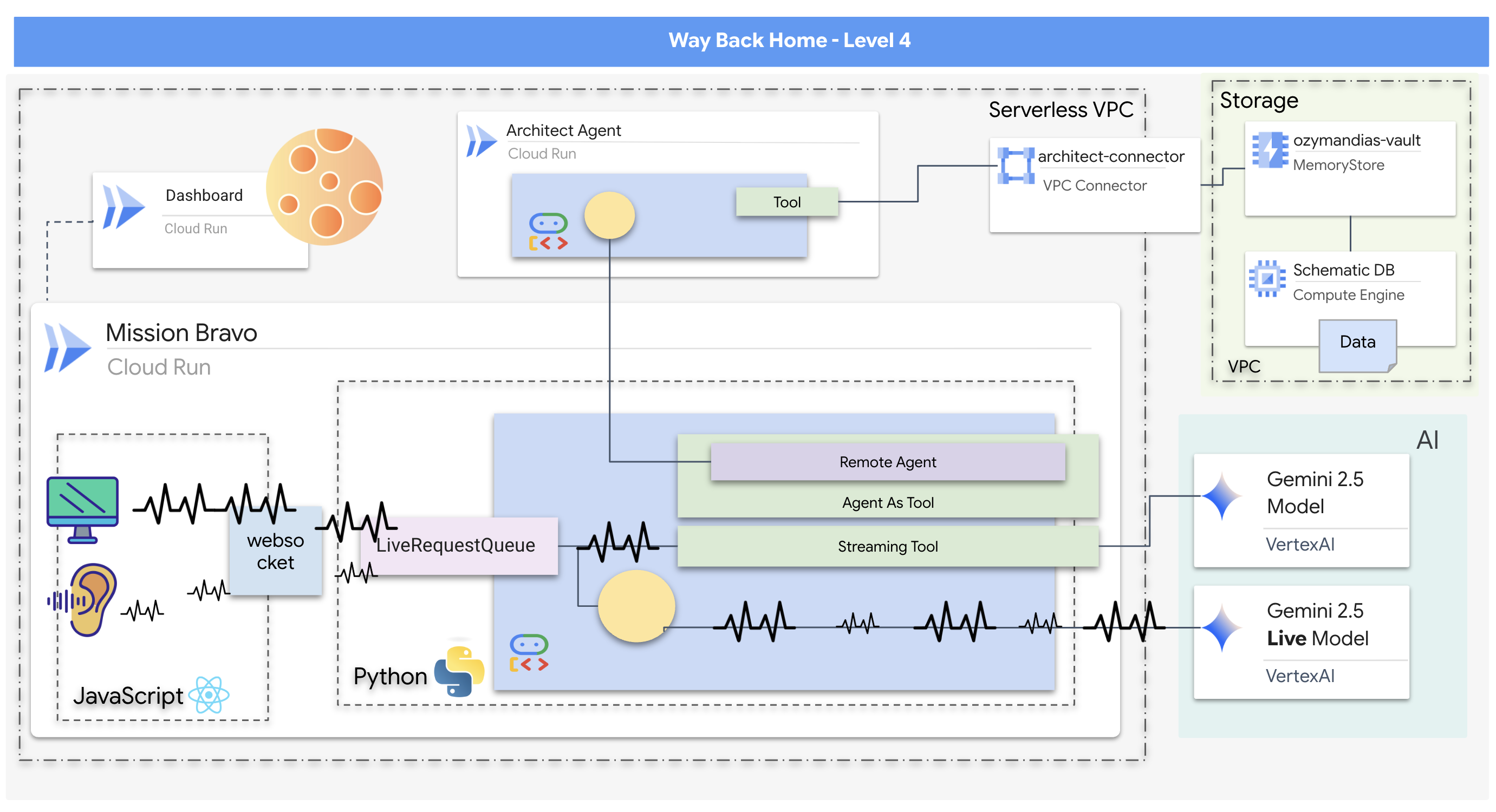

- একটি রিয়েল-টাইম, দ্বিমুখী মাল্টি-এজেন্ট এআই সিস্টেম, যেখানে একটি কেন্দ্রীয় ডিসপ্যাচ এজেন্ট ব্যবহারকারীর মিথস্ক্রিয়া পরিচালনা করে এবং বিশেষায়িত এজেন্টদের সাথে সমন্বয় সাধন করে।

- একটি আর্কিটেক্ট এজেন্ট যা স্কিমেটিক ডেটা পুনরুদ্ধার ও পরিবেশন করার জন্য একটি রেডিস ডেটাবেসের সাথে সংযোগ স্থাপন করে।

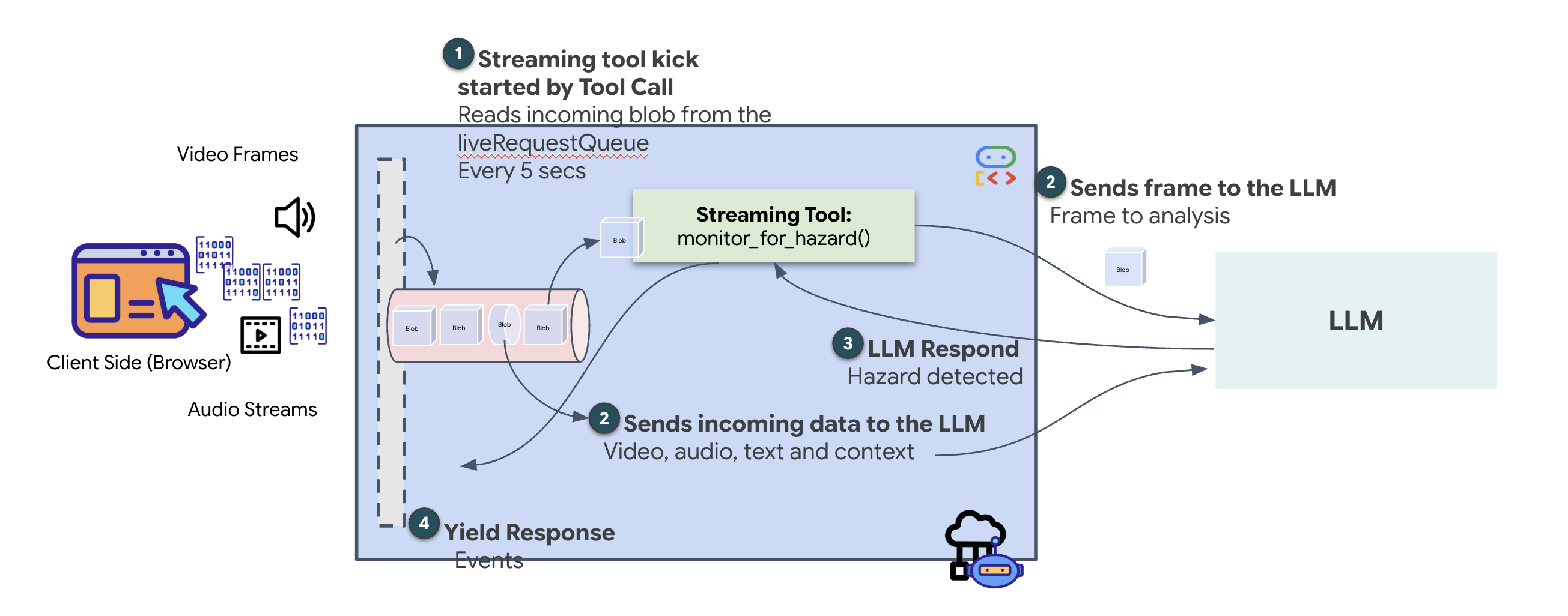

- একটি সক্রিয় নিরাপত্তা মনিটর যা স্ট্রিমিং টুল ব্যবহার করে লাইভ ভিডিও ফিড থেকে দৃশ্যমান বিপদ বিশ্লেষণ করে এবং রিয়েল-টাইম অ্যালার্ট জারি করে।

- একটি রিয়্যাক্ট-ভিত্তিক ফ্রন্টএন্ড যা সিস্টেমের সাথে যোগাযোগের জন্য ইউজার ইন্টারফেস প্রদান করে এবং ব্যাকএন্ড এজেন্টগুলিতে ভিডিও ও অডিও স্ট্রিম করে।

আপনি যা শিখবেন

প্রযুক্তি / ধারণা | বর্ণনা |

গুগল এজেন্ট ডেভেলপমেন্ট কিট (ADK) | আপনি ADK ব্যবহার করে এজেন্টগুলো তৈরি, পরীক্ষা এবং পরিচালনা করবেন, যার জন্য আপনি রিয়েল-টাইম যোগাযোগ, টুল ইন্টিগ্রেশন এবং এজেন্ট লাইফসাইকেল পরিচালনার ফ্রেমওয়ার্কটি কাজে লাগাবেন। |

দ্বিমুখী (বিডি) স্ট্রিমিং | আপনি একটি বিডি-স্ট্রিমিং এজেন্ট বাস্তবায়ন করবেন যা স্বাভাবিক, স্বল্প-বিলম্বের দ্বিমুখী যোগাযোগের সুযোগ দেবে এবং মানুষ ও এআই উভয়কেই রিয়েল-টাইমে কথোপকথনে বাধা দিতে ও প্রতিক্রিয়া জানাতে সক্ষম করবে। |

মাল্টি-এজেন্ট সিস্টেম | আপনি শিখবেন কীভাবে একটি ডিস্ট্রিবিউটেড এআই সিস্টেম ডিজাইন করতে হয়, যেখানে একজন প্রাইমারি এজেন্ট বিশেষায়িত এজেন্টদের কাছে কাজ অর্পণ করে, যা কাজের বিভাজন এবং আরও স্কেলেবল আর্কিটেকচারকে সম্ভব করে তোলে। |

এজেন্ট-টু-এজেন্ট (A2A) প্রোটোকল | আপনি ডিসপ্যাচ এজেন্ট এবং আর্কিটেক্ট এজেন্টের মধ্যে যোগাযোগ সক্ষম করতে A2A প্রোটোকল ব্যবহার করবেন, যার মাধ্যমে তারা একে অপরের সক্ষমতা সম্পর্কে জানতে এবং ডেটা আদান-প্রদান করতে পারবে। |

স্ট্রিমিং টুলস | আপনি এমন একটি স্ট্রিমিং টুল বাস্তবায়ন করবেন যা একটি ব্যাকগ্রাউন্ড প্রসেস হিসেবে কাজ করবে, এবং ভিডিও ফিডের অবস্থার পরিবর্তন (বিপদ) নিরীক্ষণের জন্য ক্রমাগত তা বিশ্লেষণ করে সক্রিয়ভাবে ফলাফল প্রদান করবে। |

গুগল ক্লাউড রান এবং মেমোরিস্টোর | আপনি এজেন্ট সার্ভিসগুলো হোস্ট করার জন্য ক্লাউড রান এবং স্থায়ী ডেটাবেস হিসেবে মেমোরিস্টোর (রেডিস) ব্যবহার করে সম্পূর্ণ মাল্টি-এজেন্ট অ্যাপ্লিকেশনটি একটি প্রোডাকশন এনভায়রনমেন্টে ডেপ্লয় করবেন। |

ফাস্টএপিআই এবং ওয়েবসকেটস | অডিও, ভিডিও এবং এজেন্ট রেসপন্স স্ট্রিমিংয়ের জন্য প্রয়োজনীয় উচ্চ-পারফরম্যান্স ও রিয়েল-টাইম কমিউনিকেশন পরিচালনার উদ্দেশ্যে ব্যাকএন্ডটি FastAPI এবং WebSockets ব্যবহার করে তৈরি করা হয়েছে। |

রিঅ্যাক্ট ফ্রন্টএন্ড | আপনি একটি রিয়্যাক্ট-ভিত্তিক ফ্রন্টএন্ড নিয়ে কাজ করবেন, যা ব্যবহারকারীর মিডিয়া (অডিও/ভিডিও) ক্যাপচার ও স্ট্রিম করে এবং এআই এজেন্টদের কাছ থেকে পাওয়া রিয়েল-টাইম প্রতিক্রিয়া প্রদর্শন করে। |

২. আপনার পরিবেশ প্রস্তুত করুন

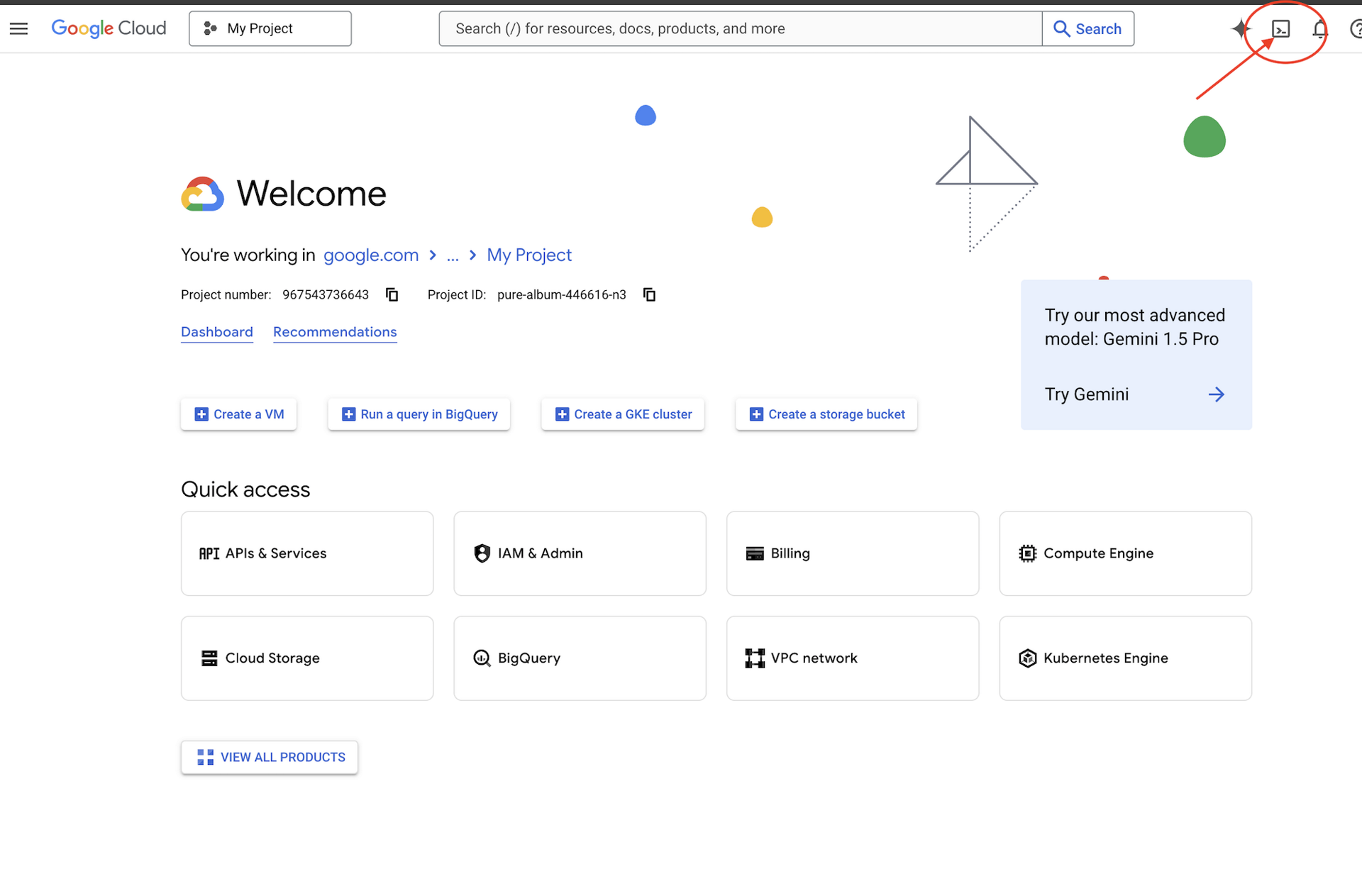

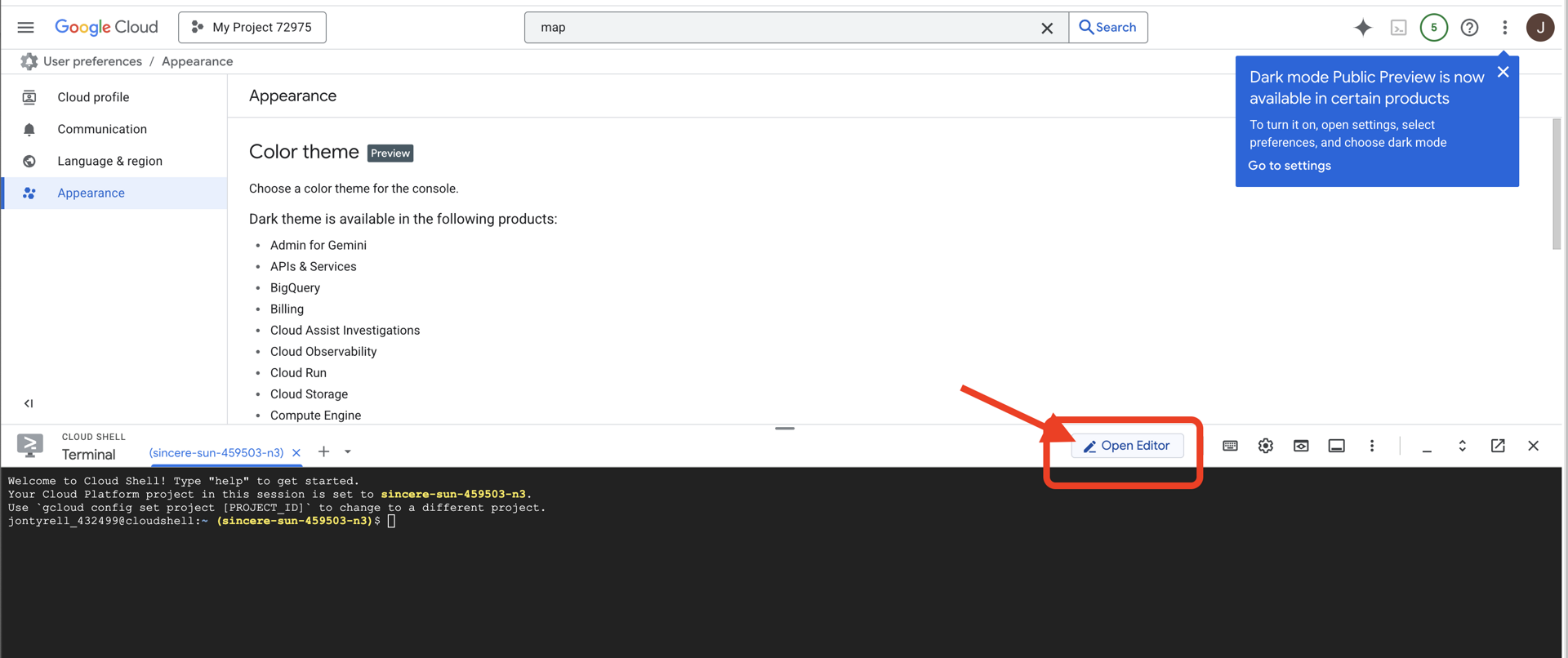

ক্লাউড শেল অ্যাক্সেস করুন

👉Google Cloud কনসোলের উপরে থাকা Activate Cloud Shell-এ ক্লিক করুন (এটি Cloud Shell পেনের উপরে থাকা টার্মিনাল আকৃতির আইকন),

👉'ওপেন এডিটর' বোতামে (এটি দেখতে পেন্সিলসহ একটি খোলা ফোল্ডারের মতো) ক্লিক করুন। এটি উইন্ডোতে ক্লাউড শেল কোড এডিটর খুলে দেবে। আপনি বাম দিকে একটি ফাইল এক্সপ্লোরার দেখতে পাবেন।

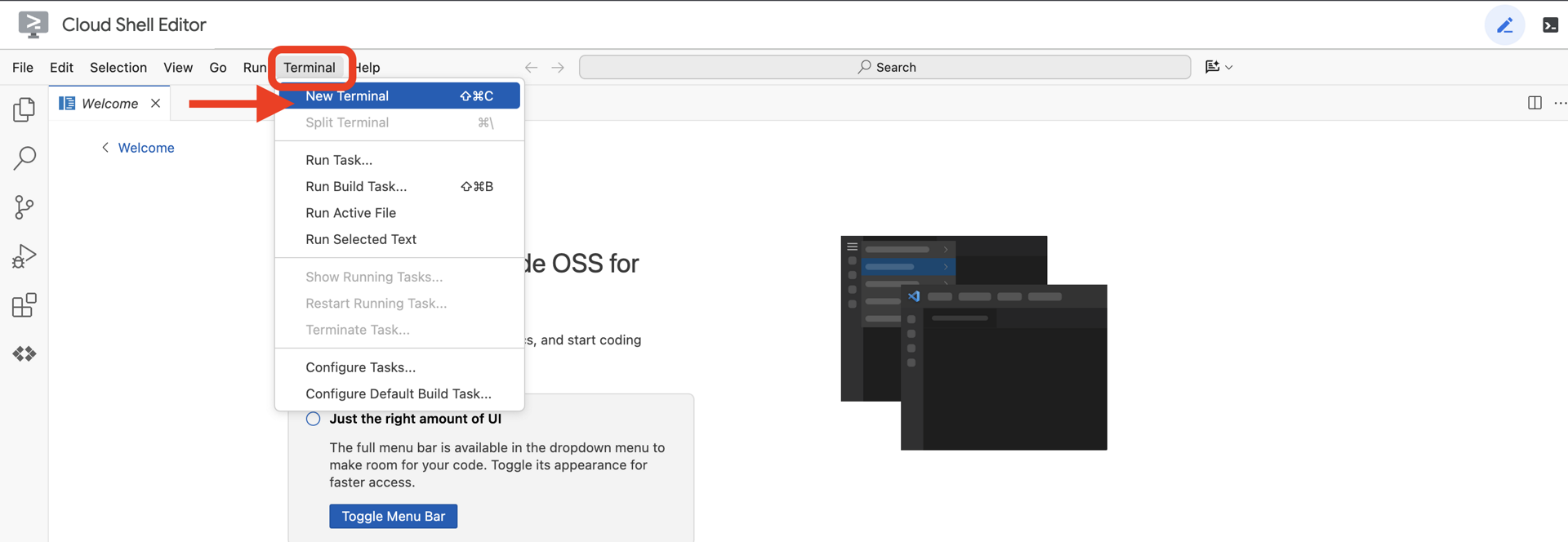

👉ক্লাউড IDE-তে টার্মিনালটি খুলুন,

👉💻 টার্মিনালে, নিম্নলিখিত কমান্ডটি ব্যবহার করে যাচাই করুন যে আপনি ইতিমধ্যেই প্রমাণীকৃত এবং প্রজেক্টটি আপনার প্রজেক্ট আইডিতে সেট করা আছে:

gcloud auth list

আপনার অ্যাকাউন্টটি (ACTIVE) হিসেবে তালিকাভুক্ত দেখতে পাবেন।

পূর্বশর্ত

ℹ️ লেভেল ০ ঐচ্ছিক (তবে সুপারিশকৃত)

আপনি লেভেল ০ ছাড়াও এই মিশনটি সম্পন্ন করতে পারেন, কিন্তু প্রথমে এটি শেষ করলে আরও বেশি বাস্তবসম্মত অভিজ্ঞতা পাওয়া যায়, যার ফলে আপনি অগ্রগতির সাথে সাথে গ্লোবাল ম্যাপে আপনার বীকনটি জ্বলতে দেখতে পাবেন।

প্রকল্পের পরিবেশ সেটআপ করুন

আপনার টার্মিনালে ফিরে এসে, সক্রিয় প্রজেক্ট সেট করে এবং প্রয়োজনীয় গুগল ক্লাউড পরিষেবাগুলি (ক্লাউড রান, ভার্টেক্স এআই, ইত্যাদি) সক্রিয় করে কনফিগারেশনটি চূড়ান্ত করুন।

👉💻 আপনার টার্মিনাতে প্রজেক্ট আইডি সেট করুন:

gcloud config set project $(cat ~/project_id.txt) --quiet

👉💻 প্রয়োজনীয় পরিষেবাগুলি সক্রিয় করুন:

gcloud services enable compute.googleapis.com \

artifactregistry.googleapis.com \

run.googleapis.com \

cloudbuild.googleapis.com \

iam.googleapis.com \

aiplatform.googleapis.com \

cloudresourcemanager.googleapis.com \

redis.googleapis.com \

vpcaccess.googleapis.com

নির্ভরতা ইনস্টল করুন

👉💻 লেভেল ৪-এ যান এবং প্রয়োজনীয় পাইথন প্যাকেজগুলো ইনস্টল করুন:

cd $HOME/way-back-home/level_4

uv sync

মূল নির্ভরশীলতাগুলো হলো:

প্যাকেজ | উদ্দেশ্য |

| স্যাটেলাইট স্টেশন এবং এসএসই স্ট্রিমিংয়ের জন্য উচ্চ-কর্মক্ষমতাসম্পন্ন ওয়েব ফ্রেমওয়ার্ক |

| FastAPI অ্যাপ্লিকেশনটি চালানোর জন্য ASGI সার্ভার প্রয়োজন। |

| ফর্মেশন এজেন্ট তৈরি করতে ব্যবহৃত এজেন্ট ডেভেলপমেন্ট কিট |

| প্রমিত যোগাযোগের জন্য এজেন্ট-টু-এজেন্ট প্রোটোকল লাইব্রেরি |

| জেমিনি মডেল অ্যাক্সেস করার জন্য নেটিভ ক্লায়েন্ট |

| স্কিমেটিক ভল্ট (মেমরিস্টোর)-এ সংযোগ করার জন্য পাইথন ক্লায়েন্ট |

| রিয়েল-টাইম দ্বিমুখী যোগাযোগের জন্য সমর্থন |

| পরিবেশ ভেরিয়েবল এবং কনফিগারেশন গোপনীয়তা পরিচালনা করে |

| ডেটা যাচাইকরণ এবং সেটিংস ব্যবস্থাপনা |

সেটআপ যাচাই করুন

কোড শুরু করার আগে, চলুন নিশ্চিত করে নিই যে সবকিছু ঠিকঠাক আছে। আপনার গুগল ক্লাউড প্রজেক্ট, এপিআই (API), এবং পাইথন ডিপেন্ডেন্সিগুলো নিরীক্ষা করতে ভেরিফিকেশন স্ক্রিপ্টটি চালান।

👉💻 ভেরিফিকেশন স্ক্রিপ্টটি চালান:

cd $HOME/way-back-home/level_4/scripts

chmod +x verify_setup.sh

. verify_setup.sh

👀 আপনি পরপর কয়েকটি সবুজ টিক চিহ্ন (✅) দেখতে পাবেন।

- যদি আপনি লাল ক্রস (❌) চিহ্ন দেখতে পান, তাহলে আউটপুটে দেওয়া সমাধান কমান্ডগুলো অনুসরণ করুন (যেমন,

gcloud services enable ...অথবাpip install ...)। - দ্রষ্টব্য:

.envজন্য একটি হলুদ সতর্কবার্তা আপাতত গ্রহণযোগ্য; আমরা পরবর্তী ধাপে ফাইলটি তৈরি করব।

🚀 Verifying Mission Bravo (Level 4) Infrastructure... ✅ Google Cloud Project: xxxxxxx ✅ Cloud APIs: Active ✅ Python Environment: Ready 🎉 SYSTEMS ONLINE. READY FOR MISSION.

৩. রেডিসে স্কিমেটিক ভল্ট তৈরি করা এবং ADK ব্যবহার করে দ্বি-দিকনির্দেশক এজেন্ট তৈরি করা

আপনি পরিত্যক্ত রকেটটির নকশা ধারণকারী গ্রহীয় নকশা ভান্ডারটি খুঁজে পেয়েছেন। এই তথ্য নির্ভুলভাবে পুনরুদ্ধার করতে, আপনাকে অবশ্যই ভান্ডারটির নির্দিষ্ট ব্যবস্থাপনা ইন্টারফেস—আর্কিটেক্ট এজেন্টের—সাথে সংযোগ স্থাপন করতে হবে।

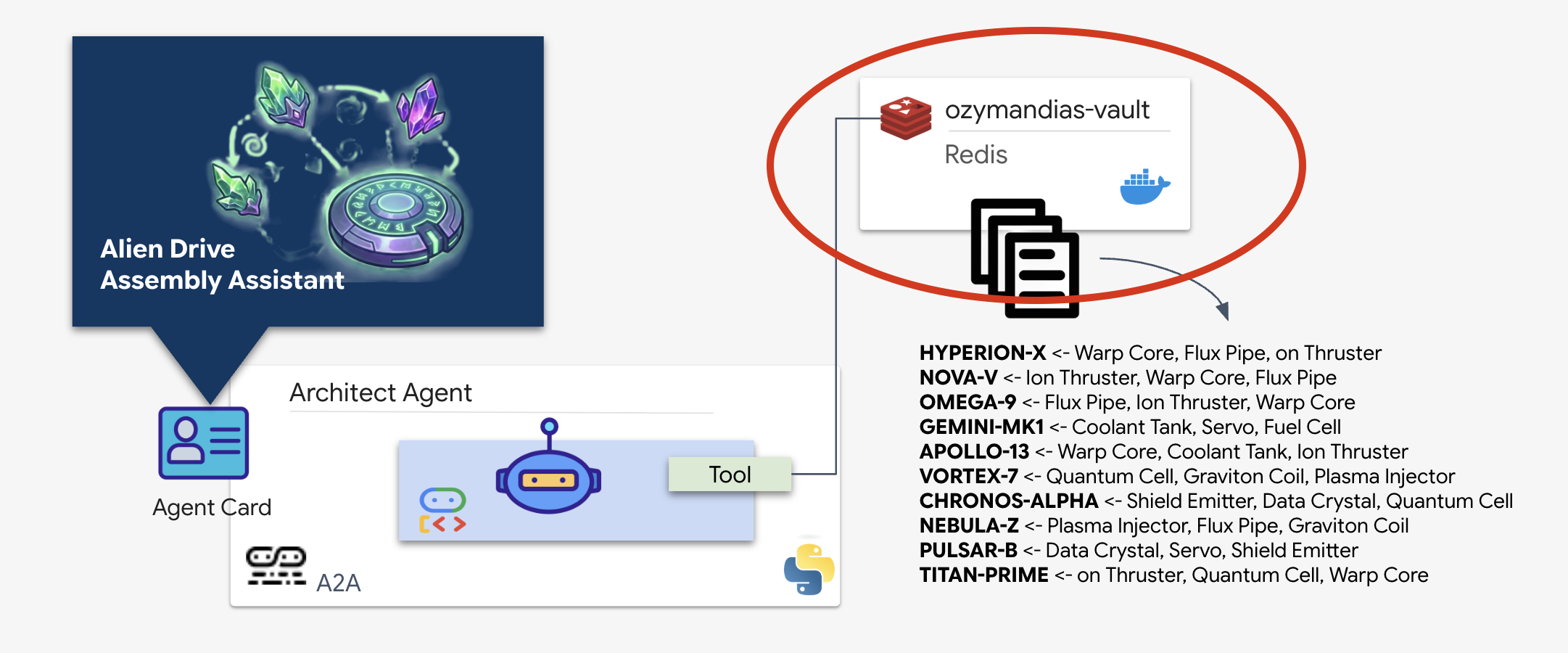

স্কিমেটিক ভল্ট (রেডিস) প্রস্তুত করা

আর্কিটেক্ট আমাদের সাহায্য করার আগে, আমাদের অবশ্যই নিশ্চিত করতে হবে যে ডেটা একটি সুরক্ষিত, উচ্চ-প্রাপ্যতা সম্পন্ন পরিবেশে হোস্ট করা আছে। আমরা আমাদের এলিয়েন স্কিমেটিকসের জন্য একটি দ্রুত ডেটা স্টোর হিসেবে রেডিস (Redis) ব্যবহার করব। ডেভেলপমেন্টের সুবিধার জন্য, আমরা একটি লোকাল রেডিস ইনস্ট্যান্স চালু করব, কিন্তু গুগল ক্লাউড মেমোরিস্টোর (Google Cloud Memorystore) ব্যবহার করে প্রোডাকশন এনভায়রনমেন্টে কীভাবে ডেপ্লয় করতে হবে তার নির্দেশাবলী পরে প্রদান করা হবে।

👉💻 Redis ইনস্ট্যান্সটি প্রোভিশন করতে আপনার টার্মিনালে নিম্নলিখিত কমান্ডগুলি চালান (এতে ২-৩ মিনিট সময় লাগতে পারে):

docker run -d --name ozymandias-vault -p 6379:6379 redis:8.6-rc1-alpine

👉💻 প্রাথমিক ডেটা লোড করতে, Redis Shell-এ প্রবেশ করার জন্য নিম্নলিখিত কমান্ডটি চালান:

docker exec -it ozymandias-vault redis-cli

(আপনার প্রম্পট পরিবর্তিত হয়ে 127.0.0.1:6379 হবে)

👉💻 এই কমান্ডগুলো ভিতরে পেস্ট করুন:

RPUSH "HYPERION-X" "Warp Core" "Flux Pipe" "Ion Thruster"

RPUSH "NOVA-V" "Ion Thruster" "Warp Core" "Flux Pipe"

RPUSH "OMEGA-9" "Flux Pipe" "Ion Thruster" "Warp Core"

RPUSH "GEMINI-MK1" "Coolant Tank" "Servo" "Fuel Cell"

RPUSH "APOLLO-13" "Warp Core" "Coolant Tank" "Ion Thruster"

RPUSH "VORTEX-7" "Quantum Cell" "Graviton Coil" "Plasma Injector"

RPUSH "CHRONOS-ALPHA" "Shield Emitter" "Data Crystal" "Quantum Cell"

RPUSH "NEBULA-Z" "Plasma Injector" "Flux Pipe" "Graviton Coil"

RPUSH "PULSAR-B" "Data Crystal" "Servo" "Shield Emitter"

RPUSH "TITAN-PRIME" "Ion Thruster" "Quantum Cell" "Warp Core"

👉💻 আপনার স্বাভাবিক শেলে ফিরে যেতে exit টাইপ করুন।

👉💻 আপনার টার্মিনাল থেকে সরাসরি কোনো নির্দিষ্ট জাহাজ সম্পর্কে জিজ্ঞাসা করে ডেটা আছে কিনা তা পরীক্ষা করতে, চালান:

# Check 'TITAN-PRIME'

docker exec ozymandias-vault redis-cli LRANGE "TITAN-PRIME" 0 -1

👀 এটিই প্রত্যাশিত আউটপুট:

1) "Ion Thruster" 2) "Quantum Cell" 3) "Warp Core"

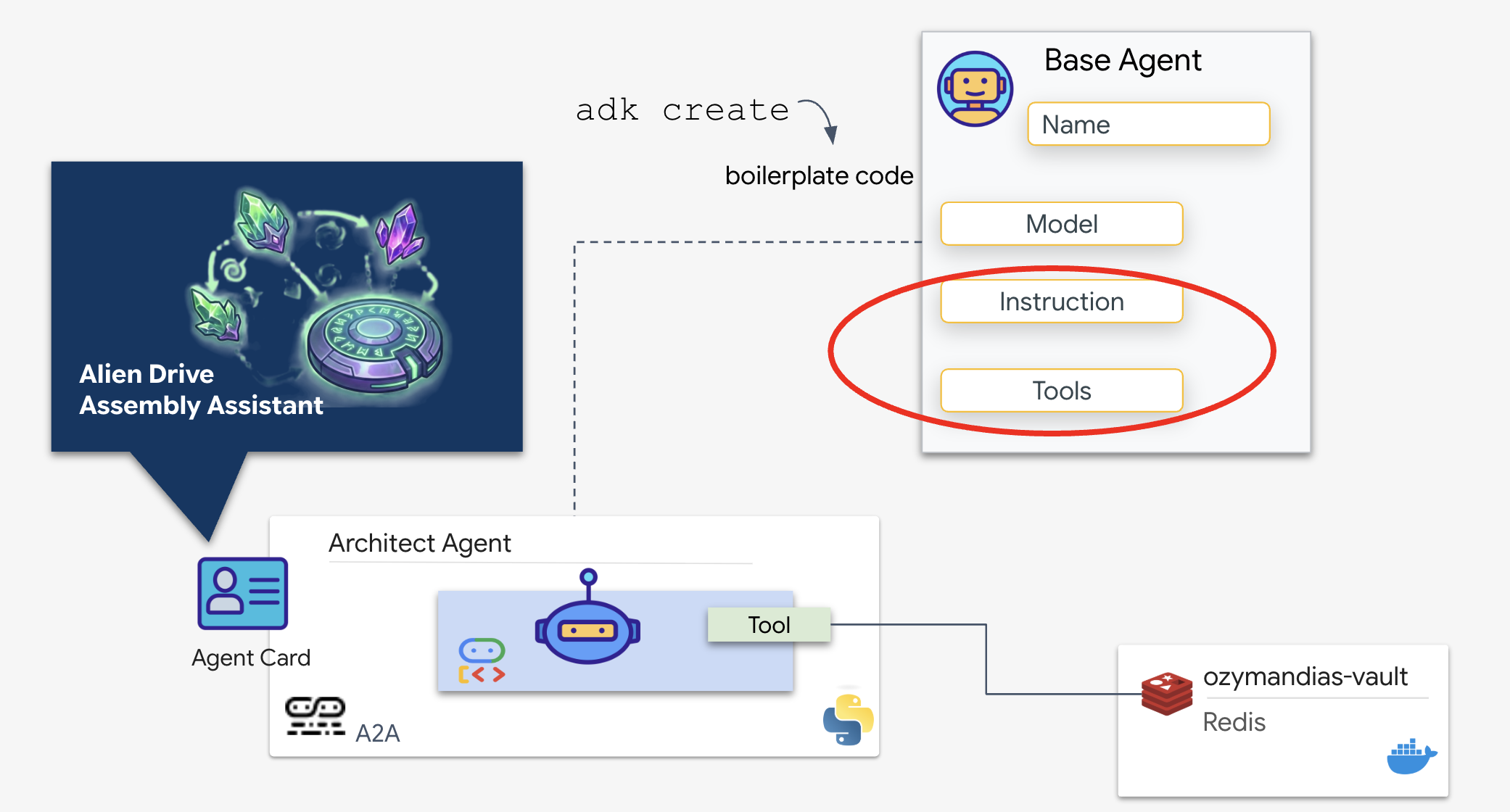

আর্কিটেক্ট এজেন্ট বাস্তবায়ন করা

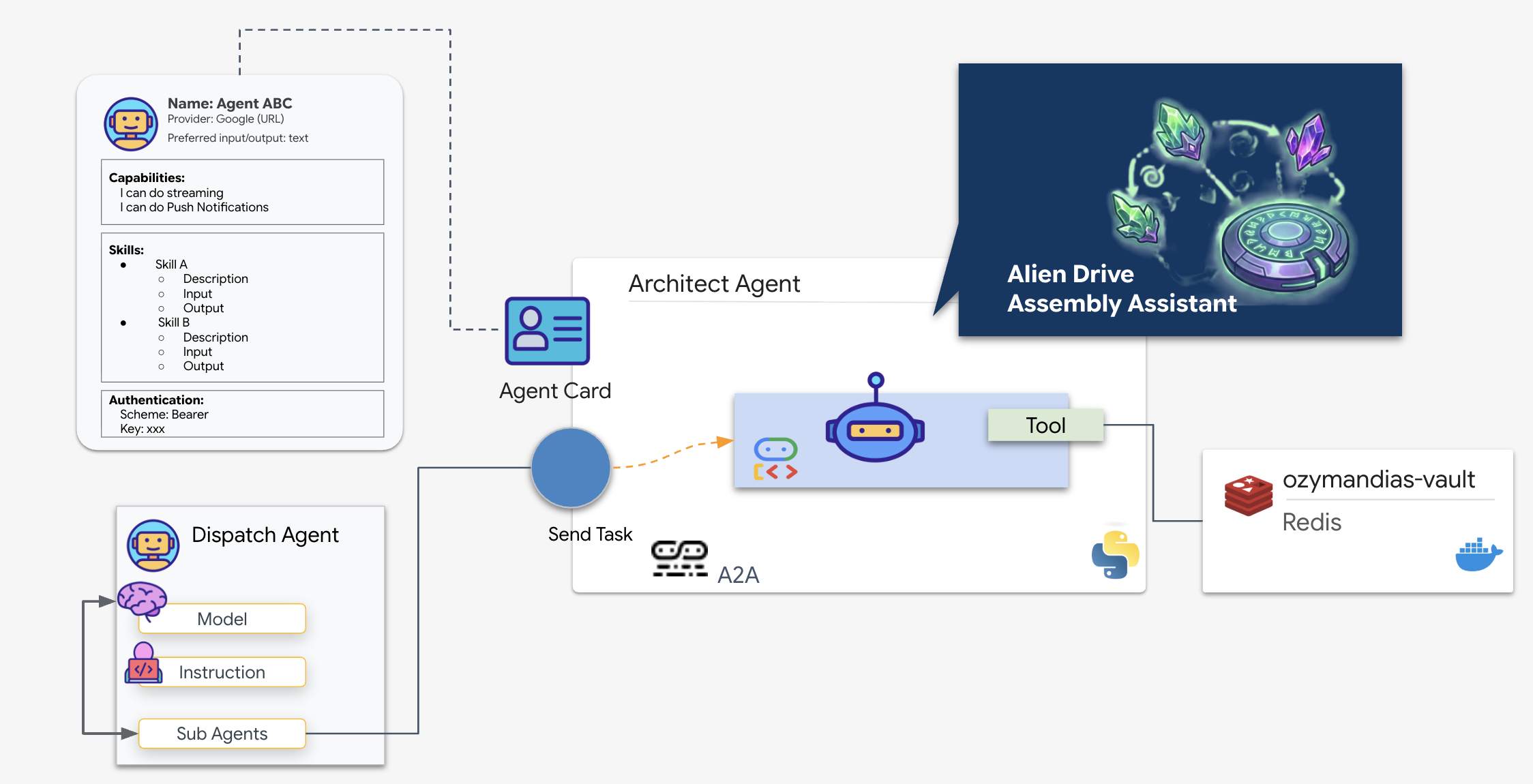

আর্কিটেক্ট এজেন্ট হলো একটি বিশেষায়িত এজেন্ট, যা আমাদের রেডিস ভল্ট থেকে স্কিমেটিক ব্লুপ্রিন্ট পুনরুদ্ধার করার দায়িত্বে থাকে। এটি একটি ডেডিকেটেড ডেটা ইন্টারফেস হিসেবে কাজ করে, যা নিশ্চিত করে যে মূল ডিসপ্যাচ এজেন্ট অন্তর্নিহিত ডেটাবেস লজিক না জেনেই নির্ভুল এবং সুসংগঠিত তথ্য গ্রহণ করতে পারে।

গুগল এজেন্ট ডেভেলপমেন্ট কিট (ADK) হলো সেই মডিউলার ফ্রেমওয়ার্ক যা এই মাল্টি-এজেন্ট সেটআপকে সম্ভব করে তোলে। এটি দুটি গুরুত্বপূর্ণ স্তর পরিচালনা করে:

- সংযোগ ও সেশন জীবনচক্র: রিয়েল-টাইম এপিআই-এর সাথে ইন্টারঅ্যাক্ট করার জন্য জটিল প্রোটোকল ব্যবস্থাপনার প্রয়োজন হয়—যার মধ্যে হ্যান্ডশেক, প্রমাণীকরণ এবং কিপ-অ্যালাইভ সিগন্যাল পরিচালনা অন্তর্ভুক্ত।

- ফাংশন কলিং: এটি হলো "মডেল-কোড-মডেল রাউন্ড ট্রিপ"। যখন LLM-এর ডেটার প্রয়োজন হয়, তখন এটি একটি স্ট্রাকচার্ড ফাংশন কল আউটপুট করে। ADK এটি গ্রহণ করে, আপনার পাইথন কোড (

lookup_schematic_tool) এক্সিকিউট করে এবং কয়েক মিলিসেকেন্ডের মধ্যে ফলাফলটি মডেলের কনটেক্সটে ফিরিয়ে দেয়।

আমরা এখন আর্কিটেক্ট তৈরি করব। এই এজেন্টের ক্যামেরা অ্যাক্সেস নেই। এর একমাত্র কাজ হলো একটি 'ড্রাইভ নেম' গ্রহণ করা এবং ডাটাবেস থেকে 'পার্টস লিস্ট' ফেরত দেওয়া।

👉💻 আমরা `adk create` কমান্ডটি ব্যবহার করব। এটি এজেন্ট ডেভেলপমেন্ট কিট (ADK)-এর একটি টুল, যা একটি নতুন এজেন্টের জন্য স্বয়ংক্রিয়ভাবে বয়লারপ্লেট কোড এবং ফাইল স্ট্রাকচার তৈরি করে, ফলে আমাদের সেটআপের সময় বেঁচে যায়।

cd $HOME/way-back-home/level_4/backend/

uv run adk create architect_agent

এজেন্ট কনফিগার করুন

CLI একটি ইন্টারেক্টিভ সেটআপ উইজার্ড চালু করবে। আপনার এজেন্ট কনফিগার করতে নিম্নলিখিত প্রতিক্রিয়াগুলি ব্যবহার করুন:

- একটি মডেল বেছে নিন : অপশন ১ (জেমিনি ফ্ল্যাশ) নির্বাচন করুন।

- দ্রষ্টব্য: প্রাপ্যতার উপর ভিত্তি করে নির্দিষ্ট সংস্করণ (যেমন, ২.৫, ৩.০) ভিন্ন হতে পারে। দ্রুত গতির জন্য সর্বদা 'ফ্ল্যাশ' সংস্করণটি বেছে নিন।

- একটি ব্যাকএন্ড বেছে নিন : বিকল্প ২ (ভার্টেক্স এআই) নির্বাচন করুন।

- গুগল ক্লাউড প্রজেক্ট আইডি লিখুন : ডিফল্টটি (আপনার পরিবেশ থেকে শনাক্তকৃত) গ্রহণ করতে এন্টার চাপুন।

- গুগল ক্লাউড অঞ্চল প্রবেশ করান : ডিফল্ট (

us-central1) গ্রহণ করতে এন্টার চাপুন।

👀 আপনার টার্মিনাল ইন্টারঅ্যাকশনটি দেখতে এইরকম হওয়া উচিত:

(way-back-home) user@cloudshell:~/way-back-home/level_4/agent$ adk create architect_agent Choose a model for the root agent: 1. gemini-2.5-flash 2. Other models (fill later) Choose model (1, 2): 1 1. Google AI 2. Vertex AI Choose a backend (1, 2): 2 You need an existing Google Cloud account and project... Enter Google Cloud project ID [your-project-id]: <PRESS ENTER> Enter Google Cloud region [us-central1]: <PRESS ENTER> Agent created in /home/user/way-back-home/level_4/agent/architect_agent: - .env - __init__.py - agent.py

এখন আপনি একটি Agent created সফলতার বার্তা' দেখতে পাবেন। এটি সেই কাঠামো কোডটি তৈরি করে যা আমরা পরবর্তী ধাপে পরিবর্তন করব।

👉✏️ আপনার এডিটরে নতুন তৈরি করা $HOME/way-back-home/level_4/backend/architect_agent/agent.py ফাইলটি খুলুন। ফাইলটির প্রথম ইম্পোর্ট লাইনের পরে টুল স্নিপেটটি যোগ করুন:

import os

import redis

REDIS_IP = os.environ.get('REDIS_HOST', 'localhost')

r = redis.Redis(host=REDIS_IP, port=6379, decode_responses=True)

def lookup_schematic_tool(drive_name: str) -> list[str]:

"""Returns the ordered list of parts for a drive from local Redis."""

# Logic to clean input like "TARGET: X" -> "X"

clean_name = drive_name.replace("TARGET:", "").replace("TARGET", "").strip()

clean_name = clean_name.replace(":", "").strip()

# LRANGE gets all items in the list (index 0 to -1)

result = r.lrange(clean_name, 0, -1)

if not result:

print(f"[ARCHITECT] Error: Drive ID '{clean_name}' not found in Redis.")

return ["ERROR: Drive ID not found."]

print(f"[ARCHITECT] Returning schematic for {clean_name}: {result}")

return result

👉✏️ root_agent ডেফিনিশনের সম্পূর্ণ ইনস্ট্রাকশন লাইনটি নিচের লাইন দিয়ে প্রতিস্থাপন করুন এবং আগে ডিফাইন করা টুলটিও যোগ করুন:

instruction='''SYSTEM ROLE: Database API.

INPUT: Text string (Drive Name).

TASK: Run `lookup_schematic_tool`.

OUTPUT: Return ONLY the raw list from the tool.

CONSTRAINT: Do NOT add conversational text.

''',

tools=[lookup_schematic_tool],

ADK সুবিধা

আর্কিটেক্ট অনলাইন থাকায়, এখন আমাদের কাছে তথ্যের একটি নির্ভরযোগ্য উৎস রয়েছে। এটিকে মূল এজেন্টের সাথে সংযুক্ত করার আগে, এজেন্ট ডেভেলপমেন্ট কিট (ADK) এআই এজেন্ট তৈরি ও পরীক্ষার জটিলতাগুলোকে সহজ করে একটি উল্লেখযোগ্য সুবিধা প্রদান করে। এর অন্তর্নির্মিত adk web ডেভেলপার কনসোলের সাহায্যে, আমরা আমাদের Architect Agent কার্যকারিতা, বিশেষ করে এর টুল-কলিং ক্ষমতা, বৃহত্তর মাল্টি-এজেন্ট সিস্টেমে একীভূত করার আগেই আলাদা করে যাচাই করতে পারি। শক্তিশালী ও নির্ভরযোগ্য এআই অ্যাপ্লিকেশন তৈরির জন্য ডেভেলপমেন্ট ও টেস্টিং-এর এই মডিউলার পদ্ধতিটি অত্যন্ত গুরুত্বপূর্ণ।

👉💻 আপনার টার্মিনালে, এটি চালান:

cd $HOME/way-back-home/level_4/

. scripts/check_redis.sh

cd $HOME/way-back-home/level_4/backend/

uv run adk web

👀 না দেখা পর্যন্ত অপেক্ষা করুন:

+-----------------------------------------------------------------------------+ | ADK Web Server started | | | | For local testing, access at http://127.0.0.1:8000. | +-----------------------------------------------------------------------------+ INFO: Application startup complete. INFO: Uvicorn running on http://127.0.0.1:8000 (Press CTRL+C to quit)

- ক্লাউড শেল টুলবারে থাকা ওয়েব প্রিভিউ আইকনে ক্লিক করুন। ‘Change port’ নির্বাচন করে সেটিকে 8000- এ সেট করুন এবং ‘Change and Preview’-এ ক্লিক করুন।

- স্থপতি এজেন্ট নির্বাচন করুন।

- টুলটি চালু করুন: চ্যাট ইন্টারফেসে টাইপ করুন:

CHRONOS-ALPHA(অথবা স্কিম্যাটিক ডেটাবেস থেকে যেকোনো ড্রাইভ আইডি)। - আচরণটি পর্যবেক্ষণ করুন:

- আর্কিটেক্টের অবিলম্বে

lookup_schematic_toolচালু করা উচিত। - আমাদের কঠোর সিস্টেম নির্দেশাবলীর কারণে, এটি কোনো অপ্রয়োজনীয় অংশ ছাড়াই শুধুমাত্র অংশগুলির তালিকা (যেমন,

['Shield Emitter', 'Data Crystal', 'Quantum Cell']) ফেরত দেবে।

- আর্কিটেক্টের অবিলম্বে

- লগ যাচাই করুন: আপনার টার্মিনাল উইন্ডোটি দেখুন। আপনি সফলভাবে এক্সিকিউশনের লগ দেখতে পাবেন:

[ARCHITECT] Returning schematic for CHRONOS-ALPHA: ['Shield Emitter', 'Data Crystal', 'Quantum Cell']!(architect_agent adk)[img/03-02-adkweb.png]

যদি আপনি টুল এক্সিকিউশন লগ এবং ক্লিন ডেটা রেসপন্স দেখতে পান, তাহলে আপনার স্পেশালিস্ট এজেন্টটি উদ্দেশ্য অনুযায়ী কাজ করছে। এটি অনুরোধগুলি প্রসেস করতে, ভল্ট কোয়েরি করতে এবং স্ট্রাকচার্ড ডেটা ফেরত দিতে পারে।

👉💻 বের হতে Ctrl+C চাপুন।

A2A সার্ভার শুরু করুন

ডিসপ্যাচ এজেন্টকে আর্কিটেক্টের সাথে সংযুক্ত করতে আমরা এজেন্ট-টু-এজেন্ট (A2A) প্রোটোকল ব্যবহার করি।

যেখানে এমসিপি (মডেল কনটেক্সট প্রোটোকল)-এর মতো প্রোটোকলগুলো এজেন্টদের টুলের সাথে সংযোগ করার উপর মনোযোগ দেয়, সেখানে এ২এ এজেন্টদের অন্যান্য এজেন্টের সাথে সংযোগ করার উপর মনোযোগ দেয়। এটি সেই স্ট্যান্ডার্ড যা আমাদের ডিসপ্যাচারকে আর্কিটেক্টকে "আবিষ্কার" করতে এবং স্কিম্যাটিকস খুঁজে বের করার তার সক্ষমতা বুঝতে সাহায্য করে।

A2A প্রবাহ: এই মিশনে, আমরা একটি ক্লায়েন্ট-সার্ভার মডেল ব্যবহার করি:

- সার্ভার (আর্কিটেক্ট): ডাটাবেস টুলগুলো হোস্ট করে এবং একটি এজেন্ট কার্ডের মাধ্যমে নিজের দক্ষতার "বিজ্ঞাপন" দেয়।

- ক্লায়েন্ট (প্রেরণ): আর্কিটেক্টের কার্ডটি পড়ে, এর এপিআই (API) বোঝে এবং একটি স্কিম্যাটিক অনুরোধ পাঠায়।

এজেন্ট কার্ড কী?

এজেন্ট কার্ডকে একটি ডিজিটাল বিজনেস কার্ড অথবা একটি এআই-এর জন্য 'ড্রাইভার্স লাইসেন্স' হিসেবে ভাবুন। যখন একটি A2A সার্ভার চালু হয়, তখন এটি এই JSON অবজেক্টটি প্রকাশ করে, যাতে থাকে:

- পরিচয়: এজেন্টের নাম (

architect_agent) এবং আইডি। - বিবরণ: এটি কী করে তার একটি মানুষ ও মেশিন-পাঠযোগ্য সারসংক্ষেপ ("সিস্টেমের ভূমিকা: ডেটাবেস এপিআই...")।

- ইন্টারফেস: এর প্রত্যাশিত নির্দিষ্ট ইনপুট কী (

drive_name) এবং আউটপুট ফরম্যাট।

এই কার্ডটি ছাড়া, ডিসপ্যাচ এজেন্টকে অন্ধের মতো কাজ করতে হতো এবং আর্কিটেক্টের সাথে কীভাবে যোগাযোগ করতে হবে তা অনুমান করতে হতো।

সার্ভার কোড তৈরি করুন

👉✏️ আপনার এডিটরে, $HOME/way-back-home/level_4/backend/architect_agent ডিরেক্টরির অধীনে server.py নামে একটি ফাইল তৈরি করুন এবং নিম্নলিখিত কোডটি পেস্ট করুন:

from google.adk.a2a.utils.agent_to_a2a import to_a2a

from agent import root_agent

import os

import logging

import json

from dotenv import load_dotenv

load_dotenv()

# Configure logging

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger("architect_server")

HOST= os.environ.get("HOST_URL","localhost")

PROTOCOL= os.environ.get("PROTOCOL","http")

PORT= os.environ.get("A2A_PORT",8081)

# 1. Create the A2A App (Handles Agent Card & HTTP)

# This middleware automatically sets up the /a2a/v1/... endpoints

app = to_a2a(root_agent, host=HOST, port=PORT, protocol=PROTOCOL)

if __name__ == "__main__":

import uvicorn

# Use 0.0.0.0 to allow external access if needed, port 8080 as standard

uvicorn.run(app, host='0.0.0.0', port=8081)

👉💻 আপনার টার্মিনালে ফিরে এসে, ফোল্ডারটিতে যান এবং সার্ভারটি চালু করুন:

cd $HOME/way-back-home/level_4/

. scripts/check_redis.sh

cd $HOME/way-back-home/level_4/backend/architect_agent

uv run server.py

👀 A2A সার্ভার চালু হয়েছে কিনা নিশ্চিত করুন:

INFO: Waiting for application startup. INFO: Application startup complete. INFO: Uvicorn running on http://0.0.0.0:8081 (Press CTRL+C to quit)

এজেন্ট কার্ড যাচাই করুন

একটি নতুন টার্মিনাল ট্যাব খুলুন ( + আইকনে ক্লিক করুন)। আমরা ম্যানুয়ালি আর্কিটেক্টের এজেন্ট কার্ডটি সংগ্রহ করে যাচাই করব যে সে তার পরিচয় সঠিকভাবে সম্প্রচার করছে কিনা।

👉💻 নিম্নলিখিত কমান্ডটি চালান:

curl -s http://localhost:8081/.well-known/agent.json | jq .

👀 আপনি একটি JSON রেসপন্স দেখতে পাবেন। আউটপুটে " description ফিল্ডটি খুঁজুন। এটি আপনার আগে এজেন্টকে দেওয়া নির্দেশনার ( "SYSTEM ROLE: Database API..." ) সাথে মিলতে হবে।

{

"capabilities": {},

"defaultInputModes": [

"text/plain"

],

"defaultOutputModes": [

"text/plain"

],

"description": "A helpful assistant for user questions.",

"name": "root_agent",

"preferredTransport": "JSONRPC",

"protocolVersion": "0.3.0",

"skills": [

{

"description": "A helpful assistant for user questions. SYSTEM ROLE: Database API.\n INPUT: Text string (Drive Name).\n TASK: Run `lookup_schematic_tool`.\n OUTPUT: Return ONLY the raw list from the tool.\n CONSTRAINT: Do NOT add conversational text.\n ",

"examples": [],

"id": "root_agent",

"name": "model",

"tags": [

"llm"

]

},

{

"description": "Returns the ordered list of parts for a drive from local Redis.",

"id": "root_agent-lookup_schematic_tool",

"name": "lookup_schematic_tool",

"tags": [

"llm",

"tools"

]

}

],

"supportsAuthenticatedExtendedCard": false,

"url": "http://localhost:8081",

"version": "0.0.1"

}

আপনি যদি এই JSON দেখতে পান, তার মানে আর্কিটেক্ট লাইভ আছে, A2A প্রোটোকল সক্রিয় আছে, এবং এজেন্ট কার্ডটি ডিসপ্যাচার দ্বারা আবিষ্কৃত হওয়ার জন্য প্রস্তুত।

এখন যেহেতু আর্কিটেক্ট একটি রিমোট রিসোর্স হিসেবে কাজ করার জন্য প্রস্তুত, আমরা এটিকে ডিসপ্যাচ এজেন্টের সাথে সংযুক্ত করার জন্য অগ্রসর হতে পারি।

👉💻 A2A সার্ভার থেকে বের হতে Ctrl+C চাপুন।

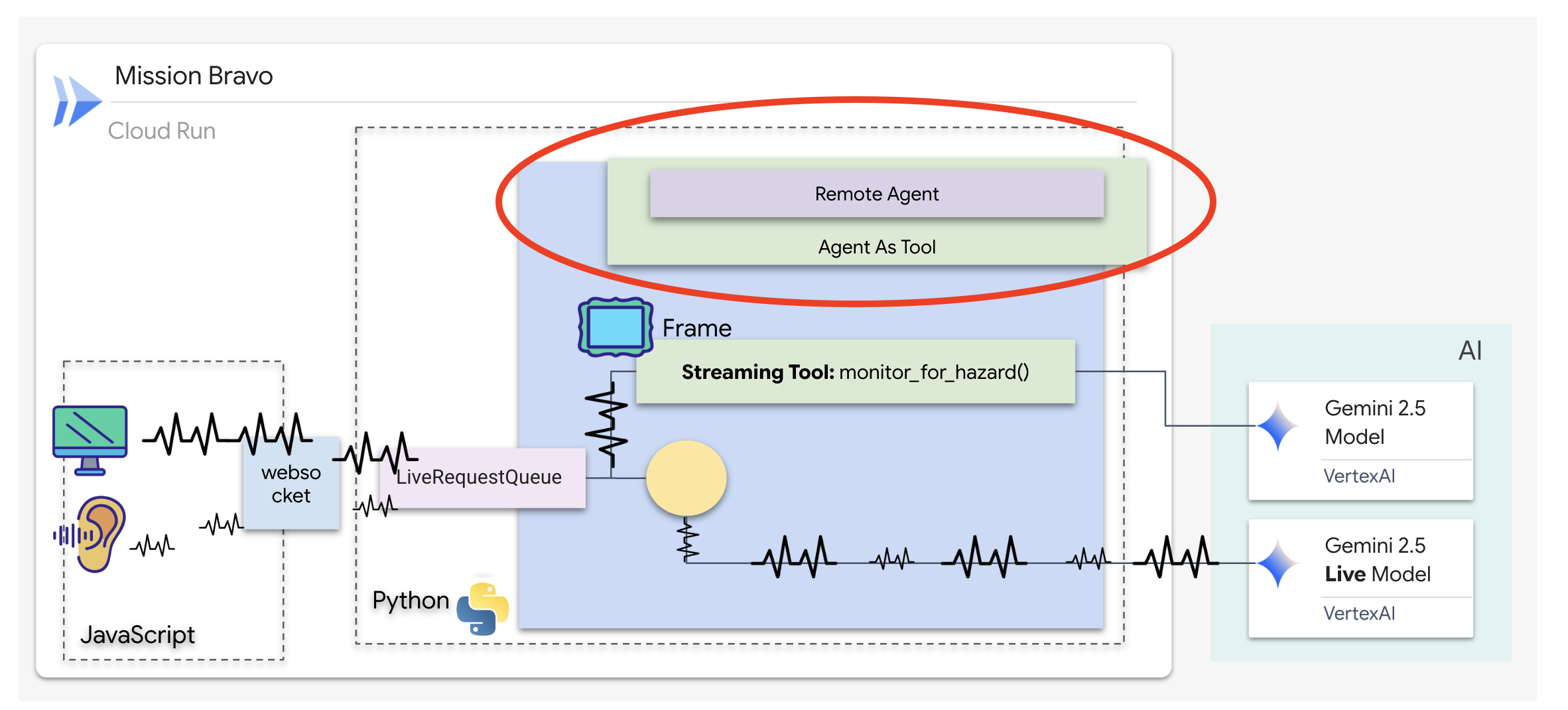

৪. BIDI-Streams এজেন্টকে রিমোট এজেন্ট এবং স্ট্রিমিং টুলের সাথে সংযুক্ত করা

এখন আপনি লাইভ ডেটা এবং দূরবর্তী আর্কিটেক্টের মধ্যে সংযোগ স্থাপনের জন্য প্রাথমিক কমিউনিকেশন হাবটি কনফিগার করবেন। এই সংযোগের জন্য একটি উচ্চ-ব্যান্ডউইথ ও স্বল্প-লেটেন্সির পাইপলাইন প্রয়োজন, যা অপারেশন চলাকালীন অ্যাসেম্বলি বেঞ্চের স্থিতিশীলতা নিশ্চিত করবে।

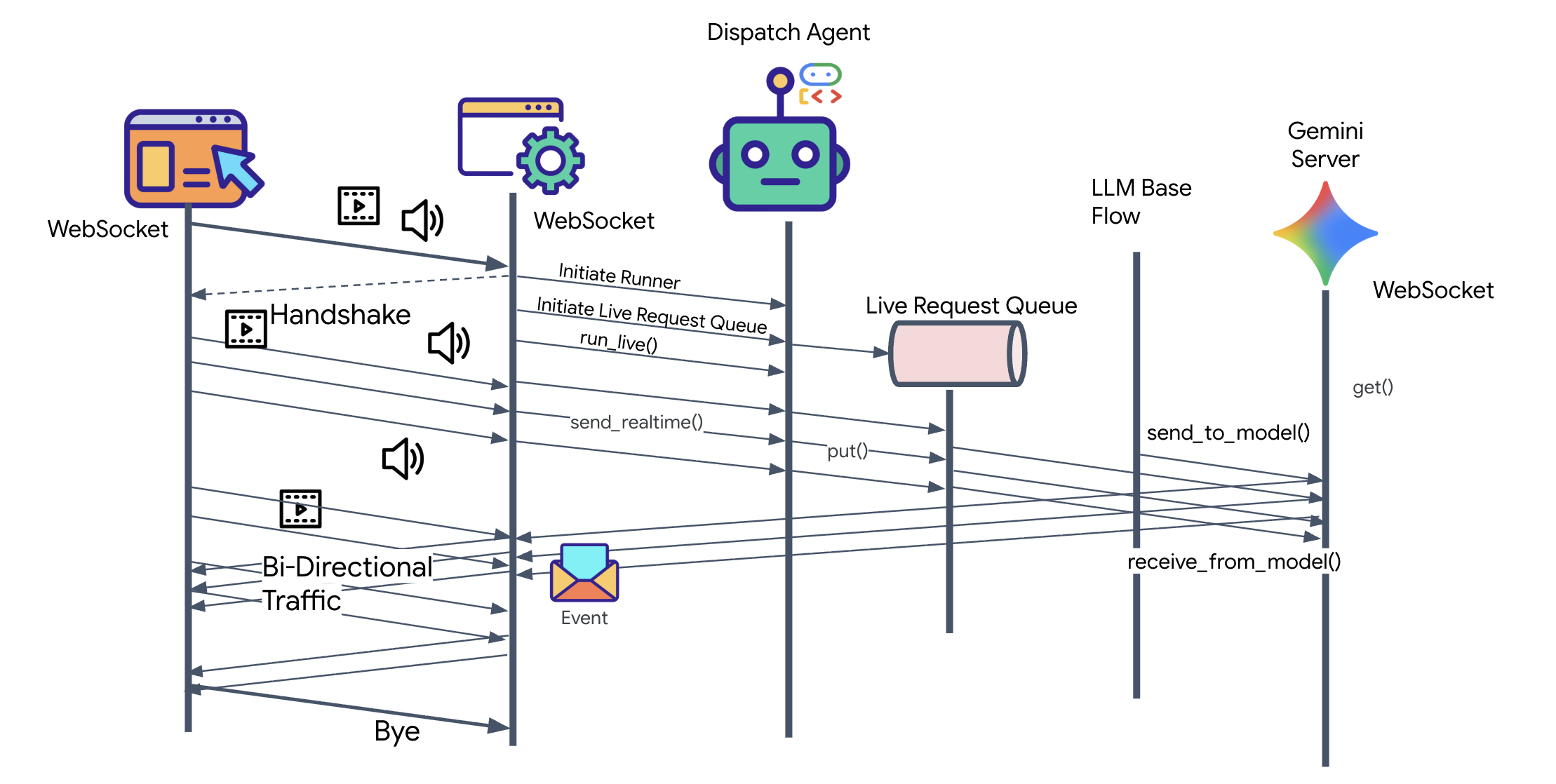

দ্বিমুখী স্ট্রিমিং (লাইভ) এজেন্ট বোঝা

ADK-তে দ্বিমুখী (Bidi) স্ট্রিমিং, AI এজেন্টদের সাথে Gemini Live API-এর স্বল্প-বিলম্বের দ্বিমুখী ভয়েস এবং ভিডিও মিথস্ক্রিয়ার সক্ষমতা যুক্ত করে। এটি প্রচলিত AI মিথস্ক্রিয়া থেকে একটি মৌলিক পরিবর্তন। গতানুগতিক "জিজ্ঞাসা করো এবং অপেক্ষা করো" পদ্ধতির পরিবর্তে, এটি রিয়েল-টাইম, দ্বিমুখী যোগাযোগ সক্ষম করে, যেখানে মানুষ এবং AI উভয়ই একই সাথে কথা বলতে, শুনতে এবং প্রতিক্রিয়া জানাতে পারে।

ইমেল পাঠানো এবং ফোনে কথা বলার মধ্যে পার্থক্যটি ভাবুন। প্রচলিত এজেন্ট ইন্টারঅ্যাকশনগুলো ইমেলের মতো: আপনি একটি সম্পূর্ণ বার্তা পাঠান, একটি সম্পূর্ণ উত্তরের জন্য অপেক্ষা করেন এবং তারপর আরেকটি পাঠান। বিডি-স্ট্রিমিং একটি ফোন আলাপের মতো: সাবলীল, স্বাভাবিক, এবং এতে রিয়েল-টাইমে কথা থামিয়ে, স্পষ্ট করে এবং উত্তর দেওয়ার সুযোগ থাকে।

মূল বৈশিষ্ট্য:

- দ্বিমুখী যোগাযোগ: সম্পূর্ণ উত্তরের জন্য অপেক্ষা না করে নিরবচ্ছিন্ন তথ্য আদান-প্রদান। ব্যবহারকারী কথা বলা শেষ করেছেন বুঝতে পেরেই এআই সাড়া দেয়।

- প্রতিক্রিয়াশীল বাধা: ব্যবহারকারীরা মানুষের কথোপকথনের মতোই এজেন্টের উত্তরের মাঝখানে নতুন কিছু বলে তাকে বাধা দিতে পারেন। যদি কোনো এআই একটি জটিল ধাপ ব্যাখ্যা করে এবং আপনি বলেন, "একটু দাঁড়ান, আবার বলুন," তাহলে এআইটি সঙ্গে সঙ্গে থেমে যায় এবং আপনার বাধার জবাব দেয়।

- মাল্টিমোডালিটির জন্য অপ্টিমাইজ করা: বিডি-স্ট্রিমিং একই সাথে বিভিন্ন ধরণের ইনপুট প্রসেস করতে অত্যন্ত পারদর্শী। আপনি ভিডিওর মাধ্যমে এলিয়েন অংশগুলো দেখানোর পাশাপাশি এজেন্টের সাথে কথাও বলতে পারেন, এবং এটি একটি একক, সমন্বিত সংযোগের মাধ্যমে উভয় স্ট্রিমই প্রসেস করে।

👀 ক্লায়েন্ট লজিক প্রয়োগ করার আগে, চলুন ডিসপ্যাচ এজেন্টের জন্য আগে থেকে তৈরি করা কাঠামোটি পরীক্ষা করে দেখি। এই এজেন্টটি ভয়েস এবং ভিডিওর মাধ্যমে ব্যবহারকারীর সাথে যোগাযোগ করবে এবং আর্কিটেক্ট এজেন্টের কাছে কোয়েরিগুলো অর্পণ করবে।

__init__.py agent.py hazard_db.py

agent.py: এটিই হলো "মস্তিষ্ক"। এতে বর্তমানে একটি প্রাথমিক Bidi-স্ট্রিমিং সেটআপ রয়েছে। আমরা এই ফাইলটি পরিবর্তন করে A2A ক্লায়েন্ট লজিক যোগ করব, যাতে এটি আর্কিটেক্টের সাথে যোগাযোগ করতে পারে।-

hazard_db.py: এটি ডিসপ্যাচ এজেন্টের জন্য একটি নির্দিষ্ট স্থানীয় টুল, যাতে নিরাপত্তা প্রোটোকল রয়েছে। এটি আর্কিটেক্টের স্কিমেটিক ডেটাবেস থেকে আলাদা।

A2A ক্লায়েন্ট বাস্তবায়ন

ডিসপ্যাচ এজেন্টকে আমাদের রিমোট আর্কিটেক্টের সাথে যোগাযোগ করার সুযোগ দিতে, আমাদের অবশ্যই একটি রিমোট A2A এজেন্ট সংজ্ঞায়িত করতে হবে। এটি ডিসপ্যাচ এজেন্টকে বলে দেয় যে আর্কিটেক্টকে কোথায় খুঁজে পাওয়া যাবে এবং তার 'এজেন্ট কার্ড' দেখতে কেমন।

👉✏️ $HOME/way-back-home/level_4/backend/dispatch_agent/agent.py ফাইলে থাকা #REPLACE-REMOTEA2AAGENT লাইনটি নিচের লাইন দিয়ে প্রতিস্থাপন করুন:

architect_agent = RemoteA2aAgent(

name="execute_architect",

description="[SILENT ACTION]: Retrieves the REQUIRED SUBSET of parts. The screen shows a full inventory; this tool filters out the wrong parts. Must be called INSTANTLY when a Target Name is found. Input: Target Name.",

agent_card=(f"{ARCHITECT_URL}{AGENT_CARD_WELL_KNOWN_PATH}"),

httpx_client=insecure_client,

)

স্ট্রিমিং টুলগুলো কীভাবে কাজ করে

পূর্ববর্তী এজেন্টের ক্ষেত্রে, টুলগুলো একটি সাধারণ "অনুরোধ-প্রতিক্রিয়া" (Request-Response) প্যাটার্ন অনুসরণ করত; এজেন্ট একটি প্রশ্ন করত, টুলটি একটি উত্তর দিত এবং মিথস্ক্রিয়াটি শেষ হয়ে যেত। কিন্তু, ওজিম্যান্ডিয়াসে (Ozymandias), হ্যাজার্ডগুলো উপস্থিত আছে কি না, তা আপনার জিজ্ঞাসা করার জন্য অপেক্ষা করে না। এর জন্য আপনার একটি স্ট্রিমিং টুল (Streaming Tool ) প্রয়োজন।

স্ট্রিমিং টুলগুলো ফাংশনগুলোকে রিয়েল-টাইমে এজেন্টের কাছে অন্তর্বর্তী ফলাফল স্ট্রিম করার সুযোগ দেয়, যার ফলে এজেন্ট পরিবর্তন ঘটার সাথে সাথেই সে অনুযায়ী প্রতিক্রিয়া জানাতে পারে। এর সাধারণ ব্যবহারগুলোর মধ্যে রয়েছে শেয়ারের ওঠানামার মূল্য পর্যবেক্ষণ করা অথবা, আমাদের ক্ষেত্রে, একটি লাইভ ভিডিও স্ট্রিমের অবস্থার পরিবর্তন পর্যবেক্ষণ করা।

সাধারণ টুলগুলোর থেকে ভিন্ন, একটি স্ট্রিমিং টুল হলো একটি অ্যাসিঙ্ক্রোনাস ফাংশন যা একটি অ্যাসিঙ্কজেনারেটর (AsyncGenerator) হিসেবে কাজ করে। এর মানে হলো, এটি একটি একক মান return পরিবর্তে, সময়ের সাথে সাথে একাধিক আপডেট yield ।

ADK-তে একটি স্ট্রিমিং টুল সংজ্ঞায়িত করতে হলে, আপনাকে এই প্রযুক্তিগত প্রয়োজনীয়তাগুলো মেনে চলতে হবে:

- অ্যাসিঙ্ক্রোনাস ফাংশন: টুলটি অবশ্যই

async defদিয়ে সংজ্ঞায়িত করতে হবে। - AsyncGenerator রিটার্ন টাইপ: একটি

AsyncGeneratorরিটার্ন করার জন্য ফাংশনটিকে অবশ্যই টাইপড হতে হবে। প্রথম প্যারামিটারটি হলো যে ডেটা প্রদান করা হচ্ছে তার টাইপ (যেমন,str), এবং দ্বিতীয়টি সাধারণতNoneহয়। - ইনপুট স্ট্রিম: আমরা ভিডিও স্ট্রিমিং টুল ব্যবহার করি। এই মোডে, প্রকৃত ভিডিও/অডিও স্ট্রিম (

LiveRequestQueue) সরাসরি ফাংশনে পাঠানো হয়, যার ফলে টুলটি এজেন্টের দেখা একই ফ্রেমগুলো "দেখতে" পারে।

একটি স্ট্রিমিং টুলকে একজন প্রহরী হিসেবে ভাবুন। যখন আপনি এবং ডিসপ্যাচ এজেন্ট নকশা নিয়ে আলোচনা করছেন, তখন প্রহরীটি নেপথ্যে থেকে নীরবে প্রতিটি ভিডিও ফ্রেম বিশ্লেষণ করে আপনার নিরাপত্তা নিশ্চিত করে।

ব্যাকগ্রাউন্ড মনিটরিং টুল বাস্তবায়ন করা

আমরা এখন monitor_for_hazard টুলটি বাস্তবায়ন করব। এই টুলটি input_stream (ভিডিও ফ্রেম) গ্রহণ করবে, একটি পৃথক, হালকা ভিশন কল ব্যবহার করে সেগুলো বিশ্লেষণ করবে এবং শুধুমাত্র কোনো বিপদ শনাক্ত হলেই একটি সতর্কবার্তা yield ।

👉✏️ $HOME/way-back-home/level_4/backend/dispatch_agent/agent.py ফাইলে, #REPLACE_MONITOR_HAZARD নিম্নলিখিত লজিক দিয়ে প্রতিস্থাপন করুন:

async def monitor_for_hazard(

input_stream: LiveRequestQueue,

):

"""Monitor if any part is glowing"""

print("start monitor_video_stream!")

client = Client()

prompt_text = (

"Monitor the left menu if you see any glowing part, detect it's name"

)

last_count = None

while True:

last_valid_req = None

print("Monitoring loop cycle")

# use this loop to pull the latest images and discard the old ones

# Process only the current batch of events

while input_stream._queue.qsize() != 0:

live_req = await input_stream.get()

if live_req.blob is not None and live_req.blob.mime_type == "image/jpeg":

# Consumed by Monitor (Eyes)

# Deepcopy to ensure we detach from any referenced object before potential reuse/gc

# last_valid_req = deepcopy(live_req)

last_valid_req = live_req

# If we found a valid image, process it

if last_valid_req is not None:

print("Processing the most recent frame from the queue")

# Create an image part using the blob's data and mime type

image_part = genai_types.Part.from_bytes(

data=last_valid_req.blob.data, mime_type=last_valid_req.blob.mime_type

)

contents = genai_types.Content(

role="user",

parts=[image_part, genai_types.Part.from_text(text=prompt_text)],

)

# Call the model to generate content based on the provided image and prompt

try:

response = await client.aio.models.generate_content(

model="gemini-2.5-flash",

contents=contents,

config=genai_types.GenerateContentConfig(

system_instruction=(

"Focus strictly on the far-left vertical column under the heading 'PARTS REPLICATOR.' "

"Ignore the center of the screen and the 'BLUEPRINT' area entirely. "

"Look only at the list containing"

"Identify if any item in this specific left-side list has a bright white border glow and the text 'HAZARD DETECTED' overlaying it. "

"If found, return ONLY the part name in ALL CAPS. If no part in that leftmost list is glowing, return nothing."

)

),

)

except Exception as e:

print(f"Error calling Gemini: {e}")

await asyncio.sleep(1)

continue

print("Gemini response received.response:", response.candidates[0].content.parts[0].text)

current_text = response.candidates[0].content.parts[0].text.strip()

# If we have a logical change (and it's not just empty)

if current_text and current_text != last_count:

# Ignore "Nothing." response from model

if current_text == "Nothing." or "I cannot fulfill" in current_text:

print(f"Model sees nothing or refused. Skipping alert.")

last_count = current_text

continue

print(f"New hazard detected: {current_text} (was: {last_count})")

last_count = current_text

part_name = current_text

color = lookup_part_safety(part_name)

yield f"Hazard detected place {part_name} to the {color} bin"

# Update last_count even if it's empty, so we can detect when it reappears?

# Actually if it goes from "DATA CRYSTAL" to "" (nothing), we probably just silence.

# But if we don't update last_count on empty, we won't re-trigger if "DATA CRYSTAL" stays "DATA CRYSTAL".

# The user wants to detect hazards.

# If current_text is empty, we should probably update last_count to empty so next valid one triggers.

if not current_text:

last_count = None

else:

print("No valid frame found, skipping processing.")

await asyncio.sleep(5)

ডিসপ্যাচ এজেন্ট বাস্তবায়ন করা

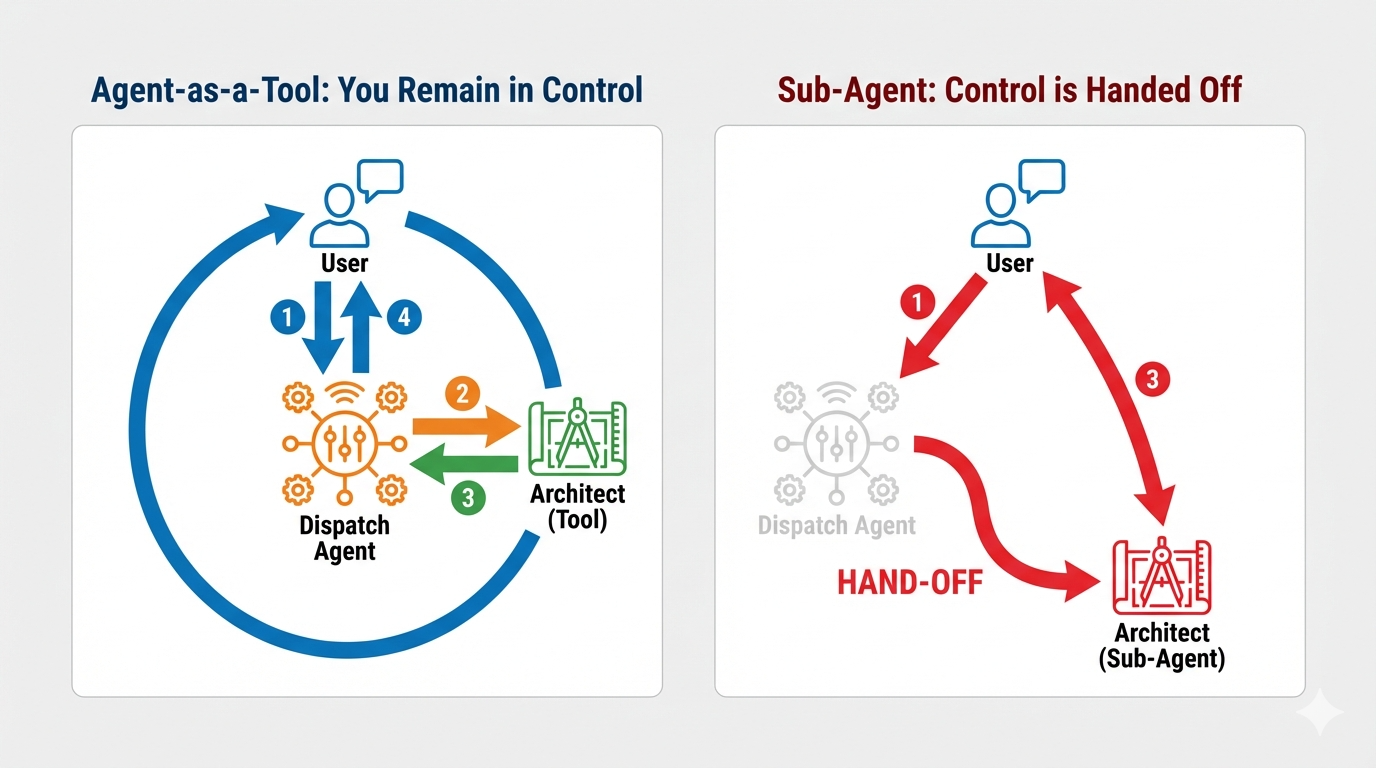

ডিসপ্যাচ এজেন্ট হলো আপনার প্রাথমিক ইন্টারফেস এবং নিয়ন্ত্রক। যেহেতু এটি বিডি-স্ট্রিমিং লিঙ্ক (আপনার লাইভ ভয়েস এবং ভিডিও) পরিচালনা করে, তাই এটিকে অবশ্যই সব সময় কথোপকথনের নিয়ন্ত্রণ ধরে রাখতে হবে। এটি করার জন্য, আমরা ADK-এর একটি নির্দিষ্ট ফিচার ব্যবহার করব: এজেন্ট-অ্যাজ-এ-টুল ।

ধারণা: হাতিয়ার হিসেবে এজেন্ট বনাম উপ-এজেন্ট

একাধিক এজেন্ট সমন্বিত সিস্টেম তৈরি করার সময়, দায়িত্ব কীভাবে ভাগ করা হবে তা আপনাকে স্থির করতে হবে। আমাদের উদ্ধার অভিযানে এই পার্থক্যটি অত্যন্ত গুরুত্বপূর্ণ:

- এজেন্ট-অ্যাজ-এ-টুল: আমাদের বিডি-স্ট্রিমিং হাবের জন্য এটিই প্রস্তাবিত পদ্ধতি। যখন ডিসপ্যাচ এজেন্ট (এজেন্ট এ) আর্কিটেক্ট এজেন্টকে (এজেন্ট বি) একটি টুল হিসেবে কল করে, তখন আর্কিটেক্টের ডেটা ডিসপ্যাচে ফেরত পাঠানো হয়। এরপর ডিসপ্যাচ সেই ডেটা বিশ্লেষণ করে আপনার জন্য একটি প্রতিক্রিয়া তৈরি করে। ডিসপ্যাচ নিয়ন্ত্রণে থাকে এবং পরবর্তী সমস্ত ব্যবহারকারীর ইনপুট পরিচালনা করতে থাকে।

- সাব-এজেন্ট: সাব-এজেন্ট সম্পর্কে দায়িত্ব সম্পূর্ণরূপে হস্তান্তর করা হয়। যদি ডিসপ্যাচ আপনাকে একজন সাব-এজেন্ট হিসেবে আর্কিটেক্টের কাছে হস্তান্তর করে, তবে আপনি সরাসরি এমন একটি ডাটাবেস এপিআই-এর সাথে কথা বলবেন যার কোনো 'ভিশন' বা কথোপকথনের দক্ষতা নেই। এক্ষেত্রে প্রাইমারি এজেন্ট (ডিসপ্যাচ) কার্যত পুরো প্রক্রিয়ার বাইরে থাকবেন।

‘এজেন্ট-অ্যাজ-এ-টুল’ ব্যবহারের মাধ্যমে, আমরা বিডি-স্ট্রিমিং এজেন্টের সাবলীল ও মানবিক মিথস্ক্রিয়া বজায় রেখে আর্কিটেক্টের বিশেষায়িত জ্ঞানকে কাজে লাগাই।

রাউটিং লজিক কোডিং

আমরা এখন আমাদের architect_agent একটি AgentTool মধ্যে রাখব এবং Dispatch এজেন্টকে একটি "Logic Map" প্রদান করব। এই ম্যাপটি এজেন্টকে স্পষ্টভাবে বলে দেয় কখন ভল্ট থেকে ডেটা আনতে হবে এবং কখন ব্যাকগ্রাউন্ড সেন্টিনেল থেকে প্রাপ্ত ফলাফল রিপোর্ট করতে হবে।

ডিসপ্যাচকে অবিরাম পলকহীন 'চোখ' দিতে হলে, আমাদের অবশ্যই পূর্ববর্তী ধাপে তৈরি করা স্ট্রিমিং টুলটিতে এটিকে অ্যাক্সেস দিতে হবে।

ADK-তে, যখন আপনি tools লিস্টে একটি AsyncGenerator ফাংশন (যেমন monitor_for_hazard ) যোগ করেন, তখন এজেন্ট এটিকে একটি স্থায়ী ব্যাকগ্রাউন্ড প্রসেস হিসেবে গণ্য করে। একবার চালানোর পরিবর্তে, এজেন্ট টুলটির আউটপুটের জন্য "সাবস্ক্রাইব" করে। এর ফলে ডিসপ্যাচ তার মূল কাজ চালিয়ে যেতে পারে, আর সেন্টিনেল নীরবে ব্যাকগ্রাউন্ডে হ্যাজার্ড অ্যালার্ট পাঠাতে থাকে।

👉✏️ $HOME/way-back-home/level_4/backend/dispatch_agent/agent.py ফাইলে থাকা #REPLACE_AGENT_TOOLS নিম্নলিখিত কোড দিয়ে প্রতিস্থাপন করুন:

tools=[AgentTool(agent=architect_agent), monitor_for_hazard],

যাচাইকরণ

👉💻 উভয় এজেন্ট কনফিগার করা হয়ে গেলে, আমরা লাইভ মাল্টি-এজেন্ট ইন্টারঅ্যাকশন পরীক্ষা করতে পারি।

- টার্মিনাল A-তে, আর্কিটেক্ট এজেন্ট চালু করুন:

cd $HOME/way-back-home/level_4/

. scripts/check_redis.sh

cd $HOME/way-back-home/level_4/backend/architect_agent

uv run server.py

- একটি নতুন টার্মিনালে (টার্মিনাল B), ডিসপ্যাচ এজেন্টটি চালান:

cd $HOME/way-back-home/level_4/backend/

cp architect_agent/.env .env

uv run adk web

adk web সিমুলেটরের মধ্যে gemini-live মতো একটি রিয়েল-টাইম, মাল্টিমোডাল মডেল ব্যবহারকারী মাল্টি-এজেন্ট সিস্টেম পরীক্ষা করার জন্য একটি নির্দিষ্ট কর্মপ্রবাহ অনুসরণ করতে হয়। টুল কলগুলো পরীক্ষা করার জন্য সিমুলেটরটি চমৎকার, কিন্তু এই ধরনের মডেল দিয়ে প্রথমবার ছবি প্রসেস করার সময় এর একটি পরিচিত অসামঞ্জস্যতা রয়েছে।

- ক্লাউড শেল টুলবারে থাকা ওয়েব প্রিভিউ আইকনে ক্লিক করুন। ‘Change port’ নির্বাচন করে সেটিকে 8000- এ সেট করুন এবং ‘Change and Preview’-এ ক্লিক করুন।

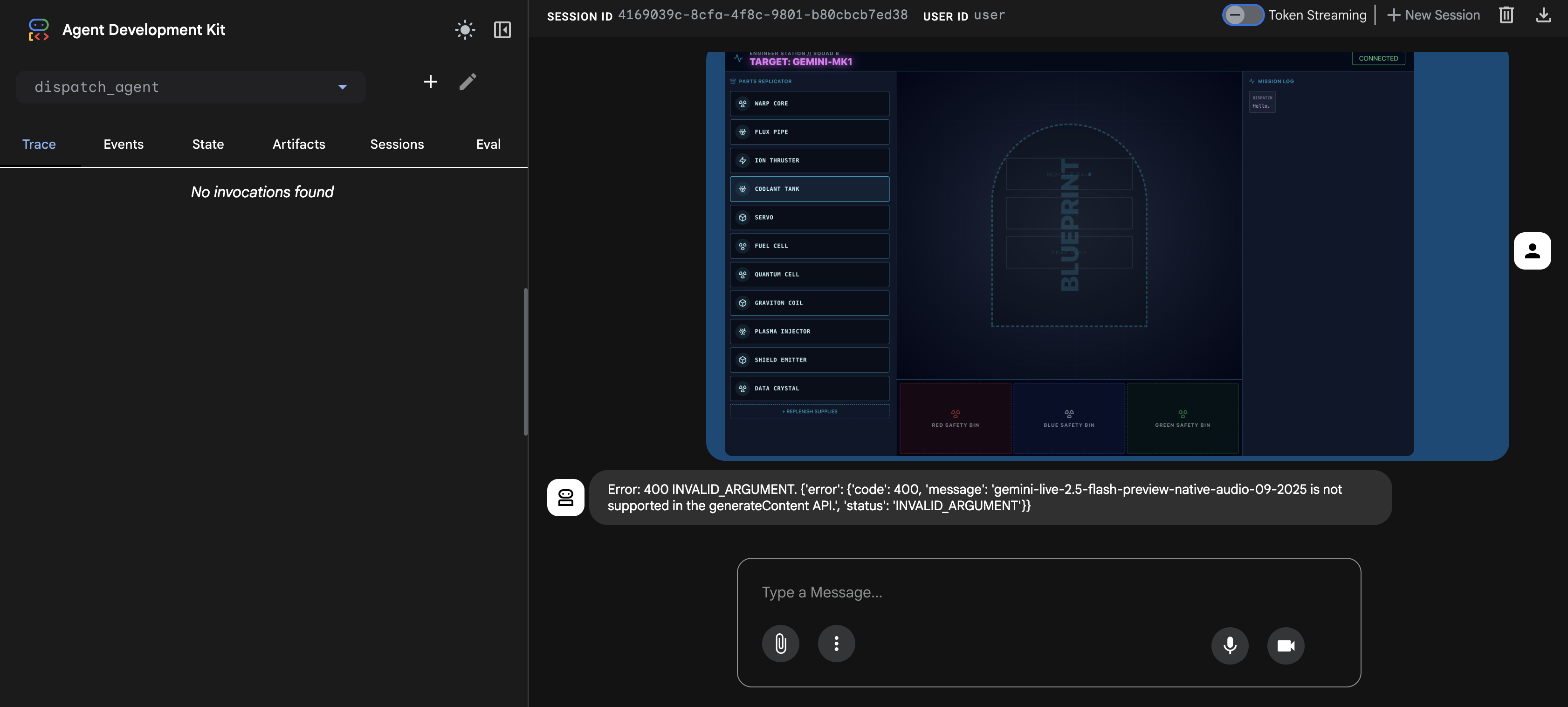

👉dispatch_agent নির্বাচন করুন, ব্লুপ্রিন্ট আপলোড করুন এবং প্রত্যাশিত ত্রুটিটি সমাধান করুন।

এটি সবচেয়ে গুরুত্বপূর্ণ ধাপ। আমাদের এজেন্টকে ছবির প্রেক্ষাপট সরবরাহ করতে হবে।

- ইন্টারফেসটি লোড হলে, অনুরোধ করা হলে আপনার মাইক্রোফোন অ্যাক্সেস করার অনুমতি দিন ।

- এই ব্লুপ্রিন্ট ছবিটি আপনার কম্পিউটারে ডাউনলোড করুন:

-

adk webইন্টারফেসে, পেপারক্লিপ আইকনে ক্লিক করুন এবং আপনার এইমাত্র ডাউনলোড করা ব্লুপ্রিন্ট ইমেজটি আপলোড করুন।

⚠️⚠️আপনি একটি 400 INVALID_ARGUMENT এরর দেখতে পাবেন। এটি স্বাভাবিক।⚠️⚠️

এই ত্রুটিটি ঘটে কারণ adk web ইমেজ হ্যান্ডলারটি এককালীন আপলোডের জন্য gemini-live মডেলের API-এর সাথে সম্পূর্ণরূপে সামঞ্জস্যপূর্ণ নয়। তবে, ছবিটি সফলভাবে সেশন কনটেক্সটে যুক্ত করা হয়েছে ।

- 👉 ত্রুটিটি দূর করতে, ব্রাউজার পৃষ্ঠাটি পুনরায় লোড করুন ।

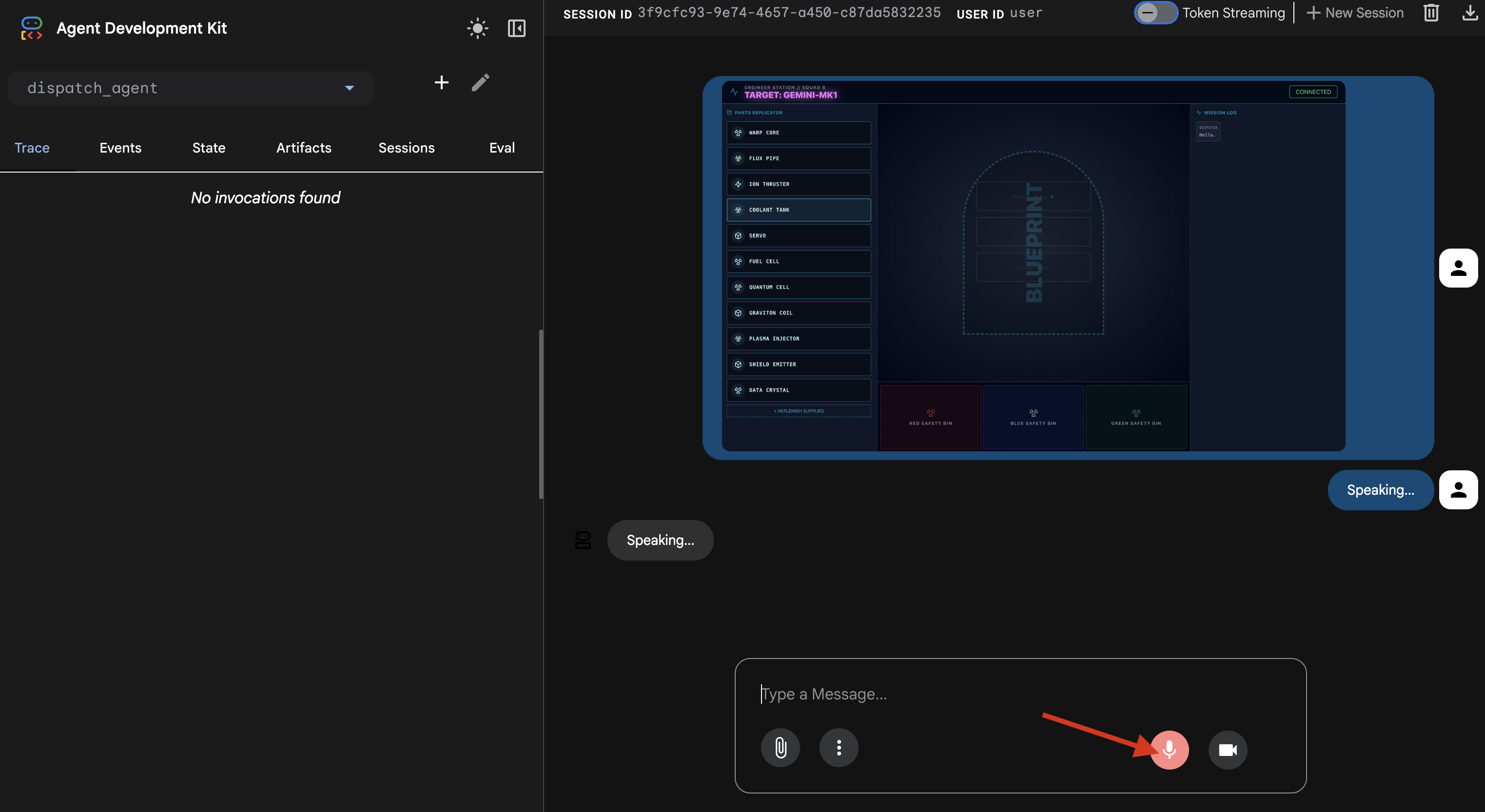

অ্যাসেম্বলি প্রক্রিয়াটি চালু করুন

👉 রিলোড করার পর ত্রুটিটি চলে যাবে এবং আপনি চ্যাট হিস্ট্রিতে ব্লুপ্রিন্ট ছবিটি দেখতে পাবেন। এজেন্টটি এখন তার প্রয়োজনীয় ভিজ্যুয়াল প্রেক্ষাপটটি পেয়ে গেছে।

- মাইক্রোফোন আইকনটি ক্লিক করে এটি চালু করুন। ইন্টারফেসে "শুনছে..." লেখাটি দেখা যাবে।

- ভয়েস কমান্ডটি বলুন: "স্টার্ট টু অ্যাসেম্বল" ।

- এজেন্ট আপনার অনুরোধটি প্রক্রিয়া করবে এবং ইউজার ইন্টারফেস (UI) "Speaking..."-এ পরিবর্তিত হবে। আপনি একটি শুধুমাত্র-অডিও প্রতিক্রিয়া শুনতে পাবেন, যেখানে প্রয়োজনীয় অংশগুলির একটি তালিকা থাকবে।

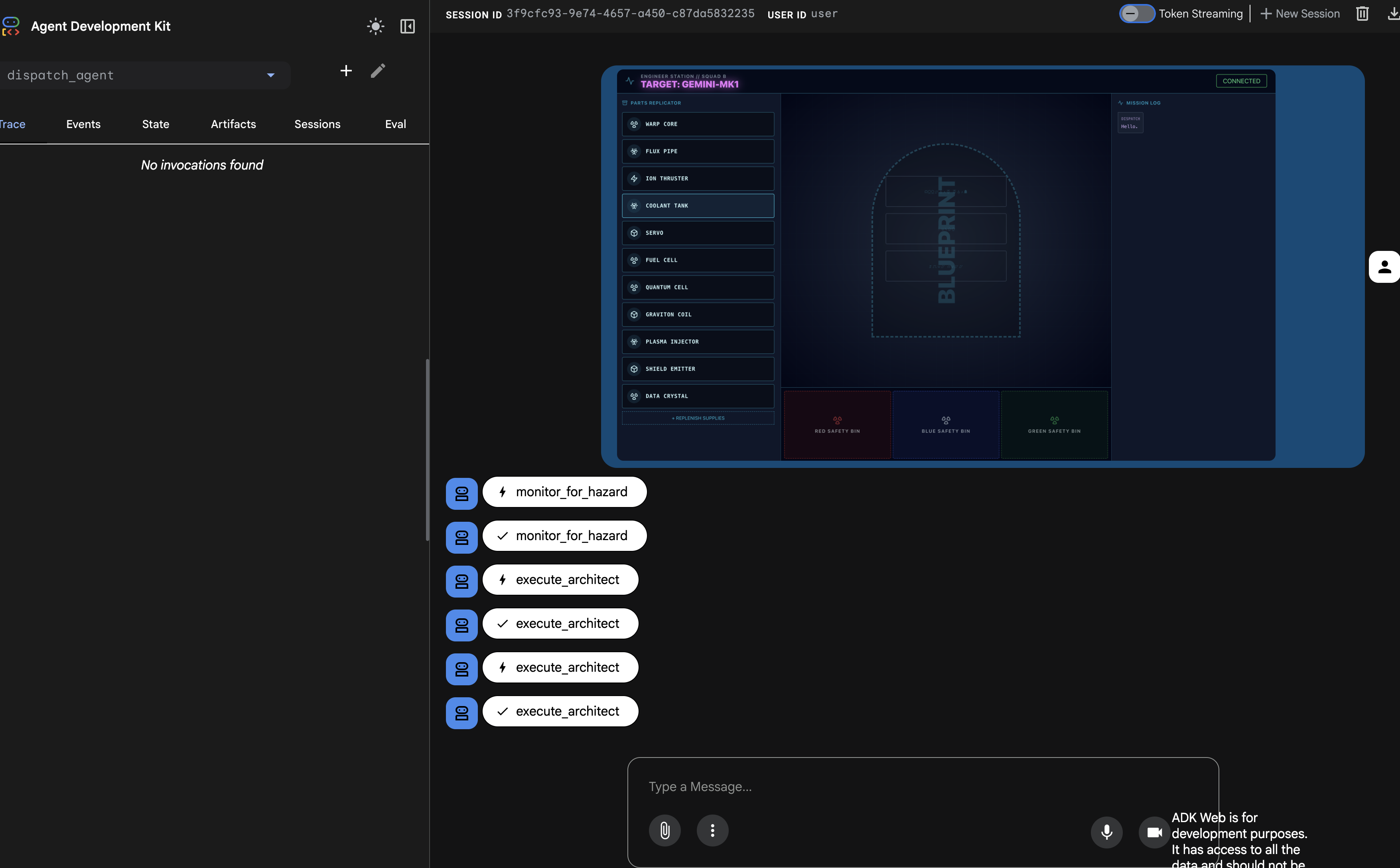

৪. এজেন্ট-টু-এজেন্ট টুল কলগুলো যাচাই করুন

👉 প্রাথমিক অডিও প্রতিক্রিয়া নিশ্চিত করে যে সিস্টেমটি কাজ করছে, কিন্তু আসল জাদুটা রয়েছে মাল্টি-এজেন্ট কমিউনিকেশন ট্রেস-এর মধ্যে।

- মাইক্রোফোনটি বন্ধ করুন।

- পৃষ্ঠাটি আরও একবার রিফ্রেশ করুন।

বাম দিকের "ট্রেস" প্যানেলটি এখন ডেটা দ্বারা পূর্ণ হবে। আপনি সম্পূর্ণ, সফল কার্যসম্পাদন প্রবাহটি দেখতে পারেন:

-

dispatch_agentপ্রথমেmonitor_for_hazardকল করে। - এরপর, এটি স্কিমেটিক ডেটা পুনরুদ্ধার করার জন্য

architect_agentকে একাধিকexecute_architectকল করে।

এই অনুক্রমটি নিশ্চিত করে যে সম্পূর্ণ মাল্টি-এজেন্ট ওয়ার্কফ্লোটি সঠিকভাবে কাজ করছে: dispatch_agent অনুরোধটি গ্রহণ করেছে, একটি টুল কলের মাধ্যমে architect_agent ডেটা পুনরুদ্ধারের কাজটি অর্পণ করেছে, এবং ব্যবহারকারীর নির্দেশ পালনের জন্য ডেটা ফেরত পেয়েছে।

আপনার বিডি-স্ট্রিমিং লিঙ্কটি এখন ব্যাকগ্রাউন্ড মনিটরিং এবং একাধিক এজেন্টের মধ্যে সহযোগিতায় সক্ষম। এরপরে, আমরা শিখব কীভাবে ফ্রন্টএন্ডে এই জটিল প্রতিক্রিয়াগুলি পার্স করতে হয়।

👉💻 বের হওয়ার জন্য উভয় টার্মিনালে Ctrl+c চাপুন।

৫. লাইভ মাল্টিমোডাল ইভেন্ট স্ট্রিমগুলির একটি গভীর বিশ্লেষণ

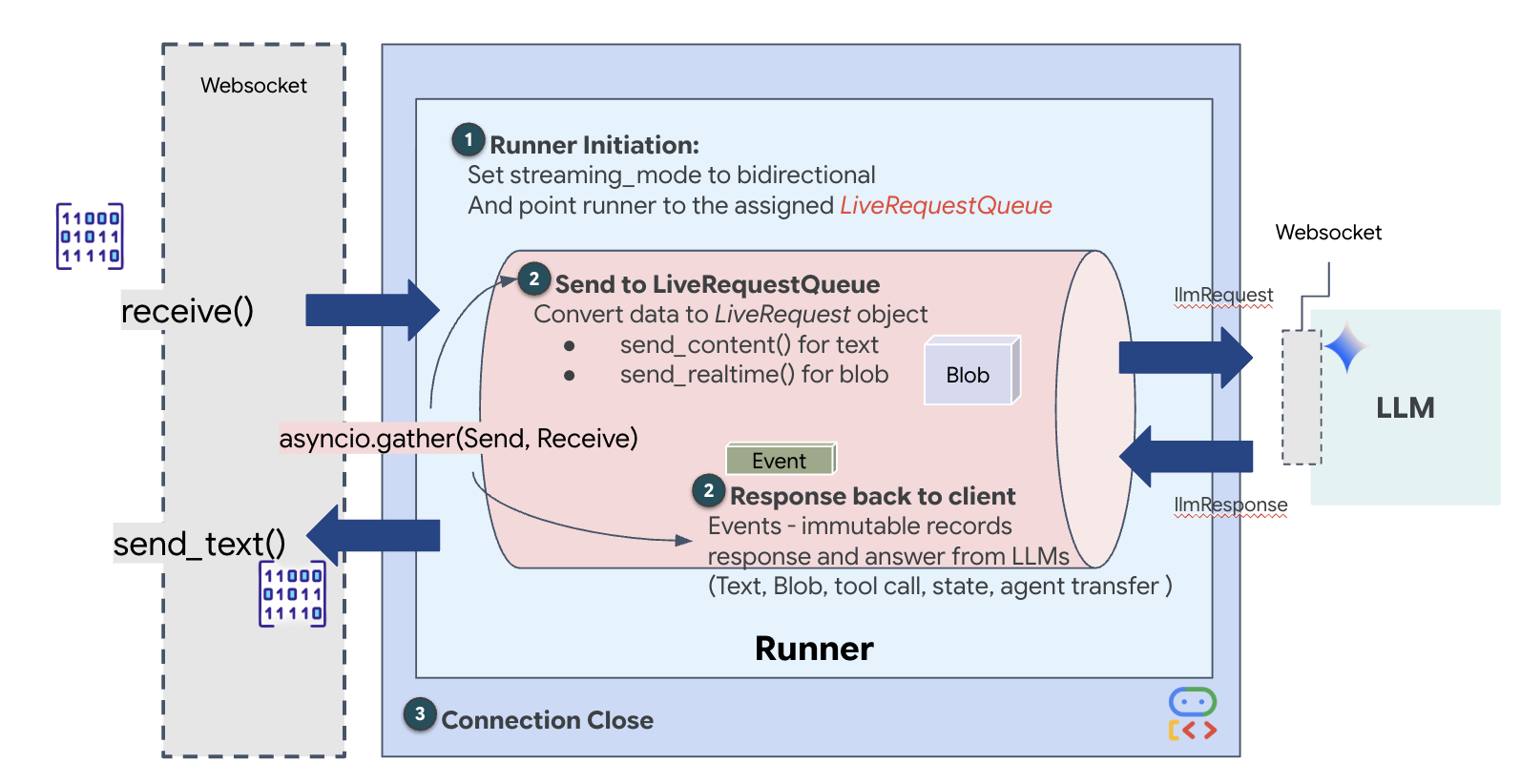

পূর্ববর্তী ধাপে, আমরা বিল্ট-ইন ডেভেলপমেন্ট সার্ভার, adk web ব্যবহার করে আমাদের মাল্টি-এজেন্ট সিস্টেমটি সফলভাবে যাচাই করেছি। এই ইউটিলিটিটি সেশন, স্ট্রিম এবং এজেন্টের জীবনচক্র স্বয়ংক্রিয়ভাবে পরিচালনা করার জন্য একটি ডিফল্ট ADK রানার ব্যবহার করে। তবে, আমাদের FastAPI সার্ভিসের ( main.py ) মতো একটি স্বতন্ত্র, প্রোডাকশন-রেডি অ্যাপ্লিকেশন তৈরি করতে আমাদের সুস্পষ্ট নিয়ন্ত্রণের প্রয়োজন। লাইভ ইউজার সেশনগুলো পরিচালনা করার জন্য আমাদের অবশ্যই ADK রানারটি ম্যানুয়ালি তৈরি এবং পরিচালনা করতে হবে, কারণ এটিই মূল উপাদান যা অডিও, ভিডিও এবং টেক্সটের জন্য দ্বিমুখী স্ট্রিমগুলো প্রসেস করে।

মডেল-কোড-মডেল লুপ

সিস্টেমটি রিয়েল-টাইমে কীভাবে কাজ করে তা বোঝার জন্য, আসুন একটি একক মিশন সেশনের জীবনচক্র অনুসরণ করি। এই লুপটি LlmRequest এবং LlmResponse অবজেক্টগুলোর অবিরাম আদান-প্রদানকে বোঝায়।

- ভিজ্যুয়াল লিঙ্ক: আপনি সংযোগটি শুরু করেন এবং আপনার ওয়েবক্যাম/স্ক্রিন শেয়ার করেন।

realtimeInput(LiveRequestQueueব্যবহার করে) এর মাধ্যমে উচ্চ-মানের JPEG ফ্রেম আপস্ট্রিমে প্রবাহিত হতে শুরু করে। - সেন্টিনেল অ্যাক্টিভেশন: সিস্টেমটি একটি প্রাথমিক "হ্যালো" সংকেত পাঠায়। এর নির্দেশনা অনুযায়ী, ডিসপ্যাচ এজেন্ট অবিলম্বে

monitor_for_hazardস্ট্রিমিং টুলটি চালু করে। এটি একটি ব্যাকগ্রাউন্ড লুপ শুরু করে যা নীরবে প্রতিটি আগত ফ্রেম পর্যবেক্ষণ করে। - পাইলটের নির্দেশ: আপনি যোগাযোগ ব্যবস্থায় বলবেন: "জোড়া লাগাতে শুরু করুন।"

- ভোকাল আপস্ট্রিম: আপনার কণ্ঠস্বর ১৬ কিলোহার্টজ অডিও হিসেবে ধারণ করা হয় এবং ভিডিও ফ্রেমের পাশাপাশি আপস্ট্রিমে পাঠানো হয়।

- প্রতিনিধি প্রেরণ (A2A): ডিসপ্যাচ আপনার অভিপ্রায় "শুনতে" পায়। এটি বুঝতে পারে যে এর কাছে নকশা বা স্কিম্যাটিকস নেই, তাই এটি

AgentTool(Agent-as-a-Tool) প্রোটোকল ব্যবহার করে আর্কিটেক্ট এজেন্টকে কল করে। - তথ্য পুনরুদ্ধার: আর্কিটেক্ট রেডিস ডাটাবেসে কোয়েরি করে এবং পার্ট লিস্টটি ডিসপ্যাচকে ফেরত পাঠায়। ডিসপ্যাচ "সেশনের মাস্টার" হিসেবেই থাকে এবং আপনাকে হস্তান্তর না করেই ডেটা গ্রহণ করে।

- তথ্যমূলক ডাউনস্ট্রিম: ডিসপ্যাচ টেক্সট এবং নেটিভ অডিও উভয়ই সম্বলিত একটি

modelTurn(ডাউনস্ট্রিম) পাঠায়: "স্থপতি নিশ্চিত করেছেন। প্রয়োজনীয় সাবসেটটি হলো: ওয়ার্প কোর, ফ্লাক্স পাইপ, আয়ন থ্রাস্টার।" - সংকট: হঠাৎ, ওয়ার্কবেঞ্চের একটি যন্ত্রাংশ অস্থিতিশীল হয়ে পড়ে এবং সাদা আলোয় জ্বলতে শুরু করে।

- স্বয়ংক্রিয় সনাক্তকরণ: ব্যাকগ্রাউন্ডে থাকা

monitor_for_hazardলুপটি (সেন্টিনেল) আভা ধারণকারী নির্দিষ্ট JPEG ফ্রেমটি শনাক্ত করে। এটি 'জেমিনি'-কে কল করার মাধ্যমে ফ্রেমটি প্রসেস করে এবং বিপদটি সনাক্ত করে। - ডাউনস্ট্রিম নিরাপত্তা: স্ট্রিমিং টুলটি একটি ফলাফল

yields। যেহেতু এটি একটি বিডি-স্ট্রিমিং এজেন্ট, ডিসপ্যাচ এর বর্তমান অবস্থা থামিয়ে দিয়ে অবিলম্বে ডাউনস্ট্রিমে একটি গুরুতর নিরাপত্তা সতর্কতা পাঠাতে পারে: "বিপদ শনাক্ত হয়েছে! এখন ডেটা ক্রিস্টালটি নিষ্ক্রিয় করা হচ্ছে। এটিকে RED বিনে সরান।"

এজেন্টের রানটাইম কনফিগারেশন সেট করা

ADK-এর RunConfig একটি এজেন্টের আচরণের বিস্তারিত কনফিগারেশনের সুযোগ দেয়, যার মধ্যে অন্তর্ভুক্ত রয়েছে এটি কীভাবে স্ট্রিমিং ডেটা পরিচালনা করে এবং বিভিন্ন মোডালিটির সাথে ইন্টারঅ্যাক্ট করে।

রিয়েল-টাইম, দ্বিমুখী যোগাযোগের জন্য streaming_mode BIDI তে সেট করা হয়, যা ব্যবহারকারী এবং এজেন্ট উভয়কেই একই সাথে কথা বলতে এবং শুনতে দেয়। response_modalities প্যারামিটারটি নির্ধারণ করে যে এজেন্ট কী ধরনের আউটপুট তৈরি করতে পারে, যেমন ভয়েস এবং টেক্সট। input_audio_transcription কনফিগার করে যে এজেন্ট কীভাবে ব্যবহারকারীর আগত কথা প্রক্রিয়া এবং প্রতিলিপি করবে। আরও স্থিতিশীল অভিজ্ঞতা তৈরি করতে, session_resumption এজেন্টকে কথোপকথনের প্রেক্ষাপট মনে রাখতে এবং সংযোগ বিচ্ছিন্ন হয়ে গেলে পুনরায় শুরু করতে সক্ষম করে। সবশেষে, proactivity এজেন্টকে ব্যবহারকারীর সরাসরি কমান্ড ছাড়াই কাজ বা কথা শুরু করার অনুমতি দেয়, যেমন স্বতঃস্ফূর্তভাবে বিপদের সতর্কতা জারি করা, অন্যদিকে enable_affective_dialog এজেন্টকে আরও স্বাভাবিক এবং সহানুভূতিশীল প্রতিক্রিয়া তৈরি করতে সাহায্য করে। আপনি এখানে ADK-এর RunConfig সম্পর্কে আরও জানতে পারেন।

👉✏️ আপনার $HOME/way-back-home/level_4/backend/main.py ফাইলে থাকা #REPLACE_RUN_CONFIG প্লেসহোল্ডারটি খুঁজুন এবং এটিকে নিম্নলিখিত ডিসেকশন লজিক দিয়ে প্রতিস্থাপন করুন:

run_config = RunConfig(

streaming_mode=StreamingMode.BIDI,

response_modalities=response_modalities,

input_audio_transcription=types.AudioTranscriptionConfig(),

output_audio_transcription=types.AudioTranscriptionConfig(),

session_resumption=types.SessionResumptionConfig(),

proactivity=(

types.ProactivityConfig(proactive_audio=True) if proactivity else None

),

enable_affective_dialog=affective_dialog if affective_dialog else None,

)

এজেন্টের কাছে অনুরোধ বাস্তবায়ন করা

এরপরে, আমরা মূল কমিউনিকেশন আপলিঙ্কটি বাস্তবায়ন করব, যা ব্যবহারকারীর ভলাটাইল ওয়ার্কবেঞ্চ থেকে একটি ওয়েবসকেটের মাধ্যমে ডিসপ্যাচ এজেন্টের কাছে রিয়েল-টাইম, মাল্টিমোডাল ডেটা স্ট্রিম করবে। এর ফলে এজেন্ট ক্রমাগত "দেখতে" (ভিডিও ফ্রেম) এবং "শুনতে" (ভয়েস কমান্ড) পারবে। এই লজিকটি ক্রমাগত ডেটা স্ট্রিম গ্রহণ করে, আগত বাইনারি অডিও চাঙ্ক এবং JSON-এ মোড়ানো টেক্সট/ইমেজ প্যাকেটের মধ্যে পার্থক্য করে, এবং সেগুলোকে Blob (মাল্টিমিডিয়ার জন্য) বা Content (টেক্সটের জন্য) অবজেক্টে এনক্যাপসুলেট করে দ্বিমুখী এজেন্ট সেশনটি চালু রাখার জন্য LiveRequestQueue-তে পাঠিয়ে দেয়।

আপনার $HOME/way-back-home/level_4/backend/main.py ফাইলে #PROCESS_AGENT_REQUEST প্লেসহোল্ডারটি খুঁজুন এবং এটিকে নিম্নলিখিত ডিসেকশন লজিক দিয়ে প্রতিস্থাপন করুন:

# Start the loop

try:

while True:

# Receive message from WebSocket (text or binary)

message = await websocket.receive()

# Handle binary frames (audio data)

if "bytes" in message:

audio_data = message["bytes"]

audio_blob = types.Blob(

mime_type="audio/pcm;rate=16000", data=audio_data

)

live_request_queue.send_realtime(audio_blob)

# Handle text frames (JSON messages)

elif "text" in message:

text_data = message["text"]

json_message = json.loads(text_data)

# Extract text from JSON and send to LiveRequestQueue

if json_message.get("type") == "text":

logger.info(f"User says: {json_message['text']}")

content = types.Content(

parts=[types.Part(text=json_message["text"])]

)

live_request_queue.send_content(content)

# Handle audio data (microphone)

elif json_message.get("type") == "audio":

# logger.info("Received AUDIO packet") # Uncomment for verbose debugging

import base64

# Decode base64 audio data

audio_data = base64.b64decode(json_message.get("data", ""))

# logger.info(f"Received Audio Chunk: {len(audio_data)} bytes")

import math

import struct

# Calculate RMS to debug silence

count = len(audio_data) // 2

shorts = struct.unpack(f"<{count}h", audio_data)

sum_squares = sum(s*s for s in shorts)

rms = math.sqrt(sum_squares / count) if count > 0 else 0

# logger.info(f"RMS: {rms:.2f} | Bytes: {len(audio_data)}")

# Send to Live API as PCM 16kHz

audio_blob = types.Blob(

mime_type="audio/pcm;rate=16000",

data=audio_data

)

live_request_queue.send_realtime(audio_blob)

# Handle image data

elif json_message.get("type") == "image":

import base64

# Decode base64 image data

image_data = base64.b64decode(json_message["data"])

# logger.info(f"Received Image Frame: {len(image_data)} bytes")

mime_type = json_message.get("mimeType", "image/jpeg")

# Send image as blob

image_blob = types.Blob(mime_type=mime_type, data=image_data)

live_request_queue.send_realtime(image_blob)

frame_count += 1

finally:

pass

মাল্টিমোডাল ডেটা এখন এজেন্টের কাছে পাঠানো হচ্ছে।

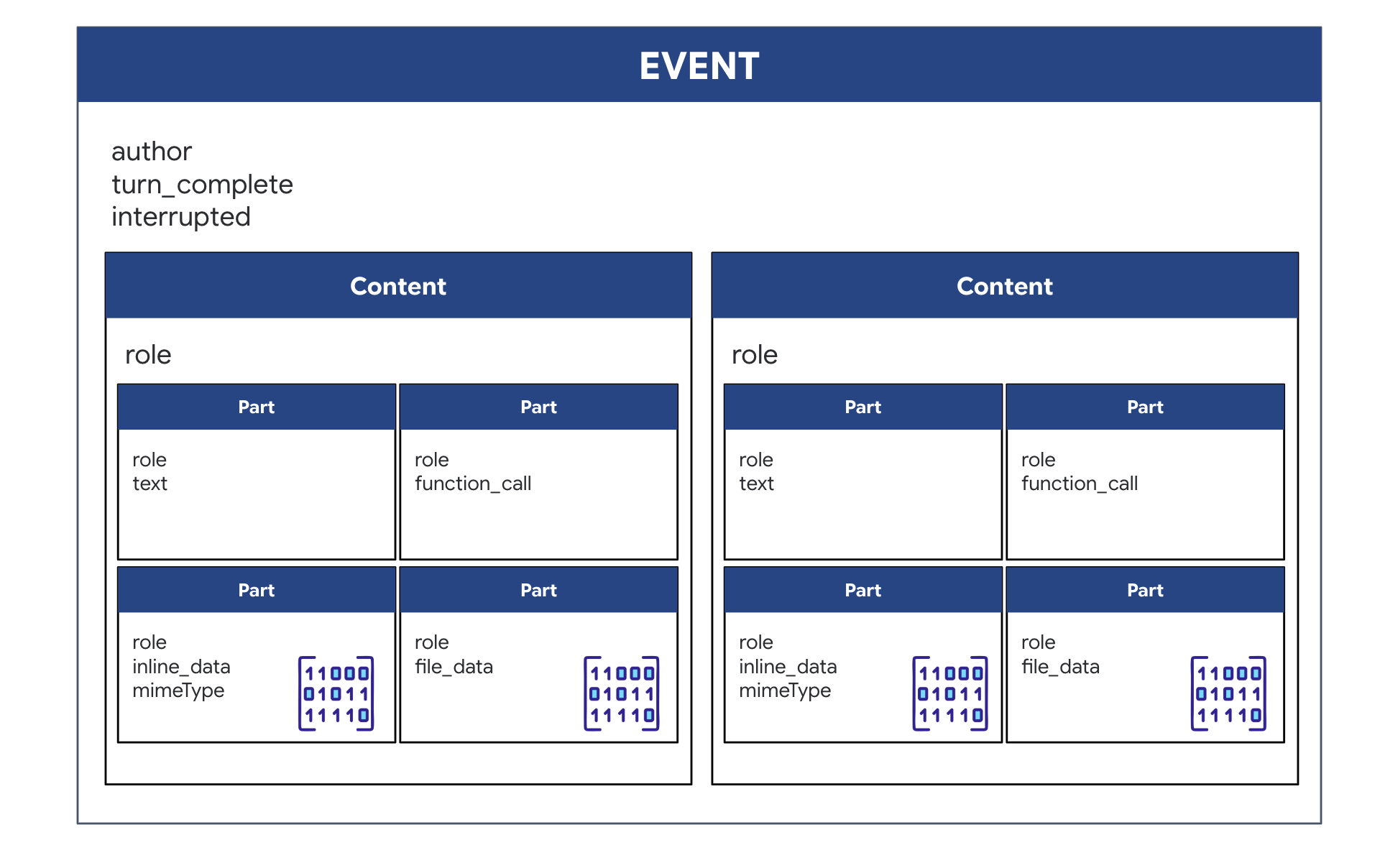

প্রতিক্রিয়া বাস্তবায়ন: ডাউনস্ট্রিম ইভেন্ট ডেটা স্ট্রাকচার

যখন আপনি ADK-এর সাথে একটি দ্বিমুখী (লাইভ) এজেন্ট চালান, তখন এজেন্ট থেকে ফিরে আসা ডেটা একটি নির্দিষ্ট ধরণের Event- এ প্যাকেজ করা হয়, যা কোর GenAI SDK স্ট্রাকচার থেকে ইনহেরিট করে। আপনার async for event in runner.run_live(...) লুপে আপনি যে Event অবজেক্টটি পান, সেটি একটি একক অবজেক্ট, যাতে বিভিন্ন ধরণের তথ্যের জন্য বেশ কয়েকটি ঐচ্ছিক ফিল্ড থাকে:

বিষয়বস্তুর গঠনশৈলী:

- যখন এজেন্ট কথা বলে (

.server_contentএর মাধ্যমে ): ফিল্ডটি শুধু সাধারণ টেক্সট নয়। এতেParts-এর একটি তালিকা থাকে। প্রতিটিPartএক ধরনের ডেটার ধারক—হয় একটি টেক্সট স্ট্রিং (যেমন"The part is stable.") অথবা একটি কাঁচা অডিও ব্লব (কণ্ঠস্বর)। - যখন এজেন্ট কাজ করে (via

.tool_call): এই ফিল্ডটিতেFunctionCallঅবজেক্টের একটি তালিকা থাকে। প্রতিটিFunctionCallহলো একটি সরল, সুগঠিত অবজেক্ট যা টুলের নাম এবং ইনপুট আর্গুমেন্টগুলোকে এমন একটি পরিচ্ছন্ন ফরম্যাটে নির্দিষ্ট করে, যা আপনার ব্যাকএন্ড কোড সহজেই পড়তে ও কার্যকর করতে পারে।

👀 আপনি যদি run_live লুপ থেকে প্রাপ্ত একটিমাত্র Event দেখেন, event.model_dump(by_alias=True) দ্বারা তৈরি JSON-টি GenAI SDK-এর গঠন কঠোরভাবে অনুসরণ করে এইরকম দেখাবে:

{

"serverContent": { // <-- LiveServerMessageServerContent

"modelTurn": { // <-- ModelTurn

"parts": [ // <-- list[Part]

{

"text": "Architect Confirmed."

},

{

"inlineData": { // <-- Blob (Audio Bytes)

"mimeType": "audio/pcm;rate=24000",

"data": "BASE64_AUDIO_DATA..."

}

}

]

}

},

"toolCall": { // <-- LiveServerMessageToolCall

"functionCalls": [ // <-- list[FunctionCall]

{

"name": "neutralize_hazard",

"args": { "color": "RED" }

}

]

}

}

👉✏️ সম্পূর্ণ ইভেন্ট ডেটা ফরওয়ার্ড করার জন্য আমরা এখন main.py এর downstream_task আপডেট করব। এই লজিকটি নিশ্চিত করে যে AI-এর প্রতিটি "চিন্তা" জাহাজের ডায়াগনস্টিক টার্মিনালে লগ করা হয় এবং একটি একক JSON অবজেক্ট হিসেবে ফ্রন্টএন্ড UI-তে পাঠানো হয়।

আপনার $HOME/way-back-home/level_4/backend/main.py ফাইলে #PROCESS_AGENT_RESPONSE প্লেসহোল্ডারটি খুঁজুন এবং এটিকে নিম্নলিখিত ডিসেকশন লজিক দিয়ে প্রতিস্থাপন করুন:

# Suppress raw event logging

event_json = event.model_dump_json(exclude_none=True, by_alias=True)

# logger.info(f"raw_event: {event_json[:200]}...")

await websocket.send_text(event_json)

মিশন সম্পাদন

ব্যাকএন্ড ভল্ট সংযুক্ত এবং উভয় এজেন্ট কনফিগার করা হয়ে গেলে, সমস্ত সিস্টেম এখন মিশনের জন্য প্রস্তুত। নিম্নলিখিত ধাপগুলো সম্পূর্ণ অ্যাপ্লিকেশনটি চালু করবে, যা আপনাকে এইমাত্র তৈরি করা দুই-এজেন্ট সিস্টেমটির সাথে ইন্টারঅ্যাক্ট করার সুযোগ দেবে।

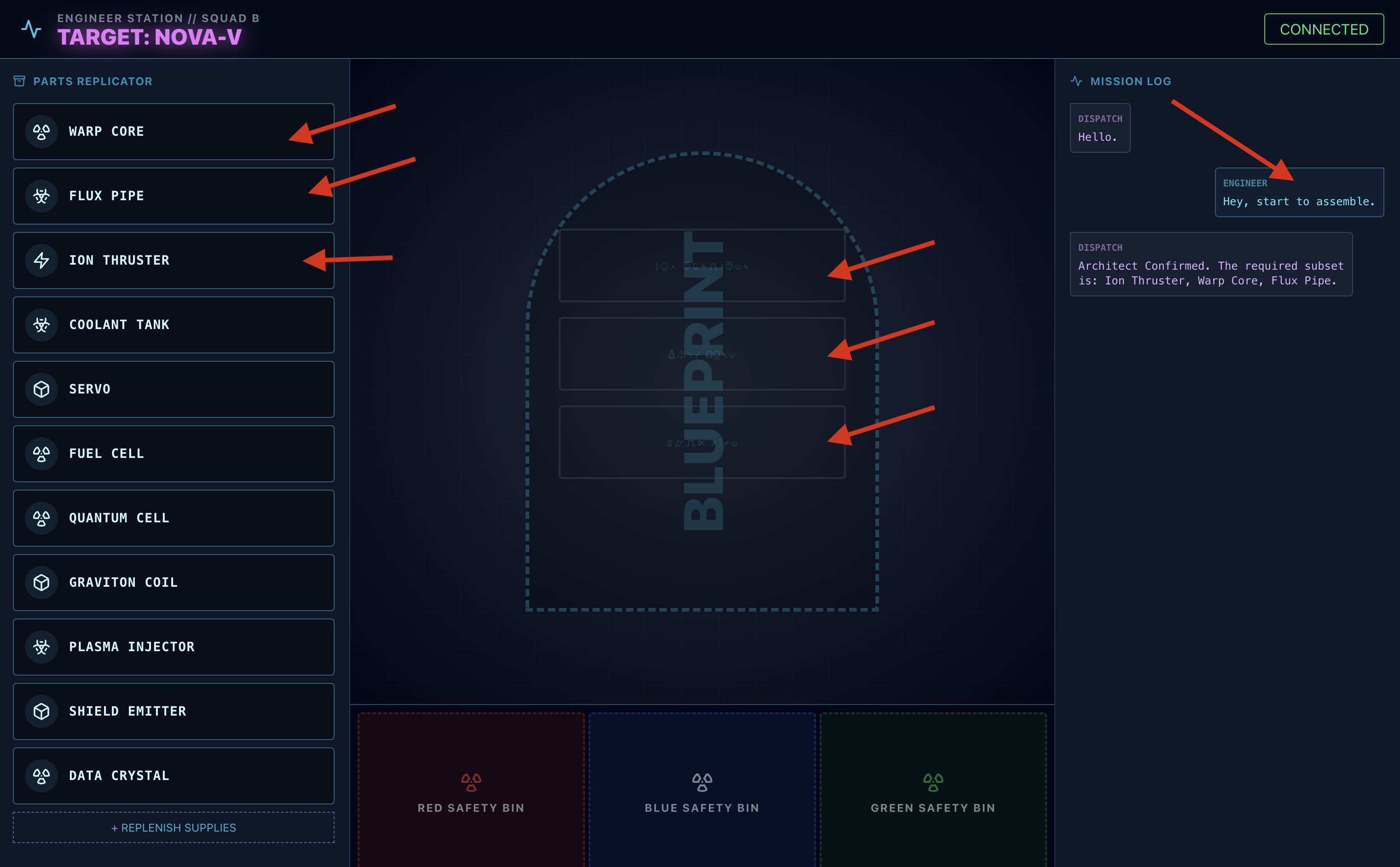

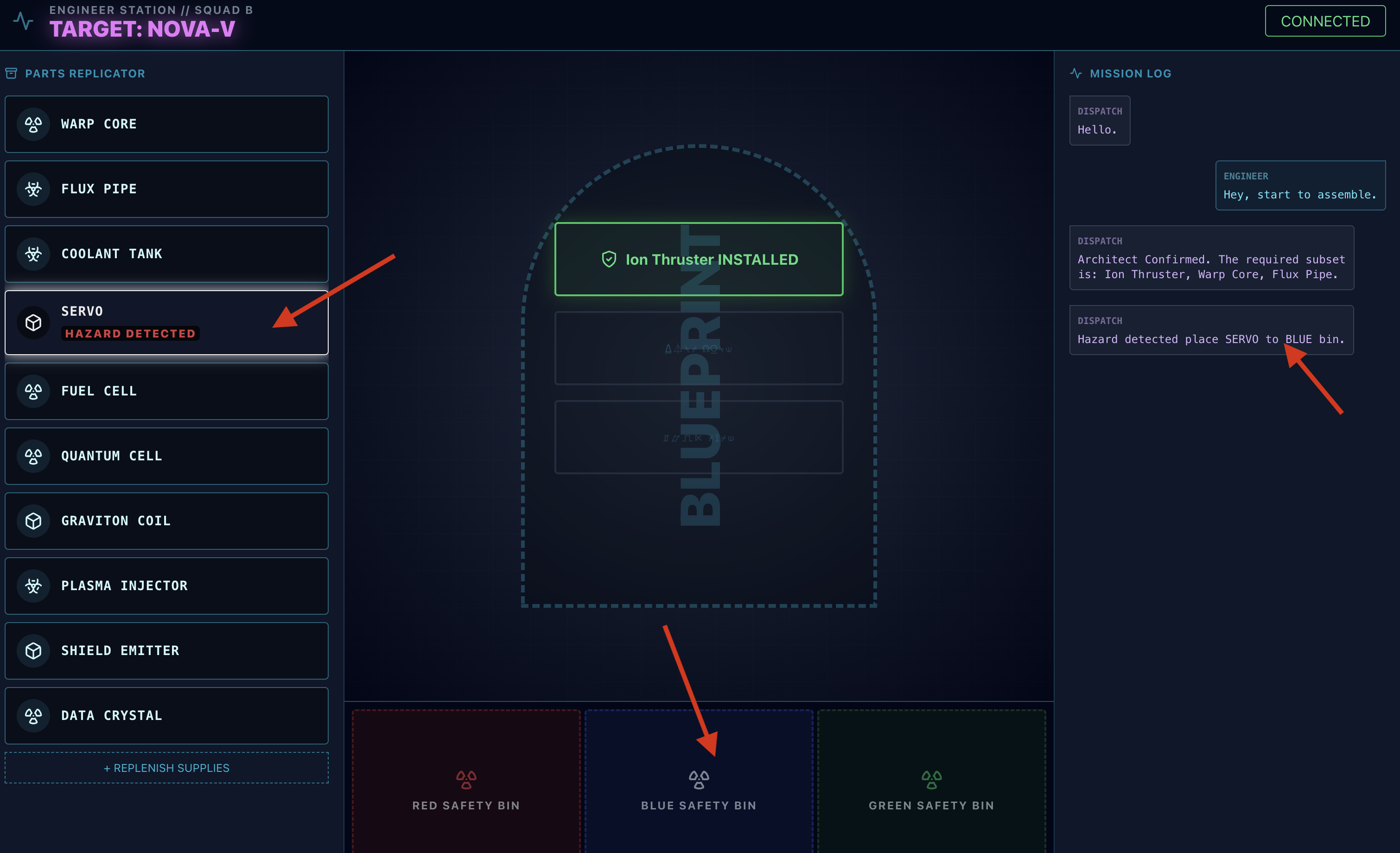

Objective: Assemble the randomly assigned warp drive that appears on your workbench. Protocol: You must follow the vocal guidance of the Dispatch Agent, especially the hazard warnings for specific components.

Activate the Specialist (The Architect)

👉💻 In your first terminal window , launch the Architect agent. This backend service will connect to the Redis vault and wait for schematic requests from the Dispatcher.

# Ensure you are in the backend directory

cd $HOME/way-back-home/level_4/

. scripts/check_redis.sh

cd $HOME/way-back-home/level_4/backend

# Start the A2A Server on Port 8081

uv run architect_agent/server.py

(Leave this terminal running. It is now your active "database agent.")

Launch the Cockpit (The Dispatcher)

👉💻 In a new terminal window (Terminal B), we will build the frontend UI and start the main Dispatch agent, which serves the user interface and handles all live communication.

# 1. Build the Frontend Assets

cd $HOME/way-back-home/level_4/frontend

npm install

npm run build

# 2. Launch the Main Application Server

cd $HOME/way-back-home/level_4/backend

cp architect_agent/.env .env

uv run main.py

(This starts the primary server on Port 8080.)

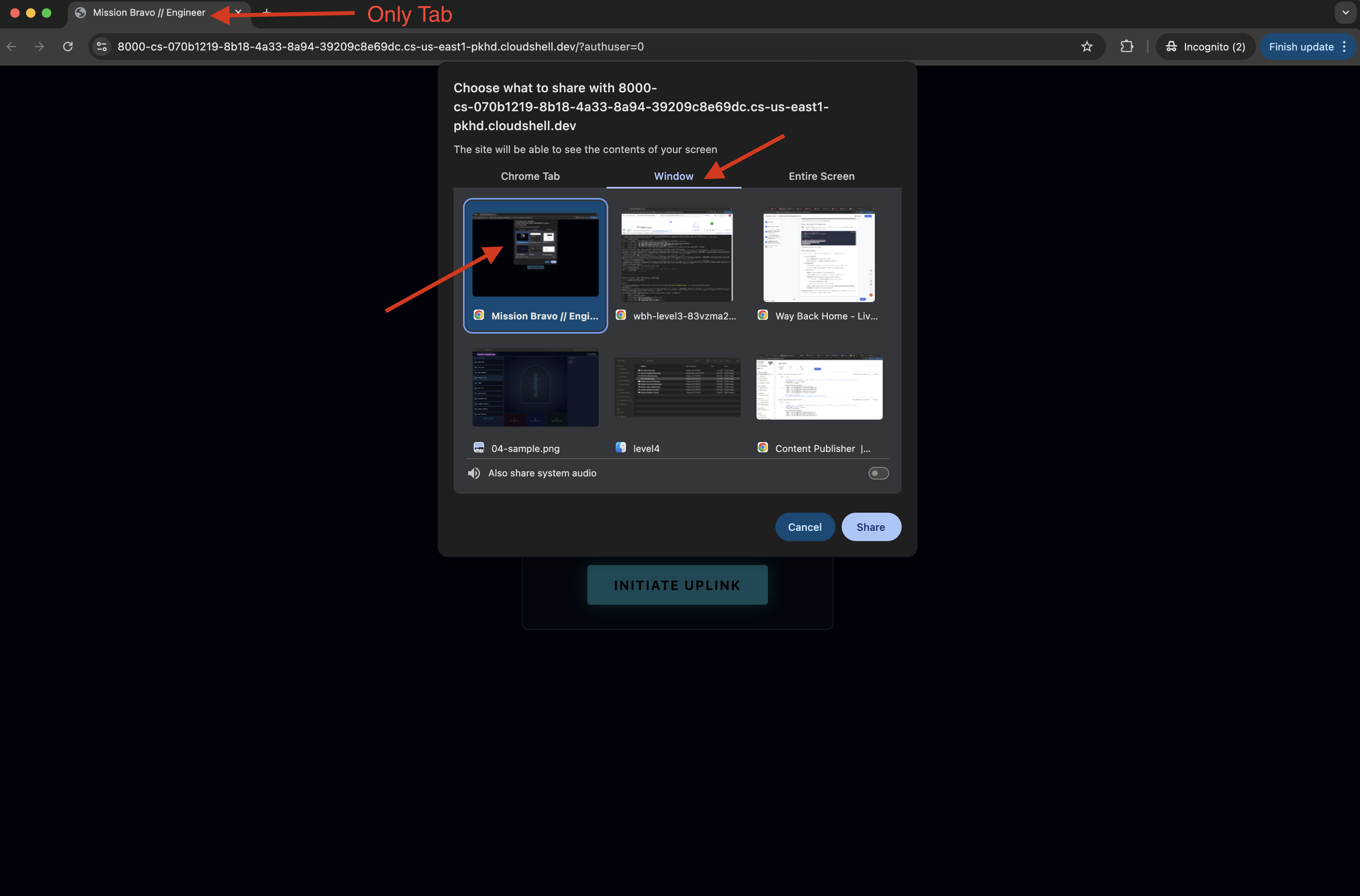

Run the Test Scenario

The system is now live. Your goal is to follow the agent's instructions to complete the assembly.

- 👉 Access the Workbench:

- Click the Web preview icon in the Cloud Shell toolbar.

- Select Change port , set it to 8080 , and click Change and Preview .

- 👉 Start the Mission:

- When the interface loads, make sure you allow it to access your screen and microphone.

- You will be ask to select a tab or a window to share, if you are sharing the window, to avoid problem, make sure this is the ONLY tab in the window.

- A drive with a random name (eg, "NOVA-V", "OMEGA-9") will be assigned to you.

- When the interface loads, make sure you allow it to access your screen and microphone.

- 👉 The Assembly Loop:

- Request: To start assembling the drive say: "Start assembling."

- Architect Respond: The agent will provide the correct parts to assemble the drive.

- Hazard Check: When a part appears to be hazardous on the workbench:

- The Dispatch agent's

monitor_for_hazardtool will visually identify it. - It will yield a "VISUAL HAZARD ALERT". (This will take about 30 sec)

- It will check which bin to use to disengage the hazard.

- The Dispatch agent's

- Action: The Dispatch Agent will give you a direct command: "Hazard Confirmed. Place XXX in the Red bin immediately." You must follow this instruction to proceed.

- Request: To start assembling the drive say: "Start assembling."

Mission Accomplished. You have successfully built an interactive, multi-agent system. The survivors are safe, the rocket has cleared the atmosphere, and your "Way Back Home" continues.

👉💻 Press Ctrl+c in both terminal to exit.

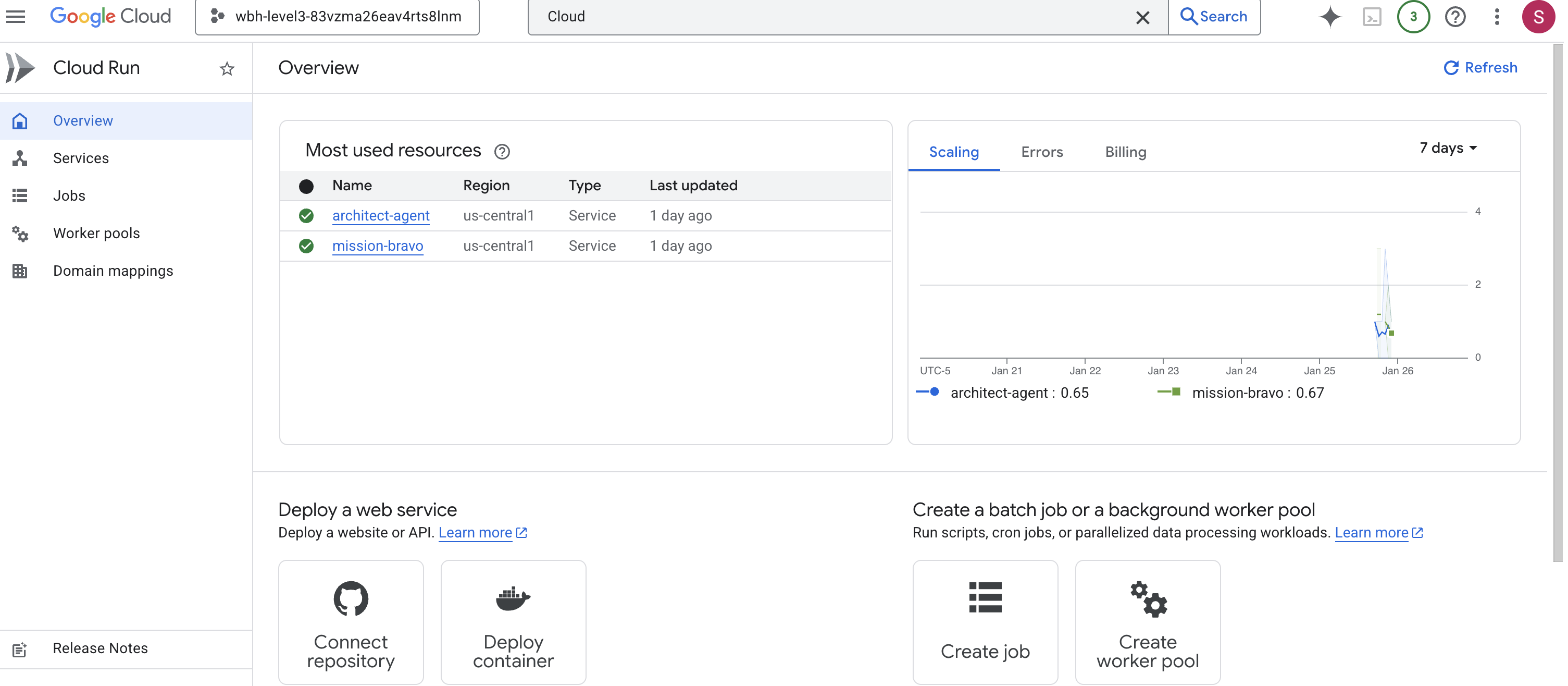

6. Deploy to Production (Optional)

You have successfully tested the agent locally. Now, we must upload the Architect's neural core to the ship's mainframes (Cloud Run). This will allow it to operate as a permanent, independent service that the Dispatch agent can query from anywhere.

Provision the Secure Vault (Infrastructure)

Before deploying the agent, we must create its persistent memory (Memorystore) and the secure channel to access it (VPC Connector).

👉💻 Create the Memorystore Instance (Redis Vault):

export REGION="us-central1"

gcloud redis instances create ozymandias-vault-prod --size=1 --tier=basic --region=${REGION}

👉💻 Retrieve the Vault's Network Address: Execute this command and copy the host IP address. This is the private address of your new Redis instance.

gcloud redis instances describe ozymandias-vault-prod --region=us-central1

👉💻 Create the VPC Access Connector (Secure Bridge): This connector acts as a private bridge, allowing Cloud Run to access the Redis instance inside your VPC.

export REGION="us-central1"

export SUBNET_NAME="vpc-connector-subnet"

export PROJECT_ID=$(gcloud config get-value project)

# Create the Dedicated Subnet ---

gcloud compute networks subnets create ${SUBNET_NAME} \

--network=default \

--region=${REGION} \

--range=192.168.1.0/28

gcloud compute networks vpc-access connectors create architect-connector \

--region ${REGION} \

--subnet ${SUBNET_NAME} \

--subnet-project ${PROJECT_ID} \

--min-instances 2 \

--max-instances 3 \

--machine-type f1-micro

👉💻 Load the data:

export REGION="us-central1"

export ZONE="us-central1-a"

export VM_NAME="redis-seeder-$(date +%s)"

export REDIS_IP=$(gcloud redis instances describe ozymandias-vault-prod --region=${REGION} | grep 'host:' | awk '{print $2}')

gcloud compute instances create ${VM_NAME} \

--zone=${ZONE} \

--machine-type=e2-micro \

--image-family=debian-11 \

--image-project=debian-cloud \

--quiet \

--metadata=startup-script='#! /bin/bash

# Install tools quietly

apt-get update > /dev/null

apt-get install -y redis-tools > /dev/null

# Run each command individually

redis-cli -h '"${REDIS_IP}"' DEL "HYPERION-X"

redis-cli -h '"${REDIS_IP}"' RPUSH "HYPERION-X" "Warp Core" "Flux Pipe" "Ion Thruster"

redis-cli -h '"${REDIS_IP}"' DEL "NOVA-V"

redis-cli -h '"${REDIS_IP}"' RPUSH "NOVA-V" "Ion Thruster" "Warp Core" "Flux Pipe"

redis-cli -h '"${REDIS_IP}"' DEL "OMEGA-9"

redis-cli -h '"${REDIS_IP}"' RPUSH "OMEGA-9" "Flux Pipe" "Ion Thruster" "Warp Core"

redis-cli -h '"${REDIS_IP}"' DEL "GEMINI-MK1"

redis-cli -h '"${REDIS_IP}"' RPUSH "GEMINI-MK1" "Coolant Tank" "Servo" "Fuel Cell"

redis-cli -h '"${REDIS_IP}"' DEL "APOLLO-13"

redis-cli -h '"${REDIS_IP}"' RPUSH "APOLLO-13" "Warp Core" "Coolant Tank" "Ion Thruster"

redis-cli -h '"${REDIS_IP}"' DEL "VORTEX-7"

redis-cli -h '"${REDIS_IP}"' RPUSH "VORTEX-7" "Quantum Cell" "Graviton Coil" "Plasma Injector"

redis-cli -h '"${REDIS_IP}"' DEL "CHRONOS-ALPHA"

redis-cli -h '"${REDIS_IP}"' RPUSH "CHRONOS-ALPHA" "Shield Emitter" "Data Crystal" "Quantum Cell"

redis-cli -h '"${REDIS_IP}"' DEL "NEBULA-Z"

redis-cli -h '"${REDIS_IP}"' RPUSH "NEBULA-Z" "Plasma Injector" "Flux Pipe" "Graviton Coil"

redis-cli -h '"${REDIS_IP}"' DEL "PULSAR-B"

redis-cli -h '"${REDIS_IP}"' RPUSH "PULSAR-B" "Data Crystal" "Servo" "Shield Emitter"

redis-cli -h '"${REDIS_IP}"' DEL "TITAN-PRIME"

redis-cli -h '"${REDIS_IP}"' RPUSH "TITAN-PRIME" "Ion Thruster" "Quantum Cell" "Warp Core"

# Signal that the script has finished

echo "SEEDING_COMPLETE"

'

# This command streams the logs and waits until grep finds our completion message.

# The -m 1 flag tells grep to exit after the first match.

gcloud compute instances tail-serial-port-output ${VM_NAME} --zone=${ZONE} | grep -m 1 "SEEDING_COMPLETE"

gcloud compute instances delete ${VM_NAME} --zone=${ZONE} --quiet

Deploy the Agent Application

Compile and Build Agent Image

👉💻 Navigate to the backend directory and create the dockerfile.

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export SERVICE_NAME=architect-agent

export IMAGE_PATH=gcr.io/${PROJECT_ID}/${SERVICE_NAME}

export VPC_CONNECTOR_NAME=architect-connector

export REDIS_IP=$(gcloud redis instances describe ozymandias-vault-prod --region=${REGION} | grep 'host:' | awk '{print $2}')

cd $HOME/way-back-home/level_4/backend/architect_agent

cp $HOME/way-back-home/level_4/requirements.txt requirements.txt

cat <<EOF > Dockerfile

# Use an official Python runtime as a parent image

FROM python:3.13-slim

# Set the working directory in the container

WORKDIR /app

# Copy the requirements file and install dependencies for THIS agent

COPY requirements.txt requirements.txt

RUN pip install --no-cache-dir -r requirements.txt

# Copy the rest of the architect's code (server.py, agent.py, etc.)

COPY . .

# Expose the port the architect server runs on

EXPOSE 8081

# Command to run the application

# This assumes your server file is named server.py and the FastAPI object is 'app'

CMD ["uvicorn", "server:app", "--host", "0.0.0.0", "--port", "8081"]

EOF

👉💻 Package the application into a container image.

cd $HOME/way-back-home/level_4/backend/architect_agent

export PROJECT_ID=$(gcloud config get-value project)

export SERVICE_NAME=architect-agent

export IMAGE_PATH=gcr.io/${PROJECT_ID}/${SERVICE_NAME}

export REGION=us-central1

# This should now print the full, correct path

echo "Verifying build path: ${IMAGE_PATH}"

gcloud builds submit . --tag ${IMAGE_PATH}

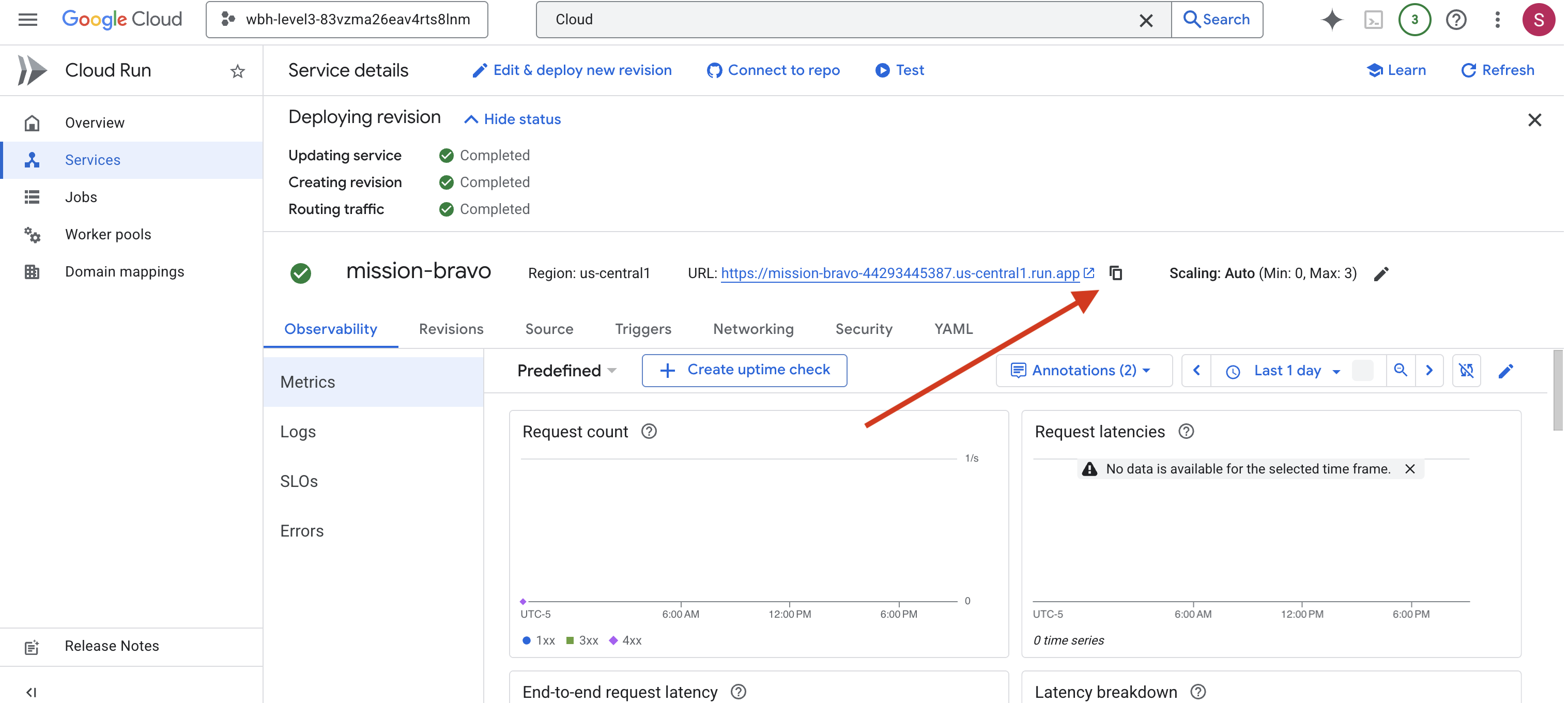

ক্লাউড রানে স্থাপন করুন

👉💻 Deploy the agent to Cloud Run. We will inject the Redis IP and link the VPC Connector directly into the launch command. This ensures the agent starts with a secure, private connection to its database.

cd $HOME/way-back-home/level_4/backend/architect_agent

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export SERVICE_NAME=architect-agent

export IMAGE_PATH=gcr.io/${PROJECT_ID}/${SERVICE_NAME}

export VPC_CONNECTOR_NAME=architect-connector

export REDIS_IP=$(gcloud redis instances describe ozymandias-vault-prod --region=${REGION} | grep 'host:' | awk '{print $2}')

export PROJECT_NUMBER=$(gcloud projects describe ${PROJECT_ID} --format="value(projectNumber)")

export PREDICTED_HOST="${SERVICE_NAME}-${PROJECT_NUMBER}.${REGION}.run.app"

export PROTOCOL=https

gcloud run deploy ${SERVICE_NAME} \

--image=${IMAGE_PATH} \

--platform=managed \

--region=${REGION} \

--port=8081 \

--allow-unauthenticated \

--labels=dev-tutorial=multi-modal \

--vpc-connector=${VPC_CONNECTOR_NAME} \

--vpc-egress=private-ranges-only \

--set-env-vars="REDIS_HOST=${REDIS_IP}" \

--set-env-vars="GOOGLE_GENAI_USE_VERTEXAI=True" \

--set-env-vars="MODEL_ID=gemini-2.5-flash" \

--set-env-vars="GOOGLE_CLOUD_PROJECT=${PROJECT_ID}" \

--set-env-vars="HOST_URL=${PREDICTED_HOST}" \

--set-env-vars="PROTOCOL=${PROTOCOL}" \

--set-env-vars="A2A_PORT=443"

👉💻 Verify if the A2A server is running.

export REGION=us-central1

export ARCHITECT_AGENT_URL=$(gcloud run services describe architect-agent --platform managed --region ${REGION} --format 'value(status.url)')

curl -s ${ARCHITECT_AGENT_URL}/.well-known/agent.json | jq

Once the command finishes, you will see a Service URL . The Architect Agent is now live in the cloud, permanently connected to its vault and ready to serve schematic data to other agents.

Deploy Dispatch Hub to Production Mainframe

With the Architect Agent operational in the cloud, we must now deploy the Dispatch Hub. This agent will serve as the primary user interface, handling live voice/video streams and delegating database queries to the Architect's secure endpoint.

👉💻 Run the following command in your Cloud Shell terminal. It will create the complete, multi-stage Dockerfile in your backend directory.

cd $HOME/way-back-home/level_4

cat <<EOF > Dockerfile

# STAGE 1: Build the React Frontend

# This stage uses a Node.js container to build the static frontend assets.

FROM node:20-slim as builder

# Set the working directory for our build process

WORKDIR /app

# Copy the frontend's package files first to leverage Docker's layer caching.

COPY frontend/package*.json ./frontend/

# Run 'npm install' from the context of the 'frontend' subdirectory

RUN npm --prefix frontend install

# Copy the rest of the frontend source code

COPY frontend/ ./frontend/

# Run the build script, which will create the 'frontend/dist' directory

RUN npm --prefix frontend run build

# STAGE 2: Build the Python Production Image

# This stage creates the final, lean container with our Python app and the built frontend.

FROM python:3.13-slim

# Set the final working directory

WORKDIR /app

# Install uv, our fast package manager

RUN pip install uv

# Copy the requirements.txt from the root of our build context

COPY requirements.txt .

# Install the Python dependencies

RUN uv pip install --no-cache-dir --system -r requirements.txt

# Copy the entire backend directory into the container

COPY backend/ ./backend/

# CRITICAL STEP: Copy the built frontend assets from the 'builder' stage.

# The source is the '/app/frontend/dist' directory from Stage 1.

# The destination is './frontend/dist', which matches the exact relative path

# your backend/main.py script expects to find.

COPY --from=builder /app/frontend/dist ./frontend/dist/

# Cloud Run injects a PORT environment variable, which your main.py already uses.

# We expose 8000 as a standard practice.

EXPOSE 8000

# Set the command to run the application.

# We specify the full path to the Python script.

CMD ["python", "backend/main.py"]

EOF

Compile and Build Agent/Frontend Image

👉💻 Navigate to the backend directory containing the Dispatch agent's code ( main.py ) and package it into a container image.

cd $HOME/way-back-home/level_4

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export SERVICE_NAME=mission-bravo

export IMAGE_PATH=gcr.io/${PROJECT_ID}/${SERVICE_NAME}

# This assumes your dispatch agent server (main.py) is in the backend folder

gcloud builds submit . --tag ${IMAGE_PATH}

ক্লাউড রানে স্থাপন করুন

👉💻 Deploy the Dispatch Hub to Cloud Run. We will inject the Architect's URL as an environment variable, creating the critical link between our two cloud-native agents.

export PROJECT_ID=$(gcloud config get-value project)

export REGION=us-central1

export SERVICE_NAME=mission-bravo

export AGENT_SERVICE_NAME=architect-agent

export IMAGE_PATH=gcr.io/${PROJECT_ID}/${SERVICE_NAME}

export PROJECT_NUMBER=$(gcloud projects describe ${PROJECT_ID} --format="value(projectNumber)")

export ARCHITECT_AGENT_URL="https://${AGENT_SERVICE_NAME}-${PROJECT_NUMBER}.${REGION}.run.app"

gcloud run deploy ${SERVICE_NAME} \

--image=${IMAGE_PATH} \

--platform=managed \

--region=${REGION} \

--port=8080 \

--labels=dev-tutorial=multi-modal \

--allow-unauthenticated \

--set-env-vars="ARCHITECT_URL=${ARCHITECT_AGENT_URL}" \

--set-env-vars="GOOGLE_GENAI_USE_VERTEXAI=True" \

--set-env-vars="MODEL_ID=gemini-live-2.5-flash-native-audio" \

--set-env-vars="GOOGLE_CLOUD_PROJECT=${PROJECT_ID}" \

--set-env-vars="GOOGLE_CLOUD_LOCATION=${REGION}"

Once the command finishes, you will see a Service URL (eg, https://mission-bravo-...run.app ). The application is now live in the cloud.

👉 Go to the Google Cloud Run page and select the biometric-scout service from the list.

👉 Locate the Public URL displayed at the top of the Service details page.

Final Systems Check (End-to-End Test)

👉 Now you will interact with the live system.

- Get the URL: Copy the Service URL from the output of the last deployment command (it should end with

run.app). - Open the Cockpit: Paste the URL into your web browser.

- Initiate Contact: When the interface loads, make sure you allow it to access your screen and microphone.

- Request Data: When a drive is assigned, ask to start assembling. For example: "Start to assemble"

You are now interacting with a fully deployed, multi-agent system running entirely on Google Cloud.

The Multi-agent system locks the final containment ring into place, and the erratic radiation flatlines into a steady hum.

"Warp Drive: STABILIZED. Rescue Craft: ENGINES IGNITED."

On your monitor, the alien ship streaks upward, narrowly escaping the crumbling surface of Ozymandias as the atmosphere collapses. It settles into a safe orbit alongside your vessel, and the comms fill with the voices of the survivors—shaken but alive. With the rescue complete and your path home clear, the remote link severs.

Thanks to you, the survivors are rescued.

If you participated in Level 0, don't forget to check where your progress is on the way back home mission!