1. Descripción general

La API de Text-to-Speech permite que los desarrolladores generen voces similares a las humanas. La API convierte texto en formatos de audio, como WAV, MP3 o Ogg Opus. También admite entradas de Lenguaje de marcado de síntesis de voz (SSML) para especificar pausas, números, formatos de fecha y hora, y otras instrucciones de pronunciación.

En este instructivo, te enfocarás en usar la API de Text-to-Speech con Python.

Qué aprenderás

- Cómo configurar tu entorno

- Cómo enumerar los idiomas compatibles

- Cómo enumerar las voces disponibles

- Cómo sintetizar audio a partir de texto

Requisitos

Encuesta

¿Cómo usarás este instructivo?

¿Cómo calificarías tu experiencia en Python?

¿Cómo calificarías tu experiencia con los servicios de Google Cloud?

2. Configuración y requisitos

Configuración del entorno de autoaprendizaje

- Accede a Google Cloud Console y crea un proyecto nuevo o reutiliza uno existente. Si aún no tienes una cuenta de Gmail o de Google Workspace, debes crear una.

- El Nombre del proyecto es el nombre visible de los participantes de este proyecto. Es una cadena de caracteres que no se utiliza en las APIs de Google. Puedes actualizarla cuando quieras.

- El ID del proyecto es único en todos los proyectos de Google Cloud y es inmutable (no se puede cambiar después de configurarlo). La consola de Cloud genera automáticamente una cadena única. Por lo general, no importa cuál sea. En la mayoría de los codelabs, deberás hacer referencia al ID de tu proyecto (suele identificarse como

PROJECT_ID). Si no te gusta el ID que se generó, podrías generar otro aleatorio. También puedes probar uno propio y ver si está disponible. No se puede cambiar después de este paso y se usa el mismo durante todo el proyecto. - Recuerda que hay un tercer valor, un número de proyecto, que usan algunas APIs. Obtén más información sobre estos tres valores en la documentación.

- A continuación, deberás habilitar la facturación en la consola de Cloud para usar las APIs o los recursos de Cloud. Ejecutar este codelab no costará mucho, tal vez nada. Para cerrar recursos y evitar que se generen cobros más allá de este instructivo, puedes borrar los recursos que creaste o borrar el proyecto. Los usuarios nuevos de Google Cloud son aptos para participar en el programa Prueba gratuita de $300.

Inicia Cloud Shell

Si bien Google Cloud se puede operar de manera remota desde tu laptop, en este codelab usarás Cloud Shell, un entorno de línea de comandos que se ejecuta en la nube.

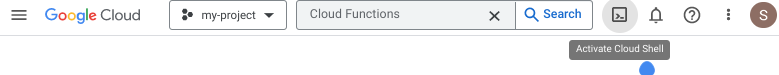

Activar Cloud Shell

- En la consola de Cloud, haz clic en Activar Cloud Shell

.

.

Si es la primera vez que inicias Cloud Shell, aparecerá una pantalla intermedia en la que se describirá qué es. Si apareció una pantalla intermedia, haz clic en Continuar.

El aprovisionamiento y la conexión a Cloud Shell solo tomará unos minutos.

Esta máquina virtual está cargada con todas las herramientas de desarrollo necesarias. Ofrece un directorio principal persistente de 5 GB y se ejecuta en Google Cloud, lo que permite mejorar considerablemente el rendimiento de la red y la autenticación. Gran parte de tu trabajo en este codelab, si no todo, se puede hacer con un navegador.

Una vez que te conectes a Cloud Shell, deberías ver que te autenticaste y que el proyecto se configuró con tu ID del proyecto.

- En Cloud Shell, ejecuta el siguiente comando para confirmar que tienes la autenticación:

gcloud auth list

Resultado del comando

Credentialed Accounts

ACTIVE ACCOUNT

* <my_account>@<my_domain.com>

To set the active account, run:

$ gcloud config set account `ACCOUNT`

- En Cloud Shell, ejecuta el siguiente comando para confirmar que el comando gcloud conoce tu proyecto:

gcloud config list project

Resultado del comando

[core] project = <PROJECT_ID>

De lo contrario, puedes configurarlo con el siguiente comando:

gcloud config set project <PROJECT_ID>

Resultado del comando

Updated property [core/project].

3. Configuración del entorno

Antes de poder comenzar a usar la API de Text-to-Speech, ejecuta el siguiente comando en Cloud Shell para habilitar la API:

gcloud services enable texttospeech.googleapis.com

Deberías ver algo como esto:

Operation "operations/..." finished successfully.

Ahora puedes usar la API de Text-to-Speech.

Navega a tu directorio principal:

cd ~

Crea un entorno virtual de Python para aislar las dependencias:

virtualenv venv-texttospeech

Activa el entorno virtual:

source venv-texttospeech/bin/activate

Instala IPython y la biblioteca cliente de la API de Text-to-Speech:

pip install ipython google-cloud-texttospeech

Deberías ver algo como esto:

... Installing collected packages: ..., ipython, google-cloud-texttospeech Successfully installed ... google-cloud-texttospeech-2.16.3 ...

Ya puedes usar la biblioteca cliente de la API de Text-to-Speech.

En los siguientes pasos, usarás un intérprete de Python interactivo llamado IPython, que instalaste en el paso anterior. Inicia una sesión ejecutando ipython en Cloud Shell:

ipython

Deberías ver algo como esto:

Python 3.9.2 (default, Feb 28 2021, 17:03:44) Type 'copyright', 'credits' or 'license' for more information IPython 8.18.1 -- An enhanced Interactive Python. Type '?' for help. In [1]:

Ya puedes realizar tu primera solicitud y enumerar los idiomas admitidos…

4. Obtén una lista de los idiomas compatibles

En esta sección, obtendrás la lista de todos los idiomas admitidos.

Copia el siguiente código en tu sesión de IPython:

from typing import Sequence

import google.cloud.texttospeech as tts

def unique_languages_from_voices(voices: Sequence[tts.Voice]):

language_set = set()

for voice in voices:

for language_code in voice.language_codes:

language_set.add(language_code)

return language_set

def list_languages():

client = tts.TextToSpeechClient()

response = client.list_voices()

languages = unique_languages_from_voices(response.voices)

print(f" Languages: {len(languages)} ".center(60, "-"))

for i, language in enumerate(sorted(languages)):

print(f"{language:>10}", end="\n" if i % 5 == 4 else "")

Tómate un momento para estudiar el código y ver cómo usa el método de la biblioteca cliente list_voices para compilar la lista de idiomas admitidos.

Llama a la función:

list_languages()

Deberías obtener la siguiente lista (o una más grande):

---------------------- Languages: 58 -----------------------

af-ZA am-ET ar-XA bg-BG bn-IN

ca-ES cmn-CN cmn-TW cs-CZ da-DK

de-DE el-GR en-AU en-GB en-IN

en-US es-ES es-US eu-ES fi-FI

fil-PH fr-CA fr-FR gl-ES gu-IN

he-IL hi-IN hu-HU id-ID is-IS

it-IT ja-JP kn-IN ko-KR lt-LT

lv-LV ml-IN mr-IN ms-MY nb-NO

nl-BE nl-NL pa-IN pl-PL pt-BR

pt-PT ro-RO ru-RU sk-SK sr-RS

sv-SE ta-IN te-IN th-TH tr-TR

uk-UA vi-VN yue-HK

En la lista, se muestran 58 idiomas y variantes, como los siguientes:

- Chino y mandarín taiwanés

- Inglés australiano, británico, indio y estadounidense

- Francés de Canadá y Francia

- Portugués de Brasil y Portugal

Esta lista no es fija y crece a medida que hay nuevas voces disponibles.

Resumen

Este paso te permitió enumerar los idiomas admitidos.

5. Enumera las voces disponibles

En esta sección, obtendrás la lista de voces disponibles en diferentes idiomas.

Copia el siguiente código en tu sesión de IPython:

import google.cloud.texttospeech as tts

def list_voices(language_code=None):

client = tts.TextToSpeechClient()

response = client.list_voices(language_code=language_code)

voices = sorted(response.voices, key=lambda voice: voice.name)

print(f" Voices: {len(voices)} ".center(60, "-"))

for voice in voices:

languages = ", ".join(voice.language_codes)

name = voice.name

gender = tts.SsmlVoiceGender(voice.ssml_gender).name

rate = voice.natural_sample_rate_hertz

print(f"{languages:<8} | {name:<24} | {gender:<8} | {rate:,} Hz")

Dedica un momento a estudiar el código y observa cómo usa el método de la biblioteca cliente list_voices(language_code) para enumerar las voces disponibles para un idioma determinado.

Ahora, obtén la lista de voces en alemán disponibles:

list_voices("de")

Deberías ver algo como esto:

------------------------ Voices: 20 ------------------------ de-DE | de-DE-Neural2-A | FEMALE | 24,000 Hz de-DE | de-DE-Neural2-B | MALE | 24,000 Hz ... de-DE | de-DE-Standard-A | FEMALE | 24,000 Hz de-DE | de-DE-Standard-B | MALE | 24,000 Hz ... de-DE | de-DE-Studio-B | MALE | 24,000 Hz de-DE | de-DE-Studio-C | FEMALE | 24,000 Hz de-DE | de-DE-Wavenet-A | FEMALE | 24,000 Hz de-DE | de-DE-Wavenet-B | MALE | 24,000 Hz ...

Hay varias voces femeninas y masculinas disponibles, así como voces estándar, WaveNet, Neural2 y Studio:

- Las voces estándar se generan con algoritmos de procesamiento de señales.

- Las voces generadas por WaveNet, Neural2 y Studio son de mayor calidad, se sintetizan con modelos de aprendizaje automático y suenan más naturales.

Ahora, obtén la lista de voces en inglés disponibles:

list_voices("en")

Deberías obtener un resultado similar a este:

------------------------ Voices: 90 ------------------------ en-AU | en-AU-Neural2-A | FEMALE | 24,000 Hz ... en-AU | en-AU-Wavenet-A | FEMALE | 24,000 Hz ... en-GB | en-GB-Neural2-A | FEMALE | 24,000 Hz ... en-GB | en-GB-Wavenet-A | FEMALE | 24,000 Hz ... en-IN | en-IN-Standard-A | FEMALE | 24,000 Hz ... en-IN | en-IN-Wavenet-A | FEMALE | 24,000 Hz ... en-US | en-US-Neural2-A | MALE | 24,000 Hz ... en-US | en-US-News-K | FEMALE | 24,000 Hz ... en-US | en-US-Standard-A | MALE | 24,000 Hz ... en-US | en-US-Studio-M | MALE | 24,000 Hz ... en-US | en-US-Wavenet-A | MALE | 24,000 Hz ...

Además de una selección de varias voces con diferentes géneros y calidades, hay varios acentos disponibles: inglés australiano, británico, indio y estadounidense.

Dedica un momento a enumerar las voces disponibles para tus idiomas y variantes preferidos (o incluso todos):

list_voices("fr")

list_voices("pt")

list_voices()

Resumen

Este paso te permitió enumerar las voces disponibles. Obtén más información sobre los idiomas y las voces compatibles.

6. Sintetiza audio a partir de texto

Puedes usar la API de Text-to-Speech para convertir una cadena en datos de audio. Puedes configurar el resultado de la síntesis de voz de distintas maneras, como seleccionar una voz única o modular el resultado en tono, volumen, velocidad de habla y frecuencia de muestreo.

Copia el siguiente código en tu sesión de IPython:

import google.cloud.texttospeech as tts

def text_to_wav(voice_name: str, text: str):

language_code = "-".join(voice_name.split("-")[:2])

text_input = tts.SynthesisInput(text=text)

voice_params = tts.VoiceSelectionParams(

language_code=language_code, name=voice_name

)

audio_config = tts.AudioConfig(audio_encoding=tts.AudioEncoding.LINEAR16)

client = tts.TextToSpeechClient()

response = client.synthesize_speech(

input=text_input,

voice=voice_params,

audio_config=audio_config,

)

filename = f"{voice_name}.wav"

with open(filename, "wb") as out:

out.write(response.audio_content)

print(f'Generated speech saved to "{filename}"')

Dedica un momento a estudiar el código y observa cómo usa el método de la biblioteca cliente synthesize_speech para generar los datos de audio y guardarlos como un archivo wav.

Ahora, genera oraciones en diferentes acentos:

text_to_wav("en-AU-Neural2-A", "What is the temperature in Sydney?")

text_to_wav("en-GB-Neural2-B", "What is the temperature in London?")

text_to_wav("en-IN-Wavenet-C", "What is the temperature in Delhi?")

text_to_wav("en-US-Studio-O", "What is the temperature in New York?")

text_to_wav("fr-FR-Neural2-A", "Quelle est la température à Paris ?")

text_to_wav("fr-CA-Neural2-B", "Quelle est la température à Montréal ?")

Deberías ver algo como esto:

Generated speech saved to "en-AU-Neural2-A.wav" Generated speech saved to "en-GB-Neural2-B.wav" Generated speech saved to "en-IN-Wavenet-C.wav" Generated speech saved to "en-US-Studio-O.wav" Generated speech saved to "fr-FR-Neural2-A.wav" Generated speech saved to "fr-CA-Neural2-B.wav"

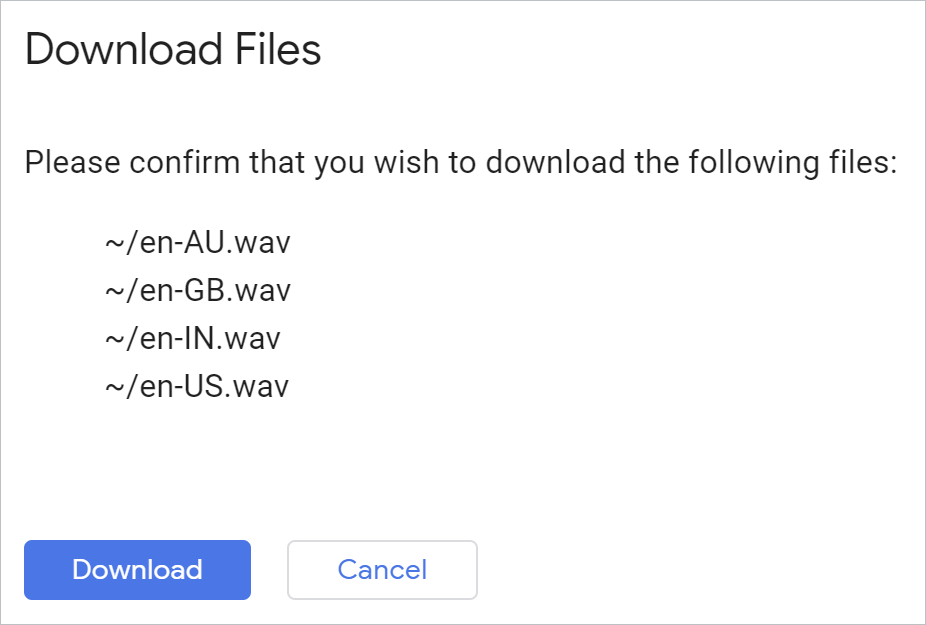

Para descargar todos los archivos generados a la vez, puedes usar este comando de Cloud Shell desde tu entorno de Python:

!cloudshell download *.wav

Valida y tu navegador descargará los archivos:

Abre cada archivo y escucha el resultado.

Resumen

En este paso, pudiste usar la API de Text-to-Speech para convertir oraciones en archivos de audio wav. Obtén más información para crear archivos de audio de voz.

7. ¡Felicitaciones!

Aprendiste a usar la API de Text-to-Speech con Python para generar voces similares a las humanas.

Limpia

Para limpiar tu entorno de desarrollo, sigue estos pasos desde Cloud Shell:

- Si aún estás en tu sesión de IPython, vuelve a la shell:

exit - Deja de usar el entorno virtual de Python:

deactivate - Borra la carpeta del entorno virtual:

cd ~ ; rm -rf ./venv-texttospeech

Para borrar tu proyecto de Google Cloud, desde Cloud Shell, haz lo siguiente:

- Recupera el ID del proyecto actual:

PROJECT_ID=$(gcloud config get-value core/project) - Asegúrate de que este sea el proyecto que quieres borrar:

echo $PROJECT_ID - Borra el proyecto:

gcloud projects delete $PROJECT_ID

Más información

- Prueba la demostración en tu navegador: https://cloud.google.com/text-to-speech

- Documentación de Text-to-Speech: https://cloud.google.com/text-to-speech/docs

- Python en Google Cloud: https://cloud.google.com/python

- Bibliotecas cliente de Cloud para Python: https://github.com/googleapis/google-cloud-python

Licencia

Este trabajo cuenta con una licencia Atribución 2.0 Genérica de Creative Commons.