1. Pengantar

Codelab ini adalah bagian dari seri dua bagian yang membahas cara membuat Agen GenAI yang Memahami Tata Kelola.

(Anda dapat membaca bagian pertama dari seri ini, yang membahas cara membuat fondasi data dengan menerapkan Aspek Dataplex ke tabel BigQuery dan menguji aturan secara lokal melalui Gemini CLI. 👉 Baca Bagian 1)

Namun, pengujian di CLI lokal baru permulaannya saja. Untuk meluncurkannya ke seluruh perusahaan, Anda memerlukan keamanan terpusat, koneksi alat AI standar, dan framework aplikasi yang tepat untuk mengorkestrasi logika agen dan menyediakan antarmuka chat yang sudah dikenal.

Di bagian kedua ini, Anda akan menyelesaikan tantangan ini dan melakukan penskalaan ke produksi. Anda akan men-deploy aturan tata kelola ke server MCP pusat yang dihosting di Cloud Run. Kemudian, Anda akan menggunakan Agent Development Kit (ADK) Google untuk membangun aplikasi agen yang sebenarnya dan menghubungkannya ke alat MCP Anda, lengkap dengan UI web profesional.

Prasyarat

- Project Google Cloud yang mengaktifkan penagihan.

- Pemahaman dasar tentang Cloud Run, Akun Layanan IAM, dan Python.

- Set data BigQuery dan Aspek Dataplex yang dibuat di Bagian 1. (Jangan khawatir jika Anda menghapusnya; kami menyediakan skrip jalur cepat di bawah untuk membuatnya kembali.)

Yang akan Anda pelajari

- Cara menggunakan Model Context Protocol (MCP) untuk menstandardisasi cara agen AI berinteraksi dengan data Google Cloud.

- Cara men-deploy server MCP yang aman ke Cloud Run.

- Cara membuat agen AI menggunakan Agent Development Kit (ADK) dan menghubungkannya ke backend MCP Anda.

- Cara menjalankan UI developer bawaan ADK untuk berinteraksi dengan agen yang diatur.

Yang Anda butuhkan

- Akses ke Google Cloud Shell

Konsep utama

- Model Context Protocol (MCP): Anggap MCP sebagai "kabel USB-C universal" untuk agen AI. Alih-alih menulis kode integrasi API kustom untuk setiap model AI, MCP menyediakan cara standar bagi AI untuk terhubung secara aman ke alat data perusahaan Anda (seperti Dataplex dan BigQuery).

- Agent Development Kit (ADK): Framework open source yang fleksibel dari Google yang dirancang untuk menyederhanakan pengembangan agen AI secara menyeluruh. Framework ini menerapkan prinsip rekayasa software pada pembuatan agen, sehingga Anda dapat mengatur alat yang kompleks, mengelola status, dan meluncurkan UI developer bawaan dengan mudah untuk pengujian dan deployment.

2. Penyiapan dan persyaratan

Mulai Cloud Shell

Meskipun Google Cloud dapat dioperasikan dari jarak jauh menggunakan laptop Anda, dalam codelab ini, Anda akan menggunakan Google Cloud Shell, lingkungan command line yang berjalan di Cloud.

Dari Google Cloud Console, klik ikon Cloud Shell di toolbar kanan atas:

Hanya perlu waktu beberapa saat untuk penyediaan dan terhubung ke lingkungan. Jika sudah selesai, Anda akan melihat tampilan seperti ini:

Mesin virtual ini berisi semua alat pengembangan yang Anda perlukan. Layanan ini menawarkan direktori beranda tetap sebesar 5 GB dan beroperasi di Google Cloud, sehingga sangat meningkatkan performa dan autentikasi jaringan. Semua pekerjaan Anda dalam codelab ini dapat dilakukan di browser. Anda tidak perlu menginstal apa pun.

Lakukan inisialisasi lingkungan

Buka Cloud Shell dan tetapkan variabel project Anda untuk memastikan semua perintah menargetkan infrastruktur yang benar.

export PROJECT_ID=$(gcloud config get-value project)

gcloud config set project $PROJECT_ID

export REGION="us-central1"

Checkpoint: Lanjutkan atau bangun ulang?

Karena ini adalah Bagian 2, agen Anda memerlukan data yang diatur dari Bagian 1 agar dapat berfungsi. Pilih jalur Anda:

Jalur A: Saya baru saja menyelesaikan Bagian 1 dan resource saya masih berjalan.

Bagus! Buka direktori kerja dan Anda siap melanjutkan.

cd ~/devrel-demos/data-analytics/governance-context

Jalur B: Saya melewati Bagian 1 ATAU Saya menghapus resource saya (Sudah dibersihkan).

Bukan masalah. Kami telah menyediakan blok perintah "Fast-Track" di bawah. Tindakan ini akan otomatis membangun ulang data lake BigQuery dan menerapkan metadata tata kelola Dataplex persis seperti yang kita lakukan di Bagian 1.

# 1. Clone the repo and navigate to the working directory

git clone --depth 1 --filter=blob:none --sparse https://github.com/GoogleCloudPlatform/devrel-demos.git

cd devrel-demos

git sparse-checkout set data-analytics/governance-context

cd data-analytics/governance-context

# 2. Rebuild the messy data lake with Terraform

cd terraform

terraform init

terraform apply -var="project_id=${PROJECT_ID}" -var="region=${REGION}" -auto-approve

# 3. Generate and apply Dataplex Aspects (Governance rules)

cd ..

chmod +x ./generate_payloads.sh ./apply_governance.sh

./generate_payloads.sh

./apply_governance.sh

3. Melakukan penskalaan dengan MCP: Membangun bidang kontrol data

Sejauh ini, Anda telah berhasil menguji logika tata kelola menggunakan Gemini CLI. Cara ini sangat baik untuk pembuatan prototipe cepat, tetapi berjalan secara lokal menggunakan kredensial pengguna pribadi Anda.

Dalam lingkungan perusahaan yang sebenarnya, Anda memerlukan bidang kontrol data terpusat. Untuk membangunnya, kita akan menggunakan GenAI Toolbox for Databases, sebuah project open source resmi dari Google. Toolbox ini menyediakan server MCP bawaan yang dirancang khusus untuk menghubungkan agen AI secara aman ke database dan layanan metadata Google Cloud seperti Dataplex.

Dengan men-deploy toolbox ini sebagai Server MCP kami di Cloud Run, kami mencapai:

- Identitas terpusat: Agen berjalan sebagai Akun Layanan yang dibatasi, bukan sebagai akun pengguna pribadi Anda.

- Standardisasi: Klien mana pun (ADK, Gemini, aplikasi kustom) dapat "terhubung" ke server ini menggunakan protokol MCP standar.

- Cakupan yang dikontrol (hak istimewa terendah): Kami tidak memberikan akses terbuka kepada LLM ke BigQuery. Kita memaksanya untuk membuka katalog metadata Dataplex terlebih dahulu.

Konfigurasi definisi alat (tools.yaml)

Toolbox GenAI memerlukan file konfigurasi deklaratif, tools.yaml. File ini menentukan sources (tempat terhubung) dan tools (tindakan yang diizinkan untuk AI).

- Buka direktori server dan masukkan Project ID Anda ke dalam file konfigurasi:

cd ~/devrel-demos/data-analytics/governance-context/mcp_server

envsubst < tools.yaml > tools.tmp && mv tools.tmp tools.yaml

cat tools.yaml

Hasilnya akan terlihat sama dengan cuplikan berikut. Verifikasi bahwa kolom project kini cocok dengan Project ID Google Cloud Anda yang sebenarnya.

sources:

dataplex:

kind: dataplex

project: YOUR-PROJECT-ID

tools:

search_entries:

kind: dataplex-search-entries

source: dataplex

description: Search for entries in Dataplex Catalog.

lookup_entry:

kind: dataplex-lookup-entry

source: dataplex

description: Retrieve a specific entry from Dataplex Catalog.

search_aspect_types:

kind: dataplex-search-aspect-types

source: dataplex

description: Find aspect types relevant to a query.

toolsets:

dataplex-toolset:

- search_entries

- lookup_entry

- search_aspect_types

Dengan menentukan ketiga alat ini, kita dapat memaksa AI menjadi "hanya baca" dan "mengutamakan tata kelola".

Mengamankan konfigurasi (Secret Manager)

Dalam arsitektur perusahaan, Anda tidak boleh menyertakan file konfigurasi secara langsung ke dalam image container. Kita akan menyimpan tools.yaml dengan aman di Google Cloud Secret Manager.

gcloud services enable secretmanager.googleapis.com

gcloud secrets create dataplex-tools-config --data-file=tools.yaml

Menerapkan Hak Istimewa Terendah (IAM)

Selanjutnya, kita akan membuat Akun Layanan khusus untuk server MCP GenAI Toolbox. Identitas ini hanya akan memiliki izin persis yang diperlukan untuk membaca katalog Dataplex dan mengakses data BigQuery.

export MCP_SA=mcp-sa

gcloud iam service-accounts create ${MCP_SA} \

--display-name="Service Account for Dataplex MCP"

export MCP_SERVICE_ACCOUNT="${MCP_SA}@${PROJECT_ID}.iam.gserviceaccount.com"

# Allow the server to read its own config from Secret Manager

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/secretmanager.secretAccessor"

# Allow the server to read Dataplex Metadata and BigQuery Data

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/dataplex.catalogViewer"

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/bigquery.dataViewer"

Men-deploy server MCP ke Cloud Run

Sekarang, kita men-deploy Toolbox GenAI. Kita menggunakan image container bawaan Google (database-toolbox/toolbox) dan memasang konfigurasi dari Secret Manager (--set-secrets) saat runtime.

export IMAGE=us-central1-docker.pkg.dev/database-toolbox/toolbox/toolbox:latest

gcloud run deploy governance-mcp \

--image=$IMAGE \

--service-account $MCP_SERVICE_ACCOUNT \

--region=$REGION \

--no-allow-unauthenticated \

--set-secrets="/app/tools.yaml=dataplex-tools-config:latest" \

--args="--tools-file=/app/tools.yaml","--address=0.0.0.0","--port=8080"

Anda kini telah membuat API yang diatur. Alih-alih memberikan akses database langsung ke frontend GenAI, frontend tersebut akan terhubung ke URL Cloud Run ini. Agen hanya dapat melihat apa yang diizinkan oleh Kotak Alat ini.

4. Membangun backend agen dengan ADK

Anda telah membuat Data Control Plane (MCP) yang aman dan dikelola yang berjalan di Cloud Run. Sekarang, agen AI Anda memerlukan framework untuk mengorkestrasi logikanya, seperti memproses input pengguna, memutuskan kapan harus memanggil server MCP, dan memformat output.

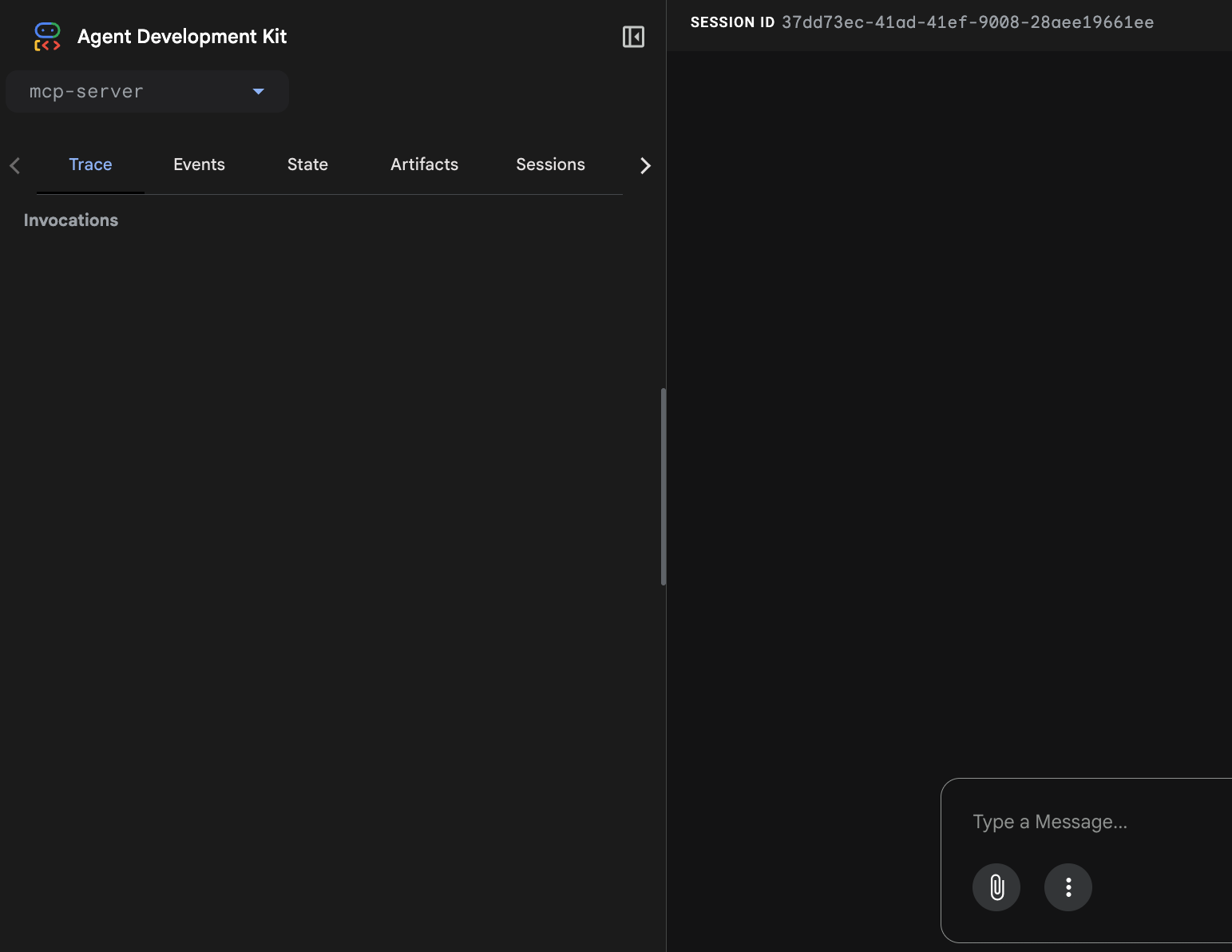

Daripada menulis semua kode boilerplate ini dari awal, kita akan menggunakan Agent Development Kit (ADK) Google. ADK adalah framework berbasis kode yang secara otomatis membungkus logika agen Anda ke dalam backend FastAPI. Selain itu, alat ini dilengkapi dengan UI developer bawaan, sehingga Anda dapat langsung memvisualisasikan proses penalaran dan panggilan alat agen tanpa membuat frontend kustom terlebih dahulu.

Periksa Logika Agen (agent.py)

Sebelum mengonfigurasi infrastruktur, mari kita lihat inti aplikasi ini.

Buka direktori dan keluarkan konten agent.py. File ini adalah "otak" deployment ADK Anda.

cd ~/devrel-demos/data-analytics/governance-context/mcp_server

cat agent.py

Lihat struktur kodenya. Library ini menjalankan tiga fungsi penting dengan boilerplate minimal:

- Integrasi MCPToolset: Daripada menulis klien HTTP kustom untuk berinteraksi dengan alat Dataplex, ADK menggunakan

MCPToolset(server_url=mcp_url). Tindakan ini secara dinamis mengambil definisitools.yamldari server MCP yang di-deploy dan menerjemahkannya ke dalam panggilan fungsi native untuk LLM. - Petunjuk Sistem: Parameter

instructionsberisi aturan tata kelola yang ketat (logika yang sama dengan yang kami gunakan di CLIGEMINI.md). Parameter ini secara eksplisit memerintahkan model untuk menjalankan loop penalaran Fase 1 (Pencarian metadata) ke Fase 2 (Kueri data). - Orkestrasi Agen: Class

Agent(...)mengikat model Gemini, perintah sistem, dan alat MCP secara bersamaan. Saat di-deploy, ADK akan otomatis mengonversi objek ini menjadi endpoint FastAPI yang skalabel.

Pemisahan tugas: Mengonfigurasi identitas frontend

Untuk menjalankan kode ini dengan aman, kita harus memberi tahu agen lokasi server MCP Anda. Kita akan membuat URL secara dinamis dan menyimpannya ke file .env yang akan dibaca ADK saat runtime.

Kita juga akan membuat identitas terpisah (dataplex-agent-sa) untuk aplikasi yang ditampilkan kepada pengguna ini. Pemisahan tugas ini memastikan bahwa agen frontend memiliki izin yang berbeda dengan server tata kelola backend.

Jalankan perintah berikut untuk mengonfigurasi lingkungan dan identitas:

export PROJECT_NUMBER=$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")

export MCP_SERVER_URL=https://governance-mcp-${PROJECT_NUMBER}.${REGION}.run.app/mcp

export AGENT_SA=dataplex-agent-sa

export AGENT_SERVICE_ACCOUNT="${AGENT_SA}@${PROJECT_ID}.iam.gserviceaccount.com"

gcloud iam service-accounts create ${AGENT_SA} \

--display-name="Service Account for Dataplex Agent "

Mengonfigurasi Variabel Runtime

Framework ADK mengandalkan variabel lingkungan untuk memahami konteksnya. Kita harus menetapkan Project ID, Region, dan mengaktifkan penggunaan Vertex AI secara eksplisit. Kita menambahkan ini ke file .env yang sama.

echo MCP_SERVER_URL=$MCP_SERVER_URL > .env

echo GOOGLE_GENAI_USE_VERTEXAI=1 >> .env

echo GOOGLE_CLOUD_PROJECT=$PROJECT_ID >> .env

echo GOOGLE_CLOUD_LOCATION=$REGION >> .env

Memberikan Izin

Meskipun mendelegasikan pemeriksaan tata kelola ke server MCP, agen tetap memerlukan izin dasar untuk beroperasi. Kita memberikan tepat dua peran:

- Pengguna Vertex AI: Untuk memanggil model Gemini dalam menghasilkan respons bahasa alami.

- Cloud Run Invoker: Untuk memanggil MCP Server API Anda secara aman. Pengguna tidak mendapatkan akses langsung ke BigQuery atau Dataplex.

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/aiplatform.user"

gcloud run services add-iam-policy-binding governance-mcp \

--region=$REGION \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/run.invoker"

Deploy ke Cloud Run

Terakhir, kita men-deploy stack penuh ke Cloud Run.

Kita menggunakan uvx untuk menjalankan alat ADK tanpa menginstal dependensi secara manual. Perintah di bawah ini mengemas logika agent.py Anda, membangun image container, menyuntikkan Akun Layanan Anda, dan meluncurkan server FastAPI. Dengan menambahkan tanda --with_ui, ADK Web Playground juga akan di-bundle untuk proses debug.

Perintah ini membangun container dan men-deploy-nya. Proses ini mungkin memerlukan waktu 1-3 menit.

uvx --from google-adk \

adk deploy cloud_run \

--project=$PROJECT_ID \

--region=$REGION \

--service_name=dataplex-agent \

--with_ui \

. \

-- \

--service-account=$AGENT_SERVICE_ACCOUNT \

--allow-unauthenticated

Setelah perintah ini selesai, perintah akan menampilkan Service URL (e.g., https://dataplex-agent-xyz.run.app). Klik link tersebut untuk membuka Antarmuka Chat AI Generatif yang sepenuhnya diatur.

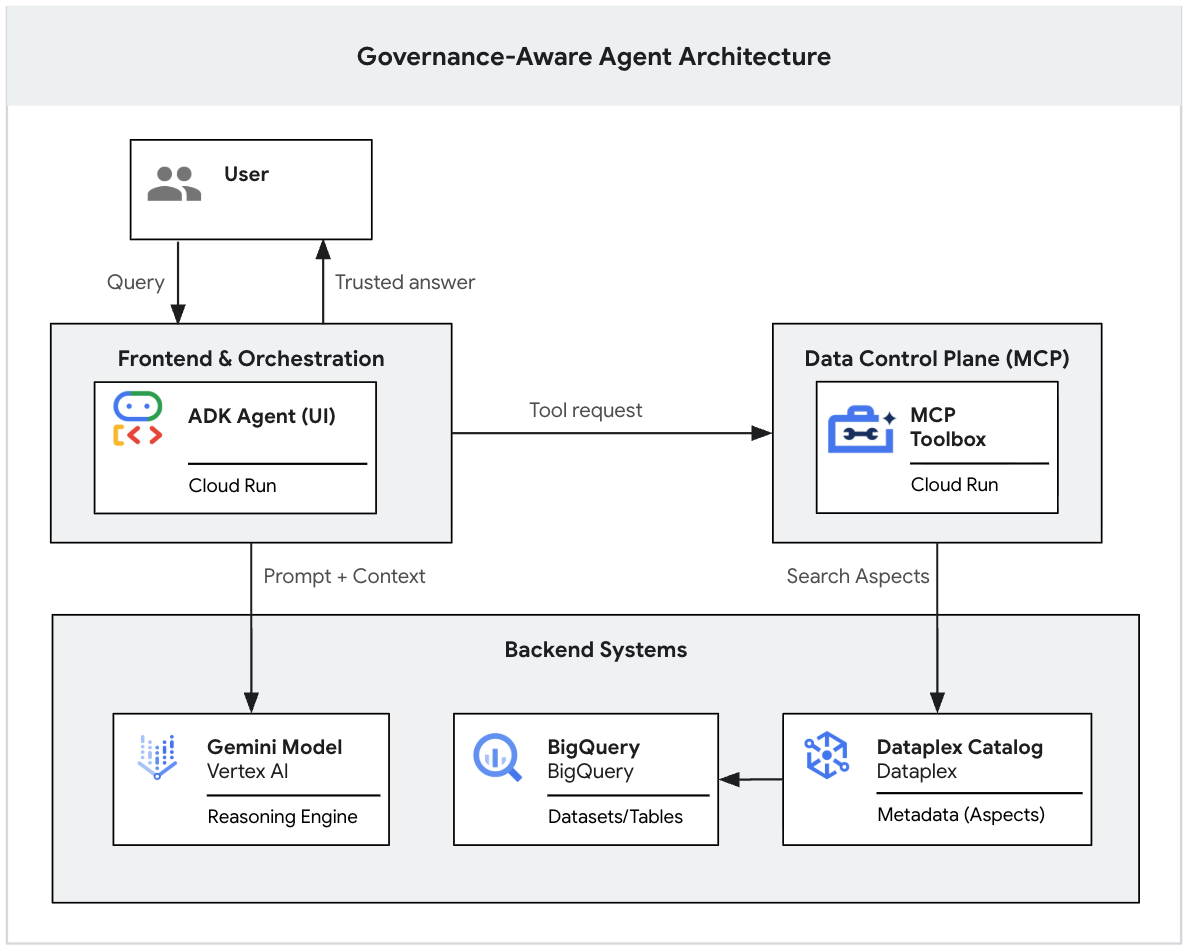

Alur Arsitektur End-to-End

Anda telah menyelesaikan sistem. Saat pengguna berinteraksi dengan UI ADK, urutan berikut terjadi:

- Pengguna mengirimkan perintah di Agen ADK (UI Dev).

- Agen ADK (agent.py) memproses input dan memanggil model Gemini.

- Gemini menentukan bahwa ia memerlukan konteks dan meminta Server MCP untuk menjalankan alat Dataplex.

- Server MCP menerapkan aturan Tata Kelola Dataplex dan menampilkan metadata.

- Gemini menyintesis jawaban tepercaya berdasarkan metadata dan menampilkannya kepada pengguna.

5. Menguji Agen Perusahaan

Setelah agen Anda aktif, mari kita tinjau kembali skenario tata kelola yang diuji sebelumnya dengan CLI. Logikanya tetap sama, tetapi sekarang Anda berinteraksi dengan ADK Web Playground yang di-deploy, yang memvisualisasikan status internal dan eksekusi alat.

- Orkestrasi: Agen ADK (yang berjalan di Cloud Run) menerima teks Anda.

- Perutean Alat: Gemini mengenali bahwa pertanyaan Anda memerlukan konteks data dan meneruskan permintaan ke Server MCP.

- Pemeriksaan Tata Kelola: Server MCP (yang berjalan di instance Cloud Run terpisah) membuat kueri Dataplex untuk Jenis Aspek tertentu.

- Sintesis: Metadata yang relevan dikembalikan ke Gemini untuk membuat jawaban akhir.

Memverifikasi Logika Tata Kelola

Buka URL Layanan yang Anda buat di langkah sebelumnya (e.g., https://dataplex-agent-xyz.run.app) di browser Anda. Tempelkan perintah berikut:

"My dashboard needs to show what's happening right now with our ad spend. I can't wait for the overnight load. What do you recommend?"

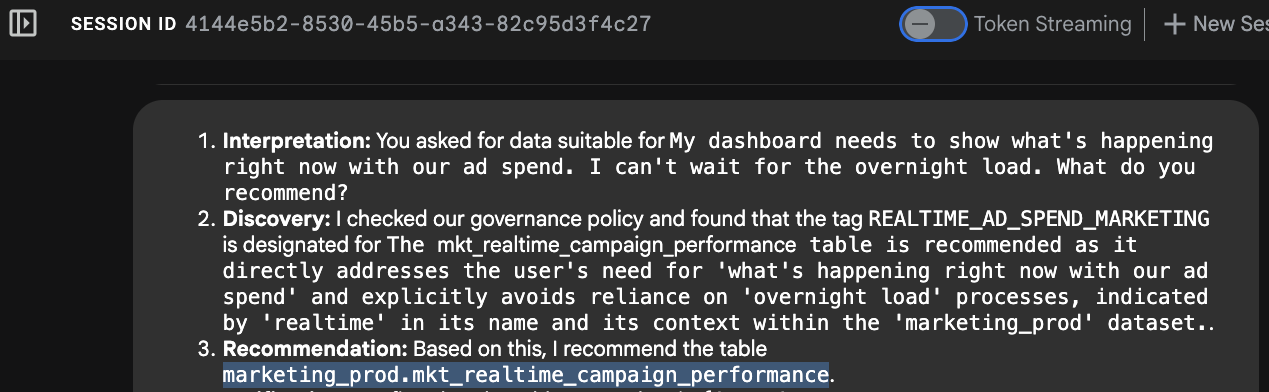

Amati proses penalaran Agen di UI developer:

- Pengenalan Maksud (Intent Recognition): Agen mengurai "sekarang" dan "tidak sabar menunggu semalaman".

- Pencarian Metadata: Memanggil alat MCP

search_aspect_types. Layanan ini mencari aset data yang Aspekupdate_frequency-nya disetel ke REALTIME atau STREAMING, bukan DAILY atau MONTHLY. - Pemilihan: Pemilihan mengidentifikasi bahwa tabel

mkt_realtime_campaign_performancememenuhi kriteria ini, sedangkanfin_monthly_closing_internal(meskipun berkualitas tinggi) terlalu lambat untuk permintaan Anda. - Respons: Agen merekomendasikan tabel real-time.

Mengapa hal ini penting:

Tanpa metadata tata kelola ini, LLM kemungkinan akan merekomendasikan tabel fin_monthly_closing_internal hanya karena memiliki kolom bernama "ad_spend", dan mengabaikan fakta bahwa data tersebut sudah berusia 24 jam. Konteks metadata Anda mencegah terjadinya error bisnis.

Anda juga dapat menguji perintah "Rapat Dewan" untuk melihat cara agen melakukan pivot ke tabel yang berbeda berdasarkan aspek Tingkat Produk Data:

"We are preparing the deck for an internal Board of Directors meeting next week. I need the numbers to be absolutely finalized, trustworthy, and kept strictly confidential. Which table is safe to use?"

6. Pembersihan

Agar tidak menimbulkan biaya pada akun Google Cloud Anda untuk resource yang digunakan dalam codelab ini, ikuti langkah-langkah berikut untuk menghancurkan semua infrastruktur yang dibuat di Bagian 1 dan Bagian 2.

Menghancurkan Datalake (Terraform)

Gunakan Terraform untuk menghapus tabel, set data, dan definisi Aspek Dataplex BigQuery.

cd ~/devrel-demos/data-analytics/governance-context/terraform

terraform destroy -var="project_id=${PROJECT_ID}" -var="region=${REGION}" -auto-approve

Menghapus layanan Cloud Run

Hapus resource komputasi untuk menghentikan penagihan aktif untuk container yang sedang berjalan.

gcloud run services delete governance-mcp --region=$REGION --quiet

gcloud run services delete dataplex-agent --region=$REGION --quiet

Membersihkan artefak build dan penyimpanan penyiapan

Saat Anda men-deploy agen ADK menggunakan uvx, sistem akan otomatis membuat image container dan mengupload kode sumber Anda ke bucket Cloud Storage sementara. Artefak ini tetap ada meskipun layanan Cloud Run dihapus dan akan menimbulkan biaya penyimpanan berkelanjutan.

Hapus repositori Artifact Registry dan bucket staging Cloud Storage:

# Delete the repository used for the agent build

gcloud artifacts repositories delete cloud-run-source-deploy \

--location=$REGION \

--quiet

# Delete the staging bucket created by Cloud Run source deploy

gcloud storage rm --recursive gs://run-sources-${PROJECT_ID}-${REGION}

Menghapus identitas, izin, dan rahasia

Hapus binding kebijakan IAM terlebih dahulu untuk mencegah entri "tanda nisan" (catatan yang tidak memiliki induk) tetap ada di halaman IAM project Anda. Kemudian, hapus Akun Layanan dan secret konfigurasi.

# Remove IAM roles granted to the MCP Service Account

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/secretmanager.secretAccessor" --quiet

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/dataplex.catalogViewer" --quiet

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/bigquery.dataViewer" --quiet

# Remove IAM roles granted to the Agent Service Account

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/aiplatform.user" --quiet

# Delete the Service Accounts

gcloud iam service-accounts delete $MCP_SERVICE_ACCOUNT --quiet

gcloud iam service-accounts delete $AGENT_SERVICE_ACCOUNT --quiet

# Delete the Secret Manager entry

gcloud secrets delete dataplex-tools-config --quiet

Menghapus konfigurasi lokal

Terakhir, hapus file konfigurasi lokal dan variabel lingkungan di Cloud Shell.

# Uninstall the Gemini CLI extension (installed in Part 1)

gemini extensions uninstall dataplex

# Remove local repository files and unset variables

cd ~

rm -rf ~/devrel-demos

unset MCP_SERVER_URL

unset MCP_SERVICE_ACCOUNT

unset AGENT_SERVICE_ACCOUNT

7. Selamat!

Anda telah berhasil men-deploy Agen AI Generatif yang sadar tata kelola dan menyeluruh.

Dalam codelab dua bagian ini, Anda telah melampaui rekayasa perintah sederhana untuk menerapkan arsitektur yang kuat dan siap produksi. Dengan memperlakukan tata kelola data sebagai prasyarat untuk GenAI, Anda menetapkan metode sistematis untuk mencegah model mengambil data yang tidak bersertifikasi atau berhalusinasi.

Poin-Poin Penting

- AI Deterministik melalui Metadata: Daripada mengandalkan LLM untuk menebak tabel yang benar berdasarkan nama kolom, Anda menerapkan loop penalaran yang ketat menggunakan GenAI Toolbox for Databases. Dengan secara eksplisit hanya mengekspos tiga alat Dataplex (

search_aspect_types,search_entries,lookup_entry), Anda memaksa model untuk memverifikasi sertifikasi data sebelum menyintesis jawaban. - Arsitektur yang Tidak Terikat (MCP): Dengan men-deploy server Model Context Protocol (MCP) di Cloud Run, Anda mengabstraksi aturan tata kelola data ke dalam API terpusat dan terstandarisasi. Agen frontend tidak perlu berisi logika database; agen ini hanya perlu berkomunikasi melalui standar MCP. Artinya, Anda dapat menghubungkan model atau klien AI apa pun di masa mendatang ke backend yang sama dan diatur.

- Pemisahan Tugas: Anda menerapkan prinsip hak istimewa terendah dengan mengisolasi identitas IAM. Agen ADK yang berinteraksi dengan pengguna beroperasi dengan izin yang dibatasi untuk pemanggilan model dan perutean API, sementara server MCP backend menangani kueri katalog Dataplex dan pengambilan data BigQuery dengan aman.

- Pengaturan Agen dengan Kode Terlebih Dahulu: Anda menggunakan Google Agent Development Kit (ADK) untuk langsung membungkus logika agen Python Anda ke dalam backend FastAPI yang skalabel, menggunakan UI developer bawaannya untuk memvisualisasikan dan men-debug eksekusi alat internal agen.

Apa Selanjutnya?

- Codelab Tata Kelola Dasar Dataplex: Kuasai dasar-dasar tata kelola data di Dataplex sebelum menambahkan lapisan AI.

- Dokumentasi Alat Dataplex: Jelajahi dokumentasi resmi untuk alat dan ekstensi Dataplex bawaan yang digunakan dalam lab ini.

- Mulai Menggunakan Ekstensi Gemini CLI: Pelajari cara membuat ekstensi kustom Anda sendiri untuk memberikan lebih banyak kemampuan kepada agen GenAI Anda.

- Pembahasan Mendalam tentang MCP: Lihat spesifikasi MCP resmi untuk memahami cara membangun server kustom untuk API perusahaan internal Anda.