1. Wprowadzenie

To ćwiczenie jest częścią dwuczęściowej serii, w której pokazujemy, jak tworzyć agenta generatywnej AI uwzględniającego zasady.

(Pierwszą część tej serii, która opisuje, jak stworzyć podstawy danych, stosując aspekty Dataplex do tabel BigQuery i testując reguły lokalnie za pomocą interfejsu wiersza poleceń Gemini, znajdziesz tutaj. 👉 Przeczytaj część 1

Testowanie w lokalnym interfejsie CLI to jednak dopiero początek. Aby wdrożyć to rozwiązanie w całej firmie, potrzebujesz scentralizowanego zabezpieczenia, standardowych połączeń z narzędziami AI i odpowiednich ram aplikacji do koordynowania logiki agenta i zapewniania znanego interfejsu czatu.

W tej drugiej części rozwiążesz te problemy i skalujesz rozwiązanie do środowiska produkcyjnego. Reguły zarządzania wdrożysz na centralnym serwerze MCP hostowanym w Cloud Run. Następnie za pomocą pakietu Agent Development Kit (ADK) od Google utworzysz aplikację agenta i połączysz ją z narzędziami MCP, a także dodasz profesjonalny interfejs internetowy.

Wymagania wstępne

- Projekt Google Cloud z włączonymi płatnościami.

- Podstawowa wiedza o Cloud Run, kontach usługi IAM i Pythonie.

- Zbiory danych BigQuery i aspekty Dataplex utworzone w części 1. (Nie martw się, jeśli je usuniesz. Poniżej znajdziesz skrypt, który pozwoli Ci je szybko odtworzyć).

Czego się nauczysz

- Jak używać protokołu Model Context Protocol (MCP) do standaryzacji interakcji agentów AI z danymi Google Cloud.

- Jak wdrożyć bezpieczny serwer MCP w Cloud Run.

- Jak utworzyć agenta AI za pomocą pakietu Agent Development Kit (ADK) i połączyć go z backendem MCP.

- Jak uruchomić wbudowany interfejs deweloperski ADK, aby wchodzić w interakcję z zarządzanym agentem.

Czego potrzebujesz

- Dostęp do Google Cloud Shell

Kluczowe pojęcia

- Model Context Protocol (MCP): MCP to „uniwersalny kabel USB-C” dla agentów AI. Zamiast pisać niestandardowy kod integracji interfejsu API dla każdego modelu AI, MCP zapewnia standardowy sposób bezpiecznego łączenia AI z narzędziami do danych w Twojej firmie (takimi jak Dataplex i BigQuery).

- Pakiet Agent Development Kit (ADK): elastyczna platforma open source od Google zaprojektowana z myślą o uproszczeniu kompleksowego procesu tworzenia agentów AI. Stosuje zasady inżynierii oprogramowania do tworzenia agentów, co pozwala koordynować złożone narzędzia, zarządzać stanem i łatwo uruchamiać wbudowany interfejs programisty do testowania i wdrażania.

2. Konfiguracja i wymagania

Uruchom Cloud Shell

Z Google Cloud można korzystać zdalnie na laptopie, ale w tym ćwiczeniu użyjesz Google Cloud Shell, czyli środowiska wiersza poleceń działającego w chmurze.

W konsoli Google Cloud kliknij ikonę Cloud Shell na pasku narzędzi w prawym górnym rogu:

Uzyskanie dostępu do środowiska i połączenie się z nim powinno zająć tylko kilka chwil. Po zakończeniu powinno wyświetlić się coś takiego:

Ta maszyna wirtualna zawiera wszystkie potrzebne narzędzia dla programistów. Zawiera również stały katalog domowy o pojemności 5 GB i działa w Google Cloud, co znacznie zwiększa wydajność sieci i usprawnia proces uwierzytelniania. Wszystkie zadania w tym laboratorium możesz wykonać w przeglądarce. Nie musisz niczego instalować.

Inicjowanie środowiska

Otwórz Cloud Shell i ustaw zmienne projektu, aby mieć pewność, że wszystkie polecenia są kierowane do prawidłowej infrastruktury.

export PROJECT_ID=$(gcloud config get-value project)

gcloud config set project $PROJECT_ID

export REGION="us-central1"

Punkt kontrolny: wznowić czy odbudować?

To jest część 2, więc agent potrzebuje danych podlegających kontroli z części 1, aby działać. Wybierz ścieżkę:

Ścieżka A: Ukończyłem(-am) część 1, a moje zasoby nadal działają.

Świetnie. Przejdź do katalogu roboczego i możesz kontynuować.

cd ~/devrel-demos/data-analytics/governance-context

Ścieżka B: pominięto część 1 LUB usunięto zasoby (wyczyszczono).

Żaden problem. Poniżej znajdziesz blok poleceń „Szybka ścieżka”. Spowoduje to automatyczne ponowne utworzenie jeziora danych BigQuery i zastosowanie metadanych zarządzania Dataplex dokładnie tak, jak w części 1.

# 1. Clone the repo and navigate to the working directory

git clone --depth 1 --filter=blob:none --sparse https://github.com/GoogleCloudPlatform/devrel-demos.git

cd devrel-demos

git sparse-checkout set data-analytics/governance-context

cd data-analytics/governance-context

# 2. Rebuild the messy data lake with Terraform

cd terraform

terraform init

terraform apply -var="project_id=${PROJECT_ID}" -var="region=${REGION}" -auto-approve

# 3. Generate and apply Dataplex Aspects (Governance rules)

cd ..

chmod +x ./generate_payloads.sh ./apply_governance.sh

./generate_payloads.sh

./apply_governance.sh

3. Skalowanie za pomocą protokołu MCP: tworzenie platformy sterującej danymi

Do tej pory udało Ci się przetestować logikę zarządzania za pomocą interfejsu wiersza poleceń Gemini. Jest to doskonałe rozwiązanie do szybkiego tworzenia prototypów, ale działa lokalnie przy użyciu Twoich osobistych danych logowania.

W prawdziwym środowisku przedsiębiorstwa potrzebujesz scentralizowanej platformy sterującej danymi. Aby to zrobić, użyjemy zestawu narzędzi generatywnej AI dla baz danych, oficjalnego projektu open source Google. Ten zestaw narzędzi zawiera gotowy serwer MCP zaprojektowany specjalnie do bezpiecznego łączenia agentów AI z bazami danych Google Cloud i usługami metadanych, takimi jak Dataplex.

Dzięki wdrożeniu tego zestawu narzędzi jako serwera MCP w Cloud Run uzyskujemy:

- Scentralizowana tożsamość: agent działa jako ograniczone konto usługi, a nie jako Twoje osobiste konto użytkownika.

- Standaryzacja: każdy klient (ADK, Gemini, aplikacje niestandardowe) może „podłączyć się” do tego serwera za pomocą standardowego protokołu MCP.

- Kontrolowany zakres (najmniejsze uprawnienia): nie przyznajemy LLM nieograniczonego dostępu do BigQuery. Wymuszamy najpierw przejście przez katalog metadanych Dataplex.

Skonfiguruj definicję narzędzia (tools.yaml)

Zestaw narzędzi generatywnej AI wymaga deklaratywnego pliku konfiguracyjnego tools.yaml. Ten plik określa sources (miejsce połączenia) i tools (co może robić AI).

- Przejdź do katalogu serwera i wstaw identyfikator projektu do pliku konfiguracji:

cd ~/devrel-demos/data-analytics/governance-context/mcp_server

envsubst < tools.yaml > tools.tmp && mv tools.tmp tools.yaml

cat tools.yaml

Powinien wyglądać identycznie jak poniższy fragment kodu. Sprawdź, czy pole projektu jest zgodne z rzeczywistym identyfikatorem projektu Google Cloud.

sources:

dataplex:

kind: dataplex

project: YOUR-PROJECT-ID

tools:

search_entries:

kind: dataplex-search-entries

source: dataplex

description: Search for entries in Dataplex Catalog.

lookup_entry:

kind: dataplex-lookup-entry

source: dataplex

description: Retrieve a specific entry from Dataplex Catalog.

search_aspect_types:

kind: dataplex-search-aspect-types

source: dataplex

description: Find aspect types relevant to a query.

toolsets:

dataplex-toolset:

- search_entries

- lookup_entry

- search_aspect_types

Definiując te 3 narzędzia, możemy wymusić na AI tryb „tylko do odczytu” i „najpierw zarządzanie”.

Zabezpieczanie konfiguracji (Secret Manager)

W architekturze przedsiębiorstwa nigdy nie należy umieszczać plików konfiguracyjnych bezpośrednio w obrazach kontenerów. Będziemy bezpiecznie przechowywać tools.yaml w usłudze Google Cloud Secret Manager.

gcloud services enable secretmanager.googleapis.com

gcloud secrets create dataplex-tools-config --data-file=tools.yaml

Wdrażanie zasady najmniejszych uprawnień (IAM)

Następnie tworzymy dedykowane konto usługi dla serwera MCP GenAI Toolbox. Ta tożsamość będzie mieć tylko uprawnienia wymagane do odczytywania katalogu Dataplex i dostępu do danych BigQuery.

export MCP_SA=mcp-sa

gcloud iam service-accounts create ${MCP_SA} \

--display-name="Service Account for Dataplex MCP"

export MCP_SERVICE_ACCOUNT="${MCP_SA}@${PROJECT_ID}.iam.gserviceaccount.com"

# Allow the server to read its own config from Secret Manager

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/secretmanager.secretAccessor"

# Allow the server to read Dataplex Metadata and BigQuery Data

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/dataplex.catalogViewer"

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/bigquery.dataViewer"

Wdróż serwer MCP w Cloud Run

Teraz wdrażamy zestaw narzędzi generatywnej AI. Używamy wstępnie utworzonego obrazu kontenera Google (database-toolbox/toolbox) i w czasie działania montujemy naszą konfigurację z Secret Manager (--set-secrets).

export IMAGE=us-central1-docker.pkg.dev/database-toolbox/toolbox/toolbox:latest

gcloud run deploy governance-mcp \

--image=$IMAGE \

--service-account $MCP_SERVICE_ACCOUNT \

--region=$REGION \

--no-allow-unauthenticated \

--set-secrets="/app/tools.yaml=dataplex-tools-config:latest" \

--args="--tools-file=/app/tools.yaml","--address=0.0.0.0","--port=8080"

Udało Ci się utworzyć zarządzany interfejs API. Zamiast przyznawać interfejsowi generatywnej AI bezpośredni dostęp do bazy danych, połącz go z tym adresem URL Cloud Run. Agent może widzieć tylko to, na co pozwala mu ten zestaw narzędzi.

4. Tworzenie backendu agenta za pomocą pakietu ADK

Masz już bezpieczną, zarządzaną platformę sterującą danymi (MCP) działającą w Cloud Run. Teraz agent AI potrzebuje platformy do koordynowania swojej logiki, np. przetwarzania danych wejściowych użytkownika, decydowania, kiedy wywołać serwer MCP, i formatowania danych wyjściowych.

Zamiast pisać cały ten powtarzalny kod od zera, użyjemy pakietu Agent Development Kit (ADK) od Google. ADK to platforma oparta na kodzie, która automatycznie opakowuje logikę agenta w backendzie FastAPI. Zawiera też wbudowany interfejs programisty, który umożliwia natychmiastowe wizualizowanie procesu rozumowania agenta i wywołań narzędzi bez konieczności tworzenia niestandardowego interfejsu.

Sprawdź logikę agenta (agent.py)

Zanim skonfigurujemy infrastrukturę, przyjrzyjmy się podstawom tej aplikacji.

Przejdź do katalogu i wyświetl zawartość pliku agent.py. Ten plik to „mózg” wdrożenia ADK.

cd ~/devrel-demos/data-analytics/governance-context/mcp_server

cat agent.py

Sprawdź strukturę kodu. Wykonuje 3 kluczowe funkcje przy minimalnej ilości kodu:

- Integracja z MCPToolset: zamiast pisać niestandardowe klienty HTTP do interakcji z narzędziami Dataplex pakiet ADK używa

MCPToolset(server_url=mcp_url). Dynamicznie pobiera definicjętools.yamlz wdrożonego serwera MCP i tłumaczy ją na natywne wywołania funkcji dla LLM. - Instrukcje systemowe: parametr

instructionszawiera ścisłe reguły zarządzania (tę samą logikę, której użyliśmy w interfejsie CLIGEMINI.md). Wyraźnie nakazuje on modelowi wykonanie pętli rozumowania od fazy 1 (wyszukiwanie metadanych) do fazy 2 (zapytanie o dane). - Aranżacja agentów: klasa

Agent(...)łączy model Gemini, prompt systemowy i narzędzia MCP. Po wdrożeniu ADK automatycznie przekształca ten obiekt w skalowalny punkt końcowy FastAPI.

Podział obowiązków: konfigurowanie tożsamości frontendu

Aby bezpiecznie uruchomić ten kod, musimy poinformować agenta, gdzie znajduje się serwer MCP. Adres URL zostanie utworzony dynamicznie i zapisany w pliku .env, który pakiet ADK odczyta w czasie działania.

Utworzymy też osobną tożsamość (dataplex-agent-sa) dla tej aplikacji przeznaczonej dla użytkowników. Ten podział obowiązków zapewnia, że agent frontendu ma inne uprawnienia niż serwer zarządzania backendem.

Aby skonfigurować środowisko i tożsamość, uruchom te polecenia:

export PROJECT_NUMBER=$(gcloud projects describe $PROJECT_ID --format="value(projectNumber)")

export MCP_SERVER_URL=https://governance-mcp-${PROJECT_NUMBER}.${REGION}.run.app/mcp

export AGENT_SA=dataplex-agent-sa

export AGENT_SERVICE_ACCOUNT="${AGENT_SA}@${PROJECT_ID}.iam.gserviceaccount.com"

gcloud iam service-accounts create ${AGENT_SA} \

--display-name="Service Account for Dataplex Agent "

Konfigurowanie zmiennych czasu działania

Platforma ADK korzysta ze zmiennych środowiskowych, aby zrozumieć swój kontekst. Musimy wyraźnie ustawić identyfikator projektu i region oraz włączyć korzystanie z Vertex AI. Dołączamy je do tego samego pliku .env.

echo MCP_SERVER_URL=$MCP_SERVER_URL > .env

echo GOOGLE_GENAI_USE_VERTEXAI=1 >> .env

echo GOOGLE_CLOUD_PROJECT=$PROJECT_ID >> .env

echo GOOGLE_CLOUD_LOCATION=$REGION >> .env

Przyznawanie uprawnień

Mimo że agent deleguje sprawdzanie zasad na serwer MCP, nadal potrzebuje podstawowych uprawnień do działania. Przyznajemy dokładnie 2 role:

- Użytkownik Vertex AI: do wywoływania modelu Gemini w celu generowania odpowiedzi w języku naturalnym.

- Wywołujący Cloud Run:do bezpiecznego wywoływania interfejsu MCP Server API. Nie ma bezpośredniego dostępu do BigQuery ani Dataplex.

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/aiplatform.user"

gcloud run services add-iam-policy-binding governance-mcp \

--region=$REGION \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/run.invoker"

Wdróż w Cloud Run

Na koniec wdrażamy pełną aplikację w Cloud Run.

Używamy uvx, aby uruchomić narzędzie ADK bez ręcznego instalowania zależności. Poniższe polecenie pakuje logikę agent.py, tworzy obraz kontenera, wstrzykuje konto usługi i uruchamia serwer FastAPI. Dodanie flagi --with_ui powoduje też dołączenie środowiska testowego ADK Web Playground do debugowania.

To polecenie tworzy kontener i go wdraża. Może to potrwać 1–3 minuty.

uvx --from google-adk \

adk deploy cloud_run \

--project=$PROJECT_ID \

--region=$REGION \

--service_name=dataplex-agent \

--with_ui \

. \

-- \

--service-account=$AGENT_SERVICE_ACCOUNT \

--allow-unauthenticated

Po wykonaniu tego polecenia zostanie wyświetlony adres URL usługi (e.g., https://dataplex-agent-xyz.run.app). Kliknij ten link, aby otworzyć w pełni zarządzany interfejs czatu GenAI.

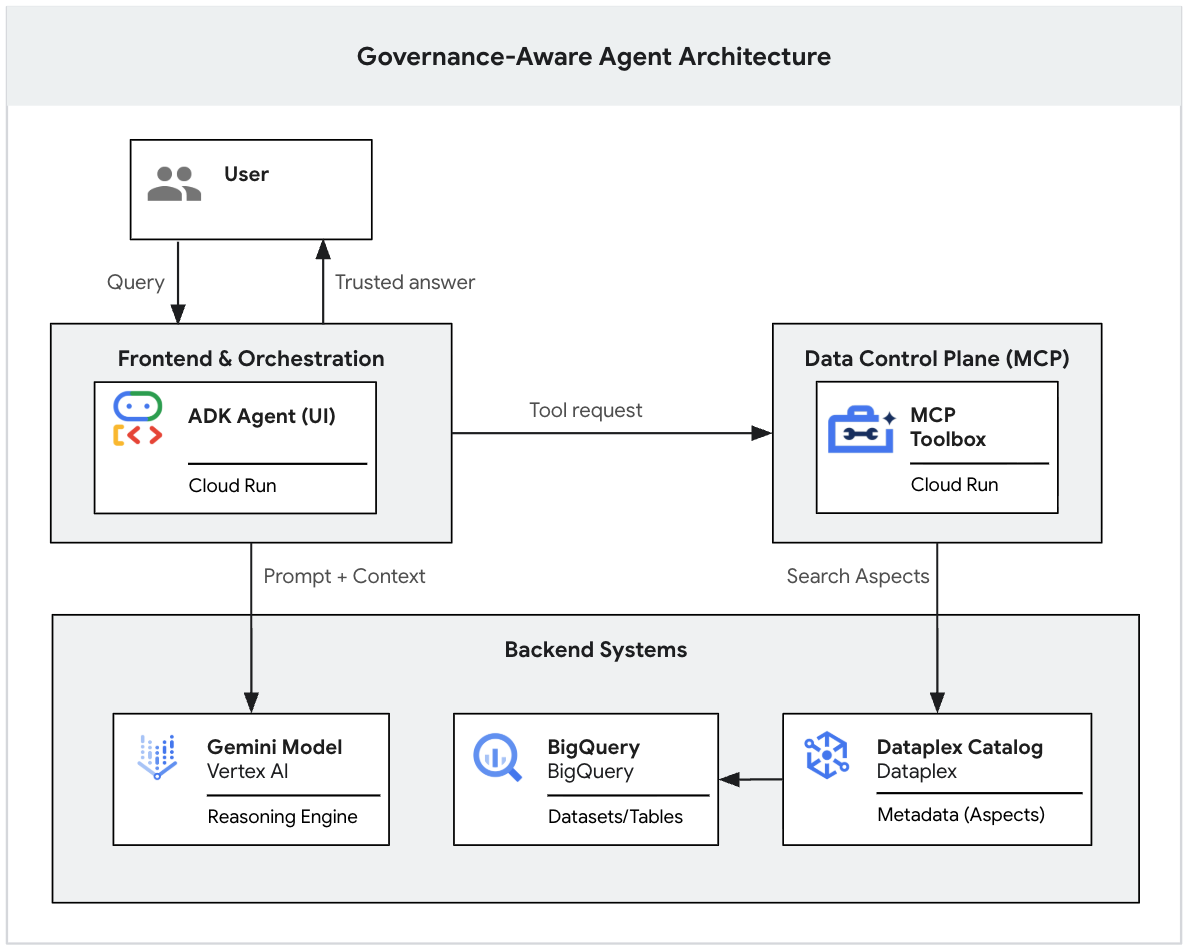

Architektura kompleksowa

System został ukończony. Gdy użytkownik wchodzi w interakcję z interfejsem ADK, następuje ta sekwencja:

- Użytkownik przesyła prompt w agencie ADK (interfejs deweloperski).

- Agent ADK (agent.py) przetwarza dane wejściowe i wywołuje model Gemini.

- Gemini stwierdza, że potrzebuje kontekstu, i prosi serwer MCP o wykonanie narzędzi Dataplex.

- Serwer MCP egzekwuje reguły zarządzania Dataplex i zwraca metadane.

- Gemini na podstawie metadanych tworzy wiarygodną odpowiedź i przesyła ją do użytkownika.

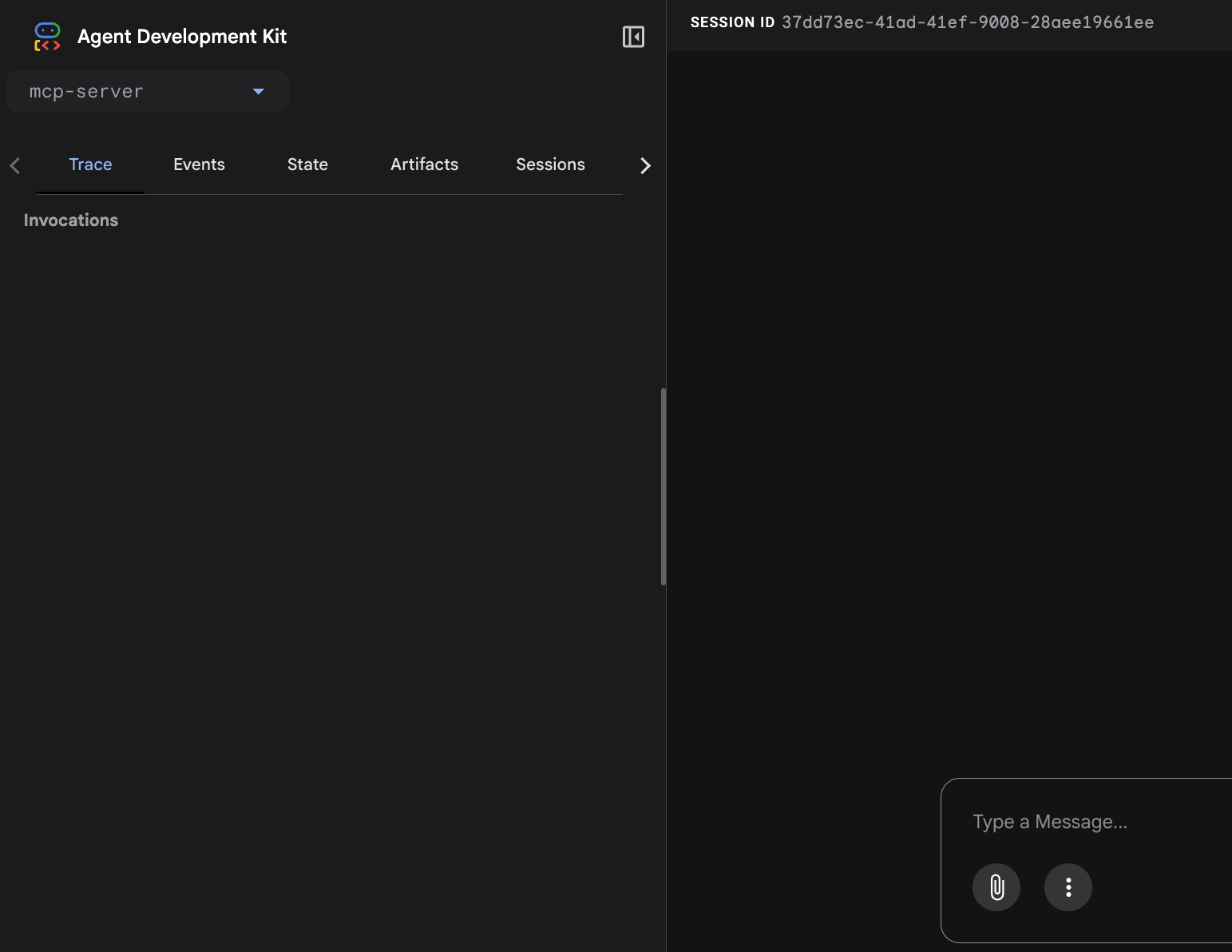

5. Testowanie agenta Enterprise

Po uruchomieniu agenta wróćmy do scenariuszy zarządzania, które były wcześniej testowane za pomocą interfejsu CLI. Logika pozostaje taka sama, ale teraz korzystasz z wdrożonego środowiska testowego ADK Web Playground, które wizualizuje stan wewnętrzny i wykonywanie narzędzi.

- Orkiestracja: agent ADK (działający w Cloud Run) otrzymuje Twój tekst.

- Routing narzędzi: Gemini rozpoznaje, że Twoje pytanie wymaga kontekstu danych, i przekazuje żądanie do serwera MCP.

- Sprawdzanie zarządzania: serwer MCP (działający w osobnej instancji Cloud Run) wysyła do Dataplex zapytania o określone typy aspektów.

- Synteza: odpowiednie metadane są zwracane do Gemini, aby wygenerować ostateczną odpowiedź.

Sprawdzanie logiki zarządzania

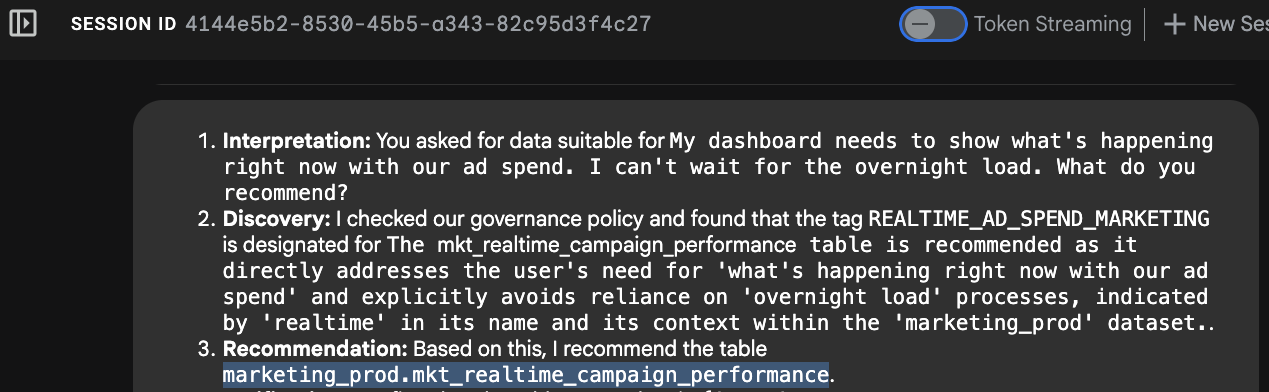

Otwórz w przeglądarce adres URL usługi wygenerowany w poprzednim kroku (e.g., https://dataplex-agent-xyz.run.app). Wklej ten prompt:

"My dashboard needs to show what's happening right now with our ad spend. I can't wait for the overnight load. What do you recommend?"

Obserwuj proces rozumowania agenta w interfejsie dewelopera:

- Rozpoznawanie intencji: agent analizuje wyrażenia „teraz” i „nie mogę czekać do jutra”.

- Wyszukiwanie metadanych: wywołuje narzędzie MCP

search_aspect_types. Wyszukuje zasoby danych, w którychupdate_frequencyaspekt jest ustawiony na REALTIME lub STREAMING, a nie DAILY lub MONTHLY. - Wybór: stwierdza, że tabela

mkt_realtime_campaign_performancespełnia te kryteria, a tabelafin_monthly_closing_internal(mimo że jest wysokiej jakości) działa zbyt wolno, aby można było jej użyć w odpowiedzi na Twoje żądanie. - Odpowiedź: agent poleca tabelę w czasie rzeczywistym.

Dlaczego to jest ważne:

Bez tych metadanych zarządzania LLM prawdopodobnie poleciłby tabelę fin_monthly_closing_internal tylko dlatego, że ma ona kolumnę o nazwie „ad_spend”, ignorując fakt, że dane są sprzed 24 godzin. Kontekst metadanych zapobiegł wystąpieniu błędu biznesowego.

Możesz też przetestować prompt „Board Meeting”, aby sprawdzić, jak agent przełącza się między różnymi tabelami na podstawie aspektu poziomu usługi danych:

"We are preparing the deck for an internal Board of Directors meeting next week. I need the numbers to be absolutely finalized, trustworthy, and kept strictly confidential. Which table is safe to use?"

6. Czyszczenie danych

Aby uniknąć obciążenia konta Google Cloud opłatami za zasoby użyte w tym laboratorium, wykonaj te czynności, aby zniszczyć całą infrastrukturę utworzoną w części 1 i części 2.

Usuwanie jeziora danych (Terraform)

Użyj Terraform, aby usunąć tabele i zbiory danych BigQuery oraz definicje aspektów Dataplex.

cd ~/devrel-demos/data-analytics/governance-context/terraform

terraform destroy -var="project_id=${PROJECT_ID}" -var="region=${REGION}" -auto-approve

Usuwanie usług Cloud Run

Usuń zasoby obliczeniowe, aby zatrzymać aktywne rozliczenia za uruchomione kontenery.

gcloud run services delete governance-mcp --region=$REGION --quiet

gcloud run services delete dataplex-agent --region=$REGION --quiet

Zwalnianie miejsca zajmowanego przez artefakty kompilacji i pamięć tymczasową

Gdy wdrożysz agenta ADK za pomocą uvx, system automatycznie skompiluje obraz kontenera i prześle kod źródłowy do tymczasowego zasobnika Cloud Storage. Te artefakty pozostają w systemie nawet po usunięciu usługi Cloud Run i generują bieżące koszty przechowywania.

Usuń repozytorium Artifact Registry i zasobnik przejściowy Cloud Storage:

# Delete the repository used for the agent build

gcloud artifacts repositories delete cloud-run-source-deploy \

--location=$REGION \

--quiet

# Delete the staging bucket created by Cloud Run source deploy

gcloud storage rm --recursive gs://run-sources-${PROJECT_ID}-${REGION}

Usuwanie tożsamości, uprawnień i tajnych kodów

Najpierw usuń powiązania zasad uprawnień, aby zapobiec pozostawieniu w projekcie wpisów „tombstone” (osieroconych rekordów). Następnie usuń konta usługi i tajne dane konfiguracyjne.

# Remove IAM roles granted to the MCP Service Account

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/secretmanager.secretAccessor" --quiet

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/dataplex.catalogViewer" --quiet

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$MCP_SERVICE_ACCOUNT" \

--role="roles/bigquery.dataViewer" --quiet

# Remove IAM roles granted to the Agent Service Account

gcloud projects remove-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$AGENT_SERVICE_ACCOUNT" \

--role="roles/aiplatform.user" --quiet

# Delete the Service Accounts

gcloud iam service-accounts delete $MCP_SERVICE_ACCOUNT --quiet

gcloud iam service-accounts delete $AGENT_SERVICE_ACCOUNT --quiet

# Delete the Secret Manager entry

gcloud secrets delete dataplex-tools-config --quiet

Usuwanie konfiguracji lokalnej

Na koniec zwalniaj miejsce w lokalnych plikach konfiguracyjnych i zmiennych środowiskowych w Cloud Shell.

# Uninstall the Gemini CLI extension (installed in Part 1)

gemini extensions uninstall dataplex

# Remove local repository files and unset variables

cd ~

rm -rf ~/devrel-demos

unset MCP_SERVER_URL

unset MCP_SERVICE_ACCOUNT

unset AGENT_SERVICE_ACCOUNT

7. Gratulacje!

Udało Ci się wdrożyć kompleksowego agenta GenAI z uwzględnieniem zasad zarządzania.

W tym dwuczęściowym ćwiczeniu wyszliśmy poza proste inżynierowanie promptów, aby wdrożyć solidną architekturę gotową do użytku produkcyjnego. Traktując zarządzanie danymi jako warunek wstępny korzystania z generatywnej AI, firma stworzyła systematyczną metodę zapobiegania pobieraniu przez model niecertyfikowanych lub wygenerowanych przez niego danych.

Podsumowanie

- Deterministyczna AI za pomocą metadanych: zamiast polegać na tym, że LLM zgadnie prawidłową tabelę na podstawie nazw kolumn, zastosowano ścisłą pętlę rozumowania za pomocą zestawu narzędzi generatywnej AI dla baz danych. Wyraźnie udostępniając tylko 3 narzędzia Dataplex (

search_aspect_types,search_entries,lookup_entry), wymuszasz na modelu weryfikację certyfikatów danych przed syntezą odpowiedzi. - Architektura rozdzielona (MCP): wdrażając serwer protokołu Model Context Protocol (MCP) w Cloud Run, wyodrębnisz reguły zarządzania danymi do scentralizowanego, standardowego interfejsu API. Agent interfejsu nie musi zawierać logiki bazy danych. Wystarczy, że będzie komunikować się zgodnie ze standardem MCP. Oznacza to, że w przyszłości do tego samego zarządzanego backendu będzie można podłączyć dowolny model AI lub klienta.

- Rozdzielenie obowiązków: zastosowano zasadę jak najmniejszych uprawnień przez odizolowanie tożsamości IAM. Agent pakietu ADK, z którego korzysta użytkownik, ma uprawnienia ograniczone do wywoływania modelu i routingu interfejsu API, a serwer MCP backendu bezpiecznie obsługuje zapytania do katalogu Dataplex i pobieranie danych BigQuery.

- Orkiestracja agentów oparta na kodzie: za pomocą pakietu Google Agent Development Kit (ADK) możesz natychmiast przekształcić logikę agenta w Pythonie w skalowalny backend FastAPI, korzystając z wbudowanego interfejsu programisty do wizualizacji i debugowania wewnętrznych wykonań narzędzi agenta.

Co dalej?

- Laboratorium Dataplex Foundational Governance: opanuj podstawy zarządzania danymi w Dataplex, zanim dodasz warstwę AI.

- Dokumentacja narzędzi Dataplex: zapoznaj się z oficjalną dokumentacją gotowych narzędzi i rozszerzeń Dataplex używanych w tym module.

- Pierwsze kroki z dodatkami do interfejsu wiersza poleceń Gemini: dowiedz się, jak tworzyć własne niestandardowe dodatki, aby zwiększyć możliwości agentów generatywnej AI.

- Szczegółowe informacje o MCP: zapoznaj się z oficjalną specyfikacją MCP, aby dowiedzieć się, jak tworzyć niestandardowe serwery dla wewnętrznych interfejsów API Twojej firmy.